Comprendre la tarification de Cloudflare AI Gateway [Présentation complète]

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Cloudflare AI Gateway est souvent le premier outil que les équipes d'ingénierie utilisent lorsqu'elles ont besoin d'intégrer l'observabilité à leur trafic LLM. C'est logique : vous placez un proxy entre votre application et OpenAI, et tout à coup, vous avez des journaux et une mise en cache sans écrire de service middleware personnalisé.

Cependant, si le « démarrage gratuit » permet une rapidité immédiate, l'économie de l'ingénierie évolue souvent à mesure que vous passez à la production. Bien que la passerelle soit commercialisée avec un niveau gratuit généreux, le coût total de possession (TCO) des charges de travail d'entreprise va au-delà des frais de passerelle. Le profil de coût complet inclut les services connexes que vous consommez, en particulier Cloudflare Workers, le stockage permanent des journaux et la mise à l'échelle du volume des demandes.

Cet article décrit les aspects économiques de l'ingénierie de Cloudflare AI Gateway. Nous examinerons ce pour quoi vous payez explicitement, les variables opérationnelles qui ont un impact sur l'échelle et les raisons pour lesquelles les entreprises migrent souvent vers des alternatives privées intégrées au VPC, comme Truefoundry lorsqu'elles passent du « prototype » à la « production ».

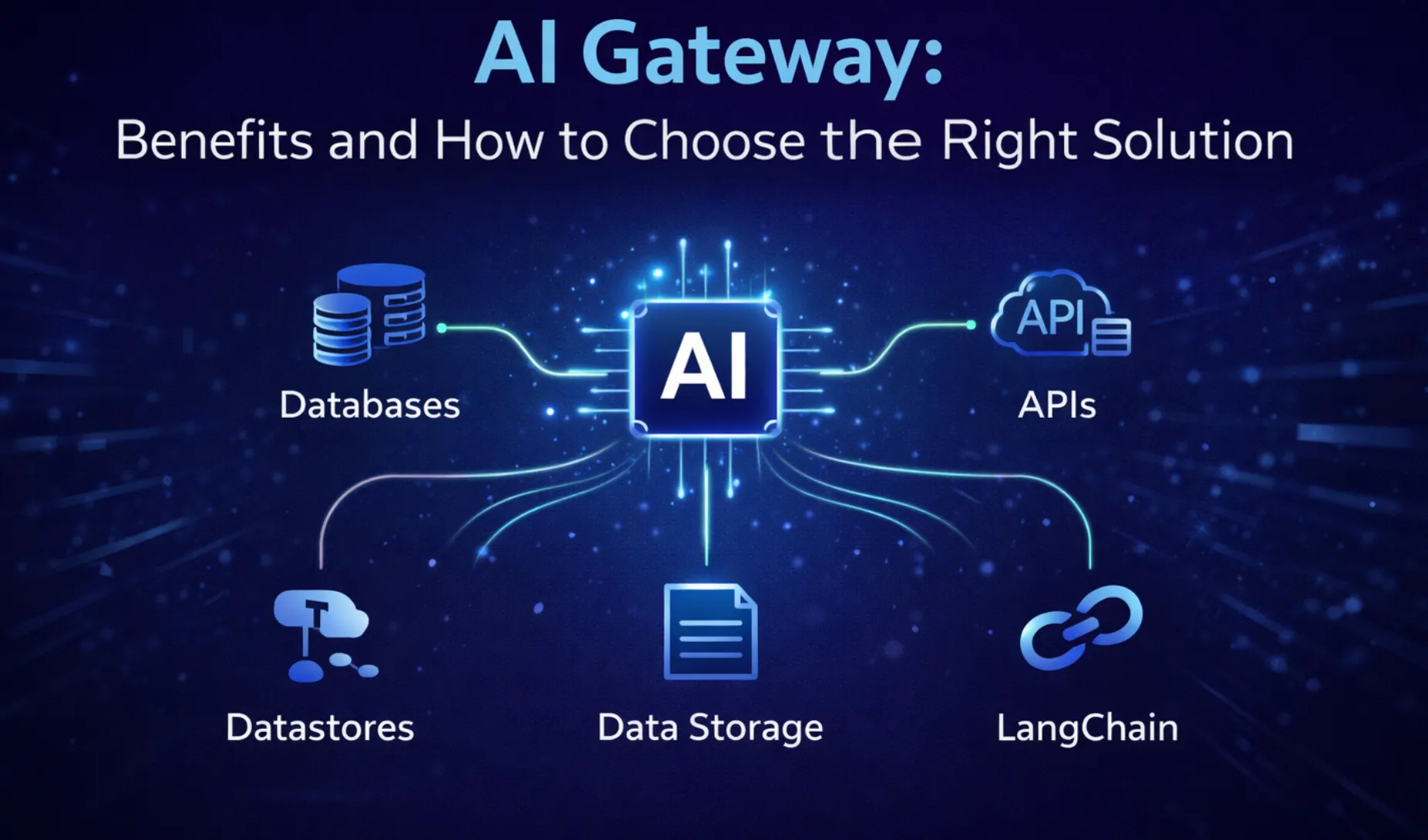

Qu'est-ce que Cloudflare AI Gateway ?

Pour comprendre le projet de loi, il faut comprendre son architecture. Cloudflare AI Gateway fonctionne comme un proxy inverse centralisé situé à la périphérie, interceptant les demandes d'API RESTful entre votre backend et vos fournisseurs LLM.

Il n'héberge pas de modèles lui-même. Il fournit la « tuyauterie » nécessaire à l'observabilité et au contrôle. Sa mission principale est la suivante :

- Gestion du trafic : Gérez la logique des nouvelles tentatives et la limitation du débit pour que votre application n'ait pas à le faire.

- Observabilité : Inspecter les charges utiles pour enregistrer les invites, les réponses et les en-têtes d'utilisation des jetons.

- Intégration de l'écosystème : Surtout, il fonctionne sur le runtime Cloudflare Workers. Il s'agit du détail le plus important pour la tarification, car il partage l'infrastructure et les limites de facturation des fonctions sans serveur standard.

Fonctionnalités de Cloudflare AI Gateway qui ont un impact sur les prix

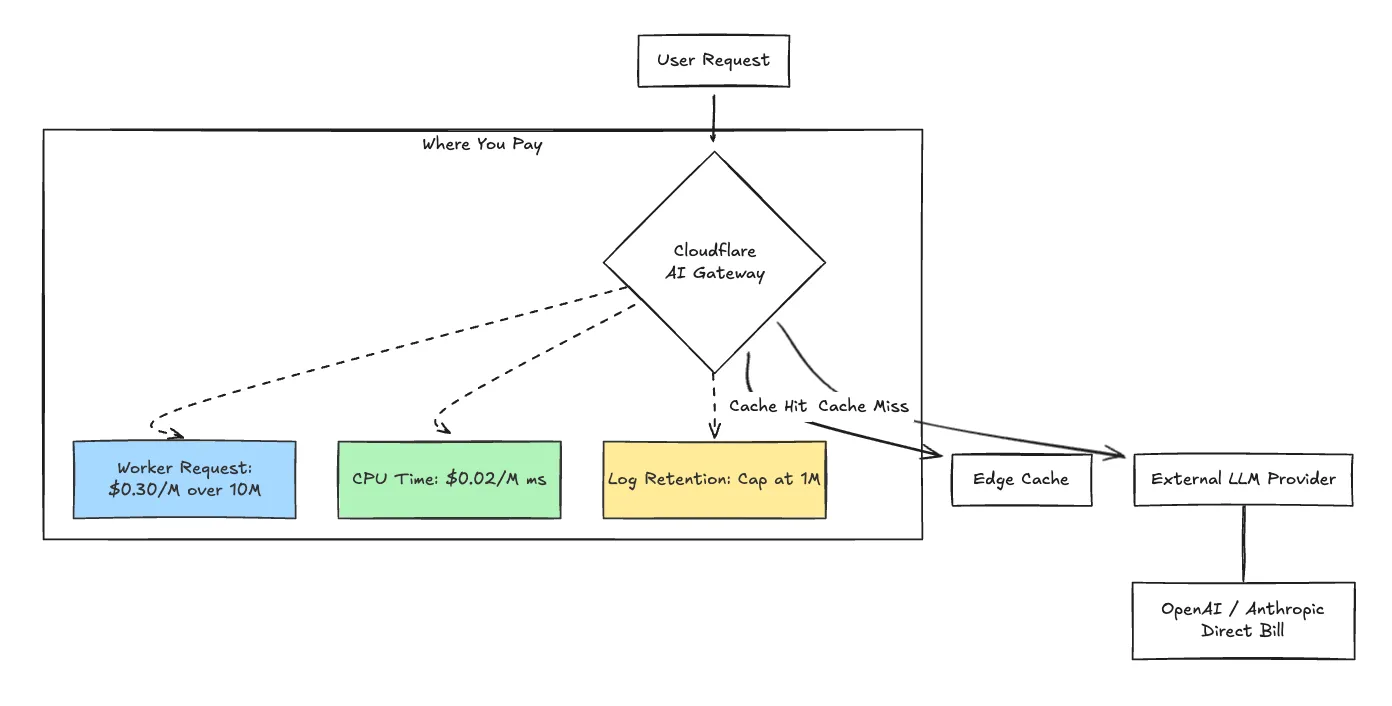

Cloudflare ne facture actuellement pas de majoration « par jeton ». Vous payez le même montant à OpenAI, que vous le fassiez directement ou via Cloudflare. Les coûts apparaissent dans l'utilisation de l'infrastructure et dans les limites de fonctionnalités qui vous orientent vers les niveaux supérieurs.

Routage des demandes et limitation de débit

Chaque appel d'API qui atteint la passerelle est considéré comme une « demande » sur la plateforme Cloudflare Workers sous-jacente.

Si vous créez un outil interne à faible volume, cela est négligeable. Mais si vous créez une boucle d'agents automatisée ou un chatbot orienté client à fort trafic, les calculs changent. Un agent qui crée une boucle récursive de 10 à 20 appels pour répondre à une seule demande utilisateur peut rapidement consommer des quotas de demandes standard. Vous ne payez pas pour l'IA ; vous payez pour les requêtes HTTP adressées au proxy.

Mise en cache des réponses et des réponses

La mise en cache est le principal argument de retour sur investissement en faveur de l'utilisation d'une passerelle. Si vous pouvez envoyer une réponse depuis la périphérie de Cloudflare, vous économisez de l'argent sur le fournisseur LLM en amont.

Cependant, la hausse financière est très variable dans ce domaine. Cela dépend entièrement de votre taux d'accès au cache.

- Retour sur investissement élevé : Des robots du service client répondent à la question « Comment réinitialiser mon mot de passe ? » (Répétition élevée).

- Faible retour sur investissement : Les applications RAG interrogent des documents uniques ou analysent des données utilisateur spécifiques.

Si votre application repose sur des fenêtres contextuelles uniques, la mise en cache ne réduira pas votre facture en amont, mais vous devrez tout de même payer des frais pour le routage des demandes.

Analyse de l'utilisation et journalisation

Il s'agit généralement de la fonction de forçage pour les mises à niveau. La journalisation persistante consomme de l'espace de stockage. Cloudflare impose des limites au nombre de journaux que vous pouvez conserver sur son tableau de bord. Lorsque vous atteignez ce plafond, la journalisation s'interrompt, vous laissant sans visibilité pendant le reste de la période de facturation, sauf si vous effectuez une mise à niveau. À terme, les volumes d'entreprise peuvent nécessiter la configuration de Logpush pour envoyer les données vers votre propre stockage, ce qui entraîne un ensemble de frais différent en fonction du volume de données.

Intégration de plusieurs fournisseurs

Le routage vers plusieurs fournisseurs (par exemple, le basculement d'OpenAI vers Anthropic) n'entraîne pas de supplément, mais complique l'attribution des coûts. Vous regroupez les coûts d'Azure, Bedrock et OpenAI en un seul flux. La passerelle normalise les rapports, mais la facturation reste généralement directe avec ces fournisseurs.

Répartition des tarifs de Cloudflare AI Gateway

La tarification n'est pas un élément autonome ; elle fonctionne comme une rubrique d'un abonnement Cloudflare Workers.

Le niveau gratuit (standard)

Ceci est optimisé pour les hackathons et les développeurs individuels. C'est 0$, mais les limites opérationnelles sont généralement adaptées aux tests plutôt qu'aux SLA de production.

- Coût : 0$ par mois.

- Limite de journalisation : 100 000 journaux/mois. Remarque : Une fois cette limite atteinte, l'enregistrement s'arrête.

- Limite de demandes : 100 000 demandes par jour.

- Verdict : Excellent pour le prototypage ; nécessite des mises à niveau pour garantir la fiabilité de la production.

Le niveau de rémunération (travailleurs rémunérés)

Si vous êtes une entreprise, c'est votre point de départ.

- Coût : À partir de 5$ par mois.

- Limite de journalisation : 1 000 000 logs/mois.

- Calcul inclus : 10 millions de requêtes et 30 millions de millisecondes de processeur.

(Source : https://www.cloudflare.com/plans/developer-platform/)

L'excédent :

- 0,30$ par million de demandes supplémentaires.

- 0,02$ par million de millisecondes de processeur supplémentaires.

Figure 1 : Flux logique et architecture de facturation

Variables opérationnelles ayant un impact sur l'échelle

Les frais de base de 5$ par mois constituent un point d'entrée intéressant car ils couvrent strictement l'accès à l'infrastructure. Cependant, le coût total de possession des entreprises nécessite la prise en compte de l'ensemble de l'infrastructure, en particulier lors de l'intégration dans un environnement sécurisé et conforme.

1. Frais généraux de conformité et de sécurité

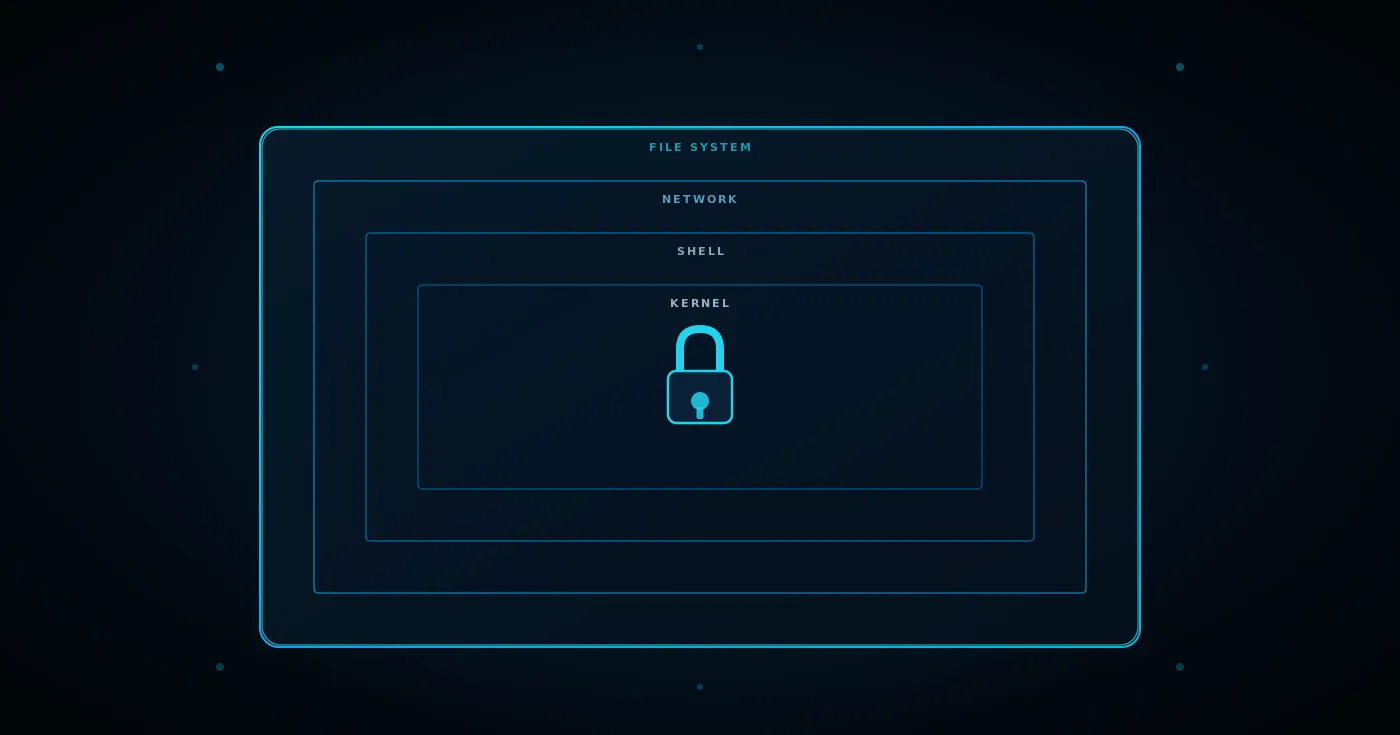

Cloudflare est une solution SaaS. Le plan de données, où se trouvent les instructions et les informations d'identification personnelle, se trouve sur leurs serveurs, et non sur les vôtres. Les données sensibles de vos clients doivent quitter votre VPC, transiter par l'Internet public (via des tunnels cryptés), être traitées par Cloudflare, puis être transférées vers le LLM.

Pour une société de technologie financière ou de santé, cette architecture déclenche souvent une évaluation des risques par un tiers. Le coût n'est pas uniquement lié à l'abonnement ; il s'agit des frais opérationnels liés aux révisions d'InfoSec, à la négociation des addendums relatifs au traitement des données (DPA) et à l'achat éventuel de modules complémentaires de sécurité d'entreprise pour répondre aux exigences de résidence des données.

2. Stratégie de conservation des journaux

La limite de 1 million de journaux sur le forfait payant couvre le débogage immédiat, mais la conformité à long terme exige davantage. Cloudflare ne conserve pas ces journaux indéfiniment.

Pour les cas d'utilisation nécessitant des pistes d'audit à long terme (par exemple, 7 ans), le stockage natif de la passerelle doit souvent être complété par des exportations externes. Vous devrez peut-être payer pour exporter des journaux via Logpush vers un bucket S3 ou Splunk.

- Les frais Logpush : Les 10 millions de premières demandes sont gratuites. Ensuite, des frais s'appliquent (par exemple, 0,05$ par million de demandes) pour transférer les données, plus vos propres coûts de stockage dans le cloud.

3. Contraintes de routage SaaS gérées

Lorsque vous utilisez un routeur SaaS géré, vous acceptez la logique d'infrastructure du fournisseur. Cela peut limiter les stratégies complexes d'arbitrage des coûts, telles que le routage du trafic vers un modèle privé hébergé sur des instances Spot au sein de votre propre AWS VPC pour économiser sur le calcul. Vous travaillez dans le cadre de la logique de routage prise en charge par la plateforme SaaS, ce qui peut limiter votre capacité à concevoir des économies d'unités inférieures spécifiques.

Quand la tarification de Cloudflare AI Gateway prend tout son sens

C'est l'outil idéal pour des tâches spécifiques :

- Applications Edge Native : Si l'ensemble de votre stack se trouve déjà sur Cloudflare Workers/Pages, il s'agit d'une solution naturelle. L'intégration est instantanée.

- Startups avant de générer des revenus : Si vos dépenses totales en IA sont inférieures à 500$ par mois, les frais de 5$ sont très compétitifs. Vous n'avez pas encore besoin d'une gouvernance complexe ; vous avez besoin de rapidité.

- POC : Si vous devez valider une chaîne d'invite aujourd'hui, vous pouvez le faire sans configurer Kubernetes Ingress.

Pourquoi certaines équipes vont au-delà de Cloudflare AI Gateway

Au fur et à mesure que vous évoluez, la priorité passe souvent de la « facilité de configuration » au « contrôle des données ».

Dimensionnement des coûts par rapport à la prévisibilité

La tarification basée sur la consommation est linéaire. Le paiement par demande (plus le processeur et les exportations de journaux) crée une facture variable qui augmente en fonction de votre trafic. À un certain niveau, le paiement d'une passerelle à coût fixe exécutée sur vos propres instances réservées permet souvent de réduire les coûts unitaires.

Conformité et résidence des données

C'est souvent le facteur décisif. De nombreux contrats d'entreprise stipulent que les données des utilisateurs ne doivent jamais quitter une région AWS ou un VPC spécifique. Une passerelle SaaS est structurellement incompatible avec cette topologie. Si vous avez besoin de souveraineté des données, vous avez besoin d'un plan de données auto-hébergé ou intégré au VPC.

Exigences d'orchestration avancées

Les pipelines RAG d'entreprise sont complexes. Vous pourriez avoir besoin d'une expression régulière de masquage des PII personnalisée qui s'exécute avant que l'invite ne quitte votre réseau, ou d'une logique de basculement complexe qui achemine vers un modèle Llama 3 local en cas d'expiration du délai d'OpenAI. L'exécuter dans un environnement SaaS partagé peut être restrictif par rapport à l'exécution de votre propre conteneur de passerelle.

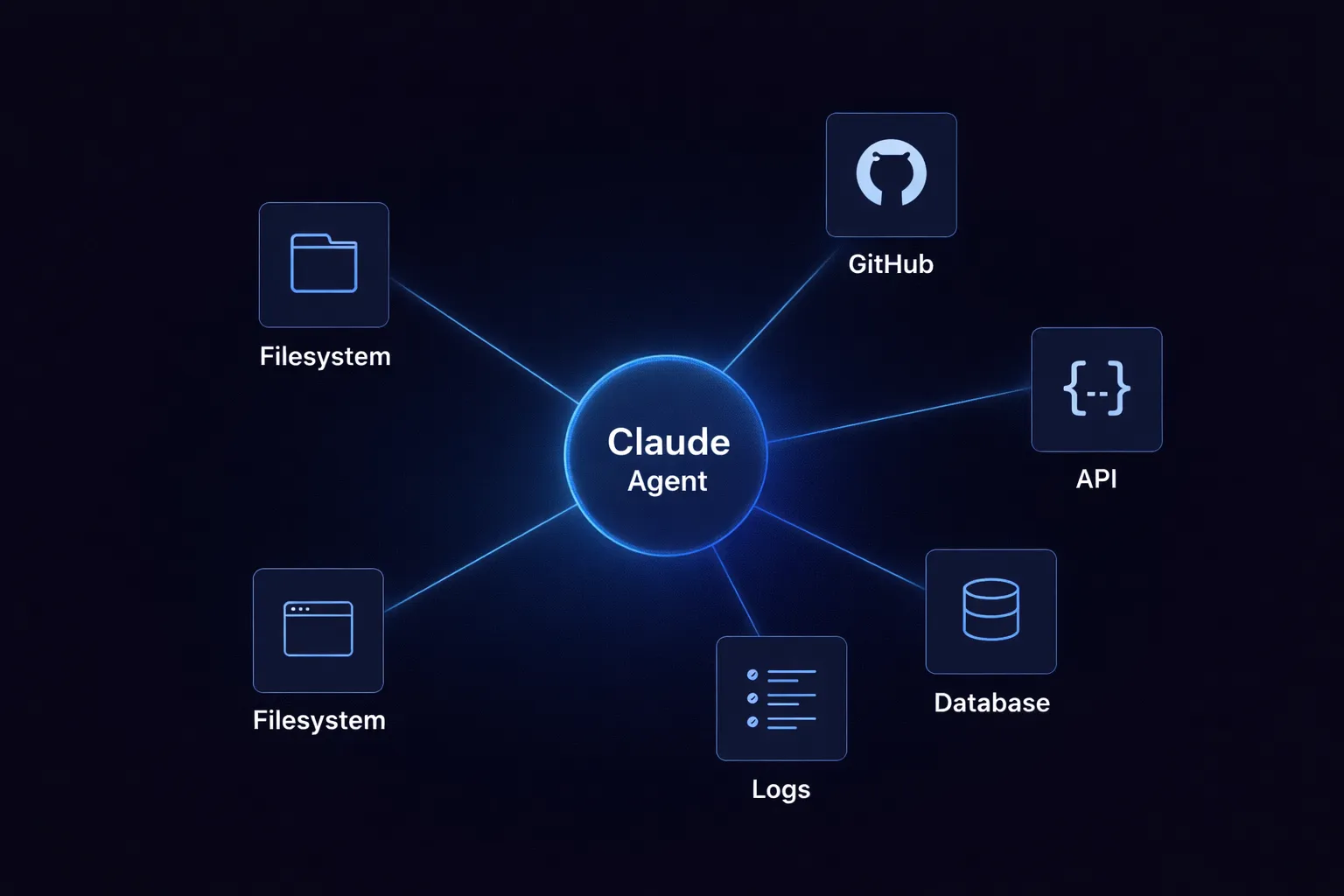

Comment Truefoundry aborde différemment la tarification d'AI Gateway

Truefoundry adopte une approche architecturale différente : Séparation du plan de contrôle et du plan de données.

Nous l'avons conçu pour les ingénieurs qui ont besoin de fonctionnalités de passerelle mais qui ont besoin d'une souveraineté totale des données.

- Le plan de contrôle : Géré par nos soins (ou auto-hébergé). Cela gère la configuration, les utilisateurs et les tableaux de bord.

- Le plan de données : Il s'exécute comme un conteneur dans votre cloud (AWS, GCP, Azure). Vos clés d'API, vos instructions et les données de vos clients ne quittent jamais votre environnement.

Contrôle budgétaire granulaire

Nous vous permettons de définir des budgets qui imposent des limites financières strictes à des équipes ou à des projets spécifiques. Si un script d'agent expérimental boucle de manière inattendue, la passerelle interrompt le trafic au niveau de l'infrastructure avant que les coûts ne montent en flèche.

Connectivité universelle

Comme la passerelle se trouve dans votre VPC, elle traite les modèles privés exactement comme les modèles publics. Vous pouvez acheminer le trafic vers un modèle Llama 3 s'exécutant sur un nœud GPU local aussi facilement que vers GPT-4. Cela vous permet d'optimiser les coûts et la latence sans vous soucier des frais de sortie ou du transport en commun sur Internet.

Cloudflare AI Gateway vs Truefoundry : comparaison détaillée des prix

Êtes-vous prêt à développer l'IA sans surprises en matière de prix ?

Le choix d'une passerelle est une décision d'infrastructure, pas simplement une sélection d'outils. Cloudflare AI Gateway est idéal pour les cas d'utilisation « en périphérie » : léger, rapide et facile à démarrer. Mais si vous créez une plateforme d'entreprise, les exigences en matière de gouvernance, de localisation des données et d'économie forfaitaire pointent souvent vers une architecture privée.

Truefoundry est conçu pour le long terme. Nous découplons le plan de contrôle de vos données afin que, à mesure que votre volume augmente, vos coûts restent liés à votre propre infrastructure efficace.

Étape suivante : Si vous évaluez des passerelles pour une charge de travail de production et que vous avez besoin de données pour rester dans votre VPC, [Réservez une démo avec Truefoundry]. Voyons comment une architecture privée gère votre trafic.

Questions fréquemment posées

La passerelle Cloudflare AI est-elle gratuite ?

Il y a un niveau gratuit, oui. Vous recevez 100 000 journaux par mois. Cependant, une fois que vous atteignez cette limite, la journalisation s'arrête généralement. Pour les applications de production, vous aurez généralement besoin du plan « Workers Paid » (à partir de 5 $/mois) pour débloquer des limites plus élevées.

Combien coûtera Cloudflare AI ?

La facturation de la passerelle est intégrée à Cloudflare Workers. Vous payez 5$ par mois pour les 10 premiers millions de demandes. Ensuite, il est de **0,30 $ par million de demandes** (tarification basée sur les données accessibles au public au début de 2026). N'oubliez pas que ces frais couvrent l'infrastructure de la passerelle. Vous payez toujours OpenAI/Anthropic séparément pour les jetons.

En quoi Truefoundry est-il plus rentable que Cloudflare AI ?

À grande échelle, Truefoundry optimise le coût total de possession en tirant parti de votre infrastructure cloud existante. Vous évitez le balisage variable « par demande » d'un proxy SaaS et vous stockez vos journaux dans vos propres compartiments S3 (ce qui réduit les frais d'exportation). En outre, notre architecture simplifie le routage du trafic vers des modèles open source auto-hébergés et rentables au sein de votre propre VPC.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.png)

.webp)

.webp)