5 meilleures passerelles IA en 2026

.webp)

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

De nombreuses organisations qui adoptent de grands modèles de langage (LLM) découvrent rapidement l'écart entre une démonstration réussie et un système prêt pour la production.

- Les factures peuvent être imprévisibles et astronomiques. Dans un cas, un développeur a laissé une boucle fonctionner du jour au lendemain et a accumulé 3 000$ en frais d'API.

- L'équipe de sécurité fait part de ses préoccupations concernant les données financières ou médicales sensibles circulant via des API tierces sans gouvernance appropriée.

- Les systèmes peuvent tomber en panne de façon inattendue lorsque des fournisseurs tels qu'OpenAI atteignent des limites de débit, sans qu'aucune stratégie de repli ne soit mise en place.

- Pire encore, les équipes n'ont souvent aucune visibilité claire sur ce qui se passe sous le capot une fois que les modèles sont en production.

Ces défis mettent en évidence l'ampleur de l'écart entre « l'IA qui fonctionne dans le cadre d'une démonstration » et « l'IA qui fonctionne à l'échelle de l'entreprise ».

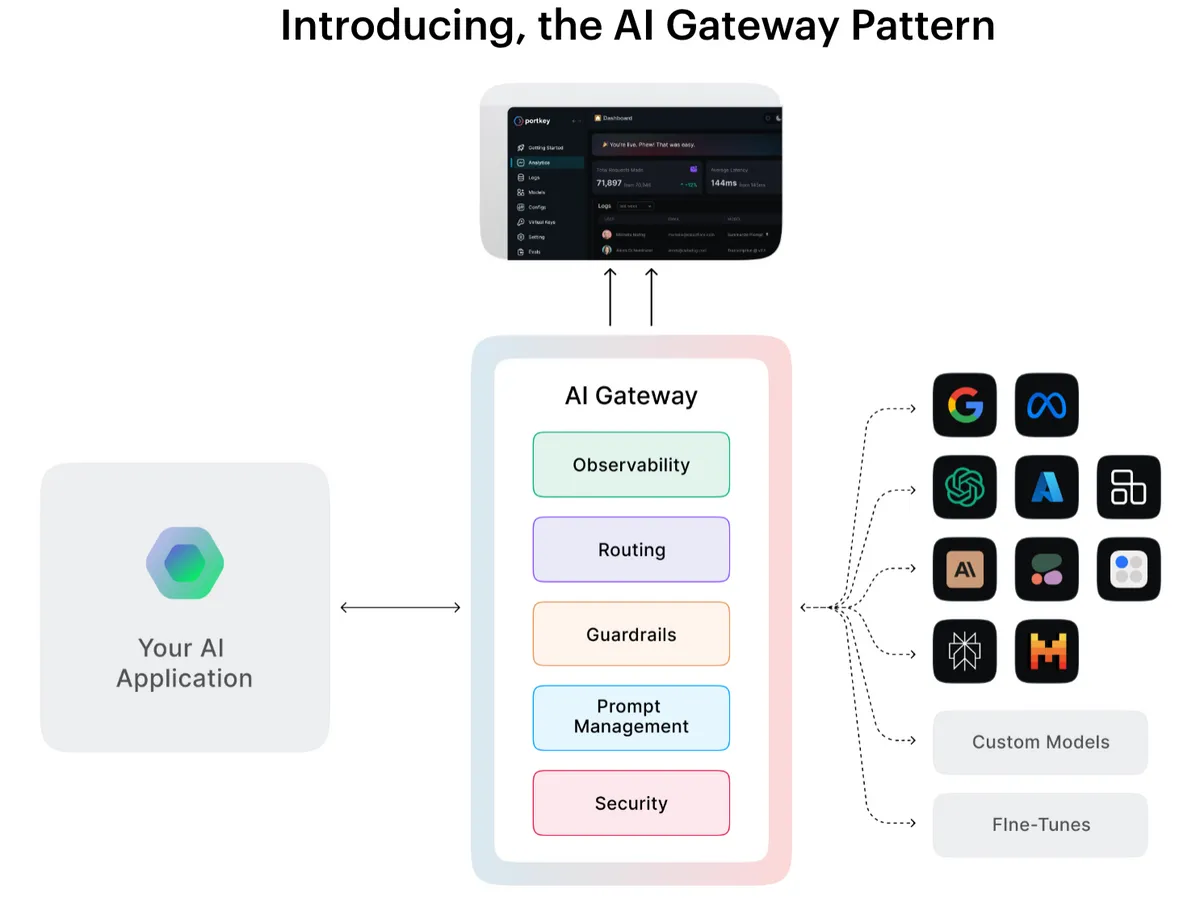

Qu'est-ce qu'une passerelle IA ?

Un Passerelle IA est une technologie ou une plateforme qui sert d'intermédiaire entre les applications et divers services ou modèles d'intelligence artificielle (IA). Son objectif est de simplifier et de gérer l'accès aux fonctionnalités d'IA, en fournissant un point central pour assurer la sécurité, la gouvernance et l'observabilité des charges de travail d'IA. Lisez le guide de marché complet de Gartner pour AI Gateways 2025 pour en savoir plus.

Considérez une passerelle IA comme le système de contrôle du trafic aérien pour vos opérations LLM. Tout comme le contrôle du trafic aérien gère des centaines de vols de manière sûre et efficace, une passerelle IA assure la liaison entre vos applications et plusieurs fournisseurs de LLM, orchestrant les demandes, appliquant les politiques et garantissant le bon fonctionnement de tout.

Mais contrairement aux passerelles API traditionnelles, les passerelles IA comprennent les défis uniques des charges de travail LLM. Ils savent comment gérer la tarification basée sur les jetons, gérer les fenêtres contextuelles, acheminer les demandes en fonction des capacités des modèles et fournir l'observabilité dont vous avez besoin pour déboguer des flux de travail d'IA complexes.

Les chiffres montrent pourquoi c'est important. Le marché des passerelles d'IA a explosé, passant de 400 millions de dollars en 2023 à 3,9 milliards de dollars en 2024, et Gartner prévoit que 70 % des organisations qui créent des applications multi-LLM utiliseront les fonctionnalités des passerelles d'IA d'ici 2028. Des entreprises comme NVIDIA font état d'une utilisation du GPU supérieure de 80 % après la mise en œuvre d'une infrastructure d'IA appropriée, tandis que les petites équipes servent désormais de plus en plus des millions d'utilisateurs, seules quelques personnes gérant l'ensemble de la pile d'IA.

Pourquoi chaque équipe d'IA a besoin d'une passerelle d'IA

Les problèmes auxquels Sarah a été confrontée ne sont pas des cas extrêmes. C'est la réalité inévitable de la gestion de LLM à grande échelle. Voici pourquoi :

Le contrôle des coûts a pris de l'ampleur: Les coûts du LLM peuvent devenir incontrôlables plus rapidement que tout autre service cloud. Contrairement aux API traditionnelles, où vous payez par demande, les LLM facturent par jeton et l'utilisation des jetons est intrinsèquement imprévisible. Une seule requête complexe peut utiliser 10 fois plus de jetons que prévu. Sans garde-corps appropriés, un petit bug peut ruiner votre budget d'IA en quelques heures.

Le piège de l'enfermement des fournisseurs: Commencer avec un seul fournisseur semble simple, mais cela crée de dangereuses dépendances. Que se passe-t-il lorsque OpenAI est hors service pour cause de maintenance ? Quand un modèle devient-il obsolète ? Quand les prix changent-ils du jour au lendemain ? Quand un nouveau modèle performant est proposé par un autre fournisseur, comme Gemini ou Anthropic ? Les équipes qui codent en dur des API spécifiques à leurs fournisseurs ont du mal à réécrire le code pendant les pannes et dans ces scénarios, ce qui les place à la traîne par rapport à leurs concurrents.

Cauchemars en matière de sécurité et de conformité: Les données d'entreprise qui circulent via des API tierces sont source de problèmes de conformité. Comment vous assurez-vous que les données sensibles des clients ne sont pas enregistrées par des routeurs LLM tiers tels qu'OpenRouter, par exemple ? Comment mettre en œuvre un contrôle d'accès basé sur les rôles lorsque différentes équipes ont besoin de différents modèles d'autorisations ? Comment auditer la prise de décision en matière d'IA pour vérifier la conformité réglementaire ?

Cécité opérationnelle: Les applications LLM échouent de manière unique. Les modèles peuvent produire des sorties incorrectes qui semblent correctes, utiliser des quantités de calcul inattendues ou atteindre des limites de débit à des moments imprévisibles. Sans une observabilité adéquate, le débogage donne l'impression de travailler dans le noir.

La solution n'est pas de construire toute cette infrastructure vous-même. C'est comme créer votre propre base de données au lieu d'utiliser PostgreSQL. La solution la plus intelligente consiste à choisir la passerelle IA adaptée à vos besoins.

Les 5 meilleures solutions de passerelle IA

Après avoir analysé des dizaines de solutions et discuté avec des équipes qui gèrent l'IA en production, cinq plateformes se distinguent par leur excellence technique et leur capacité d'entreprise. Chacun adopte une approche différente pour résoudre les principaux défis, et le bon choix dépend de vos besoins spécifiques.

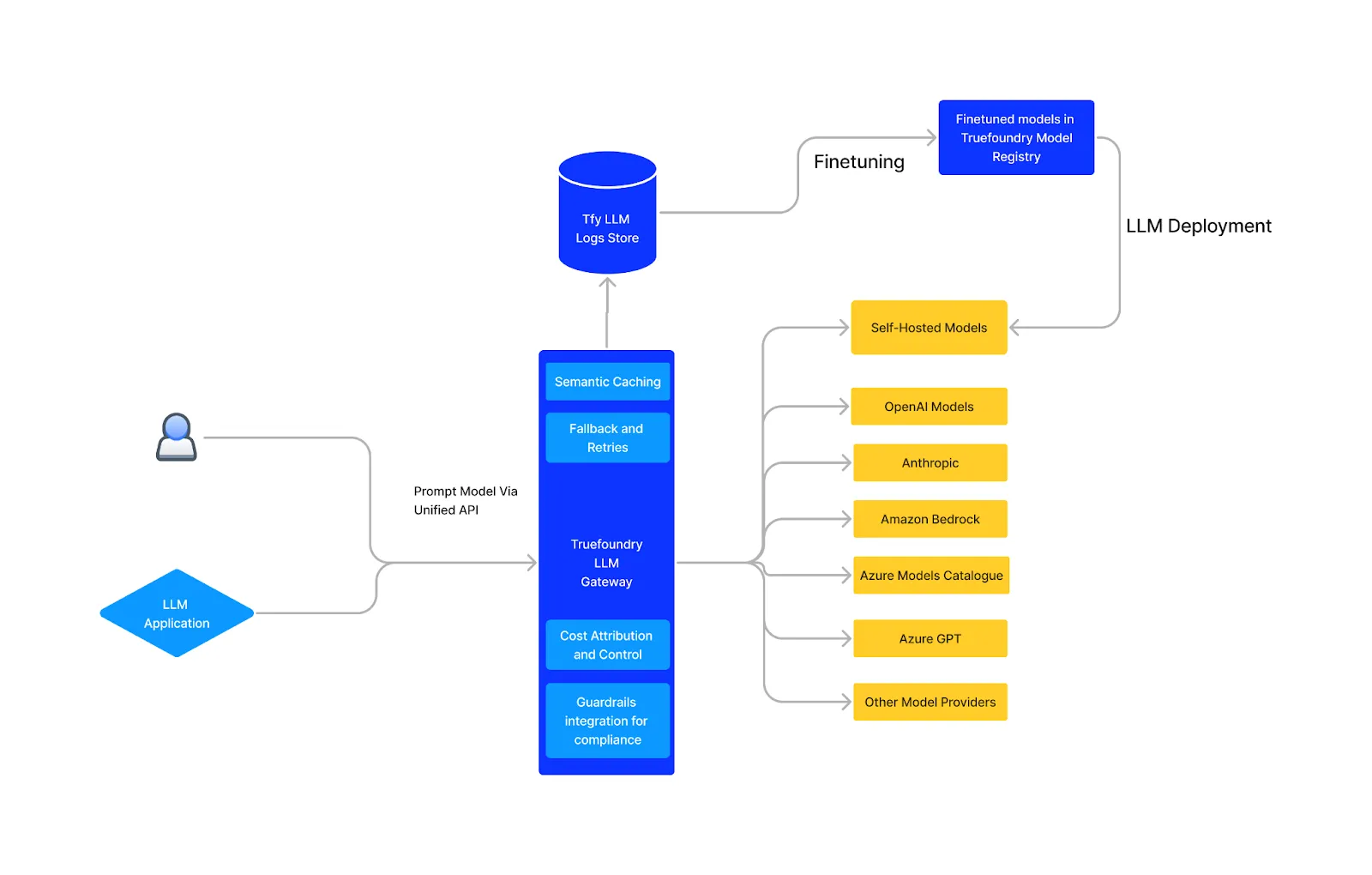

1. Passerelle TrueFoundry AI

True Foundry n'est pas un simple proxy d'IA comme les autres. Il s'agit d'une plateforme spécialement conçue par des ingénieurs qui ont éprouvé des difficultés à développer l'IA dans des entreprises telles que Meta, Apple et WorldQuant. Les résultats parlent d'eux-mêmes : un temps de latence inférieur à 5 ms, plus de 350 requêtes par seconde par cœur de processeur et des déploiements de production répondant à des millions de demandes quotidiennes.

Qu'est-ce qui différencie TrueFoundry

La plateforme architecture sépare le plan de contrôle du plan de données, ce qui permet à la fois une flexibilité opérationnelle et une optimisation des performances. Contrairement aux solutions qui ajoutent de la latence à chaque fonctionnalité, TrueFoundry traite l'authentification, l'autorisation et la limitation de débit en mémoire, garantissant des temps de réponse inférieurs à la milliseconde constants, même avec des règles de gouvernance complexes.

Le API unifiée vous donne accès à des centaines de LLM via différents fournisseurs (OpenAI, Anthropic, Gemini, Azure, AWS, Databricks, Mistral, Groq, Together, etc.), avec un support pour tous les fournisseurs compatibles avec OpenAI, ainsi que modèles auto-hébergés.

Des fonctionnalités d'entreprise qui fonctionnent réellement

TrueFoundry a atteint Conformité à la norme SOC 2 de type 2 et à la norme HIPAA en 2024, avec systèmes d'authentification prise en charge des jetons d'accès personnels pour le développement et des jetons de compte virtuel pour la production, ainsi que l'intégration d'OAuth 2.0 pour les fournisseurs d'identité d'entreprise.

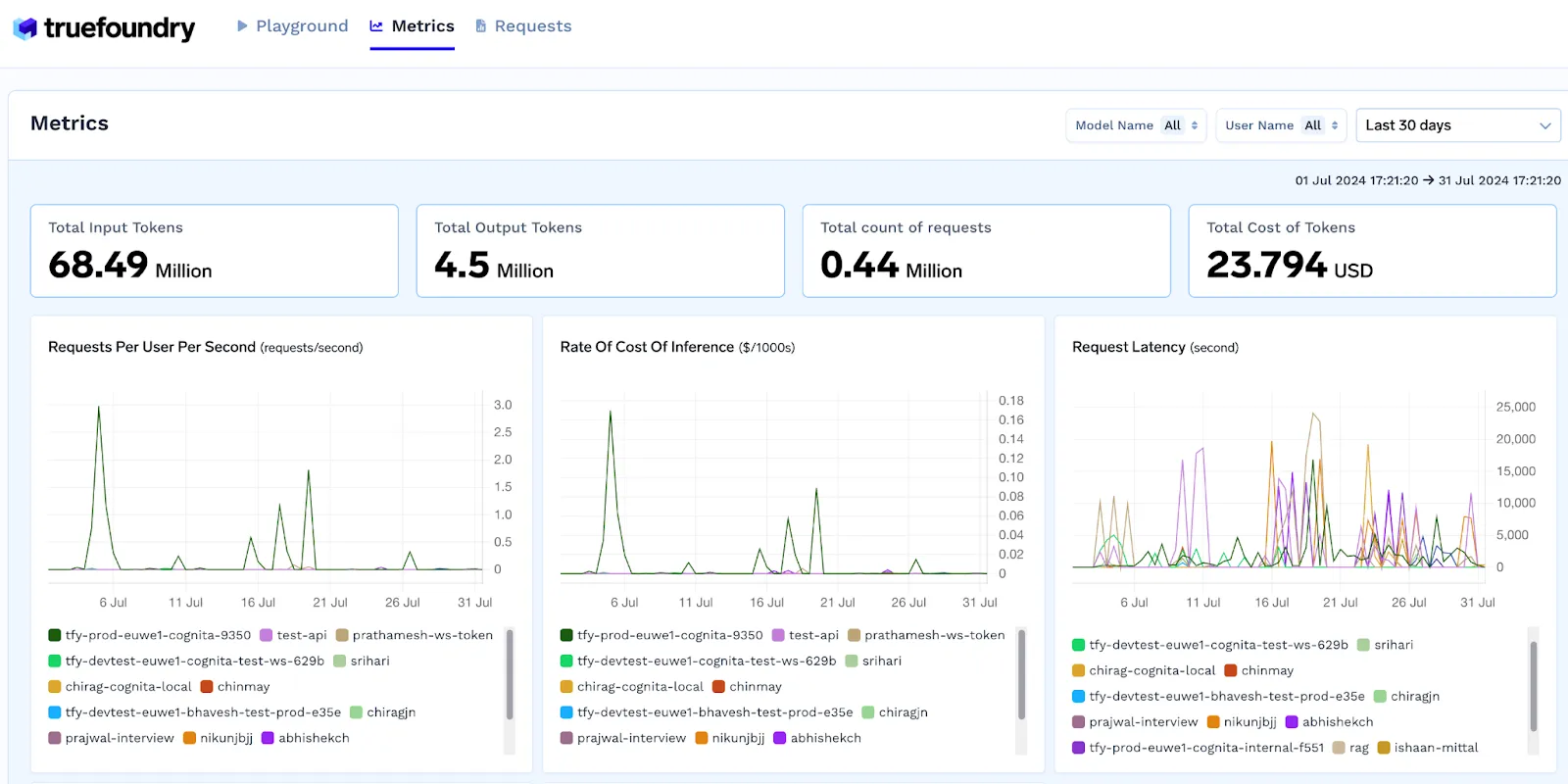

Ce qui distingue TrueFoundry, c'est gestion complète des coûts qui va au-delà du simple suivi. L'attribution de l'utilisation au niveau des jetons vous permet de comprendre les coûts par utilisateur, par équipe, par zone géographique ou par toute autre dimension personnalisée. L'application du budget en temps réel permet d'éviter les surprises, tandis que des analyses détaillées permettent d'optimiser les habitudes de dépenses. Les équipes constatent généralement une réduction des coûts de 30 à 70 % par rapport à l'utilisation directe des fournisseurs.

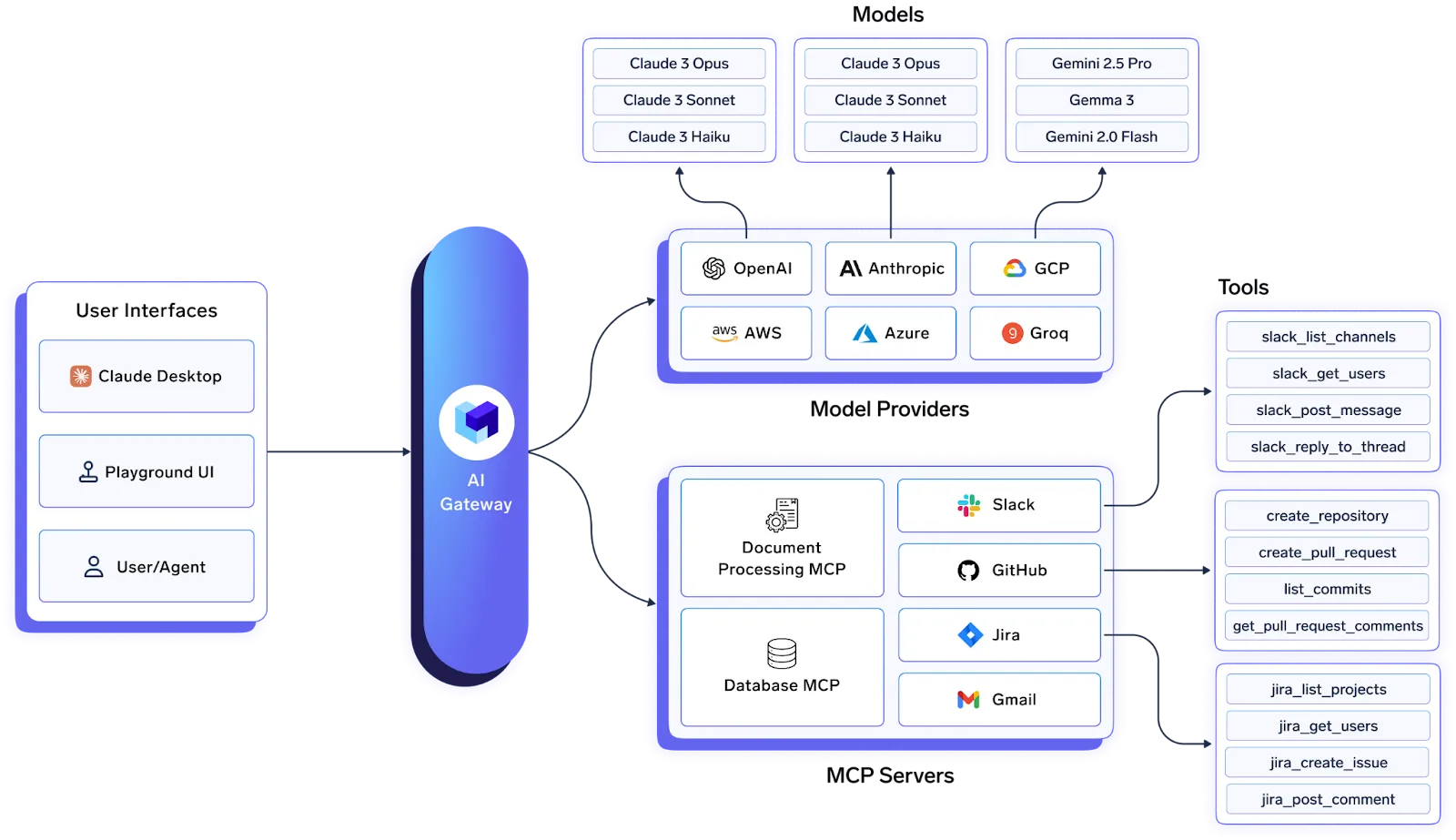

Le Passerelle MCP (Model Context Protocol) représente une architecture avant-gardiste pour l'intégration des outils d'entreprise. Au lieu de créer des connecteurs personnalisés pour chaque outil d'entreprise, vous bénéficiez d'une gestion centralisée des serveurs MCP avec un accès sécurisé OAuth 2.0 à des outils tels que Slack, GitHub et Confluence, et observabilité complète des flux de travail des agents.

TrueFoundry capacités de conteneurisation et de déploiement prend en charge des serveurs de modèles flexibles (vLLM, SGlang, TRT-LLM), la mise en cache automatique des modèles et Optimisation du GPU avec routage permanent pour l'optimisation du cache KV. La plateforme prend même en charge déploiements en espace aérien pour des exigences de sécurité maximales.

Qui devrait choisir TrueFoundry

Les organisations qui ont besoin d'une fiabilité et d'une gouvernance de niveau professionnel sans sacrifier les performances. La plateforme s'adresse particulièrement aux équipes qui apprécient une observabilité et une surveillance complètes, des coûts prévisibles, une gestion complète de la sécurité et l'intégration à l'infrastructure d'entreprise existante. Si vous gérez plusieurs fournisseurs LLM et que vous avez besoin d'un contrôle granulaire de l'accès, des coûts et de la conformité, TrueFoundry propose la solution la plus complète. Truefoundry met également à la disposition de votre équipe une suite d'IA complète, y compris la gestion des déploiements de machine learning et de LLM, l'intégration entre les fournisseurs et l'accès à des intégrations de serveurs mcp personnalisées et préexistantes (Slack, GitHub, Sentry, etc.)

Considérations potentielles: L'ensemble complet de fonctionnalités peut être plus que nécessaire pour de simples cas d'utilisation individuels (ou pour des cas d'utilisation destinés uniquement à des équipes débutantes), et l'accent mis sur l'entreprise signifie que la tarification reflète la nature complète de la plateforme.

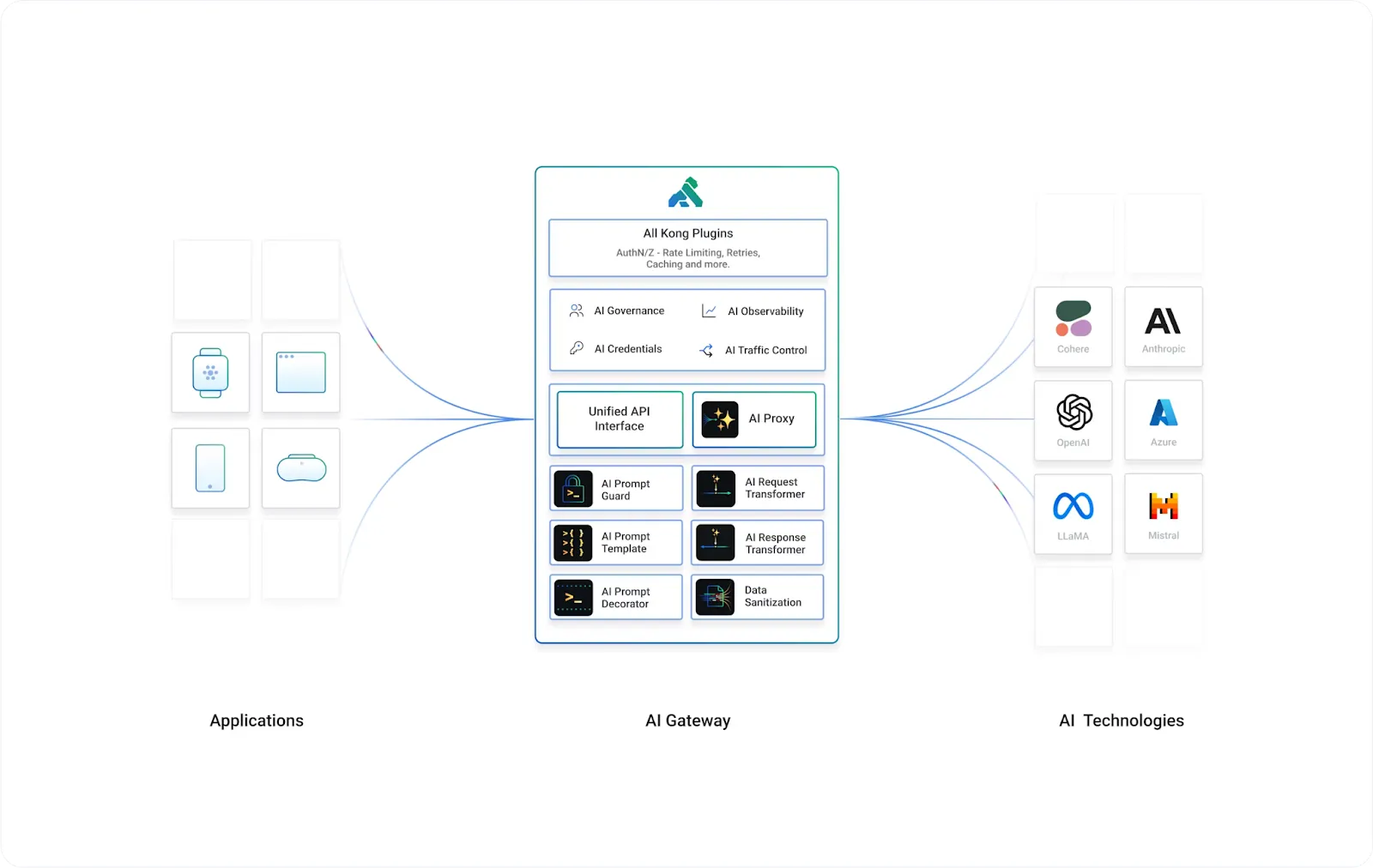

2. Passerelle Kong AI

Kong apporte des fonctionnalités de gestion des API matures aux charges de travail de l'IA, en étendant sa plateforme testée au combat avec des fonctionnalités spécifiques à l'IA. Si votre organisation utilise déjà Kong pour les API traditionnelles, la passerelle AI fournit des modèles opérationnels familiers avec de nouvelles fonctionnalités conçues pour le trafic LLM.

Tirer parti d'une infrastructure mature

La force de Kong réside dans son écosystème complet de plugins et ses fonctionnalités opérationnelles de niveau entreprise. Les plugins spécifiques à l'IA incluent le routage sémantique et l'équilibrage de charge avancé avec six stratégies de routage. La limitation de débit basée sur des jetons prend en charge diverses stratégies, bien que sa mise en œuvre puisse être complexe par rapport à des alternatives plus modernes.

Profondeur de l'intégration d'entreprise

L'héritage d'entreprise de Kong se reflète dans ses capacités de sécurité et de gouvernance. OAuth 2.0, JWT, mTLS et le contrôle d'accès basé sur les rôles s'intègrent aux fournisseurs d'identité d'entreprise existants, bien que les équipes signalent que la documentation peut être difficile à parcourir pour les fonctionnalités spécifiques à l'IA.

Idéal pour Kong AI Gateway

Les organisations disposant d'une infrastructure Kong existante et souhaitant étendre des modèles opérationnels familiers aux charges de travail d'IA. L'approche hybride convient parfaitement aux équipes qui ont besoin d'une gestion complète des API ainsi que de fonctionnalités spécifiques à l'IA.

Considérations potentielles: Kong's complexité des prix est bien documentée, avec des coûts supérieurs à 30 dollars par million de demandes par rapport aux alternatives. Le modèle de tarification multidimensionnel (services de passerelle, demandes d'API, plugins payants, plugins premium) crée une imprévisibilité des coûts qui peut être prohibitive pour les charges de travail d'IA à volume élevé. En outre, la tarification d'entreprise nécessite une consultation commerciale, ce qui complique la planification des coûts.

Découvrez également : Les 5 meilleurs Alternatives à Kong AI

3. Clé de port

Portkey se positionne comme Plateforme LLMops plutôt qu'une simple passerelle, offrant une gestion de bout en bout du cycle de vie des applications d'IA en plus des fonctionnalités de proxy traditionnelles. La fonctionnalité LLMops de la plate-forme est toutefois limitée, car il manque des fonctionnalités clés telles que le déploiement.

Au-delà des fonctionnalités de base de Gateway

La plateforme donne accès à des centaines de LLM via une API unifiée tout en proposant des outils de gestion rapide, de garde-corps et de gouvernance. Plus de 50 garde-corps prédéfinis répondent aux problèmes de sécurité et de conformité, grâce à un filtrage du contenu automatisé et à une détection des informations personnelles.

La gestion avancée des commandes inclut des modèles collaboratifs et des fonctionnalités de gestion des versions. La surveillance en temps réel offre une visibilité complète, bien que certains utilisateurs signalent que la plateforme peut être impressionnant pour les nouveaux utilisateurs en raison de la vaste gamme de fonctionnalités (suggérées sur AWS Marketplace par les évaluateurs du produit).

Fiabilité et sécurité de l'entreprise

Les certifications de conformité SOC2, ISO27001, HIPAA et RGPD, associées à des options de déploiement couvrant des environnements SaaS, hybrides et entièrement isolés, répondent aux exigences de sécurité des entreprises. Le SLA de disponibilité de 99,99 % fournit des garanties de fiabilité.

Quand choisir Portkey

Les organisations nécessitant des fonctionnalités LLMOPS intégrées allant au-delà des fonctionnalités de passerelle de base. L'ensemble complet de fonctionnalités justifie l'investissement pour les équipes qui créent des applications d'IA complexes qui nécessitent une gestion rapide sophistiquée et des garde-fous étendus.

Considérations potentielles: La tarification pour les entreprises est complexe, des fonctionnalités clés telles que les limites budgétaires sont limitées aux clients Enterprise uniquement. Certains utilisateurs signalent fonctionnalité d'exportation limitée nécessitant une intervention manuelle de l'équipe d'assistance pour accéder aux données. La fonctionnalité LLMops de la plateforme est également limitée, car les options clés telles que le déploiement ne sont pas non plus prises en charge de manière native.

4. Hélicone

Helicone se distingue par son ingénierie des performances et sa conception centrée sur le développeur. Intégrée à Rust pour obtenir des mesures de vitesse, la plate-forme traite les demandes avec un temps de traitement P50 d'environ 8 ms, bien que cela représente toujours une latence nettement plus élevée que les solutions plus optimisées.

Cependant, les équipes à la recherche de fonctionnalités plus axées sur l'entreprise peuvent envisager une Alternative à Helicone pour répondre à des exigences allant au-delà des performances, telles que la gouvernance, la gestion des coûts et la conformité.

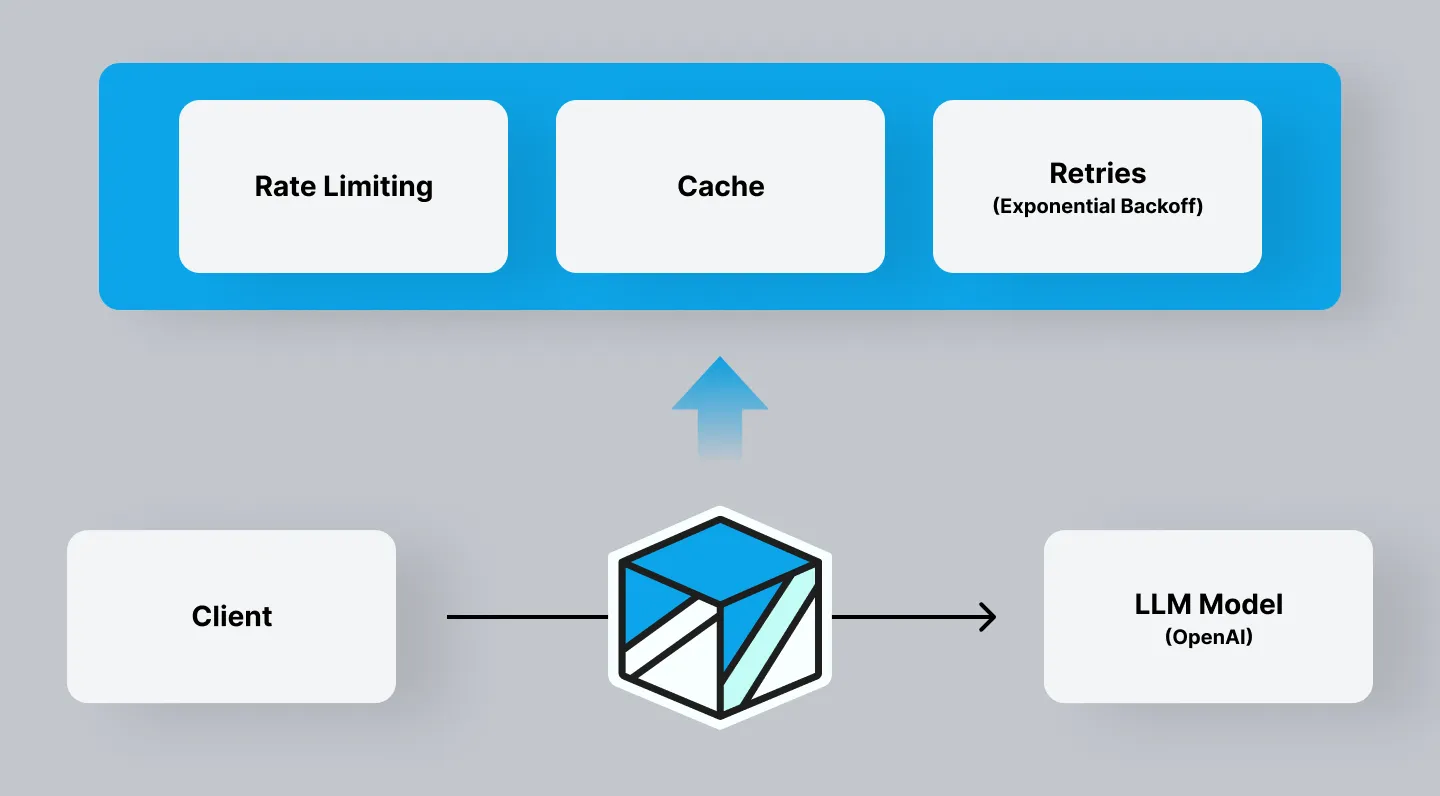

Une architecture axée sur la performance

L'API unifiée prend en charge plus de 100 modèles des principaux fournisseurs avec des fonctionnalités intelligentes de mise en cache et d'équilibrage de charge. La limitation de débit intégrée et les basculements automatiques garantissent la fiabilité des déploiements de production, bien que leur portée soit plus restreinte que celle des solutions d'entreprise complètes.

Focus sur l'expérience des développeurs

L'expérience des développeurs met l'accent sur la simplicité grâce à l'intégration de code sur une seule ligne et à la compatibilité avec le SDK OpenAI. Le tableau de bord d'observabilité fournit une surveillance intégrée sans nécessiter de configuration d'outils supplémentaires, bien qu'il ne soit pas aussi complet que les alternatives destinées aux entreprises.

Idéal pour les équipes axées sur la performance

Les organisations où la simplicité pour les développeurs est plus importante que les fonctionnalités d'entreprise complètes. L'approche axée sur les performances attire les équipes qui créent des applications destinées aux consommateurs où la simplicité est plus importante que la gouvernance.

Considérations potentielles: Bien que plus rapide que certaines solutions, la surcharge de 8 ms reste nettement supérieure à celle des solutions optimisées. L'ensemble de fonctionnalités est plus restreint que celui des plateformes d'entreprise, car il ne dispose pas de fonctionnalités avancées de gouvernance, de conformité et de fonctionnalités complètes de gestion des coûts. La plupart des fonctionnalités proposées par la plateforme sont également présentes dans d'autres solutions, réduisant ainsi la différenciation des produits.

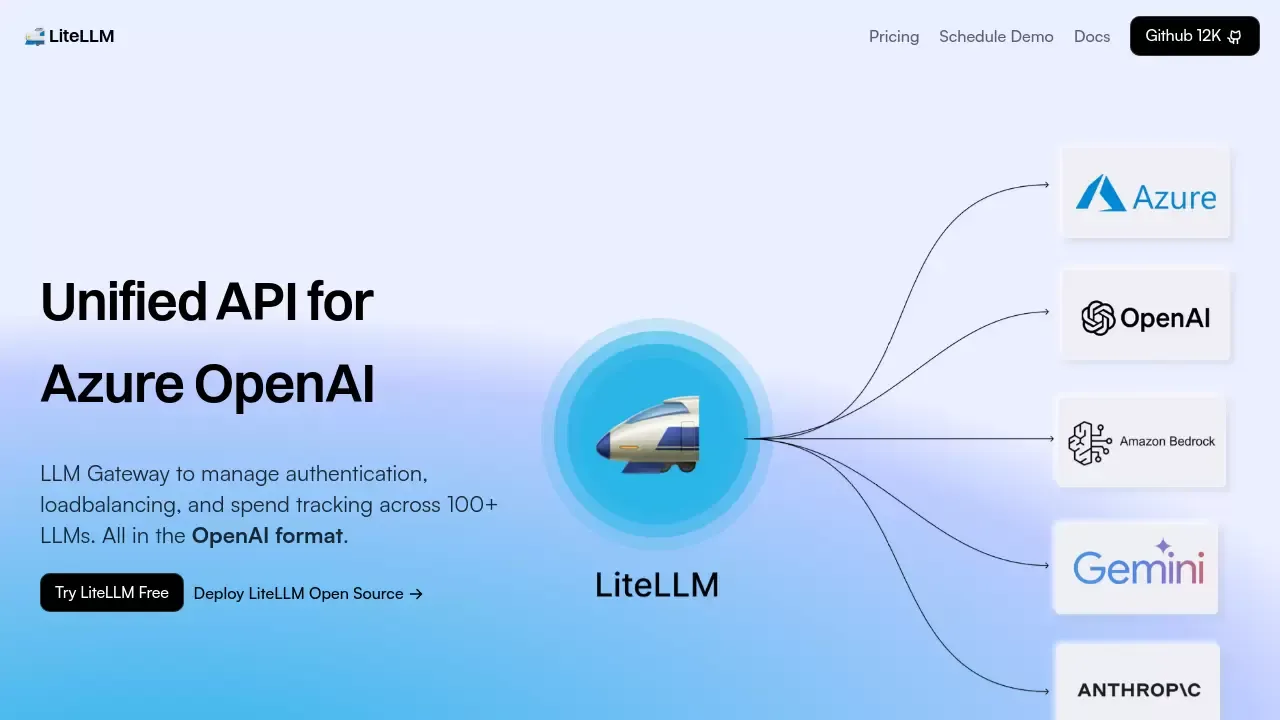

5. LitellM : flexibilité open source et contrôle des coûts

LiteLM adopte une approche open source de la fonctionnalité de passerelle AI, fournissant un serveur proxy basé sur Python qui unifie l'accès à des centaines d'API LLM au format OpenAI.

Compatibilité universelle des API

La force de la plateforme réside dans la compatibilité universelle des API, qui permet aux principaux fournisseurs de bénéficier d'un équilibrage de charge avancé et d'une logique de nouvelle tentative. Les fonctionnalités de gestion des coûts fournissent un suivi de base des dépenses et des limites budgétaires, mais sans la sophistication des alternatives d'entreprise.

Avantages et considérations de l'open source

Le modèle open source offre transparence et flexibilité de personnalisation. La gestion de configuration basée sur YAML permet des approches d'infrastructure en tant que code, tandis que les options de déploiement de Docker prennent en charge les environnements de production de base.

Idéal pour les équipes de plateforme et les organisations soucieuses des coûts

Les équipes qui apprécient la transparence de l'open source et souhaitent conserver le contrôle total de leur infrastructure d'IA.

Considérations potentielles: LiteLM possède limites importantes pour une utilisation en entreprise : l'absence de soutien commercial officiel signifie l'absence de plan de support d'entreprise, l'absence de SLA pour la disponibilité et l'absence de voie d'escalade dédiée. Rapport des utilisateurs régressions fréquentes entre les versions, des bogues marginaux et une instabilité à grande échelle. Le surcharge de latence importante devient un goulot d'étranglement pour les applications en temps réel. En outre, il ne dispose pas d'une observabilité avancée, de contrôles de sécurité et de fonctionnalités d'entreprise au-delà du routage de base. Les mises à jour se font également lentement et passent à côté de certains modèles et fournisseurs moins utilisés, entravant ainsi des éléments de base tels que la prise en charge des modèles les plus récents et ralentissant le pipeline de développement. Dans certains cas d'utilisation, les utilisateurs doivent signaler manuellement les problèmes liés à GitHub et ajouter la prise en charge des nouveaux modèles chez tous les fournisseurs.

Meilleure passerelle IA : comparaison : performances, sécurité et évolutivité

Lors de l'évaluation des passerelles d'IA, trois dimensions techniques sont les plus importantes :

Caractéristiques de performance: La surcharge inférieure à 5 ms de TrueFoundry représente les meilleures performances de latence de sa catégorie, essentielles pour les applications en temps réel et les flux de travail des agents. Les 8 ms d'Helicone sont respectables mais restent nettement plus élevés, tandis que d'autres introduisent une latence nettement plus importante, ce qui peut avoir un impact sur l'expérience utilisateur.

Sécurité et conformité: La conformité SOC 2 Type 2 et HIPAA de TrueFoundry, la conformité SOC 2, ISO, HIPAA et RGPD de Portkey, combinées à des contrôles d'accès complets et à des fonctionnalités d'audit, offrent une sécurité de niveau professionnel. D'autres solutions ne disposent pas de certifications de conformité formelles ou nécessitent une configuration complexe pour atteindre des niveaux de sécurité similaires.

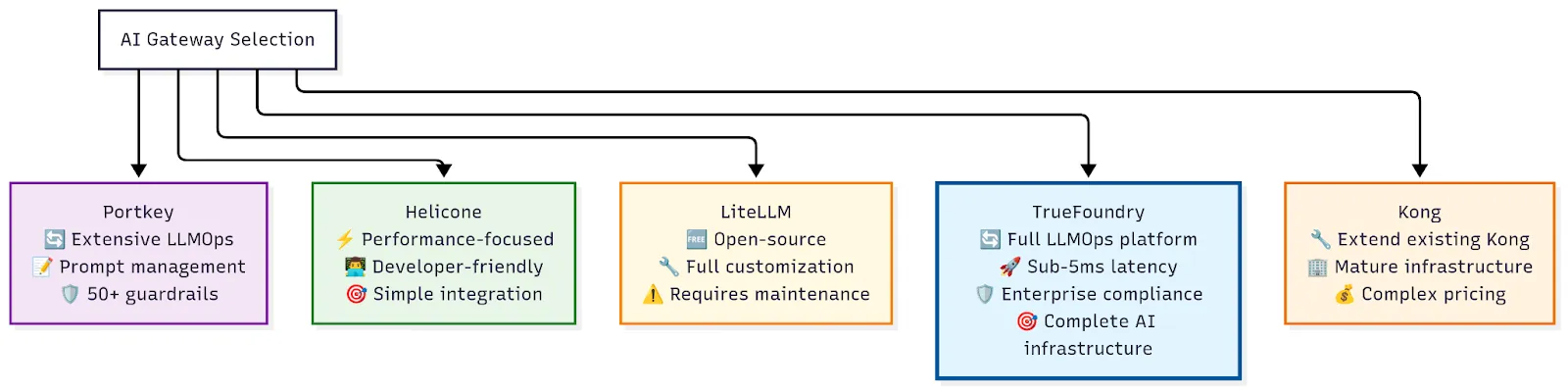

Comment choisir la bonne passerelle IA ?

La sélection optimale de la passerelle d'IA dépend de vos besoins spécifiques, de votre infrastructure existante et de vos priorités stratégiques. Voici un cadre pratique :

Choisissez TrueFoundry si vous avez besoin d'une conformité de niveau professionnel, de fonctionnalités LLMOPs étendues, de performances et d'une gouvernance sans aucun compromis. La plateforme convient particulièrement aux organisations qui gèrent plusieurs fournisseurs de LLM avec des exigences précises en matière de coûts et de contrôle d'accès. L'architecture unifiée avec support MCP complet et fonctionnalités de modèles auto-hébergés attire les équipes qui recherchent la solution de gestion d'infrastructure d'IA la plus complète. La latence inférieure à 5 ms de TrueFoundry et sa conformité éprouvée en entreprise en font la solution idéale pour les applications d'IA critiques.

Choisissez Kong si vous utilisez déjà Kong pour les API traditionnelles et souhaitez étendre des modèles opérationnels familiers aux charges de travail d'IA, malgré la complexité tarifaire et les coûts élevés. L'approche hybride convient aux organisations dotées d'architectures de services complexes, mais préparez-vous à relever les défis de la courbe d'apprentissage et de la gestion des coûts.

Choisissez Portkey si vous avez besoin de fonctionnalités LLMOPs de base intégrées et pouvez justifier la tarification d'entreprise pour des outils sophistiqués de gestion rapide et de gouvernance. Tenez compte de la complexité des fonctionnalités et des capacités d'exportation de données limitées lors de l'évaluation.

Choisissez Helicone si les performances et la simplicité pour les développeurs sont vos principales préoccupations, et vous pouvez accepter les limites des fonctionnalités de gouvernance d'entreprise. Cette approche convient aux équipes qui créent des applications destinées aux consommateurs pour lesquelles la conformité de l'entreprise n'est pas essentielle.

Choisissez LiteLM si vous disposez de solides capacités d'ingénierie pour gérer la complexité de l'open source et pouvez accepter les limites liées au support, à la stabilité et aux coûts de performance de l'entreprise. Soyez prêt à faire face à d'éventuels problèmes de production et à la nécessité d'une maintenance interne.

L'avenir de l'infrastructure d'IA

Le marché des passerelles d'IA continue d'évoluer rapidement, les fournisseurs traditionnels de gestion d'API ajoutant des fonctionnalités spécifiques à l'IA tandis que les solutions natives de l'IA évoluent pour répondre aux besoins des entreprises. Trois tendances façonneront la prochaine génération :

Intégration de l'IA agentique: À mesure que les agents d'IA gagnent en autonomie, plateformes d'IA agentic et les passerelles auront besoin de capacités d'orchestration sophistiquées pour les flux de travail multi-agents, le chaînage d'outils et les processus de raisonnement complexes. La passerelle MCP de TrueFoundry la positionne bien pour cette évolution.

Assistance multimodale: L'extension du texte aux images, à l'audio et à la vidéo nécessitera des passerelles capables de gérer divers types de données, de gérer différents coûts de traitement et d'optimiser les différentes exigences de latence.

Déploiement Edge et hybride: Les entreprises exigeront des modèles de déploiement flexibles qui prennent en charge les environnements sur site, dans le cloud et en périphérie tout en maintenant une gouvernance et une observabilité cohérentes.

Conclusion

Le marché des passerelles d'IA d'entreprise représente un point d'inflexion critique dans la maturité de l'infrastructure d'IA. Les équipes qui maîtrisent cette couche bénéficieront d'avantages concurrentiels durables dans un avenir basé sur l'IA. Ceux qui ne le feront pas se retrouveront constamment confrontés à des problèmes d'infrastructure au lieu de créer des applications d'IA innovantes.

Le choix que vous faites aujourd'hui aura un impact significatif sur votre capacité à vous adapter à l'évolution des capacités de l'IA. Bien que chaque solution présente des avantages, la combinaison de performances de niveau professionnel, de conformité complète et d'architecture avant-gardiste de TrueFoundry constitue la base la plus complète pour faire évoluer les opérations d'IA. La latence inférieure à 5 ms de la plateforme, son adoption éprouvée par les entreprises et son approche unifiée de la gestion LLM, de l'intégration MCP et de la prise en charge des modèles auto-hébergés offrent le meilleur équilibre entre valeur immédiate et flexibilité future.

Pour les équipes prêtes à passer de projets expérimentaux d'IA à des déploiements à l'échelle de la production, le choix de la plateforme de passerelle déterminera l'efficacité opérationnelle, la posture de sécurité et la flexibilité stratégique. Les solutions présentées ici sont à la pointe de la technologie actuelle, mais l'approche globale de TrueFoundry et sa conception axée sur l'entreprise en font le choix le plus judicieux pour les organisations qui souhaitent sérieusement faire évoluer leur infrastructure d'IA.

Prêt à démarrer ? Le passage des démonstrations d'IA aux systèmes de production ne doit pas être pénible. Avec le bon choix de passerelle et la bonne stratégie de mise en œuvre, vous pouvez créer une infrastructure d'IA évolutive, sécurisée et maîtrisant les coûts.

Questions fréquemment posées

Qui fournit la meilleure passerelle d'IA pour les entreprises ?

TrueFoundry fournit la meilleure passerelle d'IA avec une gestion unifiée des modèles, une sécurité et une observabilité au sein d'une plate-forme unique. Cela permet aux équipes de déployer rapidement des applications d'IA fiables tout en conservant le contrôle total de leurs données privées et de l'infrastructure sous-jacente.

Quelles fonctionnalités devez-vous rechercher dans les passerelles IA d'entreprise ?

Les passerelles IA d'entreprise nécessitent des fonctionnalités essentielles telles que le masquage des informations personnelles, le routage sensible aux coûts et l'enregistrement détaillé des demandes pour des raisons de conformité. Ces fonctionnalités aident les organisations à gérer systématiquement l'utilisation des modèles au sein de plusieurs équipes. Les meilleures plateformes offrent également une latence performante et une API unifiée pour les modèles SaaS propriétaires et open source auto-hébergés.

Quelles sont les meilleures passerelles IA pour les charges de travail LLM de production ?

Les passerelles d'IA destinées à la production donnent la priorité à la haute disponibilité et à la fluidité du basculement des fournisseurs. Les plateformes de premier plan telles que TrueFoundry permettent aux applications de rester en ligne en redirigeant automatiquement le trafic en cas d'interruption de service d'un fournisseur de modèles. Cette résilience opérationnelle est essentielle pour maintenir une expérience utilisateur cohérente à grande échelle sans intervention d'ingénierie manuelle.

Pourquoi TrueFoundry est-elle la meilleure passerelle d'IA pour faire évoluer l'IA en production ?

TrueFoundry excelle en matière d'évolutivité car il simplifie l'orchestration complexe des GPU et le déploiement de modèles au sein d'un plan de contrôle unifié. La plateforme gère des millions de demandes tout en fournissant un suivi précis des coûts pour diverses équipes. Cela permet aux organisations de développer leurs initiatives d'IA sans augmenter la complexité opérationnelle ni les frais d'infrastructure.

Qu'est-ce qu'une alternative open source à AWS API Gateway ?

Bien qu'AWS fournisse des outils généraux, la meilleure passerelle d'IA pour les tâches LLM spécialisées nécessite des plateformes open source conviviales telles que TrueFoundry. Il offre une alternative ciblée pour gérer les besoins spécifiques aux modèles, tels que les limites de jetons et la mise en cache sémantique. Cela donne aux développeurs une plus grande flexibilité que les passerelles API traditionnelles et polyvalentes ne peuvent fournir pour les flux de travail d'IA complexes.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)