Suivez le cycle de vie complet de Votre application d'IA

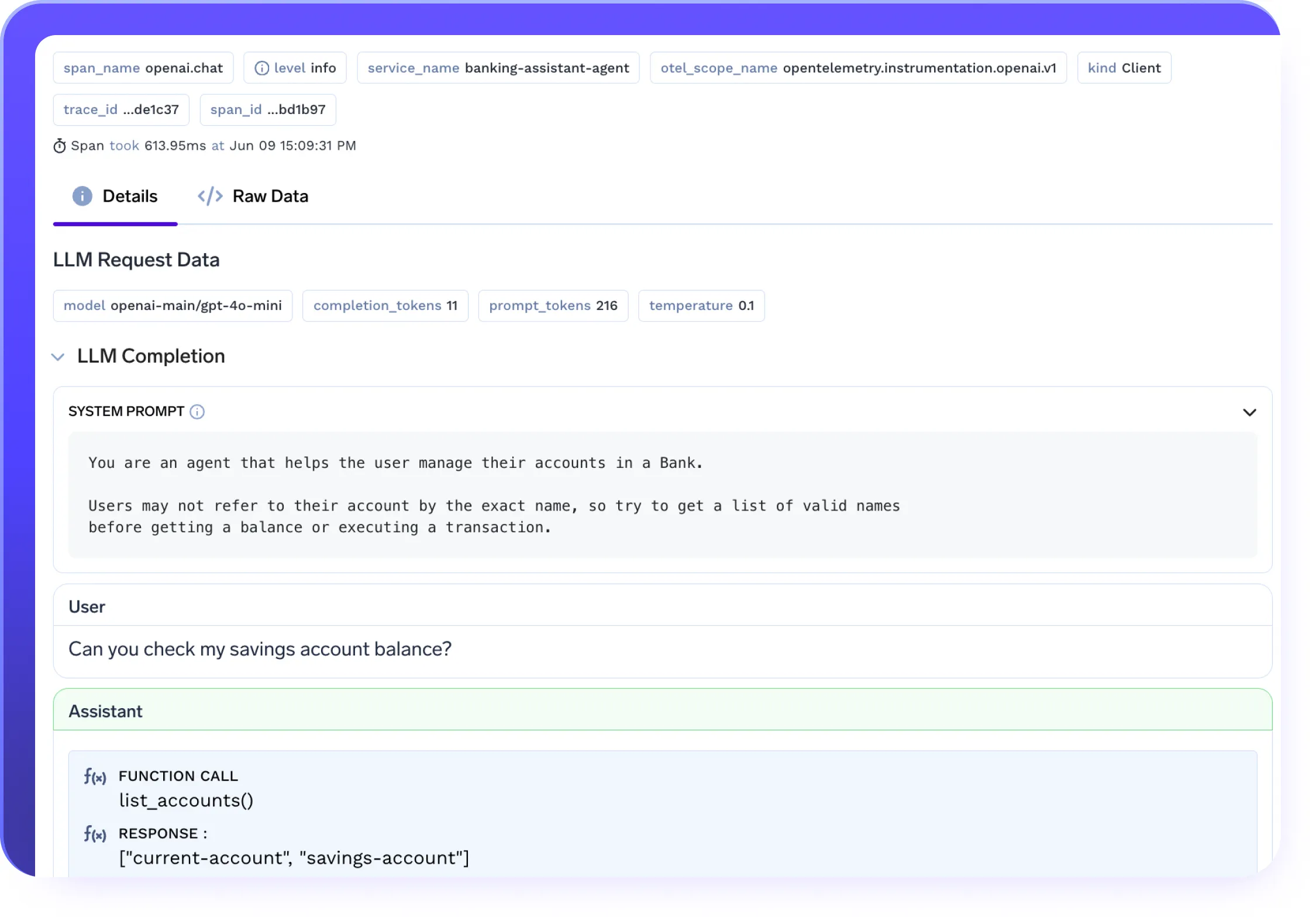

Réalisez en temps réel Observabilité de l'IA en suivant chaque étape, de la saisie de l'utilisateur à la réponse de l'agent :

- Invitations utilisateur, messages système et entrées d'outils

- Appels LLM (OpenAI, Anthropic, Cohere, etc.)

- Invocations d'outils (fonctions de style Langchain ou personnalisées)

- Décisions relatives au flux de travail et voies d'exécution

.webp)

Tracez et chronométrez chaque LLM et appel d'outils en temps réel

Bénéficiez d'une observabilité de haute fidélité grâce à l'IA et de mesures exploitables :

- Identifiez les goulots d'étranglement en matière de performances et les lenteurs de réponse du LLM

- Suivez l'utilisation des jetons, la sélection du modèle et le coût des demandes

- Comprendre l'impact des outils et des fonctions sur les flux de travail

- Repérez les modèles répétés, les sorties inattendues et les défaillances

.webp)

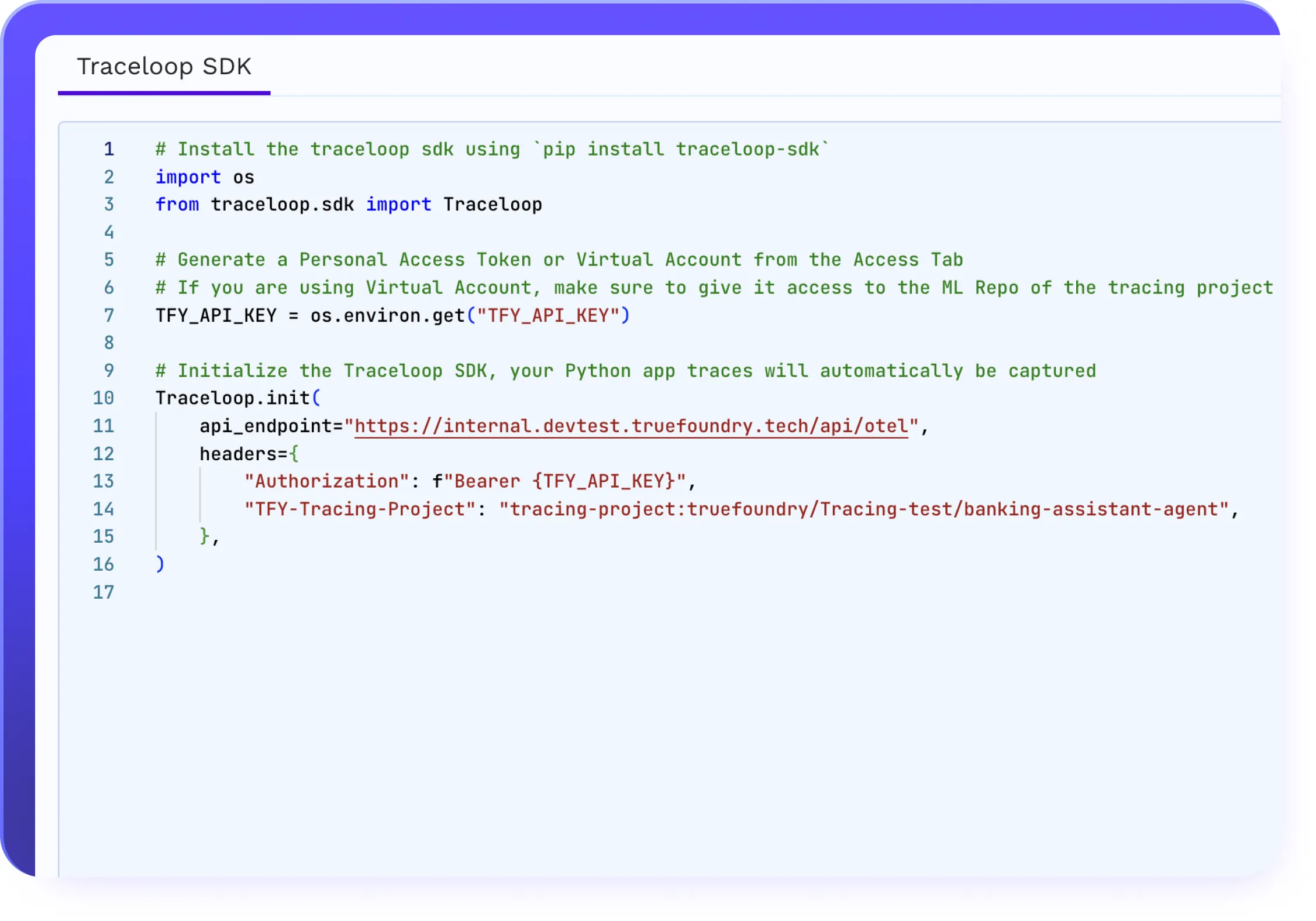

Observabilité des agents avec Instrumentation automatique

Capturez automatiquement les traces détaillées de vos agents IA :

- Requêtes LLM et métadonnées du modèle

- Appels d'outils ou de fonctions et durées d'exécution

- Logique du flux de travail, branchement et flux de décision

- Contexte de suivi au niveau de l'utilisateur/de la session

.webp)

.webp)

Construit sur OpenTelemetry pour l'observabilité de l'IA

Fonctionne sur les API alimentées par LLM, les pipelines RAG, les agents autonomes et les réseaux d'agents complexes.

Profitez de la norme ouverte pour traçage distribué et observabilité de l'IA :

- Compatible avec n'importe quel SDK OpenTelemetry

- Indépendant des fournisseurs, open source et évolutif

- Conçu pour les cas d'utilisation de l'observabilité de l'IA et du traçage des agents

- Inclut une interface utilisateur moderne pour filtrer, interroger et analyser les spans

- Livré avec un backend de collecteur OpenTelemetry pour une ingestion fluide

Tracez un agent à l'autre Interactions

Prenez en charge des cas d'utilisation complexes grâce à un traçage et à une observabilité complets de l'IA

- Suivez les demandes au fur et à mesure qu'elles se déplacent entre plusieurs agents

- Comprenez l'orchestration, la délégation et le routage des tâches multi-agents

- Visualisez les transferts, les appels d'outils et les décisions finales dans une vue unifiée

Intégrations fluides pour Observabilité de l'IA

Connectez facilement votre stack grâce à des intégrations prédéfinies, conçues pour les applications modernes Traçage par IA

.webp)

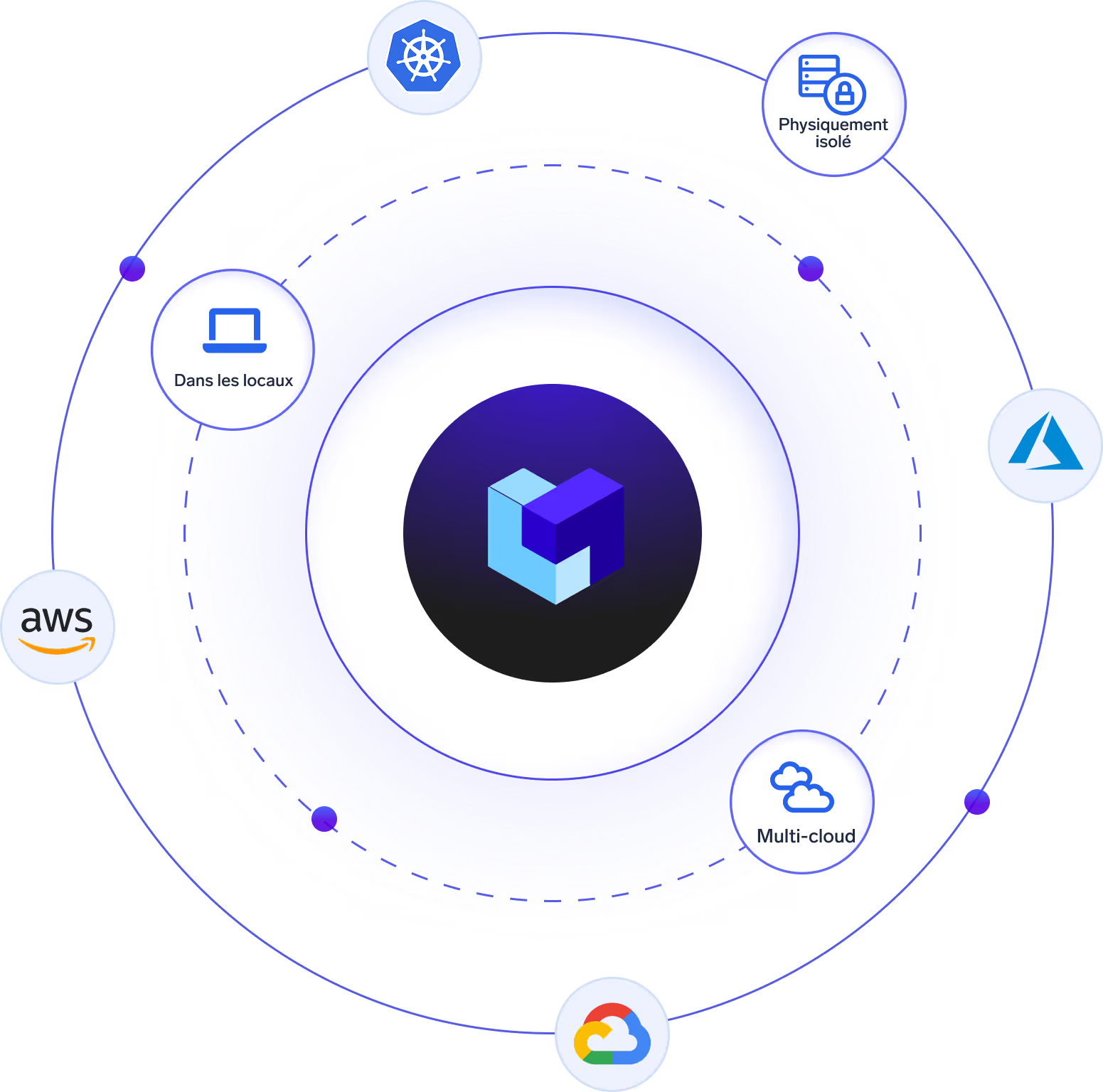

Prêt pour les entreprises

Vos données et modèles sont hébergés en toute sécurité au sein de votre infrastructure cloud ou sur site

Conformité et sécurité

Normes SOC 2, HIPAA et GDPR pour garantir une protection robuste des donnéesGouvernance et contrôle d'accès

SSO + Contrôle d'accès basé sur les rôles (RBAC) et journalisation des auditsSupport et fiabilité pour les entreprises

Assistance 24 h/24 et 7 j/7 avec support SLA SLA de réponse

VPC, sur site, en espace isolé ou sur plusieurs clouds.

Aucune donnée ne quitte votre domaine. Profitez d'une souveraineté totale, d'un isolement et d'une conformité de niveau professionnel partout où TrueFoundry fonctionne

Questions fréquemment posées

Qu'est-ce que l'observabilité de l'IA et pourquoi est-ce important ?

Comment cela permet-il l'observabilité des agents ?

Qu'est-ce que le traçage des agents et comment fonctionne-t-il ?

Est-ce que cela prend en charge LangChain, LLamaIndex ou CrewAI ?

Puis-je utiliser OpenTelemetry pour l'observabilité de l'IA ici ?

vous offre une observabilité évolutive et indépendante des fournisseurs avec un contexte riche et spécifique à l'IA.

Comment suivre l'utilisation des jetons et les coûts des modèles ?

En quoi est-ce différent des outils APM traditionnels ?

GenAI infra- simple, plus rapide et moins cher

Plus de 30 entreprises et sociétés du Fortune 500 nous font confiance