LLMops pour le service de modèles et l'inférence

.webp)

- Déployez n'importe LLM open source au sein de votre pipeline LLMops à l'aide de configurations préconfigurées et optimisées en termes de performances

- S'intègre parfaitement à Hugging Face, registres privés, ou n'importe quel hub de modèles, entièrement géré au sein de votre plateforme LLMops

- Tirez parti de modèles de serveurs de pointe tels que VllM et SG Lang pour une inférence à faible latence et à haut débit

- Activer Mise à l'échelle automatique du GPU, arrêt automatique et provisionnement intelligent des ressources sur l'ensemble de votre infrastructure LLMops.

.webp)

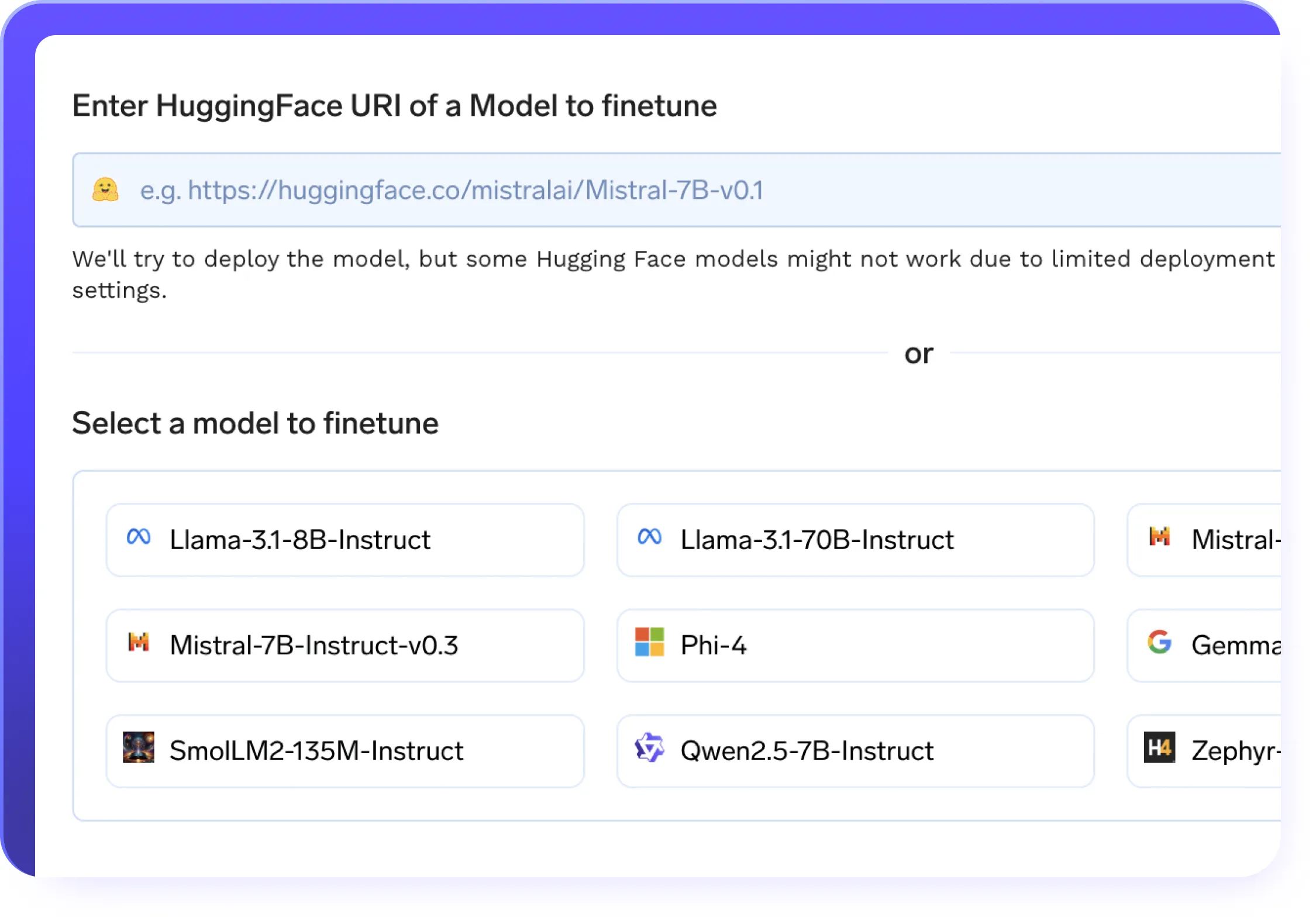

Réglage fin efficace

.webp)

- Prise en charge de l'ajustement sans code et en code complet sur les ensembles de données personnalisés

- LoRa et QLoRa pour une adaptation efficace à un rang inférieur

- Reprenez la formation en toute simplicité avec pointage de contrôle assistance sur l'ensemble de vos pipelines LLMops

- En un clic déploiement de modèles affinés avec les meilleurs modèles de serveurs de leur catégorie

- Canalisations de formation automatisées avec intégration suivi des expériences intégré à vos flux de travail LLMops

- Support de formation distribué pour une optimisation plus rapide et à grande échelle des modèles

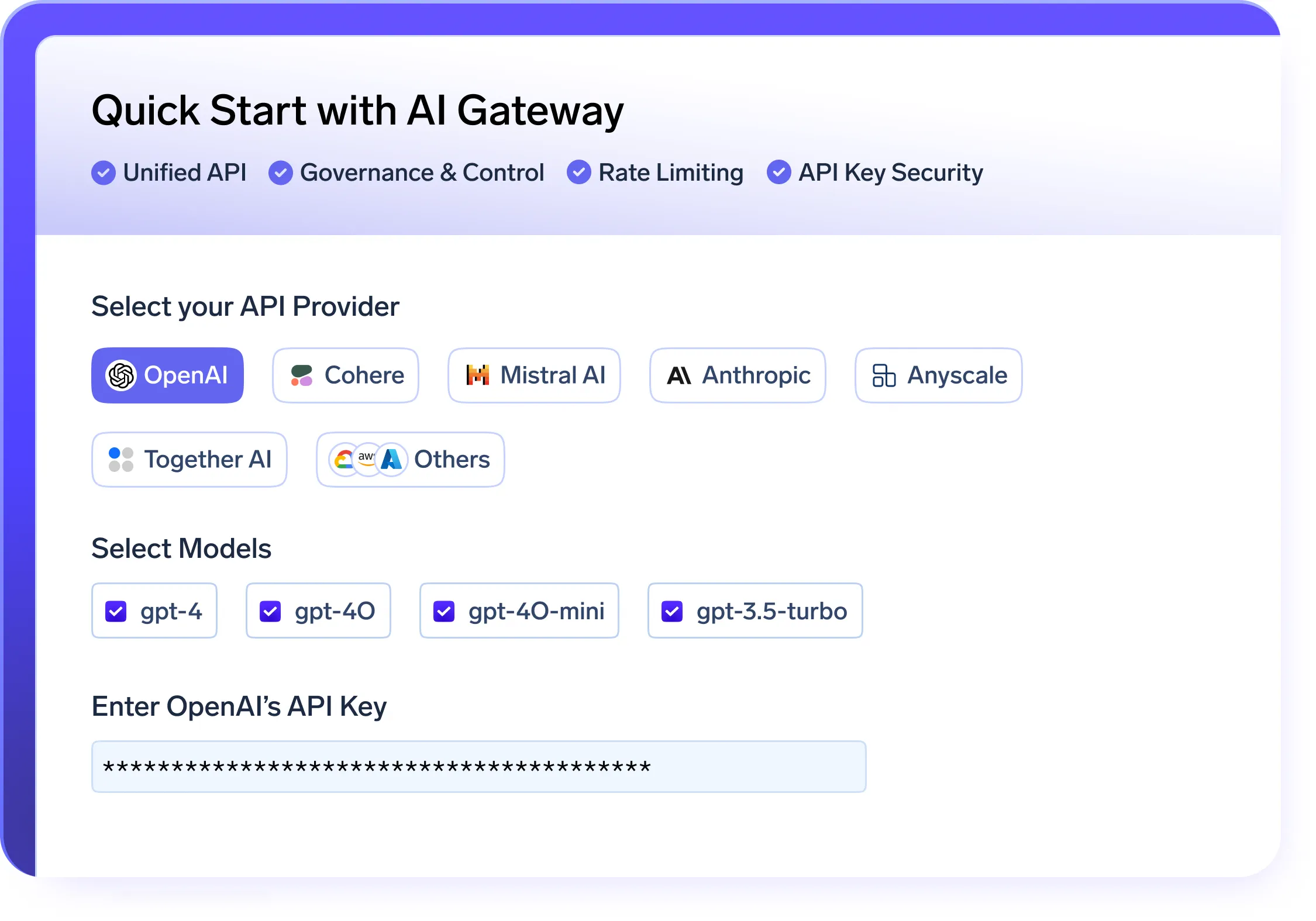

Passerelle IA sécurisée et évolutive

.webp)

- UNE API unifiée couche pour servir et gérer les modèles via OpenAI, LLama, Gemini et d'autres fournisseurs

- Intégré gestion des quotas et un contrôle d'accès pour appliquer une utilisation sécurisée et régulée des modèles au sein de votre plateforme LLMops

- Statistiques en temps réel pour l'utilisation, le coût et les performances afin d'améliorer l'observabilité du LLMOP

- Intelligent repli et nouvelles tentatives automatiques pour garantir la fiabilité de vos pipelines LLMops

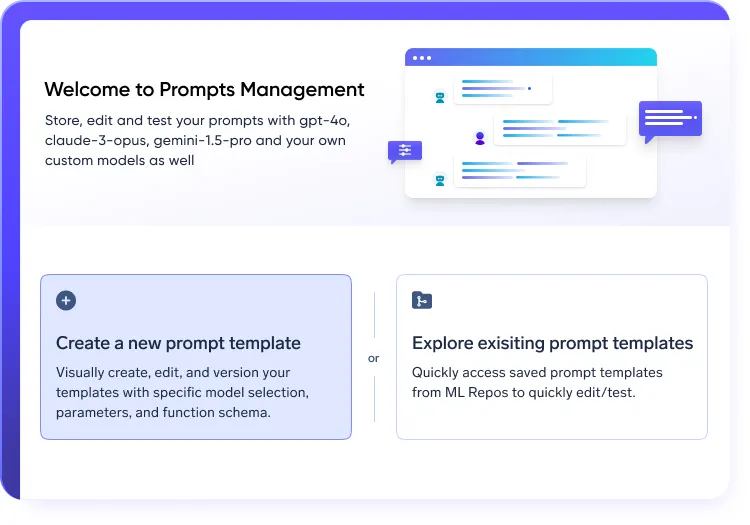

Flux de travail rapides structurés dans la pile LLMops

.webp)

- Expérimentez et itérez en utilisant invite contrôlée par version ingénierie

- Courez Tests A/B sur tous les modèles pour optimiser les performances

- Maintenez une traçabilité complète des modifications rapides au sein de votre plateforme LLMops

Traçage et garde-corps pour les flux de travail LLMops

.webp)

- Capturez traces complètes des invites, des réponses, de l'utilisation des jetons et de la latence

- Surveillez les performances, les taux d'achèvement et les anomalies

- Intégrez avec garde-corps pour la détection des informations personnelles et la modération du contenu dans les pipelines LLMOPS

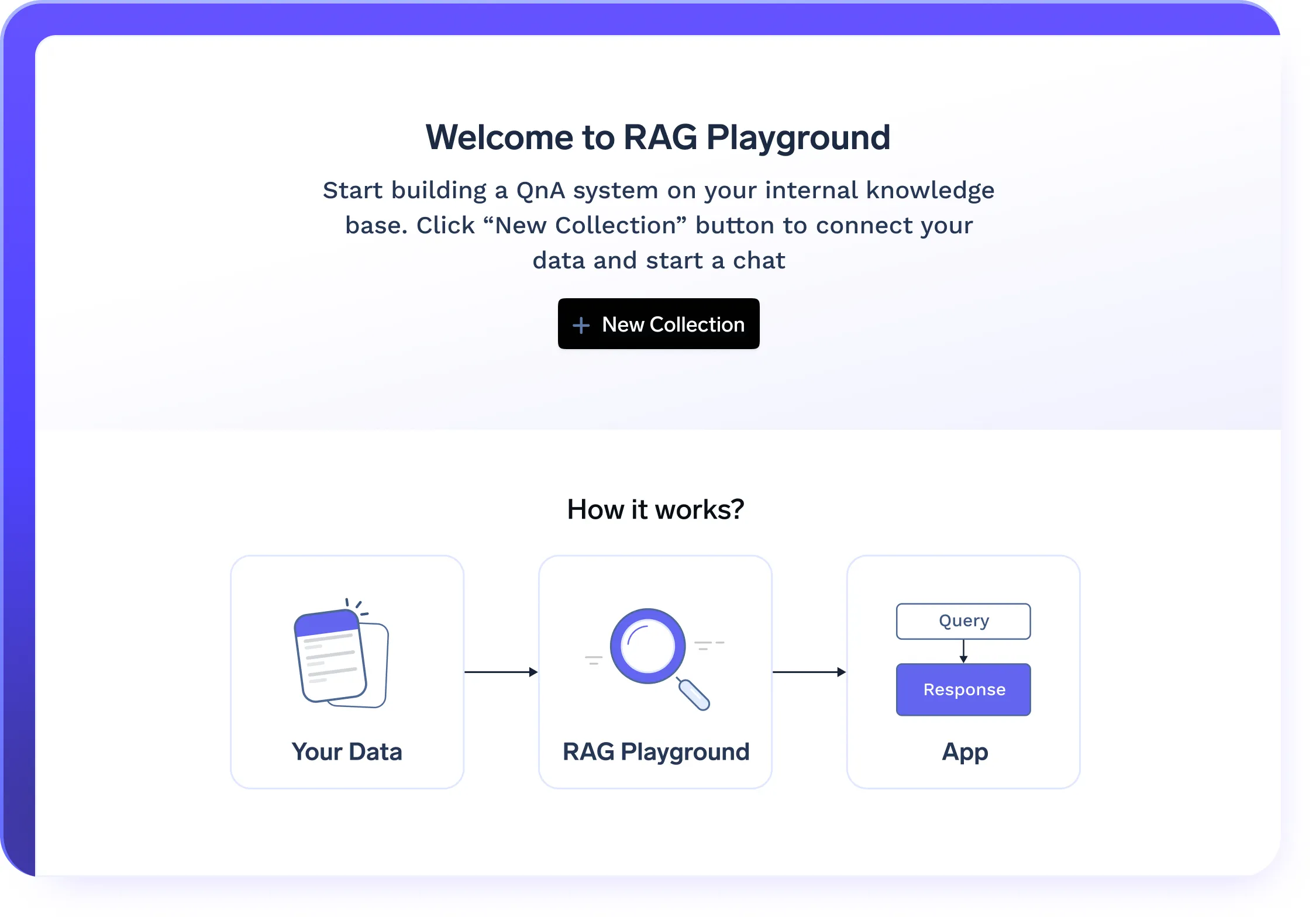

Déploiement de RAG en un clic

.webp)

- Déploie tous les composants RAG en un seul clic, y compris VectorDB, les modèles d'intégration, le frontend et le backend

- Infrastructure configurable pour optimiser le stockage, la récupération et le traitement des requêtes

- Gérez des bases de documents de plus en plus nombreuses grâce à l'évolutivité LLMOPs native du cloud

LLMops pour la gestion du cycle de vie des agents d'IA

.webp)

- Exécutez et faites évoluer des agents sur n'importe quel framework à l'aide de votre infrastructure LLMops

- Support pour LangChain, AutoGen, CrewAI et les agents personnalisés

- Orchestration des agents indépendante du framework avec surveillance LLMOPs intégrée

- Prise en charge de l'orchestration multi-agents, permettant aux agents d'interagir, de partager le contexte et d'exécuter des tâches de manière autonome

.webp)

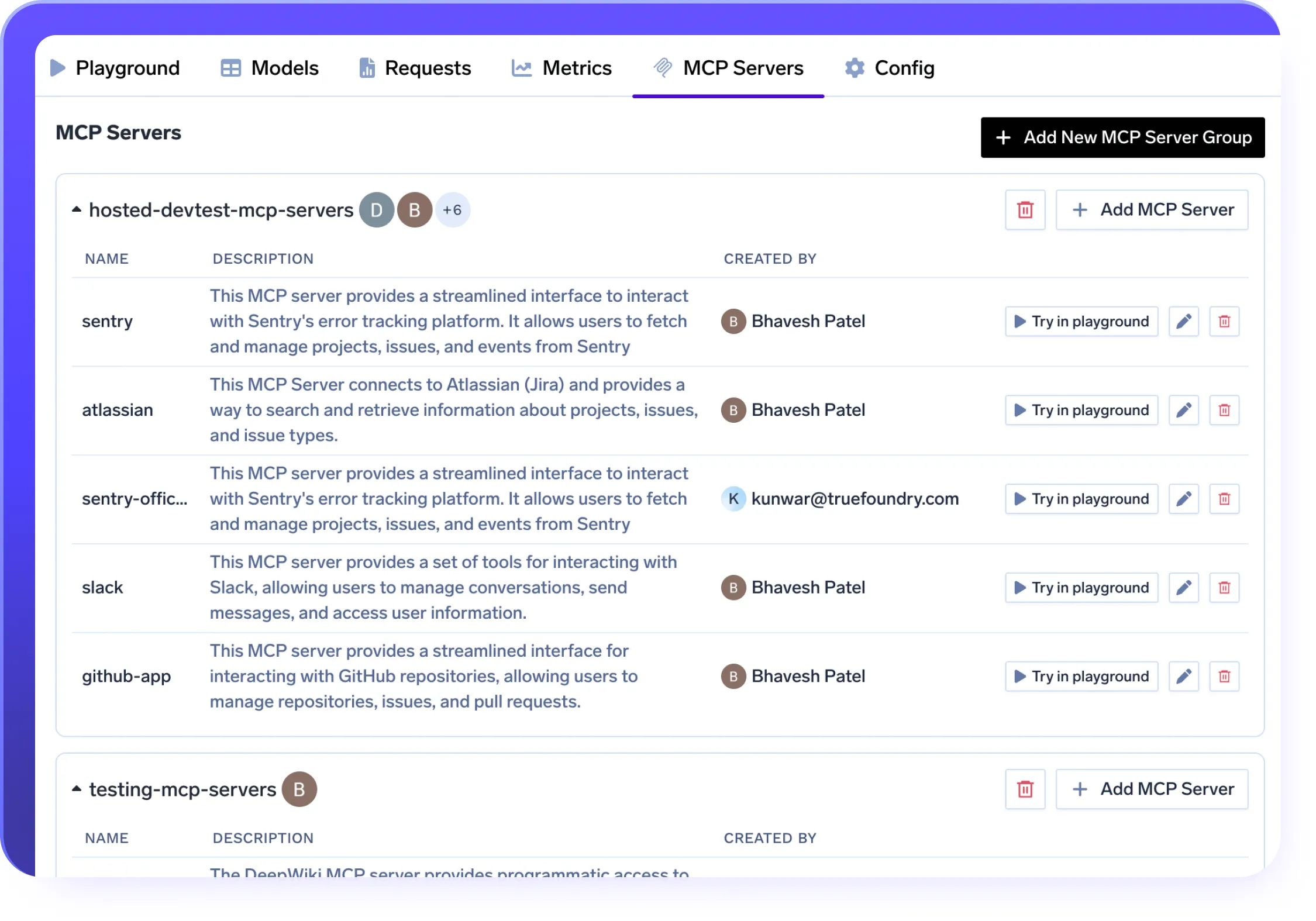

Intégration du serveur MCP dans votre stack LLMops

.webp)

- Connectez en toute sécurité les LLM à des outils tels que Slack, GitHub et Confluence à l'aide du protocole MCP

- Déployez des serveurs MCP dans des configurations VPC, sur site ou isolées avec un contrôle total des données

- Permettez une utilisation native et rapide des outils sans wrappers, entièrement intégrés à votre stack LLMops

- Gérez l'accès avec RBAC, OAuth2 et suivez chaque appel grâce à l'observabilité intégrée

Prêt pour les entreprises

Deploy a secure AI gateway that keeps your data and models within your cloud / on-prem infrastructure.

Conformité et sécurité

Normes SOC 2, HIPAA et GDPR pour garantir une protection robuste des donnéesGouvernance et contrôle d'accès

SSO + Contrôle d'accès basé sur les rôles (RBAC) et journalisation des auditsSupport et fiabilité pour les entreprises

Assistance 24 h/24 et 7 j/7 avec support SLA SLA de réponse

VPC, sur site, en espace isolé ou sur plusieurs clouds.

Aucune donnée ne quitte votre domaine. Profitez d'une souveraineté totale, isolation et conformité de niveau professionnel, où que vous soyez TrueFoundry fonctionne

Questions fréquemment posées

Qu'est-ce que LLMops et pourquoi est-ce important ?

cycle de vie des grands modèles de langage, de la formation et de la mise au point au déploiement, à l'inférence,

le suivi et la gouvernance. LLMops aide les organisations à intégrer les applications GenAI dans

production fiable et à grande échelle. TrueFoundry fournit une plateforme LLMOPS de qualité industrielle

qui simplifie et accélère l'ensemble de ce processus.

En quoi le LLMops est-il différent du MLOP traditionnel ?

modèles de langage de grande taille. Il inclut des fonctionnalités telles que l'orchestration de serveurs modèles, le prompt

gestion, observabilité au niveau des jetons, frameworks d'agents et accès sécurisé aux API.

La plateforme LLMOPS de TrueFoundry gère ces flux de travail spécifiques à GENAI de manière native, contrairement à

outils MLOps génériques.

Pourquoi investir dans une plateforme LLMops dédiée comme TrueFoundry ?

Quelles sont les principales fonctionnalités de la plateforme LLMops de TrueFoundry ?

Puis-je déployer la plateforme LLMOPS de TrueFoundry sur mon infrastructure ?

Comment LLMops améliore-t-il l'observabilité et le débogage ?

La plateforme LLMOPS de TrueFoundry est-elle sécurisée et conforme ?

Quels modèles et frameworks sont pris en charge par la plateforme LLMOPS de TrueFoundry ?

Puis-je utiliser la plateforme LLMops de TrueFoundry pour gérer plusieurs équipes et projets ?

À quelle vitesse puis-je commencer à utiliser TrueFoundry pour LLMOPS ?

GenAI infra- simple, plus rapide et moins cher

Plus de 30 entreprises et sociétés du Fortune 500 nous font confiance