Utilisation des jetons OpenCode : comment cela fonctionne et comment l'optimiser

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Présentation

Les outils de codage assistés par l'IA tels qu'OpenCode modifient fondamentalement la façon dont les développeurs interagissent avec le code. Au lieu de fonctionner sur des extraits isolés, ces systèmes raisonnent en fonction des fichiers, des dépendances et du contexte historique. Il en résulte une augmentation significative de la productivité, mais également un nouveau défi en termes de coûts et d'évolutivité que de nombreuses équipes sous-estiment : utilisation des jetons.

Contrairement aux outils de développement traditionnels dont les coûts de licence sont prévisibles, l'utilisation d'OpenCode est régie par une tarification basée sur des jetons. Chaque interaction, génération de code, refactoring, débogage ou révision consomme des jetons. À mesure que les équipes adaptent l'utilisation aux développeurs, aux référentiels et aux agents automatisés, la consommation de jetons devient le principal facteur de coût.

Ce qui rend cela particulièrement délicat, c'est que l'utilisation des jetons est souvent non intuitif. De petits changements dans la taille du contexte, la structure rapide ou le comportement des agents peuvent entraîner de fortes fluctuations de la consommation de jetons. Sans modèle mental clair de la façon dont les jetons sont utilisés, les équipes ont du mal à prévoir les coûts, à optimiser les flux de travail ou à appliquer des garde-fous.

Ce blog explique comment fonctionne l'utilisation des jetons dans OpenCode au niveau technique, pourquoi les charges de travail liées au code sont particulièrement gourmandes en jetons et ce que les équipes de la plateforme doivent comprendre avant d'étendre l'utilisation en production.

Comment fonctionne l'utilisation des jetons dans OpenCode

À la base, l'utilisation des jetons OpenCode suit les mêmes mécanismes que la plupart des systèmes alimentés par LLM : les jetons sont consommés à la fois pour les entrées et les sorties. Cependant, la nature des charges de travail de codage ajoute une complexité supplémentaire.

Jetons rapides contre jetons d'achèvement

L'utilisation des jetons OpenCode peut être largement divisée en deux catégories :

- Jetons rapides: Tout a été envoyé dans le modèle

- Jetons d'achèvement: Tout ce qui est généré par le modèle

Dans OpenCode, les jetons d'invite incluent généralement :

- L'instruction de l'utilisateur (par exemple, « refactoriser cette fonction »)

- Contexte du code (fichiers, extraits, diffs)

- Instructions ou politiques relatives aux agents au niveau du système

- État de l'outil ou de l'agent (dans les flux de travail en plusieurs étapes)

Les jetons d'achèvement incluent :

- Code généré

- Explications ou commentaires

- Sorties structurées utilisées par les agents ou les outils

Du point de vue des coûts, les jetons rapides sont souvent le facteur dominant dans l'utilisation d'OpenCode, en particulier à mesure que les référentiels et la taille des contextes augmentent.

Pourquoi les charges de travail de code consomment de manière disproportionnée plus de jetons

Les tâches liées au code se comportent très différemment des requêtes en langage naturel. Plusieurs facteurs contribuent à l'augmentation de la consommation de jetons :

1. Les grandes fenêtres contextuelles sont courantes

Contrairement aux cas d'utilisation basés sur le chat, OpenCode envoie souvent :

- Dossiers entiers

- Plusieurs fichiers connexes

- Graphiques de dépendance

- Cas de test ou fichiers de configuration

Même une « petite » base de code peut rapidement se traduire en dizaines ou centaines de milliers de jetons lorsque plusieurs fichiers sont inclus.

2. Les jetons structurels s'additionnent

Le code source est dense. La syntaxe, l'indentation, les symboles et la mise en forme comptent tous pour les jetons. Quelques milliers de lignes de code peuvent consommer bien plus de jetons qu'une quantité équivalente de texte brut.

3. Raisonnement et itération en plusieurs étapes

Les flux de travail OpenCode impliquent fréquemment :

- Étapes de planification

- Génération de code

- Validation

- Corrections ou nouvelles tentatives

Chaque étape peut renvoyer du contexte ou des sorties intermédiaires, multipliant ainsi l'utilisation des jetons sur une seule tâche.

4. L'exécution basée sur des agents amplifie l'utilisation

Lorsqu'OpenCode est utilisé par le biais d'agents ou d'une automatisation (par exemple, lors de la refactorisation de plusieurs fichiers ou de l'exécution dans des pipelines CI), l'utilisation des jetons augmente rapidement :

- Le contexte est réutilisé à travers les étapes

- L'état intermédiaire est transmis à plusieurs reprises

- Les nouvelles tentatives se produisent automatiquement

Cela rend l'utilisation pilotée par les agents puissante mais également coûteuse si elle n'est pas limitée.

Pourquoi l'utilisation des jetons est difficile à prévoir sans instrumentation

L'un des plus grands défis liés à l'utilisation des jetons OpenCode est que les développeurs voient rarement le contexte complet envoyé au modèle. Éditeurs et outils de manière abstraite :

- Quels fichiers ont été inclus

- Quelle quantité de chaque fichier a été envoyée

- Si les sorties précédentes ont été réutilisées comme contexte

Par conséquent, deux tâches apparemment similaires peuvent avoir des empreintes symboliques très différentes. Sans suivi explicite au niveau de la demande, les équipes découvrent souvent les problèmes de coûts uniquement après les pics d'utilisation.

C'est pourquoi comprendre la mécanique des jetons ne suffit pas à lui seul. Les équipes ont besoin visibilité de la consommation réelle de jetons par tâche, par développeur et par flux de travail pour prendre des décisions d'optimisation éclairées.

Scénarios courants qui entraînent une utilisation élevée des jetons OpenCode

La plupart des pics d'utilisation des jetons OpenCode ne sont pas causés par une seule erreur évidente. Ils découlent de la manière dont OpenCode est utilisé dans les flux de travail d'ingénierie du monde réel, en particulier lorsque les outils et les agents sont profondément intégrés dans les pipelines de développement et d'automatisation.

Vous trouverez ci-dessous les scénarios les plus courants qui augmentent de manière disproportionnée la consommation de jetons.

1. Référentiel volumineux ou injection de contexte multi-fichiers

L'un des principaux contributeurs à l'utilisation élevée des jetons est inclusion contextuelle trop large. De nombreux flux de travail OpenCode incluent des répertoires entiers ou de grands sous-ensembles d'un référentiel pour « garantir leur sécurité », même lorsque seule une petite partie du code est pertinente.

Les exemples incluent :

- Envoi de répertoires de services complets pour un seul changement de fonction

- Inclure inutilement des suites de tests et des fichiers de configuration

- Renvoi des mêmes fichiers en plusieurs étapes dans le flux de travail d'un agent

Étant donné que les jetons rapides évoluent de manière linéaire en fonction de la taille du contexte, ce modèle à lui seul peut rapidement multiplier les coûts.

2. Réhydratation contextuelle répétée au fil des itérations

OpenCode fonctionne souvent de manière itérative : générer du code, réviser, ajuster, régénérer. Dans de nombreuses configurations, chaque itération renvoie le contexte complet, y compris les fichiers et les sorties précédentes.

Cela conduit à :

- Consommation de jetons dupliquée lors des nouvelles tentatives

- Croissance exponentielle de l'utilisation pour les tâches de longue durée

- Coûts élevés, même pour des modifications « simples » nécessitant plusieurs itérations

Sans mise en cache ni réutilisation intelligente du contexte, l'itération devient l'un des modèles les plus coûteux.

3. Exécution illimitée des agents

Lorsqu'OpenCode est utilisé via des agents ou des flux de travail automatisés, l'utilisation des jetons peut augmenter rapidement si l'exécution n'est pas explicitement limitée.

Les causes courantes incluent :

- Agents sans limite maximale d'étapes ou de nouvelles tentatives

- Chaînes de raisonnement récursives

- Les agents réévaluent les grands contextes à chaque étape

Comme ces processus s'exécutent souvent en arrière-plan, les équipes peuvent ne pas remarquer une utilisation excessive avant une hausse des coûts.

4. Tâches de refactorisation et de révision de code à grande échelle

Les tâches de refactorisation et de révision sont généralement plus gourmandes en jetons que la génération de code, car elles nécessitent :

- Lecture et raisonnement sur le code existant

- Comparaison des anciennes et des nouvelles implémentations

- Expliquer ou valider les modifications

Lorsque ces tâches sont appliquées à de grandes bases de code ou à plusieurs pull requests, l'utilisation des jetons augmente considérablement.

5. Emplois en CI, automatisation et arrière-plan

L'utilisation d'OpenCode intégrée dans les pipelines CI ou les flux de travail d'automatisation introduit un profil de risque différent. Ces systèmes :

- Exécuter fréquemment et automatiquement

- Traitent souvent des diffs ou des référentiels importants

- Peut réessayer silencieusement en cas d'échec

Même une utilisation modeste de jetons par exécution peut devenir coûteuse si elle est multipliée sur de nombreux builds ou déploiements.

6. Manque de visibilité au niveau de l'utilisateur ou de la tâche

Enfin, l'un des facteurs les plus négligés de l'utilisation élevée de jetons est l'absence de visibilité. Quand les équipes ne peuvent pas voir :

- Qui consomme des jetons

- Quelles sont les tâches les plus coûteuses

- Comment l'utilisation évolue au fil du temps

L'optimisation devient une conjecture. Les équipes réagissent souvent en limitant l'utilisation à l'échelle mondiale, plutôt que de s'occuper des flux de travail spécifiques qui génèrent des coûts.

Meilleures pratiques pour optimiser l'utilisation des jetons OpenCode

Une fois que les équipes ont compris d'où vient l'utilisation des jetons, l'étape suivante est l'optimisation. Il est important de noter que l'optimisation ne consiste pas à limiter arbitrairement l'utilisation, mais à utilisation intentionnelle de jetons afin que les gains de productivité ne se transforment pas en coûts incontrôlés.

Vous trouverez ci-dessous les meilleures pratiques pratiques qui réduisent régulièrement l'utilisation des jetons OpenCode sans dégrader la qualité de sortie.

1. Réduire délibérément la taille du contexte

Le levier d'optimisation le plus efficace est contrôler le contexte envoyé au modèle. Plus de contexte n'est pas toujours préférable, surtout lorsque cela n'est pas pertinent.

Les techniques pratiques incluent :

- Passage contexte au niveau du fichier au lieu de répertoires entiers

- Incluant uniquement les fonctions ou les classes en cours de modification

- Exclusion des fichiers générés, du code fournisseur et des configurations volumineuses par défaut

Une bonne règle de base : si un fichier n'est pas obligatoire raison du changement, cela ne devrait pas faire partie de l'invite.

2. Préférez la récupération au remplissage contextuel

Au lieu d'envoyer de grandes quantités de code à l'avance, les équipes devraient s'orienter vers récupération à la demande.

Exemples :

- Récupérez les symboles ou les définitions uniquement lorsqu'ils sont référencés

- Récupérez les cas de test ou les configurations de manière conditionnelle

- Utilisez des recherches indexées plutôt que l'injection de contexte statique

Cette approche réduit la taille du prompt tout en améliorant souvent la qualité du raisonnement, car le modèle reçoit des informations plus ciblées.

3. Scope invite à la tâche, pas au référentiel

Les invites génériques ont tendance à encourager un raisonnement plus large et des résultats plus importants, ce qui augmente à la fois le nombre de points d'invite et de complétion.

De meilleurs modèles :

- Contraindre explicitement la tâche (« modifier uniquement cette fonction »)

- Spécifier le format de sortie et les limites

- Évitez les instructions ouvertes telles que « analyser la base de code »

Les instructions à portée de tâche réduisent non seulement l'utilisation des jetons, mais améliorent également le déterminisme.

4. Exécution explicite de l'agent lié

Les flux de travail basés sur des agents amplifient l'utilisation des jetons s'ils ne sont pas cochés. Chaque agent doit opérer dans des limites clairement définies.

Les principaux garde-corps sont les suivants :

- Nombre maximum d'étapes de raisonnement

- Limites strictes en matière de nouvelles tentatives

- Budgets temporels ou symboliques par tâche

Sans ces limites, les agents peuvent retraiter involontairement des contextes volumineux à plusieurs reprises, ce qui augmente leur utilisation.

5. Mettre en cache et réutiliser dans la mesure du possible

De nombreux flux de travail OpenCode répètent des tâches similaires d'une itération à l'autre ou d'un utilisateur à l'autre. La mise en cache peut réduire de manière significative la consommation de jetons redondants.

Scénarios applicables :

- Réutilisation des résultats d'analyse lors des nouvelles tentatives

- Mise en cache de représentations intermédiaires dans des flux à plusieurs étapes

- Éviter la génération répétée d'explications lorsque cela n'est pas nécessaire

Même une mise en cache partielle au niveau du flux de travail peut permettre de réaliser des économies significatives.

6. Optimisez la taille d'achèvement, pas seulement les instructions

Alors que les jetons rapides dominent souvent, les jetons de complétion sont également importants, en particulier dans les flux de travail de refactorisation ou riches en explications.

Les techniques incluent :

- Demandant diffs au lieu de fichiers complets

- Explications limitatives sauf si cela est explicitement nécessaire

- Appliquer la longueur ou la structure de sortie

Des contraintes de sortie claires réduisent la verbosité inutile.

7. Utilisation précoce des jetons d'instruments

Enfin, l'optimisation ne doit pas être réactive. Les équipes doivent instrumenter l'utilisation des jetons dès le premier jour.

Cela signifie au minimum le suivi :

- Jetons par demande

- Jetons par utilisateur ou par flux de travail

- Coût par tâche au fil du temps

Sans ces données, les équipes ne peuvent pas faire la distinction entre utilisation productive et gaspillage.

Pourquoi l'utilisation des jetons OpenCode devient difficile à contrôler à grande échelle

La plupart des équipes n'ont pas de difficultés à utiliser les jetons OpenCode dès le premier jour. Les problèmes apparaissent progressivement à mesure que l'utilisation se répand entre les développeurs, les référentiels et les flux de travail automatisés. Ce qui n'est au départ qu'un outil de productivité individuel devient rapidement une infrastructure partagée et l'utilisation des jetons évolue d'une manière difficile à prévoir ou à gérer.

1. L'utilisation des jetons est distribuée à de nombreux acteurs

À grande échelle, OpenCode n'est plus utilisé par un seul développeur dans un éditeur. Il est utilisé par :

- Plusieurs ingénieurs répartis dans différentes équipes

- Agents d'arrière-plan exécutant des flux de travail de longue durée

- Tâches de CI et d'automatisation déclenchées fréquemment

- Outils internes basés sur OpenCode

Chacun de ces consommateurs génère une utilisation de jetons de manière indépendante. Sans une vue centralisée, il devient difficile de répondre à des questions de base telles que qui utilise des jetons, dans quel but, et à quel prix.

2. Les contrôles au niveau de l'application ne sont pas généralisés

Les premiers efforts d'optimisation sont souvent mis en œuvre au niveau de l'application ou de l'outil, des limites d'invite personnalisées, du découpage du contexte ou de la logique de nouvelle tentative. Bien que ceux-ci soient utiles au niveau local, ils ne s'étendent pas à :

- Différents éditeurs ou intégrations IDE

- Plusieurs services alimentés par OpenCode

- Frameworks d'agents dotés de leurs propres boucles d'exécution

Par conséquent, les politiques deviennent fragmentées et incohérentes. Une équipe optimise de manière agressive tandis qu'une autre augmente les coûts sans le savoir.

3. L'automatisation amplifie les petites inefficacités

L'automatisation change les règles du jeu. Un flux de travail qui consomme un petit nombre de jetons par exécution peut devenir coûteux lorsque :

- Déclenché à chaque pull request

- Exécuté dans plusieurs succursales

- Réessayé silencieusement en cas de panne passagère

Comme ces tâches sont exécutées sans visibilité humaine directe, les inefficacités s'aggravent rapidement. Les pics d'utilisation des jetons proviennent souvent de l'automatisation plutôt que de l'utilisation interactive.

4. L'absence d'attribution masque les véritables moteurs

Sans attribution précise, les équipes ne voient que des chiffres d'utilisation agrégés. Cela rend l'optimisation réactive et directe.

Les modes de défaillance courants incluent :

- Limites d'utilisation générales qui réduisent la productivité

- Désactivation de flux de travail utiles en raison de surprises en matière de coûts

- Optimisation des mauvaises tâches alors que les flux à coûts élevés persistent

Un contrôle efficace nécessite de savoir quels flux de travail génèrent de la valeur et lesquels génèrent des déchets quelque chose que les statistiques agrégées ne peuvent pas révéler.

5. La gouvernance et le contrôle des coûts sont en retard par rapport à l'adoption

Dans de nombreuses organisations, l'adoption d'outils d'IA dépasse celle de la gouvernance. L'utilisation d'OpenCode se propage plus rapidement que :

- La propriété du budget est définie

- Les politiques sont formalisées

- Des garde-corps sont mis en place

Au moment où l'utilisation des jetons devient une préoccupation, l'outillage est déjà profondément intégré aux flux de travail, ce qui rend les contrôles rétroactifs difficiles et perturbateurs.

Qu'est-ce que cela signifie pour les équipes de la plateforme ?

Le problème principal n'est pas une mauvaise utilisation, c'est utilisation décentralisée sans contrôle centralisé. À mesure qu'OpenCode devient une infrastructure partagée, l'utilisation des jetons doit être gérée de la même manière que les équipes gèrent les ressources de calcul, de stockage ou de CI.

Cela nécessite :

- Visibilité centralisée sur les utilisateurs et les flux de travail

- Application cohérente des limites et des politiques

- Attribution qui aligne le coût sur la propriété

Sans ce changement, l'utilisation des jetons reste imprévisible et les efforts d'optimisation restent réactifs.

Surveillance et gestion de l'utilisation des jetons OpenCode en production

Une fois que l'utilisation d'OpenCode atteint l'échelle de production, le suivi ad hoc et les optimisations manuelles cessent de fonctionner. À ce stade, l'utilisation des jetons doit être traitée comme n'importe quelle autre ressource d'infrastructure partagée : mesuré en continu, géré de manière centralisée et lié à la propriété.

Pourquoi la surveillance au niveau des applications n'est pas suffisante

De nombreuses équipes commencent par suivre l'utilisation des jetons dans des outils ou des flux de travail individuels. Bien que cela fournisse des informations locales, cela se décompose rapidement lorsque :

- Plusieurs éditeurs ou IDE sont utilisés

- OpenCode est intégré aux outils internes

- Les agents et l'automatisation sont exécutés en dehors des flux de travail des développeurs

Chaque intégration rend compte de l'utilisation différemment, et aucune n'offre une vue d'ensemble. Par conséquent, les équipes de la plateforme ne disposent pas d'une source fiable unique pour la consommation de jetons.

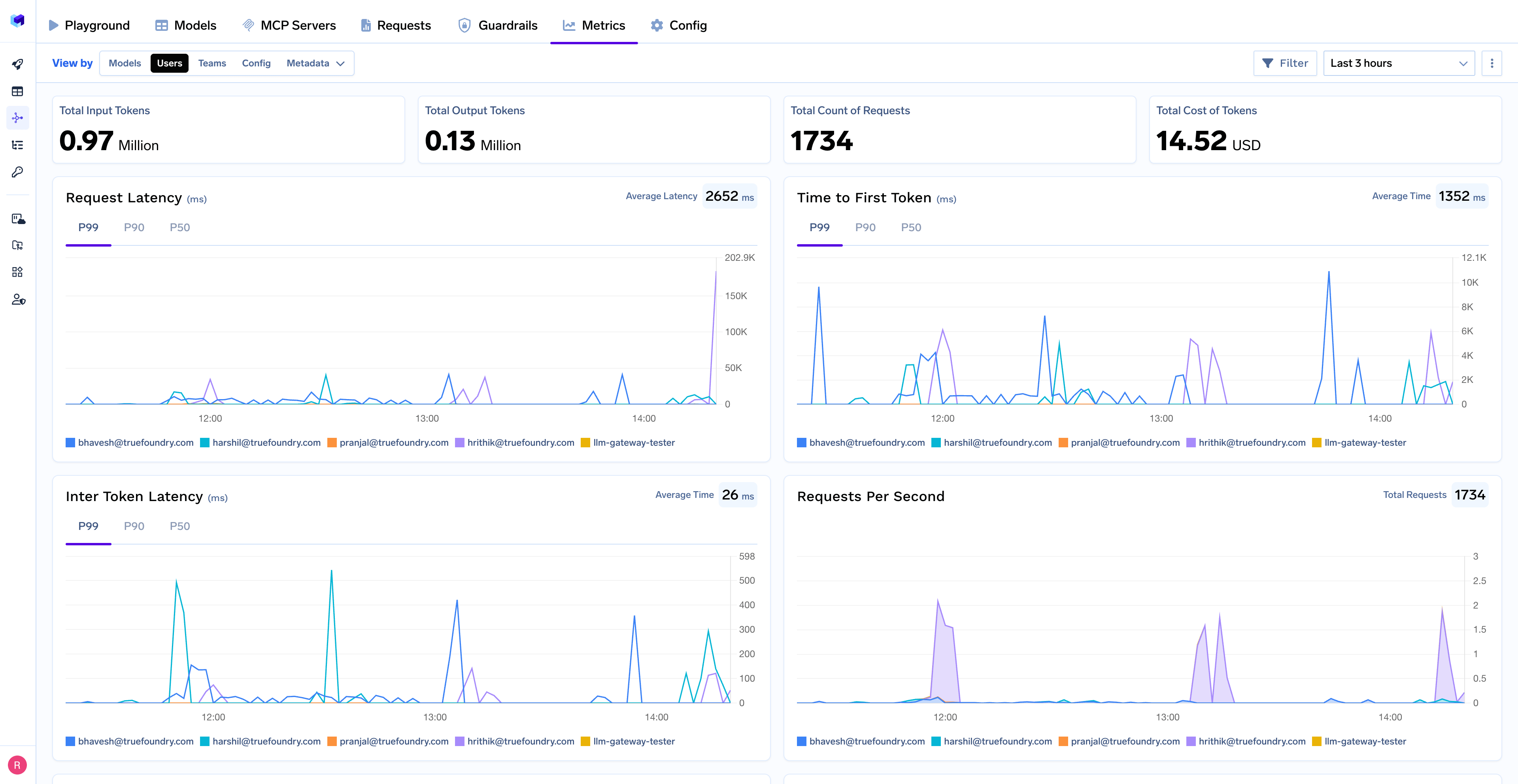

À quoi ressemble une surveillance efficace des jetons

À grande échelle, la surveillance doit se faire au niveau de demande, et pas seulement au niveau de l'outil. Capture efficace des configurations :

- Jetons consommés par demande (invite + achèvement)

- Coût par demande basé sur le modèle de tarification

- Contexte d'identité (utilisateur, service, agent, dépôt, environnement)

- Modes de latence, de nouvelles tentatives et d'échec

Cela permet aux équipes de répondre à des questions telles que :

- Quels flux de travail sont les plus coûteux par cycle ?

- Quels dépôts ou agents favorisent une utilisation durable ?

- Où les nouvelles tentatives ou les échecs font-ils gonfler le nombre de jetons ?

Sans cette granularité, les efforts d'optimisation restent grossiers et souvent mal orientés.

Attribution des coûts et propriété

La gouvernance commence par l'attribution. L'utilisation des jetons doit être mappée aux propriétaires qui peuvent agir en conséquence.

Les modèles d'attribution courants incluent :

- Par développeur ou par équipe

- Par référentiel ou projet

- Par flux de travail ou pipeline d'automatisation

Une fois que la propriété est claire, les discussions sur les coûts passent d'une budgétisation abstraite à des décisions concrètes concernant les flux de travail offrant une valeur suffisante.

Application des politiques et garde-corps

Le suivi à lui seul ne permet pas d'éviter les dépassements de coûts. Les systèmes de production nécessitent mécanismes d'exécution qui fonctionnent en temps réel.

Les garde-corps typiques incluent :

- Budgets de jetons par utilisateur ou par équipe

- Limites de débit pour les flux de travail à haute fréquence

- Capuchons rigides pour agents de fond

- Limites basées sur l'environnement (par exemple, limites plus strictes dans le CI)

Ces contrôles doivent être appliqués de manière centralisée afin que tous les flux de travail alimentés par OpenCode en héritent automatiquement.

Pourquoi la centralisation est-elle importante ?

Le fil conducteur de toutes les structures de gouvernance efficaces est centralisation. Les politiques, les limites et la visibilité relatives à l'utilisation des jetons doivent exister à un point de contrôle partagé plutôt que d'être réimplémentées entre les outils.

C'est là que les plateformes orientées vers l'infrastructure telles que True Foundry s'adapte naturellement. En centralisant le trafic d'IA, l'observabilité et l'application des politiques, les équipes de la plateforme peuvent gérer l'utilisation des jetons OpenCode de manière cohérente entre les développeurs, les agents et les systèmes automatisés, sans ralentir les équipes individuelles.

Gestion de l'utilisation des jetons OpenCode avec TrueFoundry

Du point de vue de la plate-forme, le principal défi lié à l'utilisation des jetons OpenCode est le manque de compréhension comment les jetons sont consommés, mais où le contrôle et la visibilité devraient résider.

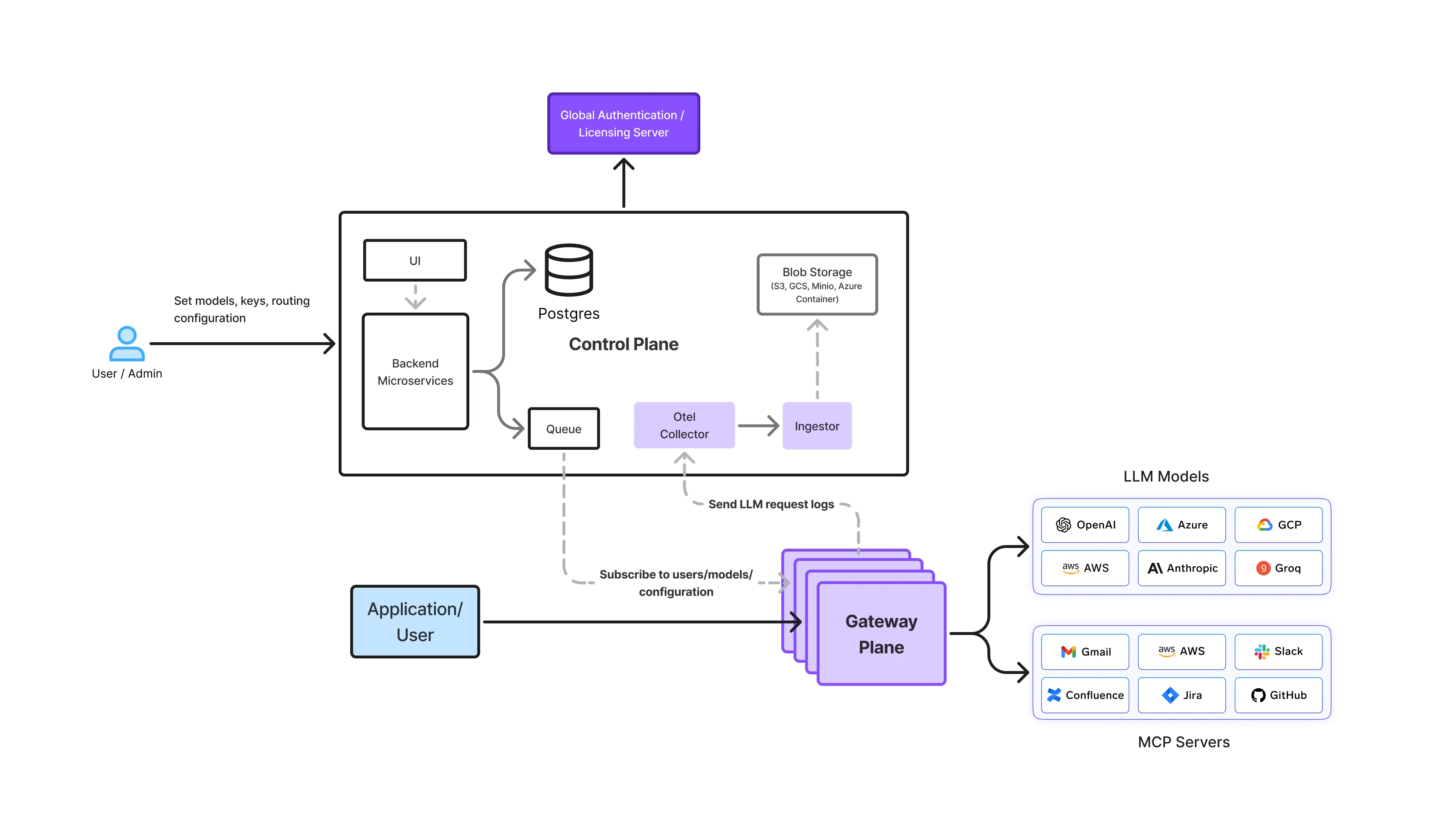

TrueFoundry aborde ce problème en traitant l'utilisation de l'IA et du LLM, y compris les outils destinés aux développeurs tels qu'OpenCode, comme une infrastructure partagée qui doit être observable, gérable et soucieuse des coûts par défaut. Au cœur de cette approche se trouve le Passerelle IA, qui fait office de plan de contrôle pour tout le trafic LLM au sein de l'organisation.

Centralisation du trafic OpenCode via la passerelle AI

Dans une configuration TrueFoundry, OpenCode n'interagit pas directement avec les fournisseurs LLM sous-jacents. Au lieu de cela, toutes les demandes passent par l'AI Gateway, qui fournit une interface unique et cohérente pour l'inférence.

Sur le plan architectural, cela permet de :

- Un point d'entrée unique pour toutes les requêtes générées par OpenCode

- Gestion uniforme du trafic rapide et complet

- Application centralisée des limites, des politiques et du routage

En supprimant l'accès direct aux modèles depuis les outils individuels, les équipes de la plateforme bénéficient d'une visibilité complète sur la manière dont OpenCode est réellement utilisé par les développeurs, les agents et l'automatisation.

L'observabilité au niveau des jetons en tant que primitive de première classe

La passerelle IA de TrueFoundry capture utilisation des jetons au niveau de la demande, y compris :

- Jetons rapides ou jetons de complétion

- Modèle et fournisseur utilisés

- Signaux de latence, de nouvelles tentatives et d'échec

- Contexte d'identité (utilisateur, équipe, service, environnement)

Il est essentiel que cette télémétrie ne soit pas bloquée dans un système contrôlé par le fournisseur. Les journaux et les métriques sont conservés dans le cloud et le stockage du client, ce qui permet aux équipes de :

- Exécuter une analyse personnalisée des modèles d'utilisation des jetons

- Corréler l'utilisation d'OpenCode avec les dépôts, les tâches CI ou les incidents

- Conservez la pleine propriété des données sensibles relatives aux instructions et aux codes

Cela permet d'éviter le problème de « boîte noire » courant avec les outils d'IA et permet une optimisation à long terme.

Attribution des coûts et application des politiques au niveau de la plateforme

Étant donné que tout le trafic OpenCode passe par la passerelle, des contrôles des coûts peuvent être appliqués de manière cohérente et en temps réel.

Les équipes de la plateforme peuvent :

- Attribuez l'utilisation des jetons aux développeurs, aux équipes ou aux projets

- Appliquez des budgets par équipe ou par environnement

- Appliquez des limites de débit ou des plafonds aux flux de travail pilotés par les agents

- Différencier les contrôles entre l'utilisation interactive et l'automatisation

Ces politiques sont appliquées une fois sur la passerelle et s'appliquent automatiquement à chaque flux de travail basé sur OpenCode sans nécessiter de modifications des éditeurs, des plugins ou des outils internes.

Soutenir l'évolutivité, l'automatisation et les flux de travail basés sur des agents

L'architecture de TrueFoundry est conçue pour les environnements dans lesquels l'utilisation d'OpenCode s'étend au-delà de l'IDE. Les pipelines CI, les tâches en arrière-plan et les agents génèrent souvent la consommation de jetons la plus importante et la moins visible.

En acheminant ces charges de travail via la même passerelle IA, les équipes peuvent :

- Détectez l'exécution incontrôlée des agents à un stade précoce

- Comparez les modèles d'utilisation interactifs et automatisés

- Appliquez des contrôles plus stricts aux charges de travail non interactives

Cela permet d'étendre l'utilisation d'OpenCode à l'échelle de l'organisation sans perdre en prévisibilité ni en contrôle.

Conclusion

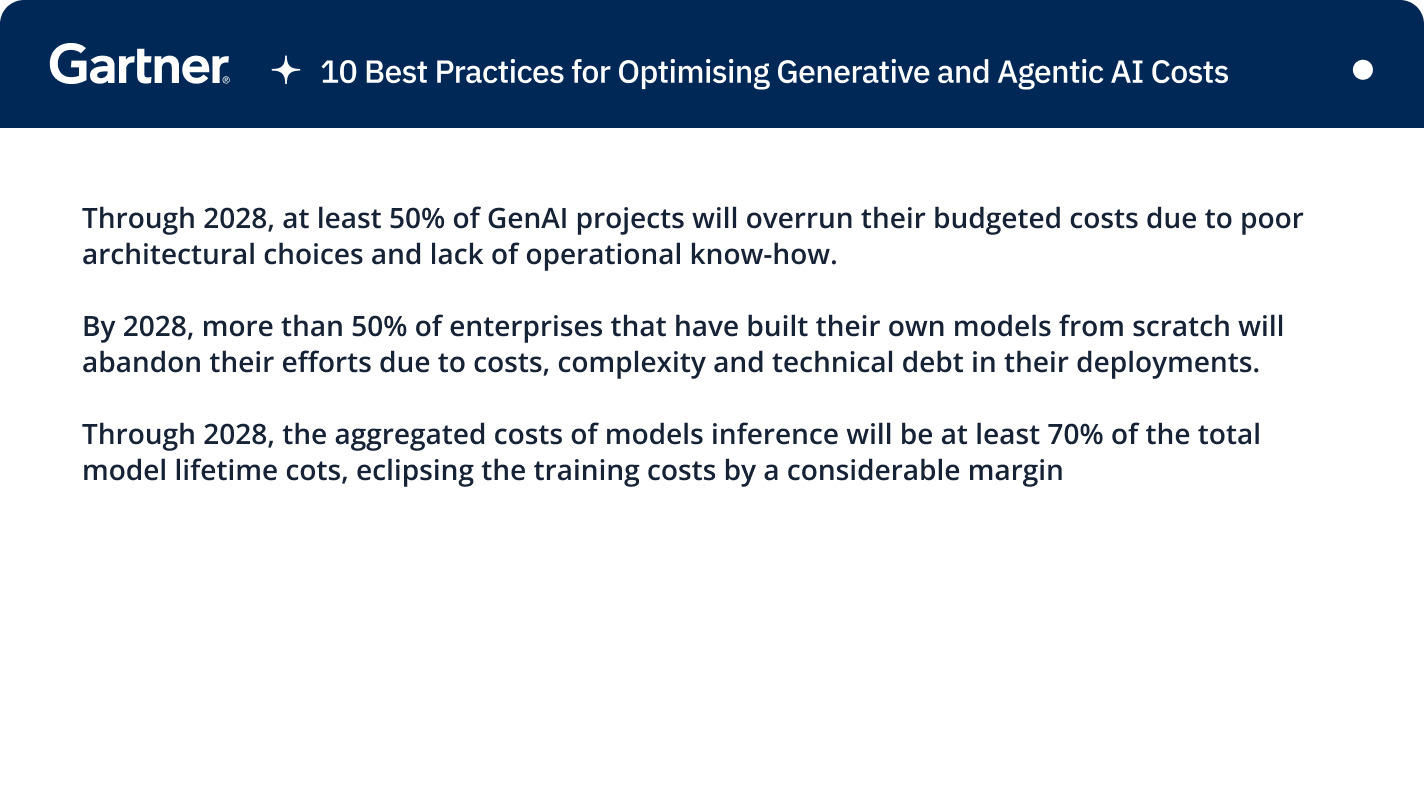

L'utilisation des jetons OpenCode est la véritable contrainte d'échelle pour le codage assisté par l'IA. À mesure que l'utilisation se propage entre les développeurs, les référentiels, l'automatisation et les agents, la consommation de jetons devient difficile à prévoir et à contrôler sans visibilité et gouvernance centralisées.

La gestion de cela au niveau de l'outil ou de l'application n'est pas évolutive. L'utilisation des jetons nécessite une observabilité au niveau de la demande, une attribution claire et une application en temps réel, en traitant le codage assisté par l'IA comme une infrastructure partagée et non comme une fonctionnalité isolée.

Des plateformes comme True Foundry reflètent cette approche en centralisant le trafic OpenCode via une passerelle IA, permettant aux équipes de surveiller, de gouverner et d'optimiser l'utilisation des jetons de manière cohérente. Pour les responsables des plateformes et de l'ingénierie, le point à retenir est simple : si OpenCode est au cœur de la conception des logiciels, l'utilisation des jetons doit être gérée avec la même rigueur que toute autre ressource d'infrastructure critique.

Questions fréquemment posées

Comment vérifier l'utilisation des jetons dans OpenCode ?

La vérification précise de l'utilisation des jetons OpenCode nécessite un suivi et une instrumentation explicites au niveau de la demande. Étant donné que les outils résument souvent le contexte complet envoyé au modèle, il est essentiel de disposer d'une visibilité sur la consommation réelle de jetons par tâche, développeur et flux de travail pour prévoir les coûts et optimiser efficacement votre utilisation.

Quelle est l'utilisation des jetons OpenCode ?

L'utilisation des jetons Opencode est le modèle de tarification basé sur les jetons pour les outils de codage assistés par l'IA tels qu'OpenCode. Chaque interaction, qu'il s'agisse des invites de saisie et du contexte du code, du code généré et des explications, consomme des jetons. La gestion de cette utilisation de jetons OpenCode est cruciale car elle devient le principal facteur de coûts pour les équipes de développement aux États-Unis.

Comment réduire l'utilisation des jetons dans OpenCode ?

Pour réduire l'utilisation des jetons OpenCode, limitez l'injection de contexte aux seuls fichiers essentiels, en évitant d'inclure de nombreux référentiels. Empêchez la réhydratation répétée du contexte en réutilisant intelligemment les résultats au fil des itérations. Décomposez les tâches complexes en étapes plus petites et utilisez des instructions précises. Le suivi de la consommation de jetons pour chaque tâche fournit des informations essentielles pour optimiser les coûts et l'efficacité.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)