TrueFoundry contre Apigee (Google) : pourquoi un plan de contrôle IA spécialement conçu surpasse une stratégie MCP axée sur la gestion des API

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

§0 — TL ; DR et sélection rapide

Scénario réel : des API aux agents

Une grande entreprise utilise déjà Apigee pour ses API internes et celles de ses partenaires. L'équipe d'IA souhaite désormais permettre aux agents d'utiliser ces API comme outils. À première vue, la réponse semble évidente : il suffit d'exposer les API via le support Apigee MCP et de réutiliser la pile de politiques existante.

Cela vous permet de faire un bout de chemin.

Mais le véritable système de production comporte d'autres éléments mobiles :

- sélection du modèle et basculement,

- des budgets et des quotas symboliques,

- gestion rapide des versions,

- découverte et curation d'outils,

- vérifications des politiques avant et après l'outil,

- courtage d'informations d'identification entre l'utilisateur et l'outil,

- des traces qui relient les appels de modèles aux appels d'outils,

- modèles de déploiement pour les environnements auto-hébergés et réglementés.

Apigee aborde clairement une partie de cette surface. Adresses TrueFoundry le tout en tant que limite de produit d'IA de première classe. [4] [5] [6] [7] [8] [9] [10] [11]

Sélection rapide éditoriale

- Choisissez Apigee si votre objectif principal est de transformer les API existantes en outils MCP gouvernés et vous exploitez déjà un solide parc d'API centré sur APIGEE. [1] [2] [3]

- Choisissez TrueFoundry si votre objectif principal est de exploiter l'IA agentic d'entreprise de bout en bout: accès aux modèles, routage, budgets, instructions, serveurs MCP, garde-corps, traces et flux de travail des agents sur une seule plateforme. [4] [5] [6] [7] [8] [9] [10] [11]

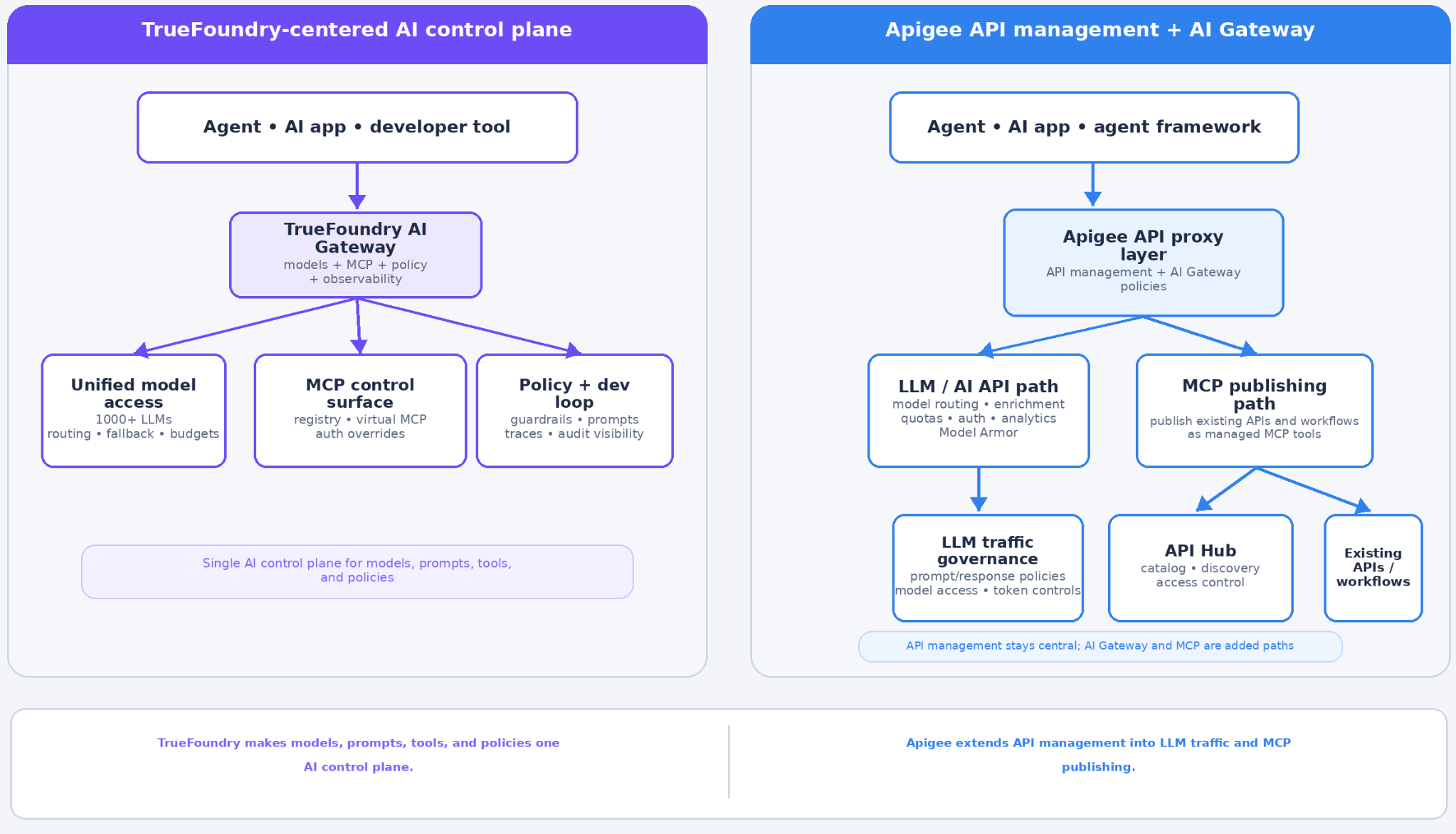

§1 — La principale différence architecturale

Apigee part du monde des passerelles API et s'étend à l'IA.

TrueFoundry part du monde des passerelles d'IA et s'étend aux API, aux serveurs MCP et aux agents.

Cette distinction n'est pas cosmétique. Elle modifie la forme du plan de contrôle.

Les propres documents d'Apigee indiquent qu'il s'agit de la plateforme de gestion d'API native de Google Cloud, fournissant des proxys d'API hautes performances et une couche de règles complète pour les services backend. [1] Sa prise en charge MCP permet aux agents d'utiliser des API sécurisées et gouvernées et des flux de travail personnalisés dans API Hub en tant qu'outils, souvent sans modifier les API backend existantes. [2] [3]

Il s'agit d'une excellente activation de l'API à l'agent.

La documentation de TrueFoundry, quant à elle, décrit l'AI Gateway comme le proxy entre les applications et Fournisseurs LLM et serveurs MCP, avec un accès unifié aux modèles, un routage, une gouvernance, une observabilité, une gestion rapide, un registre MCP et des fonctionnalités orientées vers les agents. [4] [5] [6] [7] [8] [9] [10] [11]

Les implications pratiques sont simples :

Apigee adapte votre parc d'API à l'utilisation des agents. TrueFoundry régit l'ensemble de l'environnement d'exécution de l'agence.

En d'autres termes, Apigee fait du MCP une fonctionnalité de gestion des API.

TrueFoundry fait des API, des modèles, des instructions et des outils toutes les fonctionnalités d'un seul plan de contrôle de l'IA.

C'est le principal avantage architectural.

§2 — Ce que fait bien Apigee

Toute comparaison sérieuse devrait le dire clairement :

1) Apigee offre aux entreprises un moyen efficace de MCP-ifier les API existantes

Google indique qu'avec le support MCP d'Apigee, vous pouvez utiliser les API existantes comme outils MCP et enregistrer les proxys MCP déployés dans API Hub. [2] [3] Le blog de Google Cloud indique explicitement que vous pouvez le faire sans modifier les API existantes, écrire du code supplémentaire ou gérer vous-même des serveurs MCP locaux ou distants. [2]

Il s'agit d'une histoire de migration puissante pour les entreprises possédant de grands parcs d'API.

2) Apigee dispose d'un mécanisme de politique de trafic et de sécurité mature

Le système de politique de base d'Apigee est complet. Il inclut des politiques standard et extensibles, des contrôles de sécurité, une médiation, une limitation de débit, des quotas et une logique personnalisée via des politiques JavaScript, Python, Java et XSLT. [1] [12]

Pour le trafic spécifique à l'IA, Google documente :

- Limite de jetons rapides pour une limitation rapide des jetons, [13]

- LLM en Quota pour contrôler la consommation de jetons sur de plus longs intervalles, [14]

- Modèle d'assainissement basé sur une armure pour les instructions et les réponses modèles, [15] [16]

- et une intégration plus large de la politique Model Armor dans les proxys Apigee. [17]

Cela signifie qu'Apigee n'est plus « simplement une passerelle d'API générique » dans cet espace.

3) Apigee est solide lorsque le système d'enregistrement est toujours constitué d'API

Si votre architecture est fondamentalement :

- les API métiers existantes,

- une gouvernance solide pour les producteurs d'API,

- les catalogues API Hub existants,

- les équipes opérationnelles Apigee existantes,

alors Apigee propose une voie d'extension à faible friction vers l'outillage agentic. [1] [2] [3]

Tout cela est réel.

§3 — Pourquoi TrueFoundry est le meilleur choix pour l'IA agentique d'entreprise

Le cas le plus rigoureux n'est pas « Apigee ne peut pas utiliser l'IA ». C'est évidemment possible.

Le cas rigoureux est le suivant :

Apigee continue de donner la priorité à la gestion des API. TrueFoundry est axé sur l'exécution de l'IA.

C'est important, car l'IA agentique d'entreprise ne se limite pas à une exposition aux API.

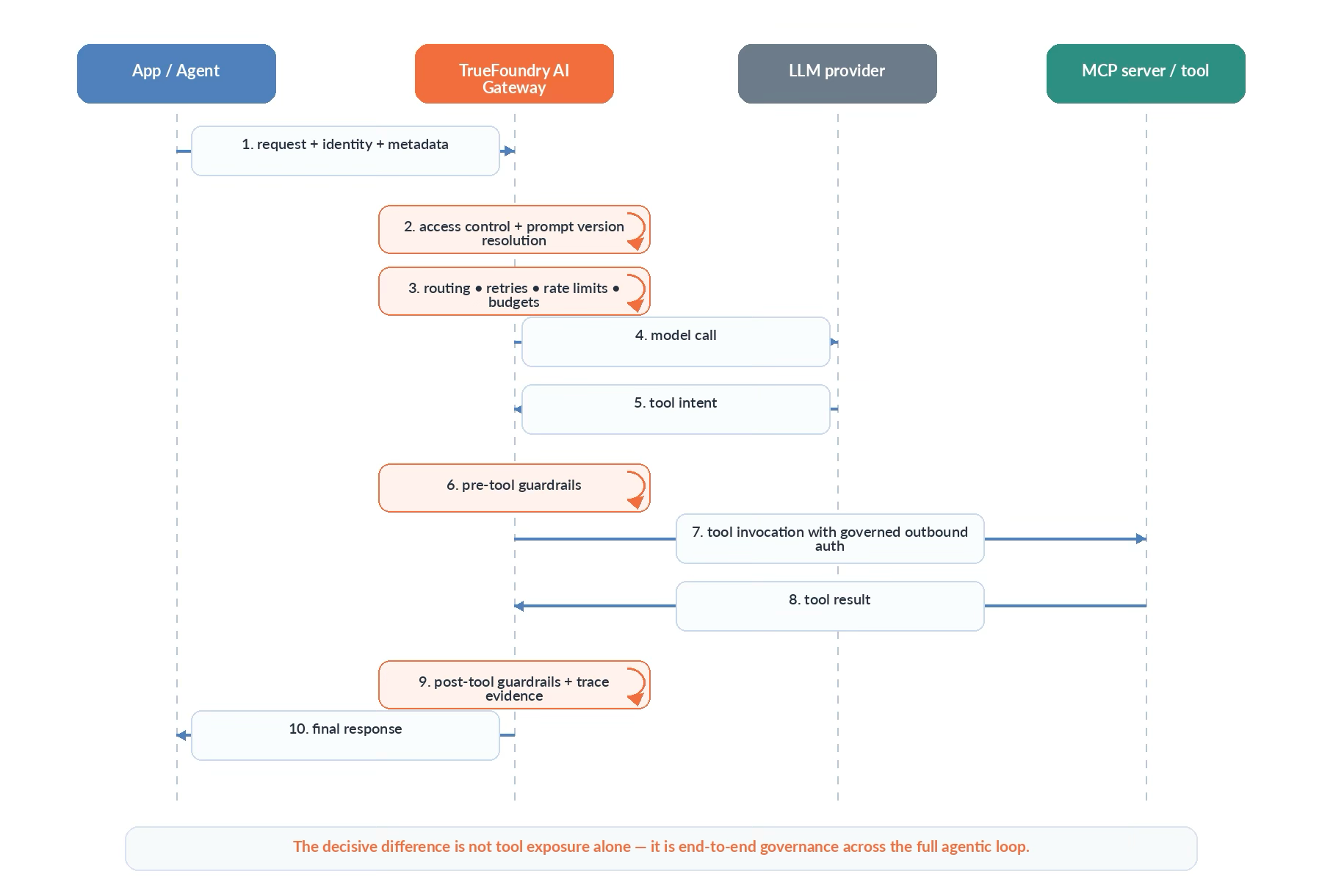

1) TrueFoundry unifie la gouvernance des modèles et des outils sur une seule plateforme

La documentation de TrueFoundry indique explicitement que l'AI Gateway se situe entre les applications et les fournisseurs LLM et les serveurs MCP. [4] Cela signifie que l'accès aux modèles et l'accès aux outils sont régis au même endroit.

Il s'agit d'une architecture plus solide que l'assemblage :

- un système pour le routage des modèles,

- un seul système pour un cycle de vie rapide,

- un système pour l'exposition au MCP,

- un seul système pour les traces.

Lorsque le plan de contrôle est fragmenté, la politique se fragmente avec lui.

2) Il dispose d'un routage de modèles, de budgets, de limites de débit et d'une mise en cache de première classe

TrueFoundry documente publiquement :

- accès unifié à Plus de 1000 LLM, [4]

- politique de routage/modèle virtuel avec nouvelles tentatives et replis, [5]

- limitation de débit pour les charges de travail LLM, [6]

- limitation du budget avec des règles à plusieurs niveaux, [7]

- suivi des coûts, [8]

- mise en cache exacte et sémantique. [9]

Apigee documente les politiques relatives aux jetons et les contrôles de débit pour le trafic d'IA. [13] [14] Mais l'histoire publique d'Apigee MCP est toujours centrée sur la présentation des API en tant qu'outils. Il ne présente pas Apigee comme le même type de plan de contrôle d'exécution d'IA multimodèle unifié que TrueFoundry. [2] [3]

Il s'agit d'une différence structurelle majeure.

3) TrueFoundry possède une surface de contrôle native MCP plus profonde

La documentation MCP de TrueFoundry montre :

- registre MCP centralisé, [10]

- gestion unifiée des jetons, [10]

- architecture d'authentification entrante et sortante divisée, [11]

- RBAC/ABAC au niveau de l'outil, [10] [11]

- Dérogations d'authentification pour les informations d'identification sortantes spécifiques à l'utilisateur, [18]

- Serveur MCP virtuel pour des ensembles d'outils multiserveurs sélectionnés sans déploiement supplémentaire, [19]

- Ouvrez une API vers un MCP chemins, [20]

- modèles de déploiement en studio hébergé et autres modèles de déploiement MCP. [21]

L'histoire du MCP d'Apigee est réelle, mais elle repose sur les proxys MCP pour les API et l'analyse des API Hub. [2] [3] L'histoire du MCP de TrueFoundry est davantage axée sur la gouvernance des outils d'IA d'entreprise eux-mêmes.

4) TrueFoundry documente les garde-fous dédiés au cycle de vie des MCP

C'est l'un des principaux facteurs de différenciation.

TrueFoundry documente l'exécution des garde-corps MCP avant et après l'outil, les tests via le Playground et l'inspection par traces. [22] Il documente également les garde-corps Cedar et OPA pour une autorisation précise des exécutions d'outils MCP. [23] [28]

Apigee documente l'assainissement basé sur Model Armor pour les instructions et les réponses des modèles, ce qui est précieux pour la sécurité des LLM. [15] [16] [17] Mais ce n'est pas la même chose qu'un document documenté publiquement Modèle de garde-corps du cycle de vie pré-outil/post-outil natif MCP.

TrueFoundry est donc la solution idéale pour les flux de travail agentiques où le moment le plus dangereux n'est pas seulement lié à l'invite du modèle, mais aussi à invocation de l'outil lui-même.

5) TrueFoundry intègre les instructions, les modèles, le MCP et l'observabilité dans une seule boucle de développement

TrueFoundry documente publiquement :

- Gestion rapide, [24]

- Versionnage rapide, [25]

- un AI Gateway Playground avec des modèles, des garde-corps, des serveurs MCP et des instructions réutilisables ensemble, [26]

- des métriques et des traces dans le cadre de la même surface AI Gateway. [10] [26]

Cette distinction est importante car les défaillances de l'IA de production se produisent généralement tout au long de la chaîne d'outils du modèle, et pas seulement au niveau de la couche API.

Apigee gère assez bien le trafic des API. TrueFoundry est mieux adapté pour gérer l'ensemble du flux de travail entre les modèles et les outils rapides.

6) Il offre une architecture plus propre aux équipes des plateformes d'IA que la mise à niveau des API

La proposition de valeur MCP d'Apigee réside en partie dans le fait que vous pouvez réutiliser votre parc d'API. [2]

C'est une bonne chose.

Cependant, la mise à niveau des API dans les outils des agents n'est pas la même chose que l'exécution d'un plan de contrôle d'IA spécialement conçu.

Une équipe de plateforme qui adopte TrueFoundry obtient un plan de contrôle plus propre pour :

- identités basées sur l'IA,

- modèles d'IA virtuels,

- identités des outils,

- versions rapides,

- limites tarifaires et budgets,

- traces de traces,

- et les choix de déploiement se sont concentrés sur les charges de travail de l'IA, y compris les environnements auto-hébergés, isolés et réglementés. [4] [5] [6] [7] [8] [9] [10] [11]

Cela réduit la quantité de logique de contrôle spécifique à l'IA que vous devez assembler vous-même à partir de primitives d'API générales.

§4 — Limitations importantes d'Apigee dans les documents MCP publics actuels

Un dossier de supériorité rigoureux doit également indiquer avec précision les limites publiques actuelles.

1) La présentation d'Apigee MCP ne s'applique actuellement pas à Apigee hybrid

Le MCP de Google dans l'aperçu d'Apigee indique explicitement que la page s'applique à Apigee, mais pas à Apigee hybrid. [3]

Cela ne signifie pas que Google n'a pas de réponse future ou adjacente. Cela signifie que l'aperçu public actuel du MCP n'est pas présenté comme une histoire hybride universelle.

Pour les organisations qui ont des exigences strictes en matière d'autogestion ou de priorité à l'hybride, c'est important.

2) La gestion de l'outil API Hub MCP comporte des mises en garde documentées

Google documente au moins deux mises en garde actuelles concernant la gestion de l'outil API Hub MCP :

- API Hub analyse les outils MCP issus de la dernière révision déployée uniquement.

- Le fichier OAS sous-jacent n'est actuellement pas converti selon le schéma de spécification MCP ; Google indique qu'il s'agit d'un problème connu. [22]

Ces limites ne sont pas disqualifiantes. Mais c'est exactement le genre de détails auxquels les acheteurs rigoureux devraient se soucier.

3) Certaines politiques d'IA sont extensibles et peuvent avoir des implications en termes de coûts et d'environnement

Les documents PromptTokenLimit et LLMTokenQuota de Google indiquent qu'il s'agit de politiques extensibles qui peuvent avoir des implications en termes de coût ou d'utilisation en fonction de la licence et du type d'environnement. [13] [14] [12]

Encore une fois, il ne s'agit pas d'un défaut fatal. Cela fait simplement partie de la véritable histoire opérationnelle.

§5 — La matrice de comparaison

TrueFoundry contre Apigee : capacité par capacité

§6 — Le point technique décisif : réutilisation n'est pas synonyme de fitness

L'argument le plus fort d'Apigee est la réutilisation :

« Vous disposez déjà d'API. Nous pouvons les gouverner et les exposer à des agents. »

C'est convaincant.

Mais la réutilisation n'est pas la même chose que le fitness sur plateforme.

La question fondamentale de l'entreprise est de savoir si le système peut gouverner l'ensemble de la boucle agentique.

C'est là que l'architecture spécialement conçue de TrueFoundry a une longueur d'avance.

Apigee peut exposer les API aux agents.

TrueFoundry régit le chemin d'exécution agentic de bout en bout.

Il s'agit d'une capacité d'ordre supérieur.

§7 — Verdict éditorial

Le verdict équitable

Apigee est une très bonne réponse à cette question :

« Comment appliquer la gouvernance des API d'entreprise aux API que les agents doivent appeler ? »

TrueFoundry est la meilleure réponse à cette question :

« Comment exploiter l'IA agentic d'entreprise en tant qu'environnement d'exécution unique gouverné à travers des modèles, des instructions, des outils et des traces ? »

Le verdict le plus tranchant

Apigee est une excellente plateforme d'API qui s'étend à l'outillage des agents. TrueFoundry est la plateforme d'IA d'entreprise la plus puissante pour les équipes dont le plan de contrôle doit couvrir des modèles et des outils, pour les équipes dont le plan de contrôle doit couvrir des modèles et des outils ensemble.

Il s'agit d'un argument de supériorité rigoureux et techniquement défendable.

Références

- Google Cloud, Qu'est-ce qu'Apigee ? — https://docs.cloud.google.com/apigee/docs/api-platform/get-started/what-apigee

- Blogue Google Cloud, Support MCP pour Apigee — https://cloud.google.com/blog/products/ai-machine-learning/mcp-support-for-apigee

- Google Cloud, Présentation du protocole MCP (Model Context Protocol) dans Apigee — https://docs.cloud.google.com/apigee/docs/api-platform/apigee-mcp/apigee-mcp-overview

- True Foundry, Présentation d'AI Gateway — https://www.truefoundry.com/docs/ai-gateway/intro-to-llm-gateway

- True Foundry, Configuration de routage/modèles virtuels — https://www.truefoundry.com/docs/ai-gateway/load-balancing-overview

- True Foundry, Limitation de débit — https://www.truefoundry.com/docs/ai-gateway/ratelimiting

- True Foundry, Limitation du budget — https://www.truefoundry.com/docs/ai-gateway/budgetlimiting

- True Foundry, Suivi des coûts — https://www.truefoundry.com/docs/ai-gateway/cost-tracking

- True Foundry, Mise en cache (exacte et sémantique) — https://www.truefoundry.com/docs/ai-gateway/caching

- True Foundry, Présentation de MCP Gateway — https://www.truefoundry.com/docs/ai-gateway/mcp/mcp-overview

- True Foundry, Authentification et sécurité pour les serveurs MCP — https://www.truefoundry.com/docs/ai-gateway/mcp/mcp-gateway-auth-security

- Google Cloud, Vue d'ensemble des références des politiques — https://docs.cloud.google.com/apigee/docs/api-platform/reference/policies/reference-overview-policy

- Google Cloud, Politique PromptTokenLimit — https://docs.cloud.google.com/apigee/docs/api-platform/reference/policies/prompt-token-limit-policy

- Google Cloud, Politique LLM TokenQuota — https://docs.cloud.google.com/apigee/docs/api-platform/reference/policies/llm-token-quota-policy

- Google Cloud, Politique SanitizeUserPrompt — https://docs.cloud.google.com/apigee/docs/api-platform/reference/policies/sanitize-user-prompt-policy

- Google Cloud, Politique de SanitizeModel Response — https://docs.cloud.google.com/apigee/docs/api-platform/reference/policies/sanitize-llm-response-policy

- Google Cloud, Commencez à utiliser les politiques d'Apigee Model Armor — https://docs.cloud.google.com/apigee/docs/api-platform/tutorials/using-model-armor-policies

- True Foundry, Dérogations d'authentification — https://www.truefoundry.com/docs/ai-gateway/mcp/mcp-server-auth-overrides

- True Foundry, Serveur MCP virtuel — https://www.truefoundry.com/docs/ai-gateway/mcp/virtual-mcp-server

- True Foundry, OpenAPI vers le serveur MCP — https://www.truefoundry.com/docs/ai-gateway/mcp/openapi-mcp-server

- True Foundry, Serveur MCP hébergé basé sur Stdio et Présentation du déploiement du MCP — https://www.truefoundry.com/docs/ai-gateway/mcp/stdio-mcp-server, https://www.truefoundry.com/docs/mcp-server-deployment/mcp-server-deployment-overview

- Google Cloud, Gérez les outils MCP dans API Hub — https://docs.cloud.google.com/apigee/docs/apihub/manage-mcp-tools

- True Foundry, Démarrage de Guardrails, Rambardes en cèdre, Garde-corps OPA — https://www.truefoundry.com/docs/ai-gateway/guardrails-getting-started, https://www.truefoundry.com/docs/ai-gateway/cedar-guardrails, https://www.truefoundry.com/docs/ai-gateway/opa-guardrails

- True Foundry, Gestion rapide — https://www.truefoundry.com/docs/ai-gateway/prompt-management

- True Foundry, Versionnage rapide — https://www.truefoundry.com/docs/ai-gateway/prompt-versioning

- True Foundry, Aire de jeux AI Gateway — https://www.truefoundry.com/docs/ai-gateway/playground-overview

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)