Orchestrer l'IA Bare-Metal : intégration de TrueFoundry à l'infrastructure cloud d'Oracle

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Déploiement de tâches de formation distribuées ou d'inférence haut débit sur Infrastructure cloud Oracle (OCI) nécessite une approche architecturale spécifique. OCI fournit des instances GPU bare-metal sans aucune surcharge d'hyperviseur et Accès direct à distance à la mémoire (RDMA) mise en réseau de clusters via Ethernet convergé.

Bien que l'infrastructure bare metal maximise les performances, elle nécessite une gestion opérationnelle avancée. Vous devez configurer les interfaces réseau, gérer les pilotes NVIDIA de bas niveau et gérer les défaillances des nœuds manuellement sans recourir à la couche d'abstraction de la virtualisation gérée. TrueFoundry fonctionne comme une superposition d'infrastructure au sein de votre location OCI. Il traduit les charges de travail d'apprentissage automatique de haut niveau en commandes d'exécution précises. Nous détaillons l'intégration technique entre TrueFoundry et OCI ci-dessous, en nous concentrant sur l'orchestration Kubernetes, la mise en réseau RDMA et l'identité des charges de travail.

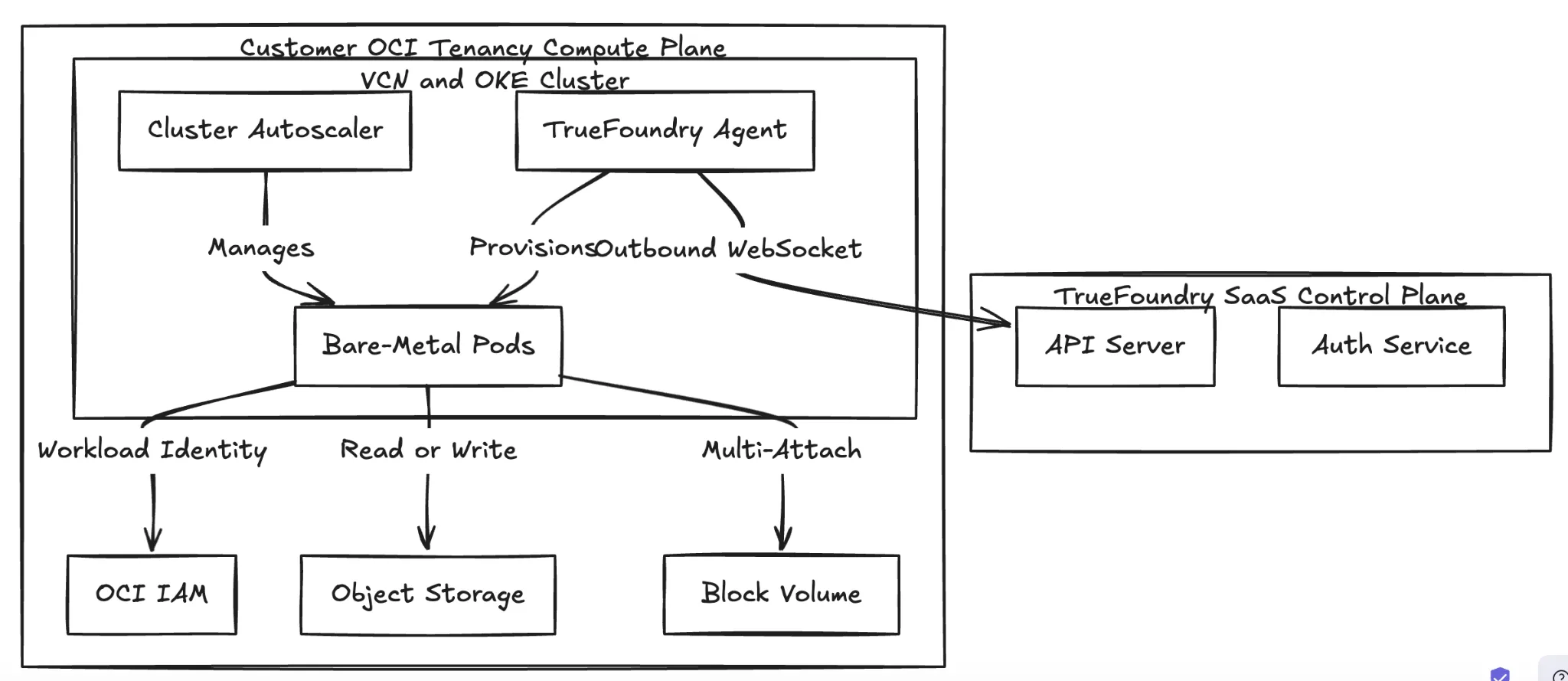

Modèle de déploiement : plan de contrôle ou plan de calcul

TrueFoundry utilise une architecture à plans divisés. Le plan de contrôle gère le RBAC, les métadonnées et le routage. Le plan de calcul exécute les pondérations du modèle et traite les données des clients. Dans un environnement OCI, vous exécutez le plan de calcul sur Moteur Kubernetes d'infrastructure cloud Oracle (OKE).

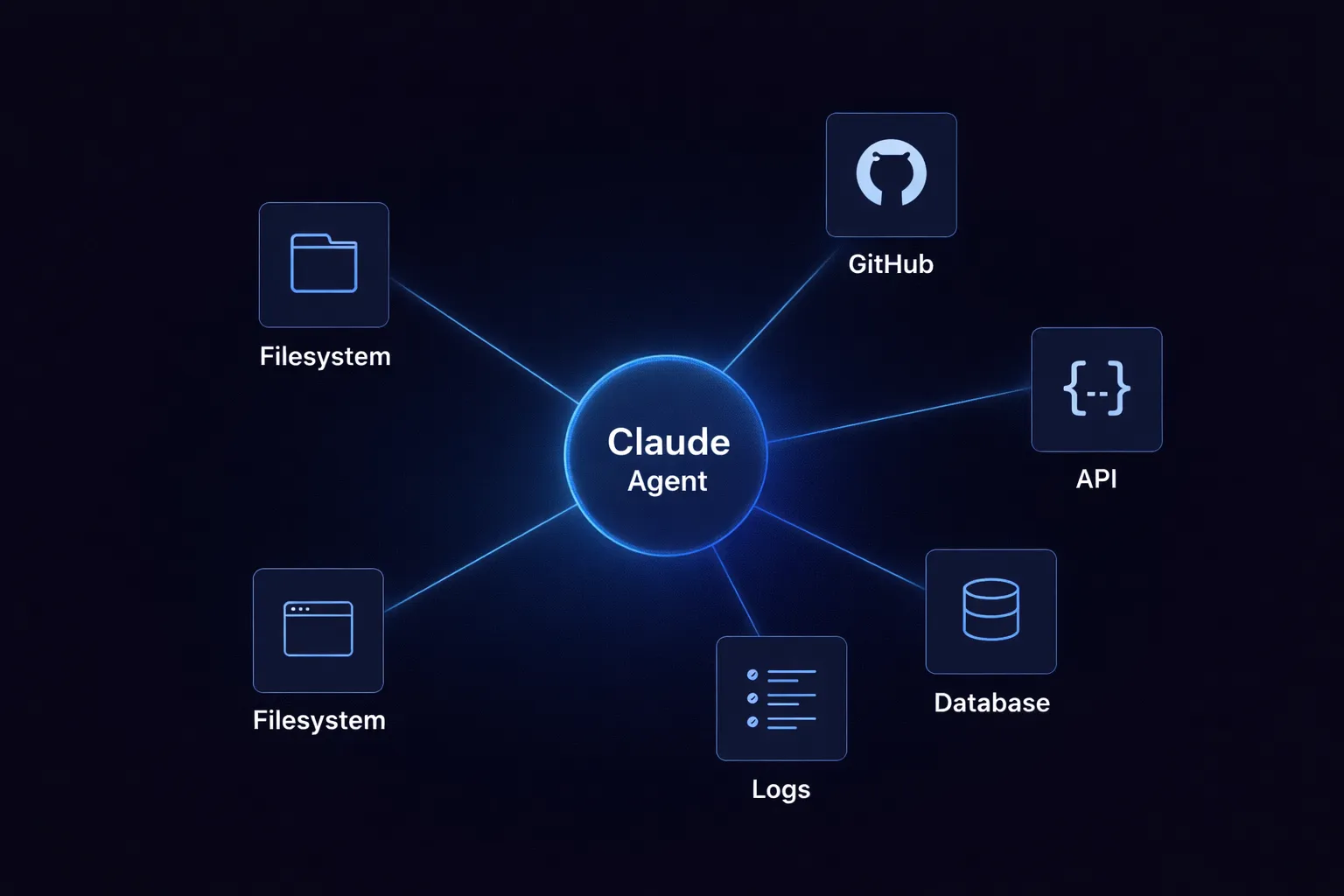

Le plan de contrôle héberge le serveur API et la logique de planification. L'agent TrueFoundry s'exécute sur votre cluster OKE. L'agent lance un appel sortant uniquement grPC ou diffusez WebSocket pour rechercher des manifestes de déploiement. Cette conception supprime la nécessité de ports entrants standard sur le réseau cloud virtuel (VCN), préservant ainsi la confidentialité de votre environnement d'exécution.

Figure 1 : L'architecture Split-Plane isole le traitement des données au sein du VCN du client.

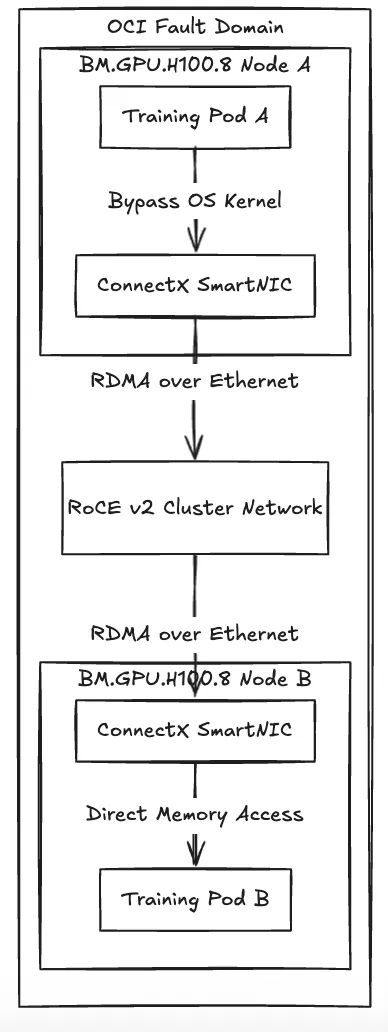

Mise en réseau : abstraction de RoCE v2 et de RDMA

La formation de grands modèles de langage nécessite une bande passante énorme de nœud à nœud. OCI fournit un réseau de clusters spécialisé capable de fournir une latence aussi faible que deux microsecondes en contournant le noyau du système d'exploitation à l'aide de RDMA sur Ethernet convergé v2 (RoCE v2). Pour utiliser ce matériel, vous devez planifier les charges de travail sur des nœuds bare-metal au sein du même domaine de défaillance et les configurer pour accéder directement aux Mellanox ConnectX SmartNIC.

TrueFoundry automatise ces contraintes de planification. Lorsque vous soumettez une tâche de formation distribuée à l'aide de DDP PyTorch ou Vitesse profonde, le contrôleur TrueFoundry traduit votre demande en Job Kubernetes MPI. Le contrôleur applique des règles d'affinité de nœud strictes pour garantir que tous les pods atterrissent sur le réseau de cluster bare-metal désigné. Il injecte ensuite les volumes de chemin d'hôte requis et les contextes de sécurité privilégiés afin que le conteneur accède aux périphériques InfiniBand de manière native. Il n'est pas nécessaire d'écrire des manifestes Kubernetes personnalisés.

Figure 2 : Flux réseau RDMA détaillant le contournement du noyau pour la communication GPU entre nœuds.

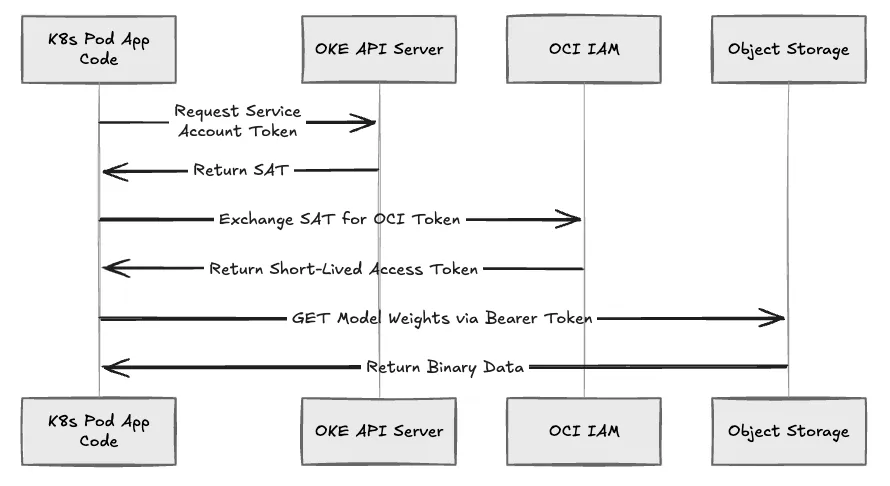

Fédération et sécurité des identités

OCI implémente Workload Identity pour remplacer les informations d'identification statiques ou les clés d'API principales de l'utilisateur dans le code de l'application.

Lorsqu'un déploiement TrueFoundry nécessite l'accès à OCI Object Storage pour charger les poids des modèles, la plateforme fournit un compte de service Kubernetes lié à un Gestion des identités et des accès (IAM) OCI politique. Le serveur de métadonnées OKE intercepte la demande d'authentification, valide le jeton Kubernetes et émet un jeton d'accès OCI de courte durée au pod. Le code de votre application utilise le SDK OCI standard via ce mécanisme de jeton injecté. Nous limitons le rayon d'action d'un pod compromis aux politiques IAM spécifiques associées à ce compte de service isolé.

Figure 3 : La séquence d'authentification OKE Workload Identity.

Optimisation du calcul : attachement multiple à plusieurs volumes de blocs

OCI propose des options matérielles simples telles que le BM.GPU.H100.8 via des modèles de tarification de calcul prévisibles. Comme il s'agit de machines physiques, la logique de provisionnement est totalement différente de celle des environnements virtualisés. TrueFoundry s'intègre directement à Autoscaler OKE Cluster pour gérer ces nœuds, en traitant le matériel nu comme une capacité élastique.

Le chargement d'un modèle de 100 Go dans la VRAM via 64 GPU sollicite simultanément le stockage réseau standard et retarde la préparation au déploiement. TrueFoundry contourne cela en utilisant Volume du bloc OCI fonctionnalités de connexion multiple. La plate-forme monte un seul volume de bloc à IOPS élevé contenant les poids du modèle sur plusieurs instances bare-metal simultanément dans une configuration en lecture seule. Cette architecture minimise l'engorgement du réseau lié à l'extraction d'objets depuis Object Storage à chaque démarrage d'un pod, ce qui peut réduire considérablement les temps de déploiement des grands modèles.

Comparaison opérationnelle : OCI natif et superposition TrueFoundry

Le tableau suivant décrit les différences opérationnelles entre la gestion des primitives brutes OCI bare-metal et l'utilisation de la superposition TrueFoundry.

Conclusion

La collaboration entre TrueFoundry et Oracle Cloud Infrastructure est conçue pour supprimer l'impédance opérationnelle de l'informatique nue. En automatisant les complexités de l'orchestration de Kubernetes, de la mise en réseau RDMA RoCE v2, de la fédération des identités de charge de travail et du multi-attachement Block Volume à hautes performances, TrueFoundry permet à vos équipes de science des données et d'ingénierie de maximiser la vitesse brute des GPU bare-metal d'OCI. Cette superposition d'infrastructure vous permet de vous concentrer entièrement sur la création, la formation et le déploiement de modèles d'IA à grande échelle sans consacrer de nombreuses ressources d'ingénierie à la gestion des primitives cloud de bas niveau.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.png)

.webp)

.webp)