Contrôle d'accès LLM : sécurisation des modèles et des charges de travail d'IA en production

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Présentation

À mesure que les organisations adoptent des LLM dans leurs équipes et leurs applications, l'accès aux modèles devient rapidement un problème de sécurité et de gouvernance. Ce qui commence par une clé d'API unique partagée entre les services se transforme souvent en dizaines d'applications, d'agents et de flux de travail invoquant tous des modèles avec peu de visibilité ou de contrôle.

Cela crée un risque réel. Sans contrôle d'accès approprié, les équipes ne peuvent pas facilement restreindre les personnes autorisées à utiliser des modèles spécifiques, empêcher les abus par les agents ou auditer la manière dont les systèmes d'IA sont accessibles en production. Les clés d'API et les autorisations du SDK au niveau du fournisseur ne sont pas conçues pour gérer ces exigences à grande échelle.

Contrôle d'accès LLM comble cette lacune en imposant qui peut accéder à quels modèles, instructions, agents et outils lors de l'exécution. Au lieu de s'appuyer sur des informations d'identification statiques intégrées au code, les décisions d'accès sont évaluées de manière centralisée au fur et à mesure de l'exécution des demandes.

Dans ce blog, nous expliquerons ce que signifie le contrôle d'accès LLM dans la pratique, pourquoi il est difficile à implémenter dans les systèmes de production et comment les architectures basées sur des passerelles permettent des charges de travail d'IA sécurisées et auditables.

Que signifie le contrôle d'accès LLM ?

Contrôle d'accès LLM est le cadre qui détermine qui ou quoi est autorisé pour interagir avec vos actifs d'IA et dans quelles conditions spécifiques. Dans un environnement informatique traditionnel, nous avons l'habitude de contrôler l'accès aux fichiers ou aux serveurs. À l'ère de l'IA, l' « actif » est plus dynamique. Il s'agit d'une combinaison d'intelligence brute (le modèle), de capacités autonomes (l'agent) et d'actions externes (les outils).

Pour construire un périmètre sécurisé, le contrôle d'accès doit être appliqué à travers ces trois dimensions critiques.

Qui peut accéder à quels modèles ?

Tous les utilisateurs d'une organisation n'ont pas besoin d'accéder à tous les modèles. Par exemple, un développeur testant une nouvelle fonctionnalité peut avoir uniquement besoin d'accéder à un modèle open source tel que Llama 3, tandis qu'un data scientist de haut niveau peut avoir besoin de la puissance de raisonnement de GPT-4o ou Claude 3.5 Sonnet.

Le contrôle d'accès au niveau du modèle vous permet d'effectuer des contrôles en fonction des coûts, de la sensibilité et de la nécessité. Cela empêche la « prolifération des modèles », au cours de laquelle les employés pourraient expérimenter avec des fournisseurs tiers non approuvés, et garantit que vos jetons les plus chers sont réservés aux utilisateurs qui en ont réellement besoin.

Qui peut déployer des agents ?

Le déploiement d'un agent basé sur LLM est fondamentalement différent de l'utilisation d'un simple chatbot. Un agent est une entité persistante capable de « réfléchir » à différentes étapes et d'exécuter des flux de travail au fil du temps.

Si le contrôle d'accès est faible, n'importe quel utilisateur peut techniquement déployer un agent autonome qui s'exécute en arrière-plan, pouvant entrer dans des boucles récursives ou effectuer des milliers d'appels d'API non autorisés.

La gouvernance consiste ici à définir quelles équipes ont l'autorisation de « déploiement », en veillant à ce que chaque agent ait un propriétaire clair et une durée de vie strictement définie.

Qui peut invoquer des outils ?

Il s'agit de la couche la plus critique des trois. Lorsque vous donnez à un LLM l'accès à « outils » comme votre CRM, votre documentation interne ou votre serveur de messagerie, vous lui donnez effectivement un coup de main.

Le contrôle d'accès granulaire consiste à définir précisément les outils qu'un agent peut appeler. Un bot de support client peut être autorisé à lire une base de connaissances, mais qui devrait être strictement bloquée écriture vers une base de données de production.

Sans autorisations au niveau des outils, une simple attaque par injection rapide pourrait inciter un agent à utiliser ses privilèges de haut niveau pour exfiltrer des données ou supprimer des enregistrements critiques. Un véritable contrôle d'accès garantit que même si un LLM est « compromis » par une invite malveillante, sa capacité à provoquer des dommages est physiquement limitée par ses autorisations étendues.

Défis courants en matière de contrôle d'accès

Au fur et à mesure que les équipes transfèrent les charges de travail LLM en production, les problèmes de contrôle d'accès ne sont souvent pas dus à une intention malveillante, mais à des raccourcis pris lors des premières expériences. Ces lacunes deviennent de graves problèmes à mesure que l'utilisation évolue au sein des équipes, des agents et des environnements.

Clés d'API partagées

De nombreuses équipes commencent avec une seule clé d'API partagée pour un fournisseur de modèles parmi plusieurs services ou développeurs. Bien que pratique, cette approche élimine toute notion d'identité ou de responsabilité.

Les clés partagées ne permettent pas de faire la distinction entre les utilisateurs, les applications ou les agents. En cas de fuite ou d'utilisation abusive d'une clé, l'ensemble du système est exposé. La révocation de l'accès d'un utilisateur signifie généralement la suppression de l'accès pour tout le monde, ce qui présente des risques opérationnels dans les environnements de production.

Pistes d'audit manquantes

La sécurité et la conformité des entreprises dépendent de leur capacité à répondre à une question simple : qui a accédé à quoi et quand ?

Sans couche de contrôle d'accès centralisée, l'utilisation de LLM est répartie entre les environnements locaux, les ordinateurs portables, les pipelines CI et les tableaux de bord tiers. Cette fragmentation rend difficile la reconstitution des événements après un incident. Si des données sensibles sont exposées ou si un modèle se comporte de manière inattendue, les équipes ne disposent souvent pas de la piste d'audit nécessaire pour en déterminer la cause première.

Pour les secteurs réglementés, l'absence d'auditabilité est considérée comme une défaillance de la posture de sécurité, quelle que soit l'intention.

Agents surautorisés

Les agents ont souvent besoin de privilèges élevés pour effectuer un travail utile, mais ils disposent souvent d'un accès plus large que nécessaire. Il est courant de voir des agents déployés avec un accès illimité aux outils, aux banques de données ou aux API, simplement pour éviter les frais de configuration.

Cela crée un scénario à haut risque dans lequel des modèles puissants, des outils privilégiés et des vulnérabilités d'injection rapide se combinent pour amplifier l'impact. Si un agent est manipulé par le biais d'une invite malveillante, ses autorisations excessives lui permettent de provoquer de réels dommages, tels que l'exfiltration de données ou des actions destructrices. Il est donc essentiel de limiter les autorisations des agents pour réduire le rayon d'explosion.

Principales fonctionnalités de contrôle d'accès

Un contrôle d'accès LLM efficace nécessite plusieurs niveaux d'application qui fonctionnent de manière cohérente entre les utilisateurs, les applications et les agents. Ces fonctionnalités doivent être appliquées lors de l'exécution et intégrées aux systèmes d'identité et de sécurité existants de l'entreprise.

Contrôle d'accès basé sur les rôles (RBAC)

Le RBAC garantit que les autorisations sont liées aux rôles plutôt qu'aux utilisateurs individuels. Dans un contexte d'IA, cela permet aux organisations de définir des limites claires entre les administrateurs, les développeurs et les utilisateurs finaux.

Par exemple, les développeurs peuvent être autorisés à expérimenter des modèles et des instructions dans des environnements hors production, tandis que les utilisateurs finaux ne peuvent interagir qu'avec des agents approuvés. L'intégration du RBAC aux fournisseurs d'identité existants permet l'intégration et la révocation automatiques de l'accès à mesure que la composition de l'équipe change.

Isolation de l'environnement

Il est essentiel de séparer les environnements de développement, de préparation et de production pour contrôler les risques. Les politiques de contrôle d'accès doivent garantir que les modèles, outils et informations d'identification à privilèges élevés ne sont accessibles qu'à partir d'environnements de production dotés de garanties supplémentaires.

Cela empêche les charges de travail expérimentales d'interagir accidentellement avec des données de production sensibles et réduit le risque que des modifications involontaires parviennent aux utilisateurs finaux.

Autorisations au niveau du modèle

Les différents modèles présentent des profils de coût, de capacité et d'exposition des données différents. Les autorisations au niveau du modèle permettent aux équipes de restreindre l'accès en fonction de ces facteurs.

Les modèles coûteux ou sensibles peuvent être limités à des équipes ou à des projets spécifiques, tandis qu'un accès plus large peut être accordé à des modèles moins coûteux ou auto-hébergés. Cela permet de contrôler les dépenses et de réduire l'exposition à des fournisseurs externes lorsque cela n'est pas nécessaire.

Autorisations au niveau des outils

Le contrôle d'accès au niveau des outils définit les actions qu'un agent peut effectuer une fois qu'il est appelé. Plutôt que d'accorder un accès étendu à l'API, les autorisations doivent être limitées à des fonctions ou à des opérations spécifiques.

Par exemple, un agent peut être autorisé à lire à partir d'un référentiel de documents mais ne peut pas modifier ou supprimer des enregistrements. L'application des autorisations à ce niveau limite l'impact d'un raisonnement incorrect ou d'une manipulation rapide et protège les systèmes centraux même lorsque les agents se comportent de manière inattendue.

Contrôle d'accès LLM via des passerelles

La gestion du contrôle d'accès au niveau des applications n'est pas évolutive dans les systèmes d'IA de production. Lorsque plusieurs équipes, agents et services s'intègrent directement à différents fournisseurs de modèles, les politiques d'accès deviennent fragmentées et difficiles à appliquer de manière cohérente.

Un Passerelle IA y remédie en agissant comme une couche d'application centralisée entre les applications et les fournisseurs de modèles. Au lieu d'intégrer les informations d'identification et les autorisations entre les services, le contrôle d'accès est évalué au moment de l'exécution, avant même qu'une demande n'atteigne un modèle.

Point d'application centralisé

La passerelle sert de point unique d'authentification et d'autorisation pour tout le trafic LLM. Les informations d'identification du fournisseur sont stockées en toute sécurité dans la passerelle plutôt que distribuées dans le code de l'application.

Les applications et les agents s'authentifient auprès de la passerelle à l'aide d'identités gérées. Cela permet aux équipes de sécurité de révoquer l'accès, de changer les clés des fournisseurs ou de mettre à jour les politiques de manière centralisée sans redéployer les applications. Si un service ou un agent est compromis, son accès peut être immédiatement désactivé au niveau de la couche passerelle.

Décisions d'accès basées sur des règles

Au-delà de la simple authentification, une passerelle permet contrôle d'accès piloté par des règles. Chaque demande peut être évaluée par rapport à des attributs contextuels tels que :

- Identité de l'utilisateur ou du service

- Association d'équipe ou de projet

- Modèle ou fournisseur cible

- Environnement d'exécution

Sur la base de ces attributs, la passerelle peut autoriser, refuser ou rediriger les demandes conformément à des politiques définies. Cela permet un contrôle précis, par exemple en limitant les modèles coûteux à des équipes spécifiques ou en empêchant certains agents d'accéder à des outils sensibles.

Audit et traçabilité de l'exécution

Comme toutes les demandes passent par la passerelle, celle-ci devient la source officielle de données d'audit. Chaque appel de modèle peut être enregistré avec un contexte complet, y compris qui a initié la demande, quel modèle a été consulté et comment la demande a été traitée.

Cette piste d'audit centralisée est essentielle pour les analyses de conformité et d'investigation. Il permet aux organisations de reconstituer les événements avec précision et de démontrer un accès contrôlé aux systèmes d'IA lors d'examens de sécurité ou d'audits.

En transférant le contrôle d'accès vers la passerelle, les équipes passent d'autorisations implicites éparpillées à politiques explicites et applicables qui évoluent en fonction de la complexité du système et de la croissance de l'organisation.

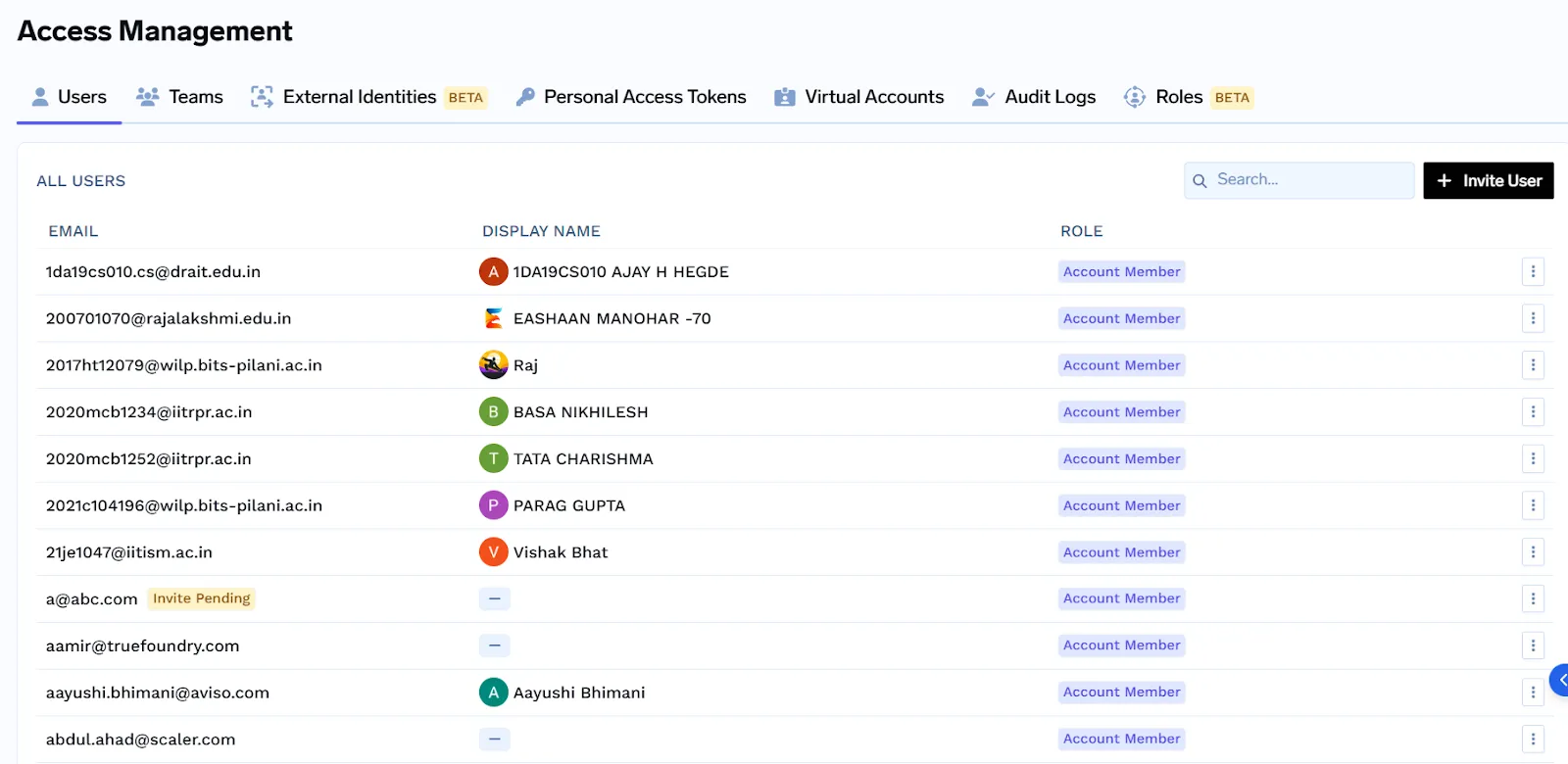

Comment TrueFoundry met en œuvre le contrôle d'accès LLM

True Foundry prend en compte les exigences théoriques du contrôle d'accès et les transforme en une réalité prête pour la production. Fonctionnant en tant que plan de contrôle unifié, il permet aux équipes de la plateforme de gérer des milliers de modèles et d'utilisateurs à partir d'une seule interface sans créer de latence.

Contrôles au niveau de la passerelle pour la gouvernance

La passerelle AI de TrueFoundry fournit plusieurs contrôles granulaires configurés au niveau du compte du fournisseur via l'interface utilisateur. Ces caractéristiques garantissent que gouvernance est intégré à l'infrastructure au lieu d'être considéré comme secondaire.

Contrôle d'accès et autorisations La plateforme utilise deux niveaux d'autorisation distincts pour les comptes des fournisseurs afin de séparer les tâches administratives de l'utilisation quotidienne :

- Gestionnaire de compte du fournisseur : Ces utilisateurs détiennent les clés du royaume. Ils peuvent modifier les paramètres du compte, ajouter ou supprimer des modèles et gérer les autorisations d'accès des autres membres de l'équipe.

- Utilisateur du compte du fournisseur : Ces utilisateurs peuvent interagir avec les modèles à des fins d'inférence, mais ils sont strictement empêchés de modifier les paramètres sous-jacents ou les configurations de sécurité.

Accès géré via des jetons Pour répondre aux différents besoins des développeurs et des systèmes de production, TrueFoundry propose deux types de clés :

- Jetons d'accès personnels (PAT) : Ils sont liés à des utilisateurs individuels. Ils sont idéaux pour les tests et les expérimentations locaux car ils permettent à l'organisation de suivre l'utilisation par développeur.

- Jetons d'accès virtuels (TVA) : Ils ne sont pas liés à une personne en particulier. Ils constituent le choix recommandé pour les applications de production. Comme ils sont indépendants des comptes individuels des employés, vos services ne seront pas interrompus si un développeur en particulier quitte l'entreprise.

Préparation à la sécurité et à la conformité

La sécurité de TrueFoundry repose sur une défense à plusieurs niveaux. Tout commence par un niveau professionnel Authentification en utilisant OIDC, JWT et clés d'API gérées, en veillant à ce que chaque demande soit accompagnée d'une identité vérifiée. Ceci est suivi par Autorisation via le contrôle d'accès basé sur les rôles (RBAC), qui garantit que les utilisateurs ne voient que les modèles et les outils qu'ils sont autorisés à utiliser.

Pour se protéger contre les menaces émergentes liées à l'IA, la passerelle intègre Rambardes pour la sécurité du contenu. Il s'agit notamment du temps réel Détection des PII pour empêcher les fuites de données sensibles, la modération pour bloquer les contenus toxiques et des filtres spécifiques pour empêcher les attaques par injection rapide. Chaque interaction est enregistrée via Enregistrement des demandes et des réponses, création d'une piste d'audit immuable essentielle à la conformité et au débogage forensique.

Contrôles de configuration avancés

Au-delà du simple accès, la passerelle fournit des contrôles techniques pour maintenir la stabilité et la rentabilité du système :

- Limitation de débit : Protégez votre infrastructure contre les abus en limitant les requêtes ou les jetons.

- Contrôles budgétaires : Définissez des limites de dépenses pour éviter les pics de facturation imprévus.

- Équilibrage de charge et repli : Répartissez automatiquement le trafic entre des modèles sains et redirigez les demandes en cas de défaillance d'un fournisseur spécifique.

Conclusion

Sécuriser les frontières de l'IA en entreprise ne consiste pas à ralentir l'innovation. Il s'agit de construire les garde-corps qui sécurisent les expériences. En abandonnant les clés partagées pour adopter un modèle centralisé piloté par des passerelles, les entreprises peuvent enfin traiter les LLM comme des citoyens de premier ordre en matière de sécurité. Grâce à des autorisations granulaires et à des pistes d'audit robustes, la transition du prototype à la production devient un avantage stratégique. Une véritable gouvernance ne se contente pas de protéger vos données ; elle permet à vos équipes de construire en toute confiance.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)