Cómo entender los precios de Cloudflare AI Gateway [Un desglose completo]

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Cloudflare AI Gateway suele ser la primera herramienta a la que recurren los equipos de ingeniería cuando necesitan definir la observabilidad de su tráfico de LLM. Tiene sentido: colocas un proxy entre tu aplicación y OpenAI y, de repente, tienes registros y almacenamiento en caché sin necesidad de escribir un servicio de middleware personalizado.

Sin embargo, si bien la opción «empezar gratis» proporciona una velocidad inmediata, la economía de la ingeniería a menudo cambia a medida que se avanza hacia la producción. Si bien la pasarela se comercializa con una generosa capa gratuita, el coste total de propiedad (TCO) de las cargas de trabajo empresariales va más allá de la tarifa de pasarela. El perfil de costes completo incluye los servicios adyacentes que consumes, en concreto, Cloudflare Workers, el almacenamiento persistente de registros y el escalado del volumen de solicitudes.

En este artículo se analizan los aspectos económicos de la ingeniería de Cloudflare AI Gateway. Analizaremos lo que pagas de forma explícita, las variables operativas que afectan a la escala y por qué las empresas suelen migrar a alternativas privadas integradas en VPC, como Truefoundry, cuando pasan de la fase de «prototipo» a la de «producción».

¿Qué es Cloudflare AI Gateway?

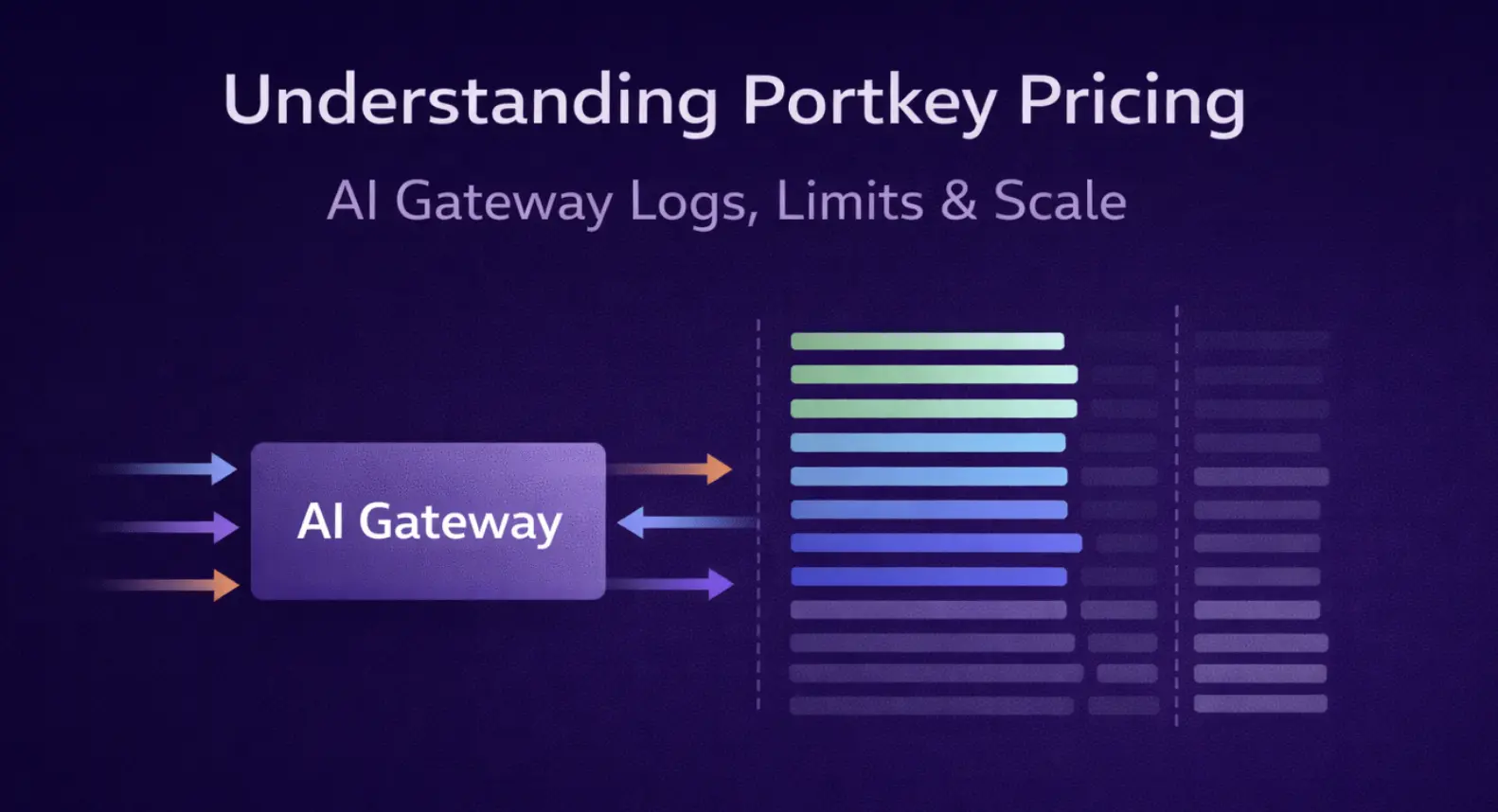

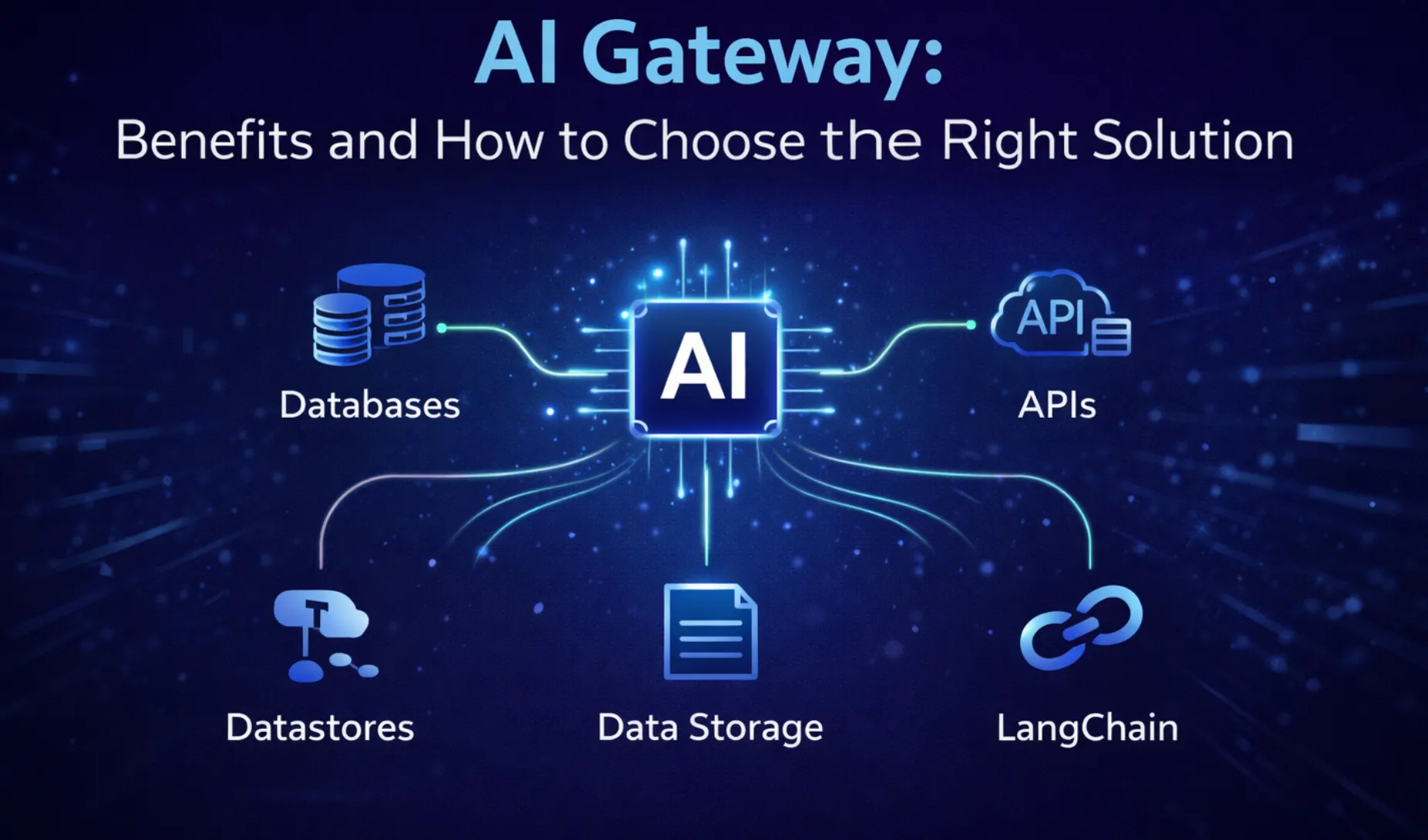

Para entender el proyecto de ley, hay que entender la arquitectura. Cloudflare AI Gateway funciona como un proxy inverso centralizado que se encuentra en el límite e intercepta las solicitudes de API RESTful entre tus proveedores de backend y LLM.

No aloja modelos en sí. Proporciona las «tuberías» necesarias para la observabilidad y el control. Su función principal es:

- Gestión del tráfico: Gestionar la lógica de reintentos y la limitación de velocidad para que tu aplicación no tenga que hacerlo.

- Observabilidad: Inspeccionar las cargas útiles para registrar las indicaciones, las respuestas y los encabezados de uso de tokens.

- Integración de ecosistemas: Fundamentalmente, se ejecuta en el entorno de ejecución de Cloudflare Workers. Este es el detalle más importante a la hora de fijar los precios porque comparte la infraestructura (y los límites de facturación) de las funciones estándar sin servidor.

Características de Cloudflare AI Gateway que afectan a los precios

Actualmente, Cloudflare no cobra un recargo «por token». Pagas lo mismo a OpenAI tanto si lo haces directamente como a través de Cloudflare. Los costos aparecen en el uso de la infraestructura y en los límites de funciones que te guían hacia niveles más altos.

Enrutamiento de solicitudes y limitación de velocidad

Cada llamada a la API que llega a la puerta de enlace cuenta como una «solicitud» en la plataforma Cloudflare Workers subyacente.

Si está construyendo una herramienta interna de bajo volumen, esto es insignificante. Pero si estás creando un bucle de agentes automatizado o un chatbot orientado a los clientes con mucho tráfico, los cálculos cambian. Un agente que crea un bucle recursivo de 10 a 20 llamadas para responder a una solicitud de un único usuario puede consumir rápidamente las cuotas de solicitudes estándar. No pagas por la IA, sino por las solicitudes HTTP al proxy.

Almacenamiento en caché de mensajes y respuestas

El almacenamiento en caché es el principal argumento del ROI para usar una puerta de enlace. Si puedes ofrecer una respuesta desde la periferia de Cloudflare, ahorrarás dinero en el proveedor de LLM que ya está en fase inicial.

Sin embargo, la ventaja financiera en este caso es muy variable. Depende completamente de tu tasa de aciertos de caché.

- Alto ROI: Los bots de atención al cliente responden a «¿Cómo restablezco mi contraseña?» (Repetición alta).

- Bajo ROI: Aplicaciones RAG que consultan documentos únicos o analizan datos de usuarios específicos.

Si tu aplicación se basa en ventanas de contexto únicas, el almacenamiento en caché no reducirá tu factura inicial, pero aun así incurrirás en costos por el enrutamiento de las solicitudes.

Análisis y registro de uso

Esta suele ser la función de forzar las actualizaciones. El registro persistente consume almacenamiento. Cloudflare impone límites a la cantidad de registros que puedes guardar en su panel de control. Cuando alcanzas ese límite, el registro se detiene, lo que te deja sin visibilidad durante el resto del período de facturación, a menos que realices una actualización. Con el tiempo, los volúmenes empresariales pueden requerir configurar Logpush para enviar los datos a tu propio almacenamiento, lo que genera un conjunto diferente de tarifas en función del volumen de datos.

Integración con varios proveedores

El enrutamiento a varios proveedores (por ejemplo, la conmutación por error de OpenAI a Anthropic) no conlleva un recargo, pero complica la atribución de costos. Estás agrupando los costes de Azure, Bedrock y OpenAI en un único flujo. La pasarela normaliza los informes, pero la facturación suele ser directa con esos proveedores.

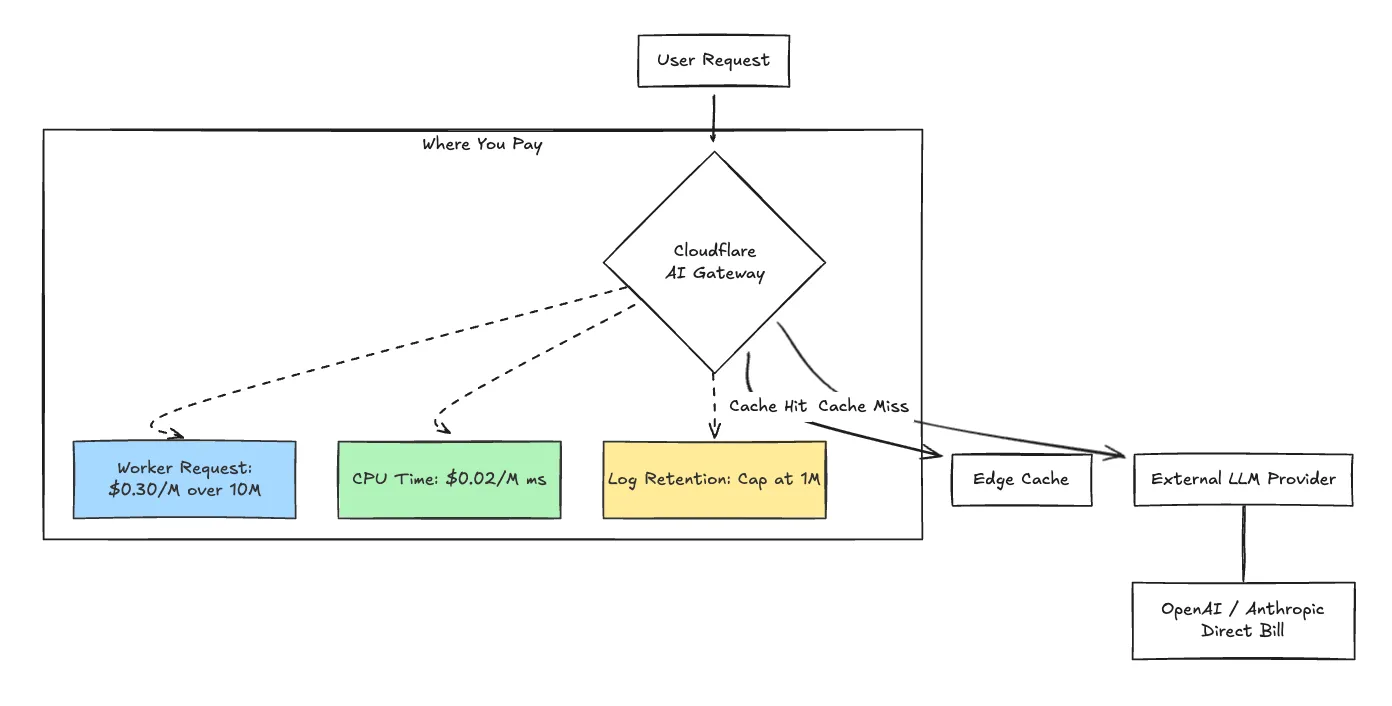

Desglose de precios de Cloudflare AI Gateway

El precio no es un elemento independiente; funciona como una partida en una suscripción de Cloudflare Workers.

La capa gratuita (estándar)

Está optimizado para hackatones y desarrolladores individuales. Cuesta 0 dólares, pero los límites operativos suelen ser más adecuados para las pruebas que para los SLA de producción.

- Coste: 0 €/mes.

- Límite de registro: 100 000 registros/mes. Nota: Cuando se alcanza este límite, se detiene el registro.

- Límite de solicitud: 100 000 solicitudes/día.

- Veredicto: Excelente para la creación de prototipos; requiere actualizaciones para la confiabilidad de la producción.

El nivel pagado (trabajadores pagados)

Si eres una empresa, esta es tu línea de partida.

- Coste: A partir de 5$ al mes.

- Límite de registro: 1 000 000 registros/mes.

- Computación incluida: 10 millones de solicitudes y 30 millones de milisegundos de CPU.

(Fuente: https://www.cloudflare.com/plans/developer-platform/)

El excedente:

- 0,30 USD por cada millón de solicitudes adicionales.

- 0,02 USD por cada millón de milisegundos de CPU adicionales.

Figura 1: Flujo lógico y arquitectura de facturación

Variables operativas que afectan a la escala

La tarifa base de 5 dólares al mes es un punto de entrada atractivo porque cubre estrictamente el acceso a la infraestructura. Sin embargo, el coste total de propiedad empresarial exige contabilizar todo el paquete, especialmente cuando se integra en un entorno seguro y que cumpla con las normas.

1. Gastos generales de cumplimiento y seguridad

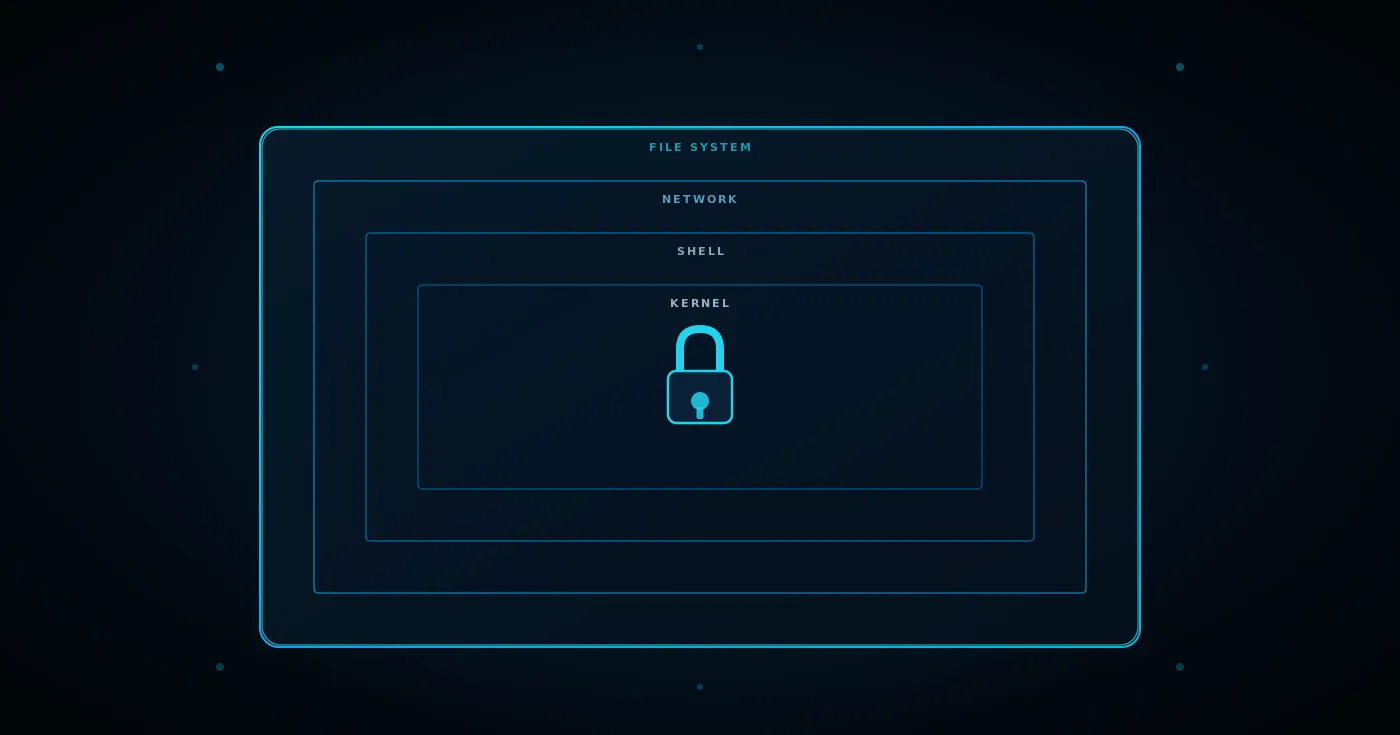

Cloudflare es una solución basada en SaaS. El plano de datos, donde se encuentran las indicaciones reales y la PII, reside en sus servidores, no en los tuyos. Los datos confidenciales de tus clientes deben salir de tu VPC, transitar por la Internet pública (a través de túneles cifrados), ser procesados por Cloudflare y, a continuación, pasar al LLM.

Para una empresa de tecnología financiera o de atención médica, esta arquitectura a menudo desencadena una evaluación de riesgos de terceros. En este caso, el coste no es solo la suscripción, sino también los gastos operativos derivados de las revisiones de InfoSec, la negociación de los anexos de procesamiento de datos (DPA) y, posiblemente, la compra de complementos de seguridad empresarial para cumplir con los requisitos de residencia de los datos.

2. Estrategia de retención de registros

El límite de 1 millón de registros del plan de pago cubre la depuración inmediata, pero el cumplimiento a largo plazo requiere más. Cloudflare no almacena estos registros de forma indefinida.

Para los casos de uso que requieren registros de auditoría a largo plazo (por ejemplo, 7 años), el almacenamiento de puerta de enlace nativo a menudo debe complementarse con exportaciones externas. Es posible que tengas que pagar para exportar los registros a través de Logpush a un bucket de S3 o a Splunk.

- La tarifa de Logpush: Las primeras 10 millones de solicitudes son gratuitas. Después, se aplican tarifas (por ejemplo, 0,05 USD por millón de solicitudes) para transferir los datos, más los gastos de almacenamiento en la nube.

3. Restricciones de enrutamiento SaaS administradas

Cuando utiliza un router SaaS administrado, acepta la lógica de infraestructura del proveedor. Esto puede limitar las estrategias complejas de arbitraje de costos, como dirigir el tráfico a un modelo privado alojado en instancias puntuales dentro de su propia VPC de AWS para ahorrar en computación. Está trabajando dentro de la lógica de enrutamiento que admite la plataforma SaaS, lo que puede limitar su capacidad de diseñar una economía específica para cada unidad inferior.

Cuando los precios de Cloudflare AI Gateway tienen sentido

Es la herramienta adecuada para trabajos específicos:

- Aplicaciones nativas de Edge: Si todo tu conjunto ya está en Cloudflare Workers/Pages, esta es una opción natural. La integración es instantánea.

- Startups sin ingresos: Si tu gasto total en IA es inferior a 500$ al mes, la tarifa de 5$ es muy competitiva. Todavía no necesita una gobernanza compleja; necesita velocidad.

- POC: Si necesitas validar una cadena de mensajes hoy mismo, puedes hacerlo sin configurar el ingreso de Kubernetes.

Por qué algunos equipos miran más allá de Cloudflare AI Gateway

A medida que se escala, la prioridad suele pasar de la «facilidad de configuración» al «control de los datos».

Escalar los costos frente a la previsibilidad

Los precios basados en el consumo son lineales. El pago por solicitud (más la CPU y la exportación de registros) genera una factura variable que aumenta con el tráfico. A una escala determinada, pagar por una puerta de enlace de coste fijo que se ejecute en sus propias instancias reservadas suele generar una mejor economía unitaria.

Cumplimiento y residencia de datos

Este suele ser el factor decisivo. Muchos contratos empresariales estipulan que los datos de los usuarios nunca deben salir de una región de AWS o una VPC específica. Una puerta de enlace SaaS es estructuralmente incompatible con esta topología. Si necesita la soberanía de los datos, necesita un plano de datos autohospedado o en una VPC.

Requisitos de orquestación avanzada

Los oleoductos RAG empresariales son complejos. Es posible que necesites una expresión regular personalizada para enmascarar la PII que se ejecute antes de que el mensaje abandone tu red, o una lógica de conmutación por error compleja que dirija a un modelo local de Llama 3 si se agota el tiempo de espera de OpenAI. Ejecutar esto en un entorno SaaS compartido puede resultar restrictivo en comparación con ejecutar tu propio contenedor de puerta de enlace.

Cómo Truefoundry aborda los precios de AI Gateway de manera diferente

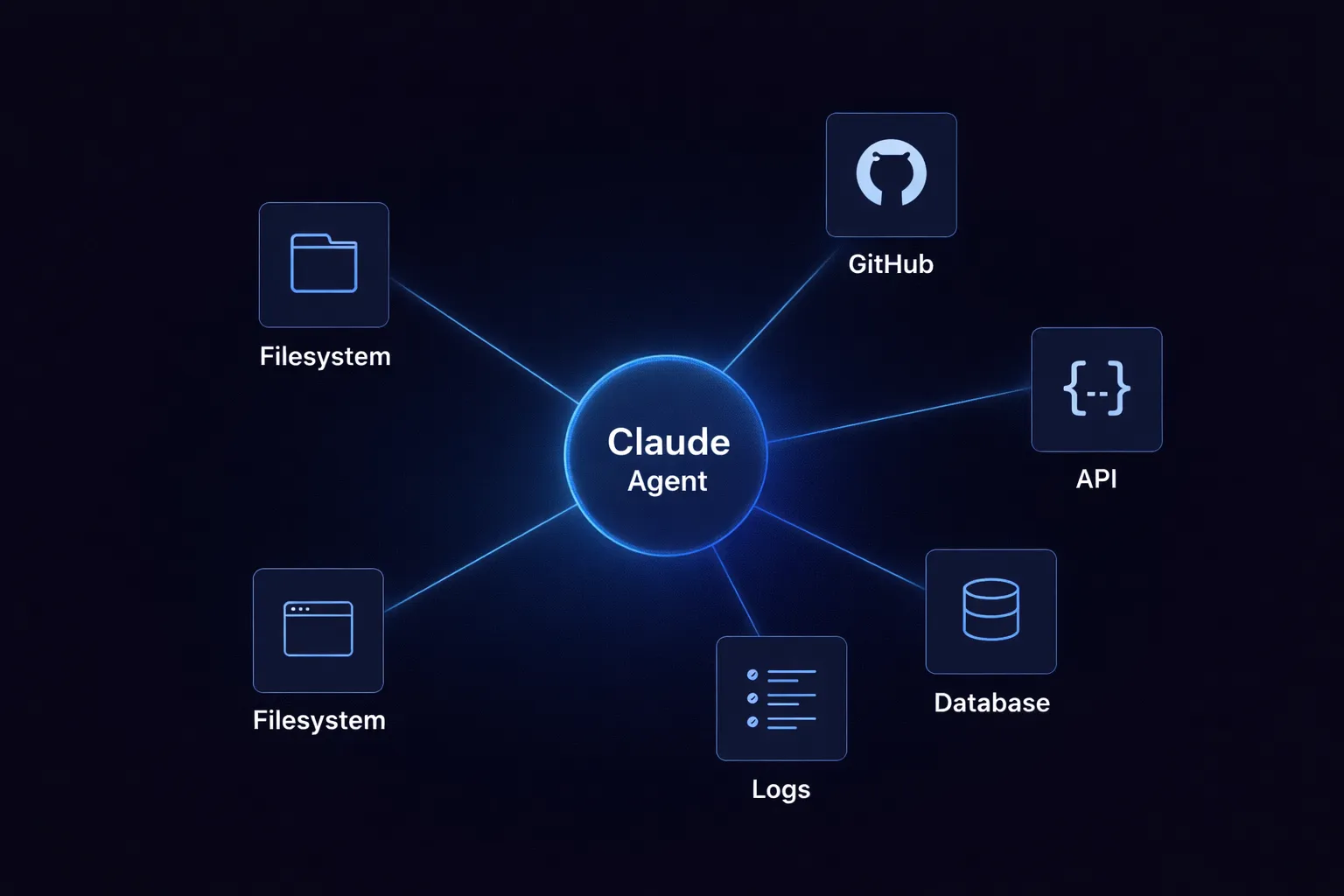

Truefoundry adopta una postura arquitectónica diferente: Separación entre plano de control y plano de datos.

Lo diseñamos para los ingenieros que necesitan funciones de puerta de enlace pero que requieren una soberanía total de los datos.

- El plano de control: Gestionado por nosotros (o hospedado por nosotros mismos). Esto gestiona la configuración, los usuarios y los paneles.

- El plano de datos: Se ejecuta como un contenedor en su nube (AWS, GCP, Azure). Sus claves de API, sus instrucciones y los datos de sus clientes nunca abandonan su entorno.

Control presupuestario granular

Le permitimos establecer presupuestos que impongan límites de dinero estrictos a equipos o proyectos específicos. Si un script de agente experimental se repite inesperadamente, la puerta de enlace detiene el tráfico a nivel de infraestructura antes de que los costos se disparen.

Conectividad universal

Dado que la puerta de enlace se encuentra en su VPC, trata los modelos privados exactamente igual que los públicos. Puedes dirigir el tráfico a un modelo de Llama 3 que se ejecute en un nodo de GPU local con la misma facilidad con la que lo harías al GPT-4. Esto te permite optimizar el coste y la latencia sin preocuparte por las tarifas de salida o el transporte público por Internet.

Cloudflare AI Gateway vs Truefoundry: comparación detallada de precios

¿Está preparado para crear IA sin sorpresas en los precios?

La elección de una puerta de enlace es una decisión de infraestructura, no solo una selección de herramientas. La puerta de enlace AI de Cloudflare es excelente para los casos de uso «periféricos»: ligera, rápida y fácil de iniciar. Sin embargo, si estás creando una plataforma empresarial, los requisitos de gobernanza, localización de datos y economía a tanto alzado suelen apuntar hacia una arquitectura privada.

Truefoundry está diseñado para durar mucho tiempo. Separamos el plano de control de sus datos para que, a medida que su volumen crezca, sus costos permanezcan vinculados a su propia infraestructura eficiente.

Próximo paso: Si está evaluando las pasarelas para una carga de trabajo de producción y necesita que los datos permanezcan dentro de su VPC, [Reserve una demostración con Truefoundry]. Veamos cómo una arquitectura privada gestiona tu tráfico.

Preguntas frecuentes

¿La puerta de enlace de IA de Cloudflare es gratuita?

Tiene un nivel gratuito, sí. Obtienes 100 000 registros al mes. Sin embargo, una vez que alcanzas ese límite, el registro normalmente se detiene. En el caso de las aplicaciones de producción, por lo general necesitarás el plan «Workers Paid» (a partir de 5 USD al mes) para desbloquear límites más altos.

¿Cuánto costará Cloudflare AI?

La facturación de la pasarela se incluye en Cloudflare Workers. Pagas 5$ al mes por los primeros 10 millones de solicitudes. Después, son **0,30 USD por millón de solicitudes** (los precios se basan en los datos disponibles públicamente a principios de 2026). Recuerde: esa tarifa cubre la infraestructura de la pasarela. Aún pagas a OpenAI/Anthropic por separado por los tokens.

¿Por qué es Truefoundry más rentable que la IA de Cloudflare?

A escala, Truefoundry optimiza el TCO al aprovechar su infraestructura de nube existente. Evita el marcado variable «por solicitud» de un proxy SaaS y almacena los registros en sus propios depósitos de S3 (lo que reduce las tarifas de exportación). Además, nuestra arquitectura simplifica el enrutamiento del tráfico hacia modelos de código abierto rentables y autohospedados dentro de su propia VPC.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.png)

.webp)

.webp)