Uso del token OpenCode: cómo funciona y cómo optimizarlo

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Introducción

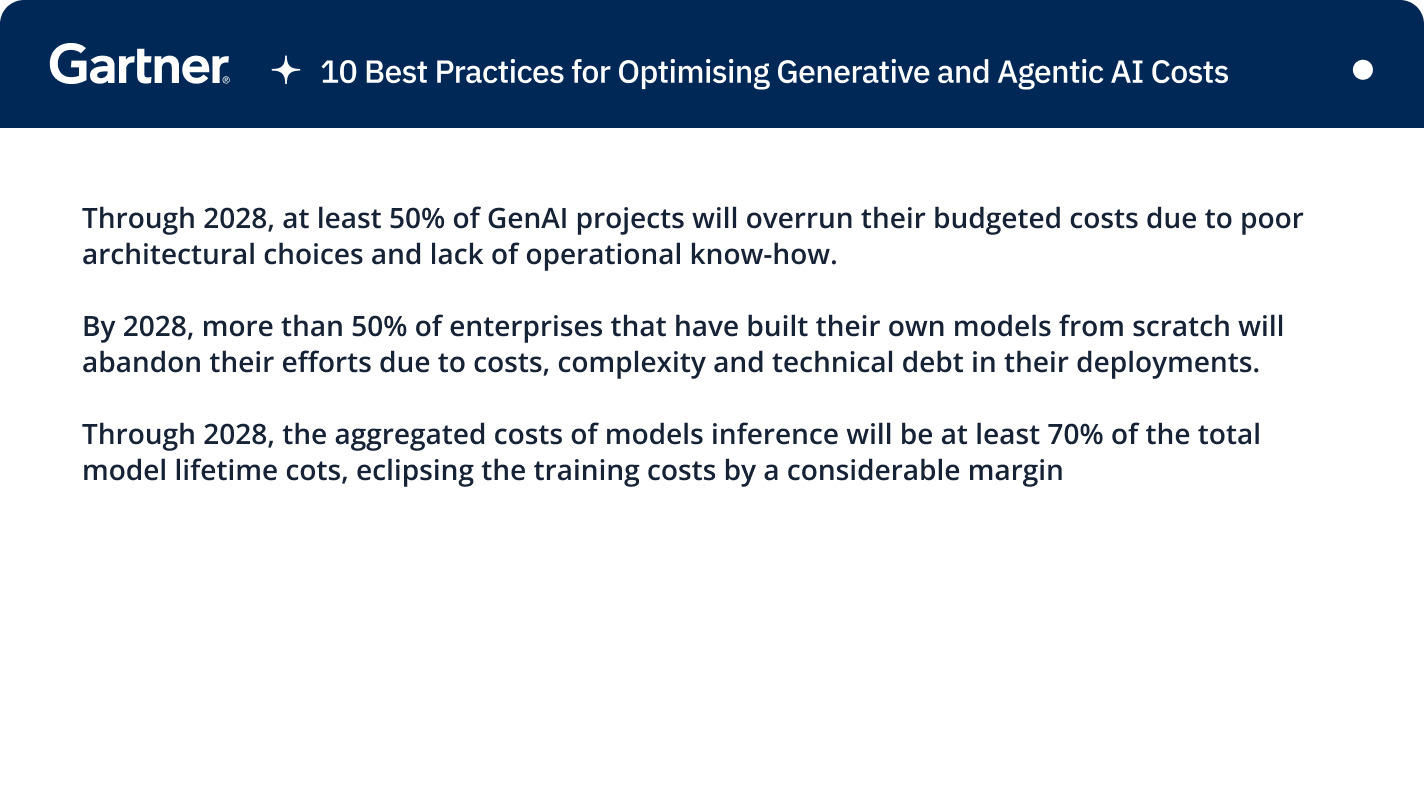

Las herramientas de codificación asistidas por IA, como OpenCode, cambian radicalmente la forma en que los desarrolladores interactúan con el código. En lugar de funcionar con fragmentos aislados, estos sistemas analizan los archivos, las dependencias y el contexto histórico. El resultado es un aumento significativo de la productividad, pero también un nuevo desafío de costos y escalabilidad que muchos equipos subestiman: uso de tokens.

A diferencia de las herramientas de desarrollo tradicionales con costos de licencia predecibles, el uso de OpenCode se rige por precios basados en tokens. Cada interacción, generación de código, refactorización, depuración o revisión, consume fichas. A medida que los equipos amplían el uso entre desarrolladores, repositorios y agentes automatizados, el consumo de tokens se convierte en el principal impulsor de costos.

Lo que hace que esto sea particularmente complicado es que el uso de tokens es a menudo no intuitivo. Los pequeños cambios en el tamaño del contexto, la estructura de los mensajes o el comportamiento de los agentes pueden provocar grandes cambios en el consumo de tokens. Sin un modelo mental claro sobre cómo se utilizan los tokens, los equipos tienen dificultades para predecir los costos, optimizar los flujos de trabajo o aplicar medidas de protección.

Este blog explica cómo funciona el uso de los tokens en OpenCode a nivel técnico, por qué las cargas de trabajo relacionadas con el código son especialmente pesadas en los tokens y qué deben entender los equipos de la plataforma antes de escalar el uso en producción.

Cómo funciona el uso de tokens en OpenCode

En esencia, el uso de los tokens de OpenCode sigue la misma mecánica que la mayoría de los sistemas impulsados por LLM: los tokens se consumen tanto para las entradas como para las salidas. Sin embargo, la naturaleza de las cargas de trabajo de codificación introduce una complejidad adicional.

Fichas rápidas frente a fichas de finalización

El uso de los tokens de OpenCode se puede dividir ampliamente en dos categorías:

- Tokens rápidos: Todo enviado en el modelo

- Tokens de finalización: Todo lo generado por el modelo

En OpenCode, los tokens de aviso suelen incluir:

- La instrucción del usuario (p. ej., «refactorizar esta función»)

- Contexto del código (archivos, fragmentos, diferencias)

- Instrucciones a nivel de sistema o políticas de agente

- Estado de la herramienta o del agente (en flujos de trabajo de varios pasos)

Los tokens de finalización incluyen:

- Código generado

- Explicaciones o comentarios

- Salidas estructuradas utilizadas por agentes o herramientas

Desde el punto de vista de los costos, los tokens rápidos suelen ser el factor dominante en el uso de OpenCode, especialmente a medida que aumentan los tamaños de los repositorios y los contextos.

Por qué las cargas de trabajo de código consumen desproporcionadamente más tokens

Las tareas relacionadas con el código se comportan de manera muy diferente a las consultas en lenguaje natural. Hay varios factores que contribuyen a un mayor consumo de fichas:

1. Las ventanas de contexto grandes son comunes

A diferencia de los casos de uso basados en el chat, OpenCode suele enviar:

- Archivos completos

- Varios archivos relacionados

- Gráficos de dependencia

- Casos de prueba o archivos de configuración

Incluso una base de código «pequeña» puede traducirse rápidamente en decenas o cientos de miles de tokens cuando se incluyen varios archivos.

2. Los tokens estructurales se suman

El código fuente es denso. La sintaxis, la indentación, los símbolos y el formato se tienen en cuenta a la hora de calcular los símbolos. Unos pocos miles de líneas de código pueden consumir muchos más símbolos que una cantidad equivalente de texto sin formato.

3. Razonamiento e iteración en varios pasos

Los flujos de trabajo de OpenCode suelen incluir:

- Pasos de planificación

- Generación de código

- Validación

- Correcciones o reintentos

Cada paso puede volver a enviar el contexto o las salidas intermedias, multiplicando el uso del token en una sola tarea.

4. La ejecución basada en agentes amplifica el uso

Cuando OpenCode se usa mediante agentes o automatización (por ejemplo, al refactorizar en varios archivos o ejecutarlo en canalizaciones de CI), el uso de los tokens aumenta rápidamente:

- El contexto se reutiliza en varios pasos

- El estado intermedio se pasa repetidamente

- Los reintentos se producen automáticamente

Esto hace que el uso impulsado por agentes sea potente, pero también caro, si no limitado.

Por qué es difícil predecir el uso de los tokens sin instrumentación

Uno de los mayores desafíos con el uso de los tokens de OpenCode es que los desarrolladores rara vez ven el contexto completo que se envía al modelo. Los editores y las herramientas resumen:

- Qué archivos se incluyeron

- Qué cantidad de cada archivo se envió

- Si los resultados anteriores se reutilizaron como contexto

Como resultado, dos tareas aparentemente similares pueden tener huellas simbólicas muy diferentes. Sin un seguimiento explícito a nivel de solicitud, los equipos suelen descubrir problemas de costes solo después de los picos de uso.

Esta es la razón por la que entender la mecánica de los tokens no es suficiente por sí solo. Los equipos necesitan visibilidad del consumo real de tokens por tarea, por desarrollador y por flujo de trabajo para tomar decisiones de optimización informadas.

Escenarios comunes que impulsan un uso elevado de los tokens de OpenCode

La mayoría de los picos en el uso de los tokens de OpenCode no se deben a un solo error evidente. Surgen de la forma en que se usa OpenCode en los flujos de trabajo de ingeniería del mundo real, especialmente cuando las herramientas y los agentes están profundamente integrados en los procesos de desarrollo y automatización.

A continuación se muestran los escenarios más comunes que aumentan desproporcionadamente el consumo de tokens.

1. Inyección de contexto en un repositorio grande o en varios archivos

Uno de los principales factores que contribuyen al alto uso de los tokens es inclusión de contexto demasiado amplia. Muchos flujos de trabajo de OpenCode incluyen directorios completos o subconjuntos grandes de un repositorio para «estar seguros», incluso cuando solo una pequeña parte del código es relevante.

Entre los ejemplos se incluyen:

- Enviar directorios de servicios completos para un solo cambio de función

- Incluir conjuntos de pruebas y archivos de configuración de forma innecesaria

- Reenviar los mismos archivos en varios pasos de un flujo de trabajo de agente

Como los tokens de aviso escalan linealmente con el tamaño del contexto, este patrón por sí solo puede multiplicar los costos rápidamente.

2. Rehidratación repetida del contexto en todas las iteraciones

OpenCode a menudo funciona de forma iterativa: genera código, revisa, ajusta, regenera. En muchas configuraciones, cada iteración reenvía el contexto completo, incluidos los archivos y las salidas anteriores.

Esto lleva a:

- Consumo de tokens duplicados en los reintentos

- Crecimiento exponencial del uso para tareas de larga duración

- Altos costos incluso para cambios «simples» que requieren varias iteraciones

Sin almacenamiento en caché ni reutilización inteligente del contexto, la iteración se convierte en uno de los patrones más caros.

3. Ejecución ilimitada de agentes

Cuando OpenCode se utiliza mediante agentes o flujos de trabajo automatizados, el uso de los tokens puede aumentar rápidamente si la ejecución no está limitada de forma explícita.

Entre las causas frecuentes se incluyen las siguientes:

- Agentes sin límite máximo de pasos o reintentos

- Cadenas de razonamiento recursivo

- Los agentes reevalúan grandes contextos en cada paso

Debido a que estos procesos suelen ejecutarse en segundo plano, es posible que los equipos no noten un uso descontrolado hasta que los costos aumenten.

4. Tareas de refactorización y revisión de código a escala

Las tareas de refactorización y revisión tienden a consumir más tokens que la generación de código porque requieren:

- Lectura y razonamiento sobre el código existente

- Comparación de implementaciones antiguas y nuevas

- Explicar o validar los cambios

Cuando estas tareas se aplican a bases de código de gran tamaño o a múltiples solicitudes de cambios, el uso de los tokens aumenta considerablemente.

5. Trabajos de CI, automatización y en segundo plano

El uso de OpenCode integrado en las canalizaciones de CI o los flujos de trabajo de automatización introduce un perfil de riesgo diferente. Estos sistemas:

- Ejecute con frecuencia y de forma automática

- A menudo procesan grandes diferencias o repositorios

- Puede volver a intentarlo de forma silenciosa en caso de error

Incluso el uso modesto de los tokens por ejecución puede resultar caro si se multiplica en muchas compilaciones o implementaciones.

6. Falta de visibilidad a nivel de usuario o tarea

Por último, uno de los factores más ignorados del alto uso de tokens es la ausencia de visibilidad. Cuando los equipos no pueden ver:

- Quién consume fichas

- Qué tareas son más caras

- Cómo cambia el uso con el tiempo

La optimización se convierte en conjeturas. Los equipos suelen responder restringiendo el uso a nivel mundial, en lugar de abordar los flujos de trabajo específicos que generan costos.

Mejores prácticas para optimizar el uso de los tokens de OpenCode

Una vez que los equipos entiendan de dónde proviene el uso de los tokens, el siguiente paso es la optimización. Es importante destacar que la optimización no consiste en limitar el uso arbitrariamente, sino en usar tokens intencionalmente para que las ganancias de productividad no se conviertan en costos incontrolados.

A continuación se presentan las mejores prácticas que reducen de manera consistente el uso de los tokens de OpenCode sin degradar la calidad de salida.

1. Reduzca deliberadamente el tamaño del contexto

La palanca de optimización más eficaz es controlar qué contexto se envía al modelo. Más contexto no siempre es mejor, especialmente cuando es irrelevante.

Las técnicas prácticas incluyen:

- Pasando contexto a nivel de archivo en lugar de directorios completos

- Incluyendo solo las funciones o clases en proceso de modificación

- Excluir los archivos generados, el código del proveedor y las configuraciones grandes de forma predeterminada

Una buena regla general: si un archivo no es necesario para motivo del cambio, no debe formar parte del mensaje.

2. Prefiero la recuperación al relleno de contexto

En lugar de enviar grandes cantidades de código por adelantado, los equipos deberían pasar a recuperación bajo demanda.

Ejemplos:

- Recupera símbolos o definiciones solo cuando se hace referencia a ellos

- Obtenga casos de prueba o configuraciones de forma condicional

- Utilice búsquedas indexadas en lugar de la inyección de contexto estático

Este enfoque reduce el tamaño de los mensajes y, a menudo, mejora la calidad del razonamiento, ya que el modelo recibe información más específica.

3. El alcance dirige a la tarea, no al repositorio

Las indicaciones genéricas tienden a fomentar un razonamiento más amplio y resultados más amplios, lo que aumenta tanto los indicadores de rapidez como de finalización.

Mejores patrones:

- Restringir explícitamente la tarea («modificar solo esta función»)

- Especifique el formato y los límites de salida

- Evite instrucciones abiertas como «analizar el código base»

Las indicaciones con ámbito de tarea no solo reducen el uso de los tokens, sino que también mejoran el determinismo.

4. Ejecución de Bound Agent de forma explícita

Los flujos de trabajo basados en agentes amplifican el uso de los tokens si no se seleccionan. Todos los agentes deben operar dentro de límites claramente definidos.

Las barandillas clave incluyen:

- Número máximo de pasos de razonamiento

- Límites estrictos para los reintentos

- Presupuestos temporales o simbólicos por tarea

Sin estos límites, los agentes pueden volver a procesar de forma involuntaria contextos de gran tamaño varias veces, lo que aumenta el uso.

5. Almacene en caché y reutilice siempre que sea posible

Muchos flujos de trabajo de OpenCode repiten tareas similares entre iteraciones o usuarios. El almacenamiento en caché puede reducir considerablemente el consumo de tokens redundantes.

Escenarios aplicables:

- Reutilización de los resultados del análisis en los reintentos

- Almacenamiento en caché de representaciones intermedias en flujos de varios pasos

- Evitar la generación repetida de explicaciones cuando no son necesarias

Incluso el almacenamiento en caché parcial a nivel de flujo de trabajo puede generar ahorros significativos.

6. Optimice el tamaño de finalización, no solo las indicaciones

Si bien los tokens rápidos suelen dominar, los tokens de finalización también son importantes, especialmente en los flujos de trabajo de refactorización o con muchas explicaciones.

Entre las técnicas se incluyen:

- Solicitando diferencias en lugar de archivos completos

- Limitar las explicaciones a menos que sea explícitamente necesario

- Hacer cumplir la longitud o la estructura de la salida

Las restricciones de salida claras reducen la verbosidad innecesaria.

7. Uso anticipado del token del instrumento

Por último, la optimización no debe ser reactiva. Los equipos deben instrumentar el uso de los tokens desde el primer día.

Como mínimo, esto significa rastrear:

- Tokens por solicitud

- Tokens por usuario o flujo de trabajo

- Coste por tarea a lo largo del tiempo

Sin estos datos, los equipos no pueden distinguir entre el uso productivo y el desperdicio.

Por qué el uso de los tokens de OpenCode se vuelve difícil de controlar a gran escala

La mayoría de los equipos no tienen problemas con el uso de los tokens de OpenCode desde el primer día. Los problemas surgen gradualmente a medida que su uso se extiende entre los desarrolladores, los repositorios y los flujos de trabajo automatizados. Lo que comienza como una herramienta de productividad individual se convierte rápidamente en infraestructura compartida, y el uso de los tokens aumenta de forma que resulta difícil predecir o gestionar.

1. El uso de los tokens se distribuye entre muchos actores

A gran escala, un solo desarrollador ya no usa OpenCode en un editor. Lo utilizan:

- Varios ingenieros en todos los equipos

- Agentes en segundo plano que ejecutan flujos de trabajo de larga duración

- Los trabajos de CI y automatización se activan con frecuencia

- Herramientas internas creadas sobre OpenCode

Cada uno de estos consumidores genera el uso de los tokens de forma independiente. Sin una visión centralizada, resulta difícil responder a preguntas básicas como quién usa los tokens, con qué propósito, y a qué precio.

2. Los controles a nivel de aplicación no se generalizan

Los primeros esfuerzos de optimización suelen implementarse en el nivel de la aplicación o la herramienta, los límites de mensajes personalizados, el recorte del contexto o la lógica de reintento. Si bien son útiles a nivel local, no se extienden de forma transversal:

- Diferentes editores o integraciones de IDE

- Múltiples servicios impulsados por Opencode

- Marcos de agentes con sus propios bucles de ejecución

Como resultado, las políticas se vuelven fragmentarias e inconsistentes. Un equipo optimiza agresivamente, mientras que otro aumenta los costos sin saberlo.

3. La automatización amplifica las pequeñas ineficiencias

La automatización cambia las matemáticas. Un flujo de trabajo que consume una cantidad modesta de tokens por ejecución puede resultar caro si:

- Se activa en cada pull request

- Se ejecuta en varias sucursales

- Se reintentó silenciosamente en caso de errores transitorios

Debido a que estos trabajos se realizan sin visibilidad humana directa, las ineficiencias se agravan rápidamente. Los picos de uso de los tokens suelen deberse a la automatización más que al uso interactivo.

4. La falta de atribución oculta los verdaderos impulsores

Sin una atribución detallada, los equipos solo ven las cifras de uso agregadas. Esto hace que la optimización sea reactiva y contundente.

Los modos de fallo comunes incluyen:

- Límites de uso generales que reducen la productividad

- Desactivación de flujos de trabajo útiles debido a costos inesperados

- Optimizar las tareas incorrectas mientras persisten los flujos de alto costo

El control efectivo requiere saber qué flujos de trabajo generan valor y cuáles generan residuos algo que las métricas agregadas no pueden revelar.

5. La gobernanza y los controles de costos van a la zaga de la adopción

En muchas organizaciones, la adopción de herramientas de IA supera a la gobernanza. El uso de OpenCode se extiende más rápido que:

- La propiedad del presupuesto está definida

- Las políticas están formalizadas

- Se implementan barandas

Cuando el uso de los tokens se convierte en una preocupación, las herramientas ya están profundamente integradas en los flujos de trabajo, lo que hace que los controles retroactivos sean difíciles y disruptivos.

¿Qué significa esto para los equipos de plataformas?

El problema central no es el mal uso, es uso descentralizado sin control centralizado. A medida que OpenCode se convierte en una infraestructura compartida, el uso de los tokens debe gestionarse de la misma manera que los equipos gestionan los recursos de computación, almacenamiento o CI.

Esto requiere:

- Visibilidad centralizada de todos los usuarios y flujos de trabajo

- Aplicación coherente de los límites y las políticas

- Atribución que alinea el costo con la propiedad

Sin este cambio, el uso de los tokens sigue siendo impredecible y los esfuerzos de optimización siguen siendo reactivos.

Supervisión y control del uso de los tokens de OpenCode en la producción

Una vez que el uso de OpenCode alcanza la escala de producción, el seguimiento ad hoc y las optimizaciones manuales dejan de funcionar. En esta etapa, el uso de los tokens debe tratarse como cualquier otro recurso de infraestructura compartida - se mide de forma continua, se gobierna de forma centralizada y está vinculado a la propiedad.

Por qué la supervisión a nivel de aplicación no es suficiente

Muchos equipos comienzan por hacer un seguimiento del uso de los tokens en herramientas o flujos de trabajo individuales. Si bien esto proporciona información local, se desglosa rápidamente cuando:

- Se utilizan varios editores o IDE

- OpenCode está integrado en herramientas internas

- Los agentes y la automatización se ejecutan fuera de los flujos de trabajo del desarrollador

Cada integración informa sobre el uso de forma diferente y ninguna ofrece una visión holística. Como resultado, los equipos de la plataforma carecen de una única fuente veraz sobre el consumo de tokens.

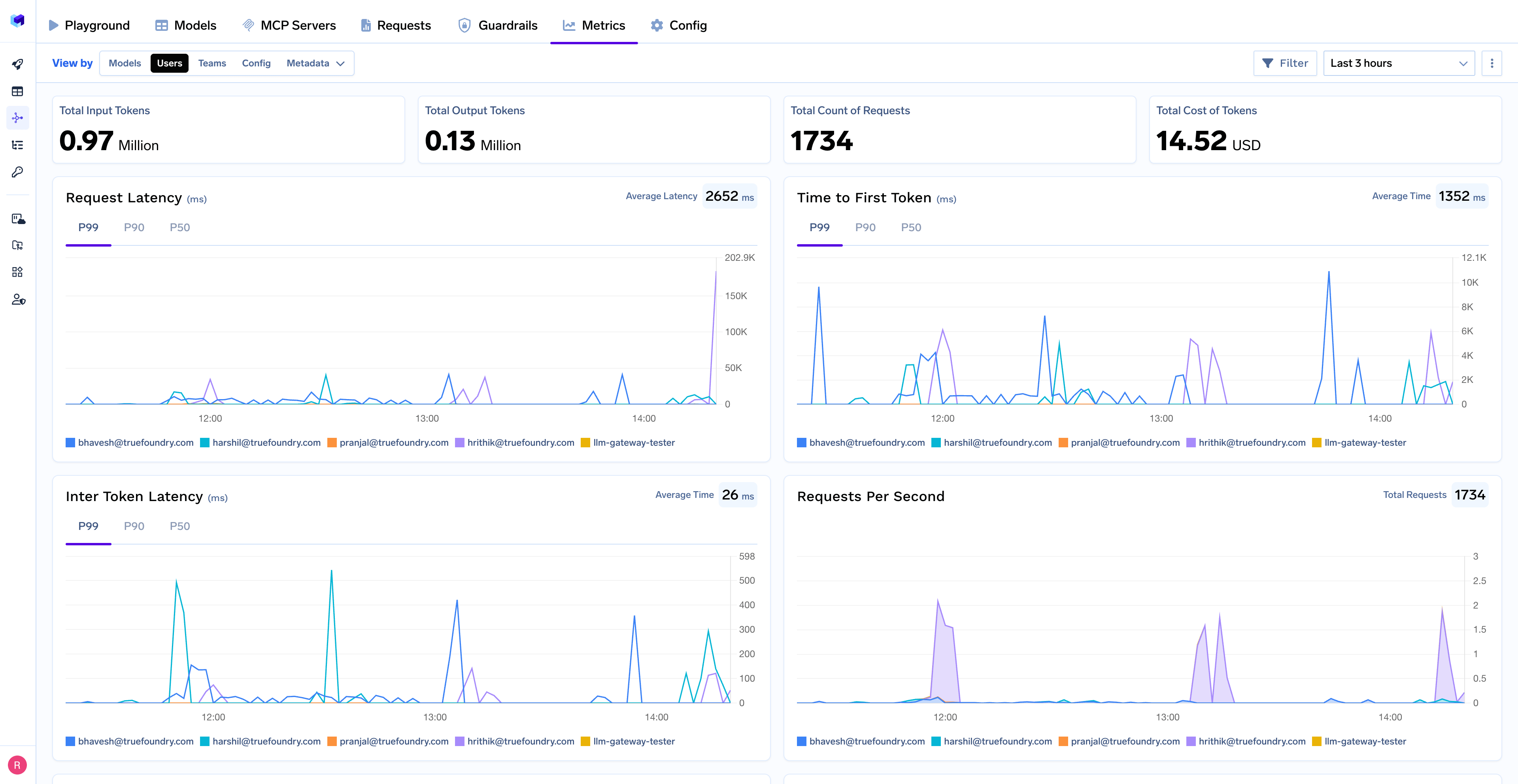

Qué aspecto tiene el monitoreo efectivo de los tokens

A gran escala, el monitoreo debe realizarse en nivel de solicitud, no solo el nivel de la herramienta. Las configuraciones efectivas capturan:

- Tokens consumidos por solicitud (solicitud y finalización)

- Coste por solicitud según el precio del modelo

- Contexto de identidad (usuario, servicio, agente, repositorio, entorno)

- Modos de latencia, reintentos y fallos

Esto permite a los equipos responder a preguntas como:

- ¿Qué flujos de trabajo son los más caros por ejecución?

- ¿Qué repositorios o agentes impulsan el uso sostenido?

- ¿En qué casos los reintentos o los errores aumentan el recuento de tokens?

Sin esta granularidad, los esfuerzos de optimización siguen siendo groseros y, a menudo, mal dirigidos.

Atribución de costos y propiedad

La gobernanza comienza con la atribución. El uso de los tokens debe asignarse a los propietarios que puedan actuar en consecuencia.

Los modelos de atribución más comunes incluyen:

- Por desarrollador o equipo

- Por repositorio o proyecto

- Por flujo de trabajo o proceso de automatización

Una vez que la propiedad está clara, las conversaciones sobre los costos pasan de la presupuestación abstracta a las decisiones concretas sobre qué flujos de trabajo ofrecen un valor suficiente.

Aplicación de políticas y barandas

El monitoreo por sí solo no evita los sobrecostos. Los sistemas de producción requieren mecanismos de ejecución que funcionan en tiempo real.

Las barandillas típicas incluyen:

- Presupuestos de tokens por usuario o por equipo

- Límites de velocidad para flujos de trabajo de alta frecuencia

- Capítulos rígidos para agentes en segundo plano

- Límites basados en el entorno (p. ej., límites más estrictos en CI)

Estos controles deben aplicarse de forma centralizada para que todos los flujos de trabajo impulsados por OpenCode los hereden automáticamente.

¿Por qué es importante la centralización?

El hilo conductor de las configuraciones de gobierno eficaces es centralización. Las políticas de uso, los límites y la visibilidad de los tokens deben estar en un punto de control compartido en lugar de volver a implementarse en todas las herramientas.

Aquí es donde las plataformas orientadas a la infraestructura, como True Foundry encajan de forma natural. Al centralizar el tráfico, la observabilidad y la aplicación de políticas de la IA, los equipos de la plataforma pueden gestionar el uso de los tokens de OpenCode de forma coherente entre desarrolladores, agentes y sistemas automatizados, sin ralentizar a los equipos individuales.

Administración del uso de tokens de OpenCode con TrueFoundry

Desde el punto de vista de la plataforma, el principal desafío con el uso de los tokens de OpenCode es no entender cómo los tokens se consumen, pero donde deberían residir el control y la visibilidad.

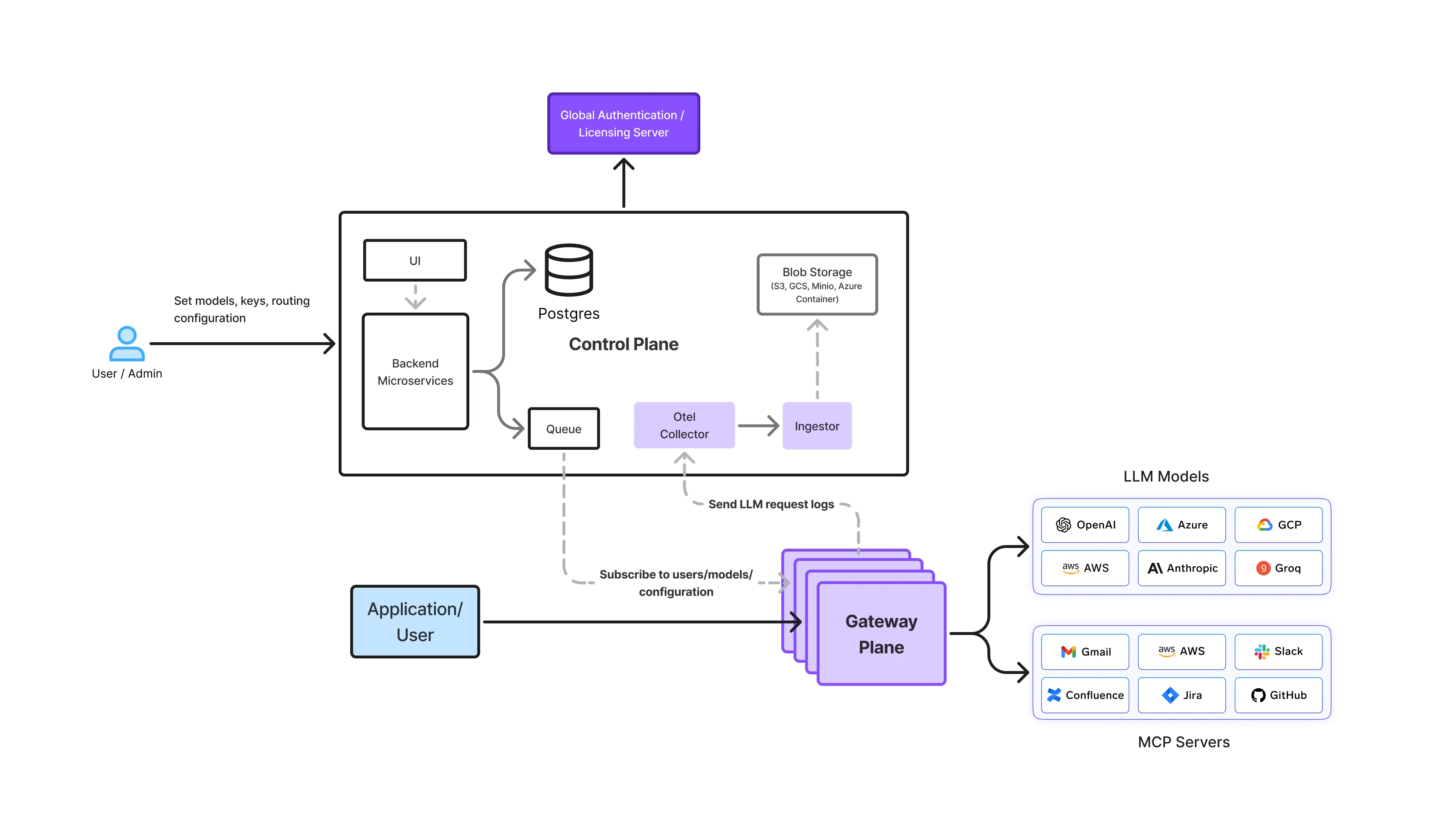

TrueFoundry aborda este problema tratando el uso de la IA y la LLM, incluidas las herramientas para desarrolladores como OpenCode, como una infraestructura compartida que debe ser observable, gobernable y rentable de forma predeterminada. En el centro de este enfoque se encuentra la Puerta de enlace de IA, que actúa como plano de control para todo el tráfico de LLM de la organización.

Centralización del tráfico de código abierto a través de la puerta de enlace de IA

En una configuración de TrueFoundry, OpenCode no interactúa directamente con los proveedores de LLM subyacentes. En cambio, todas las solicitudes fluyen a través del AI Gateway, que proporciona una interfaz única y coherente para la inferencia.

Desde el punto de vista arquitectónico, esto permite:

- Un único punto de entrada para todas las solicitudes generadas por OpenCode

- Gestión uniforme del tráfico puntual y de finalización

- Aplicación centralizada de límites, políticas y enrutamiento

Al eliminar el acceso directo al modelo de las herramientas individuales, los equipos de la plataforma obtienen una visibilidad total de cómo se usa realmente OpenCode entre los desarrolladores, los agentes y la automatización.

La observabilidad a nivel simbólico como primitiva de primera clase

AI Gateway de TrueFoundry captura uso de tokens a nivel de solicitud, que incluye:

- Fichas rápidas frente a fichas de finalización

- Modelo y proveedor utilizados

- Señales de latencia, reintentos y fallos

- Contexto de identidad (usuario, equipo, servicio, entorno)

Fundamentalmente, esta telemetría no está bloqueada en un sistema controlado por el proveedor. Los registros y las métricas se conservan en la nube y el almacenamiento propios del cliente, lo que permite a los equipos:

- Ejecute un análisis personalizado de los patrones de uso de los tokens

- Correlacione el uso de OpenCode con repositorios, trabajos de CI o incidentes

- Conserve la propiedad total de los datos confidenciales de avisos y códigos

Esto evita el problema de la «caja negra» común en las herramientas de IA y hace posible la optimización a largo plazo.

Atribución de costos y aplicación de políticas a nivel de plataforma

Como todo el tráfico de OpenCode pasa por la puerta de enlace, se pueden aplicar controles de costos. de manera consistente y en tiempo real.

Los equipos de plataforma pueden:

- Atribuya el uso de los tokens a desarrolladores, equipos o proyectos

- Imponga presupuestos por equipo o por entorno

- Aplica límites de velocidad o límites estrictos a los flujos de trabajo impulsados por agentes

- Diferencie los controles entre el uso interactivo y la automatización

Estas políticas se aplican una vez en la puerta de enlace y se aplican automáticamente a todos los flujos de trabajo impulsados por Opencode sin necesidad de realizar cambios en los editores, complementos o herramientas internas.

Compatible con flujos de trabajo de escalado, automatización y basados en agentes

La arquitectura de TrueFoundry está diseñada para entornos en los que el uso de OpenCode se extiende más allá del IDE. Las canalizaciones de CI, los trabajos en segundo plano y los agentes suelen generar el mayor y menos visible consumo de tokens.

Al enrutar estas cargas de trabajo a través del mismo AI Gateway, los equipos pueden:

- Detecte anticipadamente la ejecución incontrolada de un agente

- Compare los patrones de uso interactivos con los automatizados

- Aplica controles más estrictos a las cargas de trabajo no interactivas

Esto permite escalar el uso de OpenCode en toda la organización sin perder la previsibilidad ni el control.

Conclusión

El uso de tokens OpenCode es la verdadera restricción de escala para la codificación asistida por IA. A medida que el uso se extiende entre los desarrolladores, los repositorios, la automatización y los agentes, el consumo de tokens se vuelve difícil de predecir y controlar sin una visibilidad y una gobernanza centralizadas.

Administrar esto a nivel de herramienta o aplicación no es escalable. El uso de los tokens requiere una observabilidad a nivel de solicitud, una atribución clara y una aplicación en tiempo real, y tratar la codificación asistida por IA como una infraestructura compartida, no como una función aislada.

Plataformas como True Foundry reflejan este enfoque al centralizar el tráfico de OpenCode a través de una puerta de enlace de IA, lo que permite a los equipos monitorear, gobernar y optimizar el uso de los tokens de manera consistente. Para los líderes de plataformas e ingeniería, la conclusión es simple: si OpenCode es fundamental para la creación del software, el uso de los tokens debe gestionarse con el mismo rigor que cualquier otro recurso de infraestructura crítica.

Preguntas frecuentes

¿Cómo comprobar el uso de los tokens en OpenCode?

La verificación precisa del uso de los tokens de código abierto requiere un seguimiento e instrumentación explícitos a nivel de solicitud. Dado que las herramientas suelen abstraer todo el contexto que se envía al modelo, obtener visibilidad del consumo real de tokens por tarea, desarrollador y flujo de trabajo es crucial para predecir los costos y optimizar el uso de manera eficaz.

¿Qué es el uso de los tokens de OpenCode?

El uso de tokens Opencode es el modelo de precios basado en tokens para herramientas de codificación asistidas por IA como OpenCode. Cada interacción, desde las instrucciones de entrada y el contexto del código hasta el código generado y las explicaciones, consume tokens. Gestionar el uso de estos tokens de código abierto es crucial, ya que se convierte en el principal factor de costes para los equipos de desarrollo de EE. UU.

¿Cómo reducir el uso de tokens en OpenCode?

Para reducir el uso de tokens de código abierto, limita la inyección de contexto solo a los archivos esenciales, evitando la inclusión generalizada de repositorios. Evite la rehidratación repetida del contexto reutilizando los resultados de forma inteligente en todas las iteraciones. Divida las tareas complejas en pasos más pequeños y utilice indicaciones precisas. La supervisión del consumo de fichas para cada tarea proporciona información fundamental para optimizar los costos y la eficiencia.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)