LLMOP para servicio e inferencia de modelos

.webp)

- Implemente cualquier LLM de código abierto dentro de su canalización de LLMOps mediante configuraciones preconfiguradas y ajustadas al rendimiento

- Intégrese sin problemas con Hugging Face, registros privados, o cualquier centro de modelos, totalmente gestionado dentro de su plataforma LLMOps

- Aproveche los modelos de servidores líderes del sector, como VLLM y jerga SG para inferencias de baja latencia y alto rendimiento

- Habilitar Escalado automático de GPU, apagado automático y aprovisionamiento inteligente de recursos en toda su infraestructura de LLMOP.

.webp)

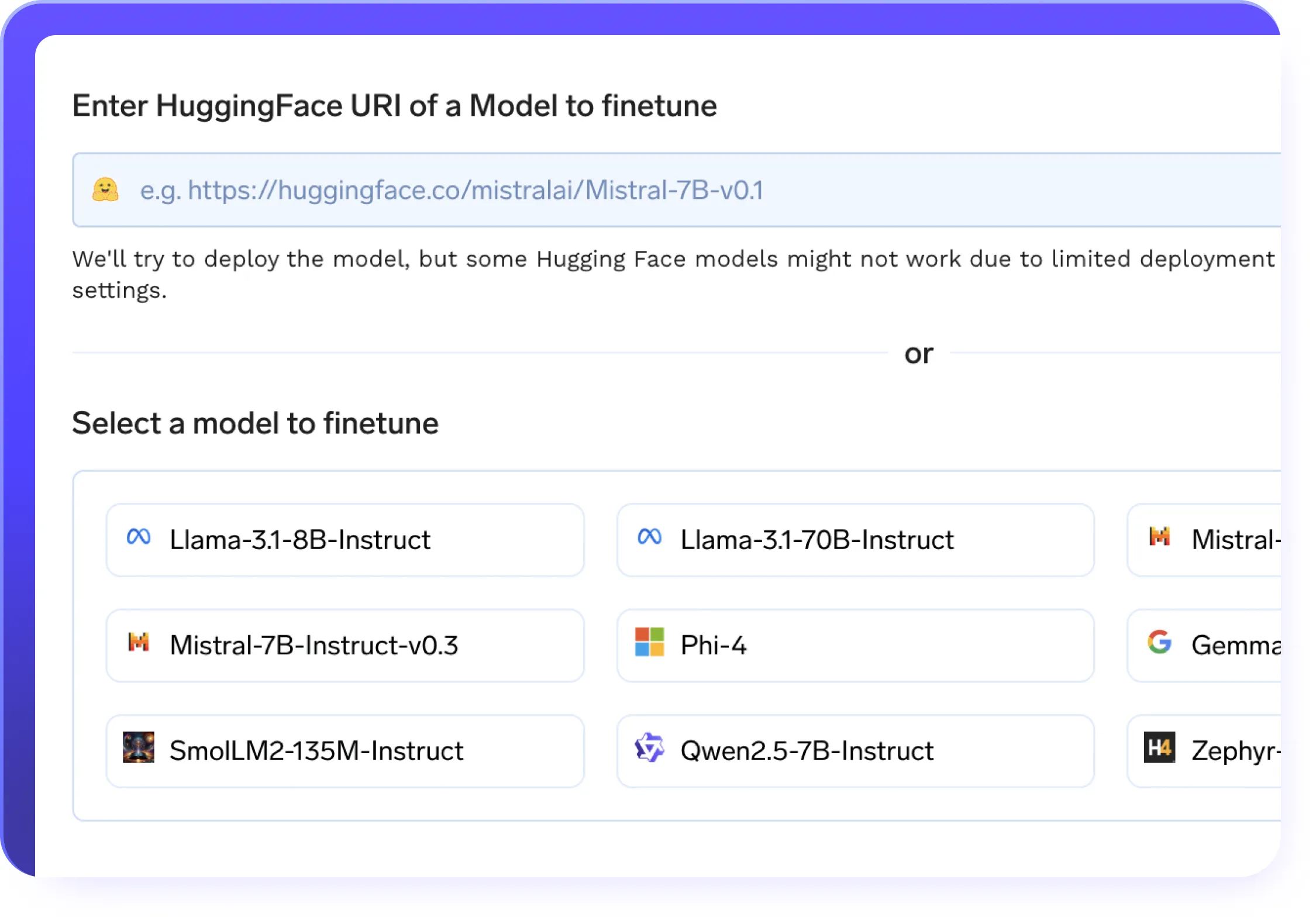

Afinación eficiente

.webp)

- Soporte de ajuste fino sin código y de código completo en conjuntos de datos personalizados

- LoRa y QLoRa para una adaptación eficiente de rango bajo

- Reanude la formación sin problemas con puesto de control soporte en todas sus canalizaciones de LLMOP

- Un clic despliegue de modelos ajustados con los mejores modelos de servidores de su clase

- Canalizaciones de formación automatizadas con funciones integradas seguimiento de experimentos integrado en sus flujos de trabajo de LLMOps

- Soporte de capacitación distribuido para una optimización de modelos más rápida y a gran escala

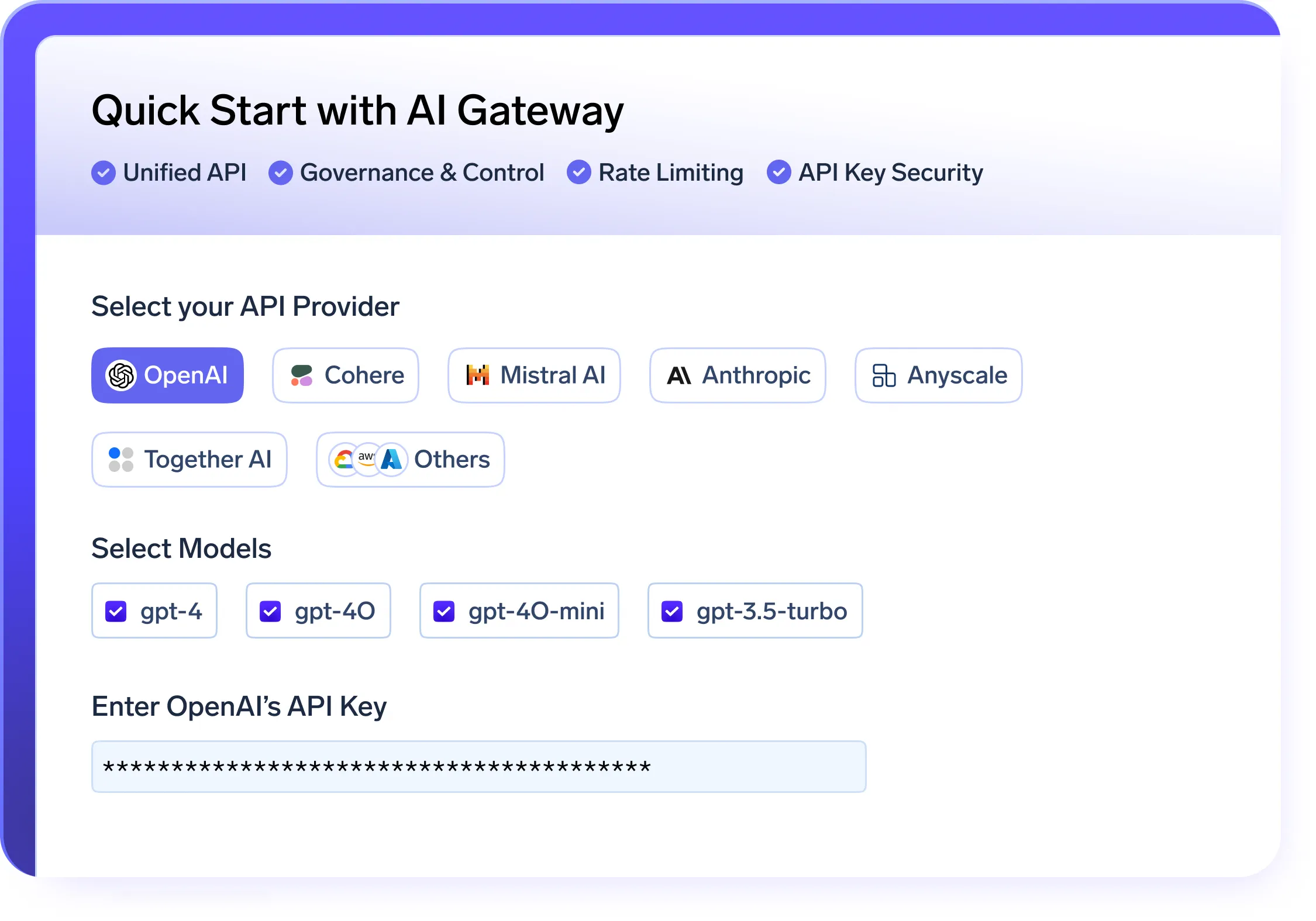

Puerta de enlace de IA segura y escalable

.webp)

- UN API unificada capa para servir y administrar modelos en OpenAI, Llama, Gemini y otros proveedores

- Incorporado gestión de cuotas y control de acceso para hacer cumplir el uso seguro y gobernado del modelo dentro de su plataforma LLMOps

- Estadísticas en tiempo real para el uso, el costo y el rendimiento para mejorar la observabilidad de los LLMOP

- Inteligente reintentos automáticos y alternativos para garantizar la confiabilidad en todas sus canalizaciones de LLMOP

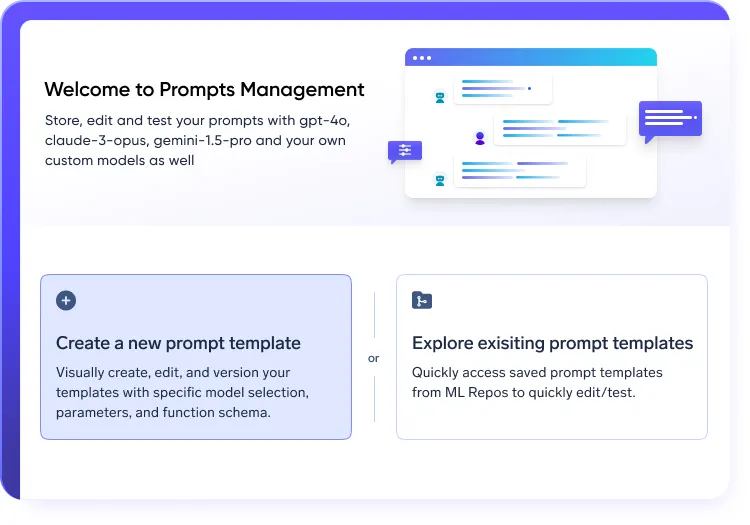

Flujos de trabajo rápidos y estructurados en la pila LLMOP

.webp)

- Experimenta e itera usando mensaje controlado por versiones ingeniería

- Corre Pruebas A/B en todos los modelos para optimizar el rendimiento

- Mantenga la trazabilidad total de los cambios rápidos dentro de su plataforma LLMOps

Rastreo y barreras para los flujos de trabajo de LLMOP

.webp)

- Capturar trazas completas de indicaciones, respuestas, uso de tokens y latencia

- Supervise el rendimiento, tasas de finalización y anomalías

- Intégralo con barandas para la detección de PII y la moderación de contenido en las canalizaciones de LLMOP

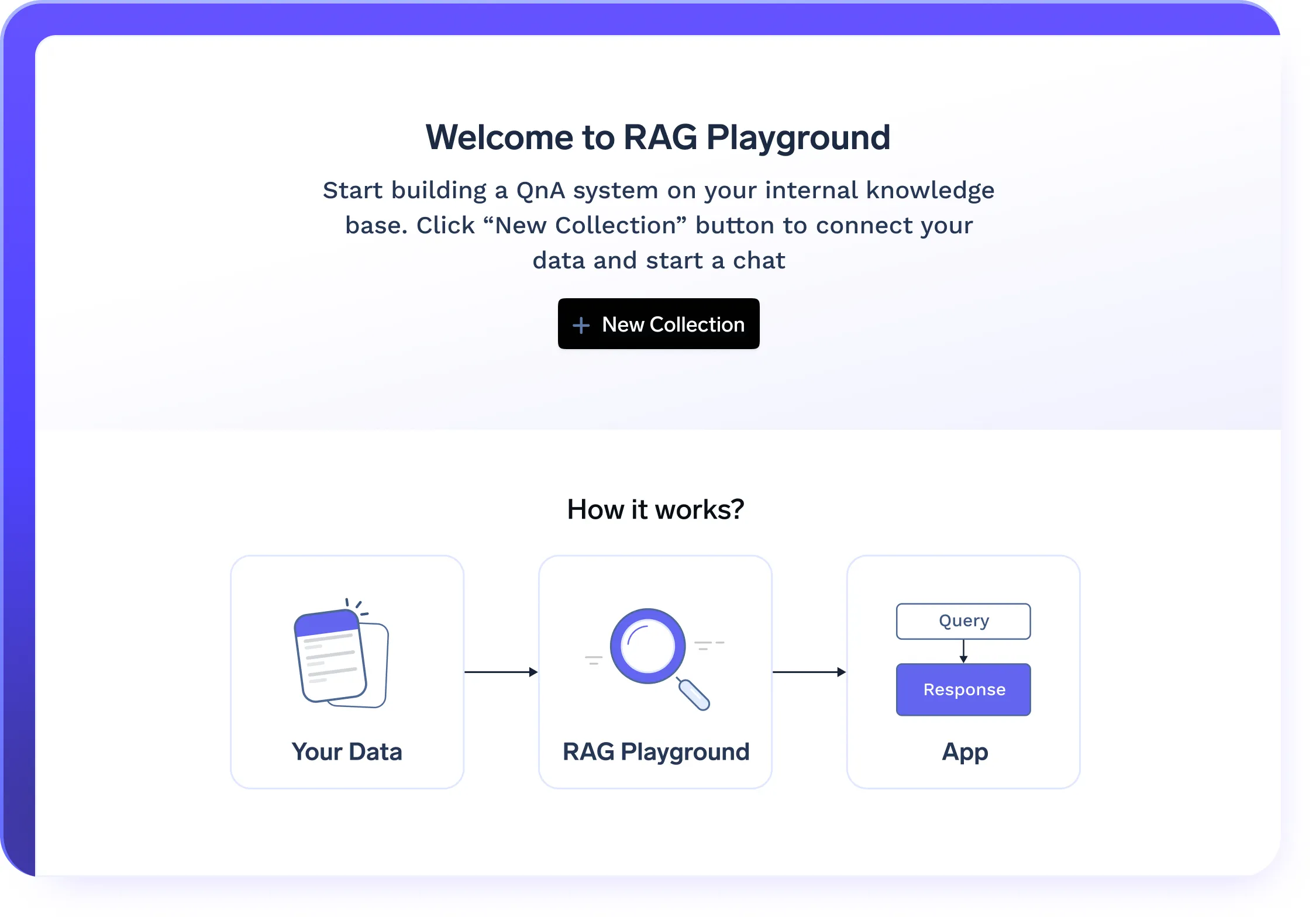

Despliegue de RAG con un clic

.webp)

- Implementa todos los componentes RAG con un solo clic, incluidos VectorDB, modelos de incrustación, frontend y backend

- Infraestructura configurable para optimizar el almacenamiento, la recuperación y el procesamiento de consultas

- Gestione las crecientes bases de documentos con la escalabilidad de LLMOP nativa de la nube

LLMOP para la gestión del ciclo de vida de los agentes de IA

.webp)

- Ejecute y escale agentes en cualquier marco utilizando su infraestructura de LLMOps

- Soporte para LangChain, AutoGen, CrewAI y agentes personalizados

- Orquestación de agentes independiente del marco con monitoreo de LLMOP incorporado

- Soporte para la orquestación de múltiples agentes, lo que permite a los agentes interactuar, compartir contexto y ejecutar tareas de forma autónoma

.webp)

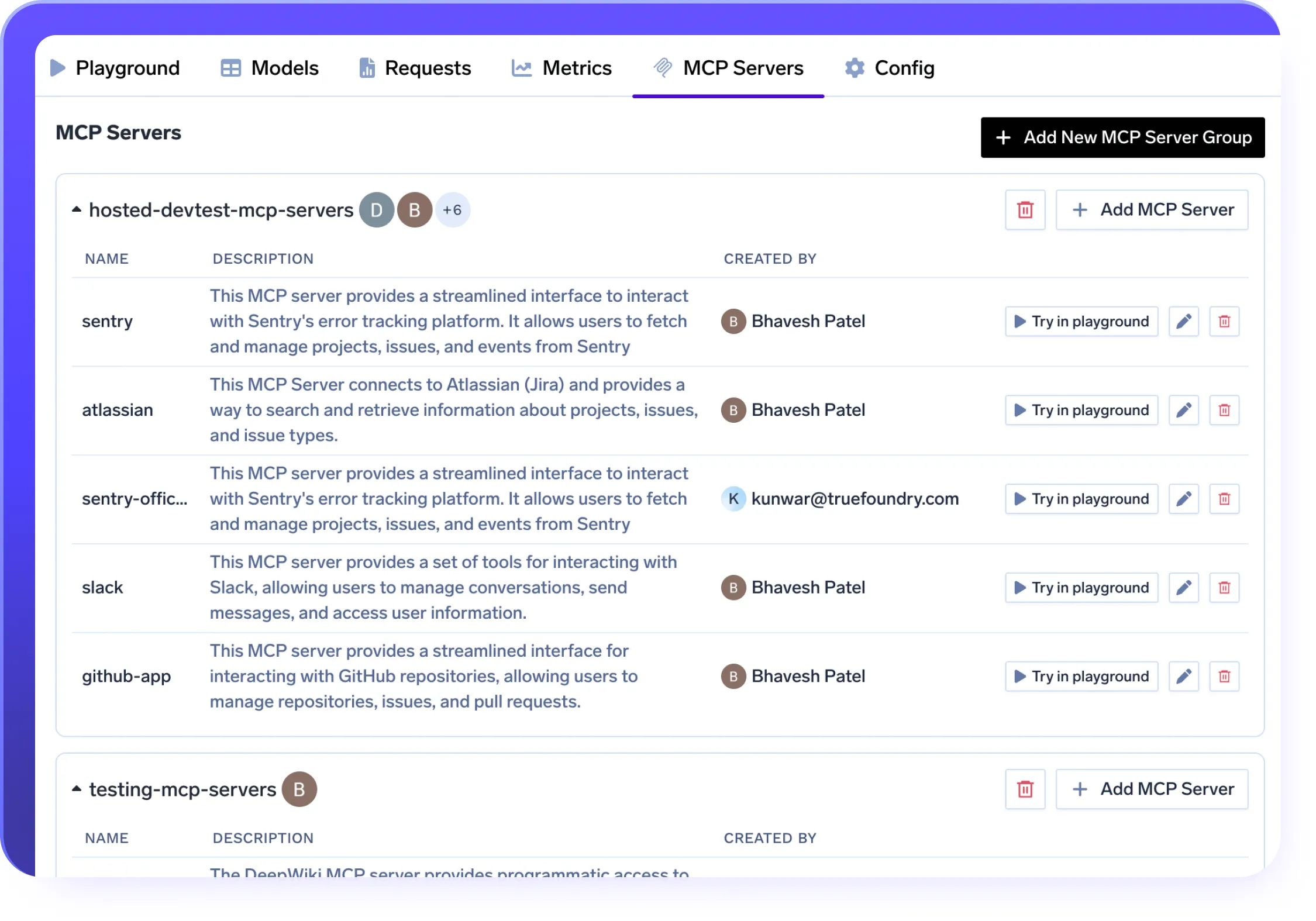

Integración del servidor MCP en su pila de LLMOps

.webp)

- Conecta de forma segura los LLM a herramientas como Slack, GitHub y Confluence mediante el protocolo MCP

- Implemente servidores MCP en configuraciones de VPC, locales o aisladas con un control total de los datos

- Permita el uso inmediato de herramientas nativas sin envoltorios, totalmente integradas en su pila de LLMOP

- Controle el acceso con RBAC y OAuth2 y rastree cada llamada con la observabilidad integrada

Preparado para la empresa

Deploy a secure AI gateway that keeps your data and models within your cloud / on-prem infrastructure.

Cumplimiento y seguridad

Estándares SOC 2, HIPAA y GDPR para garantizar una protección de datos sólidaGobernanza y control de acceso

Control de acceso basado en roles SSO + (RBAC) y registro de auditoríaSoporte y confiabilidad empresariales

Soporte ininterrumpido con respaldo de SLA SLA de respuesta

VPC, local, aislada o en varias nubes.

Ningún dato sale de tu dominio. Disfrute de una soberanía total, aislamiento y cumplimiento de nivel empresarial en cualquier lugar TrueFoundry ejecuta

Preguntas frecuentes

¿Qué es un LLMOP y por qué es importante?

ciclo de vida de los modelos lingüísticos de gran tamaño: desde la formación y el ajuste hasta la implementación, la inferencia,

supervisión y gobernanza. LLMops ayuda a las organizaciones a incorporar las aplicaciones de GenAI a

producción fiable y a escala. TrueFoundry proporciona una plataforma LLMops de nivel de producción

que simplifica y acelera todo este proceso.

¿En qué se diferencian los LLMOP de los MLOP tradicionales?

grandes modelos lingüísticos. Incluye capacidades como la orquestación de servidores modelo y la transmisión rápida

administración, observabilidad a nivel de token, marcos de agentes y acceso seguro a las API.

La plataforma LLMOps de TrueFoundry gestiona estos flujos de trabajo específicos de GenAI de forma nativa, a diferencia de

herramientas genéricas de MLOps.

¿Por qué debería invertir en una plataforma LLMOP dedicada como TrueFoundry?

¿Cuáles son las características principales de la plataforma LLMOps de TrueFoundry?

¿Puedo implementar la plataforma LLMops de TrueFoundry en mi infraestructura?

¿Cómo mejoran los LLMOP la observabilidad y la depuración?

¿La plataforma LLMOps de TrueFoundry es segura y cumple con las normas?

¿Qué modelos y marcos son compatibles con la plataforma LLMops de TrueFoundry?

¿Puedo usar la plataforma LLMOps de TrueFoundry para administrar varios equipos y proyectos?

¿Qué tan rápido puedo empezar a usar TrueFoundry para LLMOP?

GenAI infra: simple, más rápido y más barato

Con la confianza de más de 30 empresas y empresas de Fortune 500