.webp)

Hecho para la IA del mundo real a escala

99,99%

Las conmutaciones por error, el enrutamiento y las barandillas centralizadas garantizan que sus aplicaciones de IA permanezcan en línea, incluso cuando los proveedores de modelos no lo hacen.

MÁS DE 10 MIL MILLONES

Inferencia escalable y de alto rendimiento para la IA de producción.

30%

Los controles inteligentes de enrutamiento, procesamiento por lotes y presupuesto reducen el desperdicio de fichas.

1600+

Connected through one AI gateway.

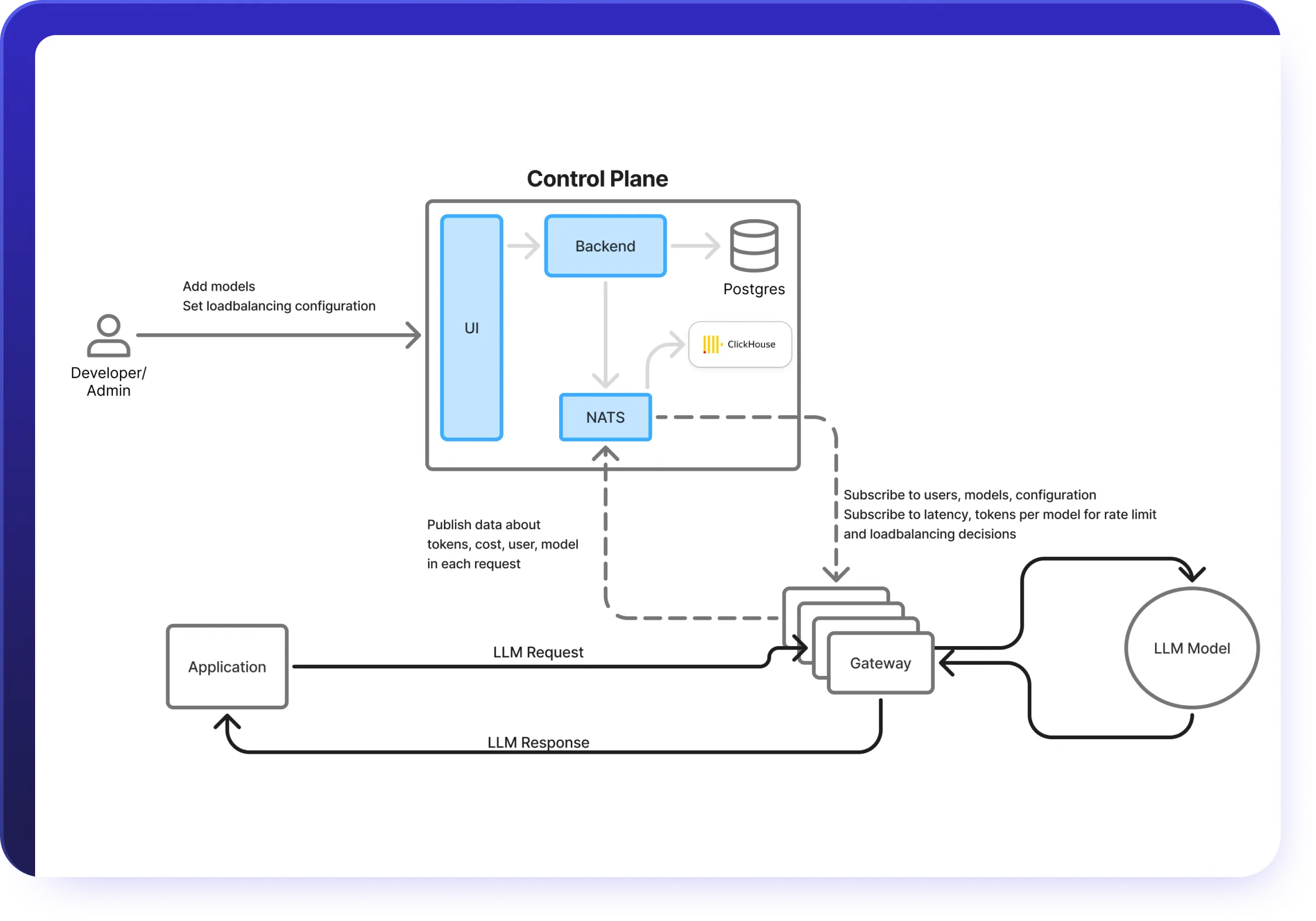

AI Gateway: acceso unificado a la API de LLM

Simplifique su pila de GenAI con una única puerta de enlace de IA que integre todos los modelos principales.

.webp)

- Conéctese a OpenAI, Claude, Gemini, Groq, Mistral y a más de 250 LLM a través de una API AI Gateway

- Usa AI Gateway para admitir tipos de modelos de chat, finalización, incrustación y reclasificación

- Centralice la administración de claves de API y la autenticación de equipos en un solo lugar.

- Organice las cargas de trabajo multimodelo sin problemas a través de su infraestructura.

.webp)

Observabilidad de AI Gateway

Track your AI gateway performance, costs, and ensure compliance across models in real-time.

- Supervise el uso de los tokens, la latencia, las tasas de error y los volúmenes de solicitudes en todo su sistema.

- Almacene e inspeccione los registros completos de solicitudes y respuestas de forma centralizada para garantizar el cumplimiento y simplificar la depuración.

- Etiquete el tráfico con metadatos como el ID de usuario, el equipo o el entorno para obtener información detallada.

- Filtre los registros y las métricas por modelo, equipo o ubicación geográfica para identificar rápidamente las causas fundamentales y acelerar la resolución.

.webp)

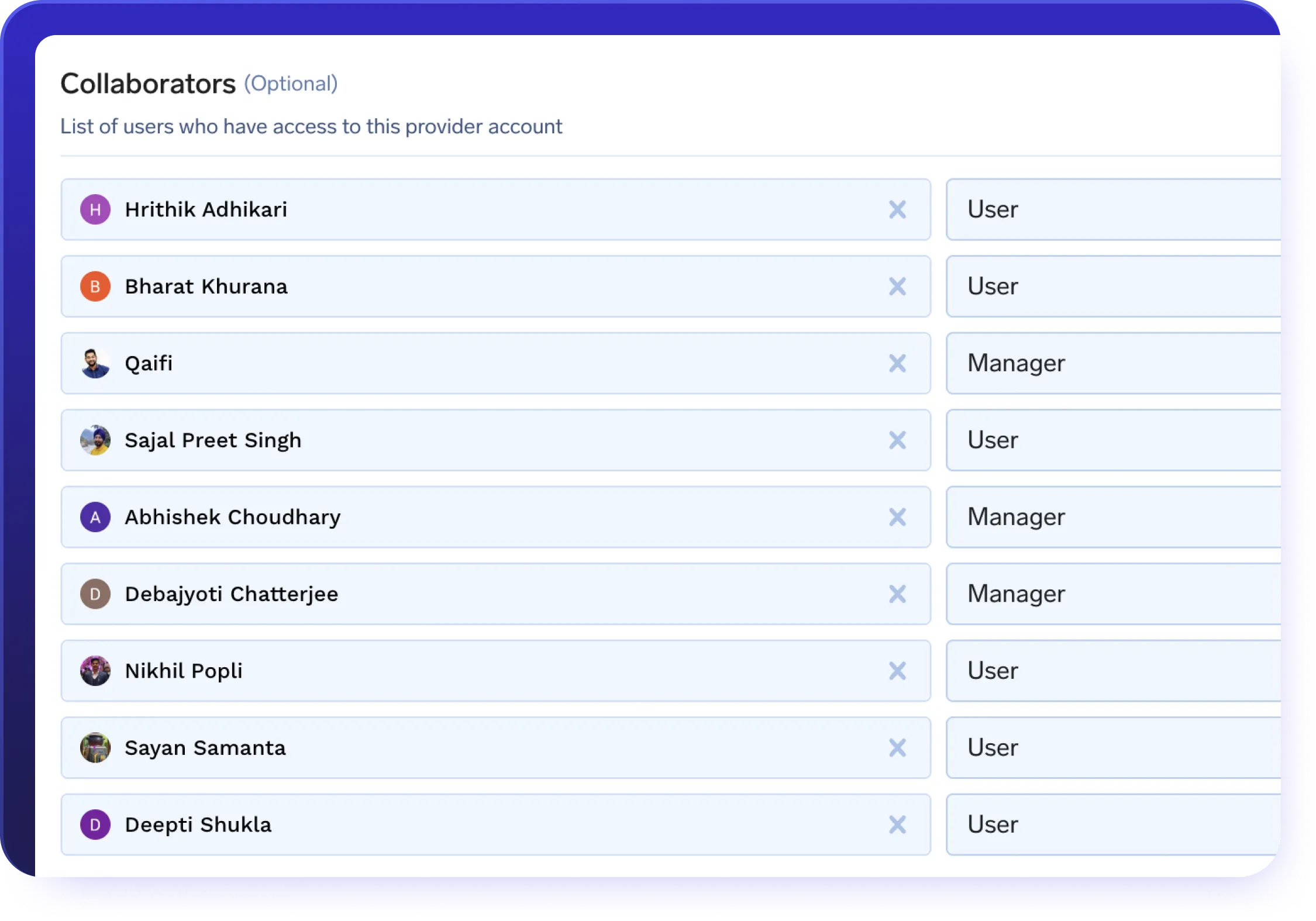

Control de cuotas y acceso mediante AI Gateway

Implemente la gobernanza, controle los costos y reduzca los riesgos con una administración de políticas coherente.

- Aplica límites de tarifas por usuario, servicio o punto final.

- Establezca cuotas basadas en los costos o en los tokens mediante filtros de metadatos.

- Use el control de acceso basado en roles (RBAC) para aislar y administrar el uso.

- Controle las cuentas de servicio y las cargas de trabajo de los agentes a escala mediante reglas centralizadas.

.webp)

Inferencia de baja latencia

Run your most performance-sensitive workloads through a high-speed AI gateway infrastructure.

- Logre una latencia interna inferior a 3 ms incluso con cargas de trabajo a escala empresarial.

- Amplíe sin problemas para gestionar el tráfico en ráfagas y las cargas de trabajo de alto rendimiento.

- Ofrezca tiempos de respuesta predecibles para los asistentes de chat, RAG e IA en tiempo real.

- Coloque las implementaciones cerca de las capas de inferencia para minimizar la latencia y eliminar el retraso de la red.

.webp)

Enrutamiento y retrocesos de AI Gateway

Garantice la confiabilidad, incluso durante las fallas del modelo, con controles de tráfico inteligentes de AI Gateway.

- Soporta el enrutamiento basado en la latencia al LLM más rápido disponible.

- Distribuya el tráfico de manera inteligente mediante el balanceo de cargas ponderado para lograr confiabilidad y escalabilidad.

- Vuelva automáticamente a los modelos secundarios cuando se produce un error en una solicitud.

- Utilice el enrutamiento con reconocimiento geográfico para satisfacer las necesidades regionales de cumplimiento y disponibilidad.

.webp)

.webp)

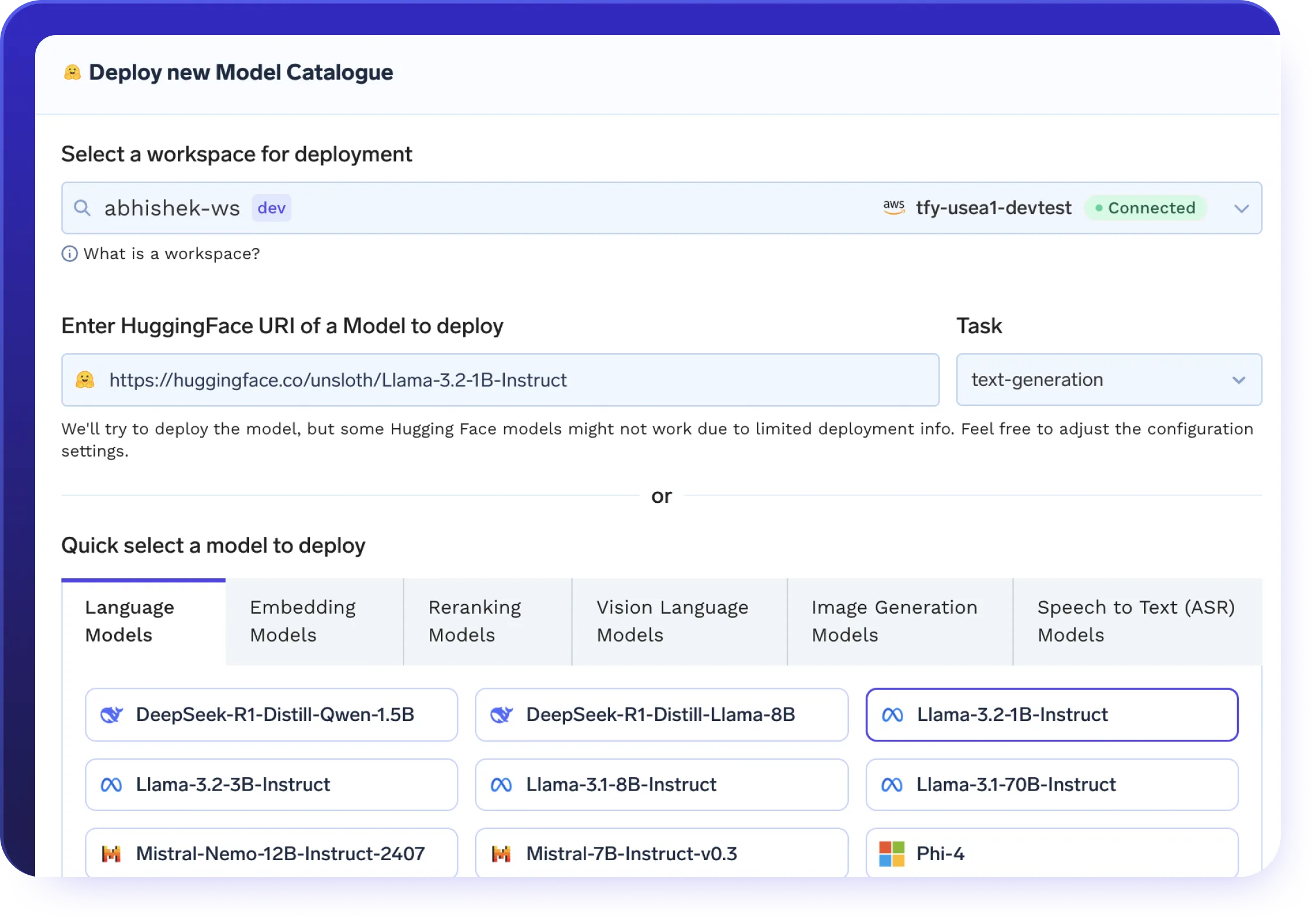

Sirva modelos autohospedados

Exponga los modelos de código abierto con control total.

- Implementa LLama, Mistral, Falcon y más sin cambios en el SDK.

- Compatibilidad total con vLLM, SGLang, KServe y Triton.

- Optimice las operaciones con la administración basada en HELM del escalado automático, la programación de GPU y las implementaciones

- Ejecute sus propios modelos en entornos de VPC, híbridos o aislados.

.webp)

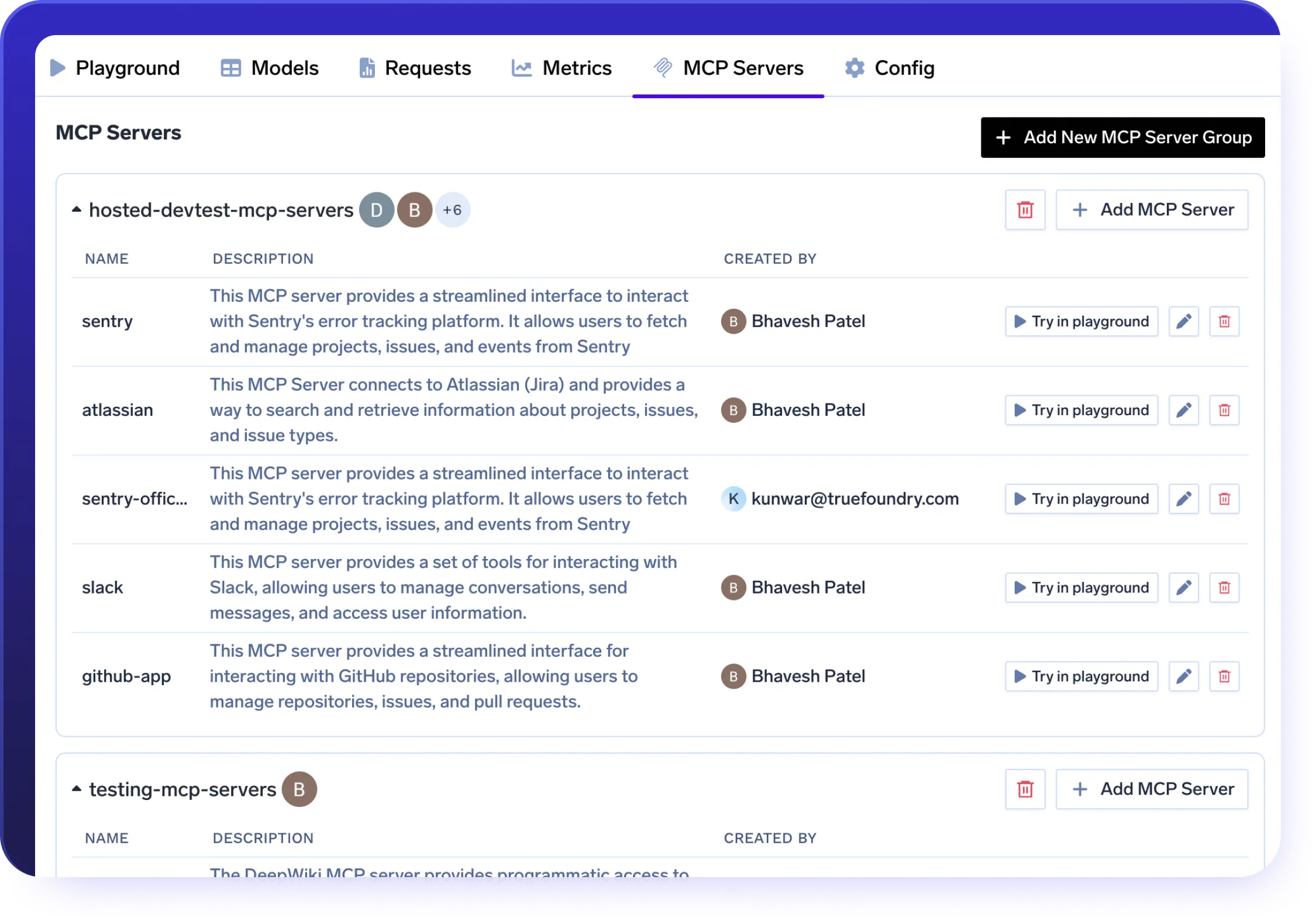

Integración de AI Gateway + MCP

Impulse los flujos de trabajo seguros de los agentes mediante el soporte MCP nativo de AI Gateway.

- Conecta herramientas empresariales como Slack, GitHub, Confluence y Datadog.

- Registre fácilmente los servidores MCP internos con una configuración mínima requerida.

- Aplica políticas de OAuth2, RBAC y metadatos a cada llamada a la herramienta.

.webp)

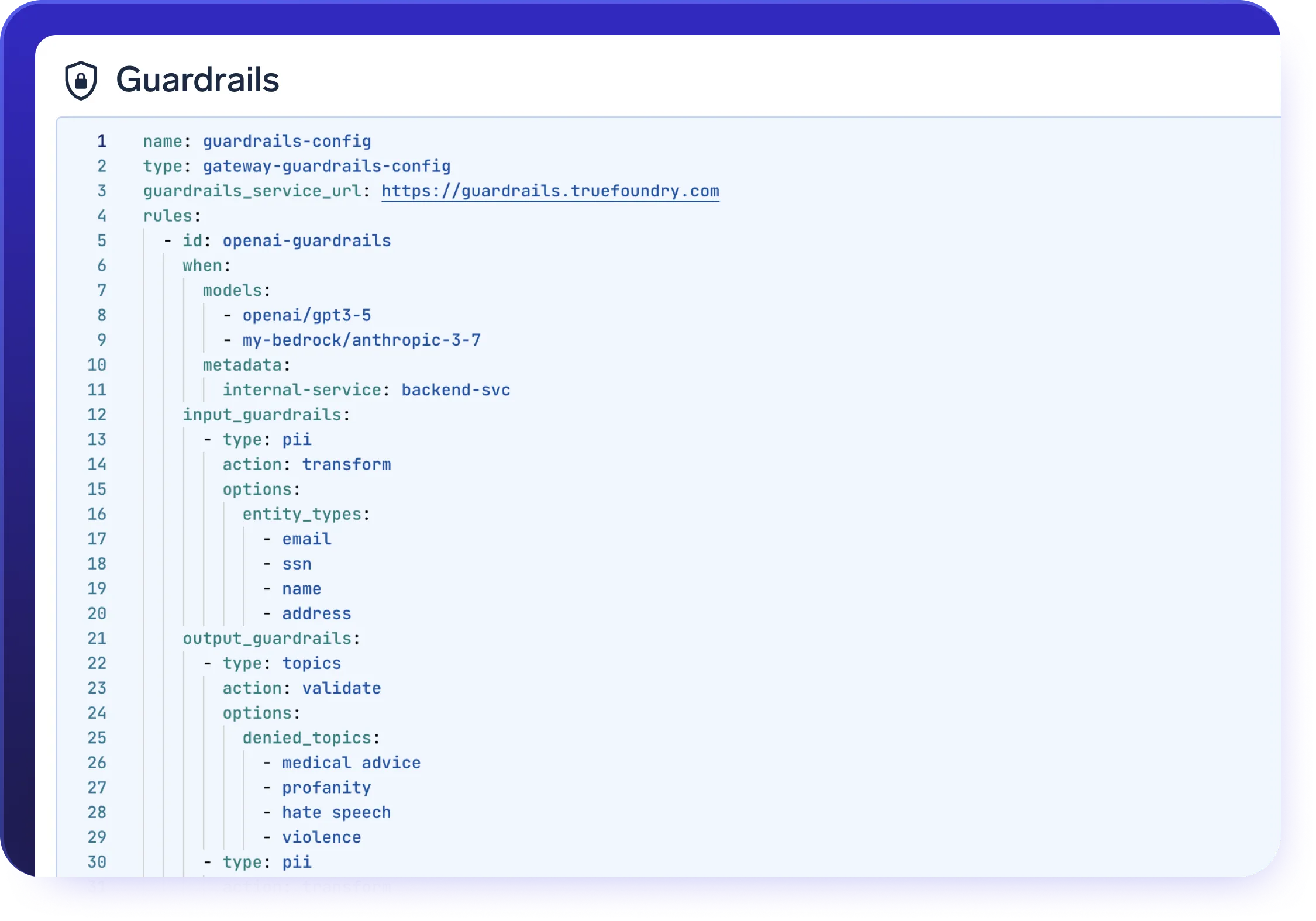

Barandas AI Gateway

Build secure AI applications with configurable AI gateway guardrails and policy controls.

- Implemente sin problemas sus propias barandillas de seguridad, incluido el filtrado de PII y la detección de toxicidad

- Personalice el AI Gateway con barandas adaptadas a sus necesidades de cumplimiento y seguridad

Preparado para la empresa

Deploy a secure AI gateway that keeps your data and models within your cloud / on-prem infrastructure.

Cumplimiento y seguridad

Estándares SOC 2, HIPAA y GDPR para garantizar una protección de datos sólidaGobernanza y control de acceso

Control de acceso basado en roles SSO + (RBAC) y registro de auditoríaSoporte y confiabilidad empresariales

Soporte ininterrumpido con respaldo de SLA SLA de respuesta

VPC, local, aislada o en varias nubes.

Ningún dato sale de tu dominio. Disfrute de total soberanía, aislamiento y cumplimiento de nivel empresarial dondequiera que se ejecute TrueFoundry

Resultados reales en TrueFoundry

Por qué las empresas eligen TrueFoundry

Frequently asked questions

¿Qué es una puerta de enlace de IA?

¿Cómo funciona una puerta de enlace de IA?

¿Cuáles son las ventajas de una pasarela de IA?

¿Cuáles son las capacidades de las pasarelas de IA?

¿Qué puerta de enlace de IA es la mejor?

¿Cuál es la diferencia entre una puerta de enlace de API y una puerta de enlace de IA?

¿Dónde se encuentra una puerta de enlace de IA en la arquitectura GenAI?

¿Se puede usar un AI Gateway con modelos autohospedados y de código abierto?

¿Cómo ayuda una puerta de enlace de IA a controlar y optimizar los costos de inferencia?

¿Cómo ayuda una puerta de enlace de IA a la privacidad y el cumplimiento de los datos?

¿Cómo apoya una puerta de enlace de IA a varios equipos y entornos?

¿Cómo ayuda TrueFoundry AI Gateway Playground a los desarrolladores a crear y probar?

Una vez que esté satisfecho con la configuración, toda la configuración (mensaje, modelo, herramientas, barreras y esquema de salida estructurado) se puede guardar como una plantilla reutilizable en un repositorio compartido. Playground también genera fragmentos de código listos para usar para el cliente de OpenAI, LangChain y otras bibliotecas, mediante la API unificada de AI Gateway, de modo que los equipos pueden realizar un experimento práctico e incorporarlo directamente a sus servicios con el mínimo esfuerzo.

¿Qué significa «acceso unificado» para las API, las claves, las herramientas y los agentes?

Para los desarrolladores, esto significa una integración más sencilla y un modelo de seguridad más limpio: las claves de los proveedores se almacenan una vez en la puerta de enlace, el acceso se controla de forma centralizada mediante políticas y RBAC, y los equipos pueden estandarizar según un patrón de cliente único en todos los idiomas y marcos. A medida que aparecen nuevos modelos o proveedores, se pueden agregar a la puerta de enlace y estar disponibles de inmediato desde la misma interfaz unificada.

¿Cómo funcionan en conjunto la administración rápida, el control de versiones y las aplicaciones de agente?

Cuando una configuración concreta esté lista para compartirse de forma más amplia, se puede publicar como una aplicación de agente. Las aplicaciones de agente funcionan con la tecnología de la puerta de enlace, pero se exponen a través de una interfaz sencilla y bloqueada: los usuarios empresariales o los equipos internos pueden interactuar con el agente exactamente como se ejecutará en producción, mientras que las instrucciones, herramientas y barreras subyacentes permanecen inmutables. Esto hace que las aplicaciones de agente sean ideales para las pruebas de aceptación de los usuarios, las demostraciones con las partes interesadas y los copilotos internos, ya que los equipos de productos y plataformas mantienen el control sobre la configuración y, al mismo tiempo, ofrecen a los demás una forma segura de probar los flujos de trabajo de las agencias.

¿Cómo funcionan las barandillas, los controles de seguridad y los controles de PII de principio a fin?

La puerta de enlace puede conectarse a los servicios de seguridad y cumplimiento existentes, como OpenAI Moderation, AWS Guardrails, Azure Content Safety y Azure PII detection, y también admite reglas personalizadas escritas como código Python o de configuración. Dado que las barreras se configuran de forma centralizada y se aplican de manera uniforme en todos los modelos y aplicaciones que pasan por el AI Gateway, los equipos de seguridad y cumplimiento disponen de una forma predecible de hacer cumplir las políticas organizativas para el uso de GenAI, incluso en entornos regulados como la sanidad, los servicios financieros y los seguros.

¿Qué capacidades de observabilidad, rastreo y depuración ofrece AI Gateway?

Para una depuración más profunda, hay una vista a nivel de solicitud que le permite inspeccionar las llamadas individuales, ver el aviso y la respuesta completos y comprender cómo se aplicaron el enrutamiento, las alternativas y las barreras de protección. En el caso de los flujos de trabajo entre agencias que utilizan herramientas y MCP, la pasarela puede capturar los rastros que muestran cada paso que ha dado un agente, las herramientas a las que ha llamado y el flujo de los resultados intermedios por el sistema. Todos estos registros y métricas también se exponen a través de las API, por lo que los equipos de plataforma y de observabilidad pueden crear alertas y paneles personalizados en sus sistemas de monitoreo existentes.

¿Cómo se configuran y automatizan las políticas, los límites de tarifas, las alternativas y los presupuestos?

Todos estos controles pueden administrarse a través de la interfaz de usuario o declararse en YAML y aplicarse mediante la CLI de TrueFoundry, lo que permite un flujo de trabajo de GitOps en el que la configuración de la puerta de enlace coincide con las definiciones de infraestructura y código de la aplicación. Combinadas con el almacenamiento en caché, el procesamiento por lotes y la administración centralizada de claves de API, estas funciones permiten a los equipos de plataformas tratar el AI Gateway como el único lugar donde definen cómo se debe usar GenAI, cuánto se puede gastar y cómo deben comportarse las aplicaciones en caso de fallo, sin obligar a los equipos de aplicaciones individuales a volver a implementar estas preocupaciones una y otra vez.

GenAI infra: simple, más rápido y más barato

Con la confianza de más de 10 empresas de la lista Fortune 500

.webp)

.webp)

.webp)