Amazon SageMaker AI-Preise: Eine detaillierte Aufschlüsselung und eine bessere Alternative

Auf Geschwindigkeit ausgelegt: ~ 10 ms Latenz, auch unter Last

Unglaublich schnelle Methode zum Erstellen, Verfolgen und Bereitstellen Ihrer Modelle!

- Verarbeitet mehr als 350 RPS auf nur 1 vCPU — kein Tuning erforderlich

- Produktionsbereit mit vollem Unternehmenssupport

Für viele Entwicklungsteams ist Amazon SageMaker der Standardstartpunkt für maschinelles Lernen auf AWS. Es bietet ein umfassendes „Lab-in-a-Box“ -Erlebnis, das die Verwaltung der zugrunde liegenden Server überflüssig macht.

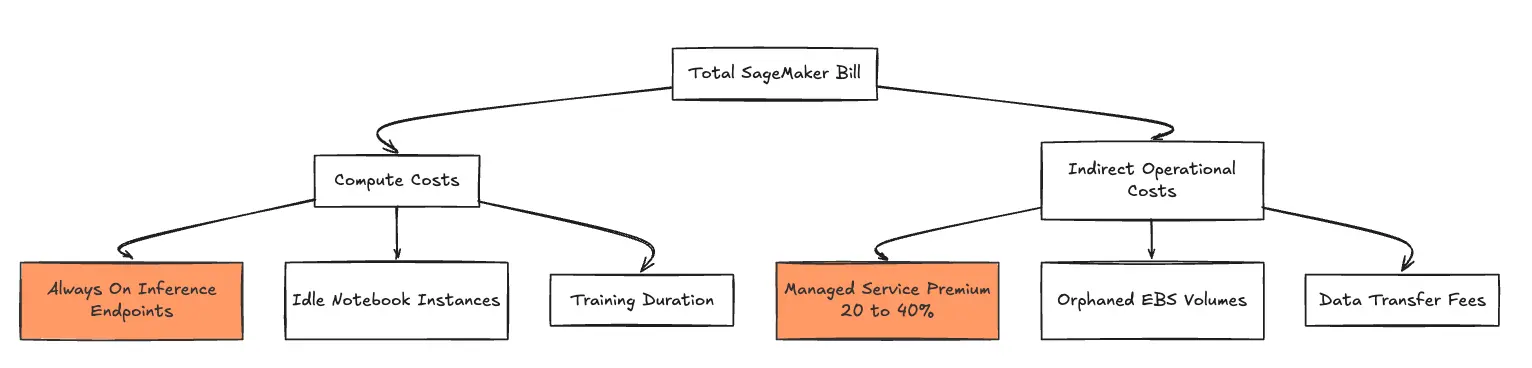

Da die Teams jedoch von experimentellen Notebooks zur vollständigen Modellbereitstellung übergehen, entspricht die monatliche Rechnung nicht der Realität. Der Vorteil von „Managed ML“ ist mit einer Prämie verbunden, die die Margen schleichend schmälern kann.

In diesem Leitfaden werden spezifische Komponenten der SageMaker-Preisgestaltung erörtert, der Preisaufschlag für Recheninstanzen aufgezeigt und erklärt, warum kostenbewusste Unternehmen nach Alternativen suchen.

Das SageMaker-Preismodell: Nach Komponenten berechnet

SageMaker bündelt die Preise nicht in einem einzigen Plan. Stattdessen zahlen Sie für jede Phase des ML-Lebenszyklus separat. Wir erklären Ihnen dann die Kostenaufschlüsselung:

Studio-Notebooks (Entwicklungskosten)

SageMaker Studio-Notebooks werden oft mit leichten Texteditoren verwechselt. In Wirklichkeit werden sie als laufende Recheninstanzen abgerechnet.

- Stündliche Abrechnung: Entwickler zahlen einen Stundensatz für die Instance, die jede Jupyter-Notebook-Sitzung unterstützt.

- Das „Zombie“ -Problem: Diese Instanzen werden häufig über Nacht oder am Wochenende ausgeführt. Ein Entwickler, der am Freitagnachmittag vergisst, ein Notebook herunterzufahren, generiert fakturierbare Stunden für das gesamte Wochenende.

- Versteckter Abfluss: Ohne strenge Auto-Shutdown-Richtlinien werden ungenutzte Entwicklungsumgebungen zu „Zombie-Notebooks“, die im Hintergrund zusammenbrechen SageMaker kostet ohne irgendeinen Mehrwert beizutragen.

Ausbildungsberufe (Modellbaukosten)

Die Schulungskosten werden auf der Grundlage des jeweils verwendeten Instanztyps und der Dauer, für die die Ressourcen aktiv bleiben, berechnet.

- Die Einrichtungszeit ist abrechnungsfähig: Sie zahlen für die gesamte Dauer der Trainingscluster, einschließlich der Zeit, die für das Hochfahren des Clusters und das Laden von Daten aufgewendet wurde, nicht nur für die Zeit, in der die GPU Zahlen verarbeitet.

- Die Größe der Instanz ist wichtig: Größere Instance-Typen (für Deep Learning oder LLMs erforderlich) erhöhen die Stundenkosten drastisch.

- Übertragung von Daten: Wenn umfangreiche Datensätze aus S3 in Trainingsinstanzen abgerufen werden, fallen häufig übersehene Datenübertragungsgebühren an, die als separate Einzelposten erscheinen.

Inferenzendpunkte (Bereitstellungskosten)

Für die meisten Produktionsteams ist Inferenz der „Eisberg“ von Amazon SageMaker-Preise—buchhalterisch 70— 80% der Gesamtrechnung.

- Ständige Abrechnung: Echtzeit-Inferenzendpunkte werden rund um die Uhr in Rechnung gestellt, unabhängig davon, ob jemand das Modell abfragt.

- Skalierung der Kosten: Um den Spitzenverkehr zu bewältigen, stellen Teams häufig zu viele Ressourcen bereit. Da SageMaker Autoscaling konservativ sein kann, zahlen Sie am Ende für ungenutzte Kapazität, nur um die Verfügbarkeit sicherzustellen.

Das „Managed Service Premium“ hinter der Preisgestaltung von SageMaker

Einer der größten Treiber von High Kosten für AWS SageMaker ist das Managed-Service-Markup. Während Sie technisch gesehen Amazon EC2-Instances unter der Haube verwenden, wickelt SageMaker sie in eine Verwaltungsebene ein und berechnet dafür eine Prämie.

Vergleich von „ml“. Instanzen im Vergleich zu Standard-EC2

- SageMaker-Instanzen (mit dem Präfix ml.) kosten in der Regel 20— 40% mehr als die entsprechenden EC2-Rohinstanzen, obwohl sie auf identischer Hardware ausgeführt werden.

- Hier ist ein vereinfachter Überblick darüber, wie das Markup zusammengesetzt ist:

- Hinweis: Bei den Preisen handelt es sich um Schätzungen, die auf On-Demand-Tarifen in den USA Ost (Nord-Virginia) basieren und Änderungen vorbehalten sind.

Wofür du bezahlst

Die Prämie ist nicht willkürlich; AWS erhebt diese Gebühr, weil sie die schwere Arbeit übernehmen:

- Betriebssystem-Patches und Gesundheitschecks.

- Treiberupdates (CUDA usw.).

- Service-Orchestrierung und Endpunktmanagement.

Für kleine Teams ohne Plattformingenieure ist dies ein fairer Handel. Im großen Maßstab verwandelt sich diese Komfortprämie jedoch in eine wiederkehrende Steuer auf die Infrastrukturnutzung, die zu sinkenden Renditen führt.

Andere versteckte Kosten, die Sie möglicherweise zahlen müssen

Abgesehen von den Gesamtrechenraten erhöhen mehrere betriebliche Ineffizienzen das Endergebnis SageMaker-Rechnung. Diese Kosten werden oft erst entdeckt, nachdem die Finanzabteilung eine Budgetüberschreitung gemeldet hat.

Speicheraufwand durch EBS-Volumes

Jedes Notizbuch und jeder Trainingsjob hängt standardmäßig ein Elastic Block Store (EBS) -Volume an, um Daten und Code zu speichern.

- Verwaister Speicher: Wenn eine Notebook-Instance beendet wird, wird das angehängte EBS-Volume nicht immer automatisch gelöscht.

- Stille Akkumulation: Dieses Volumen hält an und führt zu Gebühren für „verwaiste Speicher“, die sich ohne aktive Überwachung im Hintergrund ansammeln.

Einschränkungen bei Endpunkten mit mehreren Modellen

Multi-Model Endpoints (MMEs) versprechen Kosteneinsparungen, da Sie mehrere Modelle auf einem einzigen Container hosten können.

- Die Latenzfalle: In der Praxis führt das Laden von Modellen bei Bedarf in den Speicher zu einer „Kaltstart“ -Latenz.

- Die Umkehrung: Um Probleme mit der Benutzererfahrung zu beheben, greifen Teams häufig auf dedizierte Endgeräte zurück, was wiederum zu hohen, ständig verfügbaren Infrastrukturkosten führt.

Eingeschränkte Spot-Instance-Unterstützung für Inferenz

AWS-Spot-Instances bieten Rabatte von bis zu 90%, aber sie sind riskant, wenn es um Rückschlüsse in SageMaker geht.

- Probleme mit der Zuverlässigkeit: SageMaker fehlen robuste, native Fallback-Mechanismen, um sofort zu On-Demand-Instances zu wechseln, wenn ein Spot-Node zurückgefordert wird.

- Erzwungene Prämie: Um die Zuverlässigkeit zu gewährleisten, sind Teams gezwungen, sich für Produktionsinferenzen auf teure On-Demand-Instances zu verlassen, wodurch enorme Einsparpotenziale verpasst werden.

Warum ist die Preisgestaltung bei SageMaker im großen Maßstab immer schwieriger zu kontrollieren?

Wenn Ihre KI-Akzeptanz zunimmt, SageMaker-Preisgestaltung wird immer schwieriger zu prognostizieren und zu optimieren.

Die Kosten verteilen sich auf Notebooks, Schulungsjobs, Endgeräte, Speicher und Überwachung (CloudWatch). Da die Budgetkontrolle auf AWS-Kontoebene erfolgt, ist es schwierig, bestimmte Kosten einem bestimmten Modell oder Forschungsteam zuzuordnen. Dieser Mangel an Transparenz führt zu ungenutzten Ressourcen und überlasteten Endgeräten, wodurch die monatlichen Ausgaben auf unbestimmte Zeit in die Höhe getrieben werden.

Teams, die erweiterte Funktionen wie SageMaker Ground Truth, SageMaker Clarify oder SageMaker Debugger für die Modellentwicklung verwenden, stellen häufig fest, dass diese die Gesamtkosten noch komplexer machen.

Warum Skalierungsteams ihre Rechenleistung intern abwickeln

Oft gibt es einen klaren Wendepunkt, an dem die verwaltete Prämie von SageMaker nicht mehr tragbar ist.

Wenn die monatlichen KI-Ausgaben die Schwellenwert von 10.000 bis 20.000$, das Markup kann nicht mehr ignoriert werden. In dieser Phase streben Führungskräfte im technischen Bereich in der Regel nach reinen Infrastrukturpreisen ohne den verwalteten Overhead. Fortgeschrittene Teams benötigen eine detaillierte Kontrolle über GPU-Typen, Reserved Instances und Sparpläne — Optimierungen, die innerhalb des SageMaker-Ökosystems oft eingeschränkt oder komplexer sind.

TrueFoundry: Eine bessere Alternative zu SageMaker

Das KI-Gateway von TrueFoundry bietet einen grundlegend anderen Ansatz durch Trennen Orchestrierung von Eigentum an der Infrastruktur.

Anstatt Ihre Rechenleistung mit einem Markup weiterzuverkaufen, orchestriert TrueFoundry Workloads direkt auf Ihren eigenen EKS- (Kubernetes) und EC2-Clustern.

- Kein Markup: Sie zahlen Rohpreise für die AWS-Infrastruktur. TrueFoundry berechnet die Plattform, nicht einen Prozentsatz Ihrer Rechenleistung.

- Automatisierte Einsparungen: Ungenutzte Ressourcen werden mithilfe nutzungsbasierter Richtlinien automatisch heruntergefahren, sodass Zombie-Notebooks ausgeschlossen werden.

- Zuverlässige Punktinferenz: TrueFoundry ermöglicht zuverlässige Inferenzen auf Spot-Instances, indem es einen kleinen On-Demand-Puffer verwaltet und Unterbrechungen ordnungsgemäß behandelt, wodurch die Produktionskosten erheblich gesenkt werden.

Eine parallele technische Bewertung unserer Orchestrierungsebene im Vergleich zum von AWS verwalteten Ökosystem finden Sie in unserer vollständigen Aufschlüsselung von SageMaker gegen TrueFoundry.

Amazon SageMaker und TrueFoundry: Vergleich der Kostenstruktur

Dieser Vergleich konzentriert sich eher auf die Einheitenökonomie als auf die Merkmalsparität.

Wenn Sie eine detaillierte Analyse der realen Ersparnisse und der Wirtschaftlichkeit pro Einheit auf verschiedenen Ausgabenskalen sehen möchten, schauen Sie sich unsere Kostenvergleich mit SageMaker.

Auswahl der richtigen Plattform für langfristige KI-Skalierung

Entscheidungen zur KI-Infrastruktur sollten sich an den langfristigen Kosten- und Betriebszielen orientieren.

Amazon SageMaker ist ideal für:

- Kleine Teams oder einzelne Datenwissenschaftler.

- Schneller Einstieg mit minimalem Einrichtungsaufwand.

- Projekte, bei denen die Geschwindigkeit der Bereitstellung die Infrastrukturkosten überwiegt.

Wahre Gießerei ist ideal für:

- Skalierung von KI-Anwendungen, die vorhersehbare Kosten erfordern.

- Teams geben über 10.000$ pro Monat für Cloud-Computing aus.

- Unternehmen, die Infrastrukturflexibilität benötigen und Prämien für verwaltete Dienste vermeiden möchten.

Wenn Sie sich jedoch immer noch zwischen verschiedenen AWS-nativen Diensten für Ihren speziellen Anwendungsfall entscheiden, finden Sie in unserem Leitfaden zu AWS Bedrock im Vergleich zu AWS SageMaker untersucht die wichtigsten Unterschiede in Bezug auf Flexibilität und Verwaltung, die Sie berücksichtigen sollten.

Bereit, den Aufschlag nicht mehr zu zahlen?

SageMaker eignet sich hervorragend für frühe Experimente, aber langfristiger KI-Erfolg erfordert Kostendisziplin. Wenn Ihre Cloud-Rechnung schneller wächst als die Leistung Ihres Modells, ist es an der Zeit, Ihre Infrastrukturstrategie zu überdenken.

Wenn Sie bereit sind, die hohen Aufschläge von Managed Services hinter sich zu lassen und genau wissen möchten, wie viel Ihr Unternehmen bei der Infrastruktur sparen kann, eine Demo buchen mit TrueFoundry noch heute, um Ihre potenziellen Einsparungen zu berechnen.

Häufig gestellte Fragen

Wie viel kostet SageMaker?

Die SageMaker-Preise variieren je nach Region und Nutzung. Sie zahlen separat für Recheninstanzen (pro Stunde), Speicher (GB/Monat) und Datenübertragung. Die Instance-Preise reichen von ein paar Cent pro Stunde für Basis-CPUs bis zu über 28 USD/Stunde für fortgeschrittene GPU-Instances.

Wie können die SageMaker-Kosten gesenkt werden?

Um zu reduzieren Kosten für AWS SageMaker, stellen Sie sicher, dass Sie inaktive Notebook-Instances herunterfahren, Spot-Instances für Trainingsaufgaben verwenden, die richtige Größe Ihrer Inferenzendpunkte festlegen und nicht angehängte EBS-Volumes löschen. Alternativ kann durch die Umstellung auf eine Orchestrierungsplattform wie TrueFoundry das Markup für verwaltete Dienste vollständig entfallen.

Ist SageMaker auf AWS kostenlos?

SageMaker bietet für die ersten zwei Monate ein kostenloses Kontingent an, das begrenzte Stunden für die Nutzung von Notebooks, Schulungen und Inferenzen zu kleinen Instance-Typen beinhaltet. Sobald diese Grenzwerte überschritten werden, gelten die Standardpreise.

Inwiefern ist TrueFoundry kostengünstiger als Amazon SageMaker?

TrueFoundry ist kostengünstiger, da es Ihnen ermöglicht, Workloads auf Ihrem eigenen Cloud-Konto mithilfe von Standard-EC2-Instances auszuführen und so die SageMaker-Aufschläge von 20-40% zu vermeiden. Es bietet auch automatisierte Funktionen zum Herunterfahren ungenutzter Ressourcen und zur zuverlässigen Verwendung von Spot-Instances für Inferenzen.

TrueFoundry AI Gateway bietet eine Latenz von ~3—4 ms, verarbeitet mehr als 350 RPS auf einer vCPU, skaliert problemlos horizontal und ist produktionsbereit, während LiteLM unter einer hohen Latenz leidet, mit moderaten RPS zu kämpfen hat, keine integrierte Skalierung hat und sich am besten für leichte Workloads oder Prototyp-Workloads eignet.

Der schnellste Weg, deine KI zu entwickeln, zu steuern und zu skalieren

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)