25 meilleurs outils MLOps de 2026

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Alors que l'adoption de l'apprentissage automatique continue de s'accélérer dans tous les secteurs, le besoin de pipelines de machine learning robustes, évolutifs et automatisés n'a jamais été aussi grand. En 2026, les plateformes MLOps sont devenues essentielles à l'opérationnalisation de l'IA, de la formation et du déploiement des modèles à la surveillance et à la gouvernance.

Ces plateformes rationalisent le cycle de vie de bout en bout, aidant les équipes à gérer la complexité, à garantir la reproductibilité et à accélérer le retour sur investissement. Que vous soyez une start-up qui développe son premier modèle ou une entreprise qui en déploie des centaines, il est essentiel de choisir la bonne plateforme MLOps.

Dans ce guide, nous explorons ce qu'est le MLOps, pourquoi c'est important et les meilleurs outils MLOps qui façonneront le paysage en 2026.

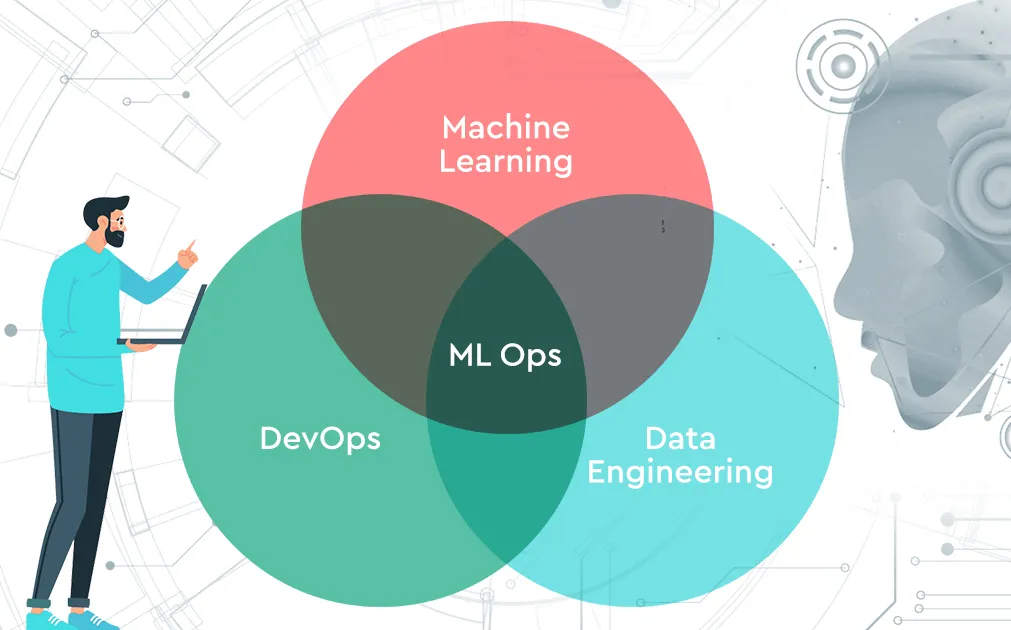

Qu'est-ce que MLOps ?

Le MLOps (Machine Learning Operations) est une discipline qui fusionne les principes de apprentissage automatique, DevOps et ingénierie des données pour permettre le développement, le déploiement, la surveillance et la maintenance de systèmes ML fiables à grande échelle. Il garantit que les modèles construits dans des environnements expérimentaux peuvent être transférés en toute sécurité et efficacement vers la production, où ils doivent fonctionner de manière constante, s'adapter aux changements et rester responsables.

Les flux de travail DevOps traditionnels se concentrent sur le contrôle des versions, les pipelines CI/CD, les tests automatisés et la fiabilité du système. MLOps en hérite, mais les étend pour relever les défis uniques de l'apprentissage automatique : gérer des données en constante évolution, réentraîner les modèles pour tenir compte de la dérive, évaluer des résultats non déterministes et maintenir la reproductibilité entre les itérations du modèle.

Pourquoi avez-vous besoin d'outils MLOps ?

Alors que l'apprentissage automatique passe de l'expérimentation au déploiement à l'échelle de l'entreprise. Les outils MLOps sont devenus essentiels pour garantir la cohérence, la fiabilité et la rapidité tout au long du cycle de vie des modèles. Sans solution MLOps centralisée, les équipes se retrouvent souvent avec des outils fragmentés, des processus manuels et des flux de travail incohérents qui ralentissent l'innovation et introduisent des risques opérationnels.

Plateformes MLOps résolvez ces défis en fournissant une interface unifiée pour gérer les pipelines de données, les flux de formation, le suivi des modèles, le déploiement et la surveillance, le tout en un seul endroit. Cette consolidation permet une collaboration plus étroite entre les data scientists, les ingénieurs ML et les équipes DevOps, réduisant ainsi les tensions liées au transfert et améliorant la reproductibilité entre les environnements.

Comment choisir les meilleures plateformes MLOps ?

Lors de la sélection des outils MLOps en 2026, il est important d'évaluer non seulement les fonctionnalités, mais aussi la capacité de la plateforme à prendre en charge votre flux de travail de machine learning, à s'adapter à votre infrastructure et à s'aligner sur les objectifs opérationnels de votre équipe. Voici quelques critères essentiels à prendre en compte :

Support du cycle de vie complet

Une plateforme MLOps idéale devrait couvrir l'intégralité du cycle de vie de l'apprentissage automatique, depuis la gestion des versions des données et la formation jusqu'au déploiement et à la surveillance. La fragmentation des chaînes d'outils peut créer des inefficacités et des incohérences entre les équipes. Les plateformes qui unifient ces étapes en un seul flux de travail contribuent à améliorer la reproductibilité, à réduire les transferts et à accélérer les itérations.

Évolutivité et flexibilité de l'infrastructure

À mesure que les charges de travail de machine learning évoluent, la plateforme doit également évoluer. Une bonne solution MLOps doit prendre en charge tous les aspects, de l'expérimentation locale à la formation distribuée sur plusieurs GPU ou nœuds. Il doit également offrir une flexibilité de déploiement, en prenant en charge les environnements cloud natifs, sur site et hybrides sans vous enfermer dans une pile spécifique.

Facilité d'utilisation et expérience pour les développeurs

L'utilisabilité est souvent négligée mais essentielle. Une plate-forme robuste offre des interfaces propres, à la fois une interface utilisateur et une interface de ligne de commande, ainsi que des SDK complets qui s'intègrent à des frameworks populaires tels que PyTorch, TensorFlow et Hugging Face. Une plateforme intuitive pour les data scientists et les ingénieurs ML favorise une meilleure collaboration et une intégration plus rapide.

Écosystème d'intégration

Le MLOps n'existe pas isolément. Votre plateforme doit s'intégrer parfaitement aux systèmes de stockage existants (tels que S3 ou GCS), aux outils CI/CD (tels que GitHub Actions ou Jenkins), aux plateformes d'observabilité (comme Prometheus ou Grafana) et aux registres de modèles. Une intégration solide garantit un flux fluide des données et des modèles dans votre pipeline.

Gouvernance, sécurité et conformité

Pour les organisations travaillant dans des environnements réglementés, les fonctionnalités de gouvernance sont indispensables. La plateforme doit prendre en charge le contrôle d'accès basé sur les rôles (RBAC), les journaux d'audit et le suivi du lignage. La conformité à des normes telles que SOC 2, HIPAA ou GDPR permet de garantir la confidentialité des données, la confiance et la viabilité à long terme dans les environnements d'entreprise.

Quels sont les meilleurs outils MLOps de 2026 ?

Le paysage MLOps en 2026 est riche en plateformes répondant à différents besoins, du suivi d'expériences légères au déploiement et à la surveillance de modèles de niveau entreprise. Vous trouverez ci-dessous les 25 meilleurs outils MLOps qui aident les équipes à rationaliser leurs flux de travail de machine learning, à optimiser l'infrastructure et à opérationnaliser les modèles à grande échelle. Chaque plateforme a ses points forts en fonction de votre infrastructure technologique, de la maturité de votre équipe et de vos objectifs commerciaux.

1. True Foundry

TrueFoundry est un plateforme MLOps et LLMops moderne conçu pour les équipes qui souhaitent déployer, faire évoluer et surveiller des modèles d'apprentissage automatique et d'IA générative en production. Il élimine la complexité de l'infrastructure tout en offrant un contrôle total, permettant aux équipes de passer de l'expérimentation au déploiement en quelques minutes.

Contrairement aux systèmes existants, TrueFoundry est optimisé pour les performances, la productivité des développeurs et les flux de travail centrés sur GENAI, y compris la prise en charge des agents, des pipelines RAG et un suivi avancé. Sa sécurité de niveau professionnel et sa conception modulaire en font l'un des meilleurs outils MLOps, adapté aux organisations de toutes tailles.

Caractéristiques principales :

- Modèle de production compatible avec vLLM, SGlang et mise à l'échelle automatique pour une inférence à haut débit et à faible latence.

- Réglage, traçage et orchestration RAG intégrés, y compris LoRA/Qlora, les bases de données vectorielles, la gestion rapide et les frameworks d'agents tels que LangChain et CrewAI.

- Préparation de l'entreprise avec SOC 2, HIPAA, conformité au RGPD, passerelle API unifiée, contrôle d'accès basé sur les rôles et journaux d'audit.

Idéal pour :

Des équipes pilotées par l'IA qui développent des produits soutenus par LLM, en particulier lorsque les performances, la sécurité et l'observabilité sont essentielles. Idéal pour les équipes en évolution rapide ou les entreprises qui ont besoin d'un déploiement GenAI évolutif. Voici certains des meilleurs outils de passerelle LLM.

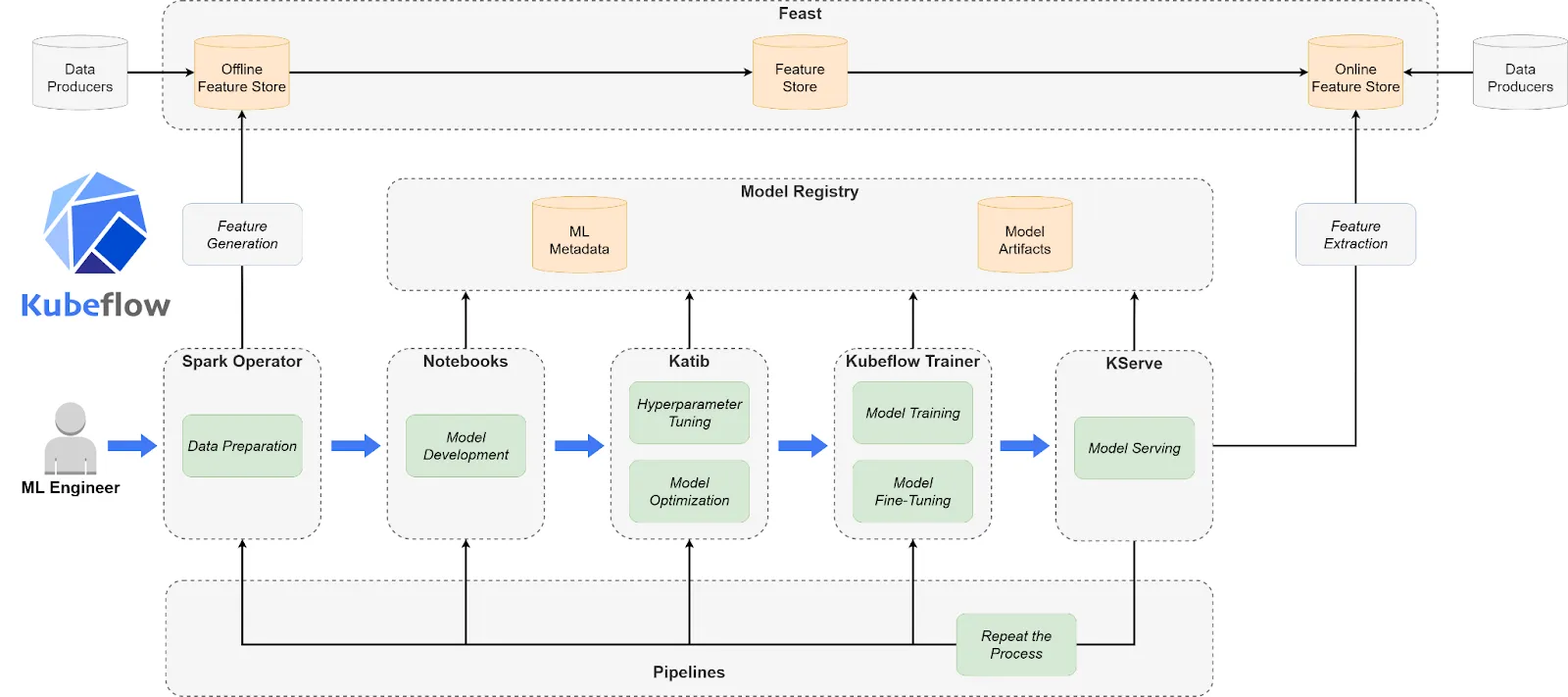

2. Kubeflow

Kubeflow est un outil open source natif de Kubernetes et l'un des meilleurs outils MLOps pour créer et gérer des flux de travail ML portables et composables. Il offre la flexibilité nécessaire pour orchestrer la formation, le réglage et le service à l'aide d'abstractions Kubernetes familières. Bien que puissant, Kubeflow nécessite une connaissance approfondie de l'infrastructure et n'est pas idéal pour les équipes qui ne disposent pas d'un support DevOps dédié. Il brille lorsque des pipelines de machine learning personnalisés, évolutifs et sécurisés sont nécessaires.

Caractéristiques principales :

- Modulaire, indépendant du cloud Canalisations ML basé sur Kubeflow Pipelines avec orchestration DAG, prise en charge des ordinateurs portables et flux de travail en plusieurs étapes.

- Intégration native de Kubernetes pour la gestion des ressources de calcul, la mise à l'échelle des tâches et le déploiement de modèles à l'aide de KFServing.

- Environnements multi-utilisateurs sécurisés avec isolation des espaces de noms, RBAC et compatibilité entre AWS, GCP, Azure et les clusters sur site.

Idéal pour :

Des équipes possédant une solide expertise de Kubernetes qui cherchent à personnaliser et à contrôler entièrement leurs flux de travail MLOps, en particulier dans les environnements de cloud réglementés ou hybrides.

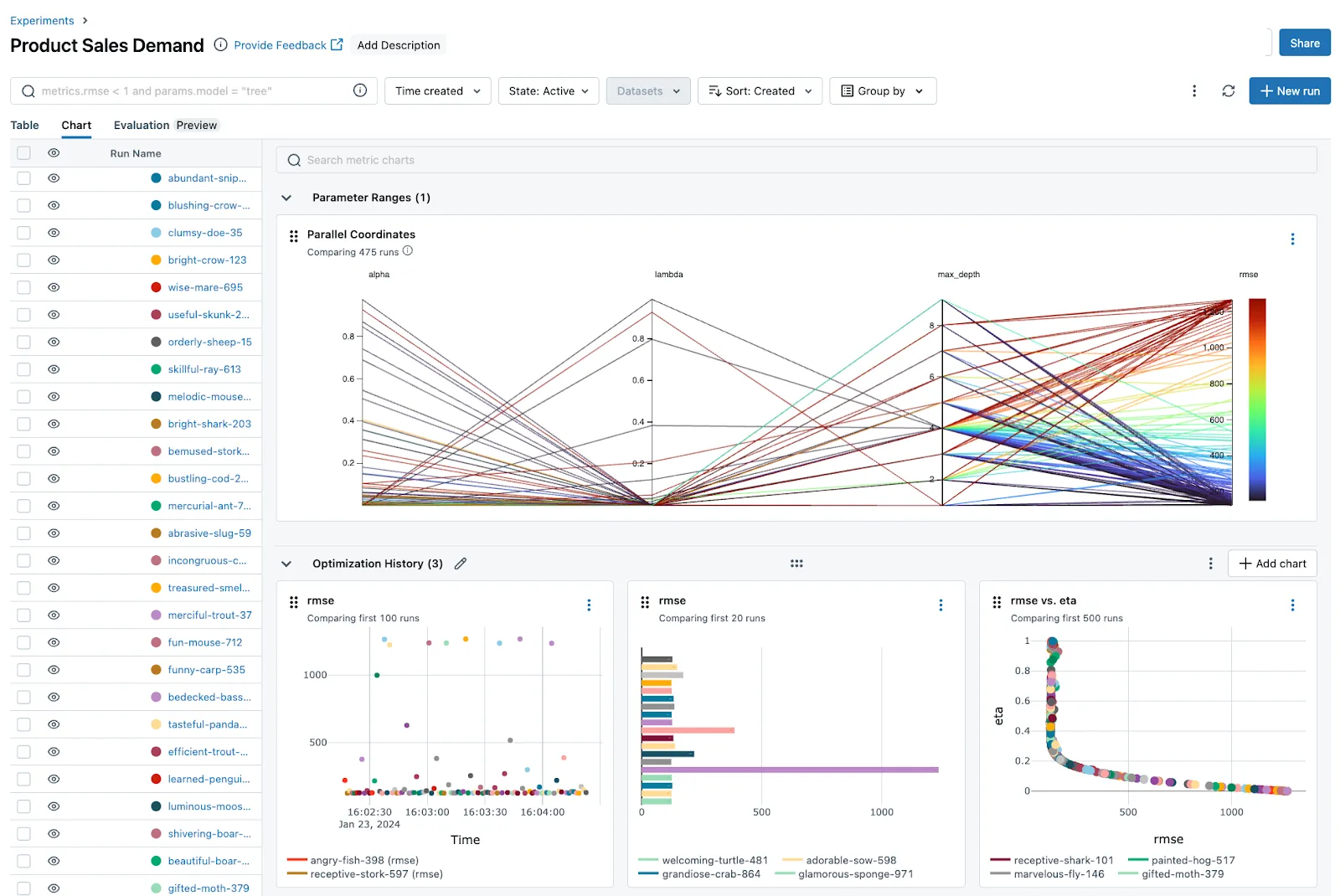

3. Débit ML

MLflow est une plateforme MLOps légère et open source créée par Databricks, axée sur la gestion de l'expérimentation ML et de la gestion des versions de modèles. Ses composants modulaires permettent aux équipes d'intégrer le suivi, l'enregistrement et le déploiement à leurs flux de travail existants.

Cet outil MLOps est idéal pour les petites équipes ou les organisations qui recherchent de la flexibilité sans les frais liés à une infrastructure complète ou à Kubernetes.

Caractéristiques principales :

- Suivi des expériences et registre de modèles avec enregistrement transparent des paramètres, des métriques et des artefacts au fil des essais.

- Indépendant du framework et extensible, prenant en charge TensorFlow, PyTorch, Scikit-learn et les flux de travail ML personnalisés avec intégration REST et CLI.

- Prêt pour le déploiement avec prise en charge de Docker, des environnements cloud et des outils de service personnalisés pour l'intégration en production.

Idéal pour :

Les équipes de machine learning recherchent des outils légers et personnalisables pour suivre les expériences, partager des modèles et gérer les versions sans recourir à une plate-forme à grande échelle.

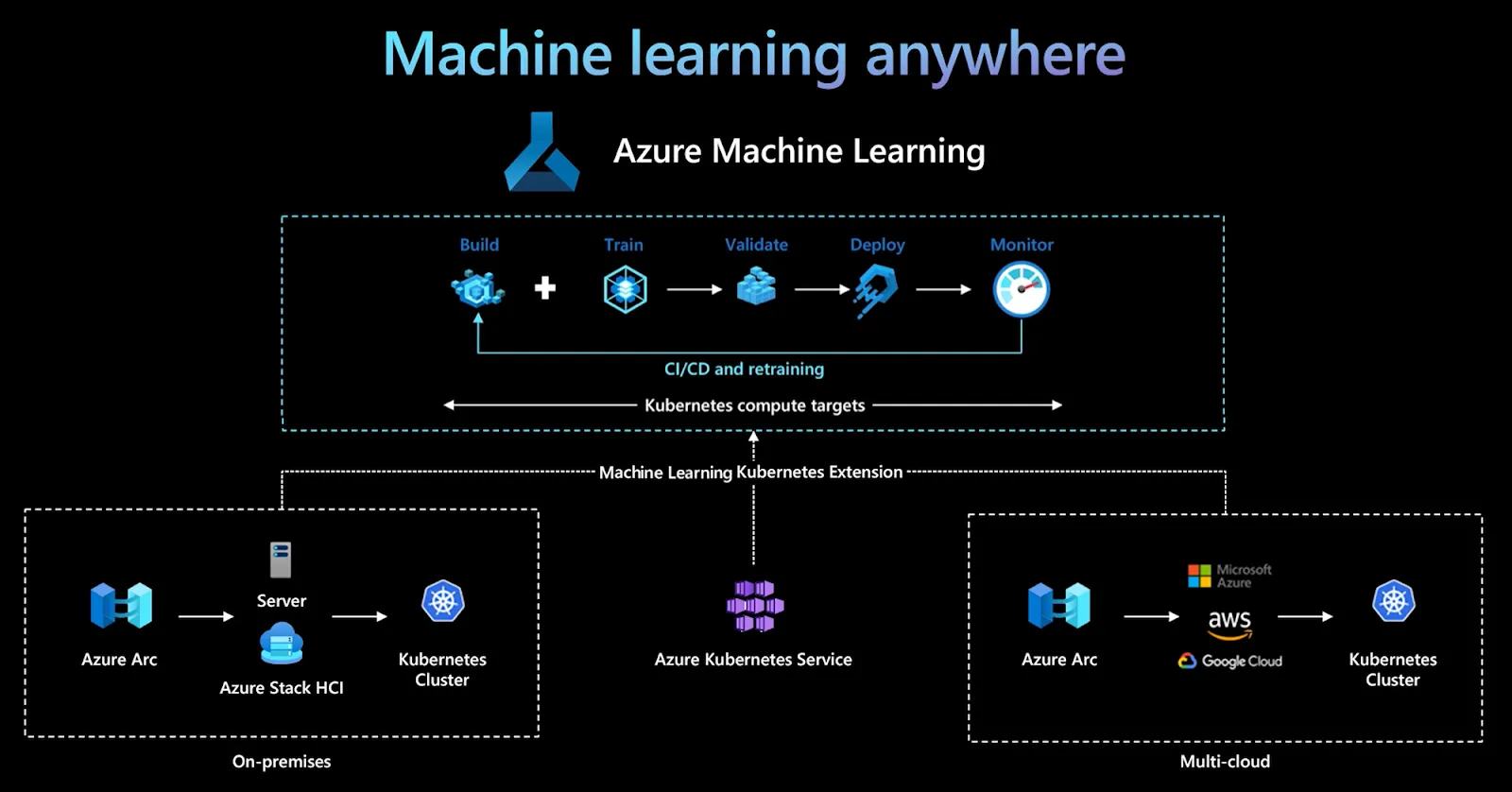

4. Apprentissage automatique Azure

Azure Machine Learning est la plateforme MLOps entièrement gérée de Microsoft, conçue pour créer, former, déployer et surveiller des modèles d'apprentissage automatique à l'échelle de l'entreprise. Il s'intègre étroitement à l'écosystème Azure et propose une puissante suite d'outils pour la gestion des modèles, l'AutoML et l'IA responsable. Azure ML est idéal pour les entreprises qui ont déjà investi dans le cloud de Microsoft et qui recherchent la sécurité, l'évolutivité et la conformité.

Caractéristiques principales :

- Prise en charge du cycle de vie du machine learning de bout en bout, y compris l'étiquetage des données, la formation automatisée, le réglage des hyperparamètres, le registre des modèles et les pipelines de déploiement.

- Intégration approfondie à Azure, permettant une utilisation fluide d'Azure Blob Storage, d'Azure DevOps, d'Azure Kubernetes Service (AKS) et d'Azure Synapse.

- Fonctionnalités de gouvernance et de conformité intégrées, telles que le suivi du lignage, l'accès basé sur les rôles, l'explicabilité des modèles et la prise en charge d'une IA responsable.

Idéal pour :

Entreprises opérant sur Microsoft Azure ont besoin d'une plateforme MLOps hautement sécurisée, évolutive et entièrement intégrée intégrant la conformité de l'entreprise.

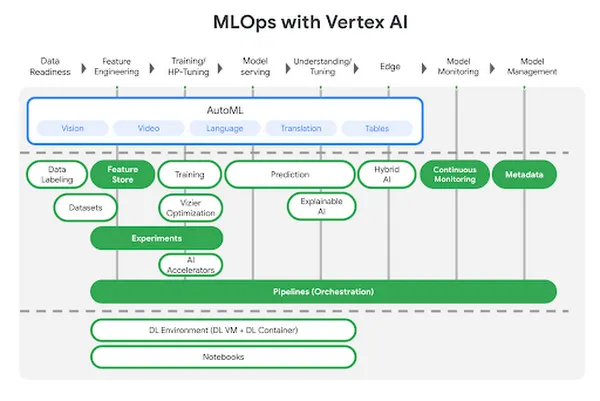

5. Google Vertex AI

Vertex AI est la plateforme unifiée de Google Cloud pour le développement de machine learning, combinant AutoML et la formation de modèles personnalisés sous une seule interface. Il fait abstraction de l'infrastructure tout en proposant des services avancés tels que des magasins de fonctionnalités, des pipelines et le suivi des expériences.

Conçu pour être évolutif et intégré à l'écosystème de Google, cet outil MLOps est optimisé pour le déploiement du machine learning au niveau de la production et les flux de travail pilotés par les données.

Caractéristiques principales :

- Plateforme mLOps unifiée combinant AutoML, une formation personnalisée, des blocs-notes gérés, des pipelines et des magasins de fonctionnalités en un seul endroit.

- Intégration native de l'écosystème GCP, notamment BigQuery, Dataflow et Kubernetes Engine pour l'orchestration des données et des calculs.

- Surveillance intégrée des modèles avec prise en charge de la détection et de l'explicabilité des dérives et Vertex AI Model Registry pour la gestion du cycle de vie.

Idéal pour :

Les équipes qui développent et font évoluer l'apprentissage automatique sur Google Cloud et qui souhaitent une plateforme MLOps gérée et évolutive avec une intégration complète des données et des déploiements.

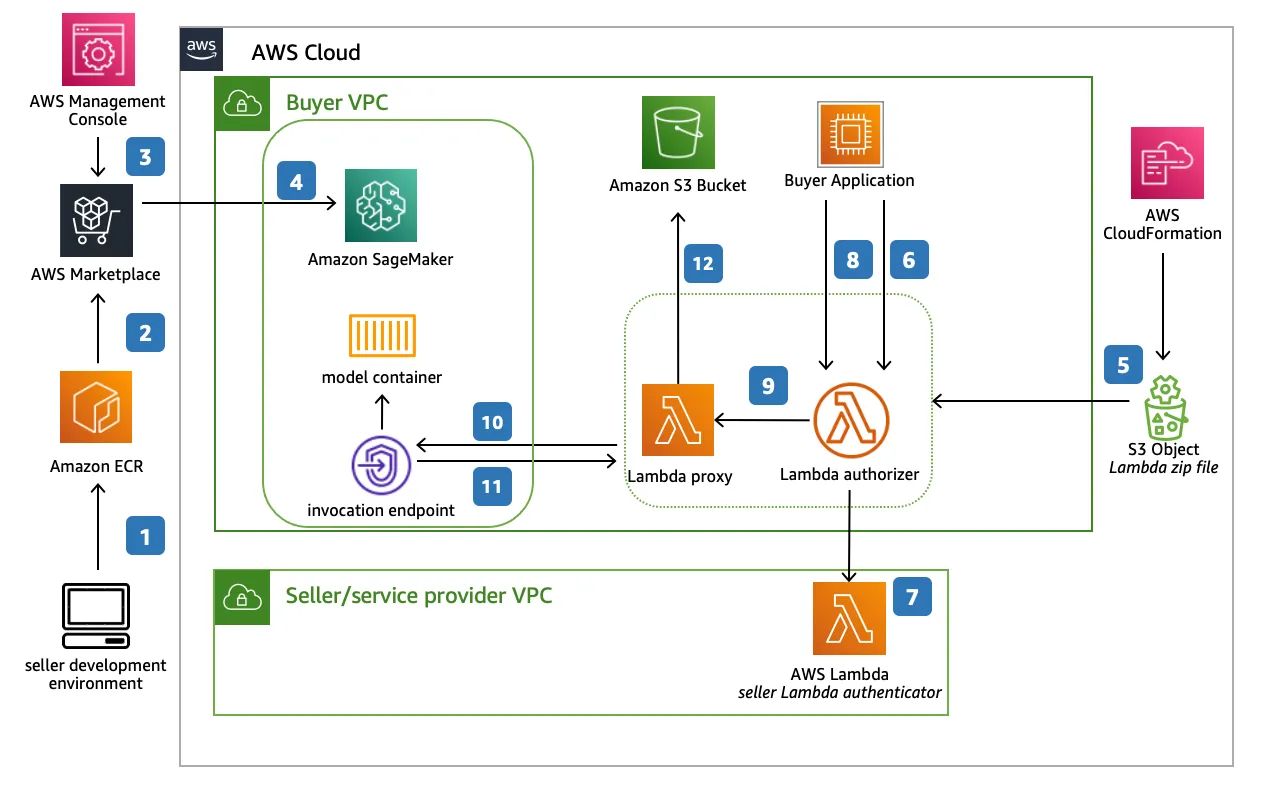

6. Amazon SageMaker

Amazon SageMaker est la plateforme MLOps phare d'AWS, qui propose tout, du prétraitement des données au déploiement de modèles en temps réel. Connu pour ses nombreuses fonctionnalités, SageMaker prend en charge le développement de modèles personnalisés, AutoML, l'hébergement de modèles et des outils de surveillance avancés. Il est étroitement intégré à l'écosystème AWS, ce qui en fait un choix incontournable pour les entreprises natives du cloud.

Caractéristiques principales :

- Services de machine learning complets, notamment des tâches de formation, des expériences, des pipelines, AutoML (SageMaker Autopilot) et un registre de modèles.

- Intégration étroite avec AWS, tirant parti de S3, Lambda, CloudWatch et IAM pour l'accès aux données, la sécurité et l'automatisation.

- Outils de production avancés tels que la surveillance des modèles, le débogueur, les déploiements fictifs et les terminaux multimodèles.

Idéal pour :

Les organisations qui utilisent déjà AWS pour leur infrastructure et qui ont besoin d'une plateforme MLOps robuste et évolutive, dotée d'une intégration approfondie et d'une prise en charge complète du cycle de vie.

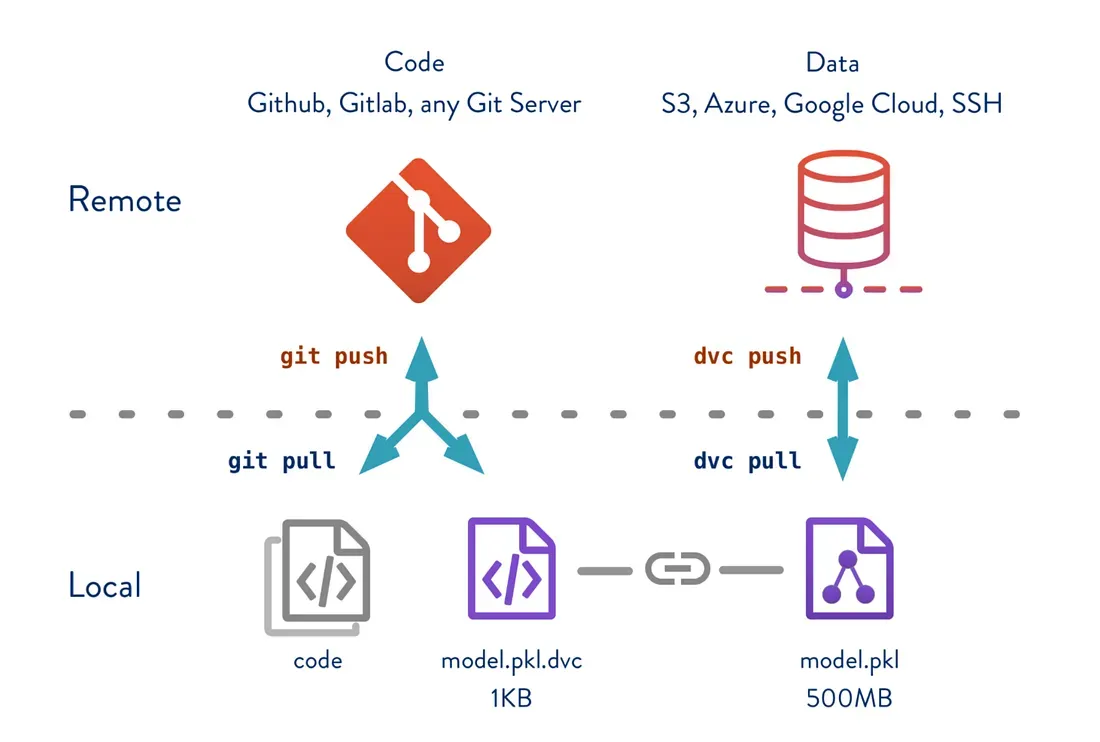

7. DVC (contrôle de version des données)

DVC est un outil open source qui apporte le contrôle de version aux projets d'apprentissage automatique en suivant les ensembles de données, les modèles et les expériences, de la même manière que Git gère le code. Il ne vise pas à être une plate-forme MLOps complète, mais se concentre plutôt sur la reproductibilité, la collaboration et le suivi des modèles via des flux de travail compatibles avec les GIT. DVC s'intègre parfaitement aux pipelines existants et permet aux praticiens du ML de mieux contrôler la gestion des expériences.

Caractéristiques principales :

- Versionnage des données et des modèles à l'aide de commandes de style GIT, permettant des pipelines reproductibles et des points de contrôle cohérents entre les équipes.

- Suivi et comparaison des expériences avec prise en charge des métriques, des paramètres et de la visualisation des résultats, localement ou via DVC Studio.

- Intégration du stockage à distance pour les ensembles de données et les artefacts dans les annuaires S3, GCS, Azure, SSH et locaux.

Idéal pour :

Les équipes à la recherche de fonctionnalités MLOps légères et centrées sur le code, centrées sur la reproductibilité, les flux de travail basés sur GIT et la gestion des expériences, en particulier dans le cadre de projets de recherche et de machine learning itératif.

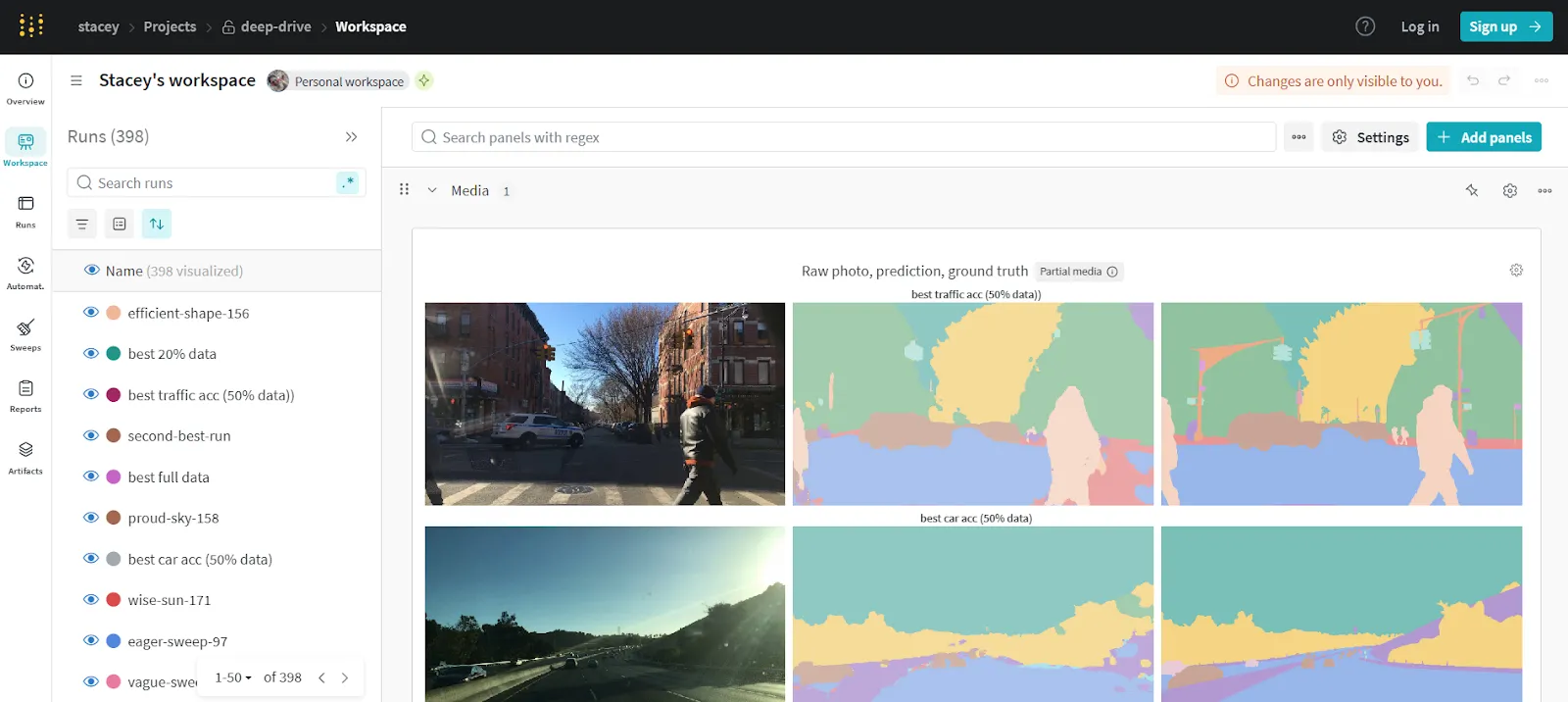

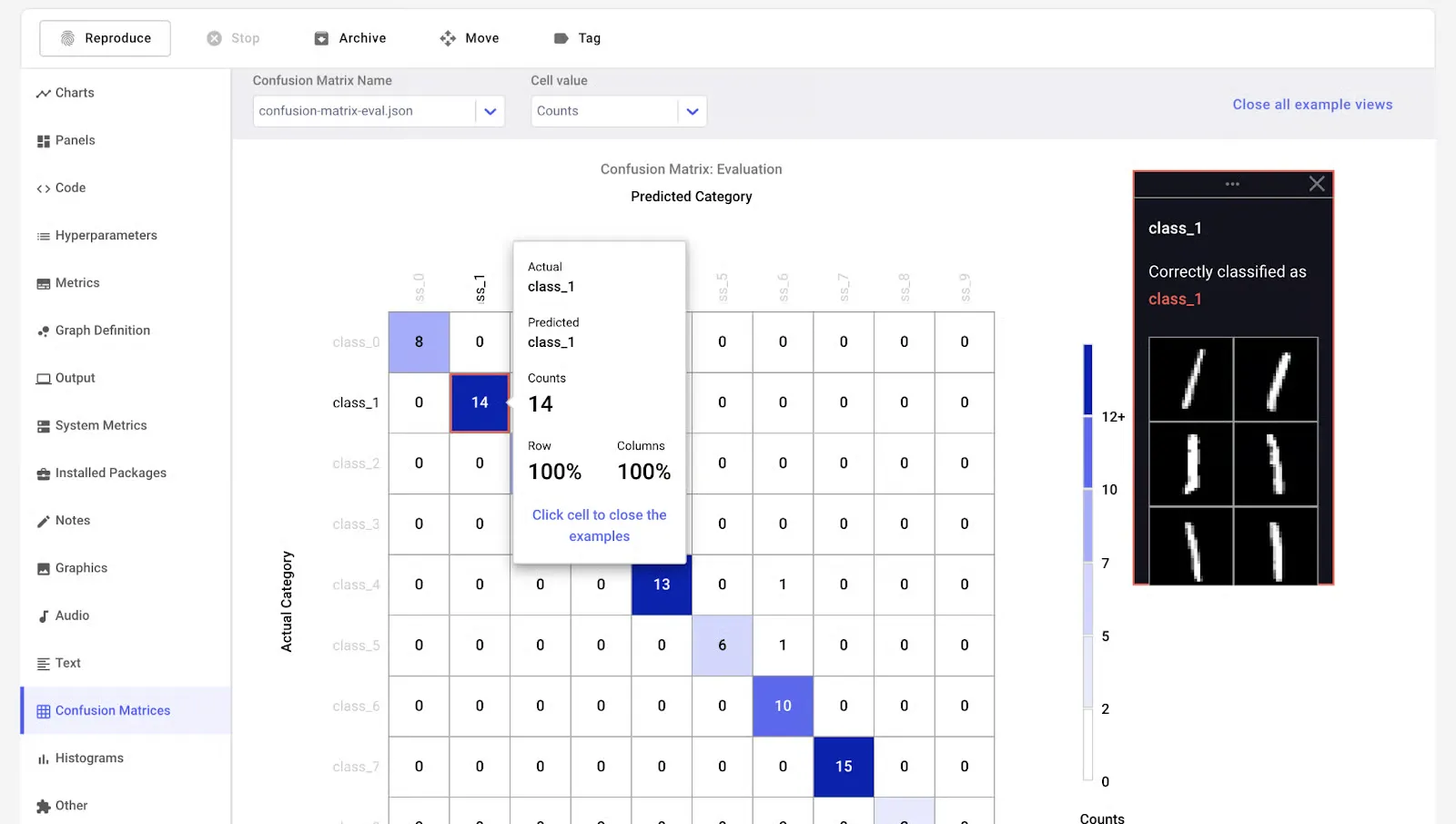

8. Poids et biais

Weights & Biases (W&B) est l'un des meilleurs outils MLOps pour le suivi des expériences, la collaboration et la visualisation de modèles. Il est largement adopté dans les environnements de recherche et de production, offrant une intégration simple avec la plupart des frameworks de machine learning. W&B met l'accent sur l'observabilité, permettant d'obtenir un aperçu en temps réel des performances d'entraînement, des hyperparamètres et des mesures du système.

Caractéristiques principales :

- Suivi des expériences et des modèles, avec tableau de bord en direct pour les cycles d'entraînement, réglage des hyperparamètres et visualisation des performances.

- Intégration parfaite avec PyTorch, TensorFlow, JAX, Hugging Face et d'autres, avec un minimum de modifications de code.

- Outils de collaboration, notamment des tableaux de bord d'équipe, des rapports de projet et la gestion des versions des artefacts pour une visibilité centralisée des projets.

Idéal pour :

Les équipes de machine learning se sont concentrées sur l'itération, la visualisation et la collaboration rapides. Idéal pour les environnements axés sur la recherche et les équipes qui souhaitent avoir un meilleur aperçu des performances de formation.

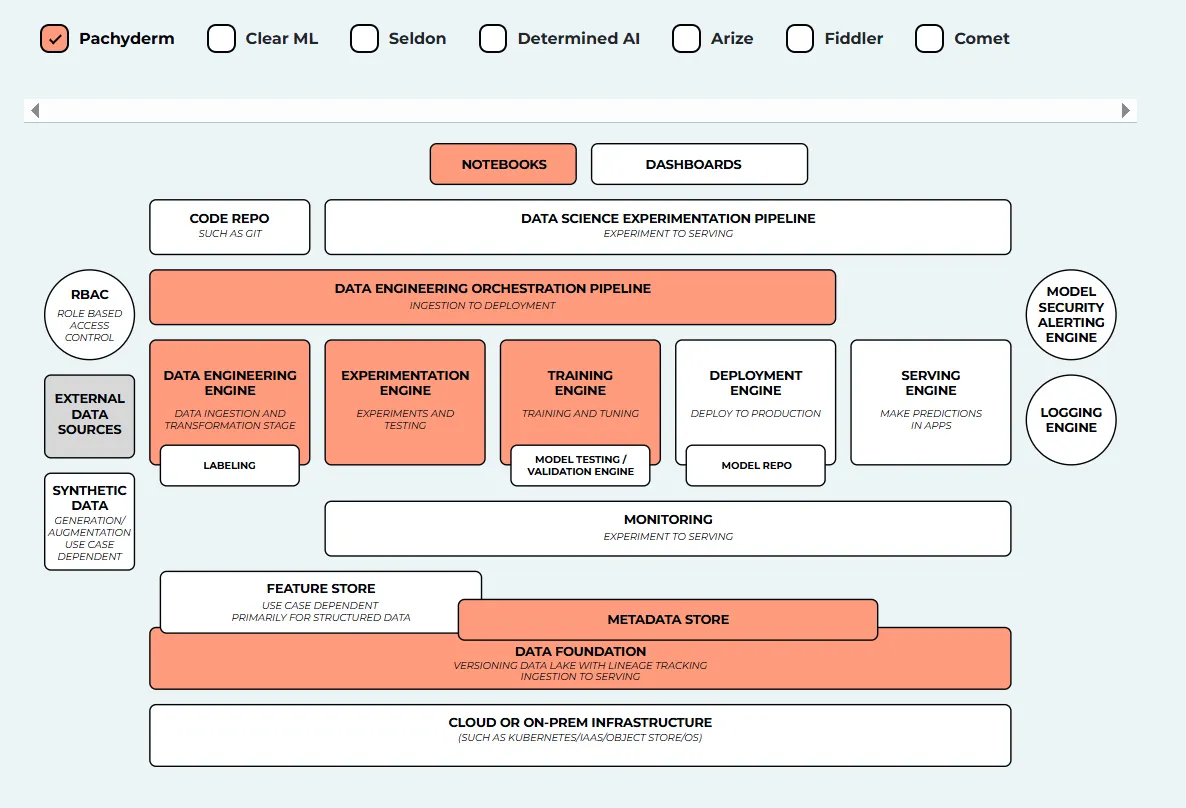

9. Pachyderme

Pachyderm est une plateforme de science des données open source conçue pour le lignage des données, le contrôle de version et les pipelines reproductibles. Contrairement aux outils MLOps traditionnels, Pachyderm utilise une approche de type GIT pour les données, ce qui le rend parfaitement adapté aux équipes qui gèrent des dépendances de données complexes ou des environnements réglementés. Il associe la conteneurisation à l'orchestration des pipelines de données pour garantir des flux de travail versionnés et traçables.

Caractéristiques principales :

- Versionnage des données et suivi du lignage pour garantir des journaux complets des ensembles de données utilisés dans la formation des modèles.

- Des pipelines évolutifs natifs de Docker qui prennent en charge le traitement parallèle de grands ensembles de données avec une configuration minimale.

- Intégrations d'entreprise et support sur site, avec compatibilité pour les déploiements Kubernetes, cloud et hybrides.

Idéal pour :

Des équipes travaillant dans des secteurs réglementés ou des flux de travail gourmands en données qui ont besoin d'un contrôle de version robuste et d'un suivi du lignage pour des raisons de conformité, de reproductibilité et d'évolutivité.

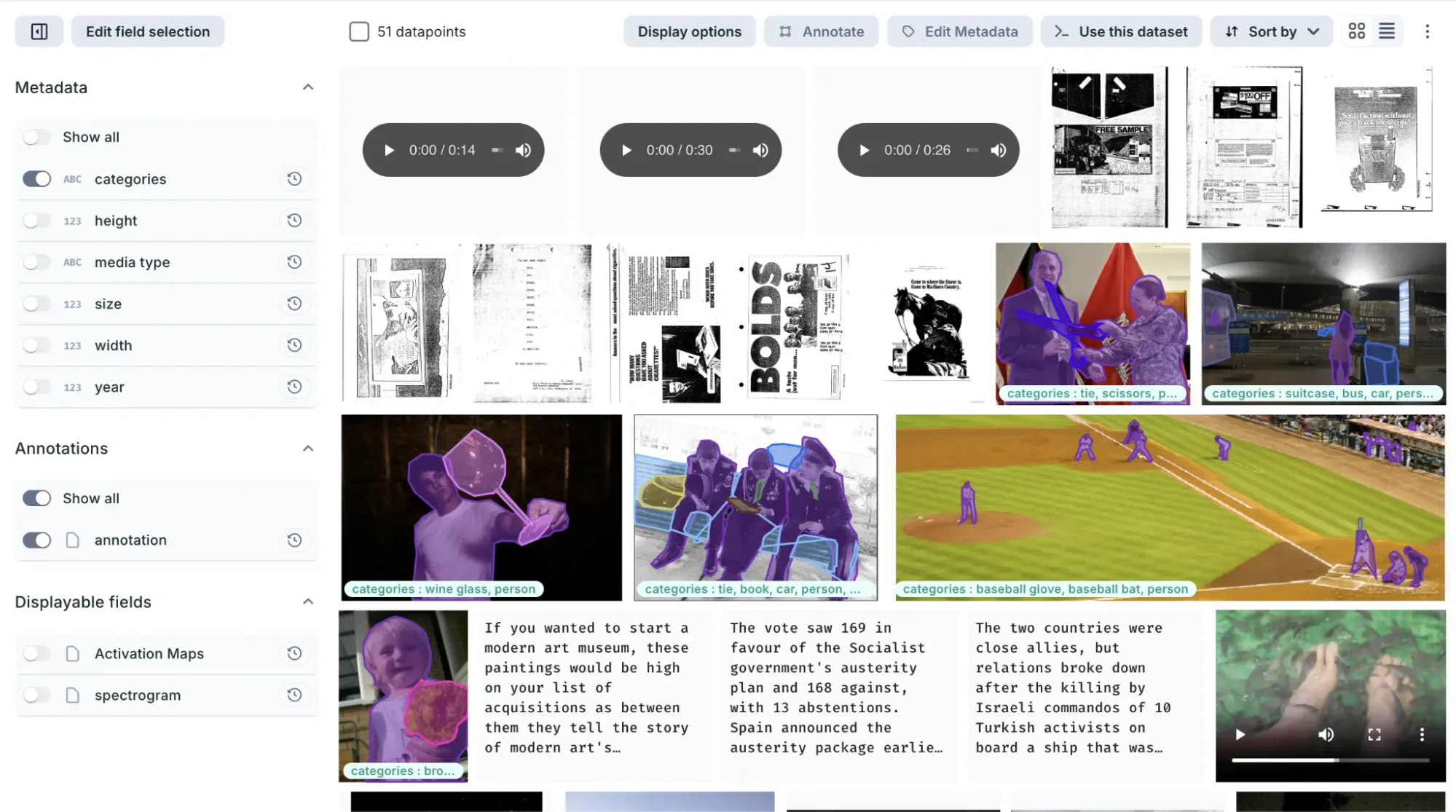

10. Allegro AI

Allegro AI est une plateforme MLOps conçue spécifiquement pour gérer les flux de travail d'apprentissage profond à grande échelle, en particulier dans les environnements de vision par ordinateur et d'IA de pointe. Il met l'accent sur l'amélioration de la reproductibilité, de la collaboration et de la traçabilité tout au long du cycle de vie de l'IA.

Doté de solides fonctionnalités de gestion des ensembles de données, de versionnement des modèles et de suivi des expériences, cet outil MLOps offre une infrastructure sécurisée de bout en bout aux équipes qui créent et déploient des modèles hautes performances dans des environnements de production ou réglementés.

Caractéristiques principales :

- Gestion visuelle des jeux de données et des modèles avec gestion automatisée des versions, des annotations et du suivi du lignage pour les projets de deep learning.

- Expérimentez le suivi et la collaboration avec des vues basées sur des projets, des comparaisons de performances et des tableaux de bord d'équipe en temps réel.

- Support Edge AI pour le déploiement de modèles sur des appareils Edge avec reproductibilité, restauration et surveillance des performances.

Idéal pour :

Les équipes travaillant sur des cas d'utilisation de la vision par ordinateur, de l'apprentissage profond ou du déploiement en périphérie, en particulier dans des secteurs tels que l'automobile, la fabrication, la santé ou la défense, où la traçabilité et le contrôle des données et des modèles sont essentiels.

11. Comète ML

Comet ML est une plateforme d'apprentissage automatique conçue pour vous aider à surveiller, analyser et affiner les modèles et les expériences. Il fonctionne parfaitement avec les bibliothèques populaires telles que Scikit-learn, PyTorch, TensorFlow et Hugging Face.

L'outil Comet MLOps facilite l'exploration et la comparaison des résultats des expériences, tout en fournissant des visualisations riches pour les échantillons de données, notamment des images, du son, du texte et des tableaux structurés.

Caractéristiques principales :

- Enregistre automatiquement les paramètres, les résultats, le code et les dépendances afin que vous puissiez comparer les expériences côte à côte.

- Fournit un emplacement central pour stocker, organiser, modifier et partager des modèles avec votre équipe.

- Enregistre et suit les versions des ensembles de données et des modèles à l'aide d' « artefacts », ce qui rend les expériences reproductibles.

- Vous aide à trouver les meilleurs paramètres pour améliorer les performances du modèle.

- Crée des graphiques et des tableaux de bord personnalisés pour suivre les résultats de l'entraînement (tels que les pertes et la précision) et l'utilisation du système (CPU/GPU).

- Surveille les modèles déployés pour détecter les baisses de performances ou les dérives de données.

Idéal pour :

Idéal pour les scientifiques des données, les ingénieurs en apprentissage automatique et les équipes qui souhaitent suivre facilement les expériences, comparer les résultats et améliorer les performances des modèles.

12. Préfet

Prefect est un outil moderne d'orchestration des flux de travail conçu pour surveiller, coordonner et gérer les pipelines de données entre les applications. Il s'agit d'une solution légère et open source conçue pour prendre en charge l'apprentissage automatique de bout en bout et les flux de données.

Vous pouvez utiliser l'interface utilisateur de Prefect Orion ou Prefect Cloud pour gérer et visualiser les flux de travail. Prefect Orion UI est un moteur d'orchestration open source hébergé localement et un serveur d'API qui fournissent des informations sur les exécutions de flux de travail locaux et l'activité du système.

Prefect Cloud, quant à lui, est un service hébergé qui vous permet de visualiser les flux, les exécutions et les déploiements tout en gérant les comptes, les espaces de travail et la collaboration en équipe.

Caractéristiques principales :

- Orchestration flexible des flux de travail entre les applications et les environnements

- Surveillance et observabilité en temps réel des flux et des tâches

- Orchestration locale avec l'interface utilisateur de Prefect Orion

- Gestion hébergée et collaboration avec Prefect Cloud

- Déploiement et planification faciles des flux de travail

- Infrastructure évolutive pour les pipelines de données et de machine learning

Idéal pour :

Les ingénieurs de données, les ingénieurs ML et les équipes qui ont besoin d'une orchestration fiable des flux de travail, d'une visibilité sur les pipelines et d'une collaboration évolutive pour les données et projets d'apprentissage automatique.

13. Métaflow

Metaflow est un outil de gestion des flux de travail pour la science des données et l'apprentissage automatique qui simplifie la création, l'exécution et le déploiement de modèles. Cet outil MLOps aide les équipes à gérer les pipelines à grande échelle tout en gérant automatiquement le suivi des expériences, le versionnage des données et le déploiement en production.

Caractéristiques principales :

- Conception et exécution de flux de travail pour la science des données et les pipelines de machine learning

- Suivi automatique des expériences et gestion des versions des données

- Exécution évolutive sur des plateformes cloud (AWS, GCP, Azure)

- Déploiement fluide des modèles en production

- Visualisation des résultats compatible avec un ordinateur portable

- Intégration avec les bibliothèques ML et les outils Python les plus populaires

- Support de l'API R pour une plus grande compatibilité linguistique

Idéal pour :

Les data scientists et les équipes de machine learning qui recherchent un outil de flux de travail simple et évolutif qui gère l'orchestration, le suivi et le déploiement tout en minimisant les frais liés aux MLOps.

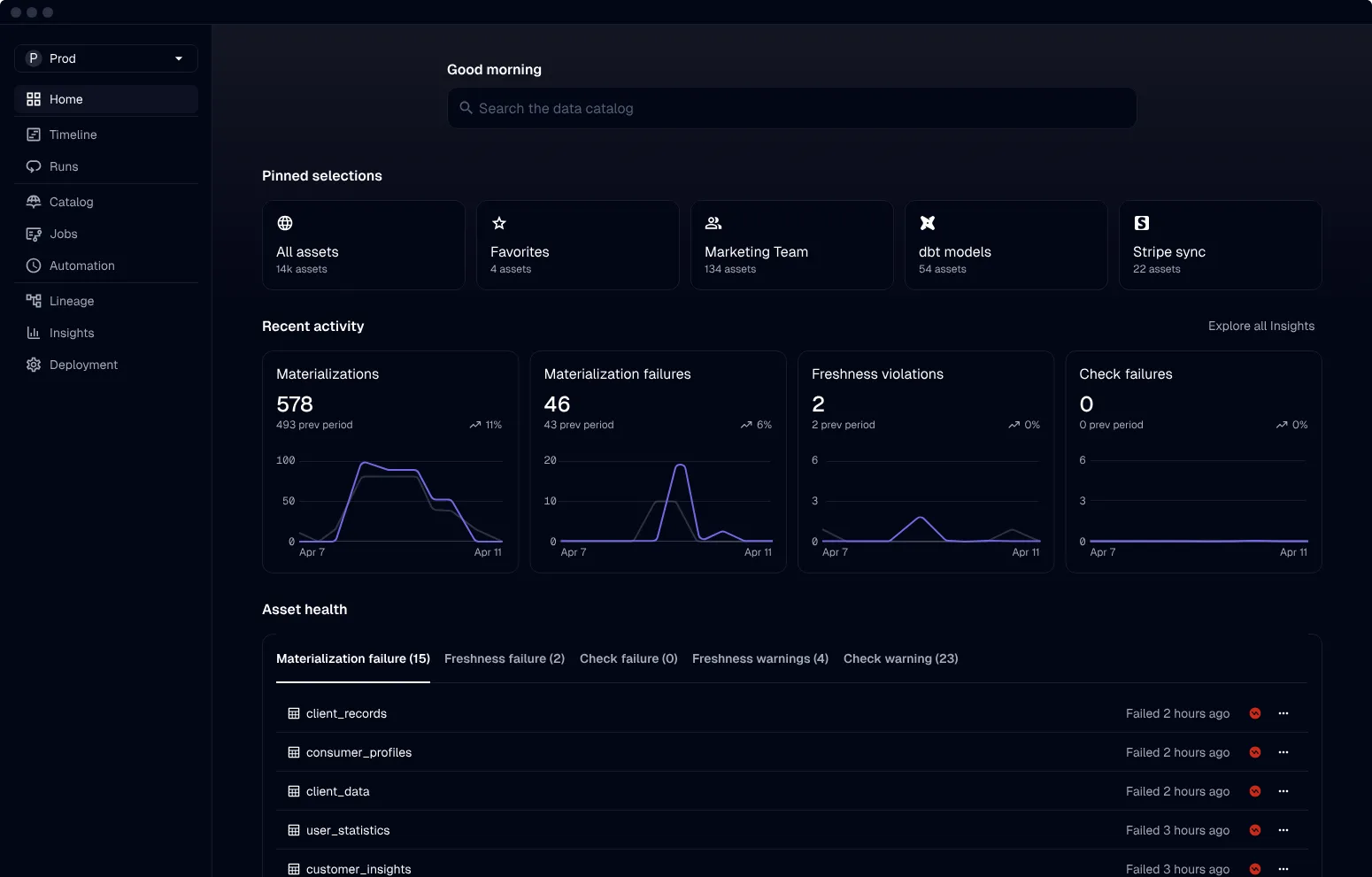

14. Poignard

Dagster est une plateforme d'orchestration native du cloud qui aide les équipes chargées des données à définir, exécuter et surveiller efficacement des pipelines de données complexes. Il met l'accent sur la fiabilité, l'observabilité et une expérience de développement moderne pour la gestion des flux de données.

Caractéristiques principales :

- Flux de travail basés sur les tâches pour la conception de canalisations modulaires et réutilisables

- Modèle de programmation déclaratif pour des définitions de pipeline plus claires

- Une observabilité renforcée grâce à la journalisation, à la surveillance et au débogage intégrés

- Testabilité améliorée pour un développement fiable de pipelines de données

- Intégrations avec les outils et plateformes de données les plus populaires

- Architecture évolutive et native du cloud pour les équipes de données modernes

Idéal pour :

Les ingénieurs de données et les équipes de données qui ont besoin d'une orchestration de pipeline de données fiable, testable et observable avec une solide intégration support et flux de développement moderne.

15. Kédro

Kedro est un outil d'orchestration des flux de travail basé sur Python qui permet de créer des projets de science des données reproductibles, maintenables et modulaires. Il intègre les meilleures pratiques d'ingénierie logicielle, telles que la modularité, la séparation des préoccupations et la gestion des versions, dans les flux de travail d'apprentissage automatique.

Caractéristiques principales :

- Création, visualisation et exécution de pipelines modulaires

- Configuration intégrée et gestion des dépendances

- Catalogue de données pour un accès organisé aux données et la gestion des versions

- Support pour la journalisation et le suivi des expériences

- Déploiement sur des machines uniques ou des environnements distribués

- Encourage le code réutilisable, maintenable et prêt à être mis en production

- Facilite la collaboration entre les équipes de science des données

Idéal pour :

Les data scientists et les équipes qui souhaitent des flux de travail de science des données structurés, maintenables et reproductibles en utilisant les meilleures pratiques de génie logiciel.

16. Véritable ère

TrueRA est une plateforme axée sur l'amélioration de la qualité des modèles d'apprentissage automatique grâce à des tests, à l'explicabilité et à l'analyse des causes profondes. Cet outil MLOps aide les équipes à déboguer des modèles, à comprendre les problèmes de performances et à garantir l'équité tout au long du cycle de vie du machine learning.

Caractéristiques principales :

- Tests de modèles automatisés pour améliorer la qualité du développement et de la production

- Contrôles systématiques des performances, de la stabilité et de l'équité

- Suivi des versions des modèles pour analyser les performances au fil du temps

- Analyse des causes profondes pour identifier les sources d'erreurs et de biais

- Informations au niveau des fonctionnalités pour détecter et réduire les biais du modèle

- Intégration facile à l'infrastructure et aux flux de travail de machine learning existants

Idéal pour :

Les ingénieurs en machine learning, les data scientists et les organisations qui ont besoin d'informations plus approfondies sur les modèles, de contrôles d'équité et d'une surveillance fiable des performances tout au long du cycle de vie des modèles.

17. Bent en ML

BentoML est une plateforme basée sur Python qui simplifie le déploiement, la diffusion et la surveillance des modèles d'apprentissage automatique en production. Il aide les équipes à expédier des applications de machine learning plus rapidement grâce à un service de modèles évolutif et performant.

Caractéristiques principales :

- Déploiement facile de modèles sous forme d'API prêtes pour la production

- Service performant avec inférence parallèle et traitement par lots adaptatif

- Support d'accélération matérielle pour des performances optimisées

- Tableau de bord centralisé pour organiser et surveiller les déploiements

- Compatibilité avec les principaux frameworks de machine learning (Keras, ONNX, LightGBM, PyTorch, Scikit-learn)

- Solution de bout en bout pour le déploiement, la diffusion et la surveillance des modèles

Idéal pour :

Les ingénieurs et les équipes de machine learning qui ont besoin d'un moyen rapide, évolutif et fiable de déployer et de gérer des modèles d'apprentissage automatique dans des environnements de production.

18. De toute évidence, l'IA

Evidently AI est une bibliothèque Python open source permettant de surveiller les modèles d'apprentissage automatique pendant le développement, la validation et la production. Il permet de garantir la qualité des données et des modèles en détectant les dérives, les problèmes de performances et d'autres problèmes potentiels.

Caractéristiques principales :

- Contrôles de la qualité des données et des modèles pour les tâches de régression et de classification

- Détection de la dérive des données et de la dérive de la cible

- Tests par lots avec contrôles structurés pour les ensembles de données et les modèles

- Rapports et tableaux de bord interactifs pour l'analyse des performances et de la dérive

- Surveillance en temps réel des données et des métriques des modèles en production

- Intégration facile dans les pipelines et flux de travail de machine learning existants

Idéal pour :

Scientifiques des données et ingénieurs ML qui ont besoin d'une surveillance fiable des modèles, d'une détection de dérive et d'un suivi des performances tout au long du cycle de vie du ML.

19. Hub DagS

DagsHub est une plateforme de collaboration pour les projets d'apprentissage automatique qui aide les équipes à suivre, à versionner et à gérer les données, les modèles, les expériences, les pipelines et le code en un seul endroit. Souvent décrit comme « GitHub pour l'apprentissage automatique », il fournit des outils permettant de rationaliser le flux de travail ML de bout en bout.

Caractéristiques principales :

- Référentiels Git et DVC pour le versionnage des données, des modèles et du code

- Suivi des expériences intégré avec DagsHub Logger et intégration MLflow

- Annotation du jeu de données avec intégration à Label Studio

- Support différent pour les blocs-notes, le code, les ensembles de données et les images de Jupyter

- Commentaires intégrés sur les fichiers, les lignes de code et les ensembles de données à des fins de collaboration

- Rapports de projet similaires à un wiki GitHub

Idéal pour :

Les équipes et les organisations de machine learning qui ont besoin d'un environnement collaboratif contrôlé par les versions pour gérer l'intégralité du cycle de vie de l'apprentissage automatique avec une intégration et une reproductibilité solides.

20. Plateforme Iguazio MLOps

La plateforme Iguazio MLOps est une solution de bout en bout qui automatise l'intégralité du cycle de vie de l'apprentissage automatique, de l'ingestion et de la préparation des données à la formation, au déploiement et à la surveillance de la production. Cet outil MLOps propose à la fois un framework open source (MLrun) et une plateforme entièrement gérée, avec un déploiement flexible dans des environnements cloud, hybrides ou sur site.

Caractéristiques principales :

- Ingestion de données provenant de sources multiples avec un magasin de fonctionnalités intégré pour les fonctionnalités réutilisables

- Formation et évaluation évolutives et sans serveur avec suivi automatique et gestion des versions des données

- CI/CD intégré pour la formation et le déploiement continus des modèles

- Déploiement de modèles en un clic avec surveillance continue des performances

- Détection et atténuation de la dérive des modèles en production

- Tableau de bord centralisé pour gérer, gouverner et surveiller les modèles en temps réel

- Options de déploiement flexibles dans les environnements cloud, hybrides et sur site

Idéal pour :

Les entreprises et les secteurs réglementés (par exemple, la santé, la finance) qui ont besoin d'une plateforme MLOps flexible, évolutive et gérée, dotée d'une automatisation et d'un contrôle de déploiement puissants.

21. Qdrant

Qdrant est une base de données vectorielles open source et recherche de similarité moteur qui vous permet de stocker, de gérer et d'interroger des intégrations vectorielles via un service prêt pour la production et une API simple. Il est conçu pour une recherche sémantique performante et des applications alimentées par l'IA.

Caractéristiques principales :

- API facile à utiliser avec support Python et bibliothèques clientes pour plusieurs langues

- Recherche précise et rapide à l'aide d'un algorithme HNSW modifié pour la recherche du voisin le plus proche

- Prise en charge de types de données riches et de filtres, notamment du texte, des plages numériques et des géolocalisations

- Architecture distribuée native au cloud avec évolutivité horizontale

- Construit dans Rust pour des performances élevées et une utilisation efficace des ressources

Idéal pour :

Création d'équipes de développeurs et de ML recherche sémantique, des systèmes de recommandation et des applications d'IA qui nécessitent une recherche et un filtrage vectoriels rapides et évolutifs.

22. Système de gestion des versions des données LakeFS

LakeFS est un système de contrôle de version de données open source qui intègre des opérations de type Git au stockage d'objets, permettant aux équipes de gérer des lacs de données avec les mêmes flux de travail que ceux utilisés pour le code. Il permet un versionnage des données évolutif et fiable pour les environnements de données à grande échelle.

Caractéristiques principales :

- Opérations de type Git (branche, validation, fusion) pour les données dans le stockage d'objets

- Branchement zéro copie pour une expérimentation et une collaboration rapides

- Hooks de pré-validation et de fusion pour le CI/CD et les contrôles de qualité des données

- Fonctionnalités de restauration et de restauration pour résoudre rapidement les problèmes liés aux données

- Contrôle de version évolutif pour les grands lacs de données, jusqu'à l'exaoctet

- Compatible avec les principaux services de stockage dans le cloud

Idéal pour :

Les ingénieurs de données et les organisations gérant de grands lacs de données qui ont besoin d'un contrôle de version fiable, d'expériences sécurisées et de flux de données reproductibles à grande échelle.

23. Violoniste

Fiddler AI est une plateforme de surveillance et d'explicabilité des modèles qui aide les équipes à comprendre, à déboguer et à suivre les modèles d'apprentissage automatique en production. Il fournit des informations claires sur le comportement, les performances et la qualité des données des modèles via une interface intuitive.

Caractéristiques principales :

- Surveillance des performances avec détection et analyse détaillées de la dérive des données

- Contrôles d'intégrité des données pour éviter les données d'entraînement incorrectes ou corrompues

- Détection des valeurs aberrantes pour les anomalies univariées et multivariées

- Métriques de service pour surveiller le fonctionnement et l'état du système de machine learning

- Outils d'explicabilité pour comprendre et déboguer les prédictions des modèles

- Alertes et notifications en cas de problèmes de modèles en production

Idéal pour :

Les ingénieurs en machine learning, les data scientists et les organisations qui ont besoin d'une surveillance transparente des modèles, d'une explicabilité et d'alertes proactives pour maintenir la fiabilité des systèmes ML de production.

24. Ray

Ray est un framework informatique distribué qui aide les développeurs à faire évoluer facilement les applications d'IA et de Python. Il fournit un environnement d'exécution flexible et une suite de bibliothèques d'IA pour la création, la formation et le déploiement de systèmes d'apprentissage automatique à grande échelle.

Caractéristiques principales :

- Un environnement d'exécution distribué pour faire évoluer les charges de travail Python et AI entre les clusters

- Abstractions de base : tâches (fonctions sans état), acteurs (travailleurs avec état) et objets (données immuables partagées)

- Traitement des données évolutif pour les grands ensembles de données ML

- Formation distribuée pour les modèles d'apprentissage automatique et d'apprentissage profond

- Réglage des hyperparamètres pour optimiser les performances du modèle

- Support d'apprentissage par renforcement pour les charges de travail avancées en matière d'IA

- Modèle évolutif au service des déploiements de production

Idéal pour :

Développeurs, ingénieurs ML et équipes d'IA qui ont besoin d'un cadre flexible et performant pour adapter la formation, le traitement des données et les services de modèles dans des environnements distribués.

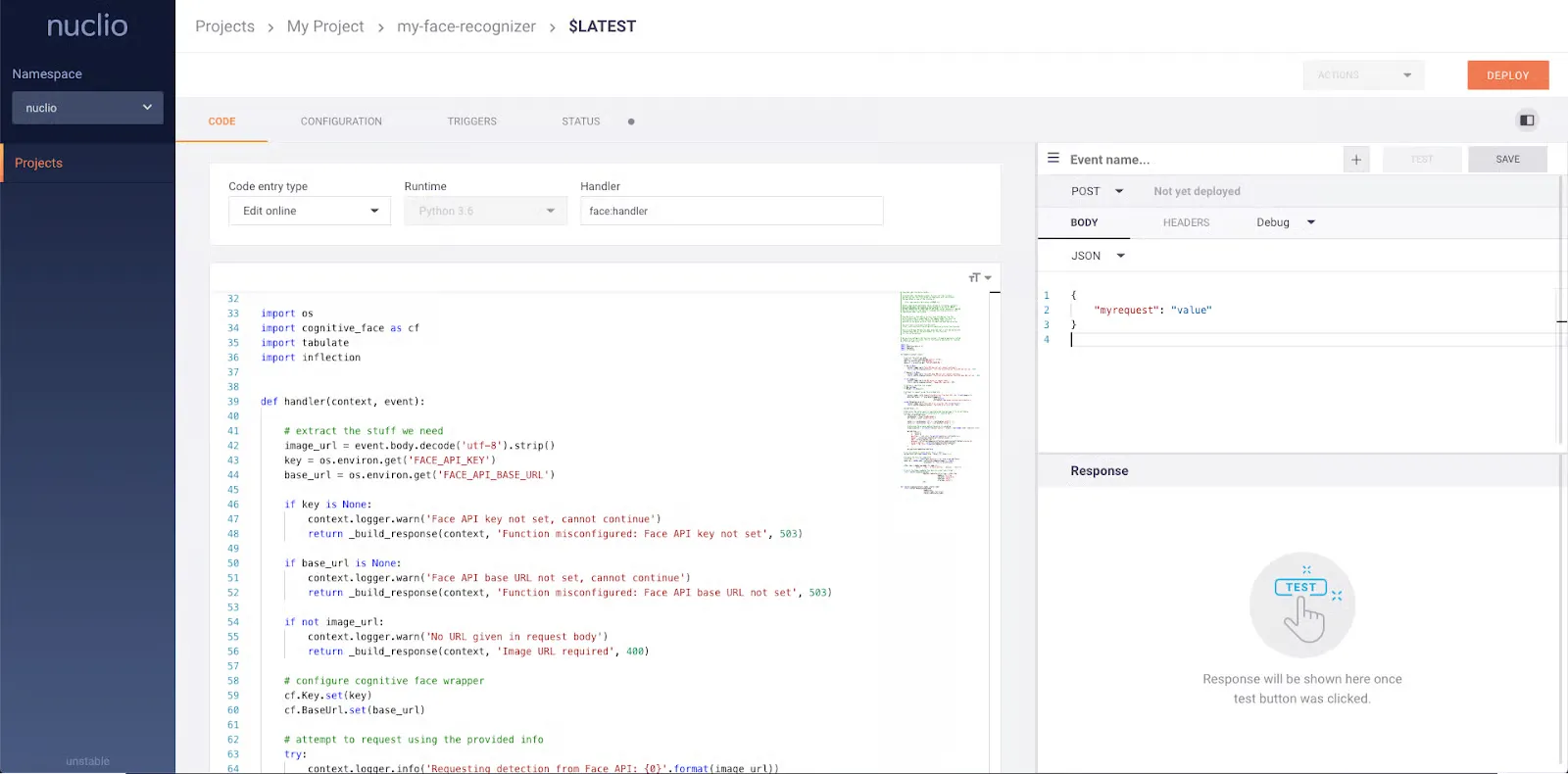

25. Nuclio

Nuclio est un framework sans serveur hautes performances conçu pour les charges de travail gourmandes en données, en E/S et en calcul. Il permet un traitement en temps réel sans gestion de serveur et s'intègre parfaitement aux outils de science des données et aux plateformes de machine learning.

Caractéristiques principales :

- Exécution sans serveur avec traitement en temps réel et parallélisme élevé

- Utilisation efficace des ressources du processeur, du GPU et des E/S

- Intégration avec des outils populaires tels que Jupyter et Kubeflow

- Prise en charge de diverses sources de données et de streaming

- Fonctions dynamiques avec accélération du chemin de données pour un traitement plus rapide

- Portabilité sur les plateformes cloud, les appareils périphériques et les environnements à faible consommation

- Conception prête à l'emploi pour des charges de travail de production évolutives

Idéal pour :

Les entreprises et les équipes de machine learning qui ont besoin d'une plateforme hautes performances sans serveur pour le traitement des données en temps réel, le streaming et les charges de travail d'IA évolutives dans les environnements cloud et périphériques.

Avantages des outils MLOps

Les meilleurs outils MLOps aident les entreprises à gérer plus efficacement le cycle de vie de bout en bout de l'apprentissage automatique. Ils apportent automatisation, collaboration et fiabilité à la création, au déploiement et à la maintenance de systèmes de machine learning.

1. Accélérez le développement de modèles

Les outils MLOps automatisent les tâches répétitives telles que la préparation des données, le suivi des expériences et l'orchestration du pipeline. Cela permet aux équipes d'itérer plus rapidement, de réduire les erreurs manuelles et de faire passer les modèles de l'idée à la production plus rapidement.

2. Améliorez la collaboration en équipe

Ces outils fournissent des espaces de travail partagés, des ressources versionnées et une documentation claire, ce qui permet aux data scientists, aux ingénieurs et aux parties prenantes de collaborer plus facilement, d'examiner les modifications et de partager des informations entre les équipes.

3. Améliorez les performances et la qualité des modèles

Grâce à la surveillance, aux tests et à la validation intégrés, les outils MLOps aident à détecter des problèmes tels que la dérive des données, les biais et la dégradation des performances. Cela garantit que les modèles restent précis, fiables et conformes aux objectifs commerciaux.

4. Contrôle de version et reproductibilité améliorés

Les plateformes MLOps suivent les versions des données, du code, des modèles et des expériences, permettant aux équipes de reproduire les résultats, d'auditer les modifications et de maintenir la cohérence entre les environnements.

5. Déploiement et mise à l'échelle rationalisés des

Ils simplifient le déploiement de modèles en production grâce à l'automatisation, à des pipelines CI/CD et à une infrastructure évolutive, permettant aux entreprises de gérer des charges de travail accrues et de s'adapter efficacement à l'évolution des demandes.

Conclusion

Le MLOps est passé d'une pratique de niche à un composant fondamental des flux de travail modernes d'apprentissage automatique. En 2026, les entreprises ne se demandent plus si elles ont besoin de MLOps, mais quelle plateforme correspond le mieux à leurs objectifs, à leur infrastructure et à leur échelle.

Comme nous l'avons vu, le paysage offre tout, des outils légers et modulaires tels que MLflow et DVC aux solutions d'entreprise entièrement gérées comme Azure ML, Vertex AI et SageMaker.

Pour les équipes qui se concentrent sur l'IA GenAI, le réglage et l'inférence en temps réel, les nouvelles plateformes telles que TrueFoundry offrent des fonctionnalités de pointe conçues pour relever les défis modernes de l'IA.

Opérationnalisez plus rapidement vos charges de travail ML et GenAI. Réservez une démo avec TrueFoundry pour commencer.

Questions fréquemment posées

Le MLOps est-il meilleur que DevOps ?

MLOps n'est pas meilleur que DevOps ; il s'agit d'une extension de DevOps adaptée à l'apprentissage automatique. Alors que DevOps se concentre sur la fourniture de logiciels et l'automatisation de l'infrastructure, MLOps ajoute des fonctionnalités de gestion des données, de suivi des expériences, de surveillance des modèles et de reproductibilité, répondant ainsi aux défis uniques liés à la création, au déploiement et à la maintenance de systèmes ML en production.

Quel est le meilleur outil MLOps pour l'IA d'entreprise ?

Les meilleurs outils MLOps pour les entreprises sont ceux qui permettent de trouver un équilibre entre la rapidité des développeurs et une gouvernance stricte de l'infrastructure. Alors que les grands fournisseurs de cloud proposent des services étendus, TrueFoundry est souvent le choix idéal pour les équipes qui ont besoin de souveraineté des données et de flexibilité multicloud. Il fournit un plan de contrôle unifié qui s'exécute de manière native au sein de votre VPC privé, vous permettant d'automatiser l'ensemble du cycle de vie, de la formation au déploiement, sans compromettre la sécurité ou le contrôle de l'infrastructure.

Docker est-il un outil MLOps ?

Docker est une technologie fondamentale pour la conteneurisation, ce qui en fait un élément essentiel de la pile d'outils MLOps. Il garantit que les modèles s'exécutent de manière cohérente dans les environnements de développement et de production, mais il ne gère pas les tâches de niveau supérieur telles que la surveillance des modèles ou la gestion des versions. TrueFoundry simplifie le processus de conteneurisation en créant automatiquement des images Docker et en les orchestrant sur Kubernetes, permettant ainsi aux data scientists de déployer du code sans avoir à devenir des experts DevOps.

Comment fonctionne TrueFoundry pour les MLOps ?

TrueFoundry fonctionne comme une couche d'abstraction centrée sur le développeur qui se trouve au-dessus de votre infrastructure cloud existante. Il se connecte directement à vos clusters Kubernetes et automatise des tâches complexes telles que le provisionnement des ressources, le CI/CD et le service de modèles. En fournissant une interface unique pour gérer les expériences et les charges de travail de production, il réduit les délais de déploiement de plusieurs semaines à quelques minutes tout en abaissant les coûts grâce à l'optimisation automatique des GPU et à la prise en charge des instances ponctuelles.

Quel cloud convient le mieux à une plateforme MLOps ?

Aucun cloud n'est idéal pour les MLOps ; le bon choix dépend de vos besoins, de vos outils et de votre budget. AWS, Azure et Google Cloud proposent tous des services MLOps performants, notamment des pipelines automatisés, une formation évolutive et la surveillance des modèles. Les équipes font souvent leur choix en fonction de l'infrastructure existante, des exigences de conformité et de l'intégration à leur écosystème de données.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)