Un guide complet des LLMOP pour l'apprentissage automatique

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Présentation de LLMops

LLMops et son rôle dans la gestion de grands modèles linguistiques

Les LLMOP, également connues sous le nom de Large Language Model Operations, englobent les pratiques et processus spécialisés essentiels à la gestion et à l'opérationnalisation efficaces des grands modèles de langage (LLM). Les LLM sont des modèles avancés de traitement du langage naturel qui ont la capacité de générer du texte semblable à celui d'un humain et d'effectuer un large éventail de tâches liées au langage. Ces modèles constituent une avancée significative dans le domaine de l'IA et ont trouvé des applications dans divers domaines tels que les chatbots, les services de traduction, la génération de contenu, etc.

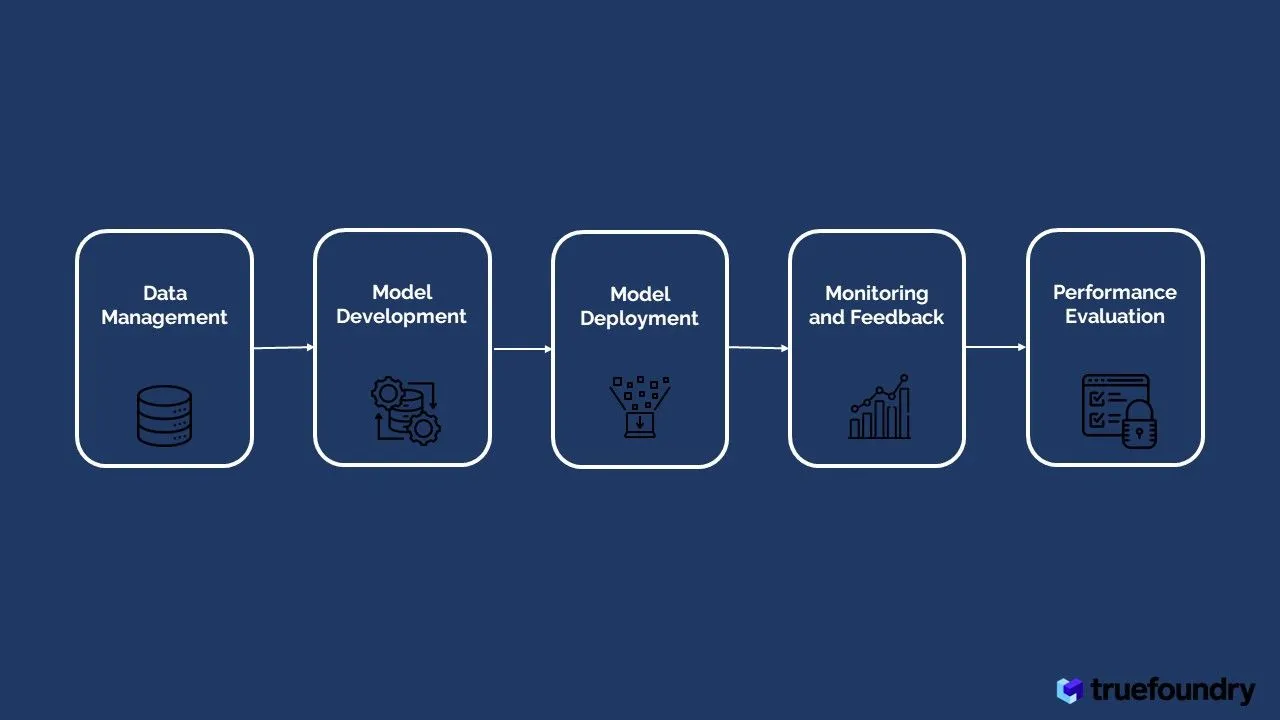

Le rôle des LLMOP est de garantir le développement, le déploiement et la maintenance fluides des LLM tout au long de leur cycle de vie. Il comporte différentes étapes, allant de l'acquisition et du prétraitement des données à la mise au point du modèle, en passant par son déploiement en production, sa surveillance et sa mise à jour continues pour garantir des performances optimales.

Difficultés rencontrées lors du développement et du déploiement de LLM

Le développement et le déploiement de grands modèles de langage présentent un ensemble de défis uniques en raison de leur complexité et de leur utilisation intensive en ressources :

- D'énormes ressources de calcul: La formation des LLM nécessite de grandes quantités de puissance de calcul et de mémoire. La formation ne serait-ce que d'un seul grand modèle peut être extrêmement coûteuse et prendre beaucoup de temps.

- Exigences relatives aux données: Les LLM ont besoin d'énormes ensembles de données pour la formation afin d'obtenir des résultats de haute qualité. L'acquisition, le nettoyage et l'annotation de telles données à grande échelle peuvent être difficiles et coûteux.

- Préoccupations d'ordre éthique: À mesure que les LLM gagnent en puissance, les risques d'utilisation abusive, tels que la génération de faux contenus ou de résultats biaisés, suscitent des inquiétudes.

- Interprétabilité du modèle: Il peut être difficile de comprendre comment les LLM prennent leurs décisions, car il est difficile d'expliquer leur comportement et de garantir la transparence.

- Apprentissage par transfert et optimisation: Le réglage précis des LLM pré-formés sur des tâches spécifiques nécessite une optimisation minutieuse pour éviter les oublis catastrophiques et garantir une bonne généralisation.

- Dimensionnement du déploiement: Le déploiement de LLM dans un environnement de production nécessite une évolutivité efficace pour gérer de grands volumes de demandes entrantes sans compromettre les performances.

LLMops et MLOps : en quoi les LLMOP sont-ils différents des MLOps ?

Bien que les LLMOP présentent des similitudes avec les MLOP (opérations d'apprentissage automatique) traditionnelles, certains aspects distincts les distinguent :

- Défis spécifiques à la langue: Les LLM traitent de tâches liées au langage, qui impliquent souvent des entrées et des sorties textuelles, ce qui rend le prétraitement et l'augmentation des données spécifiques au langage.

- Ingénierie rapide: L'élaboration d'instructions efficaces est cruciale pour guider le comportement des LLM, et les LLMOP impliquent des expériences itératives pour optimiser les invites pour les résultats souhaités.

- Boucle de rétroaction humaine: L'intégration du feedback humain est essentielle pour améliorer continuellement les performances du LLM, ce qui nécessite une boucle de rétroaction pour affiner le modèle.

- Demandes de calcul: En raison de la taille et de la complexité des LLM, leur déploiement et leur gestion nécessitent une infrastructure et des ressources informatiques spécialisées.

- Dominance de l'apprentissage par transfert: La formation préalable et la mise au point sont au cœur du développement du LLM, car ces modèles s'appuient largement sur l'apprentissage par transfert à partir de grands modèles pré-entraînés.

Les principaux composants des LLMOP

Gestion des données : approvisionnement, prétraitement et étiquetage des données pour la formation LLM

Les données sont la pierre angulaire de tout modèle de langage large (LLM) réussi, un outil puissant qui a révolutionné le traitement du langage naturel. Cependant, le passage des données brutes à un LLM performant implique une série d'étapes cruciales en matière de gestion des données. Dans cette section, nous aborderons les subtilités de l'approvisionnement des données, du prétraitement, de l'étiquetage et du développement de modèles, en mettant en lumière les défis et les meilleures pratiques auxquels les équipes LLMoPS sont confrontées à cette étape cruciale de l'excellence des langages d'IA.

Collecte de données : dénicher les joyaux

La collecte de données diversifiées et représentatives est un défi monumental qui peut avoir un impact significatif sur l'efficacité d'un LLM. Les équipes de LLMops parcourent la vaste étendue du Web et organisent une multitude de textes, de conversations et de documents pour créer un ensemble de données robuste et complet. Des stratégies telles que le web scraping, l'exploitation de référentiels open source et la collaboration avec des experts du domaine permettent aux équipes de créer des ensembles de données qui reflètent la complexité réelle du langage.

Prétraitement des données : raffinage de la matière première

Une fois collectées, les données sont soumises à un prétraitement rigoureux pour être prêtes pour la formation LLM. Le nettoyage des données implique la suppression du bruit et des informations non pertinentes, ainsi que la gestion des fautes d'orthographe et de grammaire. La tokenisation décompose le texte en unités significatives, telles que des mots ou des sous-mots, ce qui permet au modèle de mieux traiter et comprendre la langue. La normalisation garantit l'uniformité en convertissant le texte dans un format standard, réduisant ainsi les écarts potentiels pendant la formation.

Étiquetage des données : dévoiler des informations grâce à la supervision

L'apprentissage supervisé nécessite des données étiquetées, et les équipes LLMoPS investissent des efforts considérables dans la création d'ensembles de données annotés pour des tâches LLM spécifiques. L'annotation manuelle par des experts humains ou des plateformes de crowdsourcing permet de fournir des étiquettes pour l'analyse des sentiments, la reconnaissance d'entités nommées, etc. Des techniques telles que l'apprentissage actif et l'augmentation des données optimisent davantage les efforts d'étiquetage, en utilisant efficacement les ressources pour améliorer les performances des modèles.

bases de données vectorielles

Les grands modèles de langage (LLM) jouent un rôle de plus en plus important dans diverses applications, telles que le traitement du langage naturel, la traduction automatique et la réponse aux questions. Cependant, les LLM peuvent être complexes et difficiles à gérer. Les bases de données vectorielles peuvent contribuer à simplifier la gestion des LLM en fournissant un moyen de stocker et de rechercher leurs grandes représentations vectorielles.

Une base de données vectorielle est un type de base de données qui stocke des données sous forme de vecteurs. Les vecteurs sont un type d'objet mathématique qui peut être utilisé pour représenter des données complexes, telles que du texte, des images et du son. Les bases de données vectorielles sont bien adaptées au stockage et à la recherche de LLM car elles peuvent stocker et récupérer efficacement les grandes représentations vectorielles utilisées par les LLM.

Un certain nombre de bases de données vectorielles sont disponibles, notamment Pinceone, Milvus, Vespa AI, Qdrant, Redis, SingleStore, Weviate, etc. Ces bases de données vectorielles fournissent une variété de fonctionnalités qui peuvent être utilisées pour gérer les LLM. Voici quelques exemples spécifiques de la manière dont les bases de données vectorielles peuvent être utilisées dans LLMOP :

- Stockage et recherche de représentations vectorielles: Les bases de données vectorielles peuvent être utilisées pour stocker et rechercher les grandes représentations vectorielles utilisées par les LLM. Cela facilite la recherche et l'utilisation de LLM pour diverses tâches. Par exemple, une entreprise qui développe des chatbots pourrait utiliser une base de données vectorielles pour stocker les représentations vectorielles de différents modèles de chatbots. Cela permettrait de trouver facilement le meilleur modèle de chatbot pour une tâche particulière, telle que le service client ou les ventes.

- Contrôle de version: les bases de données vectorielles peuvent suivre les modifications apportées aux LLM. Cela permet de reproduire facilement les expériences et de suivre l'évolution des LLM au fil du temps. Par exemple, une équipe de recherche qui développe un nouveau LLM pourrait utiliser une base de données vectorielles pour suivre les modifications apportées aux paramètres du LLM. Cela permettrait de reproduire facilement les expériences menées avec le LLM et de suivre l'amélioration des performances du LLM au fil du temps.

- Suivi des expériences : Les bases de données vectorielles peuvent suivre les résultats des expériences menées avec des LLM. Cela permet d'identifier facilement la meilleure configuration LLM pour une tâche particulière. Par exemple, une entreprise qui développe un nouveau modèle de traduction automatique pourrait utiliser une base de données vectorielles pour suivre les résultats d'expériences menées avec différentes configurations de modèles. Cela permettrait d'identifier facilement la configuration du modèle qui produit les meilleures traductions.

- Déploiement en production: Les bases de données vectorielles peuvent être utilisées pour déployer des LLM en production. Cela facilite la mise à disposition des LLM aux utilisateurs. Par exemple, une entreprise qui développe un nouveau système de réponse aux questions pourrait utiliser une base de données vectorielles pour déployer le système en production. Cela permettrait aux utilisateurs de poser des questions sur le système et d'obtenir des réponses.

Développement de modèles : sélection architecturale, suivi des expériences, réglage fin et réglage des hyperparamètres

Le développement de modèles est au cœur des opérations LLMOP (Large Language Model Operations), où commence la quête de performances optimales et de maîtrise du langage. Au cours de cette étape cruciale, les équipes LLMoPS se lancent dans une aventure de sélection architecturale, de réglage fin et de réglage des hyperparamètres pour transformer les modèles de langage en entités compétentes et polyvalentes. Dans cette exploration complète, nous explorons les subtilités de chaque étape, en mettant en lumière les défis et les techniques de pointe qui favorisent l'excellence des langages d'IA.

Sélection architecturale : définition des bases du modèle

Le choix de la bonne architecture LLM est un facteur décisif qui influence profondément ses capacités. Les équipes de LLMops évaluent méticuleusement les différentes options architecturales, en tenant compte de facteurs tels que la taille du modèle, sa complexité et les exigences spécifiques des tâches prévues. Les architectures basées sur des transformateurs, telles que la famille GPT (Generative Pre-trained Transformer), ont révolutionné le domaine du traitement du langage naturel. Cependant, de nouvelles architectures intégrant des innovations telles que les mécanismes d'attention, l'augmentation de la mémoire et les calculs adaptatifs sont continuellement explorées pour relever des défis spécifiques, améliorer les performances et répondre à diverses applications.

Rationalisation des progrès : la puissance du suivi des expériences dans les opérations de grands modèles linguistiques

Le suivi des expériences est un aspect crucial des opérations LLMOP (Large Language Model Operations), car il permet aux équipes de gérer et d'analyser systématiquement la myriade d'expériences menées au cours du développement du LLM. En mettant en œuvre des cadres de suivi robustes, les équipes LLMops enregistrent efficacement les configurations des modèles, les hyperparamètres et les résultats, ce qui permet de prendre des décisions fondées sur les données. Il favorise la reproductibilité, la transparence et la collaboration, en facilitant le processus d'affinement et en alignant les réponses du modèle sur les attentes des utilisateurs. Le suivi des expériences joue un rôle central dans l'approche humaine intégrée, en intégrant de précieux commentaires et en nous rapprochant de la réalisation de l'intelligence artificielle sous son meilleur jour.

Perfectionner les stratégies : affiner pour atteindre l'excellence des tâches

Les LLM pré-formés servent de point de départ pour les ajustements spécifiques à une tâche. Ce processus implique d'adapter les connaissances et la compréhension du modèle pour exceller dans les tâches ciblées. Les équipes LLMops naviguent habilement dans le paysage des ajustements, trouvant le juste équilibre entre la conservation des connaissances pré-entraînées du modèle et l'intégration des informations spécifiques aux tâches. La sélection des hyperparamètres appropriés, notamment les taux d'apprentissage, la taille des lots et les algorithmes d'optimisation, joue un rôle essentiel dans l'obtention des performances souhaitées. De plus, la quantité de données d'entraînement supplémentaires nécessaires pour affiner le réglage est soigneusement déterminée afin d'éviter de surajuster ou de sous-utiliser le potentiel du modèle.

Réglage des hyperparamètres : exploiter le potentiel du modèle

Les hyperparamètres servent de cadrans qui contrôlent le comportement du modèle pendant l'entraînement. Trouver la configuration optimale de ces hyperparamètres est une étape cruciale pour optimiser les performances du modèle. Les équipes LLmops utilisent diverses techniques pour se lancer dans le processus de réglage des hyperparamètres. De la recherche par grille à l'optimisation bayésienne en passant par les algorithmes évolutifs, chaque méthode explore le vaste espace des hyperparamètres afin d'identifier le point idéal où le modèle atteint ses performances optimales. De plus, des approches telles que les calendriers d'apprentissage et la perte de poids sont mises à profit pour améliorer la généralisation et atténuer le surajustement.

Apprentissage par transfert et apprentissage multitâche : renforcer l'adaptabilité

Les équipes LLMoPS tirent parti de l'apprentissage par transfert et des paradigmes d'apprentissage multitâches pour améliorer l'adaptabilité et l'efficacité des modèles. L'apprentissage par transfert implique la formation préalable d'un modèle de langage sur un vaste corpus, suivie d'un ajustement spécifique à la tâche. Cette technique permet au modèle de tirer parti des connaissances issues d'un large éventail de données linguistiques. L'apprentissage multitâche permet aux modèles d'apprendre simultanément à partir de plusieurs tâches, ce qui leur permet de tirer parti des relations et des modèles communs entre les tâches, ce qui permet d'améliorer la généralisation et les performances.

Stratégies de déploiement et d'exploitation des modèles

Le succès de Modèles linguistiques étendus (LLM) dépend non seulement de leurs capacités impressionnantes, mais également de leur déploiement sans faille et de l'efficacité de leurs opérations. Dans cette phase cruciale des opérations de modèles linguistiques étendus (LLMOP), une planification et une exécution méticuleuses sont primordiales. Cette section explore les subtilités de Déploiement de modèles d'IA les stratégies, l'importance d'une surveillance et d'une maintenance continues, et le rôle inestimable du feedback humain et de l'ingénierie rapide dans la conception des LLM afin d'atteindre l'excellence en matière de langage d'IA.

Stratégies de déploiement : préparer le terrain pour les performances du LLM

Le déploiement de LLM dans les environnements de production nécessite des considérations stratégiques pour garantir des performances optimales et la satisfaction des utilisateurs. Les équipes LLMops évaluent méticuleusement les stratégies de déploiement, en tenant compte des exigences en matière d'infrastructure, d'évolutivité et de performances. Le déploiement basé sur le cloud offre de la flexibilité et des ressources à la demande, tandis que les solutions sur site répondent aux problèmes de confidentialité et de sécurité des données. Le déploiement en périphérie permet aux LLM de fonctionner au plus près des utilisateurs finaux, de réduire la latence et d'améliorer les interactions en temps réel. L'adoption de la stratégie de déploiement la plus adaptée améliore la disponibilité et la réactivité du LLM, répondant ainsi aux divers besoins des applications dans le monde réel.

Collaboration interdisciplinaire : favoriser l'excellence du langage de l'IA

Le déploiement et les opérations des LLM nécessitent une approche holistique et collaborative. Les équipes LLMops collaborent avec des experts du domaine, des éthiciens et des concepteurs d'interfaces utilisateur pour relever les défis de manière globale. L'implication d'experts de divers domaines garantit que les LLM sont adaptés pour servir efficacement des industries et des domaines spécifiques. Les considérations éthiques jouent un rôle crucial pour atténuer les biais et garantir un déploiement responsable de l'IA, en créant des LLM justes, inclusifs et équitables dans leurs interactions avec les utilisateurs. Les concepteurs d'interfaces utilisateur améliorent l'expérience utilisateur globale en rendant les LLM plus intuitifs et plus conviviaux et en favorisant des interactions fluides et productives.

Intégration et livraison continues (CI/CD) : automatisation du développement et du déploiement de modèles

L'intégration continue (CI) est la pratique qui consiste à automatiser la création et le test du code chaque fois qu'il est envoyé à un système de contrôle de version. Cela permet de s'assurer que le code fonctionne toujours et que toute modification est rapidement identifiée et traitée.

La livraison continue (CD) est la pratique qui consiste à automatiser le déploiement du code dans un environnement de production. Cela permet de garantir que le code peut être déployé rapidement et de manière fiable et que toutes les modifications sont annulées si nécessaire.

Lorsque CI et CD sont combinés, ils forment un pipeline CI/CD. Un pipeline CI/CD peut automatiser l'ensemble du processus de création, de test et de déploiement de modèles d'apprentissage automatique. Cela peut contribuer à améliorer la fiabilité, l'efficacité et la visibilité du processus de développement et de déploiement des modèles d'apprentissage automatique.

Voici certains des avantages de l'utilisation de CI/CD pour les LLMOP :

- Fiabilité accrue: Le CI/CD peut contribuer à réduire le risque d'erreurs dans les modèles d'apprentissage automatique en automatisant le processus de test. En effet, les tests sont exécutés automatiquement chaque fois que le code est modifié, ce qui permet d'identifier et de corriger les erreurs à un stade précoce.

- Efficacité améliorée: CI/CD peut contribuer à accélérer le processus de déploiement de modèles d'apprentissage automatique en automatisant le processus de déploiement. En effet, le processus de déploiement est automatisé, ce qui signifie qu'aucune intervention manuelle n'est nécessaire.

- Visibilité accrue: Le CI/CD peut contribuer à améliorer la visibilité du processus de développement et de déploiement des modèles d'apprentissage automatique. En effet, toutes les étapes du processus sont suivies et enregistrées, ce qui permet d'identifier plus facilement les problèmes susceptibles de survenir.

Voici quelques exemples d'outils CI/CD pour LLMOP :

- GitLab : GitLab est une plateforme DevOps populaire qui inclut des fonctionnalités CI/CD.

- Jenkins : Jenkins est un autre outil CI/CD populaire.

- CircleCI : CircleCI est une plateforme CI/CD basée sur le cloud.

Ce ne sont là que quelques-uns des avantages de l'utilisation du CI/CD pour les LLMOP. Si vous souhaitez améliorer la fiabilité, l'efficacité et la visibilité de votre processus de développement et de déploiement de modèles d'apprentissage automatique, le CI/CD est un outil précieux à envisager.

Surveillance, ingénierie rapide et feedback humain

Surveillance et maintenance : préservation de l'efficacité du LLM

La surveillance continue est au cœur du succès des opérations LLM. Il permet aux équipes LLMops d'identifier et de résoudre rapidement les problèmes, garantissant ainsi des performances et une fiabilité optimales. La surveillance englobe des mesures de performance, telles que le temps de réponse, le débit et l'utilisation des ressources, permettant une intervention rapide en cas de goulot d'étranglement ou de dégradation des performances. En outre, la détection des biais ou des sorties nuisibles est essentielle pour un déploiement responsable de l'IA. En utilisant des techniques de surveillance soucieuses de l'équité, les équipes LLMoPS s'assurent que les LLM fonctionnent de manière éthique, en réduisant les biais involontaires et en renforçant la confiance des utilisateurs. Les mises à jour et la maintenance régulières des modèles, facilitées par des pipelines automatisés, garantissent que le LLM reste à jour avec les dernières avancées et tendances en matière de données, garantissant une efficacité et une adaptabilité durables

Feedback humain et ingénierie rapide : développer l'intelligence du langage de l'IA

Le feedback humain joue un rôle moteur crucial dans l'amélioration des performances du LLM. Les équipes LLMoPS adoptent une approche axée sur l'humain, permettant aux experts et aux utilisateurs finaux de fournir des commentaires précieux sur les résultats du LLM. Ce processus itératif facilite l'amélioration et le réglage des modèles, en alignant les réponses du LLM sur les attentes humaines et les besoins du monde réel. L'apprentissage par renforcement à partir de la rétroaction humaine (RLHF) est une technique d'apprentissage automatique qui entraîne des modèles à générer du texte adapté aux préférences humaines. La RLHF fonctionne en donnant au modèle un signal de récompense pour la génération d'un texte considéré comme « bon » par un évaluateur humain. Le modèle apprend ensuite à générer du texte qui maximisera le signal de récompense. La RLHF peut être utilisée pour améliorer les performances des LLM dans diverses tâches, telles que la synthèse de texte, la réponse à des questions et la génération de dialogues. En combinant le feedback humain et l'apprentissage automatique, la RLHF peut créer des modèles plus précis, informatifs et attrayants.

En outre, l'ingénierie rapide joue un rôle central en aidant les LLM à produire les résultats souhaités. L'élaboration d'invites appropriées aide à orienter les réponses du modèle, permettant aux équipes LLMops d'expérimenter et d'optimiser les invites pour différents cas d'utilisation, domaines et préférences des utilisateurs. En conséquence, les LLM deviennent plus contrôlables, adaptables et efficaces pour fournir des réponses significatives

Garantir l'excellence : tests approfondis dans le cadre d'opérations sur de grands modèles linguistiques

Les tests font partie intégrante des opérations LLMOP (Large Language Model Operations) et garantissent la robustesse et la fiabilité des LLM dans des scénarios réels. Des procédures de test approfondies aident les équipes LLMops à valider les performances et la précision du modèle de langage pour un large éventail de tâches et de scénarios de saisie. Diverses méthodologies de test, notamment des tests unitaires, des tests d'intégration et des tests de bout en bout, sont utilisées pour évaluer différents aspects des fonctionnalités du LLM. En outre, les tests de résistance et les tests contradictoires aident à identifier les faiblesses ou les vulnérabilités potentielles dans les réponses du modèle, garantissant ainsi qu'il peut gérer les entrées difficiles et les exemples contradictoires avec brio. En effectuant des tests rigoureux, les équipes LLMoPS inspirent confiance dans les capacités du modèle, favorisant ainsi un déploiement responsable et efficace des LLM dans des applications pratiques.

Mesures de performance et méthodes d'évaluation uniques pour les LLM

L'évaluation des performances des grands modèles de langage (LLM) est cruciale pour évaluer leurs capacités et leur potentiel pour diverses tâches de traitement du langage naturel. Il existe de nombreuses méthodes d'évaluation, chacune mettant en lumière différents aspects de l'efficacité d'un modèle. Vous trouverez ci-dessous cinq dimensions d'évaluation couramment utilisées qui fournissent des informations précieuses sur les performances des LLM :

Perplexité

La perplexité est une mesure fondamentale fréquemment utilisée pour évaluer les performances des modèles linguistiques. Il quantifie l'efficacité avec laquelle le modèle prédit un échantillon de texte donné. Un score de perplexité plus faible indique que le modèle peut mieux prédire le mot suivant d'une séquence, ce qui suggère une sortie plus cohérente et plus fluide. Cette métrique aide les chercheurs et les développeurs à affiner leurs modèles afin d'améliorer la génération et la compréhension du langage.

Évaluation humaine

Bien que les mesures automatisées soient précieuses, l'évaluation humaine joue un rôle central dans l'évaluation de la véritable qualité des modèles linguistiques. Pour cette approche, des évaluateurs humains experts sont recrutés pour examiner et évaluer les réponses générées en fonction de plusieurs critères, tels que la pertinence, la fluidité, la cohérence et la qualité globale. Le jugement humain fournit un feedback subjectif et saisit les nuances que les métriques automatisées peuvent ignorer. Il s'agit d'une étape cruciale pour comprendre les performances du modèle dans des scénarios du monde réel et permet aux chercheurs de répondre à des préoccupations ou à des limites spécifiques.

BLEU (doublure d'évaluation bilingue)

Principalement utilisé dans les tâches de traduction automatique, BLEU compare la sortie générée avec une ou plusieurs traductions de référence pour mesurer la similitude entre elles. Un score BLEU plus élevé indique que la traduction générée par le modèle correspond bien aux traductions de référence fournies. Il permet d'évaluer la précision et l'efficacité de la traduction du modèle.

ROUGE (doublure axée sur les rappels pour l'évaluation des résultats)

ROUGE est un ensemble de mesures largement utilisées pour évaluer la qualité de la synthèse des textes. Il mesure le chevauchement entre le résumé généré et un ou plusieurs résumés de référence, en tenant compte de la précision, du rappel et du score F1. Les scores ROUGE fournissent des informations précieuses sur la capacité du modèle linguistique à générer des résumés concis et informatifs, ce qui le rend inestimable pour des tâches telles que la synthèse de documents et la génération de contenu.

Mesures relatives à la diversité

Il est essentiel de s'assurer qu'un modèle de langage produit des sorties diverses et uniques, en particulier dans les applications telles que les chatbots ou les systèmes de génération de texte. Les mesures de diversité impliquent l'analyse de paramètres tels que la diversité à n-grammes ou la mesure de la similitude sémantique entre les réponses générées. Des scores de diversité plus élevés indiquent que le modèle peut produire un plus large éventail de réponses et éviter des sorties répétitives ou monotones.

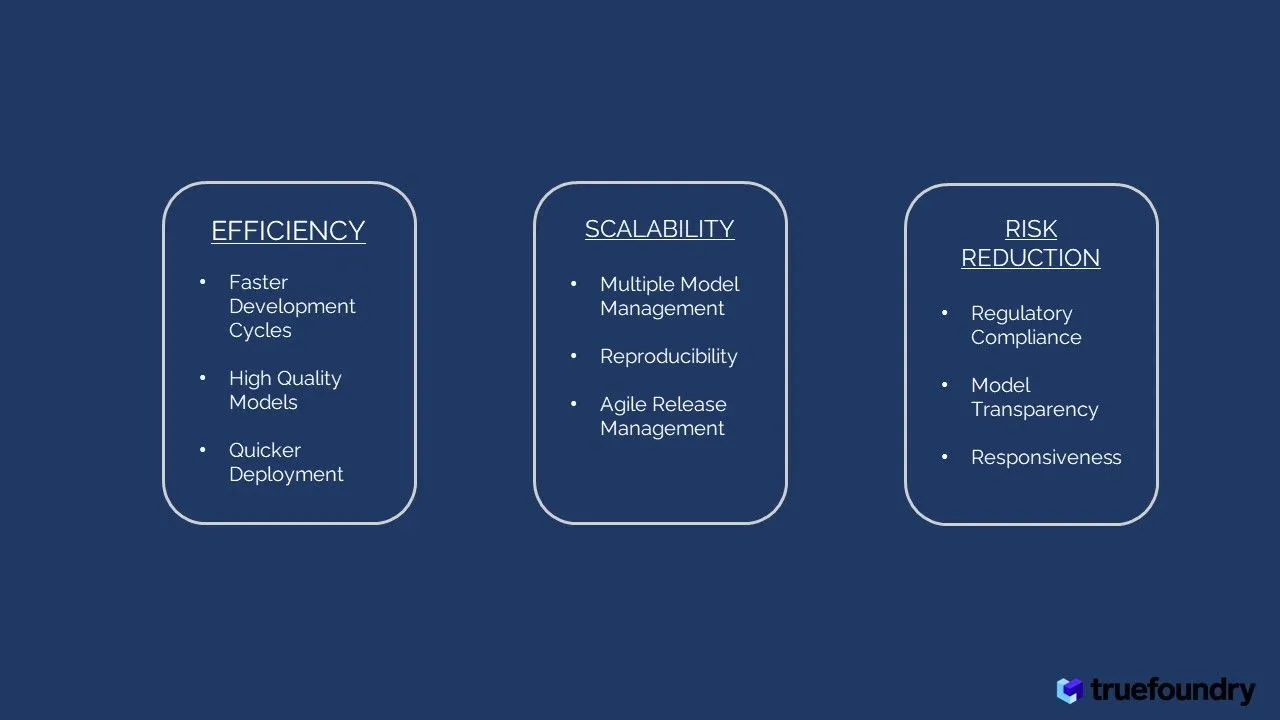

Comprendre les avantages des LLMOP

Efficacité : développement accéléré des modèles et des pipelines, amélioration de la qualité des modèles et accélération du déploiement de la production.

Les LLMOP rationalisent le processus de développement du LLM, ce qui présente plusieurs avantages :

- Cycles de développement plus rapides: Une gestion efficace des données et des techniques de réglage permettent d'accélérer le cycle global de développement des modèles.

- Modèles de haute qualité: Un suivi, une évaluation et une optimisation appropriés basés sur le feedback humain améliorent la qualité du modèle.

- Déploiement plus rapide: Des stratégies de déploiement optimisées et des opérations bien gérées permettent un déploiement plus rapide des LLM dans des applications réelles.

Évolutivité : gestion et supervision d'un grand nombre de modèles, reproductibilité des pipelines LLM et augmentation de la vitesse de libération.

Les LLMOP favorisent l'évolutivité et la reproductibilité des pipelines LLM :

- Gestion de plusieurs modèles: Les LLMOP fournissent une infrastructure et des outils permettant de gérer efficacement plusieurs LLM, chacun desservant des tâches ou des langues différentes.

- Reproductibilité: Un contrôle de version et une documentation appropriés garantissent la reproductibilité des pipelines LLM, ce qui facilite le suivi des modifications et l'annulation si nécessaire.

- Gestion agile des versions: Des pratiques LLMops efficaces permettent des mises à jour et des déploiements de modèles plus rapides et plus fluides, favorisant ainsi une rapidité de publication rapide.

Réduction des risques : garantir la conformité aux réglementations, la transparence dans le développement des modèles et une réponse plus rapide aux demandes.

LLMoPS aborde les risques potentiels associés au déploiement de LLM :

- Conformité réglementaire: Le développement transparent des modèles et les considérations éthiques contribuent à garantir le respect des réglementations et des directives.

- Transparence du modèle: LLMoPS vise à rendre le comportement du LLM plus interprétable, en réduisant le risque de résultats biaisés ou indésirables.

- Réactivité: Des pratiques LLMops efficaces permettent de répondre plus rapidement aux demandes, de réduire les retards potentiels et d'améliorer l'expérience utilisateur.

En conclusion, les LLMOP jouent un rôle essentiel dans la gestion du processus complexe et gourmand en ressources de développement, de déploiement et de maintenance de grands modèles de langage. En relevant des défis uniques et en tirant parti de techniques spécialisées, les LLMOP garantissent l'utilisation efficace et éthique de ces puissants modèles d'IA dans diverses applications du monde réel.

Découvrir les meilleures plateformes et outils LLMops

Au fur et à mesure que l'écosystème LLM mûrit, les équipes évaluent souvent différentes plateformes pour identifier Les meilleurs outils LLMops pour leurs flux de travail spécifiques, qu'il s'agisse du suivi des expériences, de la diffusion de modèles, de l'étiquetage des données ou de la surveillance de la production.

Plateformes complètes

Visage étreignant

HuggingFace est une plateforme open source permettant de créer et d'utiliser de grands modèles de langage. Il fournit une bibliothèque de modèles pré-entraînés, une interface de ligne de commande et une application Web permettant d'expérimenter des modèles. La spécialité de HuggingFace est de rendre les grands modèles linguistiques accessibles à tous.

La bibliothèque de modèles pré-entraînés de HuggingFace comprend une grande variété de modèles, du BERT au GPT-3. Ces modèles peuvent être utilisés pour diverses tâches, telles que la compréhension du langage naturel, la génération du langage naturel et la réponse à des questions. L'interface de ligne de commande de HuggingFace facilite le chargement et l'utilisation de ces modèles, et son application Web fournit une interface visuelle permettant d'expérimenter des modèles.

Effacer le ML

ClearML est une plateforme de gestion d'expériences d'apprentissage automatique. Il permet de suivre les expériences, de stocker des données et de visualiser les résultats. La spécialité de ClearML est sa capacité à suivre les expériences sur plusieurs plateformes d'apprentissage automatique. Les fonctionnalités de suivi des expériences de ClearML vous permettent de suivre facilement l'avancement de vos projets d'apprentissage automatique. Vous pouvez suivre les paramètres que vous avez utilisés, les mesures que vous avez mesurées et les résultats que vous avez obtenus. ClearML vous permet également de stocker les données de vos expériences, afin que vous puissiez facilement reproduire vos résultats.

AWS Sagemaker

AWS SageMaker est une plateforme entièrement gérée qui fournit un ensemble complet de fonctionnalités pour créer, former et déployer des modèles d'apprentissage automatique. Il comprend une variété d'outils et de services permettant de gérer l'ensemble du cycle de vie de l'apprentissage automatique, de la préparation des données au déploiement des modèles. SageMaker est un choix populaire pour LLMops car il fournit un certain nombre de fonctionnalités spécialement conçues pour les grands modèles de langage, telles que :

- Formation distribuée: SageMaker peut être utilisé pour entraîner de grands modèles de langage sur des clusters de machines distribués. Cela permet des temps d'entraînement plus rapides et de meilleures performances.

- Surveillance des modèles: SageMaker fournit des outils permettant de surveiller les performances de grands modèles de langage. Cela permet de s'assurer que les modèles fonctionnent comme prévu et qu'ils ne sont pas affectés par des modifications des données ou de l'environnement.

- Déploiement du modèle: SageMaker peut être utilisé pour déployer de grands modèles de langage en production. Cela permet d'utiliser les modèles pour alimenter des applications et des services.

Socle rocheux

Bedrock est une nouvelle plateforme d'AWS spécialement conçue pour l'IA générative. Il fournit un certain nombre de fonctionnalités conçues pour faciliter la création, la formation et le déploiement de modèles d'IA génératifs, notamment :

- Une bibliothèque de modèles d'IA génératifs pré-entraînés: Bedrock inclut une bibliothèque de modèles d'IA génératifs pré-entraînés qui peuvent être utilisés comme point de départ pour créer de nouveaux modèles.

- Un cadre pour la formation de modèles d'IA génératifs: Bedrock fournit un cadre pour la formation de modèles d'IA génératifs qui facilite l'expérimentation de différents paramètres et configurations d'entraînement.

- Une plateforme pour déployer des modèles d'IA génératifs: Bedrock fournit une plateforme de déploiement de modèles d'IA génératifs qui facilite la mise à l'échelle des modèles en production.

Services Azure OpenAI

Les services Azure OpenAI sont un ensemble de services qui vous permettent d'utiliser les grands modèles de langage d'OpenAI dans Azure. Ces services incluent un point de terminaison géré pour la famille de modèles GPT-3, un service de texte-code et un service de réponse aux questions. La spécialité des services Azure OpenAI est leur intégration avec Azure. Les services Azure OpenAI facilitent l'utilisation des grands modèles de langage d'OpenAI dans vos applications Azure. Vous pouvez utiliser le point de terminaison géré pour accéder à un modèle GPT-3, ou vous pouvez utiliser le service de synthèse pour générer du code à partir de descriptions en langage naturel. Les services Azure OpenAI fournissent également un service de réponse aux questions, qui vous permet de poser des questions sur les modèles d'OpenAI et d'obtenir des réponses.

API GCP Palm

L'API GCP Palm est une API de traitement du langage naturel qui peut être utilisée pour générer du texte, traduire des langues et répondre à des questions. Il est basé sur les LLM de Google, tels que BERT et GPT-3. La spécialité de l'API GCP Palm est sa capacité à générer du texte, à traduire des langues et à répondre à des questions. L'API GCP Palm fournit diverses fonctionnalités pour générer du texte, traduire des langues et répondre à des questions. Vous pouvez l'utiliser pour générer du texte réaliste, traduire des langues avec précision et répondre à des questions de manière complète et informative. L'API GCP Palm est un outil puissant pour les développeurs qui ont besoin d'utiliser le traitement du langage naturel dans leurs applications.

Gestion des données : approvisionnement, prétraitement et étiquetage des données pour la formation LLM

Indice de lama

LLamaIndex est une plateforme d'indexation et de recherche de grands modèles linguistiques. LLamaIndex est particulièrement bien adapté aux LLMOP, car il fournit une variété de fonctionnalités pour l'indexation et la recherche de LLM, notamment des requêtes rapides, un classement par pertinence et des facettes. La fonction de recherche rapide de LLamaIndex vous permet de rechercher rapidement dans vos LLM les informations dont vous avez besoin. La fonction de classement par pertinence vous permet de classer les résultats de vos recherches en fonction de leur pertinence par rapport à votre requête. La fonction de facettage vous permet de filtrer les résultats de vos recherches selon différents critères.

Chaîne Lang

LangChain est un Plateforme LLMops qui aide les équipes à créer, déployer et gérer de grands modèles de langage (LLM) à grande échelle. Il fournit diverses fonctionnalités pour la gestion des LLM, notamment le contrôle des versions, le suivi des expériences et le déploiement en production. La spécialité de LangChain est sa capacité à adapter les LLM pour gérer de grandes quantités de données. Il fournit également diverses fonctionnalités pour surveiller les LLM, afin que les équipes puissent s'assurer qu'ils fonctionnent comme prévu.

Toloka

Toloka est une plateforme de crowdsourcing qui vous permet d'étiqueter les données pour les modèles d'apprentissage automatique. Toloka est particulièrement bien adapté aux LLMOP, car il peut être utilisé pour étiqueter de grandes quantités de données rapidement et efficacement. Toloka dispose d'un grand nombre de travailleurs disponibles pour étiqueter les données 24 heures sur 24, 7 jours sur 7. La plateforme permet d'obtenir une contribution humaine à toutes les étapes du développement du LLM : pré-formation, mise au point et RLHF.

Boîte à étiquettes

LabelBox est une plateforme basée sur le cloud qui permet d'étiqueter les données pour les modèles d'apprentissage automatique. LabelBox est particulièrement bien adapté aux LLMOP, car il fournit une variété d'outils et de fonctionnalités pour l'étiquetage des données, notamment une interface Web, une application mobile et une API REST. L'interface Web de LabelBox est facile à utiliser et est accessible depuis n'importe quel appareil. L'application mobile vous permet d'étiqueter les données où que vous soyez. L'API REST vous permet d'intégrer LabelBox à vos flux de travail existants.

Argile

Argilla est une plateforme de gestion et de déploiement de modèles d'apprentissage automatique. Argilla est particulièrement bien adapté aux LLMOP, car il fournit une plate-forme de curation de données open source pour les LLM utilisant des boucles de rétroaction humaines et automatiques. Argilla propose également diverses fonctionnalités de gestion des modèles, notamment la gestion des versions, le suivi des expériences et le déploiement en production. Le système de gestion des versions d'Argilla vous permet de suivre les modifications apportées à vos modèles au fil du temps. Le système de suivi des expériences vous permet d'enregistrer les hyperparamètres et les résultats de vos expériences. Le système de déploiement en production vous permet de déployer vos modèles dans des environnements de production.

Surtension

Surge est une plateforme permettant de déployer des modèles d'apprentissage automatique en production. Surge dispose d'une plate-forme RLHF dédiée dotée de fonctionnalités clés telles que des étiqueteuses Domain Expert, une interface d'expérimentation rapide, une expertise RLHF et des modèles linguistiques. Surge répond à un large éventail de cas d'utilisation tels que l'évaluation des recherches et la modération du contenu. Surge est particulièrement adapté aux LLMOP, car il fournit diverses fonctionnalités pour le déploiement de modèles en production, notamment la mise à l'échelle automatique, la surveillance et les alertes. La fonction de mise à l'échelle automatique de Surge vous permet d'augmenter ou de diminuer automatiquement la taille de vos modèles en fonction de la demande. La fonction de surveillance vous permet de suivre les performances de vos modèles en production. La fonction d'alerte vous permet d'être averti en cas de problème avec vos modèles.

Échelle

Scale est une plateforme complète qui alimente la stratégie d'IA générative, y compris le réglage fin, l'ingénierie rapide, la sécurité, la sécurité des modèles, l'évaluation des modèles et les applications d'entreprise. Il prend également en charge la RLHF, la génération de données, la sécurité et l'alignement. Scale est particulièrement bien adaptée aux LLMOP, car elle fournit diverses fonctionnalités pour gérer les modèles à grande échelle, notamment la mise à l'échelle automatique, l'équilibrage de charge et la tolérance aux pannes. La fonction de dimensionnement automatique de Scale vous permet de redimensionner automatiquement vos modèles vers le haut ou vers le bas en fonction de la demande. La fonction d'équilibrage de charge répartit le trafic entre vos modèles afin de s'assurer qu'ils ne sont pas surchargés. La fonction de tolérance aux pannes permet à vos modèles de continuer à fonctionner même si certains d'entre eux tombent en panne.

Développement de modèles : sélection architecturale, suivi des expériences, réglage fin et réglage des hyperparamètres

Databricks

Databricks a récemment publié Dolly, son LLM Open Instruction-Tuned. Databricks MLflow est particulièrement adapté aux LLMOP, car il peut être utilisé pour suivre les performances des LLM au fil du temps et pour les déployer dans des environnements de production. Il fournit un référentiel centralisé pour stocker les expériences, les modèles et les artefacts de machine learning. Databricks MLflow fournit également diverses fonctionnalités permettant de suivre les performances des modèles de machine learning, notamment le suivi des expériences, la gestion des versions des modèles et la gestion des artefacts.

Voici quelques-unes des principales fonctionnalités de Databricks MLflow :

- Référentiel centralisé pour stocker les expériences, les modèles et les artefacts de machine learning

- Suivi des expériences

- Versionnage des modèles

- Gestion des artefacts

- Intégration à une variété de frameworks de machine learning

- Évolutif et fiable

Poids et biais

Suite d'outils LLMops intégrés à la plateforme W&B MLOps destinée aux développeurs. Utilisez les invites W&B pour visualiser et inspecter le flux d'exécution du LLM, suivre les entrées et les sorties, afficher les résultats intermédiaires et gérer en toute sécurité les invites et les configurations de chaînes LLM. W&B vous permet également de partager vos expériences avec d'autres équipes, ce qui peut être utile pour la collaboration et le partage des connaissances. W&B est particulièrement bien adapté aux LLMOP, car il peut être utilisé pour suivre les performances des LLM au fil du temps et pour les partager avec d'autres équipes.

Voici quelques-unes des principales caractéristiques de W&B :

- Suivi des expériences

- Versionnage des modèles

- Gestion des artefacts

- Partage d'expériences

- Intégration à une variété de frameworks de machine learning

- Analytique visuelle

Véritable objectif

TrueLens est une plateforme de gestion et de déploiement de grands modèles de langage (LLM). TrueLens fournit diverses fonctionnalités pour gérer les LLM, notamment la gestion des versions, le suivi des expériences et le déploiement en production. TrueLens utilise des fonctions de feedback pour mesurer la qualité et l'efficacité de votre application LLM. TrueLens vous permet également de déployer des LLM auprès de divers fournisseurs de cloud, ce qui peut s'avérer utile pour l'évolutivité et la fiabilité. TrueLens convient particulièrement aux équipes qui utilisent divers frameworks de machine learning, car il peut être utilisé pour gérer des modèles provenant de différents frameworks.

Voici quelques-unes des principales fonctionnalités de TrueLens :

- Gestion des LLM

- Versionnage

- Suivi des expériences

- Déploiement en production

- Déploiement auprès de différents fournisseurs de cloud

- Intégration à une variété de frameworks de machine learning

- Évolutif et fiable

Mosaïque ML

MosaicML vous permet d'exécuter des modèles open source sous licence commerciale. Intégrez facilement les LLM à vos applications. Vous permet également de déployer des modèles prêts à l'emploi ou d'affiner des modèles sur vos données. Mosaic ML est une plateforme permettant de créer, de déployer et de gérer des modèles d'apprentissage automatique à grande échelle. Mosaic ML fournit diverses fonctionnalités pour gérer les modèles à grande échelle, notamment la mise à l'échelle automatique, l'équilibrage de charge et la tolérance aux pannes. Mosaic ML vous permet également de surveiller les performances de vos modèles en production, ce qui peut vous aider à identifier et à résoudre rapidement les problèmes.

Voici quelques-unes des principales fonctionnalités de Mosaic ML :

- Création et déploiement de modèles de machine learning à grande échelle

- Mise à l'échelle automatique

- équilibrage de charge

- Tolérance aux pannes

- Surveillance des performances du modèle

- Intégration à une variété de frameworks de machine learning

- Évolutif et fiable

Déploiement et exploitation des modèles : stratégies de déploiement, de surveillance et de maintenance.

True Foundry

Déployez des outils LLMops tels que des bases de données vectorielles, un serveur d'intégration, etc. sur votre propre infrastructure Kubernetes (EKS, AKS, GKE, on-Prem), notamment en déployant, en affinant, en suivant les instructions et en diffusant des modèles LLM open source avec une sécurité complète des données et une gestion optimale du GPU. Formez et lancez votre application LLM à l'échelle de la production avec les meilleures pratiques de génie logiciel. TrurFoundry permet un réglage précis 5 fois plus rapide et des déploiements 10 fois plus rapides pour les modèles LLM. TrueFounry met également l'accent sur la réduction des coûts (50 % de moins) et la sécurité des données pour les opérations de votre modèle linguistique étendu.

Exécuter : AI

Run:AI est une plateforme de gestion du cycle de vie de bout en bout des LLM, qui permet aux entreprises d'affiner, de concevoir rapidement et de déployer des modèles LLM en toute simplicité. Il est particulièrement adapté aux déploiements à grande échelle, car il peut évoluer pour gérer n'importe quel volume de trafic. La spécialité de Run:AI est sa capacité à automatiser l'ensemble du cycle de vie du machine learning, de la préparation des données au déploiement et à la surveillance des modèles. Cela permet d'économiser du temps et des efforts, et peut contribuer à garantir que les projets d'apprentissage automatique sont achevés dans les délais et dans les limites du budget

Zen ML

ZenML est une plateforme pour créer, gérer et déploiement de LLM. Il convient particulièrement aux équipes qui souhaitent automatiser leurs flux de travail LLMops. La spécialité de ZenML est sa facilité d'utilisation. Il fournit une interface glisser-déposer et une bibliothèque de composants prédéfinis, afin que les équipes puissent créer et déployer rapidement et facilement des pipelines de machine learning.

Iguazio

Iguazio met en œuvre les principaux aspects des LLMOP : automatisation du flux, traitement à grande échelle, mises à niveau continues, développement et déploiement rapides de pipelines et surveillance des modèles. Certaines étapes doivent toutefois être adaptées. Par exemple, les étapes d'intégration, de tokenisation et de nettoyage des données doivent être ajustées, pour n'en nommer que quelques-unes. Il convient particulièrement aux équipes qui ont besoin de déployer des applications de machine learning sur plusieurs clouds. La spécialité d'Iguazio est sa capacité à adapter les applications ML pour gérer n'importe quel volume de trafic. Il fournit également une plate-forme unique pour gérer tous les déploiements de machine learning d'une équipe, ce qui permet d'économiser du temps et des efforts.

N'importe quelle échelle

Anyscale's Aviary est une infrastructure de service LLM entièrement open source, gratuite et basée sur le cloud, conçue pour aider les développeurs à choisir et à déployer les bonnes technologies et la bonne approche pour leurs applications basées sur la technologie LLM. Anyscals Aviary permet d'évaluer en permanence les performances de plusieurs LLM par rapport à vos données et de sélectionner et de déployer celui qui convient à vos applications. La spécialité d'Anyscale est son service Kubernetes géré. Cela facilite la mise à l'échelle des charges de travail de machine learning et garantit qu'elles sont toujours disponibles.

Surveillance, ingénierie rapide et tests

Arize

Arize est une plateforme LLMops qui aide les équipes à créer, déployer et gérer des LLM pour diverses tâches, notamment la compréhension du langage naturel, la génération de langage naturel et la réponse aux questions. Il fournit diverses fonctionnalités pour la gestion des LLM, notamment le contrôle des versions, le suivi des expériences et le déploiement en production. La spécialité d'Arize est sa capacité à s'intégrer à diverses autres plateformes d'apprentissage automatique, afin que les équipes puissent utiliser leur infrastructure existante. Il fournit également diverses fonctionnalités pour surveiller les LLM, afin que les équipes puissent s'assurer qu'ils fonctionnent comme prévu.

Comète

Les outils LLMops de Comet sont conçus pour permettre aux utilisateurs de tirer parti des dernières avancées en matière de gestion rapide et de modèles de requêtes de Comet afin d'itérer plus rapidement, d'identifier les goulots d'étranglement en matière de performances et de visualiser l'état interne des chaînes de prompts. Comet fournit également des intégrations avec les principaux modèles et bibliothèques de langage de grande taille tels que LangChain et le SDK Python d'OpenAI. La spécialité de Comet est sa capacité à suivre des expériences sur de multiples plateformes d'apprentissage automatique. Il fournit également diverses fonctionnalités pour gérer les projets d'apprentissage automatique, afin que les équipes puissent suivre leurs progrès et collaborer efficacement.

couche rapide

PromptLayer est une plateforme permettant de créer et de déployer de grands modèles de langage (LLM) sous forme d'API. Il fournit diverses fonctionnalités pour créer des LLM, notamment une bibliothèque de composants prédéfinis et une interface glisser-déposer. La spécialité de PromptLayer est sa capacité à déployer des LLM sous forme d'API. Cela facilite l'utilisation des LLM dans diverses applications, telles que les chatbots et les systèmes de réponse aux questions.

Ouvrez Prompt

OpenPrompt est un framework open source permettant de créer et de déployer de grands modèles de langage (LLM). Il fournit diverses fonctionnalités pour créer des LLM, notamment une bibliothèque de composants prédéfinis et une interface de ligne de commande. La spécialité d'OpenPrompt est sa nature open source. Cela permet aux équipes de personnaliser facilement OpenPrompt en fonction de leurs besoins spécifiques.

Orchestre

Orquesta est une plateforme permettant d'orchestrer des pipelines d'apprentissage automatique. Il fournit diverses fonctionnalités pour orchestrer les pipelines, notamment une interface glisser-déposer et une bibliothèque de composants prédéfinis. La spécialité d'Orquesta est sa capacité à orchestrer des pipelines sur de multiples plateformes d'apprentissage automatique. Cela facilite le déploiement de pipelines d'apprentissage automatique en production.

Recherche vectorielle et bases de données

Pomme de pin

Pinceone est un moteur de recherche vectorielle conçu pour les grands modèles linguistiques (LLM). Il peut être utilisé pour rechercher des LLM à l'aide de leurs représentations vectorielles, ce qui permet de trouver facilement le LLM le plus similaire à une requête donnée. La spécialité de Pinceone est sa capacité à rechercher des LLM à l'aide de leurs représentations vectorielles. Par exemple, si vous souhaitez utiliser le modèle de langage GPT-3, vous pouvez utiliser Pinceone pour rechercher des LLM similaires à GPT-3. Pinceone renverrait alors une liste de LLM dont les représentations vectorielles sont similaires à celles de GPT-3. Cela vous permettra de trouver facilement le LLM qui correspond le mieux à vos besoins.

Zilliz

Zilliz est une base de données vectorielles conçue pour les LLM. Il peut être utilisé pour stocker et interroger les LLM, ainsi que pour suivre les performances des LLM au fil du temps. La spécialité de Zilliz est sa capacité à stocker et à interroger efficacement les LLM. Zilliz est un bon choix pour stocker et interroger des LLM, car il est conçu pour être efficace avec de grandes quantités de données. Cela signifie que vous pouvez stocker et interroger des LLM dans Zilliz sans avoir à vous soucier des problèmes de performances.

Milvus

Milvus est une base de données vectorielles conçue pour les applications d'apprentissage automatique à grande échelle. Il peut être utilisé pour stocker et interroger des vecteurs, ainsi que pour effectuer des recherches de similarité. La spécialité de Milvus est sa capacité à effectuer des recherches de similarités de manière efficace. Milvus est un bon choix pour effectuer des recherches de similarité sur de grands ensembles de données, car il est conçu pour être efficace avec de grandes quantités de données. Cela signifie que vous pouvez effectuer des recherches de similarité sur de grands ensembles de données dans Milvus sans avoir à vous soucier des problèmes de performances.

Élastique

Elastic est un moteur de recherche conçu pour diverses applications, notamment la recherche vectorielle. Il peut être utilisé pour rechercher des vecteurs par leurs représentations vectorielles, ainsi que pour effectuer une recherche de similarité. La spécialité d'Elastic réside dans sa flexibilité et son évolutivité. Elastic est un bon choix pour la recherche vectorielle car il est flexible et évolutif. Cela signifie que vous pouvez utiliser Elastic pour diverses applications de recherche vectorielle et adapter Elastic à vos besoins.

Vespa AI

Vespa AI est un moteur de recherche conçu pour les applications d'apprentissage automatique à grande échelle. Il peut être utilisé pour stocker et interroger des vecteurs, ainsi que pour effectuer une recherche de similarité. La spécialité de Vespa AI est sa capacité à effectuer des recherches de similarités de manière efficace à grande échelle. Vespa AI est un bon choix pour la recherche de similarité à grande échelle, car elle est conçue pour être efficace avec de grandes quantités de données. Cela signifie que vous pouvez effectuer une recherche de similarité sur de grands ensembles de données dans Vespa AI sans avoir à vous soucier des problèmes de performances.

Seachium AI

Searchium AI est un moteur de recherche conçu pour les applications de traitement du langage naturel. Il peut être utilisé pour rechercher des documents texte, ainsi que pour effectuer une recherche de similarité sur du texte. La spécialité de Searchium AI est sa capacité à effectuer des recherches de similarité sur des documents texte. Searchium AI est un bon choix pour les applications de traitement du langage naturel car il est conçu pour être efficace avec les données textuelles. Cela signifie que vous pouvez effectuer une recherche de similarité sur des documents texte dans Searchium AI sans avoir à vous soucier des problèmes de performances.

Chroma

Chroma est un moteur de recherche vectorielle conçu pour les applications de traitement du langage naturel. Il peut être utilisé pour rechercher des documents texte, ainsi que pour effectuer une recherche de similarité sur du texte. La spécialité de Chroma est sa capacité à effectuer des recherches de similarité sur des documents texte en temps réel. Chroma est un bon choix pour la recherche de similarité en temps réel, car il est conçu pour être efficace avec les données textuelles. Cela signifie que vous pouvez effectuer une recherche de similarité sur des documents texte dans Chroma sans avoir à vous soucier des problèmes de performances.

Rechercher

Vearch est une base de données vectorielle conçue pour les applications de traitement du langage naturel. Il peut être utilisé pour stocker et interroger des documents texte, ainsi que pour effectuer une recherche de similarité sur du texte. La spécialité de Vearch est sa capacité à stocker et à interroger efficacement des documents texte. Vearch est un bon choix pour stocker et interroger des documents texte car il est conçu pour être efficace avec les données textuelles. Cela signifie que vous pouvez stocker et interroger des documents texte dans Vearch sans avoir à vous soucier des problèmes de performances.

Qdrant

Qdrant est une base de données vectorielle conçue pour les applications d'apprentissage automatique à grande échelle. Il peut être utilisé pour stocker et interroger des vecteurs, ainsi que pour effectuer des recherches de similarité. La spécialité de Qdrant réside dans sa capacité à effectuer des recherches de similarités de manière efficace à grande échelle et dans sa prise en charge de l'informatique distribuée. Qdrant est un bon choix pour la recherche de similarité à grande échelle et l'informatique distribuée, car il est conçu pour être efficace avec de grandes quantités de données et pour prendre en charge le calcul distribué. Cela signifie que vous pouvez effectuer une recherche de similarité sur de grands ensembles de données dans Qdrant sans avoir à vous soucier des problèmes de performances,

Tendances futures en matière de LLMOP

Techniques de préservation de la confidentialité : concentrez-vous sur la protection de la confidentialité des données et sur l'adoption de l'apprentissage fédéré

Les grands modèles de langage étant de plus en plus répandus dans diverses applications, garantir la confidentialité des données est devenu une préoccupation majeure. Les tendances futures en matière de LLMOP mettront l'accent sur l'adoption de techniques préservant la confidentialité pour protéger les données sensibles. L'apprentissage fédéré est l'une de ces approches qui gagne du terrain, dans le cadre de laquelle les modèles sont entraînés directement sur les appareils des utilisateurs et seules les mises à jour agrégées des modèles sont partagées avec le serveur central. De cette façon, LLMOP peut atténuer les risques de confidentialité et créer des modèles plus fiables sans compromettre les données des utilisateurs.

Optimisation et compression des modèles : avancées visant à réduire les besoins en ressources

La nature gourmande en ressources des grands modèles de langage exige des efforts continus pour optimiser et compresser ces modèles. Les futurs LLMOP se concentreront sur le développement d'architectures et d'algorithmes plus efficaces qui maintiennent des performances élevées tout en réduisant les besoins en mémoire et en calcul. Des techniques telles que la quantification, la distillation et l'élagage joueront un rôle crucial dans la création de LLM légers mais puissants, plus déployables et évolutifs sur divers appareils et plateformes.

Contributions open source : collaboration et avancées dans les outils et bibliothèques LLMOPs

Les contributions open source continueront de stimuler l'innovation et la collaboration au sein de la communauté LLMops. Alors que les LLM deviennent un élément essentiel du paysage de l'IA, les chercheurs, les développeurs et les praticiens contribueront activement aux outils, bibliothèques et frameworks LLMoPS. Cet effort de collaboration accélérera les pratiques LLMOP, améliorera le réglage des modèles et favorisera le développement d'applications de pointe.

Interprétabilité et explicabilité : garantir la transparence de la prise de décisions relatives aux modèles

Avec l'adoption croissante des LLM dans des applications critiques, la demande d'interprétabilité et d'explicabilité augmente. Les futurs LLMOP se concentreront sur les techniques visant à rendre ces modèles plus transparents et compréhensibles. Des méthodes telles que la visualisation de l'attention, les cartes de saillance et les explications spécifiques aux modèles aideront à mieux comprendre comment les LLM prennent leurs décisions, renforçant ainsi la confiance des utilisateurs et permettant de mieux déboguer et améliorer les modèles.

Intégration avec d'autres technologies d'IA : extension des LLMOP à des systèmes d'IA plus larges

Les grands modèles de langage ne sont qu'un des composants des systèmes d'IA complexes. À l'avenir, les LLMOP iront au-delà du réglage et du déploiement de LLM individuels pour englober une intégration transparente avec d'autres technologies d'IA. Cette intégration facilitera les systèmes d'IA multimodaux, combinant des capacités de traitement de la vision, de la parole et du langage pour créer des solutions d'IA plus holistiques et plus puissantes.

Conclusion

Récapitulation

L'évolution des grands modèles de langage a révolutionné le traitement du langage naturel et a permis des applications d'IA révolutionnaires. Cependant, leur gestion efficace nécessite des pratiques et des processus spécialisés qui relèvent de la LLMOP.

LLMoPS joue un rôle crucial pour relever les défis liés au développement, au déploiement et à la maintenance des LLM. En adhérant aux meilleures pratiques, en adoptant des outils et des plateformes spécialisés et en tirant parti de techniques avancées, les équipes LLMoPS peuvent surmonter les défis informatiques, garantir la qualité des données et optimiser les performances des modèles.

Développements en cours et potentiel des LLMOP à l'avenir

Alors que le domaine de l'IA continue de progresser rapidement, LLMOPs restera à la pointe de l'innovation. Les tendances futures en matière de LLMOP se concentreront sur les techniques de préservation de la confidentialité, l'optimisation des modèles et l'explicabilité pour répondre aux préoccupations éthiques et aux exigences réglementaires. Les contributions open source favoriseront la collaboration et le partage des connaissances au sein de la communauté LLMoPS, favorisant ainsi le développement d'outils et de cadres plus robustes.

De plus, l'intégration de grands modèles de langage avec d'autres technologies d'IA entraînera des avancées intéressantes, permettant la mise en place de systèmes d'IA multimodaux dotés de capacités de transformation. Au fur et à mesure de son évolution, LLMops jouera un rôle essentiel dans l'exploitation du plein potentiel des grands modèles de langage, en les rendant plus accessibles, plus efficaces et plus responsables dans diverses applications du monde réel.

En conclusion, LLMops est l'épine dorsale d'une gestion réussie des grands modèles linguistiques, garantissant leur utilisation responsable et libérant leur pouvoir pour façonner l'avenir de l'IA. Alors que l'IA continue de progresser, LLMOPs ouvrira la voie à des applications d'IA basées sur le langage plus efficaces, fiables et transformatrices.

Discutez avec nous

True Foundry est un PaaS de déploiement de machine learning sur Kubernetes qui permet aux équipes de ML de déployer et de surveiller des modèles en 15 minutes avec une fiabilité et une évolutivité à 100 % et avec la possibilité de revenir en arrière en quelques secondes. Si vous essayez d'utiliser les MLOps dans votre organisation, nous serions ravis de discuter et d'échanger des notes.

Passez un ☕️ avec nous

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)