Présentation de Kubernetes et des MLOps : défis et avantages

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Bienvenue dans cette série sur la création et la configuration d'une infrastructure d'apprentissage automatique évolutive dans un environnement Kubernetes. Dans cette série, nous aborderons divers sujets liés au développement, au déploiement et à la gestion de modèles d'apprentissage automatique sur un cluster Kubernetes.

Infrastructure d'apprentissage automatique évolutive : meilleures pratiques

Les opérations d'apprentissage automatique, communément appelées MLOps, font référence aux pratiques et techniques utilisées pour gérer le cycle de vie des modèles d'apprentissage automatique. L'infrastructure évolutive des opérations d'apprentissage automatique permet aux entreprises de créer, de déployer et de gérer des modèles à grande échelle, augmentant ainsi le retour sur investissement (ROI) de leurs efforts en matière de science des données.

Les avantages d'une infrastructure MLOps évolutive sont notamment les suivants :

- Délai de mise sur le marché plus rapide pour les modèles d'apprentissage automatique

- Évolutivité et flexibilité améliorées pour les flux de travail d'apprentissage automatique

- Déploiements de modèles cohérents et reproductibles

- Collaboration améliorée entre les data scientists et les équipes des opérations informatiques

- Précision et fiabilité du modèle améliorées

Airbnb a investi massivement dans la mise en place d'une pratique MLOps évolutive dès le début. Elle a utilisé des modèles d'apprentissage automatique pour améliorer ses algorithmes de classement des recherches via la recherche basée sur les données des utilisateurs, ce qui s'est traduit par une meilleure expérience de recherche et une augmentation estimée à 10 % des réservations. Airbnb a également utilisé des modèles d'apprentissage automatique pour fournir des recommandations personnalisées à ses utilisateurs, ce qui a contribué à améliorer l'expérience et l'engagement des utilisateurs !

Défis liés à la configuration de l'infrastructure MLOps

Les organisations qui s'appuient sur des machines virtuelles (VM), qu'il s'agisse d'AWS, de Google Cloud Platform (GCP) ou de Microsoft Azure, pour configurer leur infrastructure de formation et de déploiement de ML peuvent être confrontées à plusieurs défis :

- Évolutivité: les options d'évolutivité des machines virtuelles sont limitées et les entreprises peuvent avoir besoin de configurer manuellement des instances supplémentaires pour gérer la charge, ce qui entraîne des problèmes de performances et une augmentation des coûts.

- Gestion des ressources: les machines virtuelles nécessitent une configuration manuelle pour l'allocation des ressources, et les organisations peuvent avoir besoin d'estimer les ressources requises pour leurs charges de travail de machine learning. Cela peut entraîner une sous-utilisation des ressources ou des contraintes de ressources, ce qui a un impact sur les performances des modèles de machine learning.

- Contrôle de version: La gestion de différentes versions de modèles de machine learning peut s'avérer difficile lors de l'utilisation de machines virtuelles. Les organisations peuvent avoir besoin de gérer manuellement différentes versions du modèle, ce qui peut prendre beaucoup de temps et être source d'erreurs.

- Sécurité: les machines virtuelles peuvent présenter des failles de sécurité et les entreprises peuvent avoir besoin de configurer manuellement des fonctionnalités de sécurité telles que des pare-feux et des systèmes de détection d'intrusion pour protéger leurs modèles et leurs données de machine learning.

- Surveillance et journalisation: La surveillance des performances des modèles de machine learning et de l'infrastructure sous-jacente dans une infrastructure basée sur des machines virtuelles peut s'avérer difficile et il peut devenir difficile de suivre l'état des composants individuels, d'identifier les goulots d'étranglement et de résoudre les problèmes.

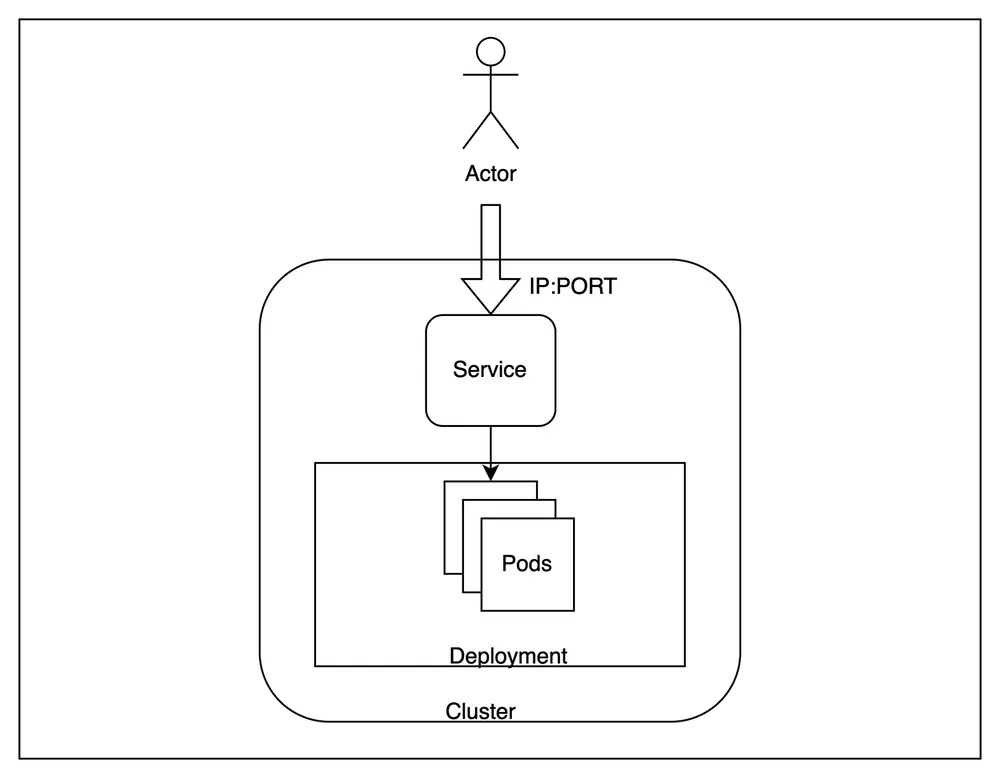

Kubernetes dans MLOps

Kubernetes est une plateforme d'orchestration de conteneurs open source populaire qui automatise le déploiement, la mise à l'échelle et la gestion des applications conteneurisées. Il fournit une API unifiée et une configuration déclarative qui simplifient la gestion des charges de travail conteneurisées, permettant aux entreprises de créer une infrastructure évolutive, résiliente et portable pour la formation et le déploiement de modèles ML. Kubernetes offre plusieurs avantages par rapport aux machines virtuelles brutes, notamment une meilleure utilisation des ressources, un contrôle de version simplifié et une évolutivité efficace. De plus, Kubernetes fournit des fonctionnalités de sécurité intégrées et des fonctionnalités de surveillance et de journalisation centralisées, qui peuvent aider les entreprises à garantir la sécurité et la fiabilité de leur infrastructure de machine learning. Kubernetes est un excellent choix pour les organisations qui souhaitent créer des pipelines d'apprentissage automatique évolutifs à long terme.

Kubernetes géré sur AWS, GCP, Azure

Les fournisseurs de cloud (AWS, GCP et Azure) proposent des services Kubernetes gérés (EKS, GKE et AKS respectivement) qui permettent aux entreprises de configurer et de gérer facilement des clusters Kubernetes, éliminant ainsi les frais opérationnels associés à l'exécution et à la mise à l'échelle de Kubernetes. En outre, les fournisseurs de cloud proposent des intégrations avec d'autres services cloud tels que le stockage, les bases de données et la mise en réseau, ce qui peut simplifier davantage le déploiement et la gestion des charges de travail de machine learning sur Kubernetes. En adoptant Kubernetes directement ou par le biais d'un service géré, les entreprises peuvent créer un pipeline MLOps flexible et évolutif capable de gérer leurs charges de travail de machine learning croissantes et d'accélérer la mise sur le marché de leurs modèles de machine learning.

Avantages de Kubernetes pour les MLOps

Examinons plus en détail les avantages de l'utilisation de Kubernetes pour les pipelines de formation et de déploiement du machine learning.

- Gestion des ressources: Kubernetes permet aux entreprises de provisionner et de gérer facilement les ressources nécessaires à l'exécution des tâches de formation en machine learning et au déploiement de modèles. Il peut automatiquement augmenter et diminuer les ressources en fonction de la charge de travail, ce qui garantit une utilisation efficace des ressources et réduit les coûts.

- Déploiement simplifié grâce aux meilleures pratiques SRE: Kubernetes fournit une API unifiée et une configuration déclarative qui simplifient le déploiement de modèles de machine learning. Les entreprises peuvent facilement déployer des modèles de manière évolutive et résiliente, grâce à la prise en charge intégrée des mises à jour continues et des déploiements Canary, ce qui peut contribuer à minimiser les temps d'arrêt et à améliorer la fiabilité.

- Flexibilité et portabilité: Kubernetes fournit une infrastructure flexible et portable capable de prendre en charge différents scénarios de déploiement, notamment des environnements sur site, cloud et hybrides. Cela permet aux entreprises de déplacer facilement leurs charges de travail de machine learning dans différents environnements et d'éviter de se retrouver dans une situation de dépendance vis-à-vis des fournisseurs.

- Meilleure utilisation des coûts et des ressources: Kubernetes permet aux entreprises d'utiliser efficacement les ressources, en regroupant plusieurs charges de travail de machine learning sur un seul nœud, ce qui contribue à minimiser les coûts d'infrastructure. De plus, Kubernetes peut tirer parti d'autres matériels spécialisés pour accélérer la formation et l'inférence en machine learning, ce qui peut encore améliorer les performances.

Exemple de cas d'utilisation 1 : AirBnB

Airbnb, la place de marché en ligne qui permet aux gens de louer leur maison ou leur appartement à des voyageurs. Avec des millions d'utilisateurs et une grande quantité de données à analyser, Airbnb avait besoin d'une infrastructure d'apprentissage automatique robuste et évolutive pour analyser le comportement des utilisateurs, améliorer le classement dans les recherches et fournir des recommandations personnalisées aux utilisateurs.

Pour y parvenir, Airbnb a investi dans la création d'une infrastructure MLOps sur Kubernetes, ce qui a permis à son équipe de science des données de développer et de déployer des modèles d'apprentissage automatique à grande échelle. Grâce à Kubernetes, Airbnb a pu conteneuriser ses modèles et les déployer sous forme de microservices, ce qui a facilité la gestion et la mise à l'échelle de son infrastructure en fonction de l'évolution de ses besoins. Airbnb a ainsi pu améliorer son classement dans les recherches et fournir des recommandations plus pertinentes à ses utilisateurs, ce qui a entraîné une augmentation des réservations et des revenus. En outre, l'entreprise a pu améliorer l'efficacité de ses flux de travail liés à la science des données, permettant à son équipe de se concentrer sur le développement de modèles d'apprentissage automatique plus avancés.

Exemple de cas d'utilisation 2 : Lyft

Lyft, un important fournisseur de transport en tant que SaaS (TaaS), a initialement construit son infrastructure ML sur AWS en utilisant une combinaison d'instances EC2 et de conteneurs Docker. Ils ont utilisé des instances EC2 pour provisionner des machines virtuelles dotées de différents niveaux de ressources CPU, mémoire et GPU, en fonction des exigences spécifiques en matière de charge de travail ML. Ils ont également utilisé des conteneurs Docker pour empaqueter et déployer leurs charges de travail de machine learning et garantir la cohérence entre les différents environnements.

Cependant, à mesure que les charges de travail de machine learning de Lyft gagnaient en complexité et en ampleur, l'entreprise a dû faire face à plusieurs défis, notamment la cohérence entre les différents environnements et équipes, et a décidé de migrer son infrastructure ML vers une infrastructure basée sur Kubernetes en utilisant KubeFlow dans un premier temps, puis une plateforme interne. En migrant vers une infrastructure basée sur Kubernetes, Lyft a pu créer une infrastructure ML plus efficace et plus évolutive, ce qui l'a aidée à accélérer ses pipelines de développement et de déploiement de ML. En outre, ils ont pu tirer parti des avantages de Kubernetes, tels que la mise à l'échelle automatique et l'utilisation efficace des ressources, pour optimiser leurs charges de travail de machine learning et réduire les coûts d'infrastructure. Ils ont utilisé EKS d'AWS comme service Kubernetes géré !

Dans l'ensemble, l'investissement dans l'infrastructure MLOps sur Kubernetes a permis à Airbnb et Lyft de réaliser des gains de productivité significatifs et d'améliorer leurs résultats, démontrant ainsi la valeur que les MLOps évolutifs associés à Kubernetes peuvent apporter aux organisations qui cherchent à tirer parti de l'apprentissage automatique à grande échelle.

Défis liés à Kubernetes dans les MLOps

Malgré ses avantages, l'utilisation de Kubernetes pour l'infrastructure de machine learning comporte son lot de défis et de complexités :

- Gestion des ressources lorsqu'il s'agit de grands ensembles de données ou de modèles complexes : en raison des exigences liées à de grandes quantités de ressources informatiques, notamment les GPU, la mémoire et le stockage, il peut être difficile de garantir une allocation efficace sans entrer en conflit avec les autres charges de travail exécutées sur le cluster Kubernetes.

- Intégration de différents outils : les organisations peuvent utiliser différents outils de machine learning tels que TensorFlow, PyTorch et scikit-learn, chacun ayant ses propres exigences et dépendances. L'intégration de ces outils et de ces dépendances à l'infrastructure Kubernetes peut être complexe et prendre beaucoup de temps.

- Problèmes de sécurité liés aux modèles d'apprentissage automatique : il est essentiel de s'assurer que les modèles de machine learning sont protégés contre les accès non autorisés ou les attaques. Kubernetes propose diverses fonctionnalités de sécurité, telles que le contrôle d'accès basé sur les rôles (RBAC), les politiques réseau et l'isolation des conteneurs, mais les configurer correctement peut s'avérer difficile lorsqu'il s'agit de données sensibles telles que des informations personnelles ou des dossiers financiers.

- Surveillance et journalisation dans un environnement distribué : la surveillance des performances des modèles ML et de l'infrastructure sous-jacente est essentielle pour garantir des performances optimales. Cependant, dans un environnement Kubernetes distribué, il peut être difficile de suivre l'état de chaque composant, d'identifier les goulots d'étranglement et de résoudre les problèmes. Les organisations doivent mettre en place des outils de surveillance et de journalisation qui fournissent une visibilité en temps réel de leurs flux de travail d'apprentissage automatique et de leur infrastructure Kubernetes.

Malgré les défis, en suivant les meilleures pratiques et en tirant parti des capacités de Kubernetes, les organisations peuvent les surmonter et créer une infrastructure MLOps évolutive, sécurisée et fiable.

Conclusion

Kubernetes for Machine Learning offre de nombreux avantages aux entreprises qui cherchent à optimiser leurs flux de travail d'apprentissage automatique. Bien que la configuration et la gestion de l'infrastructure MLOps sur Kubernetes présentent des défis, tels que la gestion des ressources, la sécurité et la surveillance, une compréhension approfondie de Kubernetes et des meilleures pratiques peut aider à surmonter ces obstacles.

Dans cette série de cours sur le machine learning sur Kubernetes, nous essaierons de couvrir divers sujets liés à la création et à la configuration d'une infrastructure de machine learning dans un environnement Kubernetes, notamment les suivants :

- Conteneurisation et orchestration à l'aide de Kubernetes

- Formation distribuée sur Kubernetes

- Service et déploiement de modèles basés sur Kubernetes

- Infrastructure ML basée sur GPU sur Kubernetes

- Pipeline CI/CD Kubernetes

- Supervision de Kubernetes pour les MLOps

et plus encore..

En adoptant ces meilleures pratiques et en exploitant la puissance de Kubernetes, les entreprises peuvent faire évoluer et déployer des modèles d'apprentissage automatique avec cohérence, fiabilité et sécurité. Cela permettrait à son tour d'accélérer la mise sur le marché, d'améliorer la collaboration entre les équipes chargées de la science des données et des opérations informatiques, et d'améliorer le retour sur investissement de leurs investissements dans la science des données.

Découvrez comment Gong a créé une infrastructure de recherche évolutive sur l'apprentissage automatique sur Kubernetes

True Foundry est un PaaS de déploiement de machine learning sur Kubernetes destiné à accélérer les flux de travail des développeurs tout en leur offrant une flexibilité totale dans les tests et le déploiement de modèles, tout en garantissant une sécurité et un contrôle complets à l'équipe Infra. Grâce à notre plateforme, nous permettons aux équipes de machine learning de déployer et surveiller des modèles en 15 minutes avec une fiabilité à 100 %, une évolutivité et la possibilité de revenir en arrière en quelques secondes, ce qui leur permet de réduire les coûts et de mettre les modèles en production plus rapidement, ce qui permet de réaliser une véritable valeur commerciale.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)