Passerelle IA sécurisée avec MCP centralisé pour les entreprises

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Les modèles en langage large peuvent désormais raisonner, coder et générer avec une fluidité époustouflante. Pourtant, ils restent déconnectés des données, des flux de travail et des API qui rendent votre entreprise unique. Le résultat : des modèles puissants qui nécessitent encore des humains pour copier-coller les données entre les outils.

Nous sommes entrés dans une ère de IA agentique où les agents alimentés par LLM peuvent appeler des outils de manière autonome, déclencher des incidents ou mettre à jour les CRM. Mais pour agir de manière sûre et fiable, les agents ont besoin d'un moyen universel de découvrir et d'invoquer les API d'entreprise.

Ce port universel est Protocole de contexte modèle (MCP). Dans cet article, nous expliquons le MCP, son importance pour les entreprises et la nouvelle version de TrueFoundry Passerelle IA avec support MCP transforme la vision en réalité de la production.

Nous avons récemment organisé un webinaire approfondi sur l'utilisation du Model Context Protocol (MCP) dans les environnements d'entreprise.

Qu'est-ce que le Model Context Protocol (MCP) ?

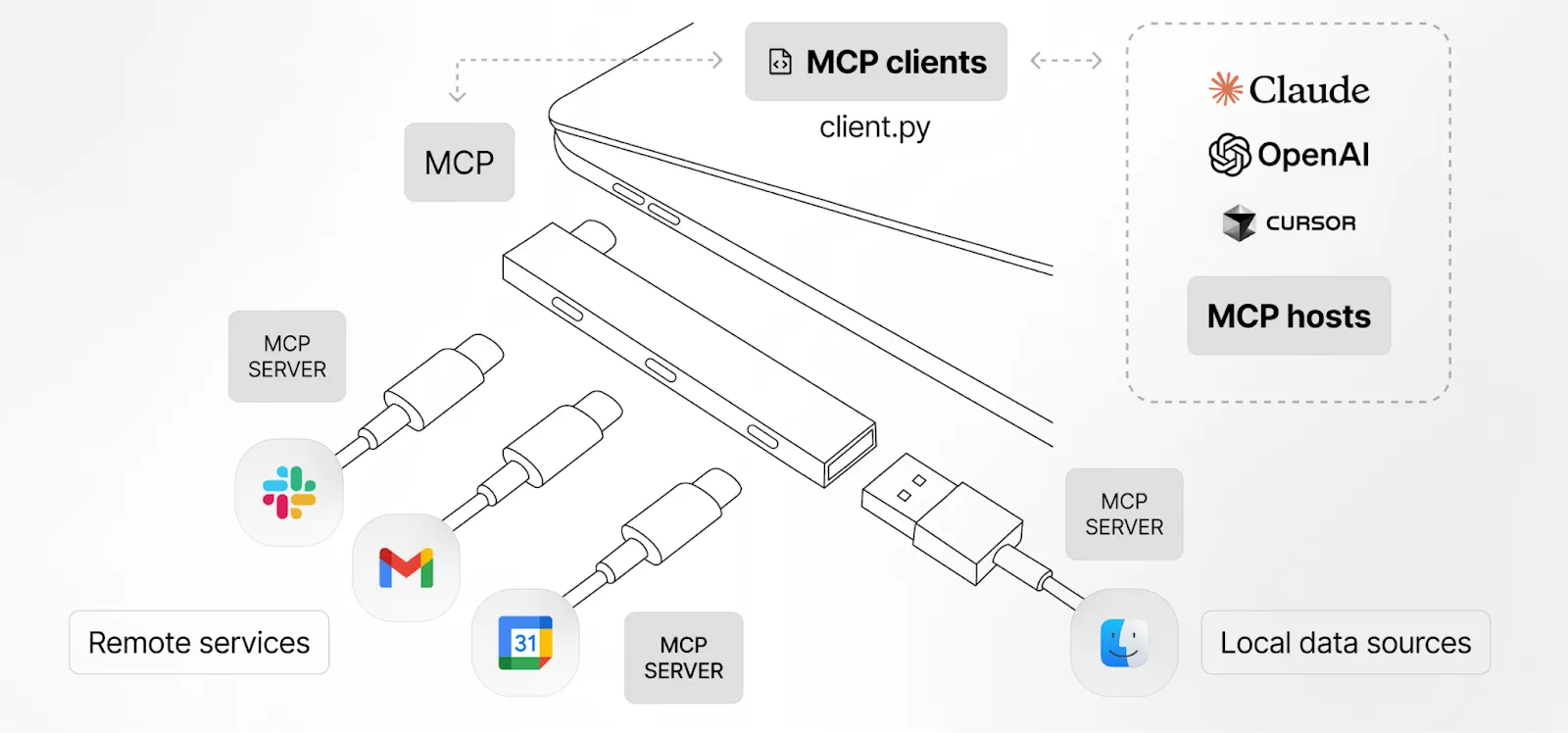

MCP est un norme ouverte qui permet aux logiciels d'exposer la surface de leur API selon un schéma adapté au LLM. Considérez-le comme un port USB‑C pour les applications d'IA. Un serveur MCP publie des définitions d'outils, des exigences d'authentification et des descriptions d'utilisation qu'un LLM peut lire lors de l'exécution.

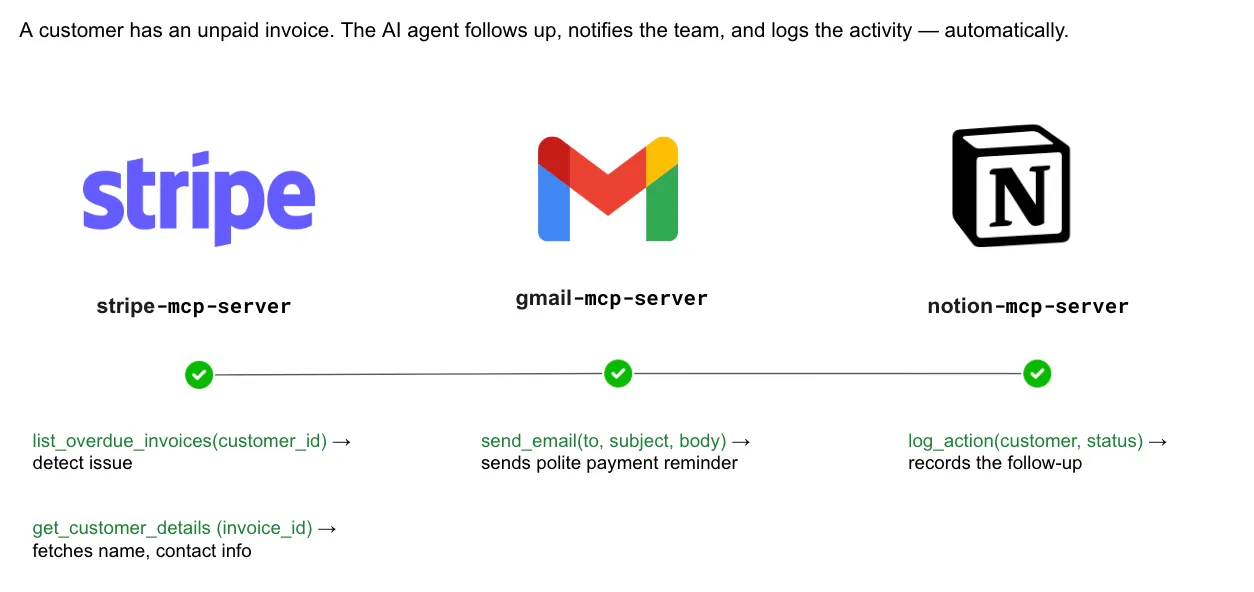

Avec MCP, vous pouvez créer un agent de facturation. Lorsque la facture d'un client dépasse sa date d'échéance, l'agent utilise le flux de travail suivant :

- Stripe MCP : liste_factures_impayées pour identifier les factures impayées, puis obtenir_des_informations sur le client pour extraire le nom et les coordonnées du client.

- Gmail MCP : Fabrique et envoie un e-mail de rappel courtois via envoi_e-mail.

- Notion MCP : Enregistre la sensibilisation avec journal_action, afin que les équipes des finances et des comptes disposent d'une piste d'audit à jour.

L'ensemble du flux de travail s'exécute de manière autonome (détection, notification et enregistrement), éliminant le changement de contexte manuel et la saisie de données. Comme chaque étape est encapsulée dans un appel MCP réutilisable, la même architecture s'étend de manière fluide à un plus grand nombre d'opérations financières, du renouvellement des abonnements aux décaissements des fournisseurs, fournissant une couche d'automatisation cohérente.

Quels sont les avantages d'une passerelle IA sécurisée avec MCP ?

Alors que les organisations intègrent de plus en plus l'IA dans leurs opérations quotidiennes, la sécurisation des données et le contrôle des interactions avec l'IA sont devenus essentiels. Une passerelle IA sécurisée agit comme une couche de protection qui garantit une utilisation sûre, conforme et efficace de l'IA.

- Protection des données améliorée: protège les informations sensibles en chiffrant les données et en empêchant tout accès non autorisé pendant le traitement de l'IA.

- Contrôle de sécurité centralisé : Agit comme un point de contrôle unique pour surveiller, filtrer et gérer toutes les demandes et réponses liées à l'IA.

- Assistance en matière de conformité : Aide les organisations à respecter les réglementations telles que le RGPD et les lois sur la protection des données en contrôlant la manière dont les données sont utilisées et stockées.

- Prévention des menaces : Détecte et bloque les entrées malveillantes, les injections rapides et les sorties nuisibles avant qu'elles n'atteignent les systèmes d'IA ou les utilisateurs.

- Gestion des accès : Active des autorisations basées sur les rôles, garantissant que seuls les utilisateurs autorisés peuvent interagir avec les outils et les données d'IA.

- Audit et journalisation: tient à jour des journaux détaillés des interactions avec l'IA à des fins de transparence, de responsabilité et d'audits de sécurité.

- Risque réduit de fuite de données: empêche la divulgation d'informations commerciales confidentielles via des invites ou des sorties d'IA.

- Surveillance améliorée des performances: Suit l'utilisation de l'IA, la qualité de réponse et les performances du système afin d'optimiser les opérations.

- Contrôle des coûts : Surveille l'utilisation des API et prévient les abus, aidant ainsi les organisations à gérer efficacement les dépenses liées à l'IA.

- Sécurité évolutive: fournit une protection cohérente à mesure que l'utilisation de l'IA augmente au sein des équipes, des applications et des sites.

Défis opérationnels liés au MCP à grande échelle

Le déploiement d'un serveur de démonstration est facile, mais le déploiement de MCP à l'échelle de l'organisation ne l'est pas. Les obstacles les plus courants sont les suivants :

- Hébergement et cycle de vie — Les serveurs personnalisés doivent fonctionner à proximité de données sensibles, parfois à distance.

- Découverte centrale — Les développeurs ont besoin d'un registre de serveurs MCP approuvés.

- Contrôle d'accès - Définissez quelles équipes/utilisateurs/applications peuvent accéder à quels serveurs MCP ou à quel registre d'outils

- Authentification et autorisation précise — Il faut s'assurer que l'utilisateur qui appelle le serveur MCP ne peut accéder qu'aux données auxquelles il a accès

- Rambardes — Les outils destructeurs (par exemple Delete_Customer) doivent nécessiter une approbation humaine.

- Observabilité et contrôle des coûts — Sans traçage, les agents en fuite peuvent spammer des API ou accumuler des factures.

Gouvernance et contrôle spécifiques au MCP

Alors que les organisations adoptent le protocole MCP (Model Context Protocol) pour connecter les modèles d'IA aux outils, aux API et aux données d'entreprise, une gouvernance solide est essentielle pour garantir des interactions sécurisées, conformes et bien gérées. Les contrôles spécifiques au MCP aident à empêcher les accès non autorisés, à protéger les informations sensibles et à maintenir l'intégrité opérationnelle tout en favorisant l'innovation en matière d'IA.

L'application centralisée des politiques permet aux organisations de définir des règles claires sur la manière dont les systèmes d'IA accèdent aux outils et aux données. Associé à un contrôle d'accès granulaire, les administrateurs peuvent restreindre les autorisations en fonction des rôles, des utilisateurs ou de modèles spécifiques, réduisant ainsi les risques de mauvaise utilisation. Les autorisations au niveau du contexte renforcent encore la sécurité en garantissant que seules les données nécessaires sont partagées, ce qui favorise la minimisation des données et la protection de la confidentialité.

Les pistes d'audit et la surveillance en temps réel assurent la transparence en suivant l'utilisation des outils, l'accès aux données et les activités inhabituelles. Ces informations aident les équipes à détecter les menaces à un stade précoce et à maintenir leur responsabilité. Le contrôle des versions et la gestion de la configuration jouent également un rôle clé en évitant les erreurs de configuration et en garantissant la sécurité et la cohérence des intégrations MCP.

Enfin, la gouvernance MCP favorise la conformité aux exigences réglementaires et permet une réponse rapide aux incidents. En cas d'activité suspecte, les terminaux MCP concernés peuvent être isolés rapidement. Avec le bon cadre de gouvernance, les entreprises peuvent faire évoluer l'adoption du MCP en toute confiance tout en protégeant les données, les systèmes et les utilisateurs.

Passerelle IA compatible MCP de TrueFoundry

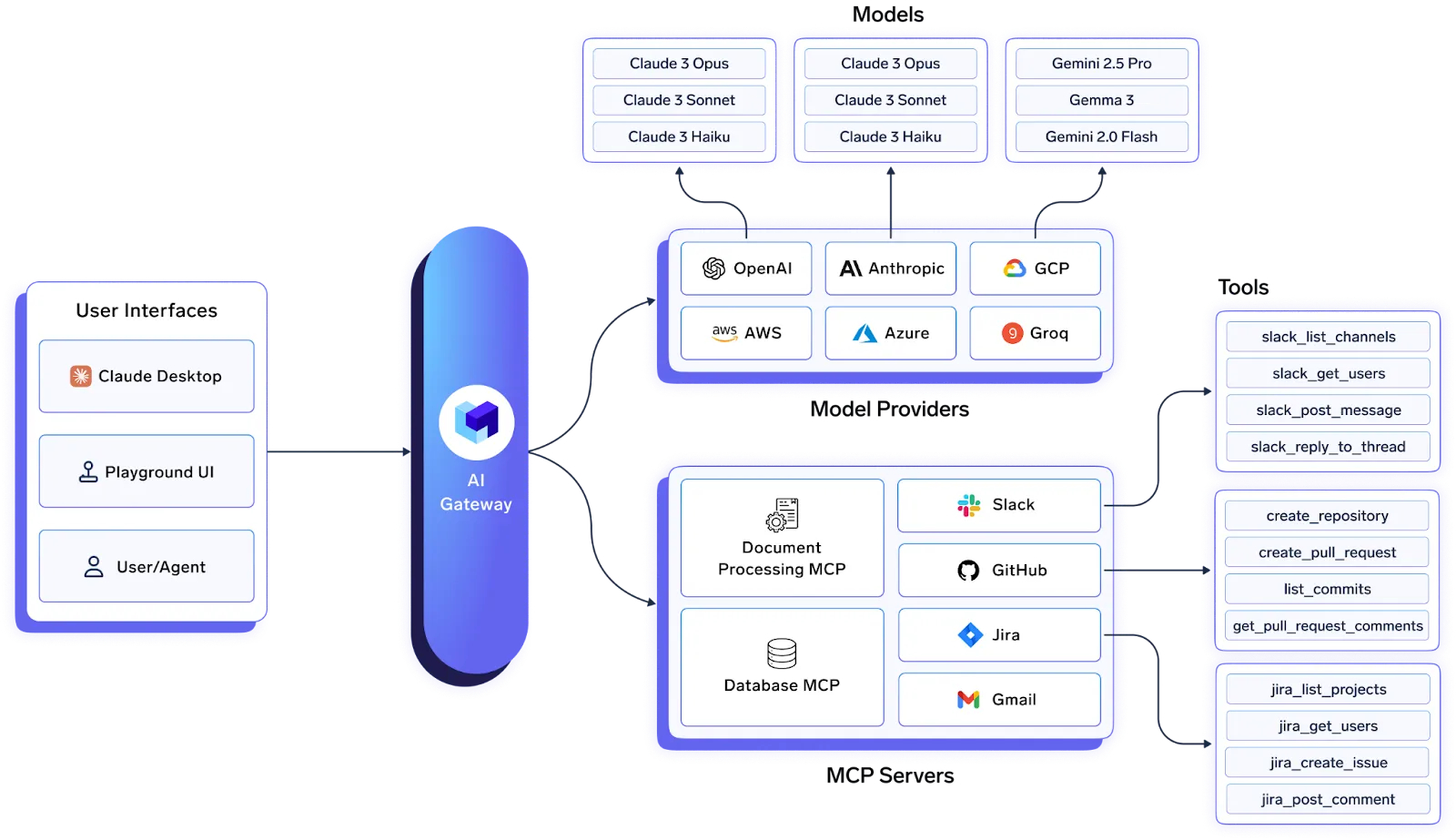

TrueFoundry Passerelle IA a déjà fourni un proxy unifié à faible latence pour plusieurs fournisseurs de LLM. Aujourd'hui, nous l'étendons pour en faire le centre Plan de contrôle MCP au sein de votre VPC, sur n'importe quel cloud ou sur site.

- Enregistrez des serveurs MCP publics ou auto-hébergés.

- Appliquez l'authentification basée sur OAuth afin que chaque appel d'outil porte la véritable identité de l'utilisateur.

- Appliquez des garde-fous, des limites de débit et une mise en cache sémantique à l'échelle de l'organisation.

- Suivez chaque étape de l'agent à des fins d'audit et d'attribution des coûts.

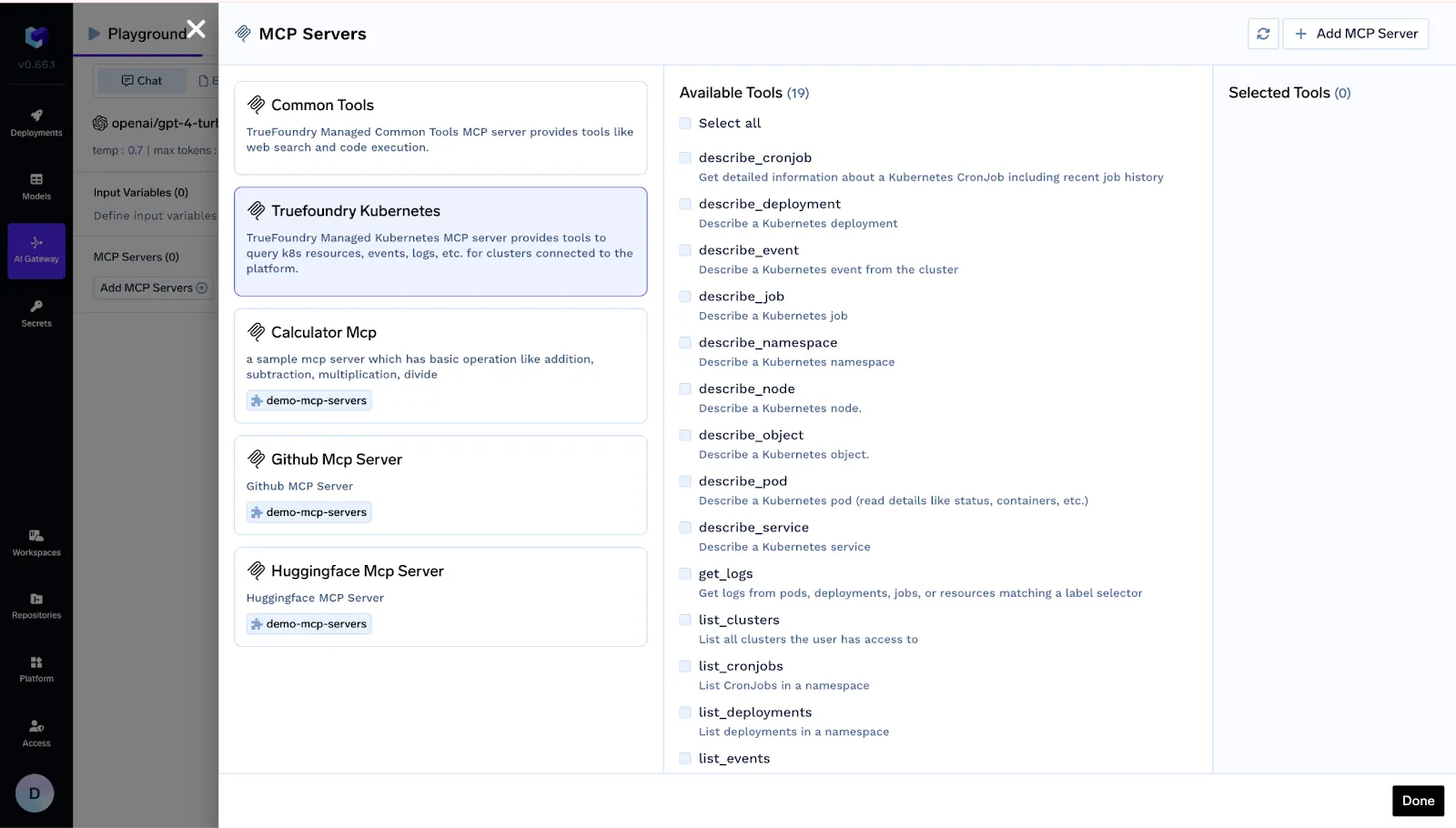

Approfondissement : fonctionnalités clés des passerelles

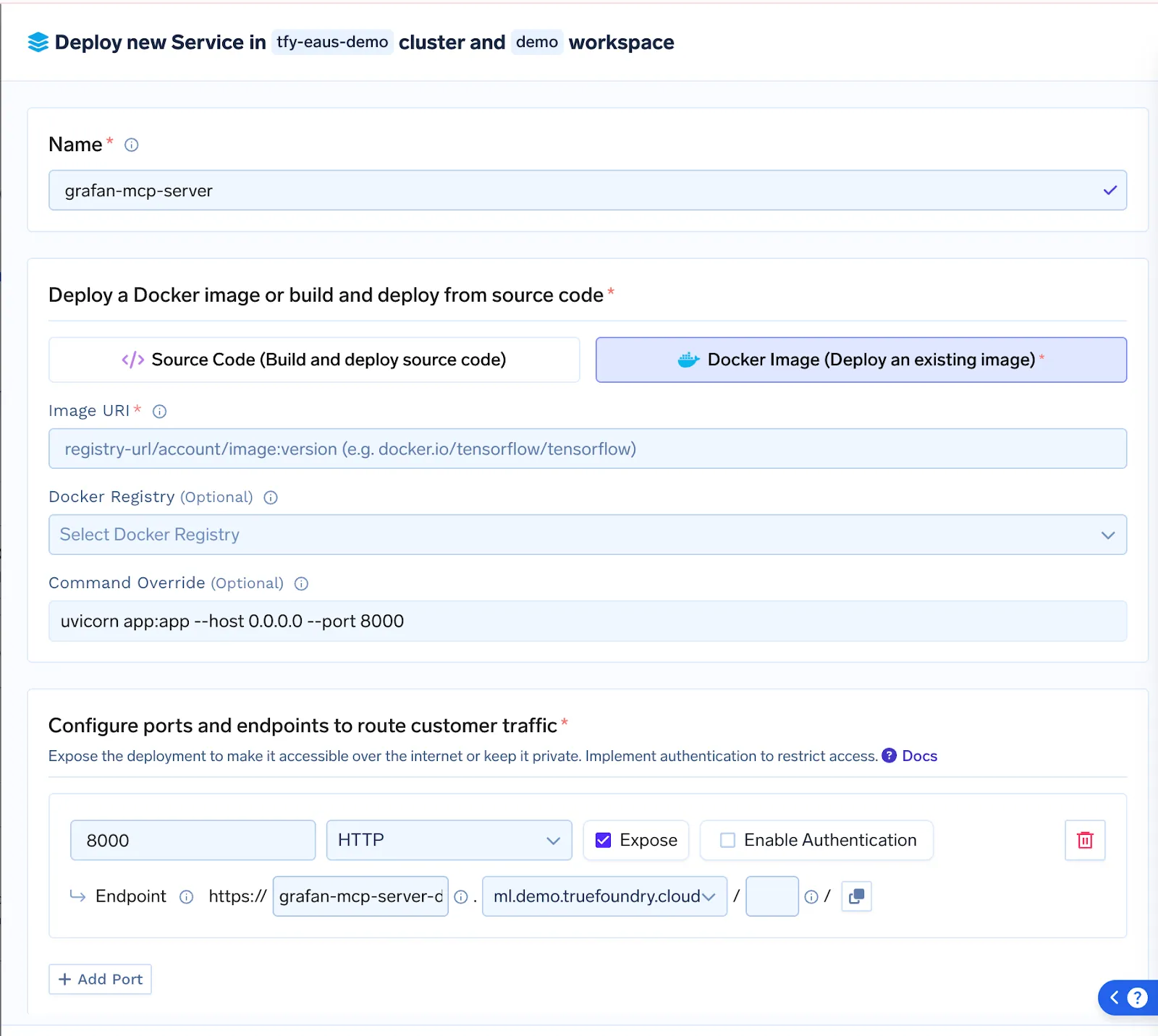

Déploiement aisé de serveurs MCP : Expédiez les serveurs en tant que source ou Docker ; Gateway gère la création, le déploiement et la mise à l'échelle automatique des conteneurs sans interruption de service.

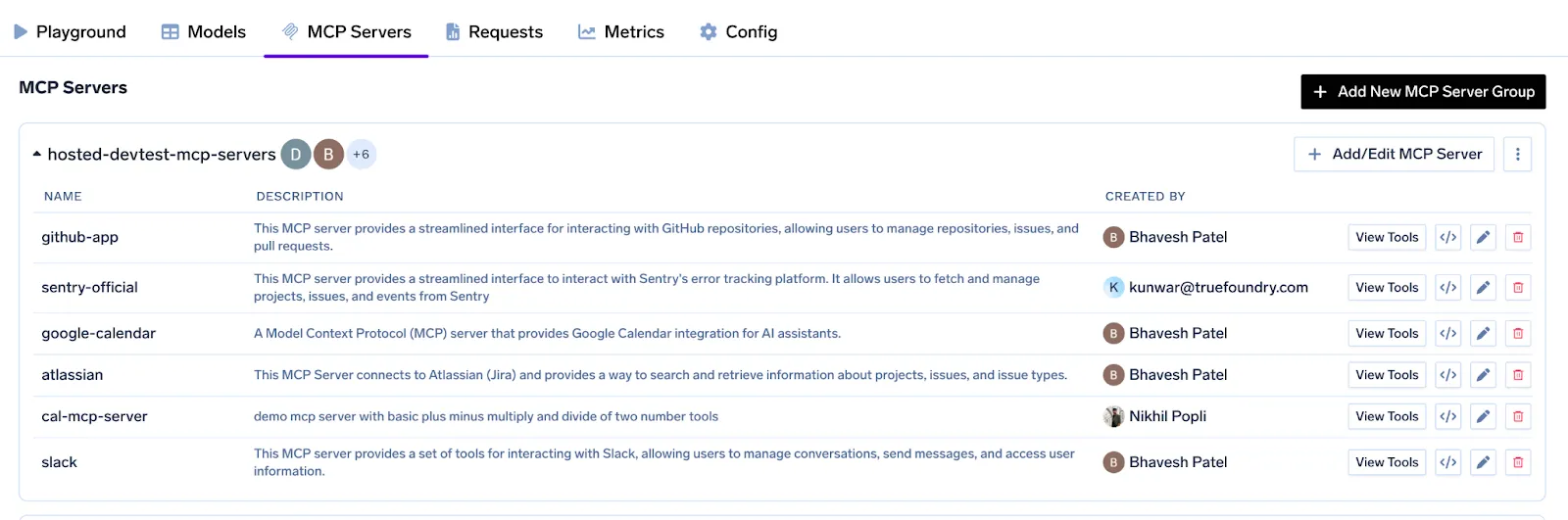

Registre central et authentification basée sur OAuth : Un seul volet répertorie Slack, GitHub, Salesforce, ou votre MCP Postgres personnalisé, avec une logique d'actualisation des jetons et des étendues par utilisateur.

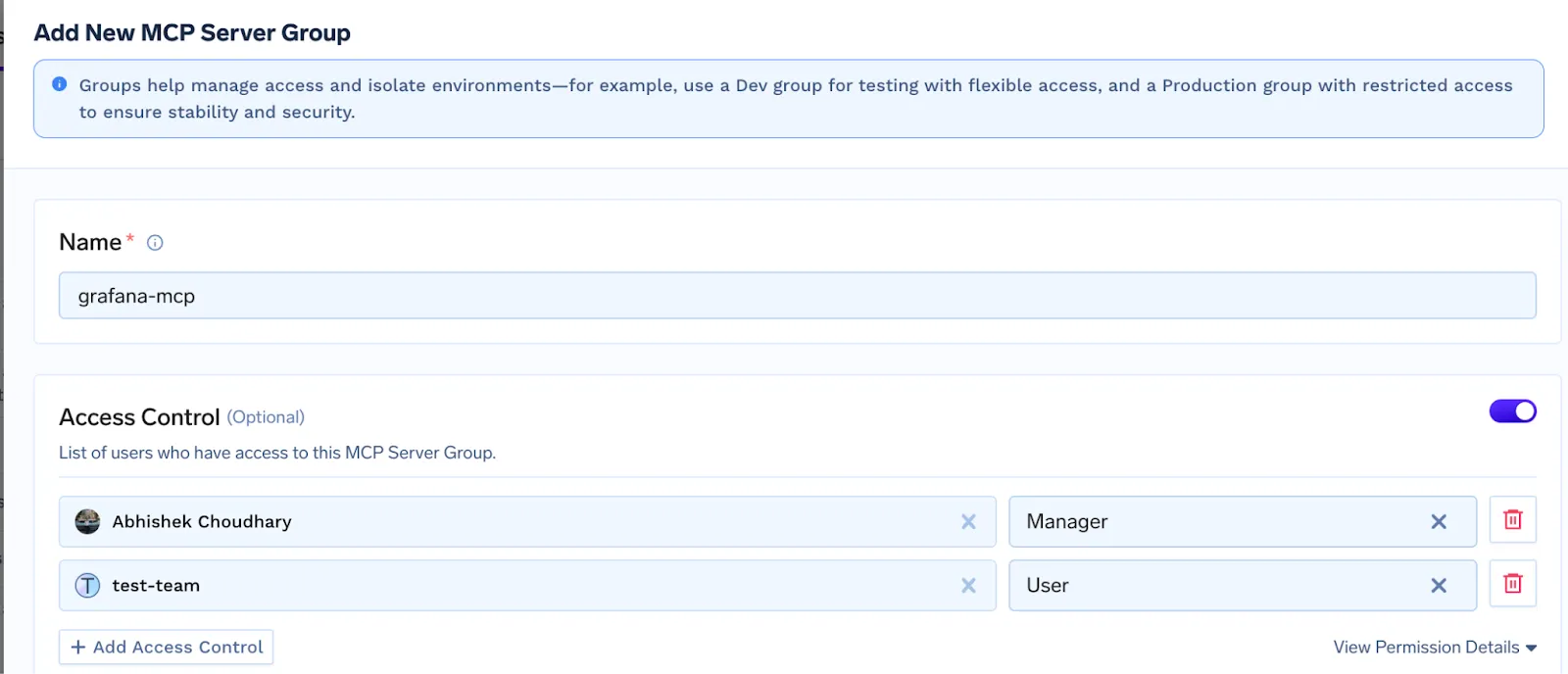

Contrôle d'accès précis : Attribuez des serveurs (ou des outils individuels) à des équipes, à des comptes de service ou à des environnements spécifiques afin qu'un agent de préparation ne puisse pas toucher aux données de production.

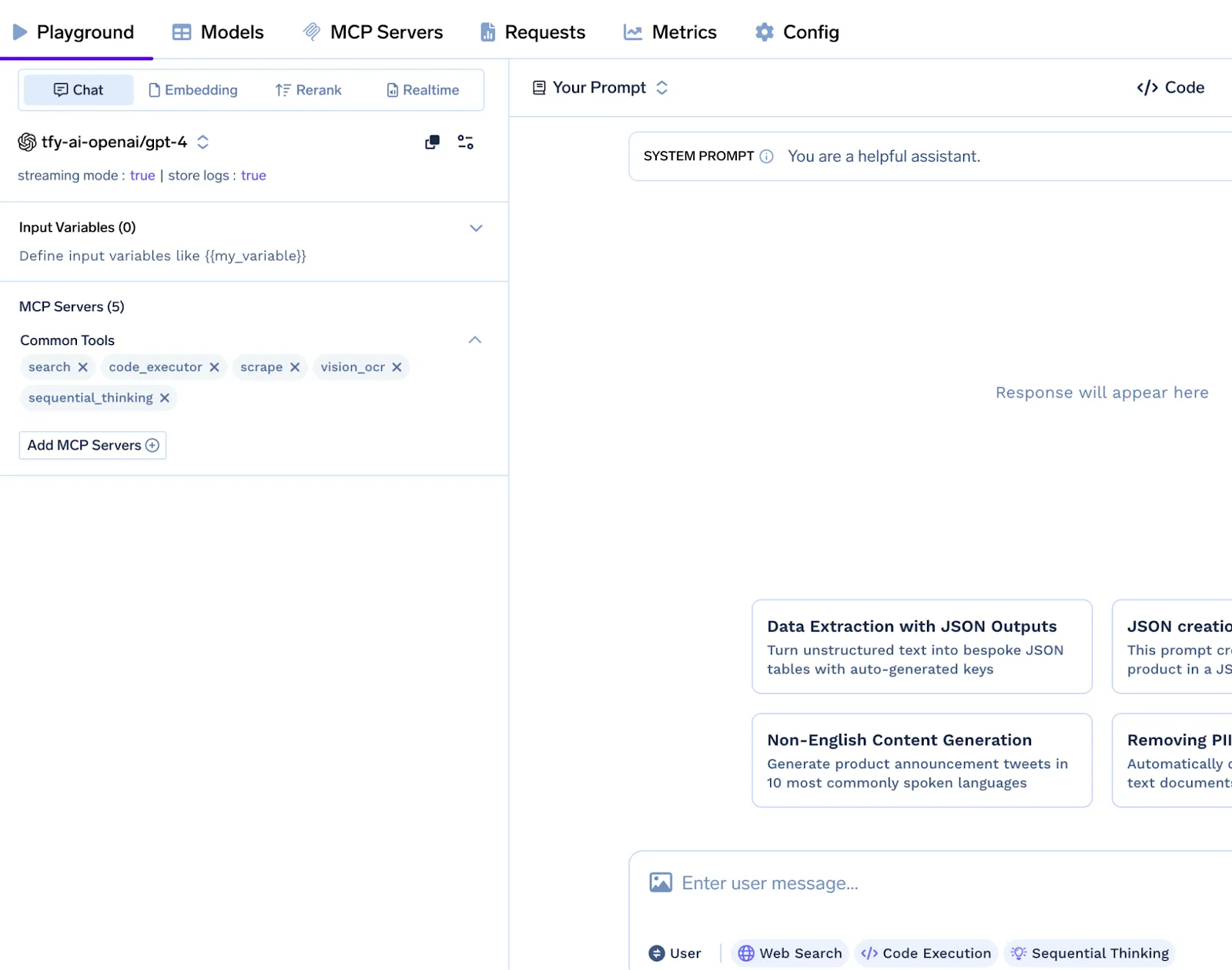

Agent Playground et extraits de code : Créez des agents en quelques minutes : choisissez des outils, rédigez une invite, regardez les traces en temps réel, puis copiez des extraits Python prêts à l'emploi dans votre pipeline.

Garde-corps, observabilité et limitation de débit : Rédaction des informations personnelles, crochets d'approbation manuelle, quotas par outil et traces distribuées complètes

Cas d'utilisation et démonstrations dans le monde réel

Vous trouverez ci-dessous deux exemples pratiques que nous avons présentés lors du webinaire. Chacun suit un flux clair, étape par étape, afin que vous puissiez vous faire une idée de ce que fait l'agent sous le capot.

1. Agent de débogage

Objectif — Triage et remédiation automatisés des défaillances de production.

Flux de travail :

- Acceptez une URL de service défaillante de la part de l'utilisateur.

- Interrogez le MCP Kubernetes pour répertorier les pods actifs et diffuser des journaux en temps réel.

- Analysez la trace de la pile, puis passez au MCP GitHub pour identifier le fichier et la ligne exacts qui ont déclenché l'erreur.

- Générez un correctif sur une nouvelle branche, poussez le commit et ouvrez une Pull Request.

- Publiez le lien PR sur la chaîne Slack désignée pour un examen rapide.

2. Assistante d'entretien

Objectif — Rédigez des dossiers concis aux candidats avant la réunion des jurys d'entretien.

Flux de travail :

- Scannez les événements de Google Agenda de demain dont le titre contient la mention « Interview ».

- Récupérez tous les CV joints ou les documents Drive liés.

- Exécutez chaque PDF via un OCR MCP pour obtenir un texte propre.

- Extrayez les informations clés (employeur actuel, expérience globale et rôles récents) tout en rédigeant les identifiants personnels.

- Publiez un bref résumé sur la chaîne Slack privée « Interview‑Prep » afin que le panel soit préparé.

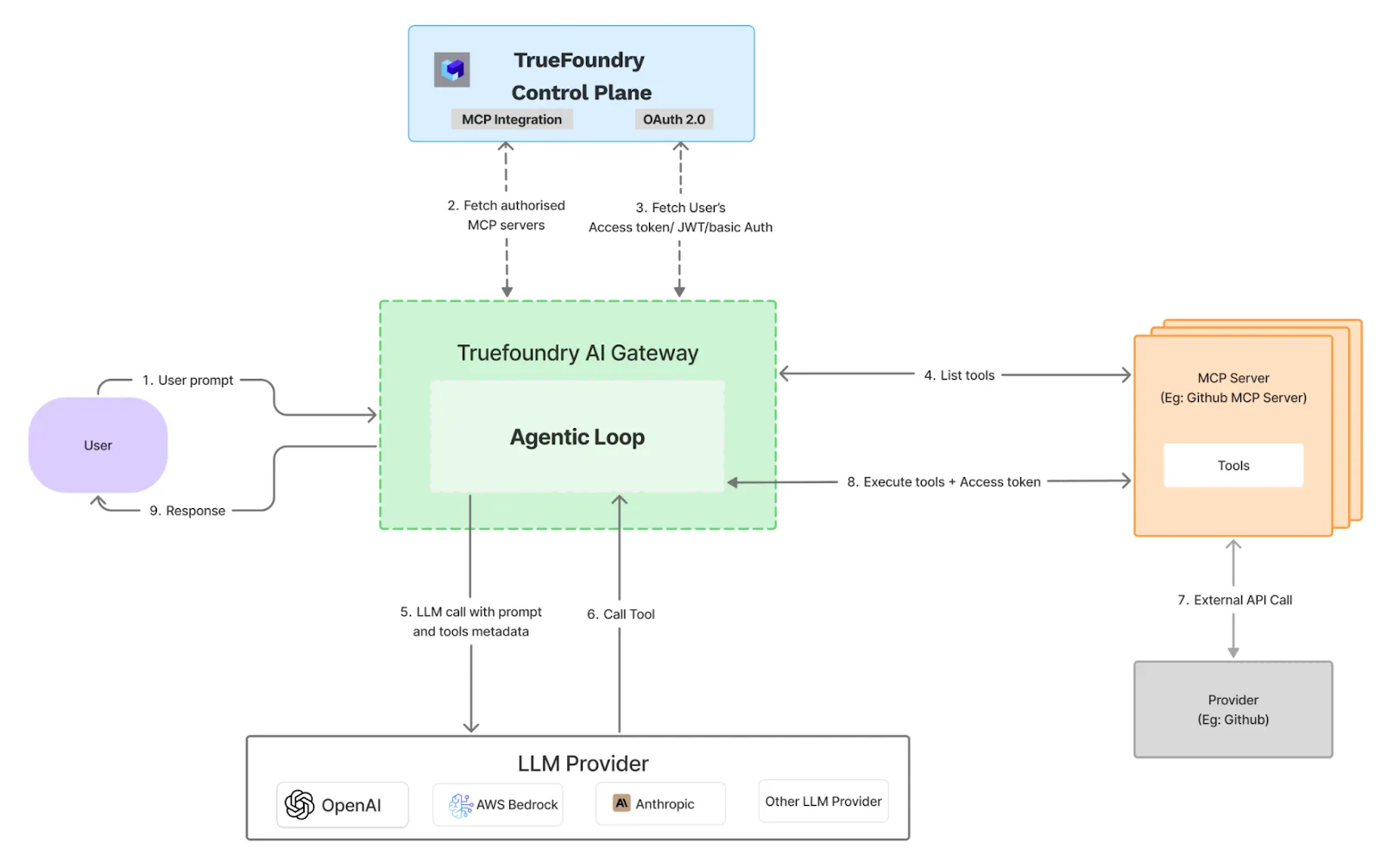

Présentation de l'architecture du système

La passerelle Truefoundry AI Gateway est conçue comme un proxy intermédiaire haute performance qui se situe entre la boucle d'agence de l'utilisateur final et les services en aval, notamment Modèle de langage étendu (LLM) fournisseurs et serveurs MCP. Le système est conçu pour une latence minimale en exécutant des fonctions critiques telles que l'authentification, la limitation du débit et les garde-fous en mémoire. Pour maintenir les performances, les données de journalisation et d'analyse sont traitées de manière asynchrone.

Cycle de vie des demandes et flux de données

Le flux opérationnel, de l'invite de l'utilisateur à la réponse finale, est exécuté selon une séquence précise en plusieurs étapes :

1. Ingestion de la demande initiale

La passerelle reçoit une invite initiale de la part de l'utilisateur. Lors de l'ingestion, la demande est étiquetée avec un identifiant unique à des fins de suivi et immédiatement transmise pour traitement.

2. Authentification et autorisation

La passerelle communique avec le plan de contrôle Truefoundry pour exécuter deux fonctions de sécurité critiques :

- Il récupère une liste de serveurs MCP autorisés auxquels l'utilisateur est autorisé à accéder sur la base de politiques prédéfinies.

- Il demande et reçoit des produits frais, jetons d'accès de courte durée pour chacun de ces serveurs autorisés, en veillant à ce que les informations d'identification aient une durée d'exposition limitée.

3. Découverte dynamique d'outils

À l'aide des jetons nouvellement acquis, la passerelle interroge chaque serveur MCP autorisé pour découvrir l'ensemble des outils ou fonctions disponibles. Ce processus se déroule en temps réel pour chaque demande utilisateur, et les résultats sont mis en cache pendant la durée de cette demande afin d'optimiser les performances.

4. Invocation LLM unifiée

La passerelle crée une invite unique et complète pour le fournisseur LLM désigné (par exemple, OpenAI, AWS Bedrock). Cette invite inclut la requête utilisateur d'origine ainsi que les métadonnées et les schémas de tous les outils découverts, permettant au LLM de générer un plan d'exécution complet en plusieurs étapes.

5. Exécution itérative de l'outil

La passerelle exécute ensuite le plan généré par le LLM dans une boucle itérative séquentielle :

- La passerelle appelle l'outil sélectionné sur le serveur MCP approprié, en transmettant le jeton d'accès spécifique à l'utilisateur nécessaire lors de l'appel.

- Le résultat de l'exécution de l'outil est renvoyé à la passerelle.

- Ce résultat est ensuite réintégré dans le contexte du LLM pour la prochaine étape du plan.

- Ce cycle se répète jusqu'à ce que le LLM détermine que la tâche est terminée.

6. Interaction API externe encapsulée

Tous les appels d'API externes (par exemple, vers GitHub, Stripe) sont gérés exclusivement par les serveurs MCP, et non par la passerelle.

7. Livraison des réponses et journalisation asynchrone

Une fois la boucle d'exécution terminée, la réponse finale est retransmise à l'utilisateur. Simultanément, toutes les données opérationnelles pertinentes, y compris les traces, les chronométrages de performances et les indicateurs de coûts, sont envoyées vers une file d'attente asynchrone pour être ingérées par les plateformes d'observabilité et d'analyse. Cela garantit que la journalisation n'introduit aucune latence dans le temps de réponse de l'utilisateur.

Meilleures pratiques pour une passerelle IA sécurisée avec MCP

Un endroit sécurisé Passerelle IA agit comme la couche de protection entre les systèmes d'IA et les données, les applications et les utilisateurs de l'entreprise. La mise en œuvre des bonnes pratiques garantit un flux de données sécurisé, un accès contrôlé et des opérations d'IA fiables tout en minimisant les risques de sécurité et de conformité.

- Appliquez une authentification et une autorisation renforcées: utilisez l'authentification multifactorielle (MFA) et le contrôle d'accès basé sur les rôles (RBAC) pour vous assurer que seuls les utilisateurs et services vérifiés peuvent accéder à la passerelle AI.

- Appliquer les principes de minimisation des données: autorisez les systèmes d'IA à accéder uniquement aux données nécessaires à des tâches spécifiques afin de réduire l'exposition aux informations sensibles.

- Chiffrez les données en transit et au repos: utilisez des normes de chiffrement modernes pour protéger les données circulant via la passerelle et stockées dans des journaux ou des caches.

- Mettre en œuvre une surveillance et des alertes en temps réel: surveillez en permanence le trafic, détectez les anomalies et déclenchez des alertes en cas d'activités suspectes ou de demandes de données inhabituelles.

- Tenir à jour des journaux d'audit détaillés: enregistrez toutes les demandes, les réponses et les événements d'accès aux données pour favoriser la conformité, les enquêtes et la responsabilité.

- Utiliser le filtrage et la rédaction du contenu: détectez et masquez automatiquement les données sensibles telles que les informations personnelles, les informations financières ou les informations d'identification avant qu'elles n'atteignent les modèles d'IA.

- Mettre à jour et corriger régulièrement les systèmes: maintenez à jour le logiciel de passerelle, les dépendances et les contrôles de sécurité pour éviter les vulnérabilités.

- Définissez des limites de débit et des contrôles d'utilisation: Prévenez les abus, les tentatives de déni de service ou l'utilisation excessive des API en imposant des limites et des quotas.

- Isolez les environnements et les charges de travail: environnements de développement, de test et de production séparés afin de réduire le risque de fuites de données entre environnements.

- Réaliser des audits de sécurité périodiques: passez régulièrement en revue les configurations, les politiques et les contrôles d'accès pour garantir une conformité et une efficacité continues.

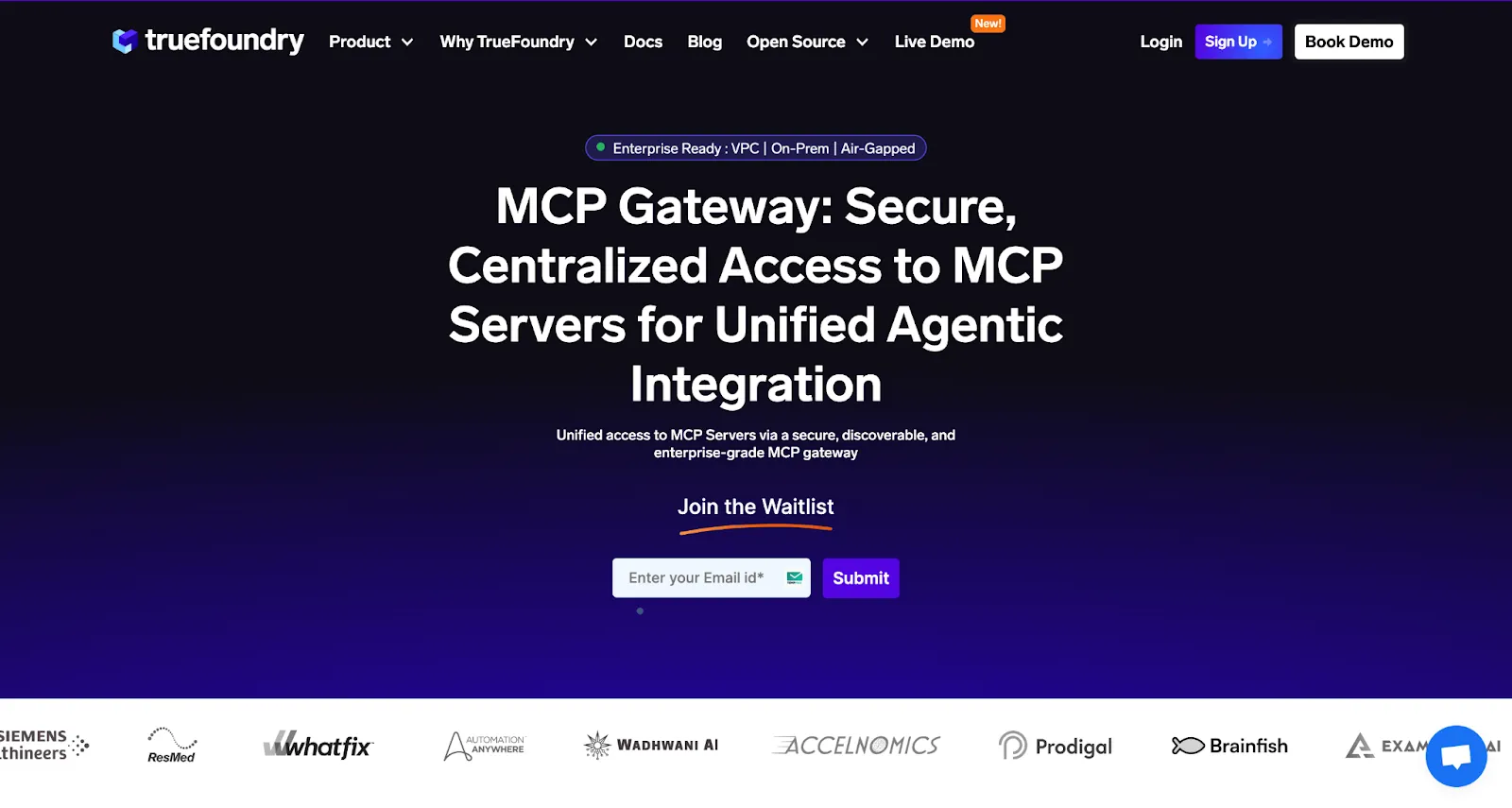

Démarrage et lancement de la version bêta de MCP Gateway

Le lancement de la version bêta de MCP Gateway est disponible sur le plan de contrôle Truefoundry. Inscrivez-vous pour essai de trois mois, ou réservez un séance de conseil personnalisée pour comparer les coûts, la latence et l'architecture avec notre équipe.

Êtes-vous prêt à transformer des API cloisonnées en agents surpuissants ? Créez votre compte gratuit et branchez votre premier serveur MCP en quelques minutes.

Conclusion

À mesure que les entreprises développent l'IA agentique, une passerelle d'IA sécurisée avec MCP devient essentielle pour connecter les modèles à de véritables outils commerciaux de manière sûre et fiable. MCP permet un accès standardisé aux outils, tandis que la passerelle assure la gouvernance, la sécurité et l'observabilité à chaque interaction.

Grâce à un contrôle centralisé, à des autorisations précises et à une surveillance en temps réel, les organisations peuvent déployer de puissants agents d'IA sans compromettre la protection des données ou la conformité. L'adoption d'une passerelle IA sécurisée avec MCP garantit une automatisation de l'IA évolutive, fiable et prête à la production pour l'entreprise.

Réservez une démo pour voir comment la passerelle IA de TrueFoundry avec MCP fonctionnera dans l'environnement de votre entreprise.

Questions fréquemment posées

Qu'est-ce qu'une passerelle IA d'entreprise avec MCP ?

Une passerelle d'IA d'entreprise avec MCP est une couche centralisée qui connecte les modèles d'IA aux outils et données de l'entreprise à l'aide du protocole Model Context. Il gère l'authentification, le contrôle d'accès, la journalisation et l'application des politiques, garantissant des interactions d'IA sécurisées, conformes et observables tout en permettant aux agents de découvrir et d'invoquer en toute sécurité des API commerciales approuvées.

Comment MCP améliore-t-il une passerelle d'IA d'entreprise ?

MCP améliore une passerelle d'IA d'entreprise en normalisant la façon dont les modèles d'IA découvrent et utilisent les outils. Il fournit des schémas structurés, des détails d'authentification et des règles d'utilisation, permettant aux passerelles d'appliquer des politiques, de gérer les autorisations et de surveiller l'utilisation des outils. Cela garantit une intégration cohérente, sécurisée et évolutive entre les agents d'IA et les systèmes d'entreprise dans tous les environnements.

Quelles fonctionnalités de sécurité une passerelle IA d'entreprise avec MCP doit-elle inclure ?

Une passerelle d'IA d'entreprise avec MCP doit inclure une authentification forte, un contrôle d'accès basé sur les rôles, le cryptage, la journalisation des audits, une surveillance en temps réel, la rédaction des données et une limitation de débit. Il devrait également soutenir l'application des politiques, la gestion sécurisée des jetons et les contrôles de conformité pour empêcher les accès non autorisés, protéger les données sensibles et garantir des interactions sécurisées entre l'IA et les outils de l'entreprise.

Comment les entreprises sécurisent-elles l'accès aux outils MCP via des passerelles IA ?

Les entreprises sécurisent l'accès aux outils MCP en appliquant l'authentification basée sur l'identité, en attribuant des autorisations basées sur les rôles et en émettant des jetons de courte durée pour les appels aux outils. Les passerelles IA valident le contexte utilisateur, limitent l'accès aux serveurs MCP approuvés, enregistrent toutes les interactions et appliquent des mesures de protection telles que des flux de travail d'approbation et un filtrage des données pour empêcher les abus ou l'exposition non autorisée des données.

Quelles sont les meilleures pratiques pour faire évoluer une passerelle d'IA d'entreprise avec MCP ?

Les meilleures pratiques incluent la centralisation des registres de serveurs MCP, la mise en œuvre de contrôles d'accès granulaires, l'activation de l'observabilité et du suivi des coûts, ainsi que l'automatisation de l'application des politiques. Les organisations doivent isoler les environnements, utiliser des limites de débit, gérer des pistes d'audit et revoir régulièrement les configurations. Ces mesures garantissent une mise à l'échelle sécurisée, efficace et conforme à mesure que l'adoption de l'IA se développe au sein des équipes et des flux de travail.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)