Las 25 mejores herramientas de mLOps de 2026

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

A medida que la adopción del aprendizaje automático continúa acelerándose en todos los sectores, la necesidad de canalizaciones de aprendizaje automático sólidas, escalables y automatizadas nunca ha sido mayor. En 2026, las plataformas MLOps se han convertido en la base de la operacionalización de la IA, desde la capacitación y el despliegue de modelos hasta la supervisión y la gobernanza.

Estas plataformas optimizan el ciclo de vida de principio a fin, lo que ayuda a los equipos a gestionar la complejidad, garantizar la reproducibilidad y acelerar la generación de valor. Tanto si se trata de una empresa emergente que está escalando su primer modelo como de una empresa que implementa cientos, elegir la plataforma mLOps adecuada es fundamental.

En esta guía, exploramos qué es MLOps, por qué es importante y las mejores herramientas de MLOps que darán forma al panorama en 2026.

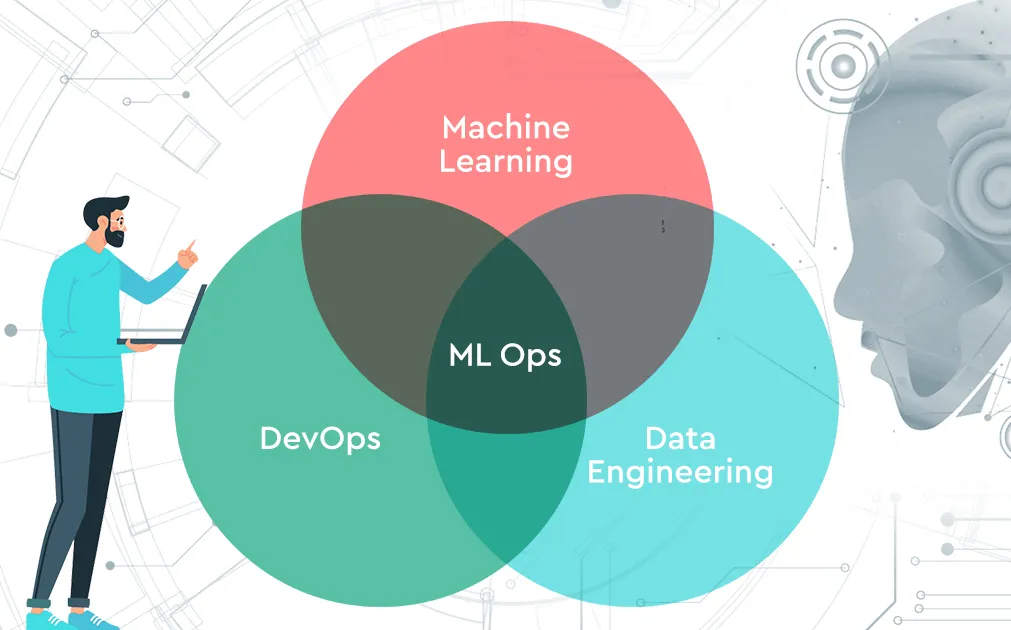

¿Qué es MLOps?

Las MLOps (operaciones de aprendizaje automático) son una disciplina que fusiona los principios de aprendizaje automático, DevOps e ingeniería de datos para permitir el desarrollo, la implementación, la supervisión y el mantenimiento de sistemas de aprendizaje automático confiables a escala. Garantiza que los modelos creados en entornos experimentales puedan pasar de manera segura y eficiente a la producción, donde deben funcionar de manera constante, adaptarse a los cambios y seguir siendo responsables.

Los flujos de trabajo de DevOps tradicionales se centran en el control de versiones, las canalizaciones de CI/CD, las pruebas automatizadas y la confiabilidad del sistema. mLOps los hereda, pero los amplía para abordar los desafíos únicos del aprendizaje automático: administrar datos en constante evolución, volver a capacitar los modelos para que tengan en cuenta las desviaciones, evaluar los resultados no deterministas y mantener la reproducibilidad en todas las iteraciones de los modelos.

¿Por qué necesita herramientas MLOps?

A medida que el aprendizaje automático pasa de la experimentación a la implementación a escala empresarial. Las herramientas de MLOps se han vuelto esenciales para garantizar la coherencia, la confiabilidad y la velocidad a lo largo del ciclo de vida del modelo. Sin una solución mLOps centralizada, los equipos suelen terminar con herramientas fragmentadas, procesos manuales y flujos de trabajo inconsistentes que ralentizan la innovación e introducen riesgos operativos.

Plataformas MLOps resuelva estos desafíos al proporcionar una interfaz unificada para administrar las canalizaciones de datos, los flujos de trabajo de capacitación, el seguimiento de modelos, la implementación y la supervisión, todo en un solo lugar. Esta consolidación permite una colaboración más estrecha entre los científicos de datos, los ingenieros de aprendizaje automático y los equipos de DevOps, lo que reduce la fricción de transferencia y mejora la reproducibilidad en todos los entornos.

¿Cómo elegir las mejores plataformas de MLOps?

Al seleccionar las herramientas de MLOps en 2026, es importante evaluar no solo las características, sino también qué tan bien la plataforma admite su flujo de trabajo de aprendizaje automático, se adapta a su infraestructura y se alinea con los objetivos operativos de su equipo. A continuación, se muestran algunos criterios esenciales que debes tener en cuenta:

Soporte integral del ciclo de vida

Una plataforma mLOps ideal debe cubrir todo el ciclo de vida del aprendizaje automático, desde el control de versiones de datos y la capacitación hasta la implementación y la supervisión. Las cadenas de herramientas fragmentadas pueden generar ineficiencias e inconsistencias entre los equipos. Las plataformas que unifican estas etapas en un único flujo de trabajo ayudan a mejorar la reproducibilidad, reducir las transferencias y acelerar la iteración.

Escalabilidad y flexibilidad de infraestructura

A medida que las cargas de trabajo de ML escalan, también debe hacerlo la plataforma. Una buena solución de MLOps debería ser compatible con todo, desde la experimentación local hasta el entrenamiento distribuido en varias GPU o nodos. También debe ofrecer flexibilidad en la implementación y ser compatible con entornos nativos de la nube, locales e híbridos sin tener que limitarse a un paquete específico.

Facilidad de uso y experiencia de desarrollador

La usabilidad a menudo se pasa por alto, pero es fundamental. Una plataforma sólida ofrece interfaces limpias, tanto de interfaz de usuario como de CLI, junto con SDK completos que se integran con marcos populares como PyTorch, TensorFlow y Hugging Face. Una plataforma que sea intuitiva tanto para los científicos de datos como para los ingenieros de aprendizaje automático promueve una mejor colaboración y una incorporación más rápida.

Ecosistema de integración

Los MLOps no existen de forma aislada. Tu plataforma debe integrarse perfectamente con los sistemas de almacenamiento existentes (como S3 o GCS), las herramientas de CI/CD (como GitHub Actions o Jenkins), las plataformas de observabilidad (como Prometheus o Grafana) y los registros de modelos. Una integración sólida garantiza un flujo fluido de datos y modelos en toda tu canalización.

Gobernanza, seguridad y cumplimiento

Para las organizaciones que trabajan en entornos regulados, las funciones de gobierno son imprescindibles. La plataforma debe admitir el control de acceso basado en roles (RBAC), los registros de auditoría y el seguimiento del linaje. El cumplimiento de estándares como el SOC 2, la HIPAA o el RGPD ayuda a garantizar la privacidad de los datos, la confianza y la viabilidad a largo plazo en los entornos empresariales.

¿Cuáles son las mejores herramientas de MLOps de 2026?

El panorama de los MLOps en 2026 está repleto de plataformas que se adaptan a diferentes necesidades, desde el seguimiento ligero de experimentos hasta la implementación y el monitoreo de modelos de nivel empresarial. A continuación, se muestran las 25 mejores herramientas de mLOps que ayudan a los equipos a optimizar sus flujos de trabajo de aprendizaje automático, optimizar la infraestructura y poner en funcionamiento los modelos a escala. Cada plataforma tiene sus puntos fuertes en función de la tecnología, la madurez del equipo y los objetivos empresariales.

1. True Foundry

TrueFoundry es un plataforma moderna de MLOps y LLMops diseñado para equipos que desean implementar, escalar y monitorear modelos de aprendizaje automático e IA generativa en producción. Elimina la complejidad de la infraestructura y, al mismo tiempo, ofrece un control total, lo que permite a los equipos pasar de la experimentación a la implementación en cuestión de minutos.

A diferencia de los sistemas antiguos, TrueFoundry está optimizado para el rendimiento, la productividad de los desarrolladores y los flujos de trabajo centrados en GenAI, que incluyen soporte para agentes, canalizaciones de RAG y rastreo avanzado. Su seguridad de nivel empresarial y su diseño modular la convierten en una de las mejores herramientas de MLOps, adecuada para organizaciones de todos los tamaños.

Características principales:

- Modelo de nivel de producción compatible con vLLM, SGLang y escalado automático para una inferencia de alto rendimiento y baja latencia.

- Ajuste fino, rastreo y orquestación RAG integrados, que incluyen LoRa/QLoRa, bases de datos vectoriales, administración rápida y marcos de agentes como LangChain y CrewAI.

- Preparación empresarial con SOC 2, HIPAA, cumplimiento del RGPD, puerta de enlace de API unificada, control de acceso basado en roles y registros de auditoría.

Ideal para:

Equipos impulsados por la IA que crean productos respaldados por la LLM, especialmente cuando el rendimiento, la seguridad y la observabilidad son fundamentales. Excelente opción para equipos o empresas que cambian rápidamente y que necesitan una implementación escalable de GenAI. Aquí están algunas de las mejores herramientas de pasarela de LLM.

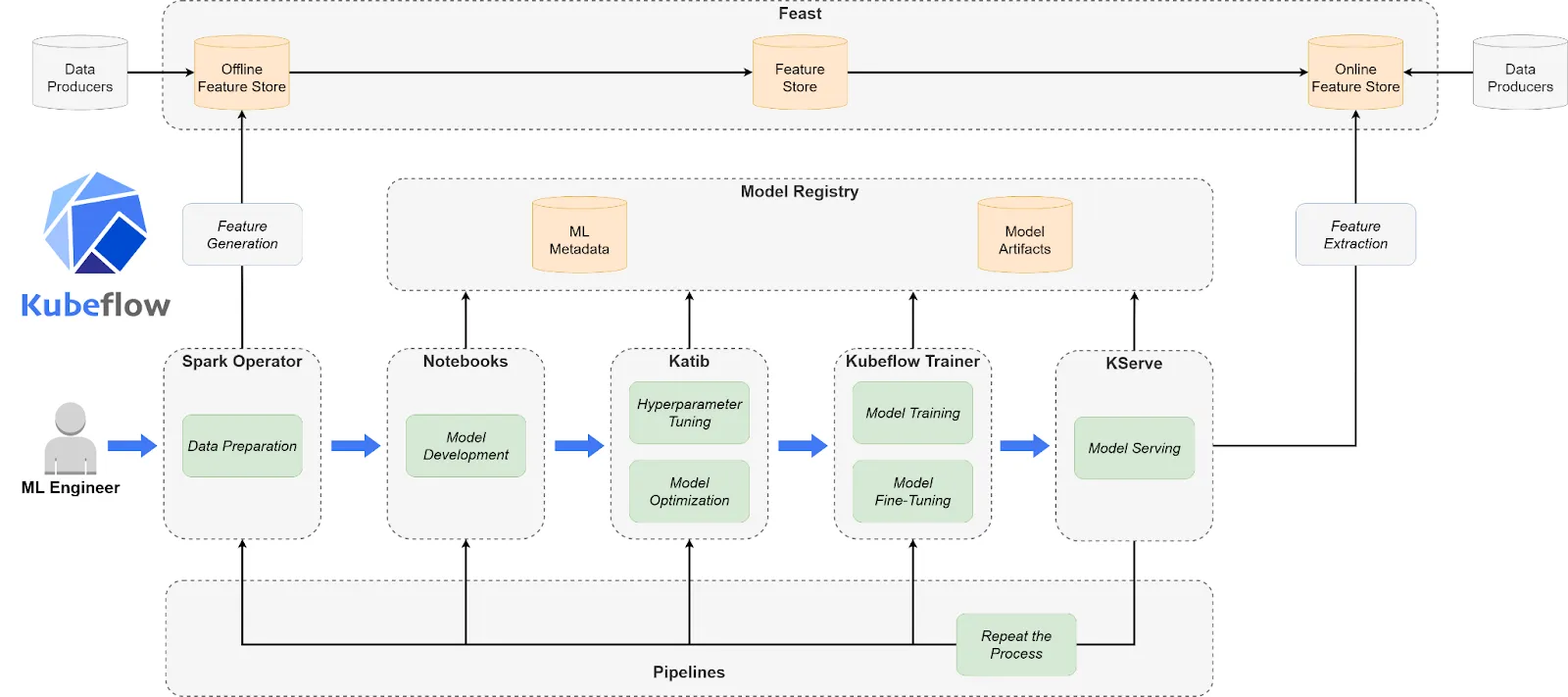

2. Kubeflow

Kubeflow es una herramienta nativa de Kubernetes, de código abierto y una de las mejores herramientas de MLOps para crear y administrar flujos de trabajo de aprendizaje automático portátiles y componibles. Proporciona la flexibilidad necesaria para organizar el entrenamiento, el ajuste y la prestación utilizando abstracciones conocidas de Kubernetes. Aunque es potente, Kubeflow requiere un conocimiento profundo de la infraestructura y no es ideal para equipos sin soporte dedicado de DevOps. Destaca cuando se necesitan canalizaciones de aprendizaje automático personalizadas, escalables y seguras.

Características principales:

- Modular, independiente de la nube Tuberías ML basado en Kubeflow Pipelines con orquestación de DAG, compatibilidad con ordenadores portátiles y flujos de trabajo de varios pasos.

- Integración nativa de Kubernetes para administrar los recursos informáticos, escalar trabajos e implementar modelos con KFServing.

- Proteja los entornos multiusuario con aislamiento de espacios de nombres, RBAC y compatibilidad en AWS, GCP, Azure y clústeres locales.

Ideal para:

Equipos con una sólida experiencia en Kubernetes que buscan personalizar y controlar por completo sus flujos de trabajo de mLOps, especialmente en entornos de nube regulados o híbridos.

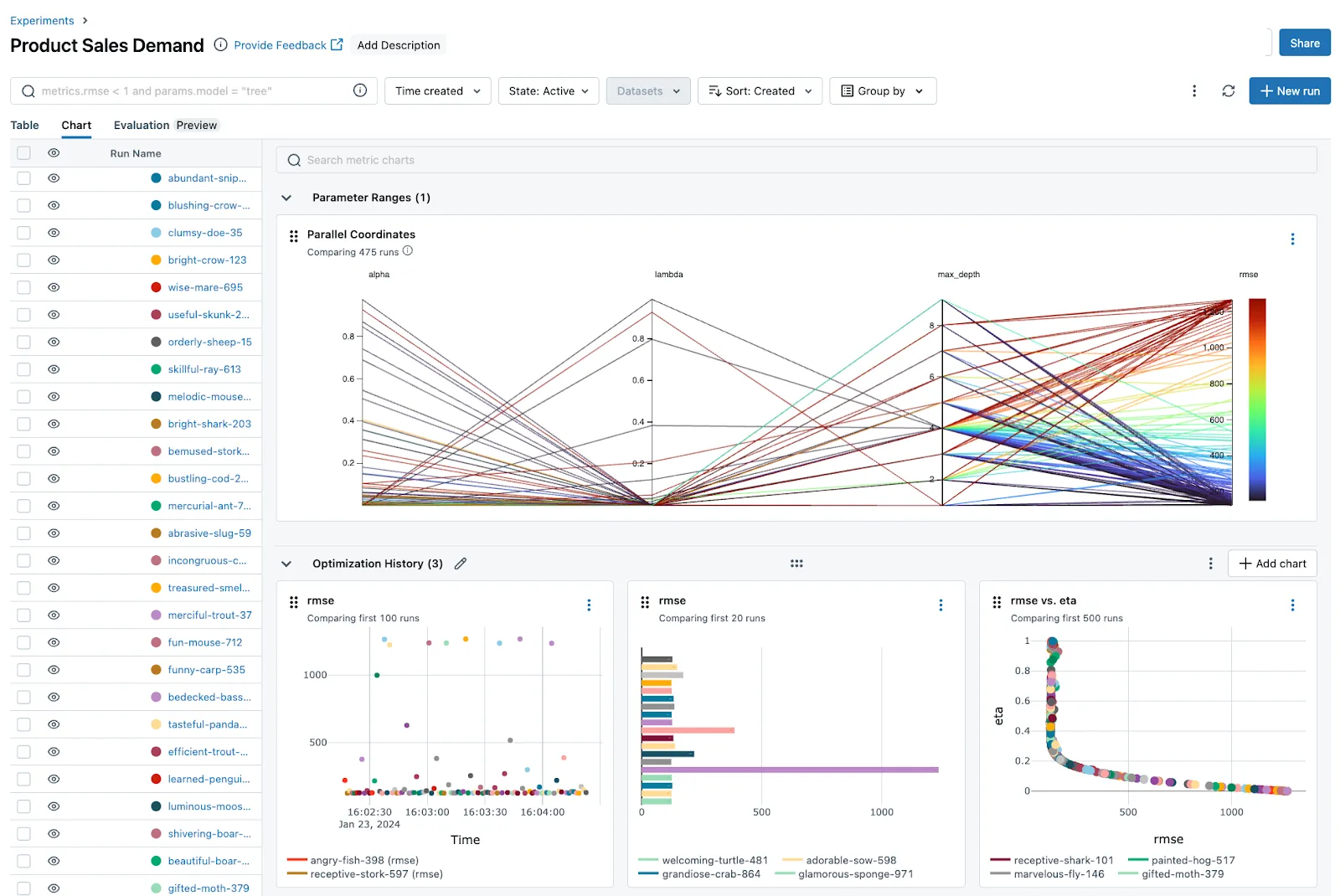

3. MLFlow

MLFlow es una plataforma mLOps ligera y de código abierto creada por Databricks, que se centra en gestionar la experimentación de ML y el control de versiones de modelos. Sus componentes modulares permiten a los equipos integrar el seguimiento, el registro y la implementación en sus flujos de trabajo existentes.

Esta herramienta mLOps es ideal para equipos u organizaciones más pequeños que desean flexibilidad sin la sobrecarga de una infraestructura a gran escala o Kubernetes.

Características principales:

- Seguimiento de experimentos y registro de modelos con un registro perfecto de parámetros, métricas y artefactos en todas las ejecuciones.

- Extensible e independiente del marco, admite TensorFlow, PyTorch, Scikit-learn y flujos de trabajo de aprendizaje automático personalizados con integración de REST y CLI.

- Listo para la implementación con soporte para Docker, entornos de nube y herramientas de servicio personalizadas para la integración de la producción.

Ideal para:

Los equipos de aprendizaje automático buscan herramientas ligeras y personalizables para rastrear experimentos, compartir modelos y administrar versiones sin depender de una plataforma a gran escala.

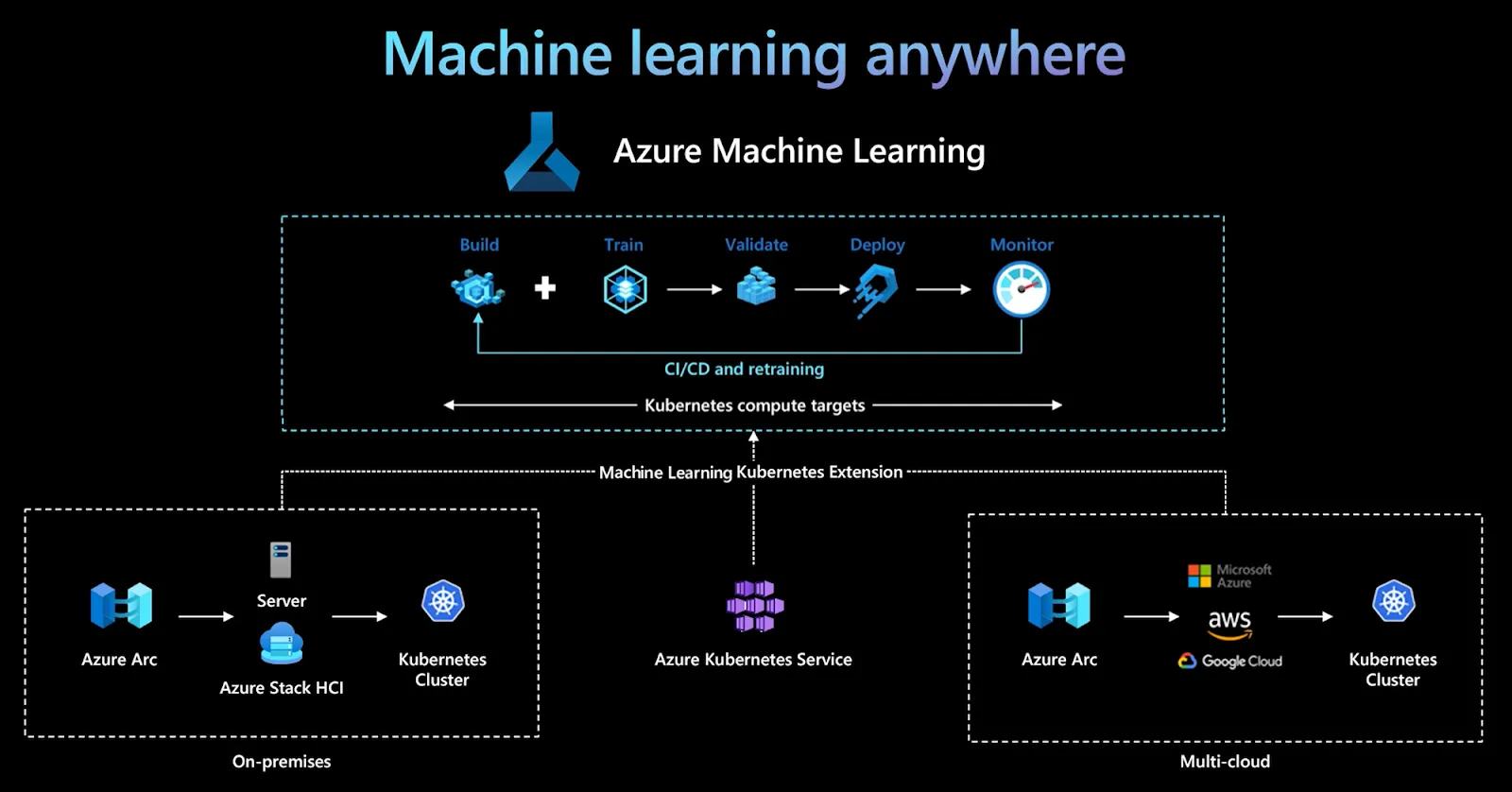

4. Aprendizaje automático de Azure

Azure Machine Learning es la plataforma mLOps totalmente administrada de Microsoft, diseñada para crear, entrenar, implementar y monitorear modelos de aprendizaje automático a escala empresarial. Se integra perfectamente con el ecosistema de Azure y ofrece un potente conjunto de herramientas para la administración de modelos, el AutoML y la IA responsable. Azure ML es ideal para las organizaciones que ya han invertido en la nube de Microsoft y buscan seguridad, escalabilidad y cumplimiento.

Características principales:

- Soporte integral del ciclo de vida del aprendizaje automático, que incluye etiquetado de datos, capacitación automatizada, ajuste de hiperparámetros, registro de modelos y canalizaciones de implementación.

- Integración profunda con Azure, que permite un uso perfecto de Azure Blob Storage, Azure DevOps, Azure Kubernetes Service (AKS) y Azure Synapse.

- Funciones integradas de gobierno y cumplimiento, como el seguimiento del linaje, el acceso basado en roles, la explicabilidad de los modelos y el soporte para una IA responsable.

Ideal para:

Empresas que operan en Microsoft Azure necesitan una plataforma mLOps altamente segura, escalable y totalmente integrada con el cumplimiento empresarial incorporado.

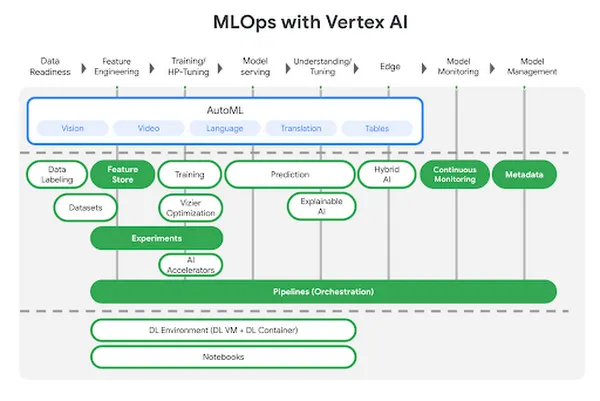

5. Inteligencia artificial de Google Vertex

Vertex AI es la plataforma unificada de Google Cloud para el desarrollo de aprendizaje automático, que combina AutoML y el entrenamiento de modelos personalizados en una sola interfaz. Abstrae la infraestructura y, al mismo tiempo, ofrece servicios avanzados, como almacenes de funciones, canalizaciones y seguimiento de experimentos.

Diseñada para la escalabilidad y la integración con el ecosistema de Google, esta herramienta MLOps está optimizada para la implementación de aprendizaje automático a nivel de producción y los flujos de trabajo basados en datos.

Características principales:

- Plataforma mLOps unificada que combina AutoML, formación personalizada, libretas gestionadas, canalizaciones y almacenes de funciones en un solo lugar.

- Integración nativa del ecosistema de GCP, que incluye BigQuery, Dataflow y Kubernetes Engine para la orquestación de datos y procesamiento.

- Supervisión de modelos integrada con soporte para la detección de desviaciones, la explicabilidad y el registro de modelos Vertex AI para la gestión del ciclo de vida.

Ideal para:

Equipos que crean y escalan el aprendizaje automático en Google Cloud y desean una plataforma mLOps gestionada y escalable con una integración total de datos e implementación.

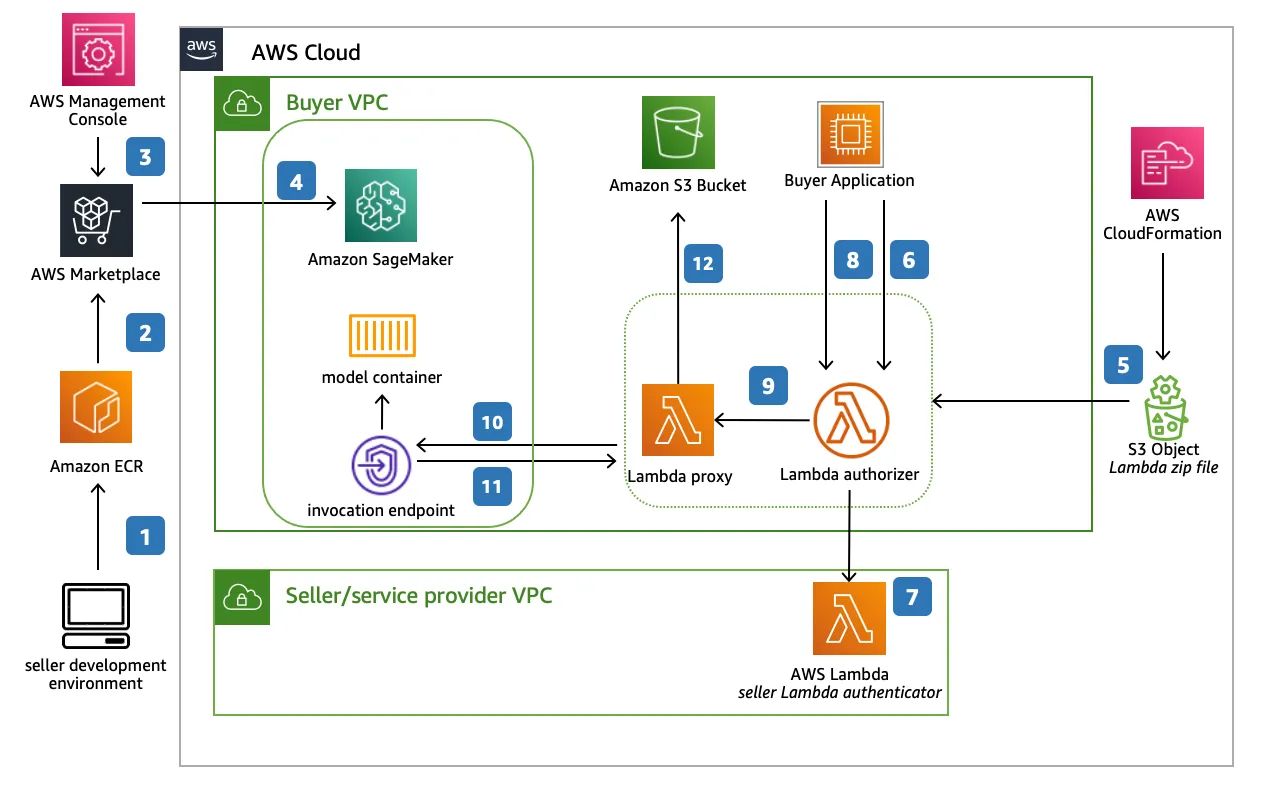

6. Amazon SageMaker

Amazon SageMaker es la plataforma MLOps insignia de AWS que ofrece de todo, desde el preprocesamiento de datos hasta la implementación de modelos en tiempo real. Conocida por su amplia funcionalidad, SageMaker admite el desarrollo de modelos personalizados, AutoML, el alojamiento de modelos y las herramientas de supervisión avanzadas. Está estrechamente integrado con el ecosistema de AWS, lo que lo convierte en la opción ideal para las empresas nativas de la nube.

Características principales:

- Servicios integrales de aprendizaje automático que incluyen trabajos de formación, experimentos, canalizaciones, AutoML (SageMaker Autopilot) y registro de modelos.

- Estrecha integración con AWS, que aprovecha S3, Lambda, CloudWatch e IAM para el acceso a los datos, la seguridad y la automatización.

- Herramientas de producción avanzadas, como la supervisión de modelos, el depurador, las implementaciones ocultas y los puntos finales multimodelo.

Ideal para:

Organizaciones que ya utilizan AWS para la infraestructura y necesitan una plataforma MLOps sólida y escalable con una integración profunda y soporte durante todo el ciclo de vida.

7. DVC (control de versión de datos)

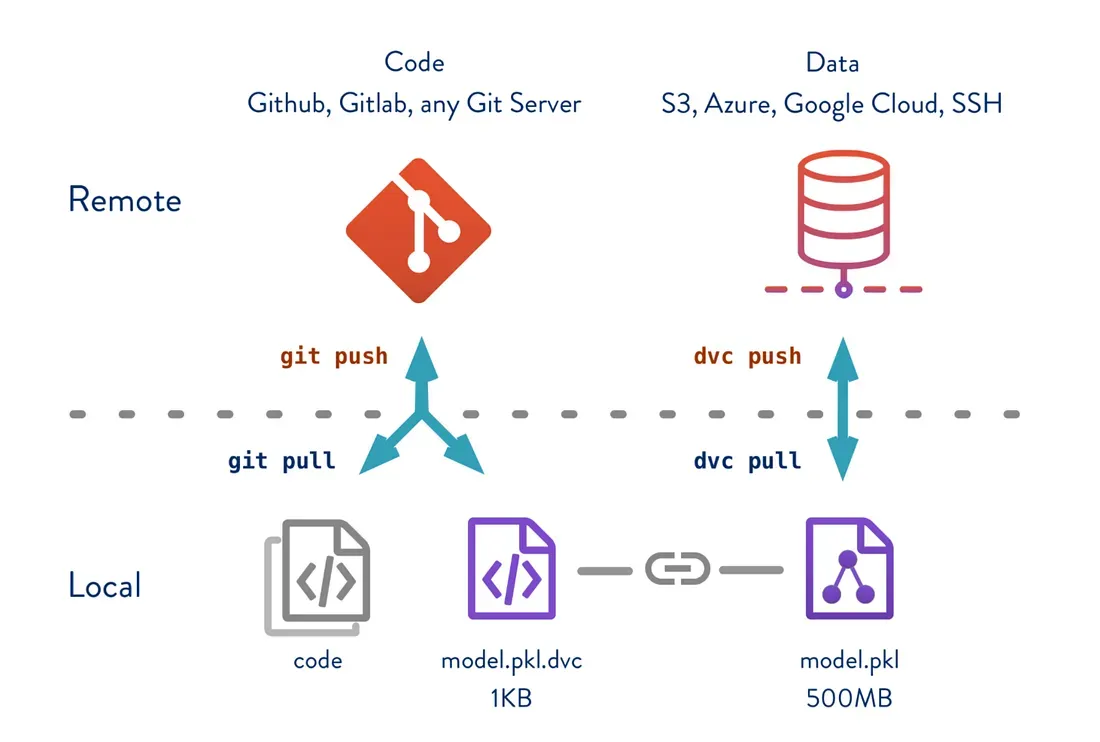

DVC es una herramienta de código abierto que lleva el control de versiones a los proyectos de aprendizaje automático mediante el seguimiento de conjuntos de datos, modelos y experimentos, de forma similar a la forma en que Git administra el código. No pretende ser una plataforma de MLOps completa, sino que se centra en la reproducibilidad, la colaboración y el seguimiento de modelos a través de flujos de trabajo compatibles con Git. El DVC se integra perfectamente en las canalizaciones existentes y brinda a los profesionales del aprendizaje automático más control sobre la gestión de los experimentos.

Características principales:

- El control de versiones de datos y modelos mediante comandos al estilo de Git permite canalizaciones reproducibles y puntos de control coherentes en todos los equipos.

- Seguimiento y comparación de experimentos con soporte para la visualización de métricas, parámetros y resultados, ya sea de forma local o mediante DVC Studio.

- Integración de almacenamiento remoto para conjuntos de datos y artefactos en S3, GCS, Azure, SSH y directorios locales.

Ideal para:

Equipos que buscan capacidades de MLOps ligeras que prioricen el código y que se centren en la reproducibilidad, los flujos de trabajo basados en GIT y la gestión de experimentos, especialmente en proyectos de aprendizaje automático iterativos y de investigación.

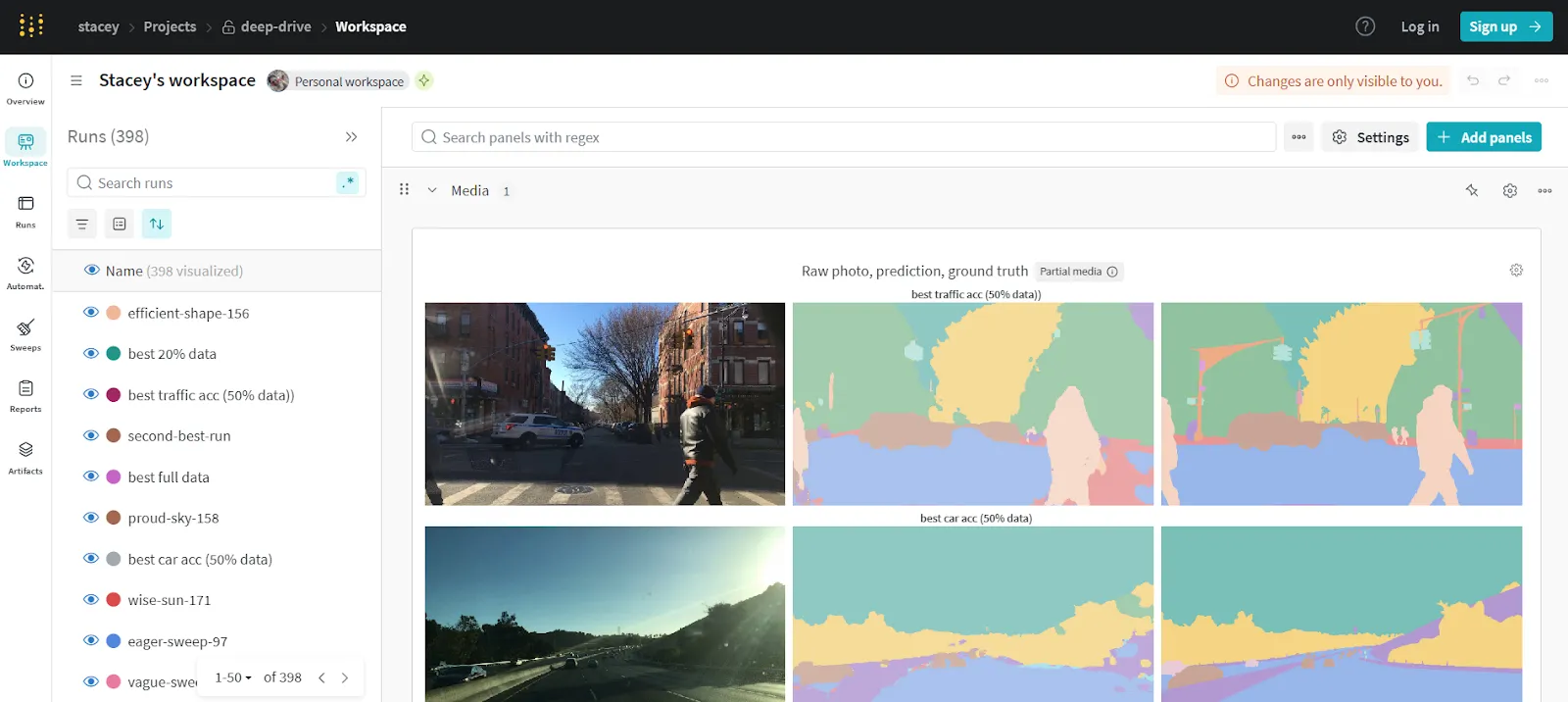

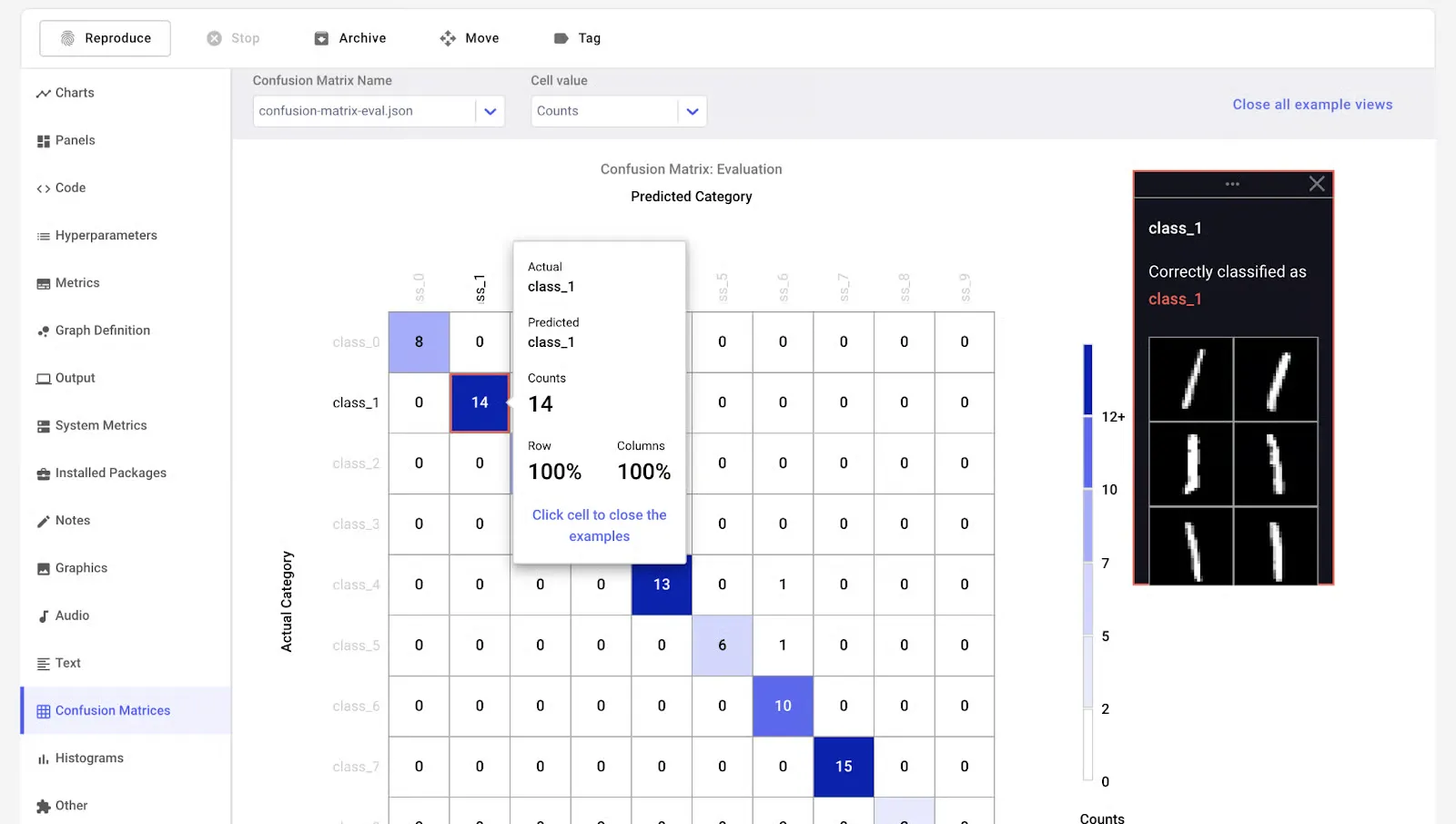

8. Pesos y sesgos

Weights & Biases (W&B) es una de las mejores herramientas de MLOps para el seguimiento de experimentos, la colaboración y la visualización de modelos. Se ha adoptado ampliamente tanto en entornos de investigación como de producción, y ofrece una integración sencilla con la mayoría de los marcos de aprendizaje automático. W&B se centra en la observabilidad, lo que permite obtener información en tiempo real sobre el rendimiento del entrenamiento, los hiperparámetros y las métricas del sistema.

Características principales:

- Seguimiento de experimentos y modelos, con paneles en vivo para las sesiones de entrenamiento, el ajuste de hiperparámetros y la visualización del rendimiento.

- Integración perfecta con PyTorch, TensorFlow, JAX, Hugging Face y otros, con cambios mínimos en el código.

- Herramientas de colaboración que incluyen paneles de equipo, informes de proyectos y control de versiones de artefactos para una visibilidad centralizada de los proyectos.

Ideal para:

Los equipos de aprendizaje automático se centraron en la iteración, la visualización y la colaboración rápidas. Ideal para entornos y equipos impulsados por la investigación que desean conocer mejor el rendimiento de la formación.

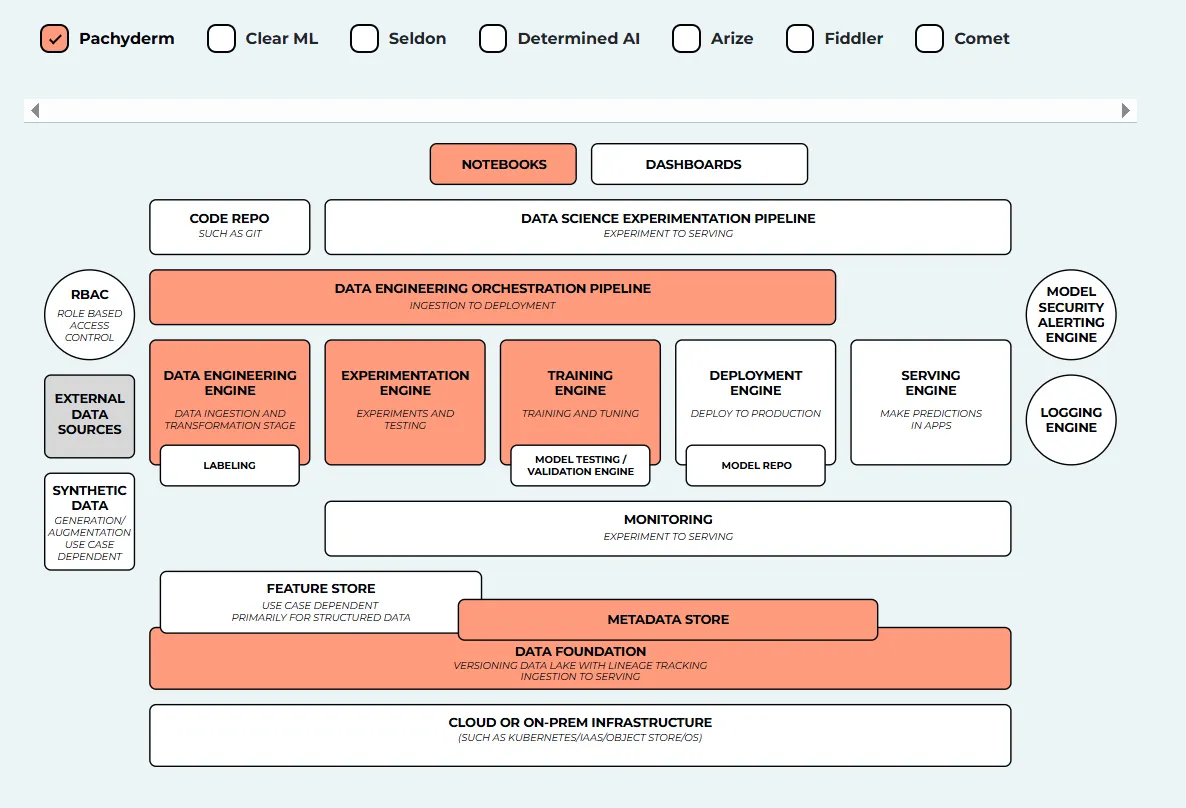

9. Paquidermo

Pachyderm es una plataforma de ciencia de datos de código abierto creada para el linaje de datos, el control de versiones y las canalizaciones reproducibles. A diferencia de las herramientas MLOps tradicionales, Pachyderm utiliza un enfoque similar al de Git para los datos, lo que la hace muy adecuada para los equipos que gestionan dependencias de datos complejas o entornos regulados. Combina la contenedorización con la orquestación de las canalizaciones de datos para garantizar flujos de trabajo rastreables y versionados.

Características principales:

- Control de versiones de datos y seguimiento del linaje para garantizar registros completos de los conjuntos de datos utilizados en el entrenamiento de modelos.

- Canalizaciones escalables nativas de Docker que admiten el procesamiento paralelo en grandes conjuntos de datos con una configuración mínima.

- Integraciones empresariales y soporte local, con compatibilidad para despliegues de Kubernetes, en la nube e híbridos.

Ideal para:

Equipos de sectores regulados o flujos de trabajo con uso intensivo de datos que necesitan un control de versiones sólido y un seguimiento del linaje para garantizar el cumplimiento, la reproducibilidad y la escalabilidad.

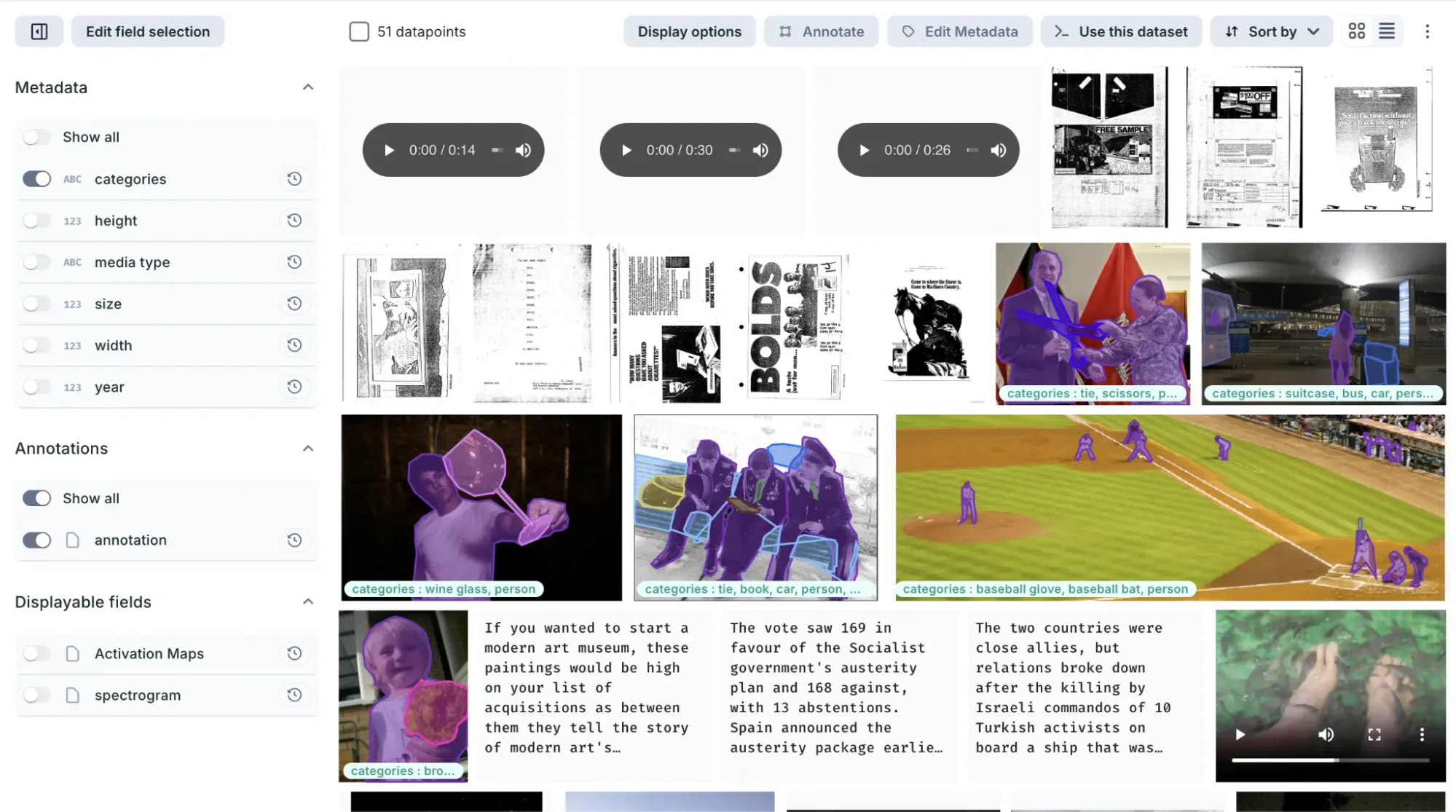

10. Allegro AI

Allegro AI es una plataforma mLOps diseñada específicamente para administrar los flujos de trabajo de aprendizaje profundo a escala, especialmente en entornos de visión artificial e IA perimetral. Se centra en mejorar la reproducibilidad, la colaboración y la trazabilidad a lo largo del ciclo de vida de la IA.

Con sólidas capacidades en la administración de conjuntos de datos, el control de versiones de modelos y el seguimiento de experimentos, esta herramienta MLOps ofrece una infraestructura segura e integral para los equipos que crean e implementan modelos de alto rendimiento en entornos regulados o de producción.

Características principales:

- Administración visual de conjuntos de datos y modelos con control de versiones, anotaciones y seguimiento de linaje automatizados para proyectos de aprendizaje profundo.

- Experimente el seguimiento y la colaboración con vistas basadas en proyectos, comparaciones de rendimiento y paneles de equipo en tiempo real.

- Soporte de IA perimetral para implementar modelos en dispositivos periféricos con reproducibilidad, reversión y monitoreo del rendimiento.

Ideal para:

Equipos que trabajan en casos prácticos de visión artificial, aprendizaje profundo o despliegue periférico, especialmente en sectores como la automoción, la fabricación, la sanidad o la defensa, donde la trazabilidad y el control de los datos y los modelos son fundamentales.

11. Cometa ML

Comet ML es una plataforma de aprendizaje automático diseñada para ayudarlo a monitorear, analizar y refinar modelos y experimentos. Funciona a la perfección con bibliotecas populares como Scikit-learn, PyTorch, TensorFlow y Hugging Face.

La herramienta Comet MLOps facilita la exploración y comparación de los resultados de los experimentos, al tiempo que proporciona visualizaciones ricas para muestras de datos, incluidas imágenes, audio, texto y tablas estructuradas.

Características principales:

- Registra automáticamente la configuración, los resultados, el código y las dependencias para que puedas comparar los experimentos uno al lado del otro.

- Proporciona un lugar central para almacenar, organizar, versionar y compartir modelos con su equipo.

- Guarda y rastrea las versiones de conjuntos de datos y modelos mediante «artefactos», lo que hace que los experimentos sean reproducibles.

- Le ayuda a encontrar los mejores ajustes de parámetros para mejorar el rendimiento del modelo.

- Crea gráficos y paneles personalizados para supervisar los resultados del entrenamiento (como la pérdida y la precisión) y el uso del sistema (CPU/GPU).

- Supervisa los modelos implementados para detectar caídas de rendimiento o desviaciones de datos.

Ideal para:

Ideal para científicos de datos, ingenieros de aprendizaje automático y equipos que desean una forma sencilla de realizar un seguimiento de los experimentos, comparar los resultados y mejorar el rendimiento de los modelos.

12. Prefecto

Prefect es una herramienta moderna de orquestación del flujo de trabajo diseñada para monitorear, coordinar y administrar las canalizaciones de datos en todas las aplicaciones. Se trata de una solución ligera y de código abierto diseñada para respaldar el aprendizaje automático y los flujos de trabajo de datos de principio a fin.

Puede usar Prefect Orion UI o Prefect Cloud para administrar y visualizar los flujos de trabajo. Prefect Orion UI es un motor de orquestación y servidor de API de código abierto y alojado localmente que proporciona información sobre los flujos de trabajo locales y la actividad del sistema.

Prefect Cloud, por otro lado, es un servicio hospedado que le permite visualizar los flujos, las ejecuciones y las implementaciones, al mismo tiempo que administra las cuentas, los espacios de trabajo y la colaboración en equipo.

Características principales:

- Orquestación flexible del flujo de trabajo en aplicaciones y entornos

- Monitorización y observabilidad en tiempo real de los flujos y las tareas

- Orquestación local con Prefect Orion UI

- Gestión alojada y colaboración con Prefect Cloud

- Fácil implementación y programación de los flujos de trabajo

- Infraestructura escalable para canalizaciones de datos y aprendizaje automático

Ideal para:

Ingenieros de datos, ingenieros de aprendizaje automático y equipos que necesitan una orquestación confiable del flujo de trabajo, visibilidad de las canalizaciones y una colaboración escalable para datos y proyectos de aprendizaje automático.

13. Metaflow

Metaflow es una herramienta de gestión del flujo de trabajo para la ciencia de datos y el aprendizaje automático que simplifica la creación, la ejecución y la implementación de modelos. Esta herramienta mLOps ayuda a los equipos a gestionar las canalizaciones a escala y, al mismo tiempo, gestionar automáticamente el seguimiento de los experimentos, el control de versiones de los datos y el despliegue de la producción.

Características principales:

- Diseño y ejecución de flujos de trabajo para canalizaciones de aprendizaje automático y ciencia de datos

- Seguimiento automático de experimentos y control de versiones de datos

- Ejecución escalable en plataformas en la nube (AWS, GCP, Azure)

- Implementación perfecta de los modelos en la producción

- Visualización de los resultados en formato portátil

- Integración con bibliotecas de aprendizaje automático y herramientas de Python populares

- Soporte de la API R para una compatibilidad de idiomas más amplia

Ideal para:

Científicos de datos y equipos de aprendizaje automático que desean una herramienta de flujo de trabajo simple y escalable que gestione la orquestación, el seguimiento y la implementación y, al mismo tiempo, minimice la sobrecarga de los MLOps.

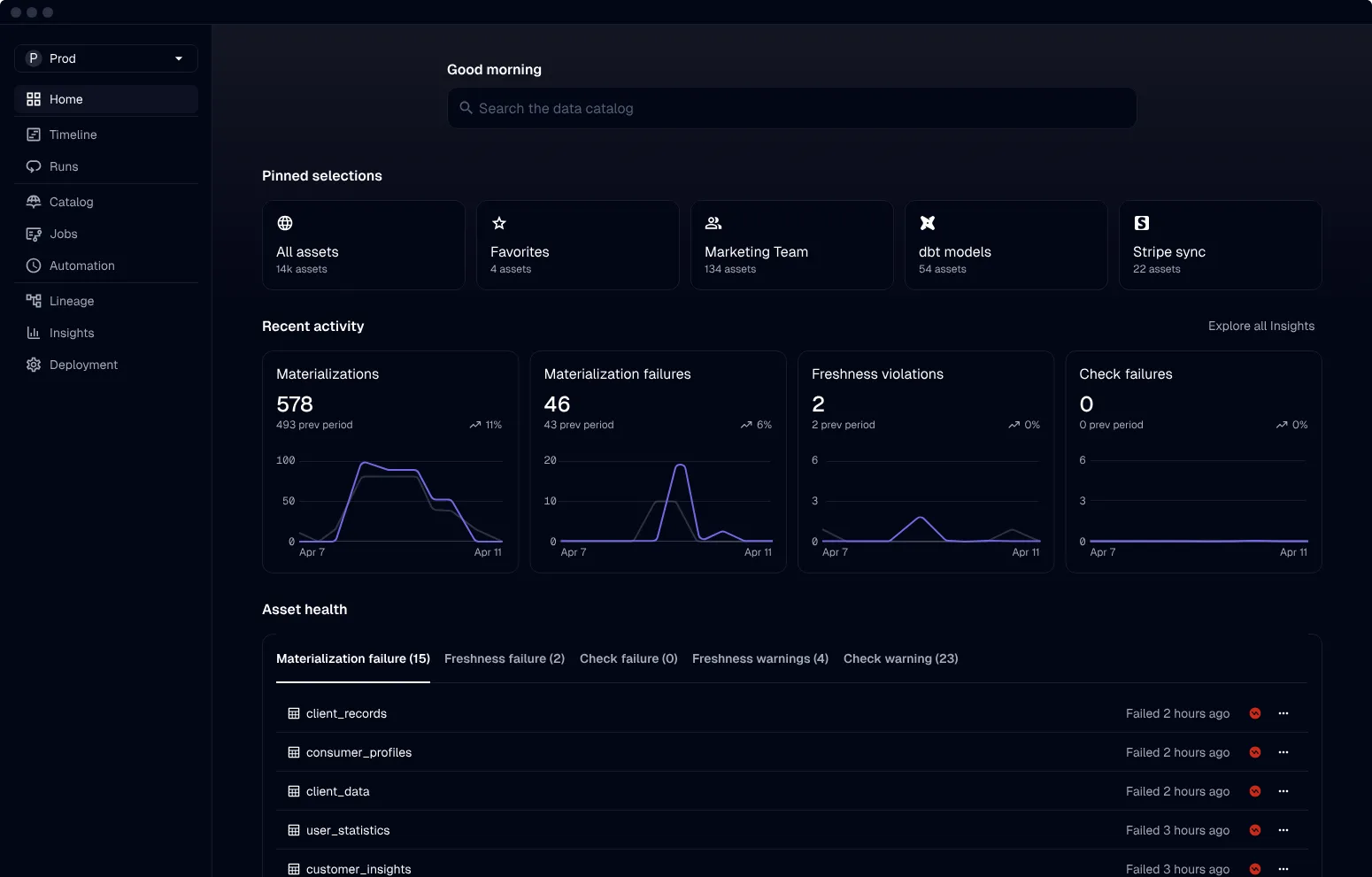

14. Daga

Dagster es una plataforma de orquestación nativa de la nube que ayuda a los equipos de datos a definir, ejecutar y monitorear flujos de datos complejos de manera eficiente. Se centra en la fiabilidad, la observabilidad y una experiencia de desarrollo moderna para gestionar los flujos de trabajo de datos.

Características principales:

- Flujos de trabajo basados en tareas para el diseño de tuberías modulares y reutilizables

- Modelo de programación declarativo para definiciones de canalizaciones más claras

- Excelente capacidad de observación con registro, supervisión y depuración integrados

- Capacidad de prueba mejorada para un desarrollo fiable de canalizaciones de datos

- Integraciones con plataformas y herramientas de datos populares

- Arquitectura escalable y nativa de la nube para equipos de datos modernos

Ideal para:

Ingenieros de datos y equipos de datos que necesitan una orquestación de canalización de datos confiable, comprobable y observable con una sólida integración soporte y un flujo de trabajo de desarrollo moderno.

15. Kedro

Kedro es una herramienta de orquestación de flujos de trabajo basada en Python que ayuda a crear proyectos de ciencia de datos reproducibles, mantenibles y modulares. Incorpora las mejores prácticas de ingeniería de software, como la modularidad, la separación de preocupaciones y el control de versiones, a los flujos de trabajo de aprendizaje automático.

Características principales:

- Creación, visualización y ejecución de canalizaciones modulares

- Configuración integrada y administración de dependencias

- Catálogo de datos para el acceso organizado a los datos y el control de versiones

- Soporte de registro y seguimiento de experimentos

- Despliegue en máquinas individuales o entornos distribuidos

- Fomenta el código reutilizable, mantenible y listo para la producción

- Facilita la colaboración entre los equipos de ciencia de datos

Ideal para:

Equipos y científicos de datos que desean flujos de trabajo de ciencia de datos estructurados, mantenibles y reproducibles utilizando las mejores prácticas de ingeniería de software.

16. Era verdadera

TrueRA es una plataforma enfocada en mejorar la calidad del modelo de aprendizaje automático mediante pruebas, explicabilidad y análisis de causa raíz. Esta herramienta de MLOps ayuda a los equipos a depurar modelos, comprender los problemas de rendimiento y garantizar la equidad durante todo el ciclo de vida del aprendizaje automático.

Características principales:

- Pruebas automatizadas de modelos para mejorar la calidad en el desarrollo y la producción

- Controles sistemáticos de rendimiento, estabilidad y equidad

- Seguimiento de versiones de modelos para analizar el rendimiento a lo largo del tiempo

- Análisis de la causa raíz para identificar las fuentes de errores y sesgos

- Información a nivel de funciones para detectar y reducir el sesgo del modelo

- Fácil integración con la infraestructura y los flujos de trabajo de aprendizaje automático existentes

Ideal para:

Ingenieros de aprendizaje automático, científicos de datos y organizaciones que necesitan información más profunda sobre los modelos, comprobaciones de imparcialidad y una supervisión fiable del rendimiento durante todo el ciclo de vida del modelo.

17. Ben a ML

BentoML es una plataforma basada en Python que simplifica la implementación, el servicio y la supervisión de los modelos de aprendizaje automático en producción. Ayuda a los equipos a distribuir las aplicaciones de aprendizaje automático con mayor rapidez con un servicio de modelos escalable y de alto rendimiento.

Características principales:

- Fácil implementación de modelos como API listas para la producción

- Servicio de alto rendimiento con inferencia paralela y procesamiento por lotes adaptativo

- Soporte de aceleración de hardware para un rendimiento optimizado

- Panel de control centralizado para organizar y supervisar las implementaciones

- Compatibilidad con los principales marcos de aprendizaje automático (Keras, ONNX, LightGBM, PyTorch, Scikit-learn)

- Solución integral para la implementación, el servicio y la supervisión de modelos

Ideal para:

Ingenieros y equipos de aprendizaje automático que necesitan una forma rápida, escalable y confiable de implementar y administrar modelos de aprendizaje automático en entornos de producción.

18. Evidentemente IA

Evidentemente, la IA es una biblioteca de Python de código abierto para monitorear los modelos de aprendizaje automático en el desarrollo, la validación y la producción. Ayuda a garantizar la calidad de los datos y los modelos al detectar desviaciones, problemas de rendimiento y otros posibles problemas.

Características principales:

- Controles de calidad de datos y modelos para tareas de regresión y clasificación

- Detección de desviaciones de datos y desviaciones de objetivos

- Pruebas por lotes con comprobaciones estructuradas para conjuntos de datos y modelos

- Informes y paneles interactivos para el análisis del rendimiento y las desviaciones

- Supervisión en tiempo real de datos y métricas de modelos en producción

- Fácil integración en las canalizaciones y flujos de trabajo de aprendizaje automático existentes

Ideal para:

Científicos de datos e ingenieros de aprendizaje automático que necesitan una supervisión fiable de los modelos, la detección de desviaciones y el seguimiento del rendimiento durante todo el ciclo de vida del aprendizaje automático.

19. Dag Hub

DagsHub es una plataforma de colaboración para proyectos de aprendizaje automático que ayuda a los equipos a rastrear, versionar y administrar datos, modelos, experimentos, canalizaciones y código en un solo lugar. A menudo descrita como «GitHub para el aprendizaje automático», proporciona herramientas para optimizar el flujo de trabajo de aprendizaje automático de principio a fin.

Características principales:

- Repositorios Git y DVC para versionar datos, modelos y código

- Seguimiento de experimentos incorporado con la integración de DagsHub Logger y MLFlow

- Anotación de conjuntos de datos con integración de Label Studio

- Compatibilidad diferencial para cuadernos, código, conjuntos de datos e imágenes de Jupyter

- Comentarios en línea sobre archivos, líneas de código y conjuntos de datos para la colaboración

- Informes de proyectos similares a los de una wiki de GitHub

Ideal para:

Equipos y organizaciones de aprendizaje automático que necesitan un entorno colaborativo y controlado por versiones para gestionar todo el ciclo de vida del aprendizaje automático con un sólido soporte de integración y reproducibilidad.

20. Plataforma Iguazio MLOps

La plataforma MLOps de Iguazio es una solución integral que automatiza todo el ciclo de vida del aprendizaje automático, desde la ingesta y preparación de datos hasta la capacitación, la implementación y el monitoreo de la producción. Esta herramienta mLOps ofrece tanto un marco de código abierto (MLRun) como una plataforma totalmente gestionada, con una implementación flexible en entornos de nube, híbridos o locales.

Características principales:

- Ingestión de datos de múltiples fuentes con un almacén de funciones integrado para funciones reutilizables

- Capacitación y evaluación escalables y sin servidores con control de versiones de datos y seguimiento automatizados

- CI/CD integrados para la capacitación e implementación continuas de modelos

- Despliegue de modelos con un solo clic con supervisión continua del rendimiento

- Detección y mitigación de desviaciones de modelos en producción

- Panel de control centralizado para administrar, gobernar y monitorear modelos en tiempo real

- Opciones de implementación flexibles en entornos de nube, híbridos y locales

Ideal para:

Empresas e industrias reguladas (por ejemplo, atención médica, finanzas) que necesitan una plataforma MLOps flexible, escalable y gobernada con un sólido control de automatización e implementación.

21. Qrant

Qdrant es una base de datos vectorial de código abierto y búsqueda de similitud motor que le permite almacenar, administrar y consultar incrustaciones de vectores a través de un servicio listo para la producción y una API sencilla. Está diseñado para aplicaciones de búsqueda semántica de alto rendimiento y basadas en inteligencia artificial.

Características principales:

- API fácil de usar con soporte para Python y bibliotecas cliente para varios idiomas

- Búsqueda precisa y de alta velocidad mediante un algoritmo HNSW modificado para la búsqueda del vecino más cercano

- Soporte para filtros y tipos de datos enriquecidos, incluidos texto, rangos numéricos y ubicaciones geográficas

- Arquitectura distribuida y nativa de la nube con escalabilidad horizontal

- Construido en Rust para un alto rendimiento y eficiencia de los recursos

Ideal para:

Creación de equipos de aprendizaje automático y desarrolladores búsqueda semántica, sistemas de recomendación y aplicaciones de IA que requieren una búsqueda y un filtrado vectoriales rápidos y escalables.

22. Sistema de control de versiones de datos LakeFS

LakeFS es un sistema de control de versiones de datos de código abierto que incorpora operaciones similares a las de Git al almacenamiento de objetos, lo que permite a los equipos gestionar los lagos de datos con los mismos flujos de trabajo que se utilizan para el código. Permite un control de versiones de datos escalable y fiable para entornos de datos a gran escala.

Características principales:

- Operaciones similares a las de Git (bifurcar, confirmar, combinar) para datos en el almacenamiento de objetos

- Ramificación sin copias para una rápida experimentación y colaboración

- Ganchos de preconfirmación y combinación para comprobaciones de calidad de datos y CI/CD

- Capacidades de reversión y recuperación para solucionar rápidamente los problemas de datos

- Control de versiones escalable para grandes lagos de datos, hasta una escala de exabytes

- Compatible con los principales servicios de almacenamiento en la nube

Ideal para:

Ingenieros de datos y organizaciones que gestionan grandes lagos de datos y necesitan un control de versiones fiable, experimentación segura y flujos de trabajo de datos reproducibles a escala.

23. Violinista

Fiddler AI es una plataforma de monitoreo y explicabilidad de modelos que ayuda a los equipos a comprender, depurar y rastrear los modelos de aprendizaje automático en producción. Proporciona información clara sobre el comportamiento, el rendimiento y la calidad de los datos de los modelos a través de una interfaz intuitiva.

Características principales:

- Supervisión del rendimiento con detección y análisis detallados de desviaciones de datos

- Comprobaciones de integridad de los datos para evitar que los datos de entrenamiento sean incorrectos o corruptos

- Detección de valores atípicos para anomalías univariadas y multivariantes

- Métricas de servicio para monitorear las operaciones y el estado del sistema ML

- Herramientas de explicabilidad para comprender y depurar las predicciones de los modelos

- Alertas y notificaciones sobre problemas de modelos en producción

Ideal para:

Ingenieros de aprendizaje automático, científicos de datos y organizaciones que necesitan una supervisión transparente de los modelos, capacidad de explicación y alertas proactivas para mantener sistemas de aprendizaje automático de producción confiables.

24. Rayo

Ray es un marco de computación distribuida que ayuda a los desarrolladores a escalar las aplicaciones de IA y Python con facilidad. Proporciona un tiempo de ejecución flexible y un conjunto de bibliotecas de IA para crear, entrenar e implementar sistemas de aprendizaje automático a escala.

Características principales:

- Tiempo de ejecución distribuido para escalar las cargas de trabajo de Python e IA en clústeres

- Abstracciones principales: tareas (funciones sin estado), actores (trabajadores con estado) y objetos (datos inmutables compartidos)

- Procesamiento de datos escalable para grandes conjuntos de datos de aprendizaje automático

- Capacitación distribuida para modelos de aprendizaje automático y aprendizaje profundo

- Ajuste de hiperparámetros para optimizar el rendimiento del modelo

- Soporte de aprendizaje por refuerzo para cargas de trabajo de IA avanzadas

- Modelo escalable que sirve para despliegues de producción

Ideal para:

Desarrolladores, ingenieros de aprendizaje automático y equipos de inteligencia artificial que necesitan un marco flexible y de alto rendimiento para escalar la capacitación, el procesamiento de datos y la prestación de modelos en entornos distribuidos.

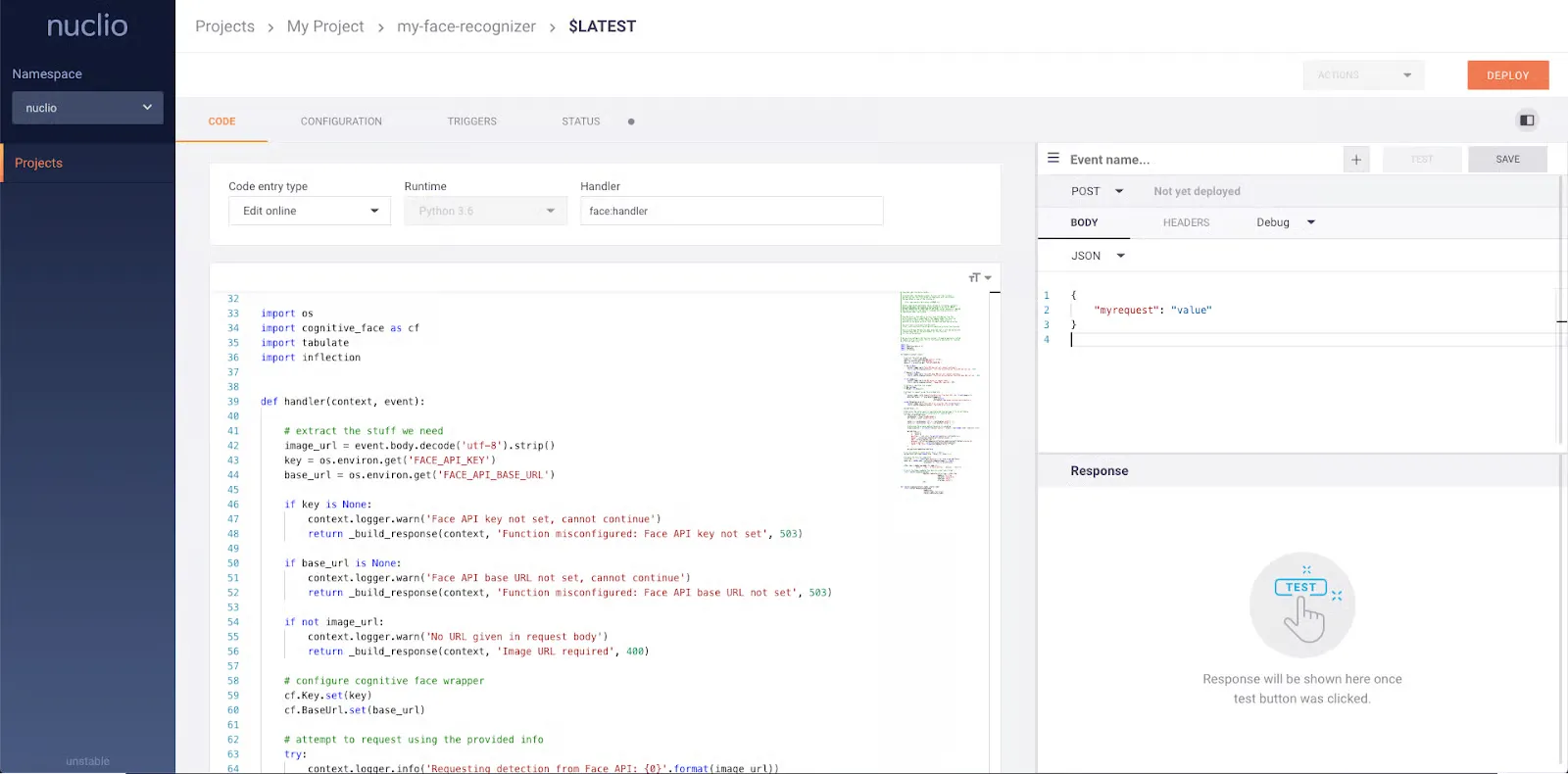

25. Nuclio

Nuclio es un marco sin servidor de alto rendimiento diseñado para cargas de trabajo con uso intensivo de datos, E/S y computación. Permite el procesamiento en tiempo real sin necesidad de administrar servidores y se integra bien con las herramientas de ciencia de datos y las plataformas de aprendizaje automático.

Características principales:

- Ejecución sin servidor con procesamiento en tiempo real y alto paralelismo

- Uso eficiente de los recursos de CPU, GPU y E/S

- Integración con herramientas populares como Jupyter y Kubeflow

- Soporte para diversas fuentes de datos y streaming

- Funciones con estado y aceleración de rutas de datos para un procesamiento más rápido

- Portátil en plataformas de nube, dispositivos periféricos y entornos de bajo consumo

- Diseño preparado para la empresa para cargas de trabajo de producción escalables

Ideal para:

Organizaciones y equipos de aprendizaje automático que necesitan una plataforma de alto rendimiento y sin servidores para el procesamiento de datos en tiempo real, la transmisión y las cargas de trabajo de IA escalables en entornos de nube y perimetrales.

Ventajas de las herramientas mLOps

Las mejores herramientas de MLOps ayudan a las organizaciones a administrar el ciclo de vida integral del aprendizaje automático de manera más eficiente. Aportan automatización, colaboración y confiabilidad a la creación, la implementación y el mantenimiento de los sistemas de aprendizaje automático.

1. Acelere el desarrollo del modelo

Las herramientas de MLOps automatizan las tareas repetitivas, como la preparación de datos, el seguimiento de experimentos y la organización de canalizaciones. Esto permite a los equipos realizar iteraciones más rápido, reducir los errores manuales y pasar los modelos de la idea a la producción con mayor rapidez.

2. Mejore la colaboración en equipo

Estas herramientas proporcionan espacios de trabajo compartidos, activos versionados y documentación clara, lo que facilita que los científicos de datos, los ingenieros y las partes interesadas colaboren, revisen los cambios y compartan información entre los equipos.

3. Mejore el rendimiento y la calidad del modelo

Con la supervisión, las pruebas y la validación integradas, las herramientas de mLOps ayudan a detectar problemas como la desviación de los datos, el sesgo y la degradación del rendimiento. Esto garantiza que los modelos sigan siendo precisos, confiables y estén alineados con los objetivos empresariales.

4. Control de versiones y reproducibilidad mejorados

Las plataformas MLOps rastrean las versiones de los datos, el código, los modelos y los experimentos, lo que permite a los equipos reproducir los resultados, auditar los cambios y mantener la coherencia en todos los entornos.

5. Despliegue y escalado simplificados de modelos

Simplifican la implementación de modelos en la producción mediante la automatización, los procesos de CI/CD y una infraestructura escalable, lo que permite a las organizaciones gestionar el aumento de las cargas de trabajo y adaptarse a las cambiantes demandas de manera eficiente.

Conclusión

MLOps ha pasado de ser una práctica especializada a convertirse en un componente fundamental de los flujos de trabajo modernos de aprendizaje automático. En 2026, las organizaciones ya no se preguntan si necesitan MLOps, sino qué plataforma se alinea mejor con sus objetivos, infraestructura y escala.

Como hemos visto, el panorama ofrece de todo, desde herramientas ligeras y modulares como MLFlow y DVC hasta soluciones empresariales totalmente administradas como Azure ML, Vertex AI y SageMaker.

Para los equipos que se centran en GenAI, el ajuste fino y la inferencia en tiempo real, las plataformas más nuevas, como TrueFoundry, ofrecen capacidades de vanguardia diseñadas para los desafíos modernos de la IA.

Operatice sus cargas de trabajo de ML y GenAI con mayor rapidez. Reserva una demostración con TrueFoundry para empezar.

Preguntas frecuentes

¿MLOps es mejor que DevOps?

mLOps no es mejor que DevOps; es una extensión de DevOps diseñada para el aprendizaje automático. Si bien DevOps se centra en la entrega de software y la automatización de la infraestructura, mLOps añade capacidades para la gestión de datos, el seguimiento de experimentos, la supervisión de modelos y la reproducibilidad, abordando los desafíos únicos de crear, implementar y mantener sistemas de aprendizaje automático en producción.

¿Cuál es la mejor herramienta de mLOps para la IA empresarial?

Las mejores herramientas de MLOps para empresas son aquellas que equilibran la velocidad de los desarrolladores con una gestión estricta de la infraestructura. Si bien los grandes proveedores de nube ofrecen amplios servicios, TrueFoundry suele ser la opción ideal para los equipos que requieren soberanía de datos y flexibilidad en la nube múltiple. Proporciona un plano de control unificado que se ejecuta de forma nativa dentro de su VPC privada, lo que le permite automatizar todo el ciclo de vida, desde la formación hasta la implementación, sin comprometer la seguridad ni el control de la infraestructura.

¿Docker es una herramienta de MLOps?

Docker es una tecnología fundamental para la contenedorización, lo que la convierte en una pieza fundamental del conjunto de herramientas de mLOps. Garantiza que los modelos se ejecuten de manera uniforme en todos los entornos de desarrollo y producción, aunque no gestiona tareas de nivel superior, como la supervisión de modelos o el control de versiones. TrueFoundry simplifica el proceso de contenedorización al crear automáticamente imágenes de Docker y organizarlas en Kubernetes, lo que permite a los científicos de datos implementar código sin necesidad de convertirse en expertos en DevOps.

¿Cómo funciona TrueFoundry para los MLOps?

TrueFoundry funciona como una capa de abstracción centrada en el desarrollador que se encuentra sobre su infraestructura de nube existente. Se conecta directamente a sus clústeres de Kubernetes y automatiza tareas complejas como el aprovisionamiento de recursos, la CI/CD y la entrega de modelos. Al proporcionar una interfaz única para gestionar los experimentos y las cargas de trabajo de producción, reduce los tiempos de implementación de semanas a minutos, al tiempo que reduce los costos mediante la optimización automatizada de la GPU y el soporte de instancias puntuales.

¿Qué nube es la mejor para una plataforma mLOps?

Ninguna nube es la mejor para los MLOps; la elección correcta depende de sus necesidades, herramientas y presupuesto. AWS, Azure y Google Cloud ofrecen servicios sólidos de MLOps, que incluyen canalizaciones automatizadas, capacitación escalable y monitoreo de modelos. Los equipos suelen elegir en función de la infraestructura existente, los requisitos de cumplimiento y la integración con su ecosistema de datos.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)