LLM Access Control: protección de modelos y cargas de trabajo de IA en producción

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Introducción

A medida que las organizaciones adoptan los LLM en todos los equipos y aplicaciones, el acceso a los modelos se convierte rápidamente en un problema de seguridad y gobierno. Lo que comienza como una única clave de API compartida entre servicios a menudo se convierte en docenas de aplicaciones, agentes y flujos de trabajo que invocan modelos con poca visibilidad o control.

Esto crea un riesgo real. Sin un control de acceso adecuado, los equipos no pueden restringir fácilmente quién puede usar modelos específicos, evitar el uso indebido por parte de los agentes o auditar el modo en que se accede a los sistemas de IA en producción. Las claves de API y los permisos de SDK a nivel de proveedor no están diseñados para gestionar estos requisitos a escala.

Control de acceso LLM aborda esta brecha al establecer quién puede acceder a qué modelos, indicaciones, agentes y herramientas en tiempo de ejecución. En lugar de basarse en credenciales estáticas integradas en el código, las decisiones de acceso se evalúan de forma centralizada a medida que se ejecutan las solicitudes.

En este blog, explicaremos qué significa el control de acceso LLM en la práctica, por qué es difícil de implementar en los sistemas de producción y cómo las arquitecturas basadas en pasarelas permiten cargas de trabajo de IA seguras y auditables.

¿Qué significa el control de acceso LLM?

Control de acceso LLM es el marco que determina quién o qué está permitido para interactuar con sus activos de IA y en qué condiciones específicas. En un entorno de TI tradicional, estamos acostumbrados a controlar el acceso a los archivos o servidores. En la era de la IA, el «activo» es más dinámico. Es una combinación de inteligencia bruta (el modelo), capacidad autónoma (el agente) y acción externa (las herramientas).

Para construir un perímetro seguro, el control de acceso debe aplicarse en estas tres dimensiones críticas.

¿Quién puede acceder a qué modelos?

No todos los usuarios de una organización necesitan acceder a todos los modelos. Por ejemplo, es posible que un desarrollador que pruebe una nueva función solo necesite acceder a un modelo de código abierto como Llama 3, mientras que un científico de datos de alto nivel puede necesitar la capacidad de razonamiento de GPT-4o o Claude 3.5 Sonnet.

El control de acceso a nivel de modelo le permite mantener el control en función del costo, la sensibilidad y la necesidad. Previene la «expansión de modelos», en la que los empleados podrían experimentar con proveedores externos no verificados, y garantiza que los tokens más caros se reserven para los usuarios que realmente los necesitan.

¿Quién puede desplegar agentes?

La implementación de un agente basado en LLM es fundamentalmente diferente a la utilización de un simple chatbot. Un agente es una entidad persistente que puede «pensar» en los pasos y ejecutar flujos de trabajo a lo largo del tiempo.

Si el control de acceso es débil, cualquier usuario podría implementar técnicamente un agente autónomo que se ejecute en segundo plano, lo que podría entrar en bucles recursivos o realizar miles de llamadas a la API no autorizadas.

En este caso, la gobernanza significa definir qué equipos tienen el permiso de «implementación», garantizando que cada agente tenga un propietario claro y una vida útil estrictamente definida.

¿Quién puede invocar las herramientas?

Esta es la capa más crítica de las tres. Cuando le das a un LLM acceso a «herramientas» como su CRM, su documentación interna o su servidor de correo electrónico, lo está poniendo manos a la obra.

El control de acceso granular significa definir con precisión a qué herramientas puede recurrir un agente. Un bot de atención al cliente podría tener permiso para leer una base de conocimientos, pero debe estar estrictamente bloqueada desde escribir a una base de datos de producción.

Sin permisos a nivel de herramienta, un simple ataque de inyección rápida podría engañar a un agente para que utilizara sus privilegios de alto nivel para filtrar datos o eliminar registros críticos. Un verdadero control de acceso garantiza que, incluso si una solicitud malintencionada pone en peligro un LLM, su capacidad para causar daños se vea limitada físicamente por el alcance de sus permisos.

Desafíos comunes del control de acceso

A medida que los equipos trasladan las cargas de trabajo de LLM a la producción, los problemas de control de acceso no suelen deberse a intenciones malintencionadas, sino a atajos utilizados durante la experimentación inicial. Estas brechas se convierten en graves problemas a medida que el uso aumenta entre los equipos, los agentes y los entornos.

Claves de API compartidas

Muchos equipos comienzan con una única clave de API compartida para un proveedor de modelos en varios servicios o desarrolladores. Si bien es práctico, este enfoque elimina cualquier noción de identidad o responsabilidad.

Las claves compartidas hacen que sea imposible distinguir entre usuarios, aplicaciones o agentes. Si una clave se filtra o se utiliza indebidamente, todo el sistema queda expuesto. La revocación del acceso de un usuario normalmente implica interrumpir el acceso de todos, lo que supone un riesgo desde el punto de vista operativo en los entornos de producción.

Registros de auditoría faltantes

La seguridad y el cumplimiento empresarial dependen de la capacidad de responder a una pregunta sencilla: ¿quién accedió a qué y cuándo?

Sin una capa de control de acceso centralizada, el uso de la LLM se distribuye en entornos locales, ordenadores portátiles, canalizaciones de CI y paneles de control de terceros. Esta fragmentación dificulta la reconstrucción de los eventos después de un incidente. Si se exponen datos confidenciales o un modelo se comporta de forma inesperada, los equipos suelen carecer del registro de auditoría necesario para rastrear la causa raíz.

Para las industrias reguladas, la falta de auditabilidad se considera un fracaso de la postura de seguridad, independientemente de la intención.

Agentes con permisos excesivos

Los agentes suelen necesitar privilegios elevados para realizar un trabajo útil, pero con frecuencia se les concede un acceso más amplio del necesario. Es habitual que los agentes se desplieguen con acceso sin restricciones a las herramientas, los almacenes de datos o las API simplemente para evitar la sobrecarga de configuración.

Esto crea un escenario de alto riesgo en el que los modelos potentes, las herramientas con privilegios excesivos y las vulnerabilidades de inyección rápida se combinan para amplificar el impacto. Si se manipula a un agente mediante un aviso malintencionado, sus permisos excesivos le permiten causar daños reales, como la exfiltración de datos o acciones destructivas. Por lo tanto, es fundamental limitar los permisos de los agentes para reducir el radio de explosión.

Capacidades clave de control de acceso

El control de acceso efectivo de la LLM requiere varios niveles de aplicación que funcionen de manera uniforme entre los usuarios, las aplicaciones y los agentes. Estas capacidades deben aplicarse en tiempo de ejecución e integrarse en los sistemas de identidad y seguridad empresariales existentes.

Control de acceso basado en roles (RBAC)

El RBAC garantiza que los permisos estén vinculados a los roles y no a los usuarios individuales. En un contexto de inteligencia artificial, esto permite a las organizaciones definir límites claros entre los administradores, los desarrolladores y los usuarios finales.

Por ejemplo, es posible que los desarrolladores puedan experimentar con modelos e indicaciones en entornos que no sean de producción, mientras que los usuarios finales solo pueden interactuar con agentes aprobados. La integración de RBAC con los proveedores de identidad existentes permite la incorporación automática y la revocación del acceso a medida que cambia la composición del equipo.

Aislamiento del entorno

Separar los entornos de desarrollo, preparación y producción es esencial para controlar el riesgo. Las políticas de control de acceso deben garantizar que los modelos, las herramientas y las credenciales con altos privilegios solo sean accesibles desde entornos de producción con medidas de seguridad adicionales.

Esto evita que las cargas de trabajo experimentales interactúen accidentalmente con datos de producción confidenciales y reduce el riesgo de que los usuarios finales reciban cambios no deseados.

Permisos a nivel de modelo

Los diferentes modelos tienen diferentes perfiles de costo, capacidad y exposición de datos. Los permisos a nivel de modelo permiten a los equipos restringir el acceso en función de estos factores.

Los modelos costosos o delicados pueden limitarse a equipos o proyectos específicos, mientras que se puede conceder un acceso más amplio a los modelos de menor costo o autohospedados. Esto ayuda a controlar los gastos y reduce la exposición a proveedores externos cuando no son necesarios.

Permisos a nivel de herramienta

El control de acceso a nivel de herramienta define qué acciones puede realizar un agente una vez que se invoca. En lugar de conceder un acceso amplio a la API, los permisos deben centrarse en funciones u operaciones específicas.

Por ejemplo, a un agente se le puede permitir leer desde un repositorio de documentos, pero se le puede impedir modificar o eliminar registros. La imposición de permisos en este nivel limita el impacto de un razonamiento incorrecto o una manipulación rápida y protege los sistemas principales incluso cuando los agentes se comportan de forma inesperada.

Control de acceso LLM a través de pasarelas

La gestión del control de acceso a nivel de aplicación no se amplía en los sistemas de IA de producción. Cuando varios equipos, agentes y servicios se integran directamente con diferentes proveedores de modelos, las políticas de acceso se fragmentan y es difícil aplicarlas de manera coherente.

Un Puerta de enlace de IA soluciona este problema actuando como una capa de aplicación centralizada entre las aplicaciones y los proveedores de modelos. En lugar de integrar las credenciales y los permisos en todos los servicios, se evalúa el control de acceso en tiempo de ejecución, antes de que una solicitud llegue a una modelo.

Punto de cumplimiento centralizado

La puerta de enlace sirve como punto único de autenticación y autorización para todo el tráfico de LLM. Las credenciales de los proveedores se almacenan de forma segura en la puerta de enlace, en lugar de distribuirse entre el código de la aplicación.

Las aplicaciones y los agentes se autentican en la puerta de enlace mediante identidades administradas. Esto permite a los equipos de seguridad revocar el acceso, rotar las claves de los proveedores o actualizar las políticas de forma centralizada sin tener que volver a implementar las aplicaciones. Si un servicio o un agente se ven comprometidos, su acceso se puede deshabilitar inmediatamente en la capa de puerta de enlace.

Decisiones de acceso basadas en políticas

Más allá de la simple autenticación, una puerta de enlace permite control de acceso basado en políticas. Cada solicitud se puede evaluar en función de atributos contextuales como:

- Identidad de usuario o servicio

- Asociación de equipos o proyectos

- Modelo o proveedor objetivo

- Entorno de ejecución

En función de estos atributos, la puerta de enlace puede permitir, denegar o redirigir las solicitudes de acuerdo con las políticas definidas. Esto permite un control detallado, como restringir los modelos de alto costo a equipos específicos o impedir que ciertos agentes accedan a herramientas confidenciales.

Auditoría y trazabilidad del tiempo de ejecución

Como todas las solicitudes pasan por la pasarela, se convierte en la fuente autorizada de datos de auditoría. Cada invocación de un modelo se puede registrar con un contexto completo, incluido quién inició la solicitud, a qué modelo se accedió y cómo se gestionó la solicitud.

Este registro de auditoría centralizado es fundamental para el análisis forense y de cumplimiento. Permite a las organizaciones reconstruir los eventos con precisión y demostrar un acceso controlado a los sistemas de inteligencia artificial durante las revisiones o auditorías de seguridad.

Al trasladar el control de acceso a la puerta de enlace, los equipos pasan de permisos implícitos dispersos a políticas explícitas y aplicables que escalan con la complejidad del sistema y el crecimiento organizacional.

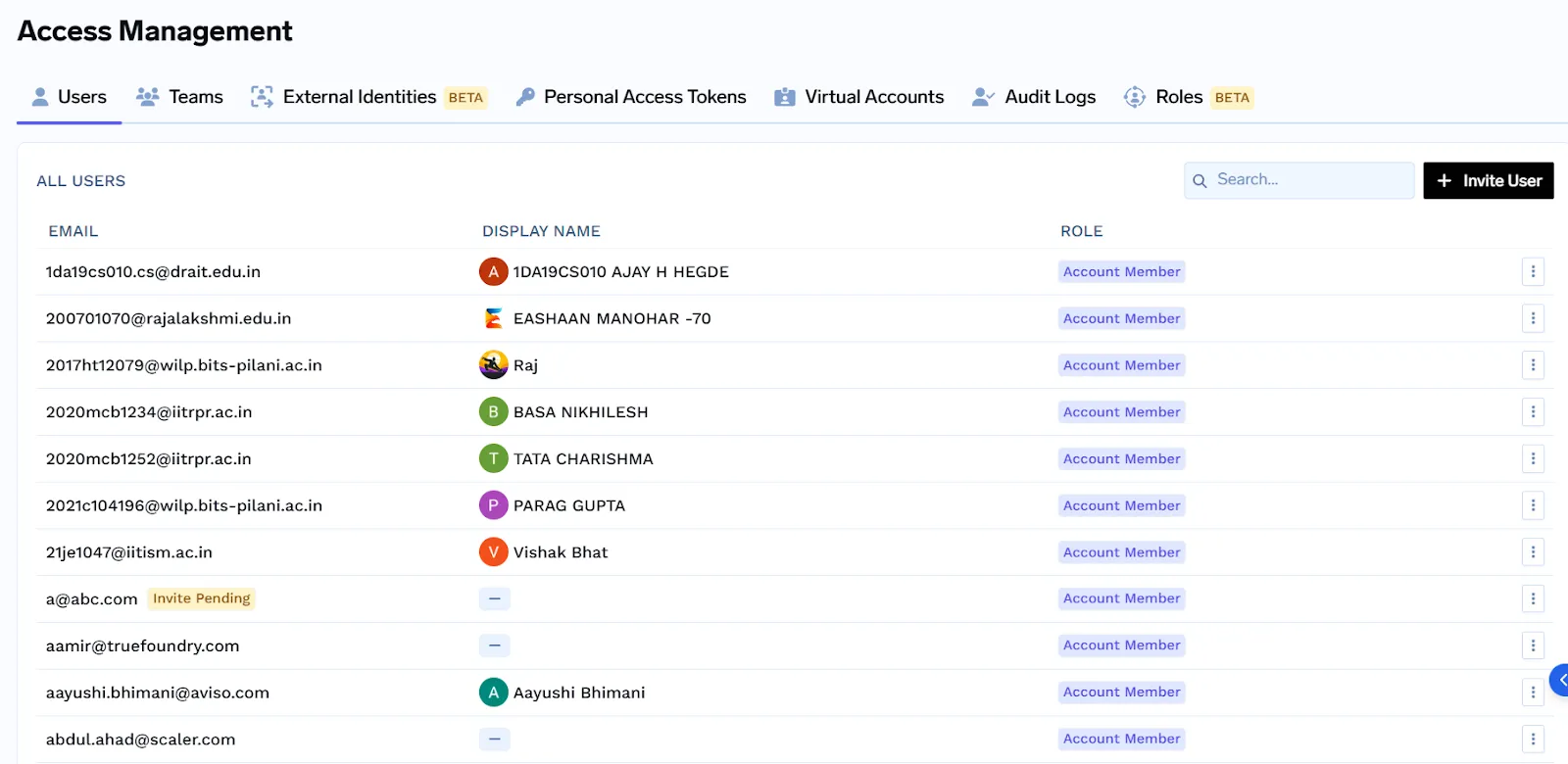

Cómo implementa TrueFoundry el control de acceso LLM

True Foundry toma los requisitos teóricos del control de acceso y los convierte en una realidad lista para la producción. Operando como plano de control unificado, permite a los equipos de la plataforma gestionar miles de modelos y usuarios desde una única interfaz sin introducir una latencia que provoque cuellos de botella.

Controles a nivel de puerta de enlace para la gobernanza

La puerta de enlace de IA de TrueFoundry proporciona varios controles granulares configurados a nivel de cuenta del proveedor a través de la interfaz de usuario. Estas funciones garantizan que gobernanza está integrado en la infraestructura en lugar de ser una idea de último momento.

Control de acceso y permisos La plataforma utiliza dos niveles de permisos distintos para las cuentas de los proveedores a fin de separar las tareas administrativas del uso diario:

- Gestor de cuentas de proveedores: Estos usuarios tienen las llaves del reino. Pueden modificar la configuración de la cuenta, añadir o eliminar modelos y gestionar los permisos de acceso de otros miembros del equipo.

- Usuario de la cuenta de proveedor: Estos usuarios pueden interactuar con los modelos para obtener inferencias, pero están estrictamente bloqueados para que no puedan cambiar los ajustes subyacentes o las configuraciones de seguridad.

Acceso administrado mediante tokens Para gestionar las diferentes necesidades de los desarrolladores y los sistemas de producción, TrueFoundry ofrece dos tipos de claves:

- Tokens de acceso personal (PAT): Están vinculadas a usuarios individuales. Son ideales para las pruebas y la experimentación locales porque permiten a la organización realizar un seguimiento del uso por desarrollador.

- Tokens de acceso virtual (VAT): No están vinculadas a una persona específica. Son la opción recomendada para las aplicaciones de producción. Como son independientes de las cuentas individuales de los empleados, tus servicios no se interrumpirán si un desarrollador específico deja la empresa.

Preparación para la seguridad y el cumplimiento

La seguridad en TrueFoundry es una defensa de varios niveles. Comienza con el nivel empresarial autenticación usando OIDC, JWT y claves de API administradas, asegurándose de que cada solicitud tenga una identidad verificada detrás de ella. A esto le sigue Autorización mediante el control de acceso basado en roles (RBAC), lo que garantiza que los usuarios solo vean los modelos y las herramientas que están autorizados a usar.

Para protegerse contra las amenazas emergentes de la IA, la puerta de enlace integra Barandas para la seguridad del contenido. Estos incluyen el tiempo real Detección de PII para evitar filtraciones de datos confidenciales, moderación para bloquear contenido tóxico y filtros específicos para detener los ataques de inyección inmediata. Cada interacción se graba a través de Registro de solicitudes y respuestas, crear un registro de auditoría inmutable que es esencial para el cumplimiento y la depuración forense.

Controles de configuración avanzada

Más allá del simple acceso, la pasarela proporciona controles técnicos para mantener el sistema estable y rentable:

- Límite de velocidad: Proteja su infraestructura del abuso estableciendo límites en las solicitudes o los tokens.

- Controles presupuestarios: Defina los límites de gasto para evitar picos de facturación inesperados.

- Equilibrio de carga y respaldo: Distribuya automáticamente el tráfico entre modelos en buen estado y redirija las solicitudes si un proveedor específico falla.

Conclusión

Proteger la frontera de la IA empresarial no consiste en frenar la innovación. Se trata de construir las barreras que hagan que la experimentación sea segura. Al dejar de lado las claves compartidas y adoptar un modelo centralizado y basado en pasarelas, las organizaciones pueden por fin tratar a los LLM como ciudadanos de primera clase en su sistema de seguridad. Con permisos granulares y registros de auditoría sólidos, la transición del prototipo a la producción se convierte en una ventaja estratégica. La verdadera gobernanza no solo protege sus datos, sino que permite a sus equipos construir con confianza.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)