Die 9 besten Cloudflare-KI-Alternativen und Wettbewerber für 2026

Auf Geschwindigkeit ausgelegt: ~ 10 ms Latenz, auch unter Last

Unglaublich schnelle Methode zum Erstellen, Verfolgen und Bereitstellen Ihrer Modelle!

- Verarbeitet mehr als 350 RPS auf nur 1 vCPU — kein Tuning erforderlich

- Produktionsbereit mit vollem Unternehmenssupport

Wolkenflare KI hat sich schnell zu einer beliebten Wahl für Entwickler entwickelt, die einfache KI-Inferenz am Edge ausführen möchten. Für Anwendungsfälle wie Textgenerierung mit niedriger Latenz, grundlegende Bildverarbeitung oder nutzernahe Experimente bietet Cloudflare ein hervorragendes Entwicklererlebnis mit minimalem Einrichtungsaufwand.

Mit der Entwicklung der KI-Workloads in Richtung Anforderungen im Maßstab 2026 - Agentische Workflows, Routing mit mehreren Modellen, umfangreiche RAG-Pipelines und strenge Unternehmensführung — viele Teams stoßen mit dem Ansatz von Cloudflare allmählich an echte Grenzen.

Zu den häufigsten Reibungspunkten gehören:

- Anbieterbindung: Sie sind auf den kuratierten Modellkatalog von Cloudflare beschränkt und haben nur begrenzte Kontrolle über Versionen, Feinabstimmungen oder benutzerdefinierte Modelle.

- Datenschutz und Kontrolle: Inference läuft in der verwalteten Umgebung von Cloudflare und ist eine „Blackbox“ für Teams, die eine vollständige Isolierung auf VPC-Ebene oder regulatorische Garantien benötigen.

- Kosten im großen Maßstab: Serverlose Preise pro Anfrage können im Vergleich zu optimierten GPU-Clustern oder Spot-Instances teuer und unvorhersehbar werden.

- Eingeschränkter Lebenszyklus-Support: Cloudflare konzentriert sich in erster Linie auf Inferenz und überlässt Schulung, Feinabstimmung und tiefere Orchestrierung externen Systemen.

Mit zunehmender Reife der KI-Systeme suchen Teams zunehmend nach Cloudflare AI Alternativen die mehr Kontrolle, bessere Kosteneffizienz und eine breitere Modellflexibilität bieten, ohne die Geschwindigkeit der Entwickler zu beeinträchtigen.

In diesem Handbuch bewerten wir die Die besten Cloudflare AI-Alternativen und Konkurrenten für 2026, wobei ein besonderer Schwerpunkt auf Plattformen liegt, die ein ausgewogenes Verhältnis zwischen Benutzerfreundlichkeit und Infrastruktureigentum bieten. Wir werden auch hervorheben, warum Wahre Gießerei hat sich als erste Wahl für Unternehmen herauskristallisiert, die das Beste aus beiden Welten wollen: die Einfachheit von Cloudflare, kombiniert mit der Kontrolle und Skalierbarkeit, die der Betrieb von KI in ihrer eigenen Cloud bietet.

Wie haben wir Cloudflare-Alternativen bewertet?

Nicht jeder „Cloudflare-Konkurrent“ löst dasselbe Problem. Einige Plattformen sind für Experimente optimiert, andere für den reinen GPU-Zugriff, und nur wenige sind dafür konzipiert KI-Systeme in Produktionsqualität im großen Maßstab. Um einen fairen und praktischen Vergleich zu erstellen, haben wir jede Alternative anhand der folgenden Kriterien bewertet:

1. Kontrolle der Infrastruktur

Kann die Plattform in Ihrem eigenen AWS-, GCP- oder Azure-Konto ausgeführt werden oder sind Sie an eine vom Anbieter verwaltete Umgebung gebunden? Das Eigentum an der Infrastruktur wird für Datenschutz, Compliance und langfristige Kostenoptimierung immer wichtiger.

2. Flexibilität des Modells

Erlaubt Ihnen die Plattform die Bereitstellung? irgendein Modell einschließlich fein abgestimmter Llama 3, Mistral, kundenspezifischer Einbettungen oder proprietärer Modelle oder sind Sie auf einen festen Katalog beschränkt?

3. Kosteneffizienz im großen Maßstab

Wir haben die Preise für serverlose Aufschläge mit Optionen verglichen, die Folgendes unterstützen:

- Roher GPU-Zugriff

- Spot-Instanzen

- Automatische Skalierung von Kubernetes-Clustern

Plattformen, die vorhersehbare, transparente Kostenstrukturen bieten, schneiden bei großen Workloads besser ab.

4. Unterstützung für moderne KI-Workloads

Handhabt die Plattform:

- Agentische Arbeitsabläufe

- Große RAG-Pipelines

- Routing mit mehreren Modellen

- Tool- und MCP-basierte Ausführung

- Reine Edge-Inferenz reicht für viele Teams nicht mehr aus.

5. Erfahrung als Entwickler

Wie schnell können Entwickler vom Code zur Produktion übergehen? Wir haben die Probleme beim Onboarding, APIs, SDKs und die Komplexität des Betriebs am zweiten Tag bewertet.

6. Produktionsbereitschaft

Wir haben Beobachtbarkeit, Überwachung, Steuerung und Betriebskontrollen bewertet — Bereiche, die entscheidend werden, sobald KI-Systeme über Prototypen hinausgehen. Anhand dieser Kriterien haben wir die eingestuft Die 9 besten Cloudflare AI-Alternativen die am besten für Teams positioniert sind, die 2026 seriöse KI-Produkte entwickeln.

Die 9 besten Cloudflare-KI-Alternativen für 2026

Während KI-Systeme über die einfache Randinferenz hinausgehen und Agentische Workflows, umfangreiche RAG-Pipelines und Orchestrierung mit mehreren Modellen, Teams benötigen Plattformen, die weit mehr bieten als nur serverlose Inferenz-APIs.

Die folgenden Alternativen wurden aufgrund ihrer Lieferfähigkeit ausgewählt:

- Eigentum oder Flexibilität der Infrastruktur

- Modellfreiheit jenseits kuratierter Kataloge

- Kosteneffizienz im großen Maßstab

- Produktionsbereitschaft für moderne KI-Workloads

Wir beginnen mit der insgesamt stärksten Alternative für Teams, die KI 2026 ernsthaft skalieren wollen.

TrueFoundry (Die beste Gesamtalternative)

Wahre Gießerei ist eine Full-Stack-KI-Plattform, die für Teams entwickelt wurde, die KI-Workloads in Produktionsqualität ausführen möchten ihre eigene Cloud oder VPC, ohne auf die Geschwindigkeit der Entwickler zu verzichten. Im Gegensatz zu Cloudflare Workers AI, das die Infrastruktur vollständig abstrahiert, bietet TrueFoundry Teams kontrollieren, wo es darauf ankommt - und bietet gleichzeitig ein erstklassiges, PaaS-ähnliches Erlebnis.

TrueFoundry unterstützt den gesamten KI-Lebenszyklus, von der Schulung und Feinabstimmung bis hin zur Bereitstellung, Inferenz und Beobachtbarkeit. Im Kern ermöglicht es Teams, jedes Modell — ob Open Source oder proprietär — auf Kubernetes in AWS, GCP oder Azure bereitzustellen, mit integrierter Skalierung, Kostenkontrolle und Governance. Dadurch eignet es sich besonders für Unternehmen, die langlebige KI-Systeme und nicht für einfache Edge-Demos entwickeln.

Die wichtigsten Funktionen

- Stellen Sie KI-Workloads in Ihrer eigenen Cloud oder VPC bereit

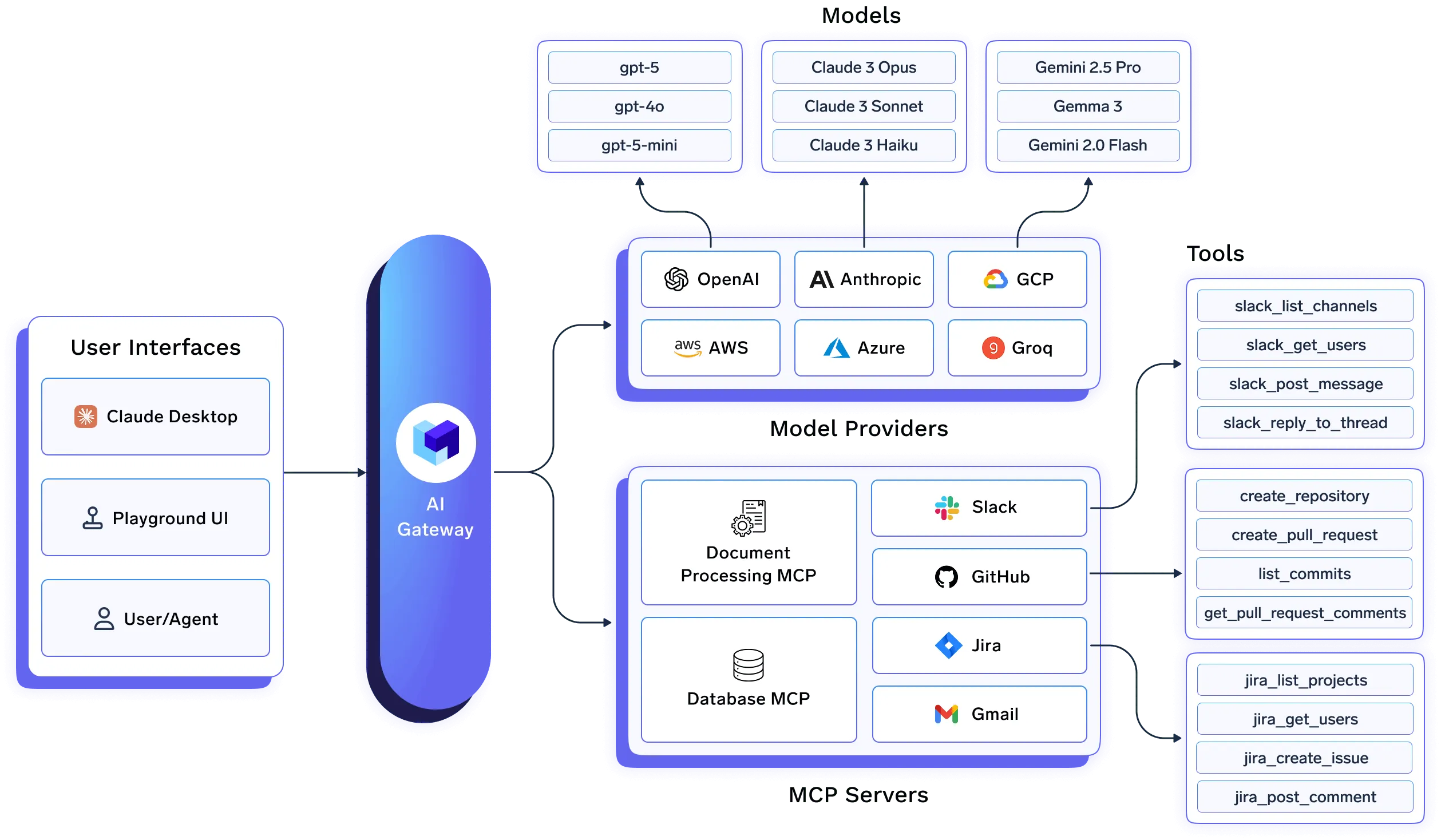

Führen Sie Inferenz- und Trainingsworkloads direkt in Ihrem AWS-, GCP- oder Azure-Konto auf Kubernetes aus und stellen Sie so die vollständige Datenverantwortung, Compliance und Netzwerkisolierung sicher. - KI-Gateway für Routing und Steuerung mehrerer Modelle

Leiten Sie den Traffic über mehrere LLM-Anbieter und selbst gehostete Modelle weiter, setzen Sie Budgets, Ratenlimits und Richtlinien durch und vermeiden Sie eine Anbieterbindung. - MCP- und Agentenregister

Verwalten Sie Tools, MCP-Server und Agentenausführung zentral und ermöglichen Sie so sichere und skalierbare agentische Workflows, die über einfache Inferenzen hinausgehen. - Schnelles Lebenszyklusmanagement

Versionieren, testen und implementieren Sie Eingabeaufforderungen systematisch, anstatt sie als ungetrackten Anwendungscode zu behandeln. - Integrierte Beobachtbarkeit und Kostentransparenz

Verfolgen Sie Tokens, Latenzen, Fehler und Ausgaben auf Anforderungsebene — modell-, team- und umgebungsübergreifend. - Autoscaling und GPU-Optimierung auf Produktionsniveau

Verwenden Sie Autoscaling, Spot-Instances und optimierte GPU-Planung, um die Inferenzkosten im Vergleich zu serverlosen Preismodellen erheblich zu senken.

Warum TrueFoundry eine bessere Wahl ist als Cloudflare Workers AI

Cloudflare zeichnet sich durch Edge-basierte Inferenz aus, TrueFoundry ist jedoch dafür konzipiert Eigenverantwortung, Umfang und Flexibilität:

- Keine Modellbindung, stellen Sie jedes Open-Source-Modell oder ein benutzerdefiniertes Modell bereit

- Vollständiger Datenschutz auf VPC-Ebene

- Kalkulierbare Kosten durch optimierte Rechenleistung anstelle von Preisen pro Anfrage

- Unterstützung für Agenten, RAG-Pipelines und komplexe Workflows

- Deckt den gesamten KI-Lebenszyklus ab, nicht nur Inferenz

Preispläne

TrueFoundry folgt einem transparentes, nutzungsabhängiges Preismodell, abgestimmt auf die Art und Weise, wie Teams die Infrastruktur tatsächlich nutzen.

- Kostenloses Kontingent: Ideal für Experimente und kleine Teams

- Wachstumsebene: Für Produktionsworkloads mit Beobachtbarkeits- und Skalierungsanforderungen

- Stufe „Enterprise“: Erweiterte Governance, Sicherheit und benutzerdefinierte Bereitstellungen

Da Workloads in Ihrer eigenen Cloud ausgeführt werden, bleiben die Infrastrukturkosten im Gegensatz zu undurchsichtigen serverlosen Preisen sichtbar und optimierbar.

Was Kunden über TrueFoundry sagen

TrueFoundry wird auf Plattformen wie G2 und Capterra hoch bewertet und immer wieder gelobt für:

- Einfache Bereitstellung von KI in privaten Cloud-Umgebungen

- Starke Kostentransparenz und -kontrolle

- Zuverlässige Unterstützung für KI-Systeme in der Produktion

Viele Kunden heben hervor, wie TrueFoundry ihnen geholfen hat, von Prototypen auf skalierbare, konforme KI-Plattformen umzusteigen, ohne ihren Stack neu aufbauen zu müssen.

ALS Bedrock

Amazon Web Services Bedrock ist der verwaltete Service von AWS für den Zugriff auf Basismodelle wie Anthropic Claude, Amazon Titan und ausgewählte Modelle von Drittanbietern. Es wurde für Teams entwickelt, die bereits tief in das AWS-Ökosystem investiert sind und eine native Methode zur Nutzung von LLMs suchen, ohne die Infrastruktur direkt zu verwalten.

Bedrock beseitigt zwar den Betriebsaufwand, aber es folgt immer noch eine verwaltetes, API-First-Modell das schränkt die Flexibilität ein, wenn die Workloads komplexer werden.

Die wichtigsten Funktionen

- Verwalteter Zugriff auf Stiftungsmodelle (Claude, Titan usw.)

- Native AWS-IAM-Integration

- Serverlose Inferenz-APIs

- Eingebaute Leitplanken und grundlegende Überwachung

Preispläne

- Pay-per-Request oder Token-basierte Preisgestaltung

- Separate Preisgestaltung pro Modellanbieter

- Zusätzliche AWS-Kosten für Protokollierung, Speicherung und Netzwerke

Profis

- Enge Integration mit AWS-Services

- Kein Infrastrukturmanagement erforderlich

- Unternehmensfreundliche Sicherheitsstandards

Nachteile

- Eingeschränkte Unterstützung für benutzerdefinierte oder fein abgestimmte Open-Source-Modelle

- Die Preisgestaltung wird in großem Maßstab teuer

- Konzentriert sich hauptsächlich auf Inferenz, nicht auf den vollständigen KI-Lebenszyklus

- Eingesperrt in das AWS-Ökosystem

Warum TrueFoundry besser ist als AWS Bedrock

TrueFoundry ermöglicht es Teams, jedes Modell auf ihrer eigenen Infrastruktur bereitstellen, einschließlich fein abgestimmter Open-Source-Modelle, die gleichzeitig durch Spot-Instances und Autoscaling eine bessere Kostenvorhersehbarkeit bieten. Im Gegensatz zu Bedrock ist TrueFoundry Cloud-unabhängig und unterstützt den gesamten KI-Lebenszyklus, der über verwaltete Inferenz-APIs hinausgeht.

Runpod

Pod ausführen ist eine GPU-Cloud-Plattform, die bei Entwicklern beliebt ist, die kostengünstigen Zugriff auf GPUs für Inferenzen oder Experimente wünschen. Sie wird häufig als Cloudflare-Alternative verwendet, wenn Teams der serverlosen Preisgestaltung nicht mehr gewachsen sind und die direkte Kontrolle über die Rechenleistung haben möchten.

Runpod konzentriert sich auf unformatierter GPU-Zugriffwobei Orchestrierung, Skalierung und Steuerung weitgehend dem Benutzer überlassen werden.

Die wichtigsten Funktionen

- On-Demand- und Spot-GPU-Instances

- Unterstützung für benutzerdefinierte Container

- Kostengünstigere GPUs im Vergleich zu Hyperscalern

- Einfache Bereitstellungsworkflows

Preispläne

- Stündliche GPU-Preise

- Niedrigere Kosten über Spot-Instances

- Zahlen Sie nur für die genutzte Rechenleistung

Profis

- Kostengünstiger GPU-Zugriff

- Gut für Experimente und kundenspezifische Modelle

- Flexibler containerbasierter Einsatz

Nachteile

- Eingeschränkte integrierte Beobachtbarkeit und Steuerung

- Kein natives KI-Gateway oder Verkehrsmanagement

- Erfordert erheblichen DevOps-Aufwand für die Produktion

- Nicht für komplexe Agentensysteme konzipiert

Warum TrueFoundry besser ist als Runpod

TrueFoundry bietet produktionsreife Orchestrierung, Beobachtbarkeit und Steuerung zusätzlich zu Kubernetes und ermöglicht gleichzeitig die Kostenoptimierung durch Spot-Instances. Teams profitieren von der reinen Recheneffizienz, ohne ihre eigene Plattformebene aufbauen und verwalten zu müssen.

Replizieren

Replizieren ist eine beliebte API-basierte Plattform, die es einfach macht, Open-Source-Modelle auszuführen, ohne die Infrastruktur zu verwalten. Entwickler können Modelle mit minimalem Einrichtungsaufwand bereitstellen und zahlen pro Sekunde für die Ausführung, was Replicate für das Prototyping und die Produktion in kleinem Maßstab attraktiv macht.

Der Komfort von Replicate ist jedoch mit Kompromissen verbunden, da die Workloads steigen und die Anforderungen an Datenschutz, Kostenvorhersehbarkeit und Anpassung steigen.

Die wichtigsten Funktionen

- Gehostete Inferenz für beliebte Open-Source-Modelle

- Einfache REST-APIs für den Modellaufruf

- Automatische Skalierung und Modellhosting

- Von der Community betriebener Modellkatalog

Preispläne

- Nutzungsabhängige Preisgestaltung (pro Sekunde der Ausführung)

- Verschiedene Tarife pro Modell und Hardwaretyp

- Keine festen Monatspläne

Profis

- Extrem einfacher Einstieg

- Kein Infrastruktur- oder DevOps-Overhead

- Gute Auswahl an Community-Modellen

Nachteile

- Eingeschränkte Kontrolle über Infrastruktur und Netzwerke

- Kosten können in großem Umfang unvorhersehbar werden

- Minimale Beobachtbarkeit und Steuerung

- Reines SaaS-Bereitstellungsmodell

Warum TrueFoundry besser ist als Replicate

TrueFoundry ermöglicht Teams führen dieselben Open-Source-Modelle in ihrer eigenen Cloud aus, mit vollständiger Beobachtbarkeit, Steuerung und Kostenoptimierung. Im Gegensatz zur Black-Box-Ausführung von Replicate bietet TrueFoundry den Plattformteams Transparenz und Kontrolle über Leistung, Daten und Ausgaben.

Google Vertex KI

Google Vertex KI ist die umfassende Plattform von Google Cloud für die Schulung, Bereitstellung und Bereitstellung von ML- und LLM-Modellen. Es unterstützt die Gemini-Modelle von Google sowie maßgeschneiderte Schulungen und verwaltete Pipelines und ist damit eine starke Option für Teams, die auf GCP standardisiert sind.

Vertex AI ist zwar leistungsstark, bleibt aber eng mit Google Cloud verbunden und verfolgt einen Managed-Service-Ansatz, der die Flexibilität für Hybrid- oder Multi-Cloud-Strategien einschränkt.

Die wichtigsten Funktionen

- Verwaltete Schulungs- und Inferenz-Pipelines

- Zugriff auf Gemini- und Drittanbietermodelle

- Integrierte MLOps und Experimentverfolgung

- Native GCP-Sicherheit und IAM-Integration

Preispläne

- Nutzungsabhängige Preisgestaltung für Schulung und Inferenz

- Separate Kosten für Rechenleistung, Speicher und Pipelines

- Premium-Preise für Managed Services

Profis

- Umfassende ML- und KI-Tools

- Starke Integration mit dem GCP-Ökosystem

- Skalierbarkeit auf Unternehmensebene

Nachteile

- In Google Cloud gesperrt

- Komplexes Preismodell

- Weniger Flexibilität für benutzerdefinierte Infrastrukturoptimierung

- Schwergewicht für Teams, die sich hauptsächlich auf Inferenz konzentrieren

Warum TrueFoundry besser ist als Google Vertex AI

TrueFoundry bietet eine Cloud-unabhängige, leichtere Plattform das sich auf Bereitstellung, Inferenz und Governance konzentriert, ohne Teams an einen einzigen Hyperscaler zu binden. Es bietet mehr Flexibilität, um Kosten zu optimieren und KI konsistent in AWS, GCP oder Azure auszuführen.

Modal

Modal ist eine serverlose Plattform für Entwickler, die es einfach macht, Python-basierte KI-Workloads auszuführen, ohne die Infrastruktur verwalten zu müssen. Sie ist beliebt für schnelle Experimente, interne Tools und einfache Inferenz-Pipelines.

Modal priorisiert die Geschwindigkeit der Entwickler, aber seine Abstraktionsebene kann einschränkend werden, wenn KI-Systeme an Komplexität und Skalierung zunehmen.

Die wichtigsten Funktionen

- Serverlose Python-Ausführung

- Automatische Skalierung für Inferenz-Workloads

- GPU-Unterstützung ohne Infrastrukturmanagement

- Einfache Entwickler-APIs

Preispläne

- Nutzungsabhängige Preisgestaltung

- Gebühren basieren auf Rechenzeit und Ressourcen

- Keine festen Preisstufen für Unternehmen, die öffentlich aufgeführt sind

Profis

- Exzellente Entwicklererfahrung

- Sehr schnelle Produktionszeit

- Minimaler DevOps-Overhead

Nachteile

- Eingeschränkte Kontrolle der Infrastruktur

- Weniger geeignet für komplexe, lang andauernde Agenten-Workflows

- Reine SaaS-Bereitstellung

- Eingeschränkte Verwaltung und Kostenvorhersehbarkeit in großem Maßstab

Warum TrueFoundry besser ist als Modal

TrueFoundry bietet volle Infrastruktureigenschaft und Lebenszykluskontrolle bei gleichzeitiger Beibehaltung einer starken Entwicklererfahrung. Es eignet sich besser für langlebige KI-Systeme in der Produktion, für die eine Steuerung, vorhersehbare Kosten und Unterstützung komplexer Pipelines erforderlich sind, die über eine einfache serverlose Ausführung hinausgehen.

Endpunkte der Gesichtsinferenz beim Umarmen

Umarmen Sie das Gesicht Inference Endpoints ermöglichen es Teams, Hugging Face-Modelle als verwaltete APIs mit minimalem Einrichtungsaufwand bereitzustellen. Es wird häufig verwendet, um Open-Source-Modelle schnell bereitzustellen und in Anwendungen zu integrieren.

Der verwaltete Service ist zwar praktisch, schränkt aber die Flexibilität für Teams ein, die strenge Kosten-, Netzwerk- oder Compliance-Anforderungen haben.

Die wichtigsten Funktionen

- Verwaltetes Hosting für Hugging Face-Models

- Unterstützung für beliebte Open-Source-Architekturen

- Automatische Skalierung von Inferenzendpunkten

- Einfache Integration mit dem Hugging Face-Ökosystem

Preispläne

- Stündliche Preisgestaltung basierend auf dem Instanztyp

- Separate Kosten für Berechnung und Autoscaling

- Höhere Kosten für größere GPUs

Profis

- Einfacher Zugriff auf Open-Source-Modelle

- Starkes Ökosystem und Gemeinschaft

- Niedrige Reibung beim Einrichten

Nachteile

- Eingeschränkte Kontrolle über die zugrunde liegende Infrastruktur

- Die Kosten steigen mit der Skalierung schnell

- Weniger geeignet für Multi-Cloud- oder Hybrid-Bereitstellungen

- Beobachtbarkeit und Steuerung sind von grundlegender Bedeutung

Warum TrueFoundry besser ist als das Umarmen von Face Inference-Endpunkten

TrueFoundry ermöglicht Teams stellen dieselben Hugging Face-Modelle in ihrer eigenen Cloud bereit, mit umfassenderer Beobachtbarkeit, Kostenkontrolle und Unterstützung für erweiterte Workflows wie Agenten und RAG-Pipelines — ohne an ein verwaltetes SaaS-Modell gebunden zu sein.

Beliebige Skala (Ray)

Beliebiger Maßstab ist die kommerzielle Plattform hinter Ray, einem Open-Source-Framework für verteilte Computer- und KI-Workloads. Es wird häufig von Teams verwendet, die umfangreiche, verteilte Inferenz-, Schulungs- und Agentensysteme aufbauen, die eine genaue Kontrolle über die Ausführung benötigen.

Anyscale ist mächtig, aber es geht davon aus, dass hohes Maß an Plattform- und verteilter Systemkompetenz, was Teams, die eine schnellere Produktionszeit wünschen, verlangsamen kann.

Die wichtigsten Funktionen

- Verwaltete Ray-Cluster

- Verteilte Inferenz und Training

- Native Unterstützung für parallele Workloads und Agenten-Workloads

- Skaliert über große GPU-Cluster

Preispläne

- Nutzungsabhängige Preisgestaltung

- Kosten im Zusammenhang mit Clustergröße und Laufzeit

- Unternehmenspreise für Managed Services

Profis

- Extrem flexibel und leistungsstark

- Ideal für komplexe, verteilte KI-Systeme

- Starke Open-Source-Grundlage

Nachteile

- Steile Lernkurve

- Erfordert Ray-spezifisches Fachwissen

- Weniger eigensinnig in Bezug auf Unternehmensführung und Kostenkontrolle

- Langsameres Onboarding für kleinere Teams

Warum TrueFoundry besser ist als Anyscale

TrueFoundry liefert produktionsreife Abstraktionen zusätzlich zu Kubernetes, ohne Teams zu zwingen, alles mit Ray-Primitiven zu erstellen. Es bietet ein schnelleres Onboarding, integrierte Beobachtbarkeit und Kostenkontrolle und unterstützt dennoch komplexe Workflows.

Lambda Labs

Lambda Labs bietet eine GPU-Cloud-Infrastruktur, die für Workloads für maschinelles Lernen optimiert ist. Es wird häufig als kostengünstige Alternative zu Hyperscalern für Training und Inferenz verwendet.

Lambda Labs konzentriert sich auf rohe Infrastrukturwobei Orchestrierung, Skalierung und Governance vollständig dem Benutzer überlassen werden.

Die wichtigsten Funktionen

- GPU-Instances auf Abruf

- Konkurrenzfähige Preise für High-End-GPUs

- Bare-Metal- und VM-basierte Bereitstellungen

- Geeignet für Training und Inferenz

Preispläne

- Stündliche Preisgestaltung nach GPU-Typ

- Keine gebündelten Plattformdienste

- Niedrigere Kosten im Vergleich zu großen Cloud-Anbietern

Profis

- Kostengünstiger GPU-Zugriff

- Gute Leistung bei Trainingsbelastungen

- Einfaches Infrastrukturmodell

Nachteile

- Keine Funktionen der verwalteten KI-Plattform

- Erfordert erheblichen DevOps-Aufwand

- Eingeschränkte Beobachtbarkeit und Steuerung

- Nicht für Produktionsumgebungen mit mehreren Teams optimiert

Warum TrueFoundry besser ist als Lambda Labs

TrueFoundry bietet eine komplette KI-Plattformschicht - Orchestrierung, Beobachtbarkeit, Skalierung und Governance — zusätzlich zur Cloud-Infrastruktur. Teams profitieren von den Kostenvorteilen einer optimierten Datenverarbeitung, ohne ihren eigenen Plattform-Stack zusammenstellen und warten zu müssen.

Ein detaillierter Vergleich von TrueFoundry und Cloudflare

Beide Plattformen helfen Teams zwar bei der Bereitstellung von KI-Modellen, TrueFoundry und Cloudflare Workers AI sind für grundlegend unterschiedliche Reifegrade der KI konzipiert. Die folgende Tabelle zeigt, wie sie im Vergleich zu den Dimensionen abschneiden, die für KI-Workloads im Maßstab 2026 am wichtigsten sind.

Warum TrueFoundry die strategische Wahl für 2026 ist

Da KI-Systeme für Produkte und Abläufe immer wichtiger werden, überdenken Teams, wo und wie Inferenzen ablaufen. Drei wichtige Trends erklären, warum Plattformen wie TrueFoundry gegenüber reinen Edge-Lösungen an Boden gewinnen.

Der hybride Wandel hin zu souveräner KI

Bis 2026 wollen viele Organisationen besitzen ihren Inferenzstapel anstatt sich ausschließlich auf verwaltete APIs zu verlassen. Die Ausführung von Modellen in Ihrer eigenen Cloud bietet bessere Garantien in Bezug auf Datenspeicherort, Compliance und langfristige Flexibilität. TrueFoundry wurde für diese hybride Realität entwickelt, während Cloudflare weiterhin für die zentralisierte Edge-Ausführung optimiert ist.

Kostenvorhersehbarkeit im großen Maßstab

Serverlose Inferenz ist praktisch, aber die Kosten können unvorhersehbar steigen, wenn der Verkehr und die Komplexität der Modelle zunehmen. TrueFoundry's Funktionen für FinOps und Kostentransparenz— kombiniert mit Spot-Instances und Autoscaling — trägt dazu bei, den „Rechnungsschock“ zu verhindern, dem Teams bei serverlosen Anbietern wie Cloudflare oder Replicate häufig begegnen.

Jenseits der Inferenz

Cloudflare Workers AI ist in erster Linie eine Inferenzschicht. TrueFoundry unterstützt dagegen die gesamter KI-Lebenszyklus von der Schulung und Feinabstimmung bis hin zu Einsatz, Inferenz, Beobachtbarkeit und Steuerung. Dies macht es zu einer besseren langfristigen Plattform für Teams, die KI als Kernfunktion und nicht nur als Zusatzfunktion entwickeln.

Bereit für die Skalierung? Wählen Sie den richtigen Infrastrukturpartner

Cloudflare Workers AI ist eine hervorragende Wahl für Edge-basierte Anwendungen, schnelles Experimentieren und entwicklerfreundliche, nutzernahe Inferenzen. Für Hobbyprojekte, Prototypen und latenzempfindliche Edge-Anwendungsfälle bietet es ein schnelles und elegantes Erlebnis.

Wenn sich die Teams jedoch darauf zubewegen KI-Systeme in Produktionsqualität Mit agentischen Workflows, großen RAG-Pipelines, kundenspezifischen Modellen und strenger Datenverwaltung überwinden viele die Einschränkungen eines vollständig verwalteten, serverlosen Modells. In dieser Phase werden die Eigentümerschaft der Infrastruktur, die Vorhersagbarkeit der Kosten und die Modellflexibilität entscheidend.

Das ist wo Wahre Gießerei fällt auf. TrueFoundry ermöglicht es Teams, KI-Workloads in ihrer eigenen Cloud oder VPC auszuführen und gleichzeitig ein PaaS-ähnliches Entwicklererlebnis beizubehalten. So bietet TrueFoundry die Flexibilität, die erforderlich ist, um KI im Jahr 2026 verantwortungsbewusst zu skalieren.

👉 Wenn Sie seriöse KI-Produkte entwickeln und eine langfristige Kontrolle über Kosten, Daten und Modelle haben möchten, eine Demo buchen kostenlos, um zu sehen, wie TrueFoundry in realen Bereitstellungen abschneidet.

Häufig gestellte Fragen

Was sind die Alternativen zu Cloudflare?

Zu den beliebten Cloudflare-KI-Alternativen gehören TrueFoundry, AWS Bedrock, Runpod, Replicate, Google Vertex AI, Modal, Hugging Face Inference Endpoints, Anyscale und Lambda Labs. Jede Plattform zielt auf verschiedene Stufen der KI-Reife ab, von schnellen Experimenten bis hin zur Serienbereitstellung.

Warum ist Cloudflare ein schlechtes Gateway?

Cloudflare ist nicht von Natur aus „schlecht“, kann aber für fortgeschrittene KI-Workloads zu Einschränkungen führen. Teams stehen oft vor Herausforderungen in Bezug auf Modellbindung, Datenschutz, Kostenvorhersehbarkeit und Unterstützung komplexer agentischer Systeme, wenn sie sich ausschließlich auf Cloudflare als KI-Gateway verlassen.

Was macht TrueFoundry zu einer besseren Alternative zu Cloudflare AI?

TrueFoundry bietet volle Infrastrukturverantwortung, Unterstützung für jedes Modell, vorhersehbare Kostenoptimierung und ein durchgängiges Lebenszyklusmanagement. Im Gegensatz zu Cloudflare Workers AI ermöglicht es Teams, über Edge-Inferenz hinauszugehen und skalierbare, konforme KI-Systeme in ihrer eigenen Cloud aufzubauen.

TrueFoundry AI Gateway bietet eine Latenz von ~3—4 ms, verarbeitet mehr als 350 RPS auf einer vCPU, skaliert problemlos horizontal und ist produktionsbereit, während LiteLM unter einer hohen Latenz leidet, mit moderaten RPS zu kämpfen hat, keine integrierte Skalierung hat und sich am besten für leichte Workloads oder Prototyp-Workloads eignet.

Der schnellste Weg, deine KI zu entwickeln, zu steuern und zu skalieren

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)