Qu'est-ce que la gouvernance de l'IA et pourquoi c'est important

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Alors que les organisations accélèrent l'adoption de l'IA, une question cruciale se pose : comment garantir la fiabilité, la conformité et l'alignement de nos systèmes d'IA sur nos valeurs ? La réponse réside dans la gouvernance de l'IA, une approche structurée pour gérer les systèmes d'IA tout au long de leur cycle de vie. Contrairement aux logiciels traditionnels, les systèmes d'IA apprennent à partir des données, s'adaptent au fil du temps et prennent des décisions ayant un impact sociétal significatif. De nombreuses organisations reconnaissent que l'IA met en évidence les limites des processus de gouvernance existants et accordent la priorité au renforcement des capacités d'IA responsable.

Les organisations qui mettent en œuvre de solides cadres de gouvernance de l'IA ne se contentent pas de réduire les risques, elles renforcent également leur avantage concurrentiel. Ils innovent plus rapidement et en toute confiance, gagnent la confiance des parties prenantes et gardent une longueur d'avance sur les réglementations en évolution rapide, telles que la loi européenne sur l'IA et le cadre de gestion des risques liés à l'IA (RMF) du NIST. La gouvernance moderne de l'IA nécessite une infrastructure capable de mettre en œuvre ces principes à grande échelle. Des plateformes comme True Foundry reliez la théorie et la pratique de la gouvernance en fournissant des contrôles centralisés, une observabilité en temps réel, une application automatisée des politiques et des garde-fous configurables, transformant ainsi la gouvernance d'une aspiration en une réalité applicable à toutes les charges de travail d'IA.

Qu'est-ce que la gouvernance de l'IA ?

La gouvernance de l'IA fait référence au cadre de politiques, de procédures et de contrôles qui guident le développement, le déploiement et la surveillance responsables de l'IA au sein d'une organisation. Il traduit des principes éthiques abstraits en pratiques concrètes et applicables.

Pensez à la gouvernance de l'IA comme à la fois un règlement et un arbitre. Le règlement définit des principes : équité, transparence, responsabilité et sécurité. L'arbitre veille à ce que ces principes soient respectés à chaque étape : de la collecte des données et de la formation des modèles au déploiement et à la surveillance continue. Une gouvernance efficace englobe des politiques opérationnelles définissant ce que les équipes peuvent faire avec l'IA, des contrôles techniques (limitation du débit, contrôles d'accès, journalisation des audits) qui appliquent automatiquement les politiques, des structures de supervision établissant la responsabilité et une surveillance continue permettant de détecter les problèmes à un stade précoce.

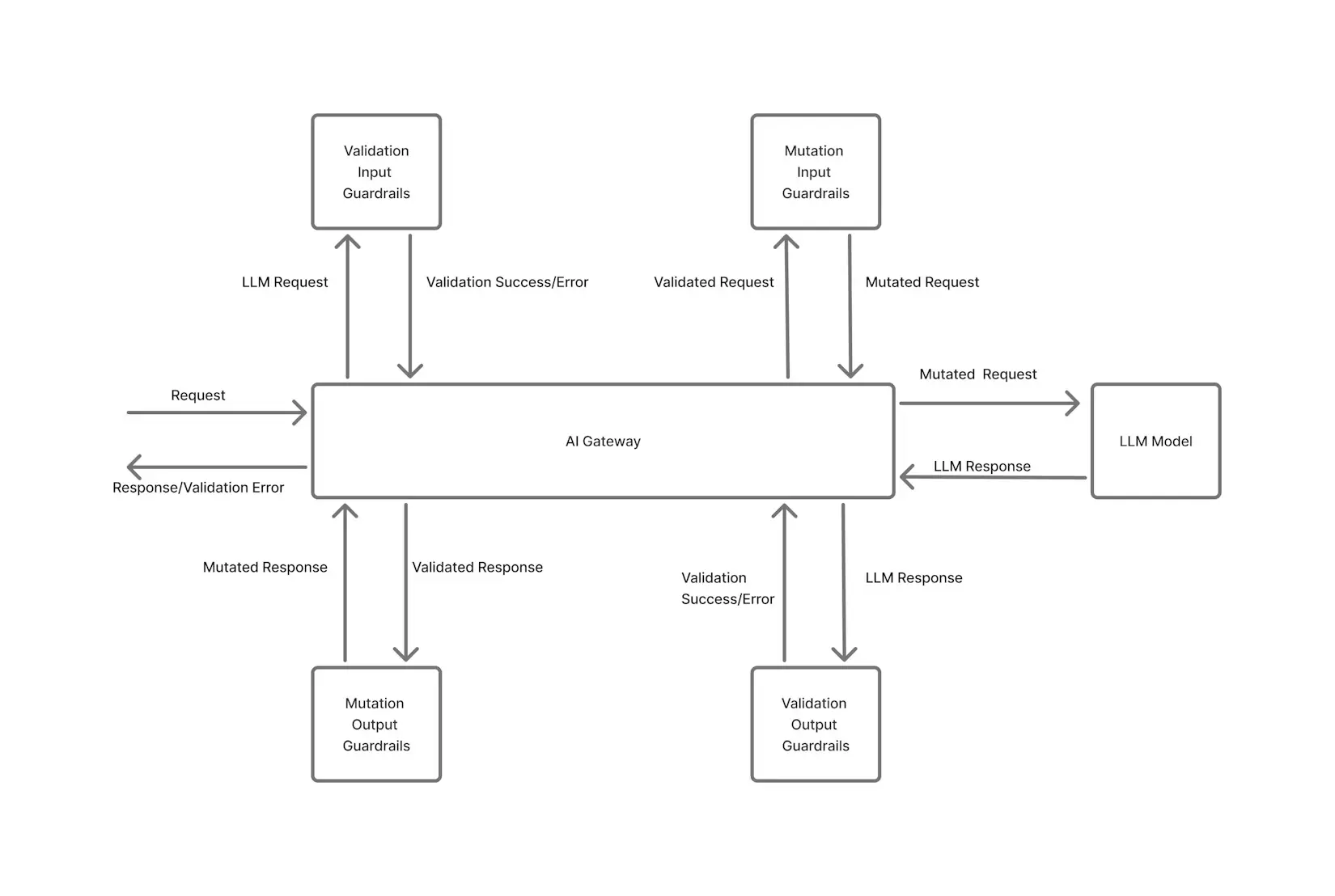

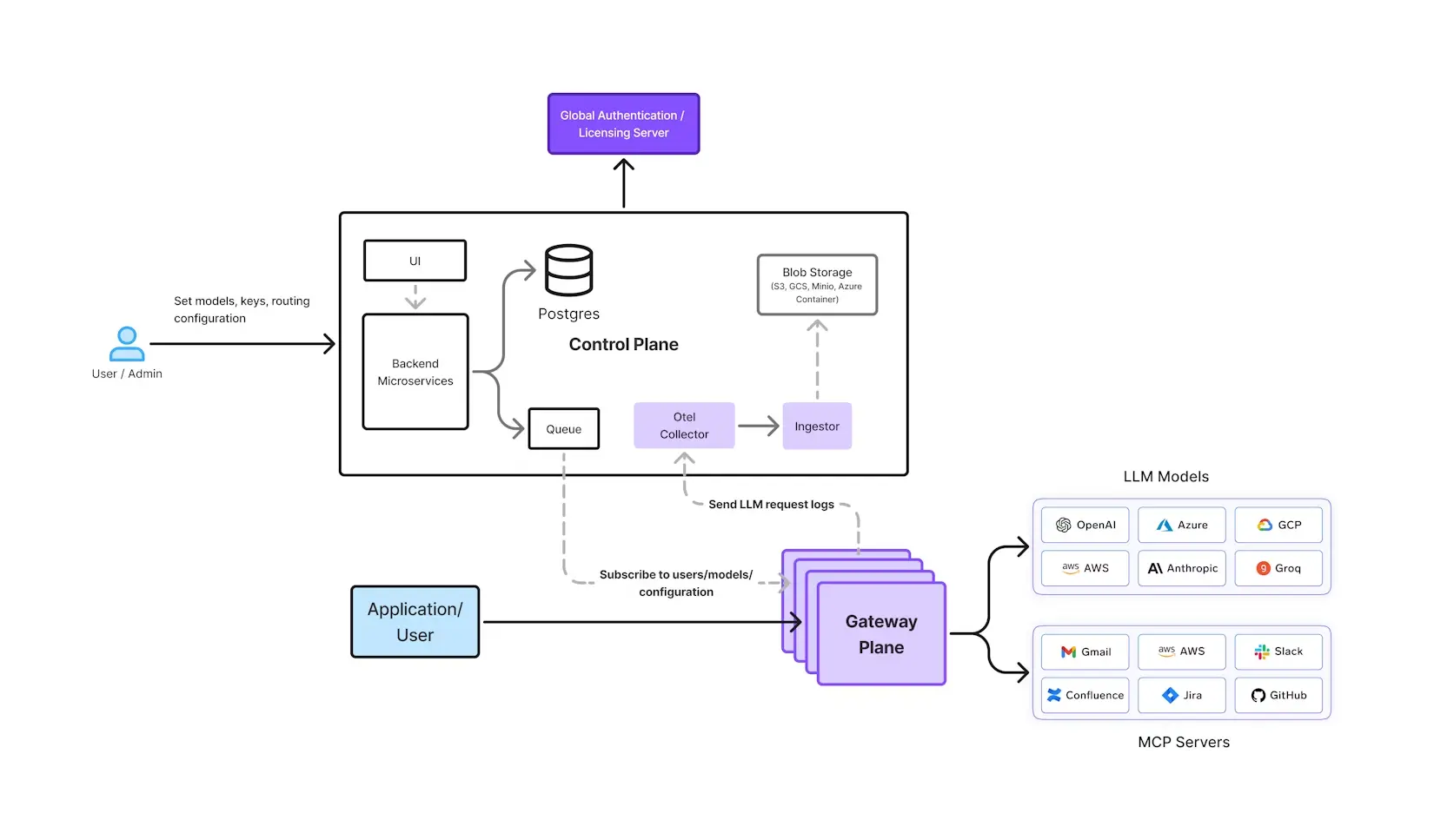

TrueFoundry Passerelle IA illustre la manière dont l'infrastructure moderne met en œuvre ces principes de gouvernance. Agissant comme un plan de contrôle centralisé pour toutes les interactions avec l'IA, la passerelle fournit une authentification et un contrôle d'accès unifiés via le protocole MCP (Model Context Protocol), permettant aux organisations de gérer des centaines d'outils et de modèles d'IA via une plateforme unique et gouvernée. Au lieu de disposer d'informations d'identification éparpillées et d'une prolifération d'outils non gérés, les équipes bénéficient d'une visibilité complète, de pistes d'audit et de l'application des politiques dans tous les flux de travail d'IA, ce qui rend la gouvernance fluide, évolutive et sécurisée.

Quels sont les niveaux de gouvernance de l'IA ?

La gouvernance de l'IA fonctionne à plusieurs niveaux, qu'il s'agisse de réglementations externes qui façonnent une utilisation responsable de l'IA ou de pratiques organisationnelles internes et de contrôles appliqués aux systèmes d'IA individuels. Chaque niveau joue un rôle distinct pour garantir que l'IA est éthique, sûre et responsable tout au long de son cycle de vie.

Pourquoi la gouvernance de l'IA est-elle importante ?

La gouvernance de l'IA est importante car elle fournit aux organisations la structure, les contrôles et la responsabilité nécessaires pour gérer les risques, maintenir la confiance et favoriser une innovation responsable.

Atténuer les risques juridiques et réglementaires. La loi européenne sur l'IA (2024) classe les systèmes d'IA par niveau de risque et impose des obligations strictes aux systèmes à haut risque, avec des amendes pouvant atteindre 7 % des recettes mondiales en cas de non-conformité. Des réglementations similaires apparaissent dans le monde entier, et les organisations dépourvues de cadres de gouvernance sont confrontées à une exposition juridique croissante.

Instaurer et maintenir la confiance. Des échecs très médiatisés (l'outil de recrutement biaisé d'Amazon, l'algorithme discriminatoire d'Apple pour les cartes de crédit, les préjugés raciaux du COMPAS dans les prévisions de condamnation) montrent à quel point les échecs de l'IA érodent la confiance du public. Les organisations qui adoptent des pratiques d'IA responsables gagnent la confiance des parties prenantes, attirent des talents et renforcent les relations avec les clients.

Permettre une innovation plus rapide et plus sûre. Une gouvernance bien conçue accélère l'innovation. Les organisations dotées de politiques claires et de contrôles automatisés peuvent déployer des modèles plus rapidement et en toute confiance. La gouvernance devient un facilitateur plutôt qu'une contrainte, permettant une itération rapide dans des limites sûres.

Garantir la qualité des données et la fiabilité des modèles. Les cadres de gouvernance imposent des pratiques telles que les audits de données, les tests de biais et la surveillance continue. Ils détectent les problèmes de qualité des données, la dérive des modèles et la dégradation des performances avant qu'ils n'aient un impact sur les utilisateurs ou les résultats commerciaux.

Optimisation des coûts et de l'allocation des ressources. Les cadres de gouvernance offrent une visibilité sur l'utilisation, les performances et les coûts des modèles, permettant aux entreprises de retirer les modèles peu performants et de prendre des décisions d'investissement fondées sur les données.

Principes fondamentaux de la gouvernance de l'IA

La gouvernance de l'IA définit les règles et les pratiques qui guident la manière dont les systèmes d'IA sont conçus et utilisés de manière responsable. Il aide les organisations à garantir l'équité, la transparence, la responsabilité et la conformité tout en réduisant les risques et en protégeant les personnes.

Voici les principes fondamentaux de la gouvernance de l'IA :

Transparence et explicabilité. Les utilisateurs et les régulateurs doivent comprendre comment les systèmes d'IA génèrent des résultats et prennent des décisions. Cela permet de résoudre le problème de la « boîte noire » grâce à des techniques telles que les valeurs SHAP et les journaux d'audit qui retracent les données qui ont influencé les prévisions.

Équité et non-discrimination. Les systèmes d'IA ne doivent pas perpétuer ou amplifier les biais existants par le biais de divers ensembles de données de formation, d'audits réguliers des biais et de mesures d'équité telles que la parité démographique ou l'égalisation des chances.

Responsabilité et supervision. Chaque décision en matière d'IA doit être retracée jusqu'aux parties responsables. Les humains doivent conserver un contrôle significatif sur les décisions à fort impact, avec des structures de gouvernance claires définissant qui est responsable de la qualité des données, des approbations et des enquêtes.

Confidentialité et sécurité des données. Les systèmes d'IA doivent gérer les données personnelles de manière responsable grâce à une ingestion sécurisée, à une formation cryptée, à une anonymisation le cas échéant et à des contrôles d'accès stricts, conformément au RGPD et à la CCPA.

Conception et sécurité centrées sur l'humain. L'IA doit favoriser le bien-être humain et respecter les droits fondamentaux. Les décisions à haut risque (emploi, crédit, justice pénale) nécessitent un examen humain et des capacités supérieures.

Robustesse et résilience. Les systèmes d'IA doivent rester sécurisés, fiables et résilients face aux attaques contradictoires grâce à des tests de résistance, des tests contradictoires et une planification de reprise après sinistre.

Gestion des risques et sécurité: Les organisations doivent identifier, évaluer et atténuer de manière proactive les risques liés à l'IA, notamment les défaillances opérationnelles, les menaces de sécurité, la dérive des modèles, les abus et les dommages sociétaux imprévus. Des pratiques telles que les évaluations d'impact de l'IA, les registres des risques, les tests de résistance et les tests contradictoires contribuent à garantir un déploiement sûr et fiable.

Conformité réglementaire et préparation aux audits: La gouvernance de l'IA doit s'aligner sur l'évolution des cadres juridiques et réglementaires, notamment la loi de l'UE sur l'IA et les réglementations sectorielles. Cela nécessite des contrôles documentés, une validation des modèles, une auditabilité et une volonté de démontrer Conformité IA aux régulateurs et aux parties prenantes externes.

Principaux éléments d'un cadre de gouvernance de l'IA

Un robuste Cadre de gouvernance de l'IA combine des structures claires, des rôles définis, des politiques et des outils pour gérer les risques, garantir la conformité et maintenir une IA éthique et fiable tout au long de son cycle de vie.

Structure et rôles de gouvernance : Les organisations ont besoin de structures formelles, notamment un comité d'éthique de l'IA supervisant les décisions stratégiques, des Data Stewards gérant la qualité et la conformité des données, des propriétaires de modèles responsables de modèles spécifiques, des responsables de la conformité gérant les exigences réglementaires et, de plus en plus, un directeur des risques liés à l'IA. La clarté des rôles permet d'éviter les lacunes et de garantir la responsabilisation.

Élaboration de politiques et de normes : Les politiques traduisent les principes en directives opérationnelles couvrant la gouvernance des données (collecte, stockage, utilisation, conservation), le développement de modèles (formation, validation, tests), le déploiement et la publication (portes d'approbation, procédures d'annulation) et la gestion des fournisseurs d'IA tiers.

Évaluation et gestion des risques : Les systèmes d'IA présentent des risques distincts : problèmes de biais et d'équité dans les données d'entraînement, dérive des modèles et dégradation des performances, vulnérabilités en matière de confidentialité et de sécurité des données, lacunes d'explicabilité dans les modèles complexes et mauvaise utilisation des modèles. Les cadres de gouvernance utilisent des évaluations d'impact de l'IA, des tableaux de bord des risques modèles et des audits de biais pour traiter systématiquement ces risques.

Gouvernance et qualité des données : Des données de haute qualité sont fondamentales. Les organisations tiennent à jour l'inventaire et le lignage des données, définissent des normes de qualité des données, établissent des normes d'étiquetage pour l'apprentissage supervisé et créent des politiques de données synthétiques le cas échéant.

Gestion du cycle de vie des modèles: La gouvernance couvre l'ensemble du cycle de vie et couvre les pratiques de développement telles que les normes de codage, le contrôle des versions et la documentation, puis la validation et les tests visant à corriger les biais et les performances dans les différents sous-groupes. Les pratiques de déploiement incluent des portes d'approbation et des déploiements de Canary, tandis que la surveillance robuste repose sur des tableaux de bord en temps réel pour suivre les performances et les biais tout au long de la production. La retraite implique l'archivage sécurisé, la suppression des données et la notification des parties prenantes.

Pistes de conformité, d'audit et d'audit : Les organisations tiennent à jour des dossiers de développement de modèles, des journaux de décisions et des pistes d'audit, des rapports de conformité et des dossiers d'audit tiers. Passerelle IA de TrueFoundry automatise la capture de la piste d'audit pour chaque interaction avec le modèle, chaque décision et chaque action d'application des politiques en temps réel.

La passerelle est configurable garde-corps valider, rédiger ou bloquer le contenu dangereux ou non conforme à chaque étape, en couvrant à la fois les entrées et les sorties des modèles. Ces garde-fous s'intègrent aux principaux fournisseurs (OpenAI Moderations, Azure Content Safety, Fiddler) ou à une logique personnalisée pour appliquer automatiquement les exigences en matière de politique, de sécurité et de réglementation. Chaque action reste correctement régie et auditable, avec une traçabilité complète de la demande à la réponse. Cette application en temps réel transforme la conformité des contrôles périodiques en une assurance continue et automatisée.

Pourquoi la gouvernance de l'IA est-elle une responsabilité organisationnelle ?

La gouvernance de l'IA est essentielle pour que les organisations puissent gérer les risques et les responsabilités liés à l'adoption de l'IA. En établissant des cadres clairs, les entreprises peuvent s'assurer que l'IA est éthique, fiable et conforme aux attentes légales et sociétales.

- Atténuation des risques : La gouvernance permet d'identifier et de gérer les risques tels que les résultats biaisés, discriminatoires ou préjudiciables susceptibles d'entraîner des dommages juridiques, financiers ou de réputation.

- Conformité réglementaire : Les nouvelles lois et lignes directrices, notamment la loi de l'UE sur l'IA, exigent des pratiques responsables en matière d'IA ; la gouvernance garantit le respect des règles et réduit les risques d'amendes ou de contestations judiciaires.

- Instaurer la confiance : Une IA transparente, équitable et responsable renforce la confiance des clients, des partenaires et du public, favorisant ainsi une adoption plus large.

- Alignement éthique : La gouvernance garantit que l'IA reflète les valeurs organisationnelles et respecte les droits de l'homme, en promouvant les avantages pour la société tout en empêchant les abus.

- Avantage stratégique : Les organisations dotées d'une gouvernance robuste peuvent déployer l'IA à grande échelle en toute confiance, en favorisant l'innovation durable et en se positionnant comme des leaders responsables.

- Responsabilité : Une propriété et une supervision claires attribuent la responsabilité des résultats de l'IA, garantissant ainsi que les décideurs, des équipes au conseil d'administration, sont responsables des échecs ou des problèmes.

Comment les organisations mettent en œuvre la gouvernance de l'IA

Les organisations mettent en œuvre la gouvernance de l'IA en l'intégrant à leurs opérations quotidiennes grâce à une collaboration interfonctionnelle, à une supervision continue, à une documentation claire et à des contrôles intégrés pour les décisions à fort impact.

Phase 1 : Évaluation et planification implique le catalogage des systèmes d'IA, l'évaluation des exigences réglementaires, l'évaluation de l'état actuel de la gouvernance et la définition d'objectifs alignés sur la stratégie commerciale.

Phase 2 : Élaboration du cadre sélectionne ou adapte des cadres (NIST, ISO 42001), définit des principes et des politiques organisationnels, conçoit des structures de gouvernance et élabore des normes détaillées.

Phase 3 : Infrastructure et outillage déploie des plateformes de gouvernance qui mettent en œuvre les politiques dans des contrôles automatisés. La passerelle LLM de TrueFoundry fait office de couche d'infrastructure centralisée, fournissant un registre de modèles, une journalisation automatique des audits, l'application des politiques en temps réel et des rapports de conformité pour toutes les charges de travail d'IA. La passerelle permet aux organisations de renforcer les contrôles d'accès par le biais d'une authentification unifiée, d'appliquer des garde-fous configurables pour la validation de la sécurité et de la conformité, et de maintenir une visibilité complète grâce à des tableaux de bord d'observabilité. En centralisant l'infrastructure de gouvernance, les entreprises éliminent les informations d'identification éparpillées, réduisent IA fantôme, et bénéficiez d'une mise en œuvre cohérente entre les équipes, les modèles et les fournisseurs, en transformant la gouvernance d'une supervision manuelle à une fonctionnalité automatisée et évolutive.

Phase 4 : Pilotage et mise en œuvre commence par des projets pilotes à faible risque visant à tester les processus, affine les procédures en fonction des commentaires, établit des cadences de gouvernance pour des examens et des audits réguliers, et développe une culture organisationnelle dans laquelle la gouvernance favorise l'innovation.

Phase 5 : Amélioration continue surveille l'efficacité de la gouvernance, s'adapte aux changements réglementaires, investit dans le renforcement des capacités et partage les enseignements tirés entre les projets.

Le ministère des Pêches et des Océans du Canada illustre cette progression : les projets pilotes initiaux sans gouvernance ne pouvaient pas passer à la production tant qu'ils n'avaient pas mis en place une infrastructure de gouvernance comprenant des définitions des rôles et des matrices de responsabilité.

Réglementations et normes mondiales

Des cadres mondiaux d'IA émergent pour garantir une utilisation sûre, éthique et responsable de l'intelligence artificielle. Examinons certaines des réglementations mondiales les plus importantes pour 2026 :

Loi sur l'intelligence artificielle de l'UE (2024) : La réglementation la plus complète utilise une approche basée sur les risques. Les utilisations interdites incluent certaines activités de surveillance de masse et de notation de crédit social. Les systèmes à haut risque nécessitent des évaluations d'impact, de la documentation, un suivi et une supervision humaine pour les décisions d'embauche, de crédit et d'application de la loi. Les systèmes à risque limité exigent de la transparence. Les systèmes à risque minimal sont soumis à des exigences minimales. Les modèles de base nécessitent une documentation technique et des évaluations des risques systémiques.

Cadre de gestion des risques liés à l'IA du NIST (2023) : Ce cadre volontaire américain met l'accent sur la gouvernance (rôles et politiques organisationnels), la cartographie (identification des risques), la mesure (élaboration de mesures), la gestion (mise en œuvre de contrôles) et le suivi (suivi continu).

ISO/IEC 42001 (2023) : La première norme internationale sur les systèmes de management de l'IA propose une approche structurée compatible avec les autres normes ISO (qualité ISO 9001, sécurité de l'information ISO 27001), permettant la certification par des tiers.

Lignes directrices en matière de gouvernance de l'IA en Inde (novembre 2025) : Le cadre indien met l'accent sur une approche « légère et favorable à l'innovation » avec les principes d'une IA centrée sur l'humain, inclusive, respectueuse de la vie privée dès la conception, équitable, explicable, sûre et alignée au niveau national.

Ces cadres convergent vers des principes communs : transparence, responsabilité, équité, sécurité et supervision humaine, fournissant une orientation organisationnelle claire.

Les défis de la gouvernance de l'IA

Malgré des cadres de plus en plus nombreux, la gouvernance de l'IA est confrontée à des défis importants, liés à la complexité technique et aux biais, en passant par la fragmentation de la réglementation et les contraintes de ressources, qui compliquent la mise en œuvre.

Complexité technique : Les modèles d'apprentissage profond fonctionnent grâce à des fonctions mathématiques complexes qui résistent à une explication simple. Les systèmes d'IA sont probabilistes et adaptatifs, ce qui les rend fondamentalement différents des logiciels traditionnels. La gouvernance doit tenir compte de l'incertitude et de l'adaptabilité inhérentes.

Biais et équité : Les biais sont omniprésents : les biais historiques dans les données de formation perpétuent la discrimination, les choix algorithmiques amplifient les biais et les problèmes apparaissent de manière invisible sans un audit minutieux. Il est difficile de définir l'équité ; la parité démographique peut entrer en conflit avec l'égalité des chances, ce qui nécessite une expertise du domaine et la contribution des parties prenantes.

Fragmentation de la réglementation : Alors que les cadres convergent sur les principes, les réglementations divergent quant aux exigences. Les organisations opérant à l'échelle mondiale doivent surmonter cette fragmentation, en mettant souvent en œuvre les exigences les plus strictes en tant que norme de facto.

Évolution rapide des modèles et IA fantôme : Les organisations ont du mal à maintenir la gouvernance au rythme de l'adoption. De nouveaux modèles apparaissent constamment ; les équipes expérimentent des modèles open source et tiers. Cela crée une « IA parallèle » en dehors des cadres de gouvernance, et la documentation est souvent en retard sur les déploiements réels.

Contraintes en matière de ressources et de capacités : La gouvernance de l'IA nécessite une expertise spécialisée : les data scientists, les responsables de la conformité, les ingénieurs en sécurité et les éthiciens doivent collaborer. De nombreuses organisations manquent d'expertise interne, en particulier dans des domaines émergents tels que les tests contradictoires ou l'évaluation de l'équité.

Équilibrer innovation et gouvernance : Les organisations craignent qu'une gouvernance stricte ne ralentisse l'innovation ou ne pousse les projets à la clandestinité. Pour trouver un équilibre, il faut une conception réfléchie et une adhésion culturelle.

Meilleures pratiques pour une gouvernance efficace de l'IA

Une gouvernance efficace de l'IA associe des principes clairs, une collaboration interfonctionnelle et des processus technologiques pour garantir une utilisation responsable, conforme et innovante de l'IA.

Commencez par des principes clairs : Définissez ce que signifie une IA responsable pour votre organisation : donnez la priorité à l'équité, à l'explicabilité, à la confidentialité ou à la sécurité en fonction du contexte et des valeurs. Documenter les principes et les aligner sur les exigences réglementaires et la stratégie commerciale.

Mettre en place des structures interfonctionnelles : Une gouvernance efficace nécessite une collaboration entre les équipes technologiques (architectes, ingénieurs, data scientists), les services juridiques et de conformité, la confidentialité et la sécurité, les équipes commerciales et de produits et les experts en éthique. Des réunions régulières et une communication claire permettent aux équipes de rester alignées.

Intégrez la gouvernance dès le début du cycle de vie : La gouvernance ne doit pas être renforcée lors du déploiement. Intégrez la gouvernance lors de la planification (évaluation des exigences réglementaires), de la préparation des données (garantie de la conformité en matière de qualité et de confidentialité), du développement (validation et tests intégrés), du déploiement (application des portes d'approbation) et des opérations (surveillance continue).

Mettre en œuvre l'application automatique des politiques : Les processus manuels ne sont pas évolutifs. Exprimez les politiques sous forme de code exécutable, exécutez des tests dans des pipelines CI/CD, capturez automatiquement les décisions et les mesures, et utilisez des plateformes telles que la passerelle IA de TrueFoundry pour appliquer les politiques de manière cohérente entre les modèles et les équipes. L'automatisation accroît la cohérence, réduit les frais généraux et permet d'innover plus rapidement.

Investissez dans la gouvernance des données : Des données de haute qualité sont fondamentales. Tenez à jour l'inventaire et le lignage des données, définissez des normes de qualité, limitez l'accès aux utilisateurs autorisés et documentez les ensembles de données, y compris les limites et les biais connus.

Élaboration d'un registre de modèles : Tenez à jour un registre centralisé des modèles de production, y compris les métadonnées (propriétaire, version, date de déploiement), la documentation des données de formation, les mesures de performance, la documentation des modèles (architecture, hyperparamètres, utilisation prévue) et l'état de conformité. Cela garantit la visibilité, facilite les audits et oriente les décisions de retraite. TrueFoundry rationalise la gestion du cycle de vie des modèles de bout en bout grâce à Registre des modèles, permettant aux équipes de suivre, de modifier, de déployer et de surveiller les modèles de manière fluide au sein d'une plateforme unique, garantissant ainsi la conformité et l'auditabilité à chaque phase.

Établissez des cycles d'audit réguliers : La gouvernance est continue et non ponctuelle. Réalisez des audits de modèles trimestriels ou semestriels, des examens annuels de conformité par rapport aux cadres réglementaires, des audits réguliers des données et des revues annuelles des politiques.

Développez une culture responsable de l'IA : Les cadres de gouvernance ne sont efficaces que si les organisations les adoptent. Favorisez une culture dans laquelle l'IA responsable favorise l'innovation, où les équipes se sentent habilitées à faire part de leurs préoccupations, où les dirigeants donnent la priorité à la gouvernance dans l'allocation des ressources et où les équipes reçoivent une formation et un soutien.

Utilisez des outils technologiques : Les plateformes modernes telles que TrueFoundry simplifient la gouvernance grâce à un déploiement centralisé avec une gouvernance cohérente, des tableaux de bord d'observabilité intégrés, une application automatisée des politiques et des outils de conformité intégrés.

Mesurez l'efficacité de la gouvernance : Définissez des indicateurs : conformité réglementaire (pourcentage de modèles répondant aux normes), réduction des risques (réduction des biais et des incidents), efficacité opérationnelle (délai de déploiement), confiance des parties prenantes (niveaux de satisfaction) et rapidité d'innovation (vitesse et volume de nouveaux projets). Effectuez un suivi régulier et ajustez-vous en fonction des apprentissages.

L'avenir de la gouvernance de l'IA

La gouvernance de l'IA évolue vers des cadres adaptatifs, continus et intégrés qui garantissent la sécurité, la conformité et la durabilité dans un environnement de plus en plus complexe.

Gouvernance modulaire et adaptative : Les futurs cadres permettront une gouvernance modulaire dans laquelle les contrôles individuels (sécurité, confidentialité, équité, coût) évoluent indépendamment. Les organisations mettront à jour les politiques en modifiant la configuration plutôt que le code, ce qui permettra une adaptation rapide aux changements réglementaires.

Conformité continue et en temps réel : La gouvernance de demain sera continue et non périodique. Les systèmes d'IA assureront la conformité de manière autonome, signaleront immédiatement les violations et permettront une correction rapide.

Domaines de gouvernance intégrée : La confidentialité, la sécurité et la conformité légale seront intégrées au lieu de fonctionner de manière cloisonnée, avec des modèles de menaces unifiés et une supervision synchronisée.

Explicabilité en tant que norme : L'explicabilité passera de l'intérêt de la recherche à la norme d'ingénierie, avec des modèles conçus pour être interprétables et des techniques intégrées dans les pipelines de déploiement.

Gouvernance multimodèle et multi-fournisseurs : La gouvernance future doit fonctionner de manière fluide sur de multiples modèles, fournisseurs et clouds tout en maintenant des politiques cohérentes.

Normes collaboratives : Les organisations partageront de plus en plus les normes de gouvernance et les meilleures pratiques par le biais de consortiums industriels, accélérant ainsi la maturité et réduisant les doublons.

La sécurité de l'IA au cœur de nos préoccupations : À mesure que les systèmes deviendront plus performants, la gouvernance mettra l'accent sur la sécurité, en veillant à ce que les modèles se comportent comme prévu, échouent en toute sécurité et restent sous un contrôle humain significatif.

Priorité à la durabilité. La gouvernance intégrera les considérations environnementales, optimisera l'efficacité et suivra l'empreinte carbone de la formation et de l'inférence.

Conclusion

La gouvernance de l'IA n'est plus une option, c'est un impératif commercial dicté par la réglementation, les risques et les attentes des parties prenantes. Les organisations qui mettent en œuvre une gouvernance robuste ne se contentent pas de réduire les risques ; elles renforcent également leur avantage concurrentiel grâce à une innovation plus rapide et plus sûre. Une gouvernance bien conçue, mise en œuvre par le biais de politiques, de contrôles automatisés et d'une infrastructure moderne, accélère réellement l'innovation en apportant confiance et en supprimant la charge de conformité manuelle.

TrueFoundry permet une « gouvernance dès la conception », en intégrant la conformité, la sécurité et la supervision directement dans l'infrastructure d'IA au lieu de la moderniser ultérieurement. Grâce à un contrôle centralisé via l'AI Gateway, à l'application automatisée des politiques, à des garde-fous en temps réel et à des pistes d'audit complètes, les organisations peuvent déployer l'IA en toute confiance que la gouvernance est intégrée dès le départ. Cette approche transforme la gouvernance d'une contrainte en un avantage concurrentiel, permettant aux équipes d'innover rapidement dans des limites sûres et conformes.

La voie à suivre nécessite un engagement des dirigeants, une collaboration interfonctionnelle, des investissements dans les capacités et les infrastructures, ainsi qu'un changement culturel. Les organisations qui empruntent cette voie aujourd'hui définissent une IA responsable pour leurs secteurs d'activité. L'ère de l'IA qui consiste à « agir vite et à innover » touche à sa fin. L'ère des « agissons vite et ne brisons pas la confiance » commence. La gouvernance de l'IA et les plateformes comme TrueFoundry qui la rendent pratique rendent cette ère possible.

Êtes-vous prêt à rendre opérationnel votre programme de gouvernance de l'IA et à protéger la valeur de votre entreprise ? Planifiez une démonstration dès aujourd'hui pour découvrir comment notre plateforme rationalise la conformité, la protection des données et la supervision éthique tout au long de votre cycle de vie d'IA.

Questions fréquemment posées

Qu'est-ce que le cadre de gouvernance de l'IA ?

Un cadre de gouvernance de l'IA établit des politiques et des processus de gouvernance structurés pour gérer les risques et soutenir les initiatives d'IA. Ces cadres définissent les rôles, les responsabilités et les directives éthiques pour la prise de décisions. En intégrant des mécanismes de protection et de surveillance des données, les organisations peuvent mettre en œuvre une IA responsable tout en s'alignant sur les normes réglementaires et les objectifs organisationnels.

Quel est un exemple de gouvernance de l'IA ?

Au-delà des réglementations telles que la loi européenne sur l'IA, un récent décret souligne la nécessité d'une supervision de l'IA générative et des applications complexes de l'IA. Ces exemples montrent comment la gouvernance de l'IA évalue l'impact de l'IA, en imposant la transparence et la supervision humaine afin de fournir un cadre concret pour une IA responsable.

Quels sont les trois piliers de la gouvernance de l'IA ?

Les trois piliers, à savoir la responsabilité, la transparence et la gestion des risques, constituent le fondement d'une gouvernance efficace de l'IA. La responsabilisation utilise des mécanismes de supervision pour définir la responsabilité, tandis que la transparence garantit l'auditabilité. La gestion des risques identifie les conséquences imprévues et gère la réponse aux incidents concernant des données sensibles, en incorporant des boucles de rétroaction pour surveiller et atténuer les dommages potentiels.

Quelle est la différence entre une IA responsable et une gouvernance de l'IA ?

Un programme de gouvernance de l'IA inclut les politiques et les structures utilisées pour gérer les risques dans le domaine de la science des données et de l'apprentissage automatique. Alors que le développement responsable de l'IA se concentre sur des principes éthiques tels que l'équité et la confidentialité, la gouvernance de l'IA rend ces concepts opérationnels, traduisant des principes abstraits en pratiques applicables et en mécanismes de conformité organisationnels robustes.

Quels sont les éléments de la gouvernance de l'IA ?

Les éléments de gouvernance de l'IA comprennent l'évaluation des risques, l'élaboration de politiques, les structures de responsabilité, le suivi de la conformité et la supervision des parties prenantes. Les éléments supplémentaires concernent la gouvernance des données, la documentation des modèles, les cycles d'audit et la formation. Ensemble, ces composants garantissent que les systèmes d'IA sont sûrs, éthiques, transparents et conformes aux objectifs organisationnels et aux exigences réglementaires.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)