Vercel AI Gateway contre OpenRouter : lequel vous convient le mieux ?

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Présentation

Alors que les équipes adoptent de grands modèles linguistiques pour l'ensemble des produits et des systèmes internes, Passerelles IA sont devenus une couche architecturale courante. Au lieu de s'intégrer séparément à chaque fournisseur de modèles, les équipes recherchent de plus en plus un API unique qui supprime les différences entre les fournisseurs, simplifie le routage et réduit les frais d'intégration.

Cela a conduit à l'essor d'offres de type passerelle qui promettent un développement plus rapide et une expérimentation plus facile. Parmi celles-ci, Passerelle Vercel AI et Routeur ouvert sont fréquemment comparés, souvent parce qu'ils se situent tous deux entre des applications et plusieurs fournisseurs de LLM.

Cependant, bien qu'ils semblent similaires à première vue, les deux sont conçus pour des besoins et des étapes très différents de l'adoption de l'IA. L'un est optimisé pour l'expérience des développeurs frontaux, tandis que l'autre donne la priorité à un large accès aux modèles et à une expérimentation rapide.

L'objectif de cette comparaison est de clarifier ces différences en termes de portée, d'architecture et de préparation à la production, afin que les équipes puissent choisir la passerelle adaptée à leur cas d'utilisation.

Pour en savoir plus sur le paysage d'AI Gateway et les considérations à prendre en compte avant de choisir un fournisseur, lisez l'intégralité Le guide du marché Gartner pour les passerelles IA 2025 est disponible ici.

Qu'est-ce que Vercel AI Gateway ?

Passerelle Vercel AI fait partie de la plate-forme d'applications plus large de Vercel et est conçu pour permettre aux développeurs de consommer facilement des LLM dans applications pilotées par le Web et le front-end.

À un niveau élevé, Vercel AI Gateway :

- Fournit une interface unifiée à certains fournisseurs LLM

- Est étroitement intégré au SDK Vercel AI

- Fonctionne parfaitement avec Next.js, les fonctions sans serveur et les environnements d'exécution Edge

Son objectif principal est expérience des développeurs. Les développeurs qui créent des applications sur Vercel peuvent ajouter des fonctionnalités LLM avec une configuration minimale, sans se soucier des SDK ou des informations d'identification spécifiques au fournisseur.

Il est important de noter que Vercel AI Gateway est mieux compris comme un passerelle de couche application. Il est optimisé pour simplifier l'utilisation du LLM dans les applications hébergées par Vercel, plutôt que de servir de plan de contrôle au niveau de l'infrastructure pour l'IA au sein des équipes, des environnements ou des déploiements.

Qu'est-ce qu'OpenRouter ?

Routeur ouvert est une solution basée sur le cloud plateforme de routage et d'agrégation de modèles qui fournit une API unique pour accéder à un large éventail de LLM parmi les fournisseurs

Les principaux atouts d'OpenRouter sont les suivants :

- Accès à des centaines de modèles provenant de plusieurs fournisseurs

- Commutation et comparaison faciles entre les modèles

- Facturation et limites tarifaires agrégées via une seule API

Cela rend OpenRouter particulièrement intéressant pour :

- Développeurs expérimentant différents modèles

- Les équipes évaluent ou comparent le comportement des LLM

- Prototypage rapide sans engagement auprès d'un seul fournisseur

OpenRouter est intentionnellement léger. Il met l'accent sur routage et agrégation, et non sur le déploiement, la gouvernance ou la gestion de l'infrastructure. Par conséquent, il fonctionne bien en tant que modèle de routeur, mais n'est pas conçu pour servir de couche de contrôle centralisée de l'IA pour les systèmes de production.

Lisez également : Alternatives à OpenRouter

Vercel AI Gateway contre OpenRouter : les principales différences en un coup d'œil

Architecture et étendue du déploiement

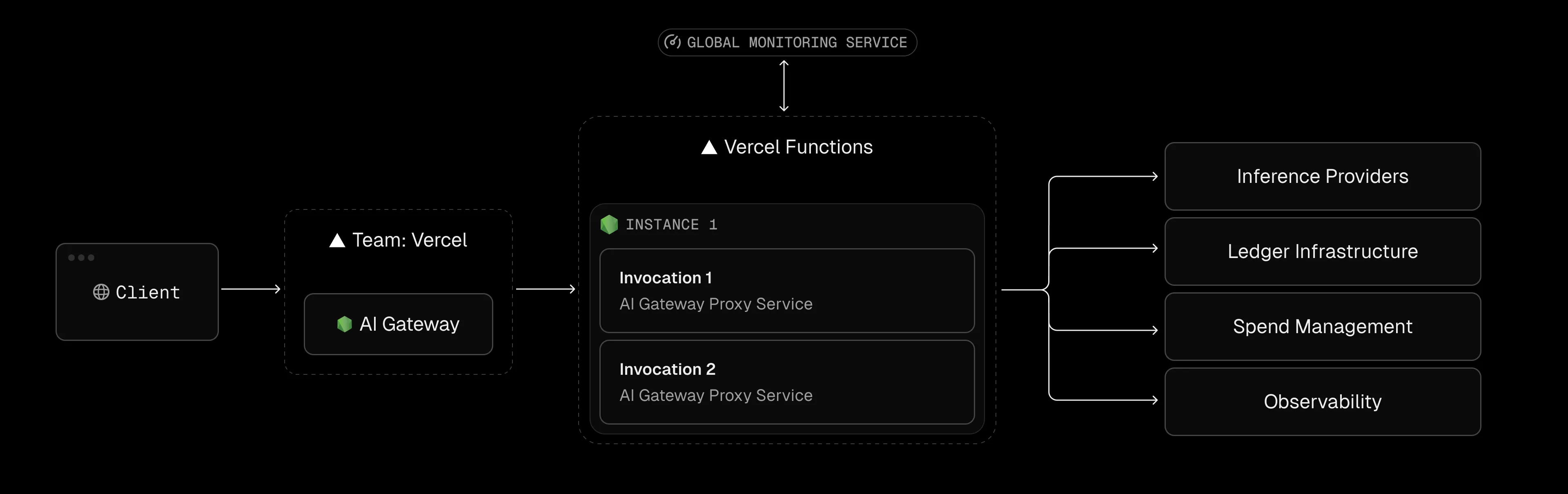

Architecture Vercel AI Gateway

Vercel AI Gateway est conçu comme passerelle gérée au sein de l'écosystème Vercel. Votre application (qui utilise souvent le SDK Vercel AI) envoie des requêtes à la passerelle, et Vercel gère la connectivité des fournisseurs, le comportement de routage et les contrôles d'utilisation. La passerelle est positionnée pour aider les équipes expédiez plus rapidement sans gérer les comptes et les clés des fournisseurs, tout en proposant des boutons opérationnels tels que budgets, surveillance de l'utilisation, équilibrage de charge et solutions de repli.

Incidence sur la portée : il est optimisé pour Applications hébergées par Vercel et flux de travail pour développeurs, pas pour gérer la passerelle dans votre propre infrastructure privée.

Architecture OpenRouter

OpenRouter est un couche de routage cloud: votre application appelle l'API d'OpenRouter, et OpenRouter achemine le trafic vers le modèle/fournisseur choisi. Il prend en charge les contrôles de routage tels que routage des fournisseurs, et propose des fonctionnalités telles que Routeur automatique pour sélectionner entre les modèles en fonction de l'invite, ainsi que les solutions de repli des modèles et l'équilibrage de charge en fonction de la disponibilité.

Du point de vue des données/opérations, OpenRouter documente ce qu'il enregistre métadonnées de demande de base et ça les invités/réponses ne sont pas enregistrées par défaut (sauf si vous vous inscrivez).

Il prend également en charge les modèles d'utilisation des équipes via Organisations (crédits partagés, gestion centralisée des clés et suivi de l'utilisation).

Incidence sur la portée : c'est génial pour accès et routage multimodèles, mais reste fondamentalement un service cloud géré plutôt que quelque chose que vous déployez à l'intérieur des limites de votre réseau.

La place de TrueFoundry : point de vue sur la passerelle d'IA d'entreprise

Vercel AI Gateway et OpenRouter contribuent tous deux à unifier l'accès aux modèles, mais de nombreuses équipes sont confrontées à de nouvelles exigences lorsqu'elles passent de applications ou expériences uniques pour déploiements d'IA à l'échelle de l'entreprise. À ce stade, la commodité à elle seule ne suffit plus.

Les exigences communes qui apparaissent sont notamment les suivantes :

- Déploiements privés (environnements VPC, sur site ou isolés)

- Gouvernance centralisée au sein de plusieurs équipes et applications

- Auditabilité et application des politiques comme comportement par défaut

- Observabilité constante à travers les modèles, les fournisseurs et les environnements

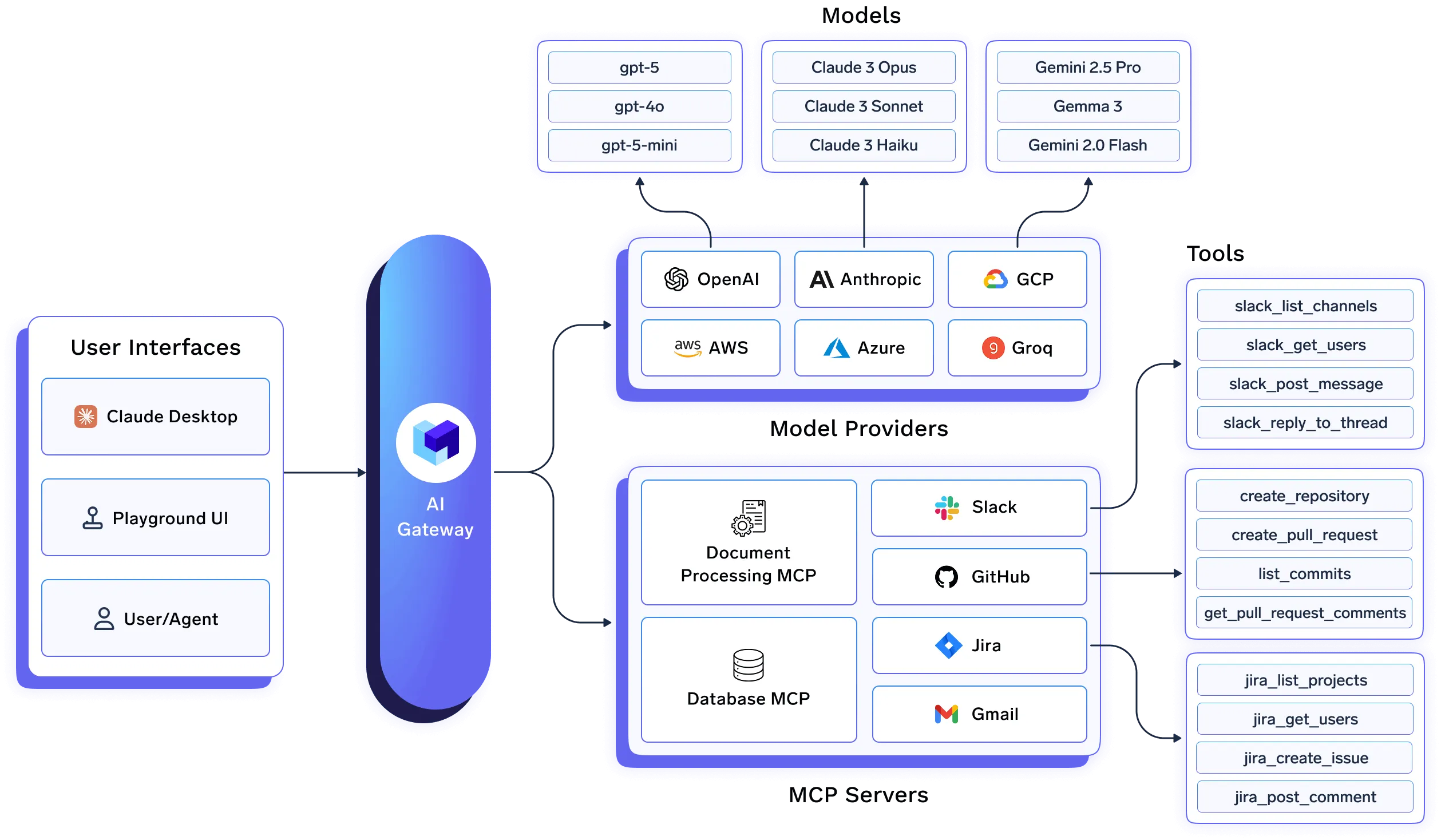

C'est l'écart qui True Foundry est conçu pour remplir.

TrueFoundry Passerelle IA est construit comme un plan de contrôle au niveau de l'infrastructure, et pas seulement une couche de routage ou de commodité d'application. Il peut être déployé en tant que SaaS ou auto-hébergé dans votre propre infrastructure cloud ou sur site, permettant aux entreprises de maintenir le trafic LLM dans leurs limites de sécurité et de conformité tout en normalisant l'accès via une passerelle unique.

Au-delà du routage de base, la passerelle TrueFoundry fournit :

- Contrôle d'accès centralisé et politiques d'utilisation appliqué de manière cohérente dans toutes les équipes

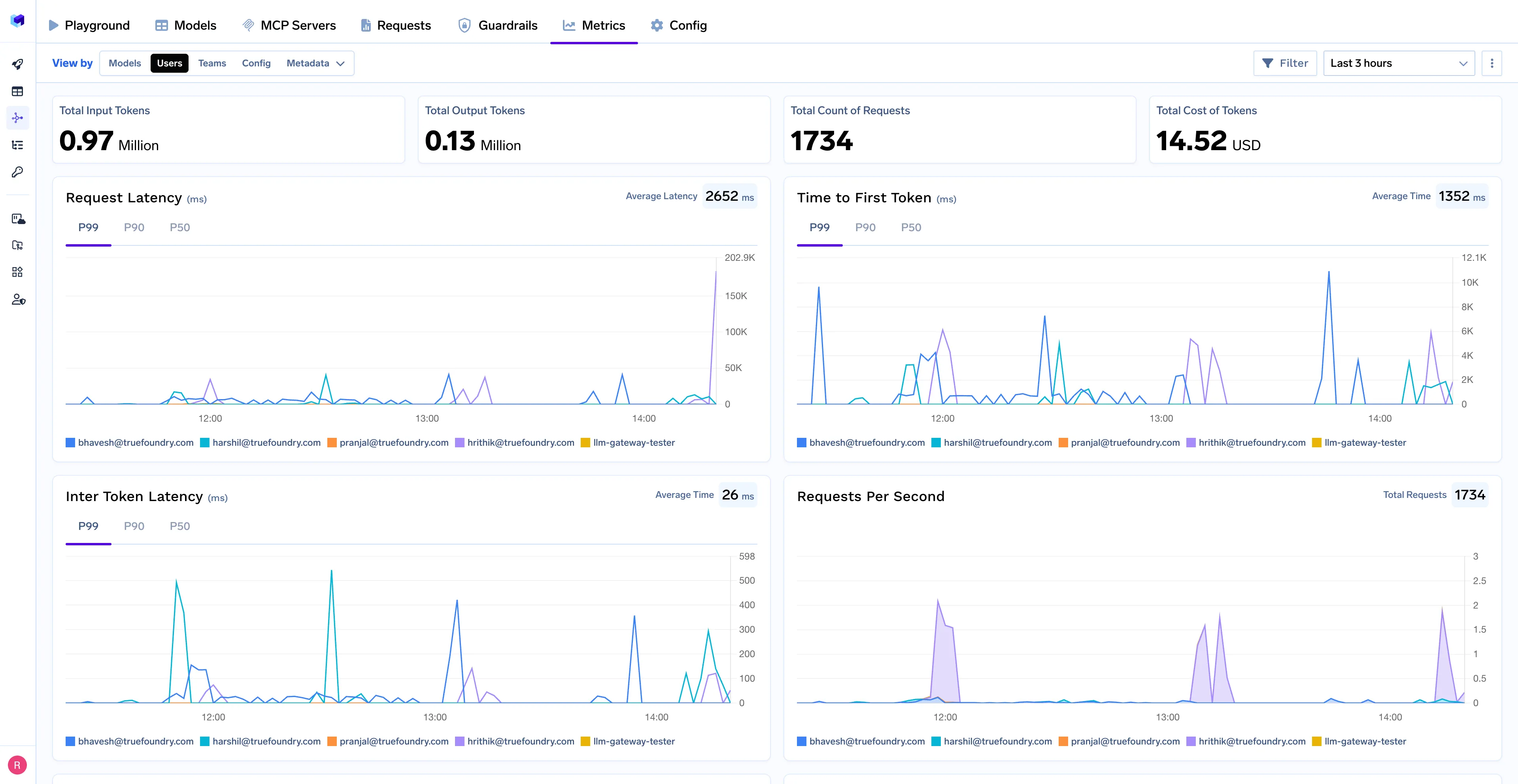

- Observabilité unifiée, y compris l'utilisation, la latence et l'attribution des coûts par application ou par équipe

- Routage indépendant du modèle, en utilisant des modèles auto-hébergés, des modèles affinés et des fournisseurs externes

- Prêt pour la production primitives de déploiement, conçu pour s'intégrer parfaitement aux environnements natifs de Kubernetes

Plutôt que de remplacer les outils destinés aux développeurs, TrueFoundry les complète à mesure que les organisations mûrissent. Il est conçu pour les équipes qui ont besoin sécurité, conformité et visibilité opérationnelle de niveau entreprise à mesure que les LLM passent d'expériences isolées à flux de travail de base.

En pratique, cela signifie traiter l'accès au LLM comme infrastructure partagée, et non une logique spécifique à une application, dans laquelle les politiques, l'observabilité, le contrôle des coûts et les limites de déploiement sont appliqués de manière centralisée, indépendamment de la manière dont les équipes développent ou déploient leurs applications.

Conclusion

Vercel AI Gateway et OpenRouter jouent tous deux un rôle important dans la simplification de l'accès à de grands modèles de langage, mais ils sont conçus pour les différentes étapes de l'adoption de l'IA. Vercel AI Gateway donne la priorité à l'expérience des développeurs au sein de l'écosystème Vercel, tandis qu'OpenRouter excelle dans l'agrégation de modèles et l'expérimentation rapide.

À mesure que les entreprises évoluent au-delà des applications individuelles, de nouvelles exigences apparaissent en matière de gouvernance, d'observabilité, de contrôle du déploiement et de conformité. À ce stade, les passerelles de niveau application ou de routage uniquement deviennent souvent limitatives.

C'est là que les passerelles au niveau de l'infrastructure telles que True Foundry entre en jeu. En traitant l'accès LLM comme une infrastructure d'entreprise partagée plutôt que comme une logique d'application, les équipes obtiennent le contrôle et la visibilité nécessaires pour exploiter les systèmes d'IA de manière fiable en production.

Le choix de la bonne passerelle dépend en fin de compte de l'état d'avancement de votre organisation dans son parcours vers l'IA. Comprendre ces distinctions à un stade précoce permet d'éviter toute refonte architecturale au fur et à mesure que l'IA devient un élément essentiel de l'activité.

Questions fréquemment posées

Quelle est la différence entre OpenRouter et Vercel AI ?

OpenRouter est une API unifiée qui permet aux développeurs d'accéder à de nombreux modèles d'IA (OpenAI, Anthropic, etc.) via un seul point de terminaison. Le SDK Vercel AI de Vercel est une boîte à outils permettant de créer des applications d'IA et des interfaces de discussion dans des frameworks Web tels que Next.js. OpenRouter se concentre sur le routage des modèles ; Vercel AI se concentre sur le développement d'applications d'IA frontales.

Quoi de mieux : passerelle Vercel AI ou OpenRouter ?

La passerelle Vercel AI est idéale si vous déployez déjà des applications sur Vercel et que vous souhaitez intégrer la journalisation, la mise en cache et le routage à votre projet. OpenRouter permet d'accéder à de nombreux modèles d'IA provenant de différents fournisseurs en un seul endroit, grâce à une tarification flexible et à un changement de modèle entre les plateformes.

Est-ce que Vercel est similaire à OpenRouter ?

Non, Vercel et OpenRouter ne sont pas identiques. Vercel est principalement une plateforme cloud pour le déploiement d'applications Web et comprend des outils de développement d'IA. OpenRouter est spécifiquement un service d'API qui achemine les requêtes vers plusieurs modèles d'IA. Ils se chevauchent dans l'utilisation de l'IA mais ont des objectifs principaux différents.

Est-il possible d'héberger Vercel AI Gateway ou OpenRouter sur site ?

Non. Les deux sont des services cloud entièrement gérés qui ne prennent pas en charge l'hébergement privé ou sur site. Les déploiements d'entreprise nécessitant des environnements VPC, air-gapped ou de cloud privé doivent prendre en compte des plateformes telles que TrueFoundry.

Vercel AI Gateway peut-il gérer des expériences multimodèles comme OpenRouter ?

Non. Vercel AI Gateway se concentre sur la simplification de l'utilisation du LLM dans les applications Vercel. Il ne permet pas d'expérimenter sur plusieurs modèles ou fournisseurs. Pour les tests, la commutation et la comparaison de plusieurs modèles, OpenRouter ou une plateforme d'entreprise telle que TrueFoundry est plus adaptée.

En quoi TrueFoundry diffère-t-il de Vercel AI Gateway et d'OpenRouter ?

TrueFoundry est une passerelle d'intelligence artificielle de niveau entreprise fournissant une gouvernance, une observabilité, un contrôle d'accès et une conformité centralisés. Contrairement à Vercel AI (axé sur le frontend) ou OpenRouter (routage multimodèle), il gère le trafic LLM entre les équipes et les environnements, permettant une gestion des modèles sécurisée et prête pour la production au niveau de l'infrastructure.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)