Las 5 mejores pasarelas de IA en 2026

.webp)

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Muchas organizaciones que adoptan modelos lingüísticos de gran tamaño (LLM) descubren rápidamente la brecha entre una demostración exitosa y un sistema listo para la producción.

- Las facturas pueden ser impredecibles y astronómicas: en un caso, un desarrollador dejó de funcionar de la noche a la mañana y acumuló 3000$ en gastos de API.

- El equipo de seguridad expresa su preocupación por los datos financieros o sanitarios confidenciales que fluyen a través de API de terceros sin una gobernanza adecuada.

- Los sistemas pueden fallar inesperadamente cuando proveedores como OpenAI alcanzan los límites de tasa, sin una estrategia alternativa establecida.

- Lo peor de todo es que los equipos no suelen tener una visión clara de lo que ocurre bajo el capó una vez que los modelos están en producción.

Estos desafíos ponen de manifiesto la amplitud de la brecha entre la «IA que funciona en una demostración» y la «IA que funciona a escala empresarial».

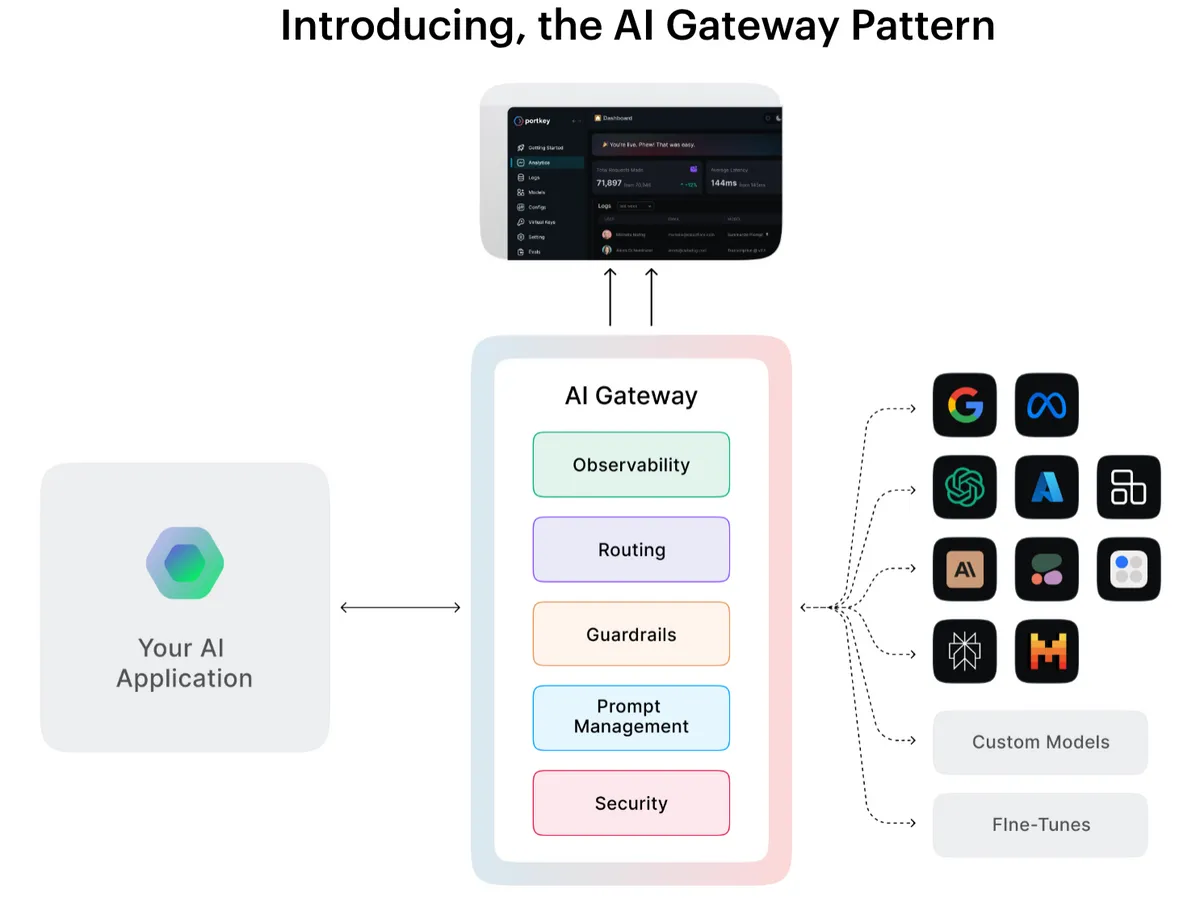

¿Qué es una puerta de enlace de IA?

Un Puerta de enlace de IA es una tecnología o plataforma que actúa como intermediaria entre las aplicaciones y varios servicios o modelos de inteligencia artificial (IA). Su objetivo es simplificar y gestionar el acceso a las capacidades de la IA, proporcionando un punto central que permita la seguridad, la gobernanza y la observabilidad de las cargas de trabajo de la IA. Lea la guía de mercado completa de Gartner sobre AI Gateways 2025 para obtener más información.

Piense en una puerta de enlace de IA como el sistema de control de tráfico aéreo para sus operaciones de LLM. Al igual que el control del tráfico aéreo gestiona cientos de vuelos de forma segura y eficiente, una puerta de enlace de IA se sitúa entre sus aplicaciones y varios proveedores de LLM, lo que organiza las solicitudes, aplica las políticas y garantiza que todo funcione sin problemas.

Sin embargo, a diferencia de las pasarelas de API tradicionales, las pasarelas de IA comprenden los desafíos únicos de las cargas de trabajo de LLM. Saben cómo gestionar los precios basados en fichas, gestionar las ventanas de contexto, dirigir las solicitudes en función de las capacidades del modelo y proporcionar la capacidad de observación necesaria para depurar los complejos flujos de trabajo de IA.

Los números cuentan la historia de por qué esto es importante. El mercado de pasarelas de IA pasó de 400 millones de dólares en 2023 a 3,9 mil millones de dólares en 2024, y Gartner predice que el 70% de las organizaciones que crean aplicaciones de múltiples LLM utilizarán las capacidades de las pasarelas de IA en 2028. Empresas como NVIDIA afirman que utilizan la GPU un 80% más después de implementar una infraestructura de IA adecuada, mientras que los equipos más pequeños ahora atienden cada vez más a millones de usuarios y solo unas pocas personas gestionan todo el conjunto de sistemas de IA.

Por qué todos los equipos de IA necesitan una puerta de enlace de IA

Los problemas a los que se enfrentó Sarah no son casos extremos. Son la inevitable realidad de la gestión de los LLM a gran escala. He aquí por qué:

El control de costos se ha vuelto loco: Los costos de LLM pueden salirse de control más rápido que cualquier otro servicio en la nube. A diferencia de las API tradicionales, en las que se paga por solicitud, los LLM cobran por token y el uso de los tokens es intrínsecamente impredecible. Una sola consulta compleja puede usar 10 veces más tokens de lo esperado. Sin las garantías adecuadas, un pequeño error puede arruinar tu presupuesto de IA en cuestión de horas.

La trampa de encerrar a los vendedores: Comenzar con un proveedor parece sencillo, pero crea dependencias peligrosas. ¿Qué ocurre cuando OpenAI está fuera de servicio por mantenimiento? ¿Cuándo un modelo deja de estar en desuso? ¿Cuándo cambian los precios de la noche a la mañana? ¿Cuándo aparece un nuevo modelo de alto rendimiento de otro proveedor, como Gemini o Anthropic? Los equipos que codifican de forma rígida las API específicas de los proveedores tienen dificultades para volver a escribir el código durante las interrupciones y estos escenarios, lo que les hace quedar rezagados con respecto a sus competidores.

Pesadillas de seguridad y cumplimiento: Los datos empresariales que fluyen a través de API de terceros crean problemas de cumplimiento. ¿Cómo se asegura de que los enrutadores LLM de terceros, como OpenRouter, por ejemplo, no registren los datos confidenciales de los clientes? ¿Cómo se implementa el control de acceso basado en roles cuando diferentes equipos necesitan diferentes modelos de permisos? ¿Cómo se auditan las decisiones de inteligencia artificial para garantizar el cumplimiento de la normativa?

Ceguera operativa: Las aplicaciones de LLM fallan de maneras únicas. Los modelos pueden producir resultados incorrectos que parezcan correctos, utilizar cantidades inesperadas de procesamiento o alcanzar límites de frecuencia en momentos impredecibles. Sin la observabilidad adecuada, la depuración es como trabajar en la oscuridad.

La solución no es construir toda esta infraestructura usted mismo. Es como crear tu propia base de datos en lugar de usar PostgreSQL. Lo más inteligente es elegir la puerta de enlace de IA adecuada para sus necesidades.

Las 5 mejores soluciones de puerta de enlace de IA

Tras analizar docenas de soluciones y hablar con los equipos que ejecutan la IA en producción, cinco plataformas destacan por su excelencia técnica y su preparación empresarial. Cada una adopta un enfoque diferente para resolver los desafíos principales, y la elección correcta depende de sus requisitos específicos.

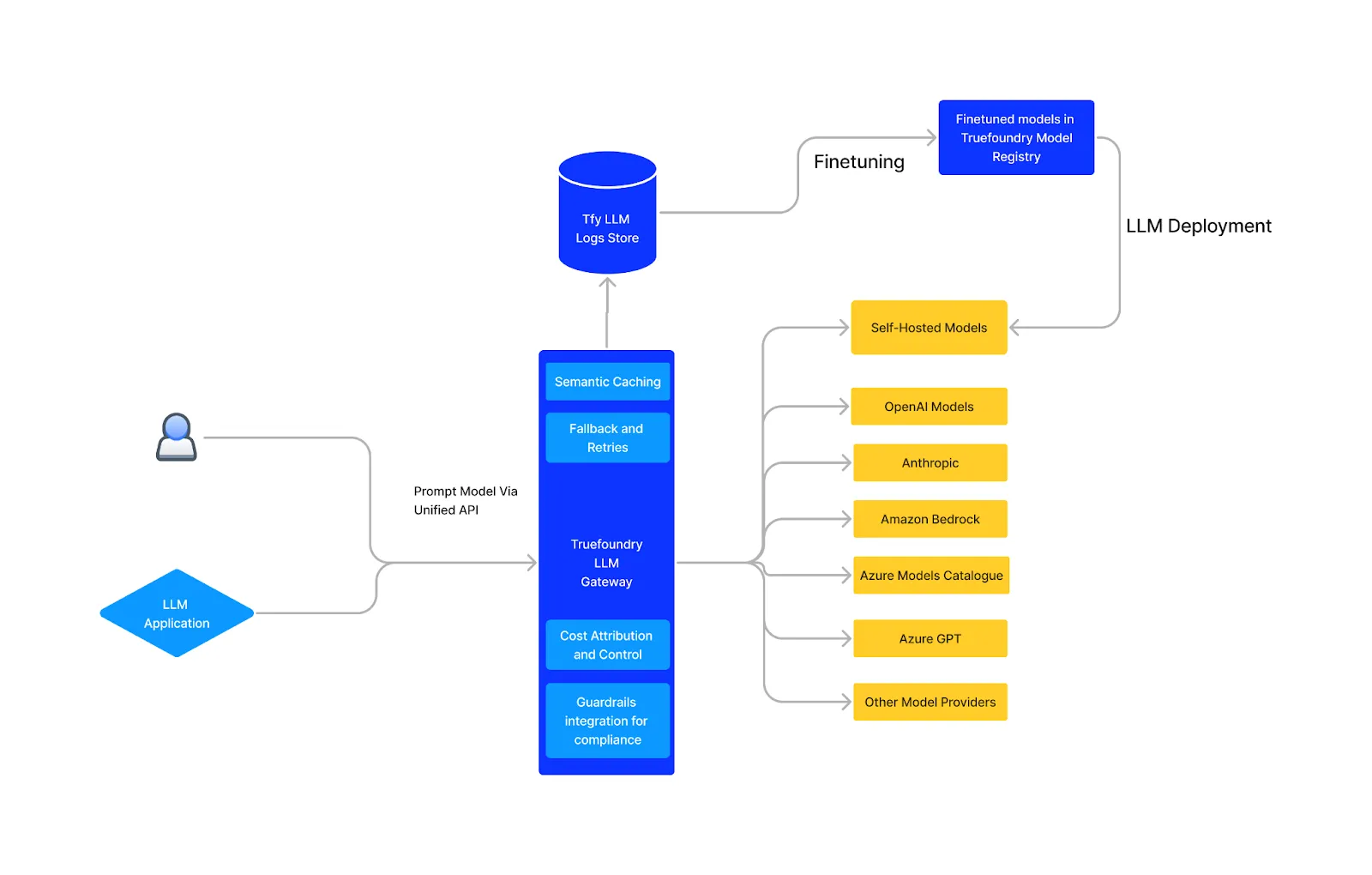

1. Puerta de enlace de IA TrueFoundry

True Foundry no es solo otro proxy de IA. Se trata de una plataforma especialmente diseñada por ingenieros que han tenido que esforzarse por ampliar la IA en empresas como Meta, Apple y WorldQuant. Los resultados hablan por sí solos: una latencia de menos de 5 ms, más de 350 solicitudes por segundo por núcleo de CPU y despliegues de producción que atienden millones de solicitudes diarias.

Qué hace que TrueFoundry sea diferente

La plataforma arquitectura separa el plano de control del plano de datos, lo que permite tanto la flexibilidad operativa como la optimización del rendimiento. A diferencia de las soluciones que añaden latencia a cada función, TrueFoundry procesa la autenticación, la autorización y la limitación de velocidad en la memoria, lo que garantiza tiempos de respuesta consistentes de menos de un milisegundo, incluso con reglas de gobierno complejas.

El API unificada le brinda acceso a cientos de LLM a través de varios proveedores (OpenAI, Anthropic, Gemini, Azure, AWS, Databricks, Mistral, Groq, Together, etc.), con soporte para todos los proveedores compatibles con OpenAI, junto con modelos autohospedados.

Funciones empresariales que realmente funcionan

TrueFoundry logró Cumplimiento de SOC 2 tipo 2 y HIPAA en 2024, con sistemas de autenticación admite los tokens de acceso personal para el desarrollo y los tokens de cuentas virtuales para la producción, además de la integración de OAuth 2.0 para proveedores de identidad empresariales.

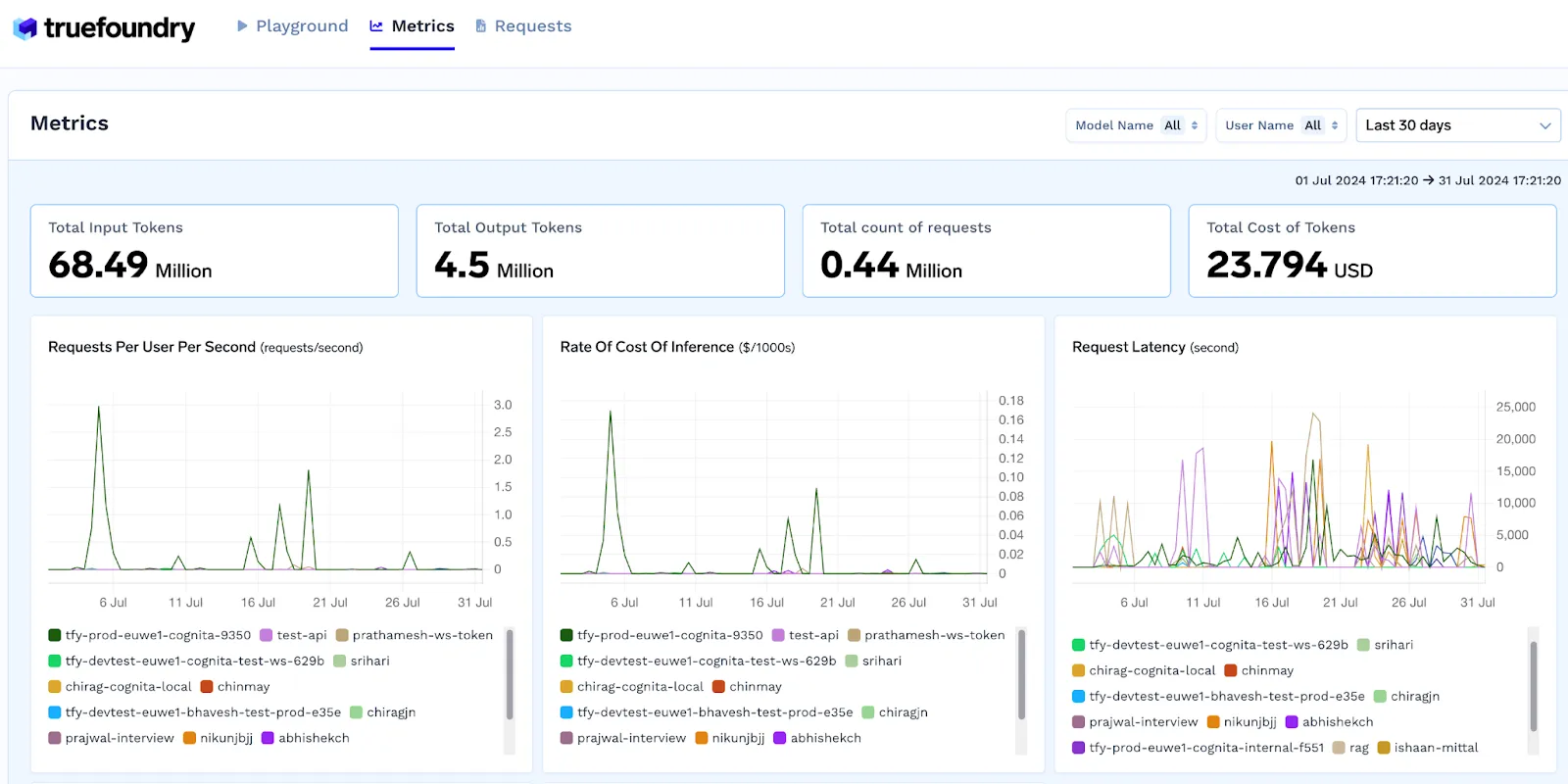

Lo que diferencia a TrueFoundry es su gestión integral de costos que va más allá del seguimiento básico. La atribución de uso a nivel de token te permite entender los costos por usuario, equipo, ubicación geográfica o cualquier dimensión personalizada. La aplicación del presupuesto en tiempo real evita sorpresas, mientras que los análisis detallados ayudan a optimizar los patrones de gasto. Los equipos suelen reducir los costes entre un 30 y un 70% en comparación con el uso directo de los proveedores.

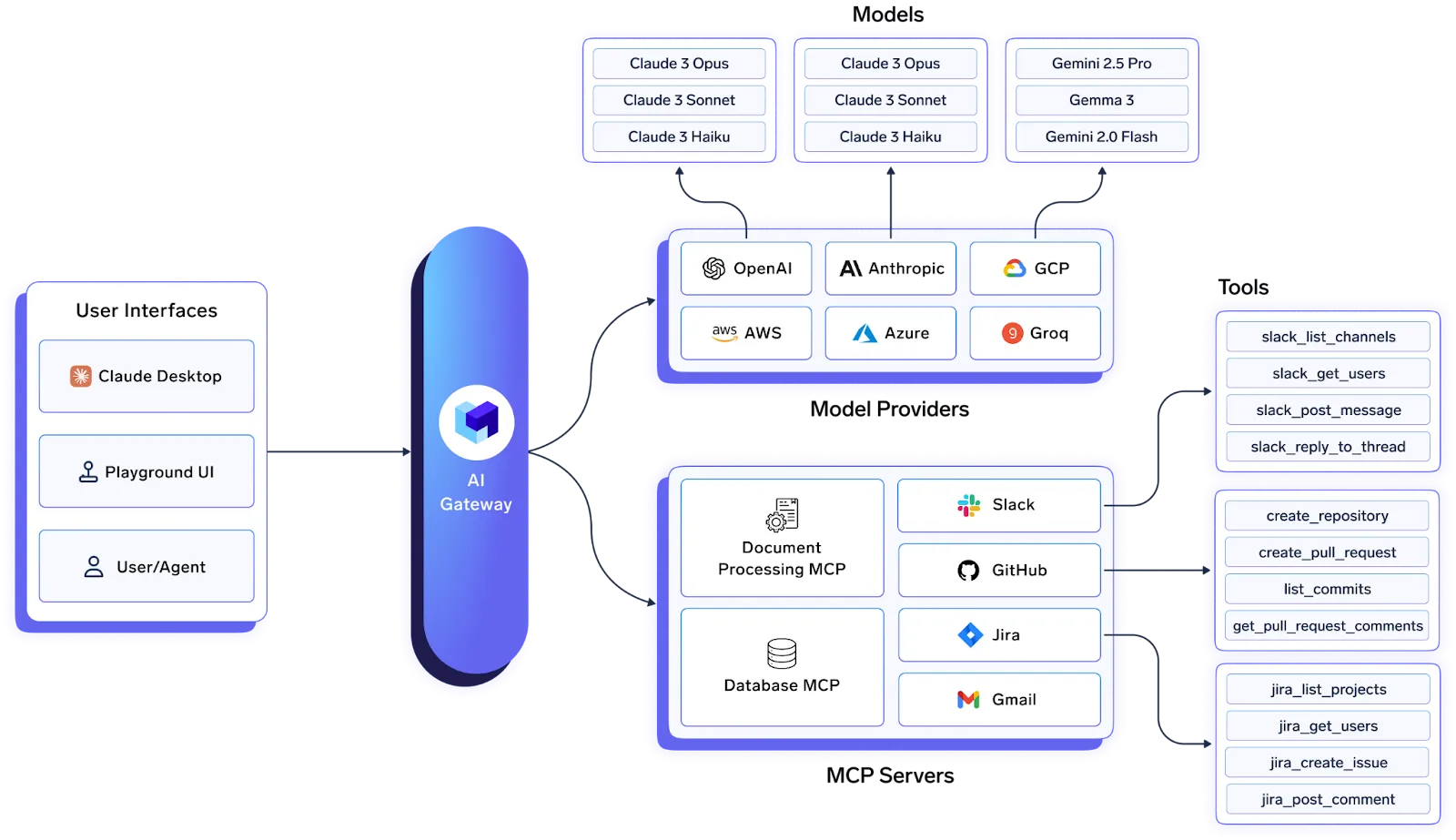

El Puerta de enlace de protocolo de contexto modelo (MCP) representa una arquitectura con visión de futuro para la integración de herramientas empresariales. En lugar de crear conectores personalizados para cada herramienta empresarial, puedes gestionar los servidores MCP de forma centralizada con OAuth 2.0 y acceder de forma segura a herramientas como Slack, GitHub y Confluence, además observabilidad integral en todos los flujos de trabajo de los agentes.

True Foundry capacidades de contenedorización e implementación admite servidores de modelos flexibles (vLLM, SGLang, TRT-LLM), almacenamiento automático de modelos en caché y Optimización de la GPU con enrutamiento fijo para la optimización de la caché de KV. La plataforma incluso es compatible despliegues aislados para cumplir con los requisitos de máxima seguridad.

Quién debe elegir TrueFoundry

Organizaciones que necesitan confiabilidad y gobierno de nivel empresarial sin sacrificar el rendimiento. La plataforma atrae especialmente a los equipos que valoran la observabilidad y el monitoreo integrales, los costos predecibles, la administración exhaustiva de la seguridad y la integración con la infraestructura empresarial existente. Si administra varios proveedores de LLM y necesita un control detallado del acceso, los costos y el cumplimiento, TrueFoundry ofrece la solución más completa. Truefoundry también permite a su equipo disponer de una pila de IA completa, que incluye la gestión de las implementaciones de aprendizaje automático y LLM, la integración entre proveedores y el acceso a integraciones de servidores mcp personalizadas y preexistentes (Slack, GitHub, Sentry, etc.)

Consideraciones potenciales: El conjunto completo de funciones puede ser más de lo necesario para casos de uso individuales sencillos (o casos de uso solo para equipos principiantes), y el enfoque empresarial significa que los precios reflejan la naturaleza integral de la plataforma.

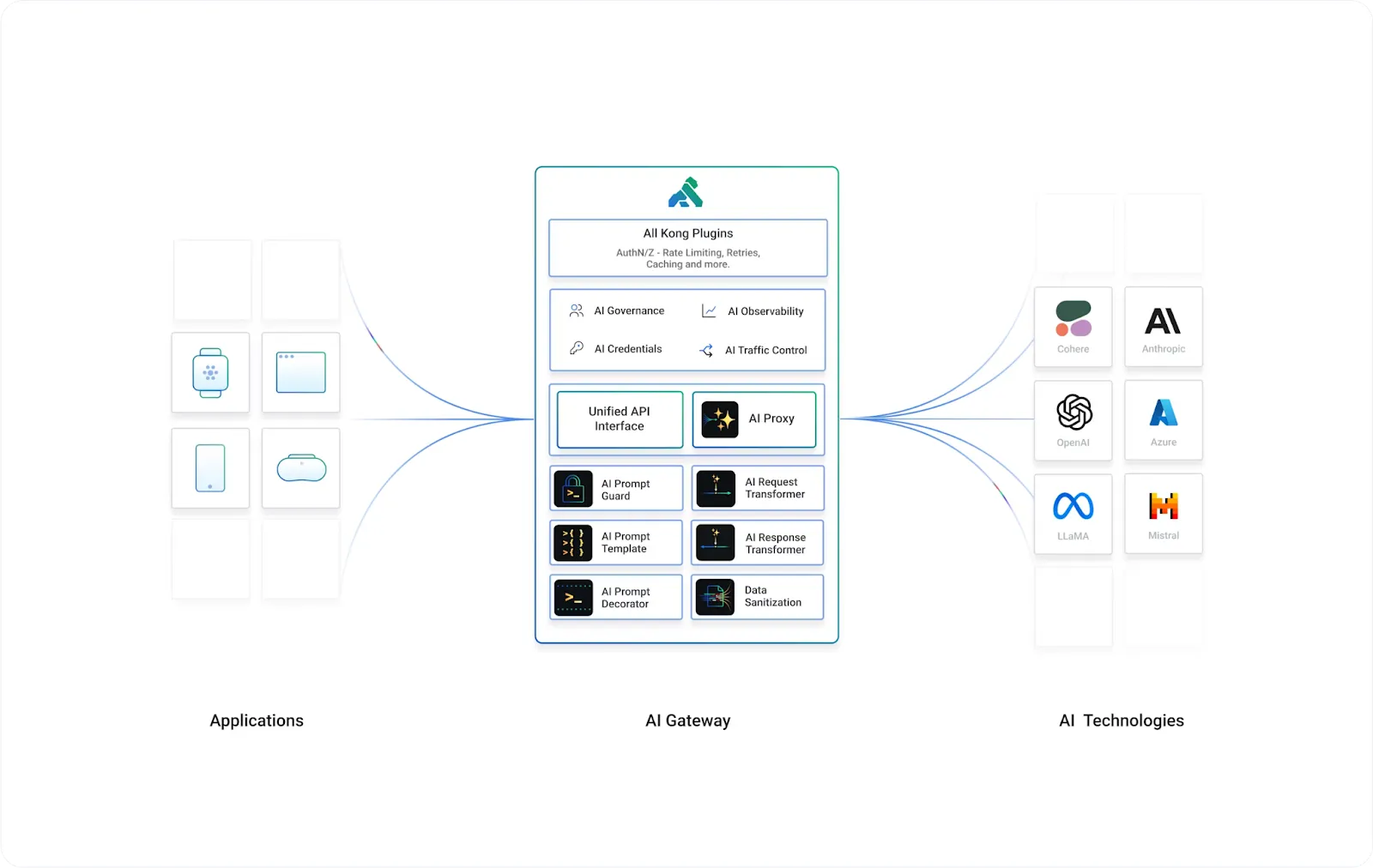

2. Puerta de enlace Kong AI

Kong aporta capacidades avanzadas de gestión de API a las cargas de trabajo de IA, ampliando su plataforma probada con funciones específicas para la IA. Si su organización ya utiliza Kong para las API tradicionales, la puerta de enlace de IA proporciona patrones operativos conocidos con nuevas capacidades diseñadas para el tráfico de LLM.

Aprovechamiento de una infraestructura madura

La fortaleza de Kong radica en su amplio ecosistema de complementos y en sus funciones operativas de nivel empresarial. Los complementos específicos para la IA incluyen el enrutamiento semántico y el equilibrio de carga avanzado con seis estrategias de enrutamiento. La limitación de velocidad basada en tokens admite varias estrategias, aunque la implementación puede resultar compleja en comparación con las alternativas más modernas.

Profundidad de integración empresarial

La herencia empresarial de Kong se refleja en las capacidades de seguridad y gobernanza. OAuth 2.0, JWT, mTLS y el control de acceso basado en roles se integran con los proveedores de identidad empresariales existentes, aunque los equipos informan que la documentación puede resultar difícil de manejar para encontrar funciones específicas de la IA.

La mejor opción para Kong AI Gateway

Organizaciones con infraestructura Kong existente que desean extender los patrones operativos conocidos a las cargas de trabajo de IA. El enfoque híbrido funciona bien para los equipos que necesitan una gestión integral de las API junto con capacidades específicas de la IA.

Consideraciones potenciales: De Kong complejidad de precios está bien documentado, con costos que superan los 30 dólares por millón de solicitudes en comparación con las alternativas. El modelo de precios multidimensional (servicios de pasarela, solicitudes de API, complementos de pago, complementos premium) crea una imprevisibilidad de los costos que puede resultar prohibitiva para las cargas de trabajo de IA de gran volumen. Además, los precios empresariales requieren consultas de ventas, lo que dificulta la planificación de los costes.

Explore también: Los 5 mejores Alternativas a Kong AI

3. Portkey

Portkey se posiciona como Plataforma LLMops en lugar de solo una puerta de enlace, que ofrece una gestión integral del ciclo de vida de las aplicaciones de IA junto con la funcionalidad de proxy tradicional. Sin embargo, la funcionalidad LLMops de la plataforma es limitada y carece de funciones clave como la implementación.

Características de Beyond Basic Gateway

La plataforma brinda acceso a cientos de LLM a través de una API unificada y, al mismo tiempo, se extiende a herramientas rápidas de administración, protección y gobierno. Más de 50 barreras prediseñadas abordan los problemas de seguridad y cumplimiento, con filtrado de contenido automatizado y detección de PII.

La administración avanzada de solicitudes incluye plantillas colaborativas y capacidades de control de versiones. La supervisión en tiempo real proporciona una visibilidad completa, aunque algunos usuarios afirman que la plataforma puede ser abrumador para los nuevos usuarios debido a la amplia gama de funciones (sugeridas en el mercado de AWS por los revisores del producto).

Fiabilidad y seguridad empresariales

Las certificaciones de cumplimiento de SOC2, ISO27001, HIPAA y GDPR, combinadas con opciones de implementación que abarcan entornos SaaS, híbridos y totalmente aislados, abordan los requisitos de seguridad empresarial. El SLA con un tiempo de actividad del 99,99% ofrece garantías de fiabilidad.

Cuándo elegir Portkey

Organizaciones que requieren capacidades integradas de LLMOP más allá de la funcionalidad básica de puerta de enlace. El completo conjunto de funciones justifica la inversión para los equipos que crean aplicaciones de IA complejas que requieren una gestión rápida y sofisticada y amplias barreras de protección.

Consideraciones potenciales: Los precios empresariales son complejos, funciones clave como los límites presupuestarios están restringidos solo para clientes empresariales. Algunos usuarios informan funcionalidad de exportación limitada requieren la intervención manual del equipo de soporte para acceder a los datos. La funcionalidad de LLMOps de la plataforma también es limitada, ya que opciones clave como la implementación tampoco se admiten de forma nativa.

4. Helicone

Helicone se diferencia a través de la ingeniería de rendimiento y el diseño centrado en el desarrollador. Creada en Rust para medir la velocidad, la plataforma procesa las solicitudes con un tiempo de procesamiento P50 de aproximadamente 8 ms, aunque esto sigue representando una latencia considerablemente mayor que la de las soluciones más optimizadas.

Sin embargo, los equipos que buscan funciones más centradas en la empresa pueden considerar una Alternativa a Helicone para cumplir con los requisitos más allá del rendimiento, como la gobernanza, la administración de costos y el cumplimiento.

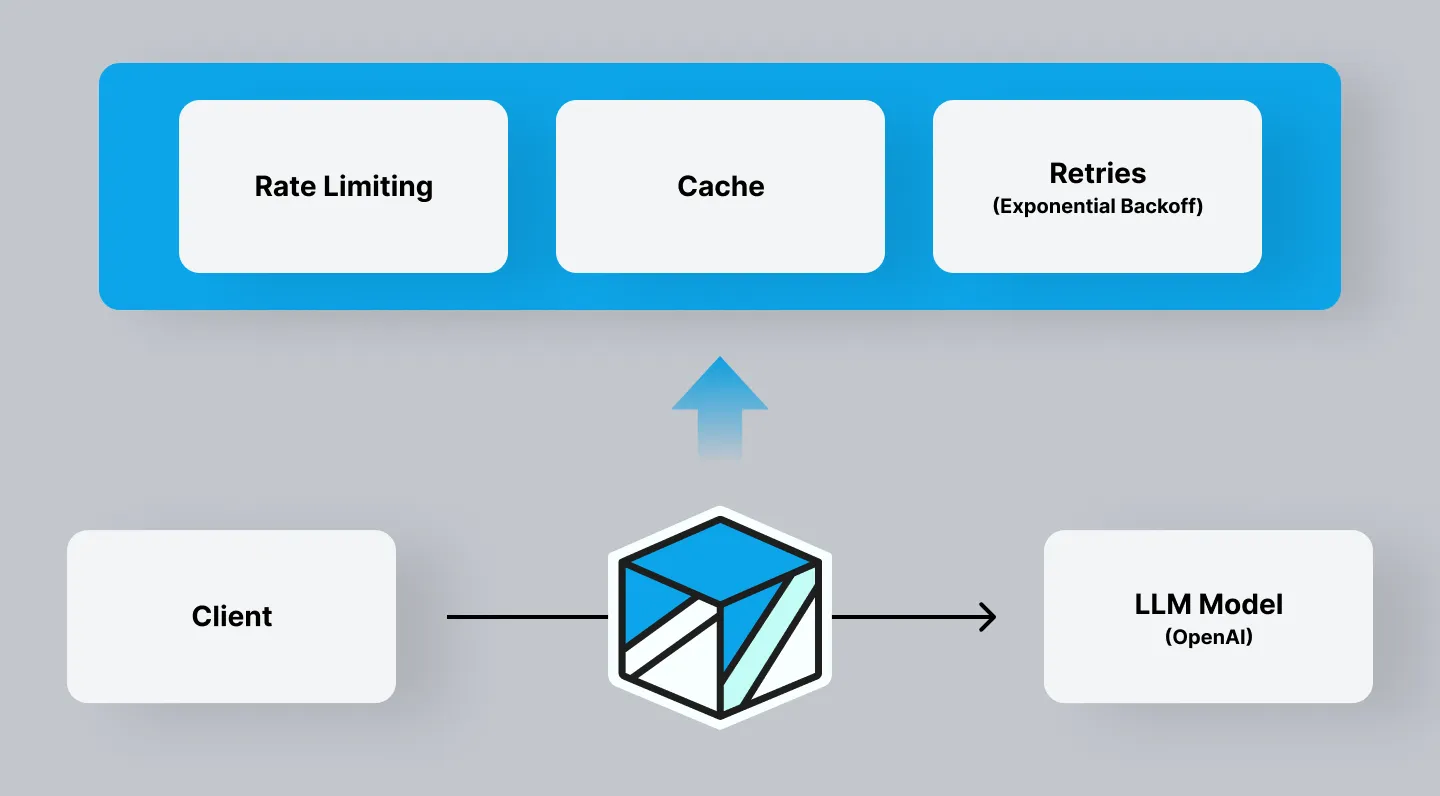

Arquitectura que prioriza el rendimiento

La API unificada admite más de 100 modelos de los principales proveedores con capacidades inteligentes de almacenamiento en caché y equilibrio de carga. La limitación de velocidad incorporada y las conmutaciones por error automáticas proporcionan confiabilidad para las implementaciones de producción, aunque el alcance es más limitado que el de las soluciones empresariales integrales.

Centrarse en la experiencia del desarrollador

La experiencia de los desarrolladores enfatiza la simplicidad con la integración de código de una sola línea y la compatibilidad con OpenAI SDK. El panel de observabilidad proporciona una supervisión integrada sin necesidad de configurar herramientas adicionales, aunque carece de la profundidad de las alternativas centradas en la empresa.

Ideal para equipos centrados en el rendimiento

Organizaciones en las que se valora la simplicidad de los desarrolladores por encima de las funciones empresariales integrales. El enfoque que prioriza el rendimiento atrae a los equipos que crean aplicaciones orientadas al consumidor en las que la simplicidad importa más que la gobernanza.

Consideraciones potenciales: Si bien es más rápida que la de algunas alternativas, la sobrecarga de 8 ms sigue siendo significativamente mayor que la de las soluciones optimizadas. El conjunto de funciones es más limitado que el de las plataformas empresariales y carece de funciones avanzadas de gobierno, cumplimiento y administración de costos integrales. La mayoría de las funciones que ofrece la plataforma también están presentes en otras soluciones, lo que reduce la diferenciación de los productos.

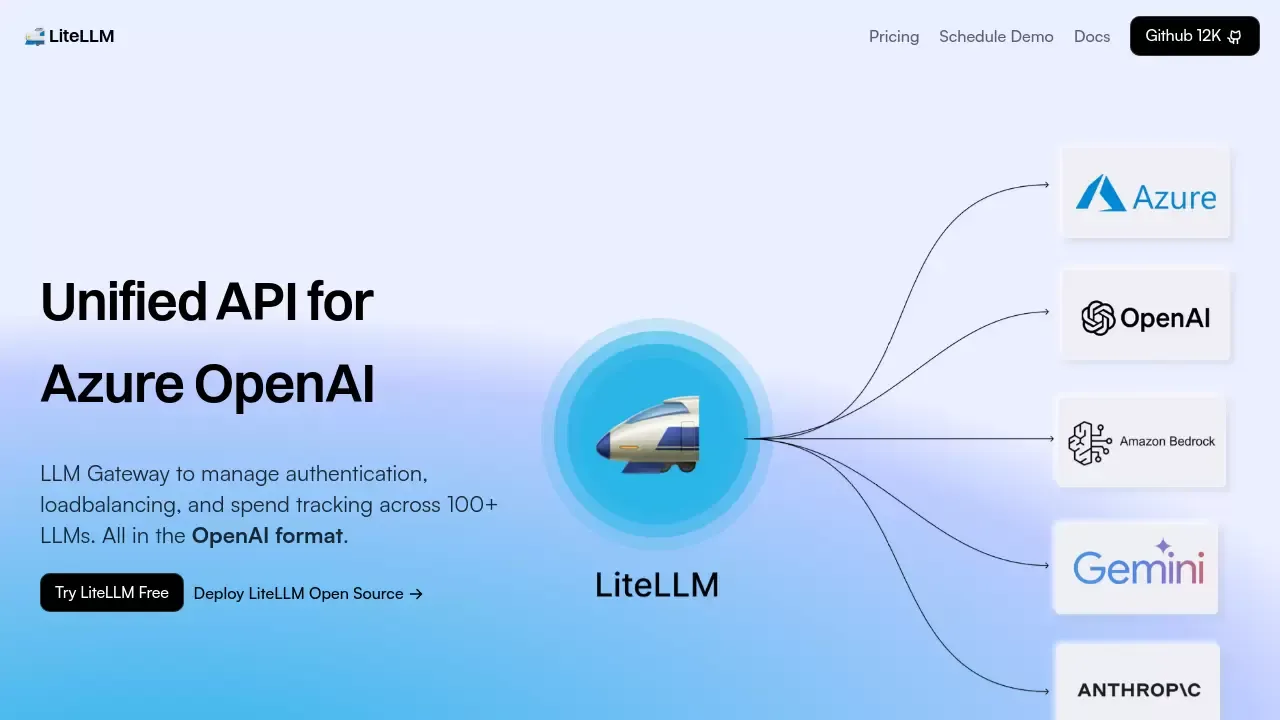

5. LitELLM: flexibilidad de código abierto y control de costos

LitellM adopta un enfoque de código abierto para la funcionalidad de puerta de enlace de IA, proporcionando un servidor proxy basado en Python que unifica el acceso a cientos de API de LLM en formato OpenAI.

Compatibilidad universal de API

La fortaleza de la plataforma reside en la compatibilidad universal de las API, que permite a los principales proveedores disponer de un equilibrio de carga avanzado y una lógica de reintento. Las funciones de administración de costos proporcionan un seguimiento básico de los gastos y límites presupuestarios, aunque sin la sofisticación de las alternativas empresariales.

Ventajas y consideraciones del código abierto

El modelo de código abierto proporciona transparencia y flexibilidad de personalización. La gestión de la configuración basada en YAML permite utilizar la infraestructura como código, mientras que las opciones de implementación de Docker son compatibles con los entornos de producción básicos.

Ideal para equipos de plataformas y organizaciones preocupadas por los costos

Equipos que valoran la transparencia del código abierto y desean mantener un control total sobre su infraestructura de IA.

Consideraciones potenciales: LitellM tiene limitaciones significativas para uso empresarial: sin respaldo comercial formal significa que no hay un plan de soporte empresarial, no hay SLA para el tiempo de actividad y no hay una ruta de escalamiento dedicada. Informe de usuarios regresiones frecuentes entre versiones, errores extremos e inestabilidad a gran escala. El sobrecarga de latencia significativa se convierte en un cuello de botella para las aplicaciones en tiempo real. Además, carece de observabilidad avanzada, controles de seguridad y funciones empresariales más allá del enrutamiento básico. Las actualizaciones también se realizan con lentitud y no llegan a algunos modelos menos utilizados, como los proveedores, lo que dificulta aspectos básicos como el soporte de modelos más nuevos y ralentiza el proceso de desarrollo. En algunos casos prácticos, los usuarios tienen que plantear manualmente los problemas de GitHub y añadir compatibilidad con los modelos más nuevos en todos los proveedores.

La mejor puerta de enlace de IA: comparación: rendimiento, seguridad y escalabilidad

Al evaluar las pasarelas de IA, tres dimensiones técnicas son las que más importan:

Características de rendimiento: La sobrecarga de menos de 5 ms de TrueFoundry representa el mejor rendimiento de latencia de su clase, fundamental para las aplicaciones en tiempo real y los flujos de trabajo de los agentes. Los 8 ms de Helicone son respetables, pero siguen siendo significativamente más altos, mientras que otros introducen una latencia considerablemente mayor que puede afectar a la experiencia del usuario.

Seguridad y cumplimiento: El cumplimiento de SOC 2 tipo 2 e HIPAA de TrueFoundry y el cumplimiento de SOC 2, ISO, HIPAA y GDPR de Portkey, combinados con controles de acceso integrales y capacidades de auditoría, brindan seguridad de nivel empresarial. Otras soluciones carecen de certificaciones de cumplimiento formales o requieren una configuración compleja para lograr niveles de seguridad similares.

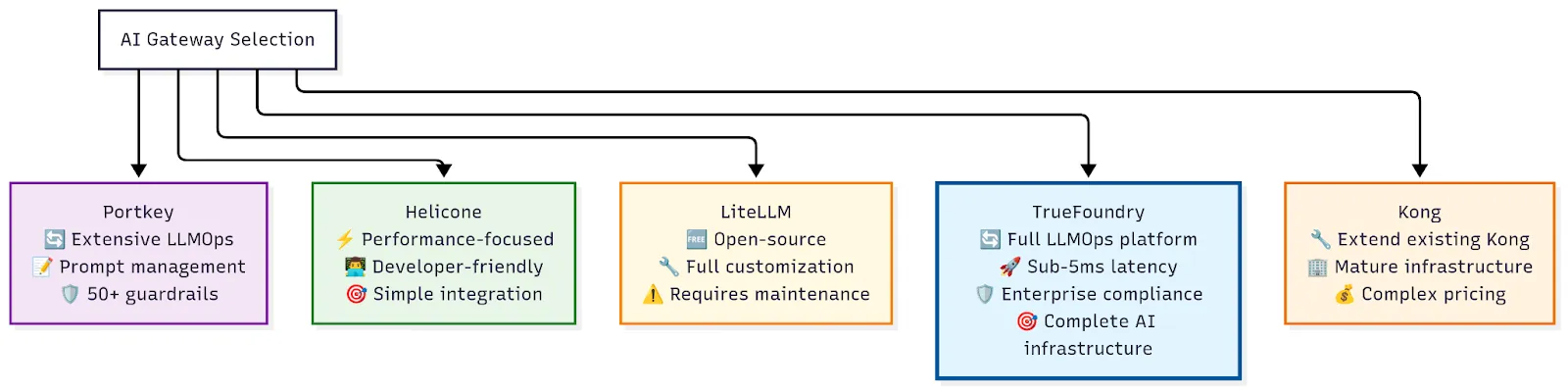

¿Cómo elegir la puerta de enlace de IA adecuada?

La selección óptima de una pasarela de IA depende de sus requisitos específicos, de la infraestructura existente y de las prioridades estratégicas. Este es un marco práctico:

Elige TrueFoundry si necesita un cumplimiento de nivel empresarial, amplias capacidades de LLMOP, rendimiento y gobierno sin comprometer ninguna dimensión. La plataforma es especialmente adecuada para las organizaciones que administran varios proveedores de LLM con requisitos granulares de control de acceso y costos. La arquitectura unificada, con soporte integral para MCP y capacidades de modelos autohospedados, atrae a los equipos que desean la solución de administración de infraestructuras de IA más completa. La latencia inferior a 5 ms de TrueFoundry y el cumplimiento empresarial comprobado lo hacen ideal para las aplicaciones de IA de misión crítica.

Elige Kong si ya está utilizando Kong para las API tradicionales y desea extender los patrones operativos conocidos a las cargas de trabajo de IA, a pesar de la complejidad de los precios y los costos más altos. El enfoque híbrido funciona para las organizaciones con arquitecturas de servicios complejas, pero hay que estar preparadas para la curva de aprendizaje y los desafíos de la administración de costos.

Elige Portkey si necesita capacidades de LLMOP básicas integradas y puede justificar el precio empresarial de herramientas sofisticadas de administración y gobierno rápidas. Al realizar la evaluación, tenga en cuenta la complejidad de las funciones y las limitadas capacidades de exportación de datos.

Elige Helicone si el rendimiento y la simplicidad de los desarrolladores son sus principales preocupaciones, y puede aceptar las limitaciones de las funciones de gobierno empresarial. El enfoque es adecuado para los equipos que crean aplicaciones orientadas al consumidor donde el cumplimiento empresarial no es fundamental.

Elija LitellM si tiene sólidas capacidades de ingeniería para gestionar la complejidad del código abierto y puede aceptar las limitaciones relacionadas con el soporte empresarial, la estabilidad y la sobrecarga de rendimiento. Prepárese para los posibles problemas de producción y la necesidad de mantenimiento interno.

El futuro de la infraestructura de IA

El mercado de pasarelas de IA continúa evolucionando rápidamente, y los proveedores tradicionales de administración de API agregan funciones específicas de IA, mientras que las soluciones nativas de IA maduran para cumplir con los requisitos empresariales. Tres tendencias darán forma a la próxima generación:

Integración de IA con agencias: A medida que los agentes de IA se vuelven más autónomos, plataformas de IA agénticas y las pasarelas necesitarán capacidades de orquestación sofisticadas para los flujos de trabajo de varios agentes, el encadenamiento de herramientas y los procesos de razonamiento complejos. El MCP Gateway de TrueFoundry lo posiciona bien para esta evolución.

Soporte multimodal: La expansión del texto a las imágenes, el audio y el vídeo requerirá pasarelas que puedan gestionar diversos tipos de datos, gestionar los diferentes costos de procesamiento y optimizar los diferentes requisitos de latencia.

Implementación perimetral e híbrida: Las organizaciones exigirán modelos de implementación flexibles que admitan entornos locales, en la nube y periféricos, a la vez que mantengan una gobernanza y una observabilidad consistentes.

Conclusión

El mercado de pasarelas de IA empresariales representa un punto de inflexión crítico en la madurez de la infraestructura de IA. Los equipos que cuenten con esta capa tendrán ventajas competitivas sostenibles en un futuro impulsado por la IA. Aquellos que no lo hagan se encontrarán constantemente luchando contra problemas de infraestructura en lugar de crear aplicaciones de inteligencia artificial innovadoras.

La elección que tome hoy afectará significativamente a su capacidad de adaptación a medida que avancen las capacidades de la IA. Si bien cada solución tiene sus ventajas, la combinación de rendimiento empresarial, cumplimiento integral y arquitectura con visión de futuro de TrueFoundry proporciona la base más completa para ampliar las operaciones de IA. La latencia inferior a 5 ms de la plataforma, la probada adopción empresarial y el enfoque unificado de la gestión de la LLM, la integración de MCP y el soporte de modelos autohospedados ofrecen el mejor equilibrio entre el valor inmediato y la flexibilidad futura.

Para los equipos que estén listos para ir más allá de los proyectos experimentales de IA hacia despliegues a escala de producción, la elección de la plataforma de puerta de enlace determinará la eficiencia operativa, la postura de seguridad y la flexibilidad estratégica. Las soluciones que se describen aquí representan el estado actual del arte, pero el enfoque integral de TrueFoundry y su diseño centrado en la empresa la convierten en la mejor opción para las organizaciones que se toman en serio la ampliación de la infraestructura de IA.

¿Estás listo para empezar? El proceso de pasar de las demostraciones de IA a los sistemas de producción no tiene por qué ser difícil. Con la elección de pasarela y la estrategia de implementación adecuadas, puede crear una infraestructura de IA que se escale, se mantenga segura y mantenga los costos bajo control.

Preguntas frecuentes

¿Quién proporciona la mejor puerta de enlace de IA para las empresas?

TrueFoundry proporciona la mejor puerta de enlace de IA con administración unificada de modelos, seguridad y observabilidad en una sola plataforma. Esto permite a los equipos implementar aplicaciones de IA confiables con rapidez y, al mismo tiempo, mantener un control total sobre sus datos privados y la infraestructura subyacente.

¿Qué funciones debe buscar en las pasarelas de IA empresariales?

Las pasarelas de IA empresariales requieren funciones fundamentales como el enmascaramiento de la PII, el enrutamiento rentable y el registro detallado de solicitudes para garantizar el cumplimiento. Estas capacidades ayudan a las organizaciones a gestionar de forma sistemática el uso de los modelos en varios equipos. Las mejores plataformas también ofrecen una latencia de alto rendimiento y una API unificada tanto para los modelos de SaaS patentados como para los de código abierto autohospedados.

¿Cuáles son las mejores pasarelas de IA para las cargas de trabajo de LLM de producción?

Las pasarelas de IA de nivel de producción priorizan la alta disponibilidad y la conmutación por error perfecta de los proveedores. Las plataformas de primer nivel, como TrueFoundry, mantienen las aplicaciones en línea al redirigir automáticamente el tráfico si un proveedor de modelos experimenta un tiempo de inactividad. Esta resiliencia operativa es fundamental para mantener una experiencia de usuario uniforme a escala sin intervención manual de ingeniería.

¿Por qué TrueFoundry es la mejor pasarela de IA para escalar la IA en producción?

TrueFoundry se destaca en la escalabilidad porque simplifica la compleja orquestación de las GPU y la implementación de modelos dentro de un plano de control unificado. La plataforma gestiona millones de solicitudes y, al mismo tiempo, proporciona un seguimiento detallado de los costos en diversos equipos. Esto permite a las organizaciones ampliar las iniciativas de inteligencia artificial sin aumentar la complejidad operativa ni la sobrecarga de infraestructura.

¿Qué es una alternativa de código abierto a AWS API Gateway?

Si bien AWS proporciona herramientas generales, la mejor puerta de enlace de IA para tareas especializadas de LLM requiere plataformas compatibles con el código abierto, como TrueFoundry. Ofrece una alternativa específica para gestionar las necesidades específicas del modelo, como los límites de los tokens y el almacenamiento en caché semántico. Esto brinda a los desarrolladores una mayor flexibilidad que la que pueden ofrecer las pasarelas de API tradicionales y de uso amplio para flujos de trabajo de IA complejos.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)