Vercel AI Review 2026 : nous l'avons testé pour que vous n'ayez pas à le faire

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Si vous parcourez Twitter ou les forums de développeurs, Vercel AI semble être le mécanisme par défaut pour créer des applications d'IA générative. L'utilisation du SDK vercel/ai avec Next.js permet aux équipes d'ingénierie de passer d'un répertoire vide à un chatbot de streaming en quelques minutes.

L'expérience développeur (DX) est indéniablement optimisée pour une satisfaction immédiate, éliminant ainsi les complexités liées à l'analyse des flux et à la gestion de l'état de l'interface utilisateur. Mais est-ce que « facile à démarrer » équivaut à « facile à adapter » ?

Nous avons rigoureusement testé la plateforme au-delà de la phase de prototype pour cette revue Vercel AI, en la soumettant à des flux de travail agentiques, à des pipelines RAG à haut débit et à des normes de conformité de sécurité d'entreprise. Cette analyse architecturale décrit les domaines dans lesquels la plateforme excelle, identifie des limites opérationnelles spécifiques et explique pourquoi les équipes de dimensionnement passent souvent à des plateformes d'orchestration dédiées telles que TrueFoundry.

.webp)

Qu'est-ce que « Vercel AI » en fait ?

L'IA de Vercel est souvent mal comprise car le marketing associe l'outillage côté client à l'infrastructure sous-jacente. D'un point de vue architectural, Vercel AI est un composite du SDK d'IA open source et des environnements d'exécution Edge et Serverless propriétaires de Vercel.

Le SDK gère la couche d'abstraction, gère les protocoles de streaming, la contre-pression et le changement de fournisseur entre des API telles qu'OpenAI ou Anthropic. Cependant, le comportement d'exécution est inextricablement lié au modèle d'hébergement de Vercel. Une fois déployées, ces routes d'API s'exécutent soit comme Fonctions Edge (isolateurs V8 légers) ou Fonctions sans serveur (conteneurs Node.js éphémères).

Cette distinction est essentielle car elle dicte les contraintes opérationnelles. Vous n'utilisez pas un serveur persistant ; vous exécutez des instances de calcul éphémères, pilotées par des événements, dont la durée d'exécution et la disponibilité de la mémoire sont strictement limitées, quelle que soit la complexité de votre chaîne de raisonnement LLM.

Le « chemin du bonheur » : là où Vercel AI brille

Avant d'analyser les limites, il est nécessaire de valider les domaines dans lesquels Vercel AI apporte une valeur d'ingénierie tangible. Lors de tests pratiques, la plate-forme a démontré une utilité claire pour des modèles architecturaux spécifiques.

- Vélocité frontale : La mise en œuvre d'interfaces de chat en streaming avec le hook UseChat permet de réduire considérablement le passe-partout. Lors de nos tests internes, l'établissement d'une connexion entre un frontend Next.js et un backend OpenAI a nécessité moins de 20 lignes de code, gérant automatiquement la reconstruction des réponses par segments.

- Temps écoulé jusqu'au premier octet (TTFB) : L'exécution Edge fournit un TTFB agressif. Comme les fonctions Edge s'exécutent sur des isolateurs V8 qui démarrent en quelques millisecondes, elles éliminent la pénalité de démarrage à froid du conteneur associée aux fonctions sans serveur traditionnelles. Ils sont donc idéaux pour les tâches d'inférence légères et sans état où la faible latence est le principal indicateur de performance clé.

- Intégration de Next.js : Pour les équipes déjà ancrées dans l'écosystème Next.js, les difficultés d'intégration sont effectivement nulles. Le package ai s'intègre de manière native à l'App Router, éliminant ainsi la nécessité d'une configuration de passerelle Vercel distincte.

Le test de résistance : lorsque l'expérience atteint ses limites

Lorsqu'elle est poussée au-delà des simples cycles demande-réponse pour aborder des tâches de raisonnement complexes, Vercel AI expose d'importantes contraintes d'infrastructure. Les limites suivantes ont été documentées lors de notre analyse comparative des charges de travail agentiques et lourdes en RAG.

Le délai d'attente maximal pour les flux de travail des agences

L'exécution d'agents de recherche approfondis ou de boucles de raisonnement en plusieurs étapes dépasse rapidement les limites d'exécution strictes imposées par la plateforme, et c'est là Vercel AI gateway et OpenRouter devient important pour les équipes qui évaluent des alternatives évolutives.

- Plan de loisirs : Les fonctions sans serveur sont strictement limitées à 10 secondes.

- Forfait Pro : Le délai d'attente par défaut est 15 secondes, configurable jusqu'à un maximum de 300 secondes (5 minutes).

Pour un agent autonome qui a besoin de scraper un site Web, d'analyser le DOM, d'interroger une base de données vectorielle, puis de générer une réponse en chaîne de pensée, cette fenêtre de 5 minutes est souvent insuffisante. Lors de nos tests, les agents de longue durée se sont régulièrement arrêtés avec 504 erreurs de temporisation de passerelle une fois la limite stricte atteinte.

Les fonctions Edge sont encore plus restrictives, imposant une limite stricte au temps entre la demande et le premier octet de la réponse. Si votre agent a besoin d'un long « temps de réflexion » avant de diffuser le premier jeton, la connexion est interrompue par la couche proxy de la plateforme.

.webp)

Démarrages à froid pour les charges de travail lourdes

Bien que les fonctions Edge soient rapides, elles ne sont pas totalement compatibles avec Node.js, ce qui oblige les équipes à utiliser des fonctions sans serveur standard pour les opérations impliquant de fortes dépendances ou des connexions à des bases de données. Le chargement de modèles d'invite volumineux, de schémas de validation (comme Zod) ou l'établissement de connexions SSL à une base de données vectorielle externe (par exemple, Pinecone ou Weaviate) entraîne une latence importante lors de l'initialisation.

Nos tests de performance ont indiqué que les fonctions sans serveur se connectant à une instance AWS RDS ont connu des démarrages à froid allant de 800 ms à 2,5 secondes. Contrairement aux serveurs persistants qui gèrent des pools de connexions, les fonctions sans serveur doivent fréquemment rétablir les prises de contact TCP/TLS lors de nouvelles invocations. Cela ajoute une latence perceptible à l'expérience utilisateur.

Dépendance architecturale à l'égard du middleware Edge

Vercel Edge Middleware utilise un environnement d'exécution propriétaire (EdgeRuntime) plutôt que le runtime Node.js standard. Bien qu'il respecte les normes Web telles que fetch, il ne prend pas en charge les API Node natives telles que les addons fs fs, net ou C++.

Par conséquent, la logique de routage ou le middleware personnalisé développé spécifiquement pour Vercel's Edge ne sont pas facilement portables. La migration de cette logique vers un environnement conteneurisé standard (Docker) ou vers un autre fournisseur de cloud (AWS Lambda) nécessite souvent une réécriture de la couche passerelle. Cela crée une dépendance architecturale dans laquelle le coût de sortie de la plate-forme augmente de façon linéaire en fonction de la complexité de la logique intergicielle mise en œuvre.

Examen des fonctionnalités de Vercel AI Gateway

La passerelle Vercel AI est souvent présentée comme une solution complète de gestion du trafic. Nous avons évalué ses capacités par rapport aux exigences d'une passerelle API de production.

Capacités de mise en cache

La stratégie de mise en cache de Vercel repose principalement sur les en-têtes HTTP et les clés basées sur des URL. Cela est insuffisant pour les charges de travail LLM où des invites distinctes peuvent être sémantiquement équivalentes. Vrai mise en cache sémantique nécessite l'intégration de l'invite et l'exécution d'une recherche de similarité vectorielle. L'implémentation de cette fonctionnalité sur Vercel nécessite une ingénierie manuelle avec une instance Vercel KV (Redis) distincte, ce qui signifie que les fonctionnalités avancées de Vercel Gateway, telles que la mise en cache sémantique, ne sont pas prêtes à l'emploi.

Observabilité et mesures

Le tableau de bord Vercel est optimisé pour les données vitales du Web (LCP, FID) plutôt que pour les métriques spécifiques à l'IA. Par défaut, il n'y a aucune visibilité sur débit de jetons, coût par utilisateur, ou Répartition de la latence LLM.

Pour obtenir ces informations, les équipes d'ingénieurs doivent instrumenter des plateformes d'observabilité tierces telles que Helicone ou Langfuse. Bien que le SDK prenne en charge ces intégrations, elles représentent des fournisseurs distincts supplémentaires à gérer et à payer, plutôt qu'une fonctionnalité native de la passerelle elle-même.

Pourquoi TrueFoundry est-il une meilleure alternative de production ?

TrueFoundry est conçu pour répondre aux limites d'infrastructure inhérentes aux architectures sans serveur. Cette section explique comment elle facilite le déploiement de l'IA de niveau production au-delà de ce que couvre généralement une revue Vercel AI.

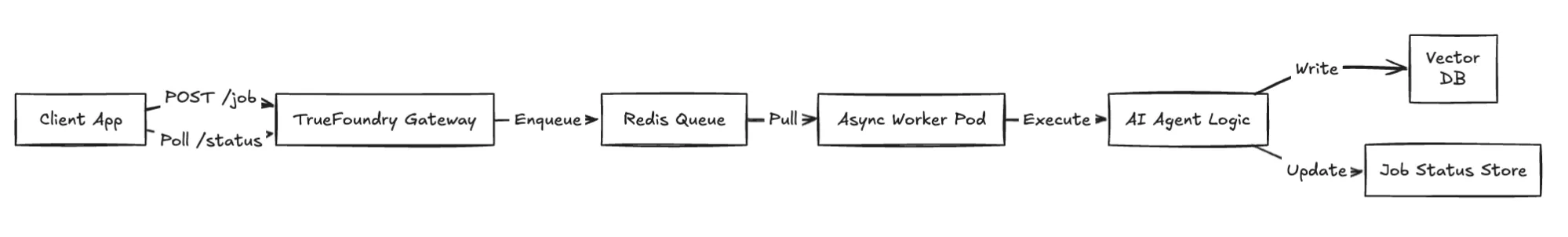

Travailleurs asynchrones pour les agents

TrueFoundry dissocie l'exécution des tâches de longue durée du cycle de requête/réponse HTTP. Il prend en charge les exécuteurs de tâches asynchrones qui fonctionnent sans les limites de temps d'exécution strictes que l'on trouve dans les environnements sans serveur.

Cette architecture permet aux agents d'effectuer des tâches étendues, telles que le grattage de centaines de pages ou le traitement de grands ensembles de données, sur des périodes allant de quelques minutes à quelques heures. En utilisant Kubernetes Jobs ou des travailleurs en arrière-plan, le système évite complètement 504 délais d'attente. Le client reçoit immédiatement un identifiant de tâche, et le travail est traité de manière fiable en arrière-plan à l'aide d'une architecture basée sur les files d'attente.

Figure 2 : Architecture asynchrone TrueFoundry

Réseau privé et déploiement de VPC

Les exigences de sécurité des environnements d'entreprise exigent souvent que les données ne transitent pas par les réseaux publics. TrueFoundry déploie des passerelles IA directement dans votre propre cloud VPC (AWS, GCP ou Azure).

Cette configuration garantit que les connexions entre vos services d'inférence et vos magasins de données (tels que RDS ou index vectoriels privés) sont acheminées via des réseaux privés internes à faible latence (par exemple, AWS PrivateLink). Cela permet de respecter les normes de sécurité d'entreprise de Vercel AI Gateway. Les charges utiles sensibles sont traitées au sein de votre périmètre de sécurité, atténuant ainsi les risques d'exfiltration de données associés aux réseaux périphériques multi-locataires.

Contrôle des coûts avec les instances ponctuelles

Vercel facture une prime pour la commodité de l'exécution sans serveur (facturation basée sur les Go d'heures). En revanche, TrueFoundry orchestre les charges de travail sur le cloud computing brut, ce qui permet d'utiliser des instances ponctuelles (AWS) ou des machines virtuelles préemptives (GCP).

En tirant parti des flottes Spot pour les charges de travail d'inférence interruptibles, les équipes peuvent réduire les coûts de calcul d'environ 60 % par rapport à la tarification à la demande. En outre, TrueFoundry gère le cycle de vie de ces instances, en gérant les interruptions avec élégance afin de maintenir la disponibilité du service.

Comparaison entre Vercel AI et TrueFoundry

Le tableau suivant met en contraste les caractéristiques opérationnelles des deux plateformes pour les charges de travail de production, résumant les évaluations courantes des passerelles Vercel AI.

Quand s'éjecter de Vercel et passer à TrueFoundry ?

Vercel est un choix optimal pour le développement frontend et le prototypage rapide de l'IA. Cependant, les charges de travail d'IA de niveau production nécessitent souvent un meilleur contrôle des coûts et de l'infrastructure que ne le permet le modèle sans serveur.

TrueFoundry fournit une plate-forme spécialement conçue pour exécuter des backends d'IA à grande échelle, en éliminant les délais d'attente, les structures de facturation opaques et les dépendances d'exécution spécifiques à la plate-forme.

Si votre équipe cherche à simplifier l'infrastructure d'IA tout en réduisant les frais d'exploitation, entrez en contact avec l'équipe TrueFoundry pour évaluer comment la plateforme peut répondre à vos besoins de production spécifiques.

Questions fréquemment posées

Est-ce que Vercel AI est sécurisé ?

Vercel AI utilise un cryptage standard pour les données en transit et au repos. Cependant, en tant que plateforme SaaS à locataires multiples, elle peut ne pas répondre aux exigences strictes de résidence ou d'isolation des données (VPC à locataire unique) imposées par des secteurs hautement réglementés par rapport à une solution auto-hébergée sur TrueFoundry.

Vercel est-il digne de confiance ?

Oui, Vercel est une société de technologie de série D réputée qui héberge de grandes propriétés Web. Les préoccupations relatives à la « confiance » suscitées par une évaluation de Vercel AI font généralement référence au « risque de plateforme », c'est-à-dire au risque stratégique lié à la mise en place d'un écosystème propriétaire, plutôt qu'à des problèmes de sécurité ou d'intégrité commerciale.

Quels sont les inconvénients de Vercel ?

Les principaux inconvénients techniques mis en évidence dans les analyses de Vercel AI sont les délais d'exécution stricts (maximum 5 minutes), la limite de 4,5 Mo de corps de requête, l'impossibilité de connecter des GPU pour l'hébergement de modèles personnalisés et la possibilité de coûts de mise à l'échelle complexes.

Combien coûte Vercel AI ?

Le SDK Vercel AI est open source. Les coûts d'infrastructure sont liés au plan d'hébergement Vercel : la version Pro commence à 20$ par utilisateur et par mois, mais des frais basés sur l'utilisation pour la durée des fonctions et le transfert des données s'appliquent. Les applications d'IA à volume élevé peuvent connaître une escalade rapide des coûts en raison de ces compteurs d'utilisation.

Quand ne pas utiliser Vercel ?

Évitez d'utiliser Vercel AI Gateway si votre application nécessite des agents autonomes de longue durée (>5 minutes), le traitement de fichiers binaires volumineux (>4,5 Mo), l'hébergement de modèles open source personnalisés sur des GPU ou une isolation stricte des réseaux privés (VPC).

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)