Alternatives à Vercel AI : 8 meilleurs choix que vous pouvez essayer en 2026

![8 Vercel AI Alternatives and Competitors for 2026 [Ranked]](https://cdn.prod.website-files.com/6295808d44499cde2ba36c71/69a877c7e93c05705b362d65_ci.webp)

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Vercel a révolutionné la configuration initiale de l'intégration de l'IA. Leur SDK AI réduit le nombre de tâches nécessaires pour connecter une interface Next.js à l'API d'OpenAI, et Edge Runtime gère parfaitement l'infrastructure de streaming. Pour le prototypage, les wrappers B2C ou les outils internes à faible trafic, l'écosystème Vercel reste un choix de premier plan.

Cependant, l'architecture de Vercel est optimisée pour livraison frontale, et non des opérations d'apprentissage automatique. Au fur et à mesure que les applications passent du stade de prototype à celui de production à grande échelle, les équipes d'ingénierie se heurtent souvent à des limites architecturales : l'évolutivité des coûts dépend de la durée des fonctions, la complexité du déploiement de modèles personnalisés et affinés (par exemple, Llama 3 ou Mistral) dans un VPC privé et la nécessité d'un contrôle granulaire de la pile d'inférence.

TrueFoundry est devenu le premier choix pour les équipes d'ingénierie nécessitant une expérience de développeur (DX) similaire à celle de Vercel appliquée à leur propre infrastructure cloud. Ce rapport évalue huit alternatives en fonction de la propriété de l'infrastructure, de la flexibilité des modèles et de l'économie des unités.

Pourquoi les équipes migrent-elles depuis Vercel AI ?

L'abandon de Vercel AI résulte généralement de trois exigences architecturales ou opérationnelles spécifiques qui apparaissent à grande échelle.

1. La contrainte d'intégration des API

Le SDK AI de Vercel est principalement conçu pour enchaîner les requêtes frontales vers des API tierces telles qu'OpenAI ou Anthropic. Cette architecture fonctionne bien pour les modèles généralistes, mais crée des frictions lorsque les équipes doivent déployer des modèles affinés et auto-hébergés. L'échange d'un appel GPT-4 externe contre un modèle de paramètres 7B exécuté sur un GPU T4 nécessite généralement de réorganiser la logique du backend, car elle va au-delà du simple encapsulage d'API.

2. Confidentialité des données et conformité VPC

Les secteurs réglementés (FinTech, santé) fonctionnent souvent dans le cadre de mandats stricts en matière de résidence des données. Les politiques de sécurité des entreprises exigent souvent que l'inférence soit effectuée au sein d'un VPC (Virtual Private Cloud) privé où les entrées/sorties de données sont strictement contrôlées par le client. Bien que Vercel propose des mesures de sécurité strictes, il fonctionne comme un PaaS multi-tenant. De nombreuses entreprises préfèrent, ou sont obligées, de détenir l'intégralité de la pile informatique sur leurs propres comptes AWS ou GCP.

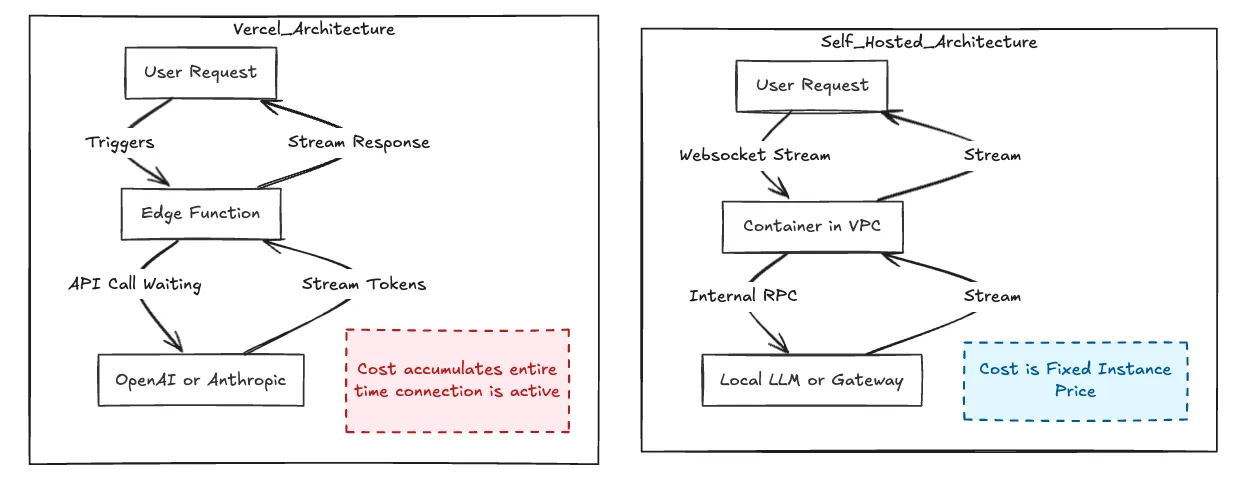

3. Le modèle de coût de la « durée de la fonction »

La tarification des fonctions sans serveur de Vercel est largement basée sur GB-secondes (allocation mémoire × durée).

- Application Web standard : Une requête prend 200 ms.

- Appli LLM : Un stream peut prendre de 20 à 40 secondes.

L'impact sur les coûts :

Exécuter une application d'IA à fort trafic sur un modèle sans serveur signifie payer pour le temps de calcul pendant que le serveur « attend » simplement que le LLM génère des jetons. À grande échelle, ce modèle de facturation peut entraîner des coûts nettement plus élevés par rapport à un service conteneurisé exécuté sur des instances à coût fixe.

Comment avons-nous évalué ces alternatives ?

Nous avons privilégié les contraintes techniques par rapport aux allégations marketing. Les alternatives ci-dessous ont été notées en fonction de quatre critères techniques :

- Modèle d'agnosticisme et d'auto-hébergement : La plateforme doit prendre en charge le déploiement de modèles arbitraires (poids Hugging Face, conteneurs Docker) et le déploiement dans un VPC appartenant au client.

- Sécurité et conformité de l'entreprise : Prise en charge des contrôles de conformité SOC2, du RBAC (contrôle d'accès basé sur les rôles) et des déploiements isolés.

- Observabilité : Possibilité de tracer des étapes distinctes dans un pipeline RAG et d'enregistrer les latences (TTFT - Time To First Token).

- Flexibilité du cadre : L'outil doit fonctionner indépendamment de l'écosystème Next.js et prendre en charge les backends Python (FastAPI/Flask) ou Go.

Les 8 meilleures alternatives à Vercel AI

1. True Foundry

Idéal pour : Les équipes qui recherchent la propriété complète de l'infrastructure sans la complexité de Kubernetes.

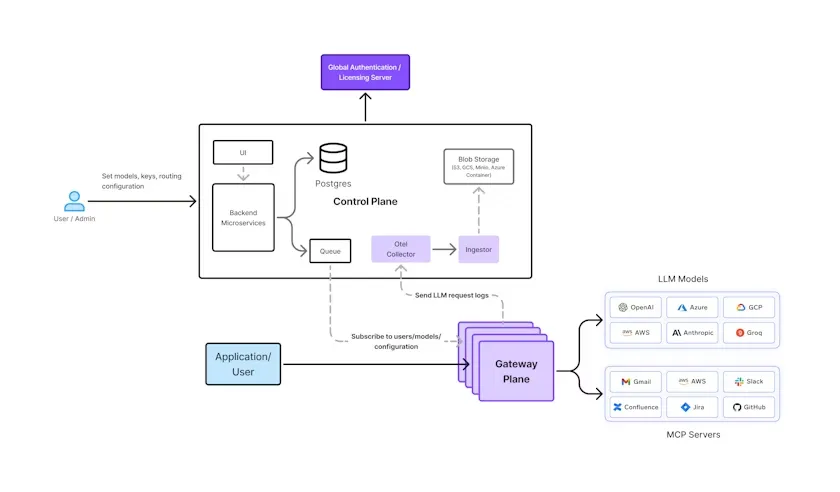

True Foundry fonctionne comme une plateforme d'apprentissage automatique en tant que service (MLPaaS) qui s'installe directement sur votre cloud existant (AWS, GCP, Azure). Contrairement à Vercel, qui fait abstraction de l'infrastructure pour donner la priorité à la vitesse du frontend, TrueFoundry fait abstraction de la complexité de Kubernetes tout en conservant un contrôle total sur le calcul sous-jacent. Il dissocie le « cerveau » (inférence/formation des modèles) de l' « interface utilisateur », permettant aux équipes de déployer des modèles open source affinés parallèlement à leur logique d'application au sein de leur propre périmètre de sécurité.

Principales caractéristiques

- Registre des modèles et déploiement : Déploiement en un clic des modèles Hugging Face, standardisant l'emballage des poids et des conteneurs Docker. Il configure automatiquement les pilotes CUDA et les demandes de ressources.

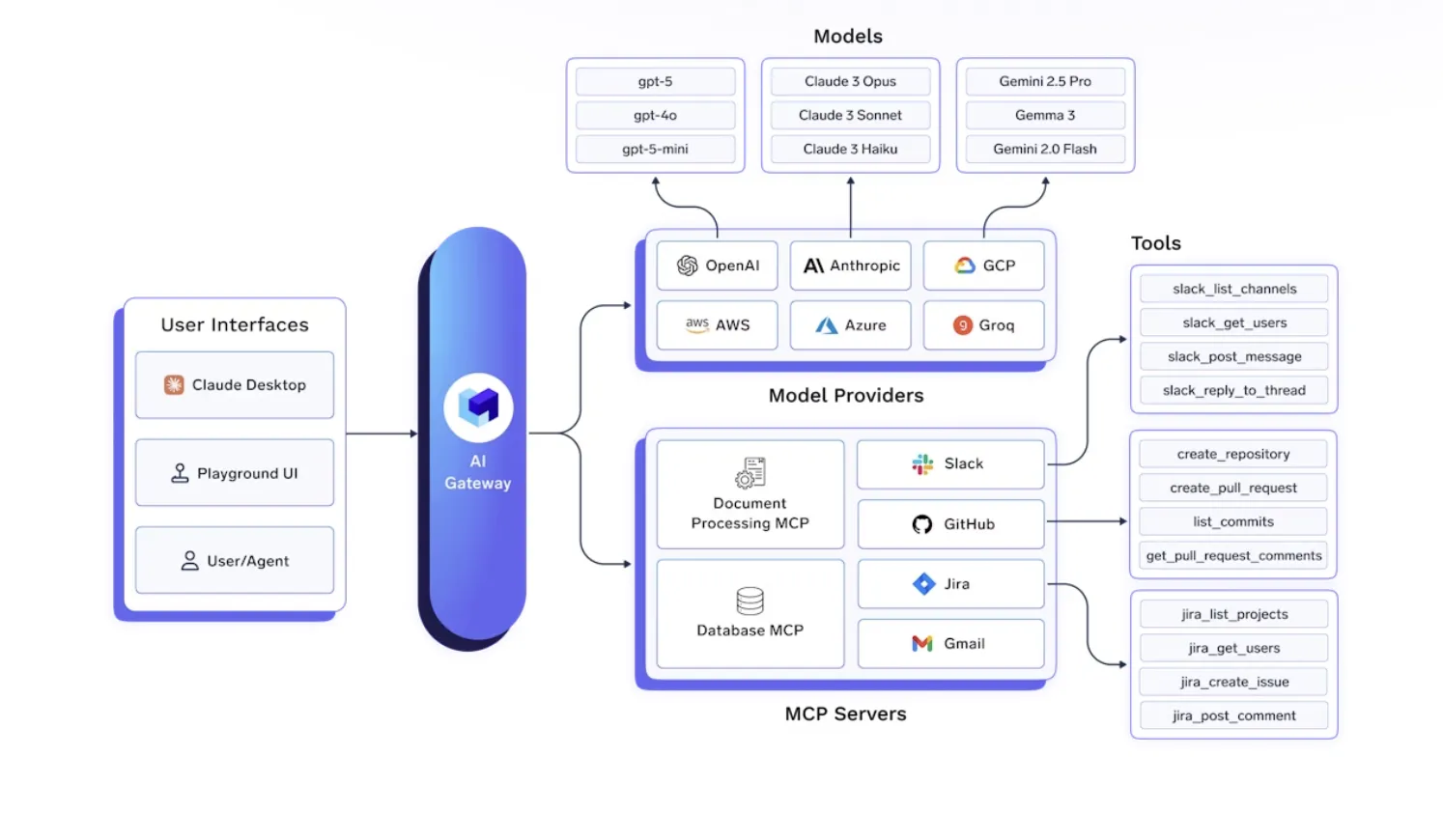

- Passerelle LLM : Une couche de routage centralisée qui normalise les API entre les fournisseurs (OpenAI, Azure, Local LLM). Gère le basculement, les nouvelles tentatives et la mise en cache.

- Tableau de bord FinOps : Fournit une visibilité granulaire sur l'utilisation du GPU et les coûts d'inférence. Les utilisateurs peuvent définir des limites budgétaires par projet, ce qui est essentiel pour Finops pour l'IA.

- Tâches de réglage : Support natif pour l'orchestration des tâches de réglage LoRA/QLoRa sur vos propres données.

Pourquoi TrueFoundry ?

TrueFoundry aborde les aspects économiques unitaires de la mise à l'échelle de l'IA. En déployant des serveurs d'inférence sur des instances réservées ou ponctuelles au sein de votre VPC, les équipes peuvent éliminer les contraintes liées au transfert de données et au temps d'exécution sans serveur. Comme vous êtes propriétaire des poids des modèles et des données, la conformité aux exigences de souveraineté des données (RGPD, HIPAA) est rationalisée.

Tarification

- Plan pour les développeurs : Gratuit pour les développeurs individuels/les petites équipes.

- Forfait Pro : Frais de gestion basés sur l'utilisation (à partir d'environ 0,03 $/heure/processeur virtuel).

- Entreprise : Remises personnalisées sur volume et garanties SLA.

- Remarque : les utilisateurs paient directement leur fournisseur de cloud pour les coûts de calcul bruts.

2. Clé de port

Idéal pour : Les équipes qui souhaitent une expérience « sans serveur » avec une fiabilité et une observabilité accrues.

Clé de port agit comme un intergiciel entre les fournisseurs d'applications et de modèles. Bien qu'il ne gère pas l'infrastructure GPU sous-jacente comme TrueFoundry, il renforce les applications d'IA basées sur des API pour la production grâce à un routage avancé.

Principales caractéristiques

- Passerelle IA : Signature d'API unifiée pour plus de 200 LLM avec équilibrage de charge et solutions de secours.

- Observabilité : Capture les métriques de latence (P99, TTFT) et le coût par demande.

- Gestion rapide : Un CMS contrôlé par version pour les invites.

Avantages et inconvénients

- Avantages : Intégration rapide ; noyau open source disponible.

- Inconvénients : Il s'agit strictement d'une couche intermédiaire : elle n'héberge pas de modèles personnalisés et ne gère pas l'infrastructure GPU.

3. LangChain et LangSmith

Idéal pour : Flux de travail agentiques complexes et logique d'application.

Chaîne Lang est un framework d'orchestration, et Lang Smith est sa plateforme complémentaire pour le traçage. Il s'agit moins d'un concurrent en matière d'hébergement que d'une alternative basée sur la couche logique.

Principales caractéristiques

- Traçage en profondeur : Visualise l'ensemble de la chaîne (Retrieval, LLM, Parser).

- Évaluation : Exécutez des tests de régression sur les invites correspondant à « Golden Datasets ».

Avantages et inconvénients

- Avantages : Indispensable pour le débogage d'agents complexes.

- Inconvénients : Courbe d'apprentissage élevée ; la bibliothèque ajoute une surcharge d'abstraction par rapport aux appels d'API bruts.

4. Indice de lama

Idéal pour : Pipelines RAG (Retrieval-Augmented Generation) avancés.

Indice de lama se concentre spécifiquement sur l'ingestion et la récupération de données. Il s'agit du composant incontournable pour la partie « Contexte » de la pile, offrant une gestion des données plus approfondie que les intégrations vectorielles de base de Vercel.

Principales caractéristiques

- Connecteurs de données : Ingestion provenant de plus de 100 sources (Notion, SQL, Discord).

- Indexation avancée : Supporte les indices hiérarchiques et la recherche hybride.

Avantages et inconvénients

- Avantages : Optimisé pour le traitement des données structurées et non structurées.

- Inconvénients : Il ne s'agit pas d'une plate-forme de service pour les modèles ; nécessite une intégration avec un fournisseur de calcul.

5. Haystack par Deepset

Idéal pour : Pipelines de recherche et d'assurance qualité centrés sur Python.

Contrairement à l'écosystème centré sur JavaScript de Vercel, botte de foin est basé sur Python, ce qui en fait un choix standard pour les équipes de science des données qui créent des pipelines NLP.

Principales caractéristiques

- Canalisations modulaires : Les flux de travail sont définis comme des graphes acycliques orientés (DAG).

- Cloud le plus profond : Plateforme gérée pour le déploiement de ces pipelines.

Avantages et inconvénients

- Avantages : Python natif ; modulaire ; support solide pour les entreprises.

- Inconvénients : Plus grande barrière à l'entrée pour les développeurs frontend habitués à TypeScript.

6. LitellM

Idéal pour : Gestion de serveurs proxy DIY.

LitellM est un serveur proxy open source léger qui normalise les formats d'E/S selon le schéma OpenAI. Il s'agit d'une alternative auto-hébergée au routage du SDK Vercel AI.

Principales caractéristiques

- Interface unifiée : Appelez Bedrock, Azure et HuggingFace à l'aide de charges utiles de chat standard.

- Budgétisation : Définissez des budgets par clé d'API.

Avantages et inconvénients

- Avantages : Faible latence ; aucune dépendance vis-à-vis d'un fournisseur.

- Inconvénients : Autogéré ; vous devez gérer l'hébergement et le dimensionnement du proxy.

7. Poids et biais (W&B)

Idéal pour : Modélisez les paramètres de formation et évaluez rapidement l'ingénierie.

Poids et biais est utilisé lors du développement du modèle ou de la stratégie rapide (LLMops), plutôt que lors du déploiement de l'application finale.

Principales caractéristiques

- Suivi des expériences : Enregistre les hyperparamètres et les courbes de perte pour les affiner.

- Invitations W&B : Analyse les performances rapides.

Avantages et inconvénients

- Avantages : La norme de l'industrie pour les métriques de machine learning.

- Inconvénients : Il ne s'agit pas d'une plateforme d'hébergement : s'intègre à des plateformes telles que TrueFoundry pour le déploiement.

8. Options natives du cloud (AWS Bedrock/Azure OpenAI)

Idéal pour : Des équipes ayant un mandat d'achat unique dans le cloud.

Les principaux fournisseurs de cloud proposent des services gérés permettant de consommer des modèles via des API sans gérer de serveurs, tout en maintenant les données dans les limites du contrat cloud. AWS Bedrock et Azure OpenAI permettre aux utilisateurs de consommer des modèles via une API sans gérer de serveurs, dans les limites de conformité d'un contrat cloud existant.

Principales caractéristiques

- Connectivité privée : Accès via PrivateLink/Private Endpoints.

- Débit provisionné : Capacité de réserve (TPM) pour garantir la latence.

Avantages et inconvénients

- Avantages : Facturation consolidée et normes de conformité élevées.

- Inconvénients : Verrouillage vis-à-vis des fournisseurs ; l'UI/UX est généralement moins intuitive que celle des startups spécialisées.

Résumé : Choisir la bonne architecture

Pour sélectionner l'architecture appropriée pour 2026, associez les principales contraintes de votre équipe aux solutions recommandées ci-dessous.

Conclusion

Vercel est un tremplin efficace pour les fonctionnalités d'IA, mais sa couche d'abstraction peut devenir une contrainte à mesure que les exigences techniques augmentent. 2026 sera définie par la propriété de l'infrastructure. Alors que les fonctionnalités de l'IA passent du statut de « simple d'utilisation » à celui de produits de base, la capacité à contrôler le temps d'exécution des inférences, à gérer directement les coûts du GPU et à sécuriser les données au sein d'une frontière privée est essentielle.

Passerelle IA de TrueFoundry comble le fossé entre l'expérience des développeurs de Vercel et la rigueur opérationnelle requise pour l'IA de production. Il fournit aux équipes d'ingénierie des plateformes les contrôles nécessaires sans sacrifier l'agilité attendue par les développeurs frontend.

Êtes-vous prêt à transférer vos charges de travail d'IA vers un environnement cloud sécurisé et performant ? Réservez une démo dès aujourd'hui pour découvrir comment TrueFoundry vous permet de contrôler totalement votre chaîne de production.

Questions fréquemment posées

Qui sont les concurrents de Vercel ?

Dans le domaine de l'hébergement Web général, les concurrents de Vercel incluent Netlify, AWS Amplify et Cloudflare Pages. Dans le domaine des infrastructures d'IA, les principaux concurrents sont TrueFoundry (pour un contrôle complet de la pile et du backend), AWS Bedrock (pour les modèles gérés) et Portkey (pour les fonctionnalités de passerelle API).

Y a-t-il quelque chose de mieux que Vercel ?

Pour les sites Web simples et les applications B2C, Vercel est un choix judicieux. Cependant, pour les équipes qui créent des produits axés sur l'IA qui nécessitent le déploiement de modèles personnalisés, des ajustements ou une stricte conformité aux VPC, TrueFoundry est souvent l'alternative préférée car elle supprime les coûts liés au modèle sans serveur de Vercel.

Est-ce que Cloudflare est meilleur que Vercel ?

Cloudflare (en particulier Cloudflare Workers AI) offre une latence plus faible et des coûts de calcul compétitifs pour l'inférence de périphérie. Cependant, l'expérience des développeurs de Cloudflare est moins intégrée à des frameworks tels que Next.js qu'à Vercel. Pour une orchestration de l'IA de niveau entreprise qui va au-delà des simples fonctions de périphérie, TrueFoundry propose une suite de gestion plus complète que les deux.

Comment Vercel Alternatives prend-il en charge les applications d'entreprise ?

Au-delà des petits projets pour adopter des applications d'entreprise, il ne suffit pas d'héberger des sites statiques gratuitement. Alors que la plupart des alternatives à Vercel se concentrent sur le frontend, TrueFoundry fournit une plate-forme cloud avec une gestion d'infrastructure d'entreprise. Nous offrons une haute disponibilité et un réseau privé au sein de votre écosystème AWS ou du cloud Google pour une infrastructure évolutive.

Quelles plateformes de déploiement offrent le meilleur support pour les services d'arrière-plan ?

TrueFoundry est le choix idéal pour gérer des services Web complexes et des travailleurs en arrière-plan. Contrairement à d'autres, nos plateformes de déploiement incluent des fonctionnalités exceptionnelles telles que l'automatisation et la prise en charge du backend pour les machines virtuelles. Les utilisateurs peuvent facilement lier leur référentiel GitHub via Git pour déclencher la CI dans des environnements cloud sécurisés conçus pour leurs besoins spécifiques.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)