TrueFoundry déploie et peaufine désormais des LLM open source en quelques clics !

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Nous sommes ravis de vous annoncer que TrueFoundry a développé une solution puissante mais facile à utiliser pour le déploiement et le réglage de grands modèles linguistiques (LLM) via notre Katalog of models. Notre objectif est d'aider les entreprises à héberger elles-mêmes leurs LLM open source sur Kuberenetes, afin de rendre vos coûts d'inférence 10 fois moins chers en un clic. Dans ce blog, nous vous montrons comment déployer un Dolly-V2-3b modéliser et affiner un Pythie - 70 M modèle utilisant TrueFoundry.Les LLM changeraient-ils notre façon de penser les MLOP ?

TrueFoundry Platform a été conçu pour prendre en charge les modèles d'apprentissage automatique et d'apprentissage profond de tous types, des plus simples comme la régression logistique aux modèles de pointe tels que la diffusion stable. On peut se demander pourquoi a-t-il besoin de créer quelque chose de nouveau en matière de grands modèles de langage ?

La taille et la complexité de ces modèles posent des défis importants lorsqu'il s'agit de les déployer dans des applications réelles. Bien que la plateforme TrueFoundry ait déjà pris en charge le déploiement de modèles de toutes tailles à grande échelle, nous avons réalisé que nous pouvions apporter davantage d'optimisations (coût+temps) et d'améliorations de l'expérience utilisateur pour ces modèles.

Les grands modèles linguistiques (LLM) sont là pour durer.

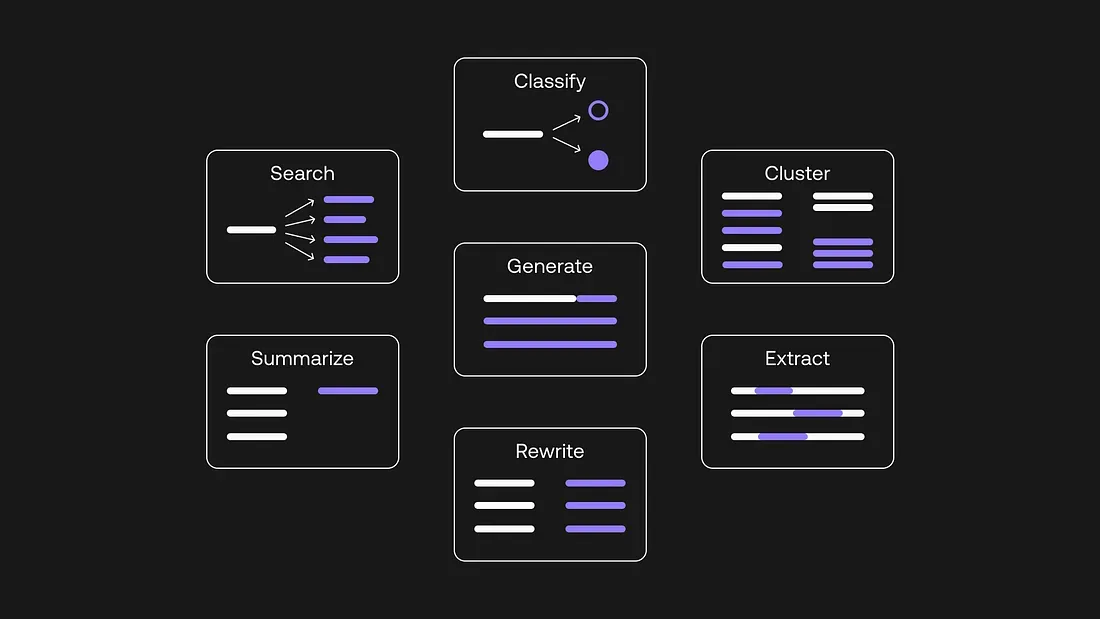

Les grands modèles de langage (LLM), tels que ChatGPT, ont indéniablement suscité un engouement considérable dans le domaine de l'intelligence artificielle.

Mais après avoir discuté avec plus de 50 entreprises qui commencent déjà à le mettre en production, la valeur que cela crée déjà est immense. Nous pensons que l'utilisation des LLM ne fera que croître à mesure que les gens découvriront de nouveaux cas d'utilisation chaque jour.

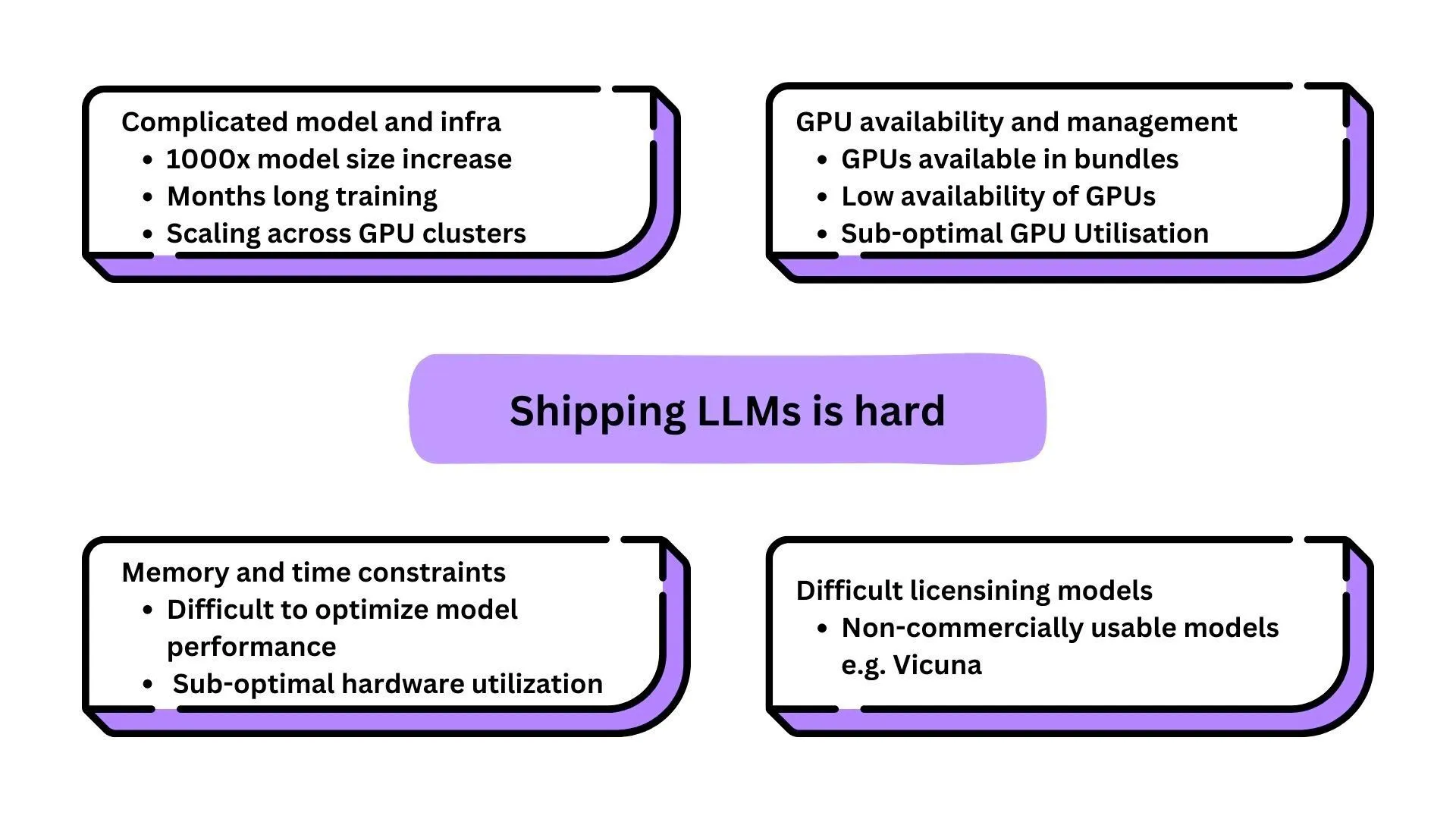

Mais il est difficile d'expédier des LLM à la production.

Il est facile de créer un cas d'utilisation de preuve de concept avec de grands modèles de langage et des API OpenAI, mais lorsque vous commencez à penser à production 🚀, de nombreuses autres considérations entrent en jeu.

Pour la plupart des entreprises, développer les capacités d'ingénierie nécessaires pour gérer l'infrastructure graphique complexe afin de servir les LLM de manière fiable est difficile et prend du temps. De plus, la plupart des entreprises souhaitent des modèles spécifiques qui fonctionnent le mieux dans leur cas d'utilisation, pour lesquels elles doivent affiner ces modèles. Cela peut être à la fois techniquement difficile et coûteux.

Expédiez rapidement des LLM open source !

Notre position quant à l'avenir des LLM est que les modèles open source seront la voie à suivre. En savoir plus sur notre point de vue sur le sujet ici. Nous avons décidé de tirer parti de cette communauté d'innovateurs qui innove rapidement et d'aider les entreprises à utiliser pleinement la valeur de ces LLM open source dans leurs organisations.

TrueFoundry souhaite que ses partenaires puissent tirer parti de tous les avantages que les LLM Open-Source, adaptés à leur cas d'utilisation spécifique, peuvent apporter à leurs organisations :

- Rentable: 5 à 10 fois moins cher que l'utilisation des API OpenAI

- Privacy complete of data: Sur votre propre cluster Kubernetes sur site ou dans le cloud

- Complete control: pour affiner, annuler, etc.

Cependant, gérer et déployer des modèles open source sur votre propre infrastructure n'est pas une mince affaire. Alors que LLM development on site offre un contrôle des données inégalé, une préparation à la conformité et une rentabilité à long terme, elle nécessite une expertise approfondie en matière d'orchestration des GPU, de gestion de Kubernetes et d'optimisation des modèles.

Mais imaginez si c'était aussi simple que de connecter vos données en quelques clics ?

Nous comprenons les défis auxquels les entreprises sont confrontées lors de la transition de la validation de concept LLM vers la production. Notre objectif est de créer la couche qui facilitera ce processus pour nos partenaires. Voici comment nous procédons :

Présentation du catalogue de modèles

True Foundry Katalog of models est un référentiel de tous les modèles de langage open source (LLM) populaires qui peuvent être déployés en un seul clic. L'utilisateur peut également affiner le modèle directement à partir du catalogue de modèles.

Le catalogue prend déjà en charge la plupart des modèles populaires, et nous en ajoutons d'autres chaque jour. Voici certains des modèles les plus populaires que vous pouvez déjà déployer sur votre propre cloud :

- Pythie - 70 M

- Vicuna 7B 1.1 Ensemble HF Vicuna 13 B 1.1 HF

- Dolly V2B et Dolby V2 12 V

- Flan T5 XL

- Alpaga 7B et Alpaga 13B

Et bien d'autres encore...

La magie que nous faisons en plus des LLM Open Source

Nous sommes obsédés par le fait que les entreprises puissent expédier dès le premier jour. Pour rendre cela possible, voici les principes sur lesquels nous développons nos capacités de LLM :

- Optimisation des coûts : Optimisez l'utilisation des ressources pour réduire les dépenses d'infrastructure sans sacrifier les performances.

- Simplicité de déploiement : Déploiement LLM rationalisé avec conteneurisation et Kubernetes pour une évolutivité sans faille et une haute disponibilité.

- Gestion de l'infrastructure : Gère des tâches complexes telles que l'allocation des GPU et la gestion de Kubernetes, ce qui permet aux entreprises de se concentrer sur l'optimisation du LLM.

- Abstractions prédéfinies : Fournit des solutions prêtes à l'emploi pour intégrer facilement les LLM dans les flux de travail existants, éliminant ainsi le besoin de développement personnalisé.

- Support pour la mise à l'échelle des modèles : Permet la mise à l'échelle de LLM de toutes tailles et de tous types pour des performances et une efficacité optimales.

ℹ️

Pour une présentation détaillée des flux de formation et de réglage de l'interface utilisateur, reportez-vous à this youtube video

Tutoriel : Déployez des LLM en trois clics.

Déployer votre LLM est aussi simple que de cliquer trois fois !

- Select the model souhaité : Choisissez parmi une variété de modèles de langage open source disponibles sur TrueFoundry. Nous vous proposons les modèles les mieux adaptés à votre cas d'utilisation. (L'analyse comparative des tâches sera bientôt disponible !) Sélectionnez le modèle qui convient le mieux à votre problème ou à votre cas d'utilisation spécifique et cliquez sur le bouton de déploiement.

- Choisissez les ressources appropriées : Confirmez les ressources que vous souhaitez allouer au modèle. TrueFoundry propose une sélection d'options matérielles optimisées pour chaque modèle afin de simplifier le processus de prise de décision qui fonctionne bien avec le modèle que vous avez sélectionné.

- Déployez le modèle : Une fois que vous avez sélectionné le modèle et l'environnement de déploiement, cliquez simplement sur le bouton « Soumettre ». TrueFoundry prend en charge les tâches en coulisse liées à la configuration de l'infrastructure, à la configuration du modèle et à sa préparation pour l'inférence.

🚀

Votre modèle est désormais déployé !

Démarrage de l'inférence avec le point de terminaison de l'API du modèle. TrueFoundry vous fournit Interface OpenAPI for tester your model and the example de code for call the model in your applications.

Tutoriel : affiner les grands modèles de langage avec TrueFoundry

La plupart des entreprises souhaiteraient utiliser des modèles adaptés à leur cas d'utilisation spécifique. Pour affiner un modèle avec TrueFoundry :

- Select the model souhaité : Choisissez le modèle que vous souhaitez utiliser dans le catalogue. Une fois que vous avez sélectionné le modèle, cliquez sur le bouton « Affiner » pour lancer le processus.

- Choisissez les ressources appropriées : Nous préconfigurons les ressources suggérées pour la tâche de réglage. Les utilisateurs peuvent le modifier s'ils prévoient une charge plus élevée en raison de modifications des configurations.

- Déployez le Finetuning Job : Après avoir sélectionné le modèle et les ressources souhaitées, cliquez sur le bouton « Soumettre ». TrueFoundry s'occupe des tâches en coulisse liées à la mise en place de l'infrastructure et à la configuration de la tâche de formation. La tâche de réglage final commence à s'exécuter, en utilisant les ressources matérielles spécifiées.

🚀

Le modèle a commencé à être peaufiné !

Tu peux surveiller la mise au point au fur et à mesure de sa progression. Dans l'onglet Exécutions des tâches, vous pouvez consulter toutes les informations pertinentes associées à la tâche de formation, telles que les mesures de perte, les courbes d'entraînement et les résultats d'évaluation. Cela vous permet de suivre le processus de mise au point et de prendre des décisions éclairées en fonction des performances de la tâche.

Quelle est la prochaine étape ?

Ce n'est que le début de notre aventure avec les grands modèles linguistiques (LLM) et l'IA générative. Nous prévoyons d'en construire beaucoup plus dans les jours à venir et nous vous tiendrons au courant !

Discutez avec nous

Nous sommes encore en train d'en apprendre davantage sur ce sujet, comme tout le monde. Si vous essayez d'utiliser de grands modèles linguistiques dans votre organisation, nous serions ravis de discuter et d'échanger des notes.

Passez un ☕️ avec nous

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)