Passerelles pour les meilleurs agents en 2025

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Presentation

Entre 2023 et 2024, le principal défi en matière d'infrastructure d'IA a consisté à optimiser rapidement et à accéder efficacement aux grands modèles de langage (LLM). La solution ? Passerelles LLM : intergiciel léger qui a unifié les appels d'API, résumé les différences entre les fournisseurs et ajouté des fonctionnalités de base telles que la mise en cache, la journalisation et le suivi des jetons.

Mais 2025 a complètement changé la donne. Nous sommes allés au-delà des chatbots et des complétions ponctuelles. Aujourd'hui, les organisations construisent autonomous agents - des systèmes qui planifient, raisonnent et agissent à travers des outils, des API et des bases de données. Ces agents agissent en tant que décideurs, et pas seulement en tant que générateurs de texte. Ils parcourent des sites Web, exécutent des flux de travail en plusieurs étapes, font appel à des services externes et mettent à jour l'état critique de l'entreprise, le tout sans supervision humaine constante.

Ce nouveau niveau d'autonomie introduit de nouveaux risques et exigences : des agents qui réessayent en cas d'échec, hallucinent des commandes ou déclenchent des actions à enjeux élevés, telles que des remboursements financiers ou des mises à jour de serveurs. Une boucle de réponse rapide de base ne peut tout simplement pas gérer cette complexité.

Ce changement a donné naissance à une nouvelle infrastructure : le Passerelle pour agents et il est en train de devenir rapidement le point de contrôle le plus critique de la pile d'Ia.

Qu'est-ce qu'une passerelle d'agents ?

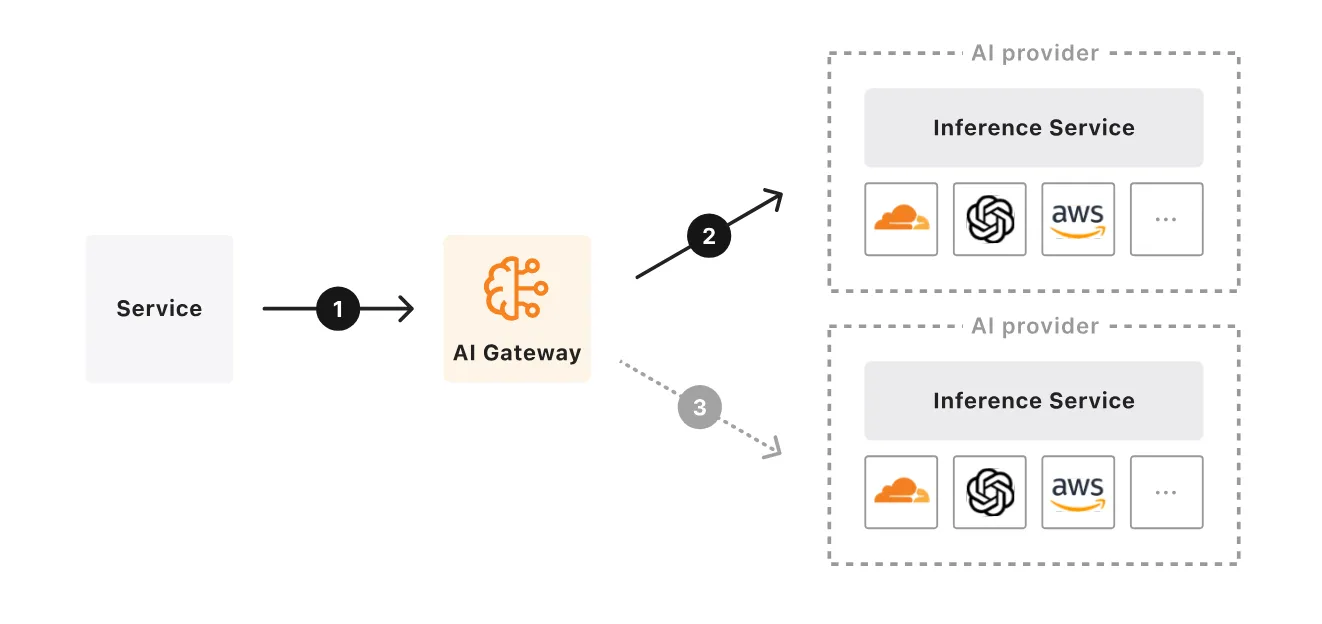

Pour comprendre l'Agent Gateway, nous devons d'abord distinguer de l'infrastructure qui l'a précédé.

Un Passerelle pour agents est une couche de gouvernance et d'orchestration située entre les agents alimentés par LLM et les systèmes externes avec lesquels ils interagissent, tels que les API, les bases de données, les outils cloud et les backends propriétaires. Il agit comme firewall d'exécution pour un comportement autonome de l'IA.

Alors qu'une passerelle LLM achemine les invitations et les réponses (sans état), une passerelle d'agent gère les tâches de longue durée, dotées d'un état et comportant plusieurs étapes. Il comprend le cycle de vie du plan d'un agent, de l'intention initiale à la sélection des outils, à l'exécution, à la validation, à la nouvelle tentative et au résultat final, et applique les politiques tout au long de ce flux.

Les principales responsabilités d'un agent Gateway sont les suivantes :

- Governance of tools: vérifier quels outils un agent peut appeler, dans quelles conditions et avec quels paramètres.

- State management: Mémoire persistante des agents, résultats des outils et contexte au fil du temps, permettant des flux de travail qui s'étendent sur des heures ou des jours.

- Security and Policy Application: appliquer des autorisations précises au niveau de l'action (par exemple, limites de remboursement, niveaux d'accès), prévenir les comportements risqués ou non autorisés.

- Observability and auditability: enregistrement de chaque étape, saisie et décision à des fins de débogage, de conformité et d'amélioration.

- Resilience and reprise: gestion des nouvelles tentatives, des solutions de secours et des sorties sécurisées lorsque les agents échouent ou sortent du script.

En substance, l'agent Gateway est le prefrontal cortex de votre architecture d'IA : filtrage et contrôle de ce que le moteur de raisonnement (le LLM) est autorisé à exécuter et de la manière dont il interagit avec le monde réel.

Principales caractéristiques à prendre en compte lors du choix d'une passerelle pour agents

Il est essentiel de sélectionner la bonne passerelle d'agent pour faire évoluer les systèmes d'IA de manière sécurisée, efficace et avec un minimum de friction. La passerelle fait office d'intermédiaire entre vos agents et le monde extérieur, en orchestrant les demandes, en appliquant les politiques, en enregistrant les activités et en gérant les accès. Voici les fonctionnalités les plus importantes à prendre en compte lors de l'évaluation d'une passerelle d'agents :

1. Multimodel routing and suppliers abstraction

Votre passerelle doit permettre un routage fluide entre plusieurs fournisseurs LLM (OpenAI, Anthropic, Mistral, etc.) et des modèles internes. Une passerelle puissante extrait les API spécifiques aux fournisseurs et offre une interface unifiée pour tous les appels de modèles, ce qui devient particulièrement important lorsque les équipes évaluent OpenRouter contre AI Gateway des approches pour une flexibilité et une gouvernance à long terme.

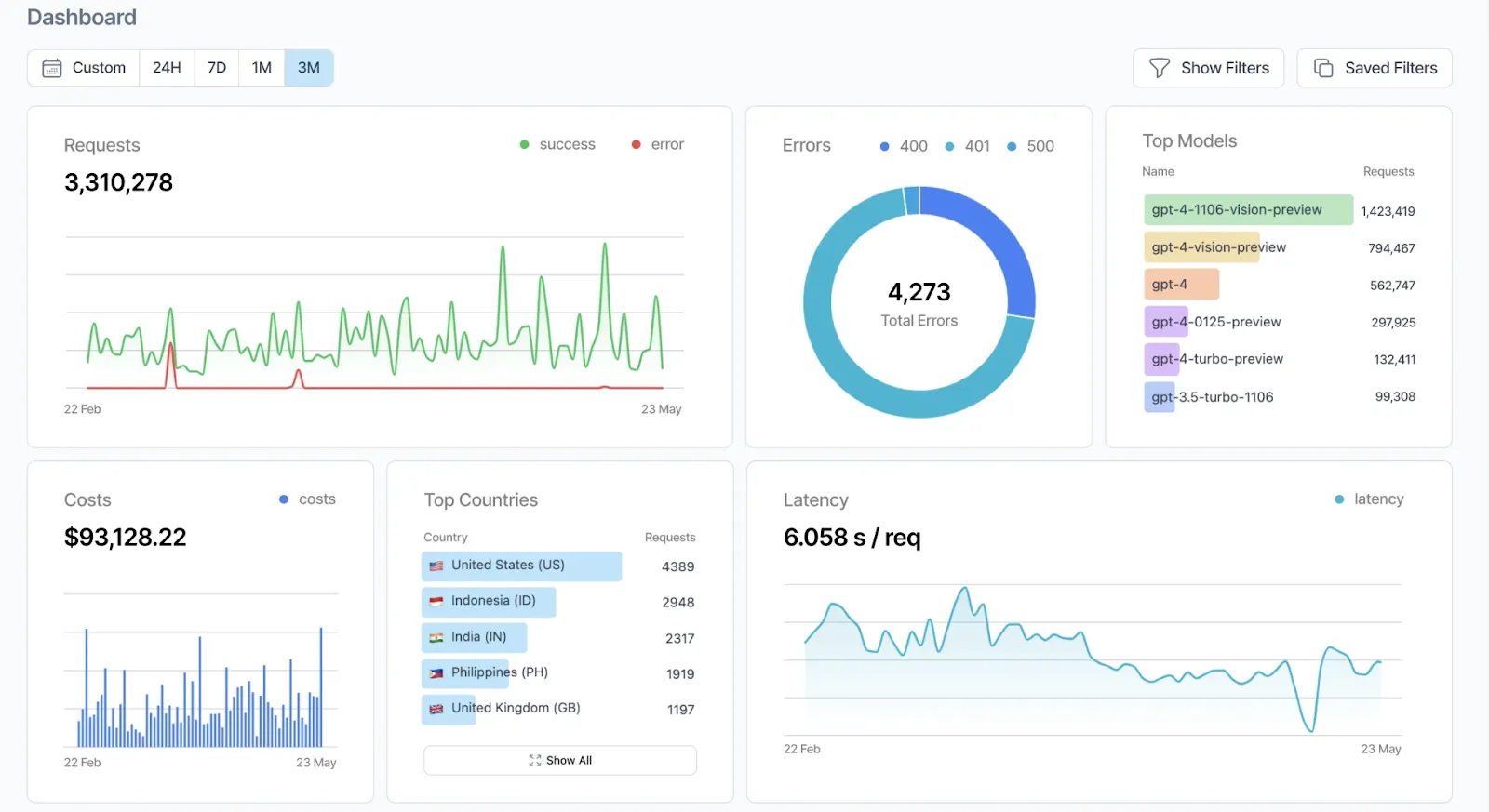

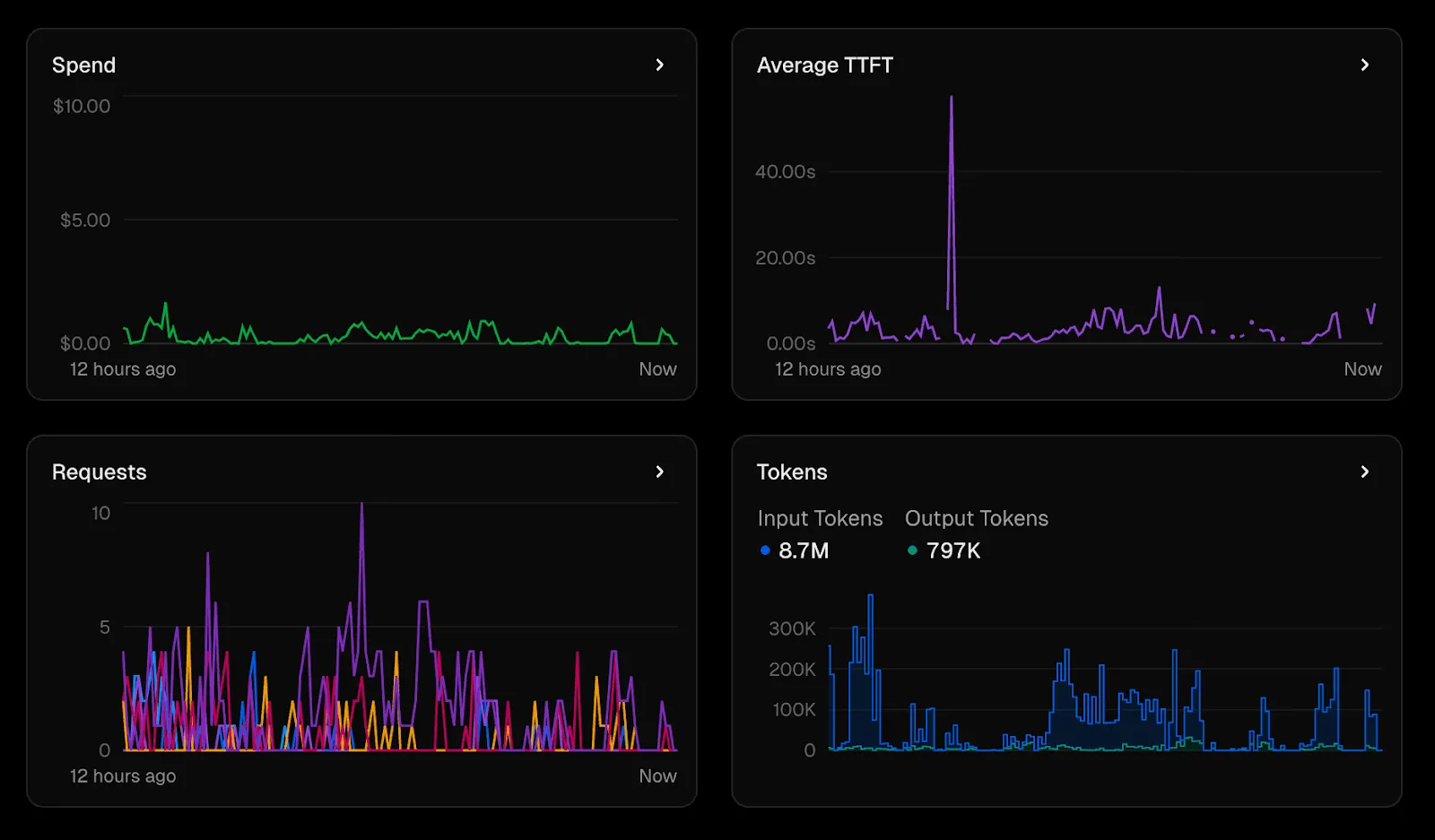

2. Observabilité au niveau des jetons et suivi des coûts

Les charges de travail d'Ia sont facturées par jeton. Une bonne passerelle doit offrir une visibilité précise de l'utilisation des jetons d'entrée/sortie par appel, utilisateur, modèle ou équipe. Cela permet une attribution précise des coûts et permet d'éviter les factures surprises.

3. Programmable Garde-corps et politiques

La passerelle doit vous permettre d'appliquer des mesures de protection telles que des limites de débit, des filtres de contenu, des restrictions d'accès et des validations d'entrée/sortie. Ces politiques programmables sont essentielles pour maintenir des interactions d'IA sûres, conformes et contrôlées.

4. Contrôles d'authentification et d'autorisation

Une gestion robuste des identités (via des jetons d'API, OAuth, RBAC) n'est pas négociable. La passerelle doit vérifier qui appelle le modèle et ce qu'il est autorisé à faire, en particulier dans les configurations multi-locataires ou d'entreprise.

5. Journalisation et audit centralisés

Chaque action d'un agent, qu'il s'agit de l'appel d'un outil ou d'une requête de modèle, doit être enregistrée de manière structurée et consultable. Cela permet le débogage, la surveillance et l'analyse post-mortem, et est souvent nécessaire pour les examens de conformité ou de gouvernance.

6. Optimisations de la mise en cache et de l'efficacité

Recherchez des fonctionnalités telles que la mise en cache sémantique, l'inférence par lots ou le modèle de repli pour réduire les requêtes dupliquées et optimiser les performances. Cela permet d'équilibrer la latence, les coûts et la charge entre les systèmes.

7. Deploiement Flexibilité (auto-hébergé, cloud, hybride)

Les entreprises ont souvent besoin de contrôler où et comment fonctionne la passerelle : sur site, dans le cloud ou hybride. Choisissez une passerelle qui répond à vos besoins en matière d'infrastructure et de résidence des données sans dépendre d'un fournisseur.

8. Experience and extensibilité for the Deelvers

La passerelle doit proposer des SDK, des tableaux de bord d'observabilité, des API d'administration et une expérience d'intégration fluide pour les développeurs. La prise en charge des plugins, des webhooks ou l'intégration avec des frameworks d'orchestration est un atout majeur.

Principales plateformes de passerelle pour agents (2025)

Le marché des passerelles pour agents a évolué rapidement. Au début de 2024, le paysage était dominé par de simples outils proxy qui se contentaient de transmettre des demandes d'API. D'ici 2025, l'écosystème sera divisé en catégories spécialisées : les plans de contrôle d'entreprise qui régissent les outils internes, les utilitaires de développement qui offrent une flexibilité brute aux ingénieurs et les écosystèmes d'infrastructure qui intègrent les fonctionnalités des agents directement au réseau périphérique.

Les cinq plateformes suivantes représentent les meilleures solutions de leur catégorie pour différents besoins architecturaux. Que vous soyez un développeur indépendant qui crée un agent client ou un architecte d'entreprise gérant des milliers de flux de travail autonomes internes, l'une de ces passerelles s'adaptera à votre environnement.

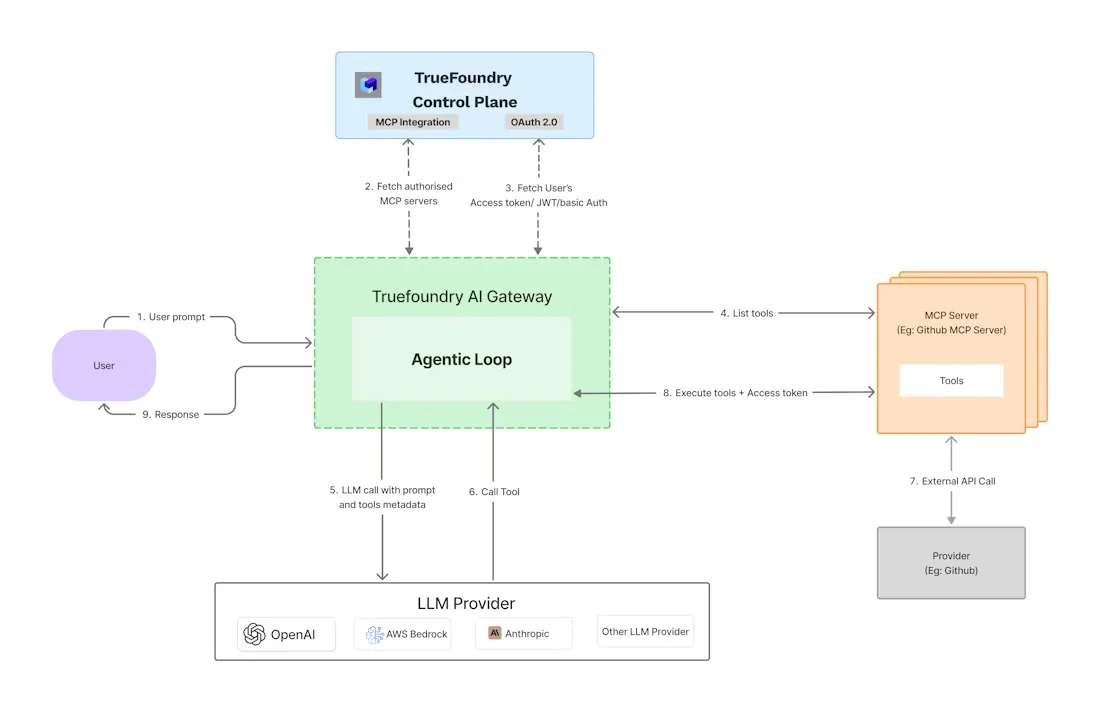

1. True Foundry

Truefoundry s'est positionné comme le champion des poids lourds pour gouvernance de l'IA d'entreprise. Pour résoudre le « problème d'intégration M×N », selon lequel chaque nouvel agent nécessite des connexions individuelles à des outils, des bases de données et des API, Truefoundry fonctionne comme un contrôleur de trafic centralisé pour les flux de travail des agences. Il est spécialement conçu pour éliminer les « angles morts en matière de sécurité » qui surviennent lorsque les développeurs diffusent des clés d'API et des informations d'identification sur des bases de code d'agents disparates.

Key différenciator : Le registre MCP centralisé Truefoundry s'attaque au chaos des outils non gérés en proposant un système centralisé de registre et de découverte. Au lieu de coder en dur des intégrations d'outils, les administrateurs définissent un catalogue de serveurs et d'outils MCP approuvés en un seul endroit.

Les agents pointent simplement vers la passerelle pour découvrir et utiliser ces outils approuvés. Cela crée un « point de terminaison MCP unique » architecture, réduisant considérablement les frais de configuration et empêchant l'apparition de « serveurs MCP fantômes » au sein de l'organisation.

Caractéristiques de l'agence :

- AuthN et AuthZ unifiés : La passerelle gère l'authentification dans le monde entier. Il prend en charge les normes modernes telles que OAuth2 et OIDC, garantissant que les agents ne peuvent accéder qu'aux outils spécifiques pour lesquels ils sont autorisés. Cela permet un contrôle d'accès granulaire basé sur les rôles (RBAC), dans lequel un « agent financier » peut avoir un accès en écriture à une base de données alors qu'un « agent de support » dispose d'autorisations en lecture seule.

- Translation and composition of protocol : Reconnaissant que les outils d'IA parlent différentes langues, la passerelle de Truefoundry peut traduire l'appel JSON-RPC d'un agent (courant dans MCP) en appel d'API REST ou en appel Lambda. Il peut même regrouper plusieurs API en un seul point de terminaison orienté agent.

- Resilience et basculement : Pour garantir une exécution robuste, la plateforme inclut des nouvelles tentatives intégrées et une logique de repli. En cas de défaillance d'un terminal de modèle ou d'une réplique d'outil spécifique, la passerelle redirige automatiquement le trafic vers une sauvegarde, empêchant ainsi les flux de travail fragiles des agents de s'interrompre pendant les interruptions de production.

- Agent Playground : Au-delà du simple routage, Truefoundry propose un terrain de jeu interactif où les développeurs peuvent prototyper des invitations et orchestrer plusieurs outils via la passerelle avant de les déployer en production.

Idéal pour : Les entreprises et les secteurs réglementés (finance, santé) qui nécessitent une gouvernance stricte (conformité SOC 2, HIPAA) et doivent gérer des systèmes complexes multi-agents sans compromettre la sécurité ou l'observabilité.

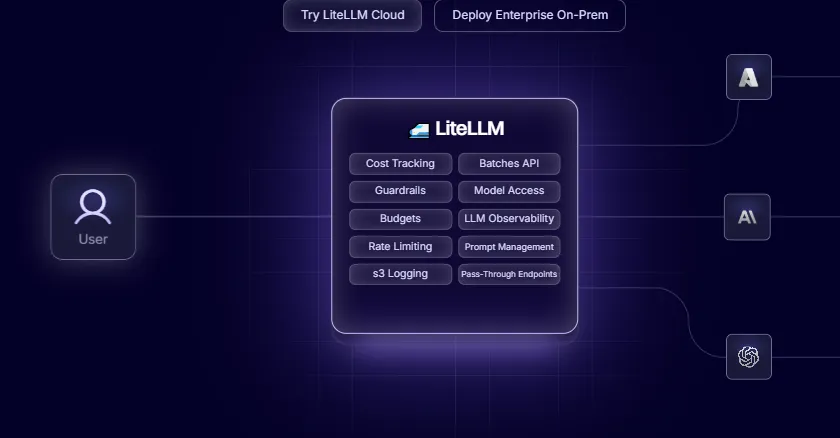

2. LitellM

LitellM est le couteau suisse du monde de l'ingénierie de l'IA. D'abord une bibliothèque Python destinée à normaliser les appels d'API, elle est devenue un serveur proxy Gateway très performant. Sa philosophie est « la flexibilité avant tout ».

Key différenciator : Les agents de la couche de normalisation sont notoirement fragiles lorsque vous changez de modèle. Une invitation qui fonctionne pour GPT-4 peut interrompre Claude 3.5 en raison de différences dans la façon dont les appels d'outils sont formatés. LitellM résout ce problème en normalisant les entrées et les sorties dans un format OpenAI standard. Cela vous permet d'écrire la logique d'appel d'outils de votre agent une fois que et échangez le cerveau sous-jacent (modèle) sans réécrire votre code.

Caractéristiques de l'agence :

- Clés virtuelles : Vous pouvez générer des clés d'API virtuelles pour chaque agent. Cela vous permet de suivre les dépenses d'un « agent commercial » par rapport à un « agent de support » séparément, même s'ils utilisent le même compte Anthropic sous-jacent.

- Fiability : Logique de relance et de réponse exceptionnelle. Si un agent échoue à une étape parce qu'Azure OpenAI connaît une latence élevée, LiteLM peut facilement acheminer cette étape de réflexion spécifique vers AWS Bedrock sans que l'agent ne se rende compte que le changement s'est produit.

- Auto-hébergé : Comme il est open source, vous pouvez l'exécuter dans votre propre VPC, en veillant à ce que les mémoires des agents et les données des outils ne quittent jamais votre infrastructure.

Idéal pour : Les équipes d'ingénierie qui souhaitent un contrôle total, sont à l'aise avec l'auto-hébergement et accordent la priorité à l'évitement de la dépendance vis-à-vis des fournisseurs.

3. Hélicone

Helicone est techniquement une plateforme d'observabilité qui fait office de passerelle. Dans le monde des agents, où les systèmes sont des « boîtes noires » non déterministes, l'observabilité n'est pas un luxe ; c'est le seul moyen de déboguer. Cela en fait un choix judicieux parmi les équipes qui envisagent Helicone alternatives.

Key différenciator : Session Replay & Experimentation Helicone excelle dans la visualisation de la « chaîne de pensée ». Lorsqu'un agent n'arrive pas à terminer une tâche, Helicone vous permet d'ouvrir cette session spécifique et de voir exactement où la logique est défaillante. Est-ce que c'était une mauvaise invitation ? L'outil a-t-il renvoyé une erreur 500 ? Le modèle a-t-il ignoré la sortie de l'outil ? Sa fonction Session Replay vous permet de rejouer la séquence exacte des événements qui ont conduit à une panne, ce qui vous permet de tester les correctifs par rapport à des données réelles sans affecter les utilisateurs en direct.

Caractéristiques de l'agence :

- Fast Versioning : Les agents sont définis par les instructions de leur système. Helicone suit les versions de ces instructions ainsi que les indicateurs de performance, ce qui vous permet de corréler une baisse du taux de réussite à une modification spécifique des instructions de l'agent.

- Mises en cache : Ils offrent une mise en cache très granulaire. Vous pouvez configurer des règles de cache sémantique de telle sorte que si deux utilisateurs demandent à différents agents de « résumer le rapport du troisième trimestre », le second agent obtienne le résultat instantanément à partir du cache, évitant ainsi les coûteuses fonctionnalités de traitement des documents.

- Users Tracking : Vous pouvez baliser les demandes avec des ID utilisateur ou des ID de session, ce qui vous permet de reconstituer l'intégralité de la « mémoire » de l'interaction d'un utilisateur avec un agent au fil du temps. Cela est crucial pour le débogage de sessions d'agent de longue durée où le contexte peut être perdu après plusieurs tournées.

Idéal pour : Développeurs et chefs de produit qui ont besoin de déboguer le comportement des agents et de répéter des itérations sur les « invites system » pour améliorer les taux de réussite.

4. Vercel

Vercel s'est lancé de manière agressive dans le domaine de l'IA grâce à son SDK AI et à sa passerelle IA intégrée. Leur approche est unique car elle met fortement l'accent sur côté client et bord experience, ce qui en fait la référence pour les applications d'agent destinées aux utilisateurs qui nécessitent une faible latence et une interactivité riche.

Key différenciator : Le protocole de flux de données et l'interface utilisateur générative. Contrairement aux passerelles gourmandes en backend qui renvoient du JSON brut, l'architecture de Vercel est conçue pour le frontend. Leur protocole de flux de données permet aux agents de diffuser du texte, des appels d'outils et même des mises à jour de l'interface utilisateur via une seule connexion. Cela active l'interface utilisateur générative, dans laquelle un agent ne se contente pas de vous envoyer la météo par SMS, mais diffuse un composant React entièrement interactif (par exemple, un widget météo) directement sur l'écran de l'utilisateur. Cela permet de résoudre le « latence perception » problème, maintenir l'engagement des utilisateurs pendant que l'agent réfléchit.

Caractéristiques de l'agence :

- Architecture axée sur l'agent (AI SDK 6) : La dernière mise à jour du SDK de Vercel a introduit des primitives spécifiques pour les agents, notamment Agent Toolloop pour un raisonnement automatique en plusieurs étapes. Il normalise la façon dont les agents découvrent et exécutent les outils, en supprimant le code standard généralement nécessaire pour relier les LLM aux API.

- Homologations Homme-in-the-Loop : Fonctionnalité essentielle pour la sécurité, Vercel permet aux développeurs de contrôler les exécutions d'outils spécifiques (par exemple, « Supprimer la base de données » ou « Envoyer un e-mail ») après une étape d'approbation humaine. L'agent interrompt son flux d'exécution jusqu'à ce qu'un utilisateur confirme l'action via l'interface utilisateur, alliant autonomie et supervision nécessaires.

- Edge Cache Update : Tirant parti de son réseau périphérique mondial, Vercel met en cache les requêtes courantes des agents à proximité de l'utilisateur. Si plusieurs utilisateurs demandent à un agent la même analyse de données, le résultat est diffusé instantanément depuis la périphérie, évitant ainsi les coûts élevés d'inférence des modèles.

- Workflow development kit : Pour les tâches de longue durée des agents qui peuvent prendre des minutes ou des heures (par exemple, « Faites des recherches sur cette entreprise »), Vercel fournit un kit de flux de travail. Cela garantit la durabilité : si un agent tombe en panne ou si une fonction expire, le système réessaie automatiquement à partir de la dernière étape réussie au lieu de redémarrer l'ensemble du processus.

Idéal pour : Développeurs complets et startups qui créent des applications d'IA destinées aux consommateurs (SaaS, agents B2C) qui souhaitent une solution fluide « Du code à la production » flux de travail sans gestion d'infrastructure.

5. Cloudfare

Cloudflare a discrètement créé l'un des écosystèmes les plus puissants pour les agents, en tirant parti de son réseau mondial. Ils constituent un choix remarquable pour 2025 car ils abordent le problème le plus difficile de l'ingénierie des agents : l'État.

Key différenciator : Durable Objects & Remote MCP Cloudflare utilise une technologie appelée Durable Objects pour fournir un « état » distinct à chaque agent. Cela signifie que votre agent n'est pas simplement un script exécuté dans le cloud ; c'est une entité persistante qui « vit » sur le réseau, mémorisant instantanément le contexte de l'utilisateur sans avoir à interroger une base de données centralisée lente.

Caractéristiques de l'agence :

- Serveurs MCP distants : Cloudflare vous permet de déployer des serveurs MCP (outils) directement sur leur plateforme Workers. La passerelle gère ensuite la connexion sécurisée entre votre LLM et ces outils distants, en gérant automatiquement l'authentification (OAuth).

- Les agents du SDK : Ils fournissent un SDK spécialisé conçu pour créer des agents « dynamiques ». Ce SDK gère la complexité de la sauvegarde de l'historique des conversations et de la gestion des tâches de longue durée (par exemple, un agent qui doit attendre 2 heures pour qu'un fichier soit traité).

- Echelle mondiale : Comme il fonctionne sur le réseau de Cloudflare, votre Agent Gateway est présent dans plus de 300 villes du monde entier. Un agent interagissant avec un utilisateur à Tokyo fonctionne à Tokyo, minimisant ainsi la latence de chaque étape de réflexion.

Idéal pour : les développeurs créent des agents dynamiques et performants qui doivent s'adapter à des millions d'utilisateurs sans avoir à gérer une infrastructure de base de données complexe pour la « mémoire ».

Conclusion

Les agents d'IA devenant la couche d'exécution des flux de travail des entreprises, l'infrastructure qui les soutient doit évoluer au-delà du simple routage rapide. L'ère des passerelles LLM cède la place aux passerelles d'agent, des systèmes conçus non seulement pour servir des modèles, mais aussi pour orchestrer la prise de décision, l'utilisation des outils et sécuriser les opérations en plusieurs étapes dans un écosystème d'IA en pleine croissance.

Choisir la bonne passerelle d'agent n'est plus une question de préférence ; il s'agit d'une décision stratégique qui a un impact sur les coûts, la sécurité, la gouvernance et la rapidité. Bien que les outils open source tels que LiteLM soient adaptés à l'expérimentation locale et que les plateformes telles que Vercel optimisent la latence et la simplicité, ils ne parviennent pas à gérer les complexités professionnelles des écosystèmes d'agents à grande échelle.

True Foundry offre la réponse la plus complète à ce défi. Grâce à son architecture de passerelle unifiée, à son registre d'outils régi (via MCP), à ses contrôles d'accès granulaires et à son observabilité prête à la production, il permet aux équipes de passer en toute sécurité des agents prototypes à l'automatisation de l'entreprise. Il ne s'agit pas seulement de faire fonctionner l'IA, il s'agit de rendre l'IA gouvernable, vérifiable et opérationnelle.

Questions fréquemment posées

Quelles sont les meilleures passerelles pour les agents ?

Les principales passerelles d'agents sont TrueFoundry pour la gouvernance d'entreprise et LitellM pour la flexibilité des développeurs. D'autres passerelles d'agents, comme Helicone, mettent l'accent sur l'observabilité, tandis que Vercel et Cloudflare donnent la priorité aux performances de pointe. Ces systèmes fournissent l'infrastructure essentielle nécessaire pour gérer, sécuriser et faire évoluer efficacement les flux de travail d'IA autonomes dans les environnements de production.

Comment les passerelles des meilleurs agents assurent-elles la sécurité et le contrôle d'accès ?

Les passerelles d'agent appliquent des autorisations précises grâce au contrôle d'accès basé sur les rôles (RBAC) et à des garde-fous programmables. Ils empêchent l'utilisation non autorisée des outils en vérifiant si un agent a le droit d'exécuter des actions spécifiques. En centralisant la gouvernance, les passerelles des meilleurs agents éliminent les angles morts en matière de sécurité et garantissent la conformité aux normes de sécurité de l'entreprise.

Comment les passerelles des meilleurs agents gèrent-elles l'authentification des agents IA ?

Les passerelles d'agents de pointe centralisent la gestion des identités en prenant en charge les normes du secteur telles que OAuth2 et OIDC pour toutes les interactions entre les modèles et les outils. Ces passerelles gèrent la rotation automatique des secrets et fournissent des clés virtuelles pour suivre les dépenses de chaque agent, garantissant ainsi que chaque action autonome est entièrement authentifiée, traçable et régie par une politique.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)