Les 6 meilleures alternatives à AWS SageMaker en 2026

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Amazon SageMaker est depuis longtemps une plateforme incontournable lorsqu'il s'agit de créer, de former et de déployer des modèles d'apprentissage automatique à grande échelle. Mais en 2026, le paysage MLOps a évolué et, soyons honnêtes, SageMaker n'est pas toujours la solution idéale pour chaque équipe ou chaque cas d'utilisation. C'est peut-être le coût, la courbe d'apprentissage ou peut-être souhaitez-vous simplement quelque chose de plus flexible. Quelle que soit la raison, l'exploration de solutions de rechange peut ouvrir de nouvelles possibilités. Donc, si vous vous demandez quels sont les autres outils disponibles qui peuvent rivaliser avec SageMaker, voire le surpasser, vous êtes au bon endroit. Passons en revue vos meilleures options.

Qu'est-ce que SageMaker ?

Amazon SageMaker est un service entièrement géré d'AWS qui aide les développeurs et les data scientists à créer, former et déployer des modèles d'apprentissage automatique (ML) rapidement et à grande échelle. Il a été introduit pour simplifier le pipeline de machine learning souvent compliqué et chronophage et le rendre plus accessible, même pour les équipes qui ne disposent pas d'une expertise approfondie en matière de ML ou de DevOps. Considérez SageMaker comme un guichet unique pour tout ce qui concerne le ML. Il prend en charge les tâches les plus lourdes liées au développement de modèles, qu'il s'agisse de la mise en place de l'infrastructure, de la gestion des expériences, de la formation à grande échelle, du déploiement d'API et même de la surveillance des modèles en production. Que vous travailliez sur une simple tâche de classification ou que vous déployiez un modèle d'apprentissage profond de grande envergure, SageMaker propose une approche modulaire prête à l'emploi pour vous permettre de passer de l'idée à la production.

Voici un bref aperçu de ce qu'il comprend :

- Des blocs-notes Jupyter intégrés pour explorer les données et créer des modèles.

- Algorithmes intégrés pour les tâches de machine learning courantes (régression, classification, clustering, etc.).

- Prise en charge de modèles personnalisés à l'aide de frameworks populaires tels que TensorFlow, PyTorch et Scikit-learn.

- Des tâches de formation qui peuvent être étendues à plusieurs GPU et instances.

- Réglage automatique du modèle (optimisation des hyperparamètres).

- Hébergement de modèles avec création et évolutivité intégrées de terminaux.

- Outils de surveillance pour suivre les performances, la dérive et les journaux en production.

Comment fonctionne SageMaker ?

Bien, maintenant que nous savons ce que c'est que SageMaker est, parlons de la façon dont cela fonctionne réellement dans les coulisses. SageMaker simplifie essentiellement le cycle de vie de l'apprentissage automatique en le décomposant en trois étapes principales : la création, la formation et le déploiement, avec de nombreuses fonctionnalités utiles intégrées à chacune d'elles.

Construisez

Tout commence lors de la phase de « construction ». SageMaker met à votre disposition de nombreux outils pour préparer vos données, les explorer et créer vos modèles. Vous pouvez lancer les blocs-notes Jupyter directement depuis la console SageMaker (aucune configuration locale requise) et les connecter aux données stockées dans S3. Que vous utilisiez des algorithmes intégrés ou que vous écriviez les vôtres dans TensorFlow, PyTorch ou Scikit-learn, vous bénéficiez d'un environnement entièrement géré prêt à l'emploi.

Il prend également en charge l'intégration avec SageMaker Data Wrangler, qui permet de nettoyer et de transformer les données grâce à une interface low-code. En gros, la phase de construction est votre terrain de jeu en matière de machine learning, sans les problèmes de configuration.

Train

Une fois que votre code modèle est prêt, il est temps de l'entraîner. C'est là que SageMaker brille vraiment. Vous pouvez exécuter des tâches de formation sur des instances de calcul puissantes et évolutives (CPU ou GPU) sans rien provisionner manuellement. Vous définissez la configuration de votre tâche (comme le type et le nombre d'instances), vous lancez la formation et SageMaker s'occupe du reste.

Encore plus cool ? SageMaker prend en charge le réglage automatique des modèles, dans le cadre duquel il teste différents hyperparamètres pour vous permettre de trouver le modèle le plus performant. C'est comme avoir un mini-assistant de science des données qui mène des expériences en parallèle.

Déployer

Après la formation, vous aurez envie de proposer votre modèle quelque part, non ? SageMaker vous permet de déployer votre modèle en tant que point de terminaison en temps réel en quelques clics ou lignes de code. Il provisionne automatiquement l'infrastructure, configure un point de terminaison d'API HTTPS et l'adapte même en fonction du trafic. Vous pouvez également déployer des modèles pour l'inférence par lots ou utiliser des points de terminaison multimodèles si vous gérez de nombreux modèles de manière rentable.

En plus de cela, SageMaker intègre des outils tels que Model Monitor pour la détection des dérives, Clarify pour l'équité et l'explicabilité, et Debugger pour obtenir des informations pendant la formation.

La situation dans son ensemble

SageMaker est comme un pipeline de machine learning dans une boîte. Mais c'est un grand box : idéal pour une utilisation en entreprise, mais potentiellement excessif pour les petites équipes agiles qui souhaitent plus de contrôle, de flexibilité ou d'efficacité budgétaire.

Pourquoi explorer les alternatives à SageMaker ?

Bien que SageMaker soit incontestablement puissant, il n'est pas toujours la solution idéale pour tout le monde. En 2026, l'espace MLOps est plus diversifié que jamais, et de nombreuses équipes explorent activement des alternatives, et pour cause.

Coût et complexité

SageMaker peut rapidement devenir coûteux, en particulier lorsque vous commencez à utiliser ses fonctionnalités les plus avancées ou que vous devez évoluer sur plusieurs modèles et environnements. Il présente également une courbe d'apprentissage abrupte pour ceux qui ne sont pas déjà familiarisés avec AWS. Si votre équipe est petite ou soucieuse de son budget, cela peut être un facteur décisif.

Verrouillage vis-à-vis d'un fournisseur

SageMaker est étroitement intégré aux services AWS. Bien que cela fonctionne très bien si vous utilisez AWS à 100 %, cela peut créer des difficultés si vous travaillez dans une configuration multicloud ou si vous souhaitez conserver votre flexibilité. Les alternatives offrent souvent une meilleure portabilité et des normes ouvertes.

Personnalisation et contrôle

Certains utilisateurs trouvent SageMaker un peu trop opiniâtre. Vous souhaiterez peut-être un contrôle plus précis de l'infrastructure, des flux de travail personnalisés ou des stratégies de service de modèles. De nombreuses plateformes open source ou hybrides vous offrent cette liberté, sans frais supplémentaires.

Communauté et écosystème

Des outils tels que MLflow, BentoML et Seldon Core bénéficient de solides communautés open source, de mises à jour fréquentes et de composants prêts à l'emploi qui peuvent s'intégrer à presque toutes les technologies. Ils sont également souvent plus faciles à étendre ou à intégrer à des outils que vous utilisez déjà.

Léger et facile à utiliser

Les développeurs et les équipes MLOps d'aujourd'hui préfèrent souvent des outils légers, modulaires et natifs des conteneurs. SageMaker, en revanche, est plus monolithique, ce qui peut ralentir les choses dans les environnements agiles.

Les 6 meilleures alternatives à Sagemaker

Maintenant que nous avons expliqué pourquoi SageMaker n'est pas toujours la solution idéale, explorons quelques alternatives intéressantes. Que vous recherchiez quelque chose de plus léger, open source, indépendant du cloud ou simplement plus économique, il existe un outil pour vous. Ces six plateformes se démarqueront en 2026 par leur flexibilité, leur rapidité et leur facilité d'utilisation dans le monde réel. Chacun apporte quelque chose d'unique en fonction de la taille, des compétences et du flux de travail de votre équipe. Décomposons-les un par un.

1. True Foundry

TrueFoundry est une plateforme MLOps moderne conçue pour rendre le déploiement du machine learning rapide, convivial pour les développeurs et indépendant du cloud. Il vise à faire passer vos modèles de l'ordinateur portable à la production en moins de 15 minutes, sans les complexités du DevOps traditionnel. Construit sur une base native de Kubernetes, il élimine les problèmes d'infrastructure tout en offrant une flexibilité totale. Il fonctionne bien avec tous les fournisseurs de cloud et peut même être déployé sur site, ce qui en fait une solution idéale pour les startups, les équipes ML en pleine croissance ou les produits axés sur l'IA. Si vous en avez assez de vous battre avec les couches de SageMaker, TrueFoundry est d'une simplicité rafraîchissante.

Caractéristiques et prix

TrueFoundry permet le déploiement automatique de modèles, la mise à l'échelle automatique, la surveillance, le versionnage et les intégrations CI/CD. Il prend en charge les outils de ML populaires tels que MLflow, Prometheus et Grafana prêts à l'emploi. Grâce à son approche Bring-Your-Own-Container, vous pouvez proposer des modèles comme vous le souhaitez, sans aucune contrainte. La tarification est basée sur l'utilisation et adaptée aux différentes tailles d'entreprises, avec des plans flexibles pour les startups, les entreprises en expansion et les entreprises. Bien qu'elle ne soit pas entièrement open source, elle est transparente, axée sur les développeurs et beaucoup plus facile à adopter que les plateformes destinées aux grandes entreprises.

Pourquoi c'est une bonne alternative à SageMaker

- Temps de mise en production plus rapide grâce à des pipelines de déploiement simplifiés (pas de configuration AWS lourde).

- Infrastructure indépendante du cloud : exécutée sur n'importe quel cloud ou sur site, contrairement au modèle AWS uniquement de SageMaker.

- Observabilité intégrée avec mesures intégrées et tableaux de bord de journalisation (pas de configuration manuelle).

- Support CI/CD natif et multi-tenant, idéal pour faire évoluer le ML entre les équipes ou les clients.

- Une solution passe-partout minimale, idéale pour les équipes d'ingénierie qui recherchent de la rapidité sans complexité.

Difficultés

Bien que TrueFoundry simplifie une grande partie de la pile MLOps, il nécessite tout de même une certaine familiarité avec les concepts Docker et Kubernetes, en particulier lors de la configuration initiale. Il s'agit d'un acteur plus récent par rapport à SageMaker, de sorte que la communauté et les intégrations tierces ne cessent de croître. Les équipes à la recherche d'une solution totalement prête à l'emploi peuvent avoir besoin d'un peu de temps pour s'adapter.

2. Bent en ML

BentoML est un framework open source qui permet d'empaqueter, d'expédier et de déployer très facilement des modèles d'apprentissage automatique sous forme d'API. Il est léger, pythonique et conçu pour les développeurs qui souhaitent contrôler avec précision la façon dont leurs modèles sont servis. Avec BentoML, vous pouvez transformer n'importe quel modèle entraîné, qu'il s'agisse de frameworks tels que PyTorch, TensorFlow ou XGBoost, en un service REST ou gRPC prêt pour la production en quelques lignes de code seulement. C'est la solution idéale pour les équipes qui souhaitent gérer elles-mêmes leur infrastructure au service de modèles sans avoir à supporter les coûts liés à des plateformes lourdes.

Caractéristiques et prix

BentoML propose une approche flexible et modulaire du service de modèles avec des fonctionnalités telles que la gestion des versions de modèles, la génération de conteneurs Docker personnalisés et la prise en charge de plusieurs modèles. Il s'intègre à une gamme de backends (tels que Triton, TorchServe et ONNX Runtime) et fonctionne bien avec les pipelines CI/CD et les outils d'orchestration tels que Kubernetes. Comme il est open source, vous pouvez l'utiliser totalement gratuitement, même si la société mère de BentoML, BentoML.ai, propose un support d'entreprise et des services gérés aux équipes qui ont besoin d'évolutivité et de fiabilité.

Pourquoi c'est une bonne alternative à SageMaker

- Entièrement open source, sans dépendance vis-à-vis d'un fournisseur : déployez n'importe où, n'importe quand.

- Conçu pour les développeurs qui souhaitent contrôler totalement la façon dont les modèles sont conteneurisés et servis.

- Support natif pour les API REST et gRPC, ce qui facilite l'intégration dans les applications modernes.

- Indépendant du framework : vous pouvez diffuser des modèles provenant de TensorFlow, PyTorch, HuggingFace, etc.

- Léger et rapide, avec la possibilité de créer une logique d'inférence et des environnements d'exécution personnalisés.

Difficultés

BentoML est puissant, mais il nécessite une certaine familiarité avec DevOps, en particulier lors de la mise à l'échelle avec Kubernetes ou de l'intégration dans des flux de production. Il n'y a pas d'interface utilisateur gérée ni de pipeline de formation de modèles intégré, il est donc uniquement axé sur le service. C'est excellent pour la flexibilité, mais cela peut nécessiter une configuration manuelle plus poussée si vous n'êtes pas déjà expert en DevOps.

3. Vertex AI

Vertex AI est la plateforme d'apprentissage automatique de bout en bout de Google Cloud qui regroupe tous les outils dont vous avez besoin pour créer, former, déployer et gérer des modèles de machine learning à grande échelle. Il est profondément intégré à l'écosystème Google Cloud et conçu pour rationaliser les flux de travail dans les domaines de l'ingénierie des données, de la modélisation et des MLOps. Grâce à la prise en charge native d'AutoML et à une formation personnalisée, Vertex AI convient à la fois aux utilisateurs no-code et aux data scientists expérimentés. C'est particulièrement intéressant si vous travaillez déjà au sein de GCP ou si vous utilisez des outils tels que BigQuery et Dataflow.

Caractéristiques et prix

Vertex AI propose tout, de l'AutoML à la formation de modèles personnalisés, en passant par le réglage des hyperparamètres, les ordinateurs portables gérés, les pipelines et les points de terminaison de déploiement de modèles évolutifs. Il prend en charge les frameworks ML les plus courants et dispose d'outils MLOps intégrés pour le registre des modèles, la surveillance et le contrôle de version. La tarification est basée sur l'utilisation et modulaire : vous payez séparément les services informatiques, de stockage, de formation et de prévision. Bien qu'il soit puissant, les coûts peuvent augmenter en fonction du nombre de services que vous utilisez.

Pourquoi c'est une bonne alternative à SageMaker

- Intégration parfaite avec d'autres services GCP tels que BigQuery, Dataflow et Looker.

- Offre à la fois AutoML (pour plus de facilité) et une prise en charge complète des modèles personnalisés (pour plus de flexibilité).

- Fonctionnalités intégrées de surveillance des modèles, de gestion des versions et d'explicabilité prêtes à l'emploi.

- Vertex Pipelines permet d'automatiser les flux de travail ML complexes à l'aide de Kubeflow ou TFX.

- Entièrement géré et évolutif, il n'est pas nécessaire de gérer l'infrastructure manuellement.

Difficultés

Vertex AI est idéal pour les utilisateurs de GCP, mais il n'est pas aussi convivial si vous utilisez plusieurs clouds ou si vous ne faites pas partie de l'écosystème de Google. Son modèle de tarification peut être complexe et la courbe d'apprentissage peut être ardue pour les nouveaux arrivants qui ne connaissent pas les services Google Cloud. Bien qu'il soit robuste, il peut sembler accablant pour les petites équipes ou les praticiens en solo.

Découvrez également : Les 6 meilleures alternatives à Vertex AI

4. Databricks

Databricks ML est une puissante plateforme d'apprentissage automatique construite sur Databricks Lakehouse. Il fournit tout ce dont les équipes ont besoin pour développer, former, suivre, déployer et surveiller des modèles à grande échelle. Grâce à des intégrations approfondies entre les données et la pile de machine learning, Databricks ML est idéal pour les entreprises à la recherche d'une plateforme unique qui unifie les flux de travail d'ingénierie des données, d'analyse et d'apprentissage automatique.

Caractéristiques et prix

Databricks ML inclut AutoML intégré, le suivi des expériences via MLflow, une formation distribuée évolutive avec Apache Spark, des magasins de fonctionnalités gérés et un service de modèles en temps réel. La plate-forme prend en charge les frameworks ML populaires tels que TensorFlow, PyTorch, XGBoost et scikit-learn. Il fonctionne sur AWS, Azure et GCP, offrant des options de déploiement flexibles. La tarification est basée sur l'utilisation et adaptée aux besoins de calcul et de collaboration, avec des niveaux spécifiques pour les utilisateurs professionnels.

Pourquoi c'est une bonne alternative à SageMaker

- Plateforme unifiée pour les données, les analyses et le machine learning

- Intégration native de MLflow pour le suivi et la gestion des modèles

- Service de modèles en temps réel avec des SLA de niveau de service d'entreprise

Support multicloud avec calcul distribué évolutif

Difficultés

Databricks ML s'adresse aux équipes de taille moyenne à grande dotées de flux de données matures. Ce n'est pas l'idéal pour les équipes qui recherchent un outil de diffusion de machine learning léger ou autonome, et cela suppose une certaine familiarité avec l'écosystème Databricks.

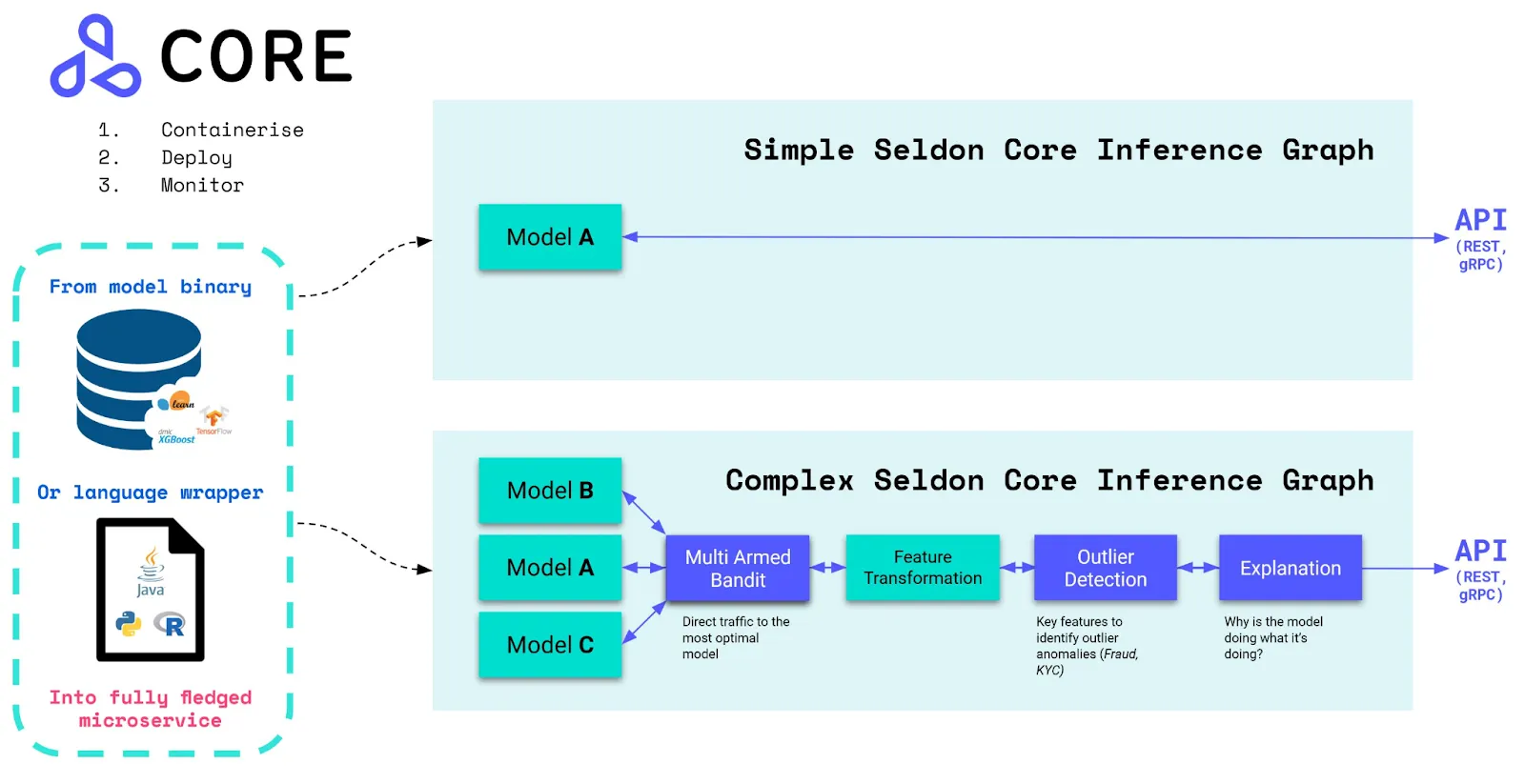

5. Noyau Seldon

Seldon Core est une plateforme MLOps open source conçue pour le déploiement, la mise à l'échelle et la surveillance de modèles d'apprentissage automatique sur Kubernetes. Il est indépendant du framework et conçu pour les équipes qui souhaitent exécuter des modèles en production avec un contrôle total de l'infrastructure. Seldon n'essaie pas d'être tout : il se concentre spécifiquement sur l'inférence et le service des modèles et le fait exceptionnellement bien. Si vous utilisez Kubernetes et que vous recherchez une solution open source de qualité production, Seldon Core est un candidat sérieux.

Caractéristiques et prix

Seldon Core prend en charge les déploiements multimodèles, les déploiements Canary, les tests A/B et l'enregistrement des demandes, le tout intégré à sa conception native de Kubernetes. Il fonctionne avec des modèles construits dans n'importe quel framework et peut les encapsuler dans une logique de pré/post-traitement à l'aide d'un code Python personnalisé. Il s'intègre également facilement à MLflow, Prometheus et Grafana pour des raisons d'observabilité. Étant open source, son utilisation est totalement gratuite, et il existe également Seldon Deploy, une version d'entreprise payante avec une interface utilisateur, un RBAC et des outils de gouvernance avancés.

Pourquoi c'est une bonne alternative à SageMaker

- Conception entièrement native de Kubernetes, idéale pour les équipes qui utilisent déjà des conteneurs et de l'orchestration.

- Des modèles de déploiement puissants tels que les tests Canary et les déploiements parallèles.

- Léger, modulaire et entièrement open source, sans frais cachés.

- Fonctionne dans le cloud et sur site, sans aucune dépendance vis-à-vis d'un fournisseur.

- Intégration facile avec les outils de surveillance et les outils de cycle de vie du machine learning tels que MLflow.

Difficultés

Seldon Core est idéal si vous avez déjà une configuration Kubernetes, mais si vous ne connaissez pas K8s, cela peut sembler un peu intimidant. Il ne propose pas de modèles de formation ni d'environnements de blocs-notes. Il est donc préférable de l'utiliser dans le cadre d'une suite MLOps plus importante plutôt que dans le cadre d'une solution autonome.

6. Débit ML

MLflow est l'une des plateformes open source les plus largement adoptées pour gérer le cycle de vie complet de l'apprentissage automatique. Développé par Databricks, il est conçu pour fonctionner avec n'importe quelle bibliothèque de machine learning, n'importe quel langage et sur n'importe quel cloud. MLflow vous aide à suivre les expériences, à empaqueter des modèles, à gérer un registre de modèles et à diffuser des modèles en toute simplicité. Il est hautement modulaire, vous pouvez donc utiliser uniquement les composants dont vous avez besoin ou l'intégrer dans une plus grande pile MLOps.

Caractéristiques et prix

MLflow comprend quatre composants principaux : le suivi (pour la journalisation des expériences), les projets (pour le code du package), les modèles (pour l'empaquetage et le déploiement) et le registre des modèles (pour la gestion du cycle de vie). Il prend en charge de nombreux frameworks, notamment TensorFlow, PyTorch, Scikit-learn et XGBoost. MLflow est gratuit et open source, avec une communauté massive et une documentation solide. Databricks propose également une version entièrement gérée avec des fonctionnalités de collaboration avancées pour les équipes d'entreprise.

Pourquoi c'est une bonne alternative à SageMaker

- Entièrement open source et indépendant du cloud, déployez-le où vous le souhaitez.

- Suivi simple des expériences et reproductibilité prêts à l'emploi.

- Fonctionne avec n'importe quel framework ou environnement ML : Python, R, Java, etc.

- Model Registry vous permet de gérer facilement les étapes du modèle (préparation, production, archivage).

- Facile à intégrer dans des pipelines ou des outils existants tels que Airflow, Docker ou Kubernetes.

Difficultés

MLflow se concentre davantage sur le suivi des expériences et la gestion du cycle de vie des modèles que sur le déploiement complet. Bien qu'il propose la diffusion de modèles, il est relativement simple et nécessite souvent d'être associé à d'autres outils (tels que Seldon ou BentoML) pour une inférence de niveau production. Les débutants peuvent également avoir besoin d'un certain temps de configuration pour tirer le meilleur parti de ses composants.

TrueFoundry trouve l'équilibre

Bien que chacune des alternatives répertoriées ci-dessus présente des avantages spécifiques (Vertex AI pour le ML complet, MLflow pour le suivi des expériences, Seldon Core pour le service de modèles et BentoML pour le packaging), TrueFoundry est la seule plateforme qui associe ces fonctionnalités au sein d'une solution MLOps unique et conviviale pour les développeurs, conçue pour évoluer. Elle associe la flexibilité d'un outillage ouvert à la structure d'une plateforme d'entreprise, ce qui la rend particulièrement adaptée aux équipes dynamiques qui recherchent à la fois rapidité et contrôle.

Pourquoi TrueFoundry gagne rapidement du terrain

- Conçu pour évoluer : TrueFoundry gère les charges de travail d'inférence LLM supérieures à 100 000 RPS avec des pools de GPU distribués et une mise à l'échelle automatique.

- LLM-Native by Design : Plus de 250 LLM préintégrés prenant en charge les modèles vLLM, TGI et personnalisés.

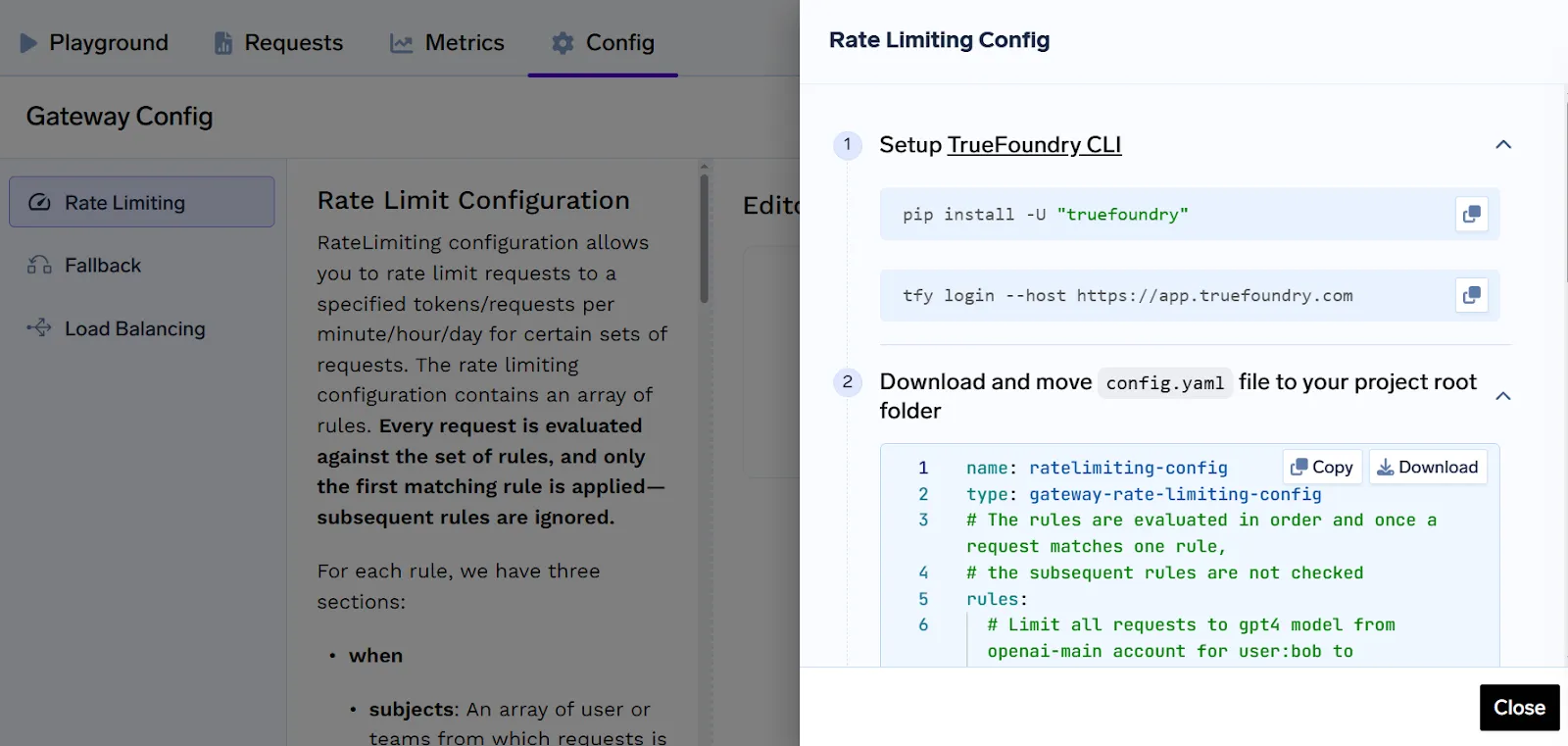

- Passerelle unifiée : Une couche d'API unique pour acheminer le trafic entre des modèles propriétaires et open source, avec limitation de débit, solution de repli et création de modèles rapides.

- Prêt pour les entreprises : Déploiements multicloud conformes à la norme SOC2 avec un contrôle d'accès précis et des flux de travail GitOps.

Parmi toutes les alternatives SageMaker répertoriées, qu'il s'agisse des fonctionnalités complètes de Vertex AI, du suivi des expériences de MLflow ou de la flexibilité de service de BentoML, TrueFoundry se distingue comme la plateforme MLOps la plus équilibrée et la plus axée sur la production. Il propose une infrastructure native de Kubernetes qui simplifie le déploiement, la mise à l'échelle et la gestion des modèles de machine learning. Avec la prise en charge native de plus de 250 LLM propriétaires et open source, TrueFoundry est également à la pointe de l'adoption de GenAI. Il fournit des fonctionnalités avancées telles que optimisation de la latence, gestion rapide, limitation du débit et passerelle LLM multicloud, le tout intégré et prêt pour la production.

Alternatives à AWS Sagemaker : configuration de la limite de débit TrueFoundry

Contrairement aux plateformes qui se concentrent sur des étapes isolées du cycle de vie du machine learning, TrueFoundry fournit une orchestration de bout en bout, de la formation des modèles au déploiement et à la surveillance. Il offre un contrôle précis de l'infrastructure, de l'observabilité et de la conformité, tout en rationalisant l'expérience des développeurs grâce aux flux de travail GitOps et à une approche axée sur les API. Pour les équipes qui souhaitent agir rapidement sans compromettre la fiabilité ou la flexibilité, TrueFoundry est bien plus qu'un simple remplacement de SageMaker. Il s'agit d'une solution MLOps moderne conçue pour être évolutive et rapide.

Conclusion

Le paysage MLOps en 2026 offre plus de flexibilité et d'innovation que jamais. Amazon SageMaker reste un outil puissant, mais il ne s'agit pas d'une solution universelle, en particulier pour les équipes qui recherchent la rapidité, la simplicité ou un meilleur contrôle de leurs flux de travail de machine learning. Que vous optiez pour des solutions open source telles que BentoML et Seldon Core, que vous souhaitiez une orchestration robuste des pipelines avec Valohai ou que vous vous intéressiez à l'écosystème de Google avec Vertex AI, il existe une alternative solide pour chaque besoin.

Cela dit, TrueFoundry s'impose rapidement comme une option hors pair, en particulier pour les équipes qui souhaitent bénéficier de la puissance de SageMaker sans les contraintes, les coûts ou la complexité. Il est rapide, convivial pour les développeurs et conçu pour évoluer. Lorsque vous évaluez les options qui s'offrent à vous, tenez compte de ce qui compte le plus pour votre équipe : rapidité de déploiement, flexibilité, adéquation à l'écosystème ou rentabilité. Le bon outil n'est pas qu'une question de fonctionnalités, c'est celui qui vous aide à expédier des produits ML percutants avec moins de friction.

Questions fréquemment posées

Quelle est l'alternative à SageMaker ?

Bien que des plateformes telles que Databricks et Vertex AI soient courantes, TrueFoundry est la meilleure alternative à Sagemaker pour les équipes en quête de flexibilité et de contrôle des coûts. Contrairement à l'écosystème AWS de SageMaker, TrueFoundry est indépendant du cloud, ce qui vous permet de déployer sur AWS, GCP, Azure ou des clusters Kubernetes sur site. Il simplifie le cycle de vie des MLOps, de l'ordinateur portable à la production en quelques minutes, offrant une meilleure expérience aux développeurs et une réduction significative des coûts sans la dépendance à un fournisseur associée à SageMaker.

Quel est l'équivalent Google de SageMaker ?

L'équivalent direct de Google Cloud est Vertex AI, qui propose des services de ML gérés similaires. Toutefois, si vous souhaitez éviter d'être bloqué dans l'écosystème de Google, TrueFoundry est une option cross-cloud supérieure. Il fonctionne parfaitement sur Google Kubernetes Engine (GKE) tout en préservant la possibilité de migrer vers d'autres clouds. TrueFoundry fournit un plan de contrôle unifié pour vos modèles, vous offrant ainsi la puissance de Vertex AI associée à la liberté d'une infrastructure ouverte.

Quel est l'équivalent Microsoft de SageMaker ?

L'équivalent de Sagemaker chez Microsoft est Azure Machine Learning (Azure ML). Bien qu'il s'intègre bien aux services Azure, il vous limite à leur infrastructure. TrueFoundry constitue une alternative flexible qui fonctionne en plus d'Azure Kubernetes Service (AKS) mais n'est pas limitée par celui-ci. Cela permet aux entreprises de tirer parti de la puissance de calcul d'Azure tout en maintenant une pile MLOps neutre pour le cloud, garantissant des flux de travail et une gouvernance standardisés dans l'environnement de votre choix.

Amazon Rekognition est-il meilleur que SageMaker ?

Cela dépend de vos besoins. Amazon Rekognition est une API SaaS prête à l'emploi pour l'analyse d'images, tandis que SageMaker est une plateforme permettant de créer et de former des modèles personnalisés. Si vous avez besoin de personnaliser SageMaker mais que vous le trouvez trop complexe, TrueFoundry est la solution idéale. Il vous permet de déployer et de gérer facilement des modèles de vision par ordinateur open source ou personnalisés, offrant la flexibilité d'un développement personnalisé avec la simplicité d'un service géré.

Est-ce que SageMaker est juste Jupyter ?

Non, SageMaker est une suite complète pour la formation et le déploiement, bien qu'elle s'appuie largement sur Jupyter pour le développement. Cependant, son intégration aux ordinateurs portables peut souvent sembler difficile pour les flux de production. TrueFoundry améliore cela en comblant parfaitement le fossé entre l'expérimentation et la production. Il permet aux développeurs de déclencher des tâches de formation et de déployer des modèles directement depuis leurs environnements préférés (y compris les ordinateurs portables), automatisant ainsi la transition vers Kubernetes sans les lourdes charges DevOps que SageMaker impose souvent.

SageMaker est-il un concurrent d'OpenAI ?

Pas directement. OpenAI fournit des modèles propriétaires, tandis que SageMaker est une plateforme d'infrastructure permettant de créer et d'héberger des modèles. Cependant, les entreprises choisissent souvent entre utiliser les API d'OpenAI et héberger des modèles open source sur SageMaker. TrueFoundry unifie ce choix en agissant comme une plateforme complète sur laquelle vous pouvez gérer les clés d'API OpenAI via une passerelle sécurisée et hébergez des modèles open source privés sur votre propre infrastructure, vous offrant ainsi le meilleur des deux mondes.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)