Les meilleurs outils d'ingénierie rapide en 2026 : tout ce que vous devez savoir

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

L'ingénierie rapide fait référence à l'amélioration des entrées pour obtenir de meilleurs résultats des LLM.

L'ingénierie rapide, c'est comme apprendre à parler efficacement à l'IA. Il s'agit de choisir les bons mots lorsque vous demandez à l'IA de faire quelque chose, qu'il s'agisse d'écrire du texte, de coder ou de créer des images.

Il existe des outils spéciaux qui nous aident à nous améliorer dans ce domaine, en nous assurant que l'IA nous comprend correctement et fait ce que nous voulons avec plus de précision.

Il s'agit de rendre la communication entre les humains et l'IA plus fluide et plus efficace. Dans ce blog, parlons des meilleurs outils d'ingénierie rapide disponibles en 2026.

Qu'est-ce qu'un outil d'ingénierie rapide ?

UNE ingénierie rapide Un outil est une plate-forme logicielle, une application ou un framework qui aide les utilisateurs à créer, tester, affiner et organiser les instructions (invites) qu'ils fournissent aux grands modèles de langage (LLM) ou aux systèmes d'IA génératifs.

Ces outils sont essentiels pour améliorer la précision de l'IA, maintenir des résultats cohérents, minimiser les erreurs ou les hallucinations et rationaliser la façon dont les humains interagissent avec l'IA. Elles vont au-delà des simples interfaces de chat et permettent des flux de travail structurés et reproductibles.

Les meilleurs outils d'ingénierie rapide font le pont entre les idées humaines et les réponses des machines, aidant les utilisateurs à transformer des demandes vagues ou simples en instructions précises et exploitables qui génèrent des résultats plus fiables.

.webp)

Les meilleurs outils d'ingénierie rapides

Voici un bref aperçu des meilleurs outils d'ingénierie rapide en 2026 :

Passerelle LLM (Truefoundry)

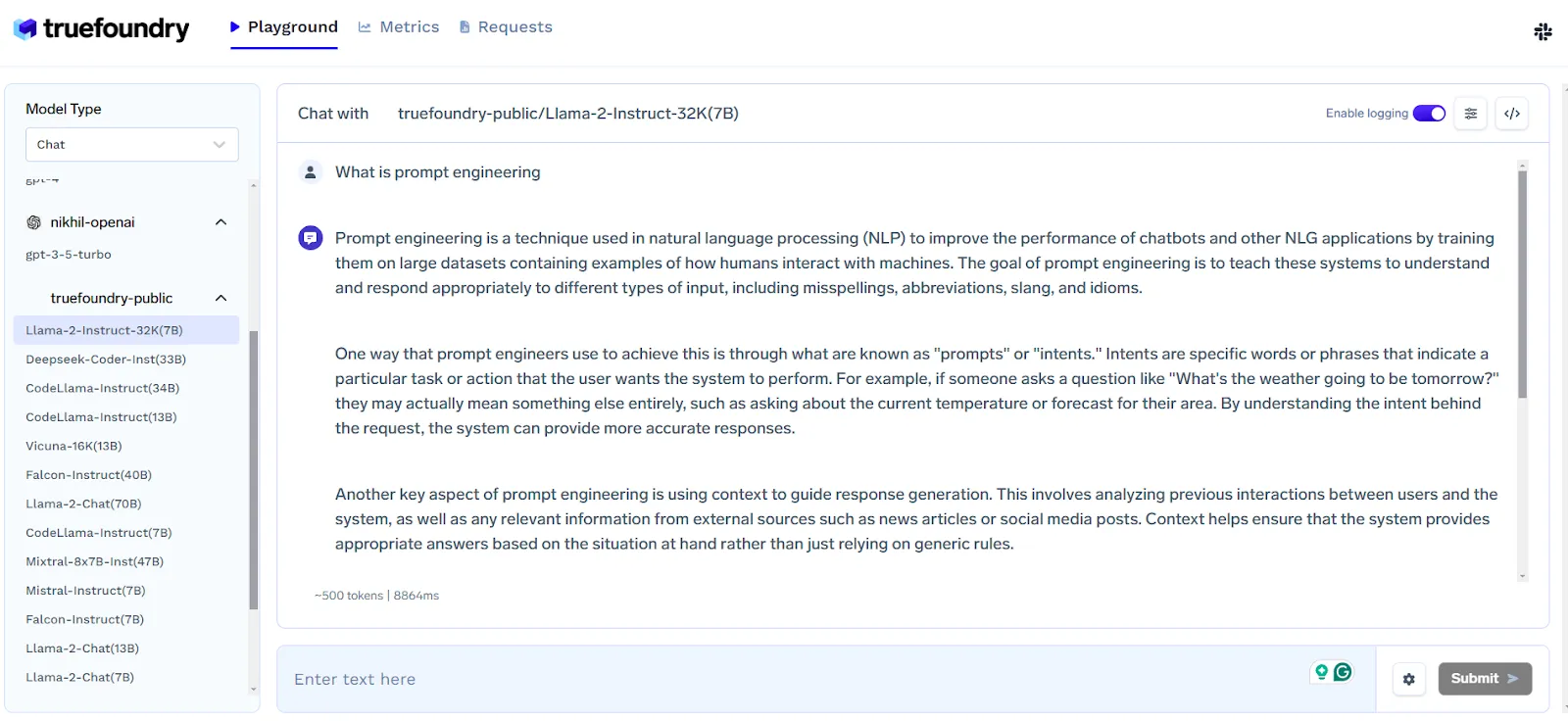

Le terrain de jeu TrueFoundry LLM est une plateforme qui simplifie l'expérimentation de grands modèles de langage (LLM) open source. Il offre un moyen simple de tester différents LLM via une API, sans avoir besoin de configurations complexes impliquant des GPU ou le chargement de modèles.

Ce terrain de jeu vous permet de comparer les modèles pour trouver celui qui vous convient le mieux avant de choisir une solution d'hébergement.

Interaction avec le LLM Gateway

Ici, vous pouvez facilement choisir parmi différents LLM, y compris OpenAI pour l'inférence.

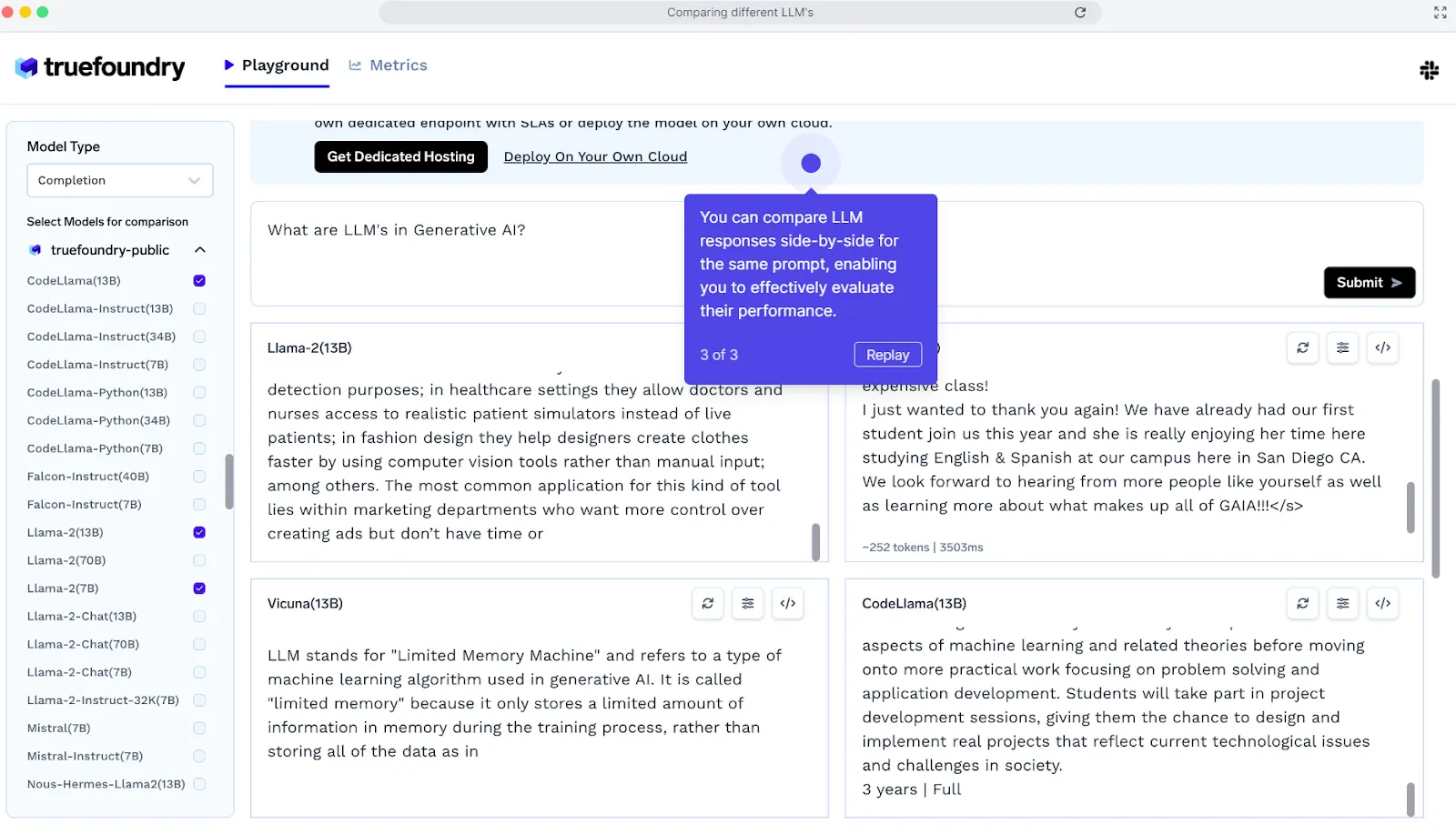

Comparez différents modèles avec LLM Gateway :

Ici, vous pouvez comparer jusqu'à 4 modèles pour une invite spécifique et décider lequel fonctionne le mieux pour une invite spécifique.

Principales caractéristiques :

Passerelle LLM fournit une API unique à l'aide de laquelle vous pouvez appeler n'importe quel fournisseur de LLM, y compris OpenAI, Anthropic, Bedrock, votre modèle auto-hébergé et les LLM open source. Il fournit les fonctionnalités suivantes :

- API unifiée pour accéder à tous les LLM de plusieurs fournisseurs, y compris vos propres modèles auto-hébergés.

- Gestion centralisée des clés

- Authentification et attribution par utilisateur, par produit.

- Attribution et contrôle des coûts

- Support de secours, de nouvelles tentatives et de limitation de débit

- Intégration de Guardrails

- Mise en cache et mise en cache sémantique

- Support pour les modèles Vision et multimodaux

- Exécutez des évaluations sur vos données

Alors que Véritable fonderie propose d'excellents outils pour une ingénierie rapide. Les capacités de TrueFoundry vont bien au-delà, notamment des fonctionnalités telles que la formation fluide des modèles, le déploiement sans effort, l'optimisation des coûts et une interface de gestion unifiée pour les ressources cloud.

Tarification :

TrueFoundry propose une option d'essai gratuite pour les développeurs et les premiers constructeurs qui expérimentent les flux de travail d'IA. Le forfait payant de TrueFoundry commence à 499$ par mois.

Transformateurs Hugging Face

Hugging Face Transformers propose des API et des utilitaires faciles à utiliser pour accéder à des modèles de PNL pré-entraînés de pointe et les entraîner. Il prend en charge des tâches telles que la traduction, la reconnaissance d'entités et la classification de texte, tout en encourageant la collaboration open source.

Avantages :

- Convivial avec des API accessibles pour les tâches de PNL.

- Supporte plusieurs frameworks : PyTorch, TensorFlow et JAX.

- Formation et inférence flexibles sur les modèles dans tous les frameworks.

- Open source, favorisant la collaboration communautaire et l'innovation.

Inconvénients :

- Pas de tableau de bord ou d'interface graphique autonome.

- Cela peut être difficile pour les débutants en raison des nombreuses options de configuration.

Idéal pour

- Praticiens et chercheurs en PNL spécialisés dans l'ingénierie rapide.

- Développeurs ayant besoin de modèles flexibles et pré-entraînés pour la classification de texte, la traduction ou la reconnaissance d'entités.

- Les équipes intègrent des modèles dans différents frameworks de machine learning de manière fluide.

Tarification

- Hugging Face Transformers est open source et gratuit. Certaines fonctionnalités premium et API d'inférence hébergées peuvent avoir des niveaux payants via Hugging Face Hub.

Allen LP

AllennLP est une bibliothèque NLP open source conçue pour simplifier un large éventail de tâches de traitement du langage naturel. Bien que légèrement plus complexe qu'AdaptNLP, il fournit une riche collection d'outils et de composants prédéfinis, ce qui le rend idéal pour les chercheurs et les développeurs travaillant avec des modèles NLP avancés.

Avantages :

- Configuration de haut niveau pour faciliter la configuration de tâches NLP complexes.

- Abstractions modulaires pour créer et expérimenter des modèles de pointe.

- Open source et piloté par la communauté avec un soutien et des contributions actifs.

Inconvénients :

- Courbe d'apprentissage plus abrupte par rapport aux bibliothèques de PNL plus simples.

- Nécessite une connaissance de la bibliothèque Python et des concepts de NLP pour une utilisation complète.

Idéal pour

- Chercheurs et développeurs travaillant sur des tâches avancées de PNL.

- Apprentissage multitâche, modèles basés sur des transformateurs et projets de classification de texte.

- Expérimenter des architectures NLP modulaires et des pipelines personnalisés.

Tarification

- AllennLP est totalement gratuit et open source, soutenu par la communauté.

Adapter NLP

AdaptNLP est une bibliothèque NLP facile à utiliser qui simplifie l'utilisation de modèles de langage avancés pour les débutants comme pour les experts. Construit sur les transformateurs Fastai et Hugging Face, il fournit des solutions rapides, flexibles et efficaces pour la formation et le réglage des modèles.

Avantages :

- Combine Transformers et Flair pour des capacités de NLP polyvalentes.

- Simplifie les tâches complexes telles que la classification de texte, l'extraction d'entités et la réponse aux questions.

- L'API conviviale permet une expérimentation et une formation rapides.

- Supporte les techniques d'entraînement modernes grâce à une inférence rapide et efficace.

Inconvénients :

- Principalement axé sur Python ; support limité pour les environnements non Python.

- Il peut être nécessaire de connaître Hugging Face ou fastai pour des personnalisations avancées.

Idéal pour

- Débutants à la recherche de pipelines NLP faciles à utiliser.

- Les ingénieurs ML ont besoin d'une mise au point efficace des modèles de transformateurs.

- Prototypage rapide de tâches de PNL telles que la classification, la reconnaissance d'entités et le marquage POS.

Tarification

- AdaptNLP est open source et gratuit, tirant parti du développement piloté par la communauté.

Buteur LMS

LMScorer est un outil open source qui fournit une interface de programmation et de ligne de commande simple pour noter des phrases à l'aide de différents modèles de langage ML. Il permet d'évaluer et d'affiner les instructions pour améliorer les interactions avec l'IA et garantir des résultats plus efficaces.

Avantages :

- Open source et utilisation gratuite avec code accessible pour modification.

- Interface de programmation simple et CLI pour une intégration facile.

- Note les phrases à l'aide de modèles de langage ML pour évaluer la qualité.

- Aide à améliorer les instructions pour améliorer les performances de l'IA.

Inconvénients :

- Limité à la notation ; il ne s'agit pas d'un cadre complet de PNL ou de formation par modèle.

- Nécessite des connaissances de base en programmation pour une utilisation efficace.

Idéal pour

- Les développeurs et les chercheurs en IA améliorent la qualité rapide.

- Expérimenter des modèles de langage pour obtenir des résultats naturels et compréhensibles.

- Évaluation rapide de multiples variantes d'invites à des fins d'optimisation.

Tarification

- LMScorer est totalement gratuit et open source.

Prompt Foo

Promptfoo est un outil de ligne de commande et une bibliothèque open source conçus pour rationaliser les tests et le développement de grands modèles de langage (LLM). Elle permet aux développeurs de tester systématiquement les instructions, de comparer les résultats et de noter automatiquement les résultats, en remplaçant les essais et erreurs par une approche pilotée par les tests.

Avantages :

- Open source et gratuit, avec intégration à la fois à la CLI et à la bibliothèque.

- Prend en charge les tests simultanés pour une évaluation plus rapide des LLM.

- Fonctionne avec plusieurs API LLM comme OpenAI et Google.

- Permet un développement systématique et piloté par les tests pour des résultats de modèles de haute qualité.

Inconvénients :

- Principalement destiné aux développeurs ; moins adapté aux débutants.

- Nécessite une connaissance des opérations en ligne de commande et des API LLM.

Idéal pour

- Les développeurs LLM testent et affinent les instructions de manière efficace.

- Ingénieurs et chercheurs en assurance qualité souhaitant une évaluation systématique des réponses des modèles.

- Les équipes qui souhaitent mettre en œuvre des flux de travail pilotés par les tests pour la qualité des résultats de l'IA.

Tarification

- Promptfoo est totalement gratuit et open source.

PromptHub

PromptHub est une plateforme à code source fermé conçue pour tester, évaluer et optimiser les invites sur plusieurs modèles linguistiques. Il permet aux utilisateurs d'évaluer l'efficacité rapide, d'explorer les réponses des modèles et d'analyser l'impact de différents paramètres d'hyperparamètres.

Avantages :

- Interface conviviale avec accès à l'API et déploiement optionnel de Docker.

- Fournit une riche bibliothèque d'instructions prêtes à l'emploi pour le développement de la PNL et des chatbots.

- Permet une personnalisation rapide pour des modèles et des tâches spécifiques.

- Facilite la collaboration en équipe, le contrôle des versions et l'amélioration continue.

Inconvénients :

- Manque de transparence totale.

- Peut nécessiter un abonnement ou une licence pour accéder aux fonctionnalités avancées.

- Flexibilité limitée par rapport aux alternatives open source pour l'expérimentation.

Idéal pour

- Les équipes et les développeurs testent les instructions sur plusieurs LLM.

- Des praticiens de la PNL qui créent des chatbots ou des pipelines de génération de contenu basés sur l'IA.

- Les organisations qui ont besoin de collaborer et de contrôler les versions gestion rapide.

Tarification

- PromptHub est une plateforme payante avec des plans d'abonnement à partir de 9$ par mois.

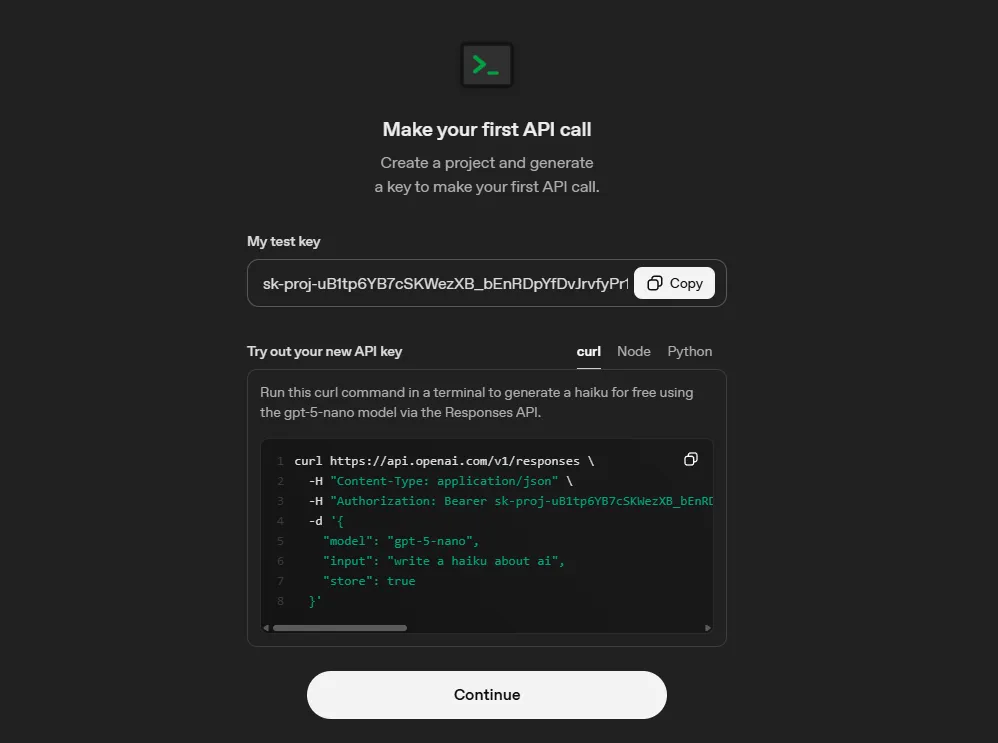

Terrain de jeu OpenAI

OpenAI Playground est un outil Web à source fermée conçu pour expérimenter les modèles d'IA avancés d'OpenAI, y compris GPT-4. Il permet aux utilisateurs de tester des instructions, de comparer des stratégies et d'affiner les modèles de langage dans un environnement interactif et convivial.

Avantages :

- Interface intuitive basée sur un navigateur, idéale pour des tests et une ingénierie rapides.

- Supporte plusieurs modèles OpenAI et des paramètres ajustables pour l'expérimentation.

- Fournit un feedback immédiat pour une itération rapide.

- De riches ressources pédagogiques, des didacticiels et une documentation d'API sont disponibles.

Inconvénients :

- Limité aux modèles OpenAI.

- Peut nécessiter un abonnement OpenAI ou des crédits d'API pour une utilisation prolongée.

- Moins adapté aux modèles non OpenAI ou au déploiement personnalisé de LLM.

Idéal pour

- Développeurs et chercheurs expérimentant avec GPT-4 ou d'autres modèles OpenAI.

- Incitez les ingénieurs à explorer des stratégies à tir zéro, à quelques coups ou à affiner.

- Les enseignants et les étudiants apprennent à travailler avec des modèles de langage d'IA avancés.

Tarification

- L'utilisation d'OpenAI Playground nécessite généralement des crédits d'API ou un abonnement, en fonction des limites d'utilisation et du choix du modèle.

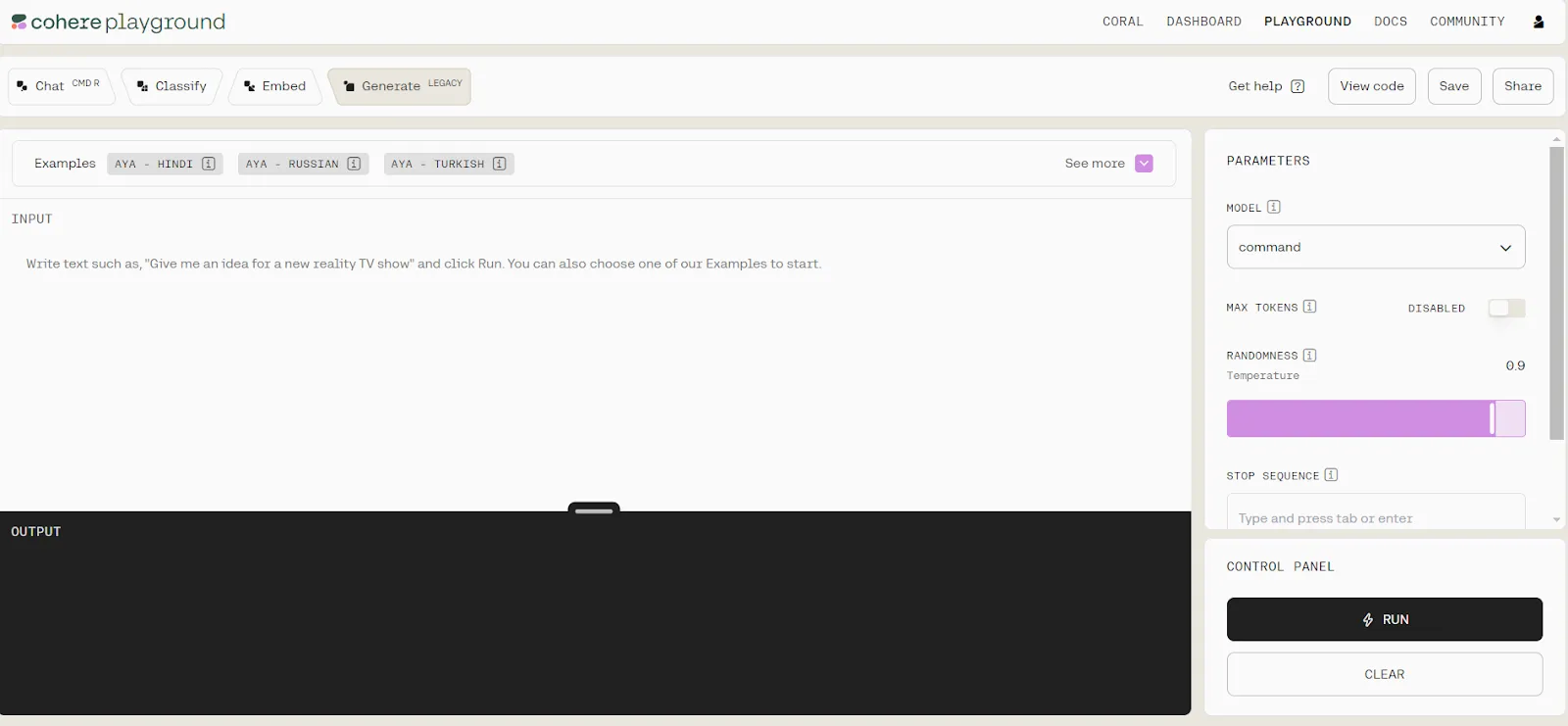

Terrain de jeu Cohere

Cohere Playground est une plateforme en ligne intuitive qui permet aux utilisateurs de travailler avec de grands modèles de langage d'IA sans coder. Il convient aussi bien aux débutants qu'aux utilisateurs expérimentés, car il permet la génération de texte, l'analyse intégrée, la création de classificateurs et des interactions simples basées sur le chat.

Avantages :

- Aucun codage requis ; interface conviviale pour les débutants.

- Générez du texte en langage naturel et créez facilement des classificateurs de texte.

- Visualisez les intégrations à des fins d'analyse sémantique dans un espace 2D.

- Sélectionnez la taille du modèle en fonction des besoins.

Inconvénients :

- Sélection de modèles et fonctionnalités limitées par rapport aux autres plateformes.

- Impossible de comparer différentes instructions ou modèles côte à côte.

- Nécessite des autorisations spéciales pour entraîner vos propres modèles.

Idéal pour

- Débutants explorant de grands modèles linguistiques.

- Utilisateurs ayant besoin d'expérimenter rapidement la génération ou la classification de texte.

- Analyse sémantique à l'aide d'intégrations sans configuration technique.

Tarification

- Cohere Playground peut nécessiter un compte ou un abonnement pour une utilisation prolongée et l'accès au modèle

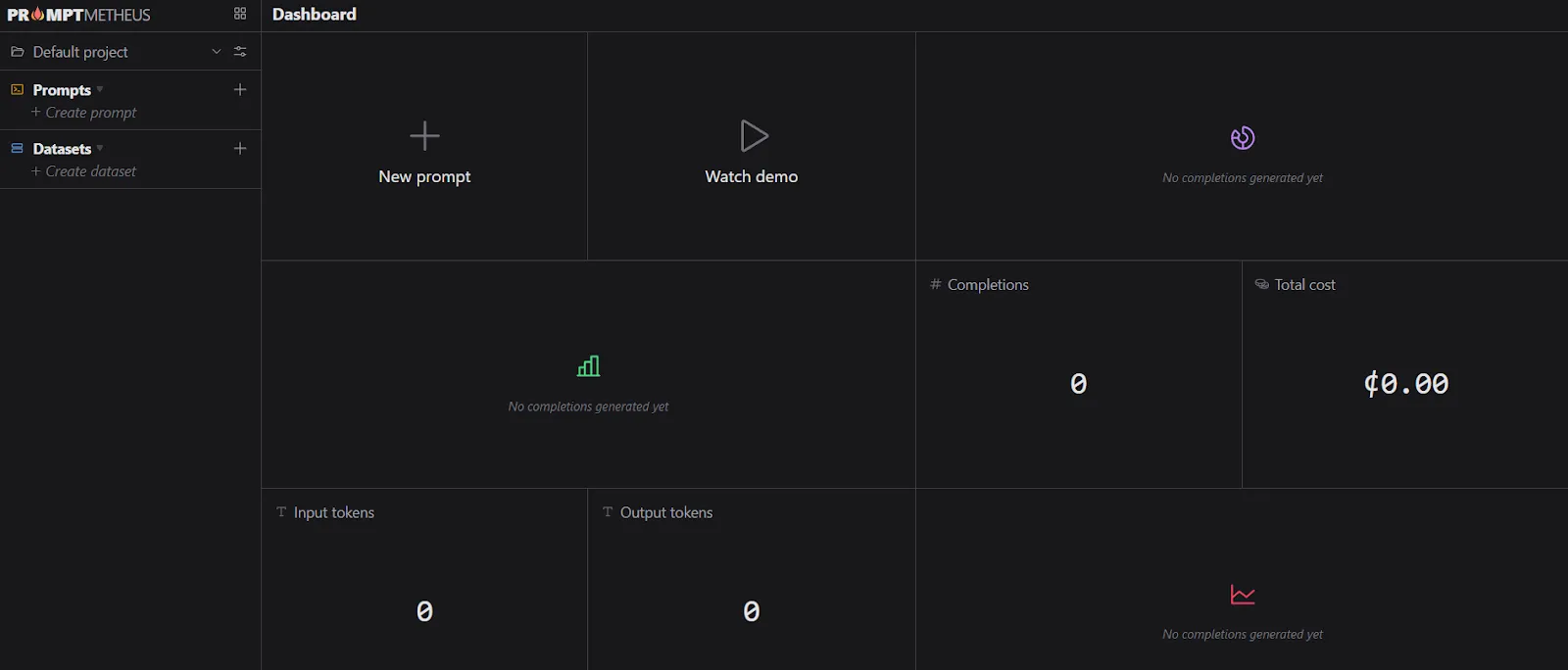

Invite Metheus

PromptMetheus est un IDE Prompt Engineering spécialisé conçu pour créer, tester et déployer des invites pour les grands modèles de langage (LLM). Il propose un environnement structuré avec des outils d'analyse, de collaboration et de déploiement en temps réel, ce qui rend l'ingénierie rapide plus efficace et plus facile à gérer.

Avantages :

- Des invites composables utilisant du texte et des blocs de données.

- Suivi complet de l'historique et traçabilité pour une conception rapide.

- Estimation des coûts d'utilisation de l'API LLM avant l'exécution.

- Accès à des statistiques et à des analyses de performance.

- Collaboration en temps réel avec les membres de l'équipe.

Inconvénients :

- Peut nécessiter un abonnement.

- Plus complexe que les outils rapides à usage général ; courbe d'apprentissage pour les débutants.

- Limité aux LLM et aux intégrations prises en charge par l'IDE.

Idéal pour

- Développeurs d'IA qui se concentrent sur l'ingénierie rapide structurée.

- Des équipes collaborant pour un développement rapide à grande échelle.

- Les utilisateurs ont besoin d'analyses et d'estimations de coûts avant de déployer des invites.

Tarification

- Les détails des prix dépendent des plans d'abonnement ou des licences d'entreprise, à partir de 29$ par mois

Comment choisir le bon outil d'ingénierie rapide ?

Le choix du bon outil d'ingénierie rapide dépend de vos objectifs, de votre expertise technique et des modèles d'IA que vous comptez utiliser. Voici un guide étape par étape qui vous aidera à prendre une décision.

1. Définissez votre cas d'utilisation

Commencez par identifier clairement ce que vous voulez réaliser grâce à une ingénierie rapide. Si vous vous concentrez sur la création de contenu, par exemple la rédaction d'articles, de textes marketing ou de billets de blog, vous aurez besoin d'un outil permettant de personnaliser le style et de produire du texte de haute qualité.

Pour les développeurs, les outils qui s'intègrent directement aux IDE et offrent une assistance à la génération de code ou au débogage sont idéaux. Si votre objectif est la recherche ou l'analyse de données, recherchez des outils capables de résumer des documents, de gérer des données structurées ou de générer des rapports détaillés.

2. Evaluer la compatibilité des modèles

Les outils ne sont pas tous compatibles avec tous les modèles d'IA. Vérifiez avec quels modèles l'outil est compatible, comme GPT-4, Claude ou LLama, et s'il vous permet de changer de modèle en fonction de la complexité de votre tâche.

L'utilisation d'un outil prenant en charge plusieurs modèles vous apporte de la flexibilité et peut améliorer la qualité de sortie pour des cas d'utilisation spécifiques.

3. Évaluer les fonctionnalités de gestion rapide

Un bon outil d'ingénierie rapide devrait faciliter la gestion et l'affinement des instructions. Des fonctionnalités telles qu'une bibliothèque de modèles fournissent des instructions prédéfinies qui permettent de gagner du temps et de maintenir la cohérence. Le contrôle de version vous permet de suivre les modifications et d'optimiser les instructions au fil du temps.

Si vous travaillez en équipe, les fonctionnalités collaboratives telles que les référentiels partagés permettent à plusieurs utilisateurs de contribuer et de gérer un flux de travail rapide unique.

4. Vérifiez l'interface utilisateur et la facilité d'utilisation

L'interface peut faire ou défaire votre expérience. Certains outils fournissent des interfaces visuelles par glisser-déposer, tandis que d'autres sont purement textuels. Choisissez celui qui correspond à votre niveau de confort et à votre flux de travail.

Une interface intuitive réduit la courbe d'apprentissage, vous permettant de vous concentrer sur la création rapide plutôt que sur la navigation dans des menus complexes.

5. Envisagez les intégrations

Déterminez dans quelle mesure l'outil s'intègre à votre flux de travail existant. Vérifiez s'il prend en charge les API ou les plugins qui se connectent à des plateformes telles que Slack, Notion ou Google Workspace. Les options d'exportation sont également utiles, car elles vous permettent de télécharger des instructions, des résultats et des journaux à des fins d'analyse ou de création de rapports plus approfondis.

6. Évaluez la tarification et l'évolutivité

Les structures de prix varient considérablement. Les niveaux gratuits sont parfaits pour les expériences, mais limitent souvent les appels d'API, les modèles ou les fonctionnalités avancées.

Les forfaits payants offrent généralement des limites d'utilisation plus élevées, une meilleure assistance et des fonctionnalités collaboratives. Assurez-vous que l'outil s'adapte à vos besoins pour éviter de changer de plateforme ultérieurement.

7. Testez la flexibilité et la qualité de sortie

Avant de valider, exécutez des exemples d'instructions pour évaluer dans quelle mesure l'outil interprète les instructions. Déterminez s'il permet de personnaliser la longueur, la tonalité ou la personnalité de la sortie. Les outils qui fournissent un contrôle précis de la production peuvent améliorer considérablement la productivité et la qualité des résultats.

8. Donnez votre avis sur Community & Support

Enfin, considérez l'écosystème de support. Une documentation complète et des didacticiels vous aident à démarrer rapidement. Les communautés d'utilisateurs actifs fournissent des bibliothèques d'instructions et des conseils partagés. Un support client fiable est essentiel pour résoudre les problèmes et faire évoluer efficacement votre utilisation.

Pourquoi les outils d'ingénierie rapides sont-ils importants en 2026 ?

Les outils d'ingénierie rapides sont devenus essentiels en 2026, car l'IA est désormais profondément intégrée dans presque tous les aspects du travail et de la vie quotidienne. Avec des modèles de plus en plus puissants tels que GPT-4.5, Claude 3 et LLama 3, la génération de sorties fiables et de haute qualité dépend largement de la manière dont les instructions sont conçues.

Une invite bien conçue peut améliorer considérablement la précision, la pertinence et la créativité, tandis qu'une invite mal structurée peut produire des résultats confus ou de faible valeur.

Ces outils rationalisent également les flux de travail en proposant des fonctionnalités telles que des modèles rapides, le contrôle des versions et la collaboration en équipe. Ils réduisent le processus d'essais et d'erreurs, permettant aux utilisateurs, qu'il s'agisse de créateurs de contenu, de développeurs ou d'analystes de données, d'atteindre leurs objectifs plus rapidement et plus efficacement.

En outre, à mesure que l'adoption de l'IA se développe dans les entreprises et la recherche, les organisations s'appuient sur des outils d'ingénierie rapides pour maintenir la cohérence, la conformité et la reproductibilité des résultats de l'IA.

En résumé, les outils d'ingénierie rapides permettent de combler le fossé entre les capacités brutes de l'IA et les résultats pratiques et exploitables, les rendant indispensables pour quiconque tirera parti de l'IA en 2026.

Évaluation d'un outil d'ingénierie rapide

Lorsque vous évaluez un outil d'ingénierie rapide, vous pouvez utiliser une série de questions directrices simples pour évaluer son utilité. N'oubliez pas que ces questions sont générales et qu'elles ne s'appliqueront pas à tous les outils.

Utilisabilité

- L'interface est-elle simple, claire et facile à naviguer ?

- Puis-je apprendre à utiliser cet outil rapidement ?

- Fournit-il des conseils ou de la documentation utiles ?

- En cas de problème, est-ce que cela donne des messages d'erreur et des correctifs clairs ?

Efficacité

- L'outil est-il rapide et réactif lors de son utilisation ?

- Est-ce que cela produit des résultats précis et corrects ?

- Fonctionne-t-il de manière fiable dans le temps et dans différents cas d'utilisation ?

Intégration

- Est-ce que cela fonctionne bien avec les outils et les systèmes que j'utilise déjà ?

- Existe-t-il des API robustes et flexibles ?

- Est-il facile d'importer/exporter ou de déplacer des données vers et vers l'extérieur ?

Évolutivité

- L'outil maintient-il ses performances avec des charges de travail importantes ou complexes ?

- De quel type de ressources de calcul cela nécessite-t-il ?

- Peut-il faire face à une demande accrue sans tomber en panne ?

Options de personnalisation

- Puis-je configurer l'outil en fonction de mon flux de travail ?

- Est-ce que cela permet la personnalisation pour moi ou mon équipe ?

- Puis-je adapter les résultats ou le comportement à des besoins spécifiques ?

.webp)

L'avenir des outils d'ingénierie rapides

L'avenir des outils d'ingénierie rapides en 2026 et au-delà s'annonce très avancé et centré sur l'utilisateur. Les principales tendances et évolutions sont notamment les suivantes :

- Optimisation rapide et intelligente : Les outils peuvent suggérer, affiner et même générer automatiquement des invites en fonction de la tâche, du style de l'utilisateur et des performances passées.

- Feedback en temps réel : Les utilisateurs recevront des conseils instantanés sur l'efficacité rapide, ce qui permettra d'améliorer la qualité de sortie sans essais ni erreurs.

- Correction automatique des erreurs : Les outils pilotés par l'IA détecteront et corrigeront les instructions mal structurées ou ambiguës.

- Collaboration améliorée : Des référentiels rapides à l'échelle de l'équipe, le suivi des versions et un accès multi-utilisateurs fluide amélioreront la cohérence du flux de travail.

- Orchestration multimodèle : Les utilisateurs pourront exploiter différents modèles d'IA au sein d'un seul flux de travail, en sélectionnant le meilleur modèle pour chaque tâche.

- Intégration aux plateformes de productivité : L'intégration directe à des outils tels que les applications de gestion de projet, les plateformes de communication et les systèmes de données rationalisera les flux de travail.

- Détection des biais et contrôles de sécurité : La surveillance intégrée garantira que les résultats de l'IA sont éthiques, sûrs et conformes aux normes réglementaires ou organisationnelles.

- Gestion centralisée des flux de travail basés sur l'IA : Les outils d'ingénierie rapides deviendront des hubs permettant de gérer, d'optimiser et de gérer les tâches pilotées par l'IA au sein des équipes et des projets.

Conclusion

Des outils d'ingénierie rapides sont essentiels en 2026, car ils permettent de transformer l'intention humaine en résultats d'IA précis, créatifs et fiables. Ils rationalisent les flux de travail grâce à des modèles, à la collaboration, à une assistance multimodèle et à des commentaires en temps réel. Choisir le bon outil avec soin, en tenant compte de la facilité d'utilisation, de la compatibilité et de l'évolutivité, garantit de meilleurs résultats et une meilleure efficacité.

Des plateformes telles que TrueFoundry vont encore plus loin en proposant un terrain de jeu unifié pour plusieurs LLM, un contrôle de version centralisé, un suivi des coûts et une collaboration en équipe, ce qui facilite le test, l'optimisation et le déploiement des invites à grande échelle.

Commencez à optimiser vos flux de travail d'IA dès aujourd'hui, explorez TrueFoundry et découvrez comment une ingénierie rapide rationalisée peut améliorer votre productivité et la qualité de vos résultats.

Questions fréquemment posées

Quels sont les outils d'ingénierie rapide couramment utilisés ?

Les meilleurs outils d'ingénierie rapide couramment utilisés incluent des bibliothèques open source telles que Hugging Face Transformers et Promptfoo pour les tests automatisés. Les plateformes à code source fermé telles que OpenAI Playground et PromptHub sont populaires pour les expériences itératives. Ces outils normalisent la façon dont les développeurs affinent les entrées des modèles pour obtenir une précision de sortie plus élevée.

Quel est le meilleur outil d'ingénierie rapide ?

Pour une gestion de niveau production, TrueFoundry est le meilleur outil d'ingénierie rapide, car il combine un terrain de jeu multimodèle avec une gestion centralisée des versions et un suivi des coûts. Il unifie les instructions entre les fournisseurs, permettant aux équipes d'évaluer et de déployer des entrées optimisées grâce à une gouvernance intégrée.

Quels sont les trois types d'ingénierie rapide ?

Les trois principaux types incluent l'incitation à zéro, à quelques coups et l'incitation par chaîne de pensée. Zero-shot propose une tâche sans exemples, tandis que few-shot inclut des démonstrations spécifiques pour guider le modèle. L'ingénierie de la chaîne de pensée encourage le LLM à traiter des étapes de raisonnement complexes, ce qui est essentiel pour résoudre des problèmes complexes de logique ou de codage.

Quelles sont les 5 meilleures techniques d'ingénierie rapide ?

Les techniques d'ingénierie les plus rapides impliquent la chaîne de pensée, l'incitation en quelques coups, les délimiteurs pour la structure, l'incitation aux rôles et le raffinement itératif. L'utilisation des meilleurs outils d'ingénierie rapide tels que Promptfoo permet d'automatiser l'évaluation de ces techniques. Ces méthodes garantissent que le modèle reste concentré, réduit les hallucinations et respecte les contraintes de formatage spécifiques requises pour la production.

Quelles sont les meilleures pratiques en matière d'utilisation d'outils d'ingénierie rapides ?

Les meilleures pratiques incluent la gestion des versions de chaque invite, l'utilisation de comparaisons de modèles côte à côte et la mise en œuvre d'une notation automatique. Vous devez suivre les coûts et la latence des jetons chez les différents fournisseurs afin d'optimiser les performances. L'utilisation d'une plateforme de gestion centralisée garantit que toute votre équipe utilise les instructions les plus efficaces tout en maintenant une sécurité et une auditabilité strictes.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)