Solution de suivi des coûts LLM pour l'observabilité, la gouvernance et l'optimisation des entreprises

.webp)

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Pourquoi chaque organisation a besoin d'une solution robuste de suivi des coûts LLM

Alors que les entreprises mettent en production l'IA générative et les grands modèles de langage (LLM), la gestion des coûts devient essentielle. La tarification basée sur des jetons, courante chez les fournisseurs de LLM, apporte une complexité unique :

- Plusieurs LLM avec des prix distincts—OpenAI, Claude, Mistral et les modèles auto-hébergés ont tous un coût par jeton différent.

- Variable use by work flow, user or team—Chaque fonctionnalité du produit ou session utilisateur peut consommer des jetons à des taux très différents.

- Contexte en couches et pipelines dynamiques—Des fonctionnalités telles que la génération augmentée de récupération (RAG), les chaînes d'outils et les agents introduisent une expansion imprévisible des jetons.

Sans solution de suivi des coûts LLM dédiée, les équipes manquent de visibilité jusqu'à ce que les coûts augmentent de manière inattendue. Cela menace les budgets et entrave les efforts de mise à l'échelle.

Voici comment aborder le suivi, la gouvernance et l'optimisation de bout en bout, ainsi que des liens directs et naturels vers la documentation TrueFoundry pour chaque élément central.

1. Unified Observability

La mise en place d'un suivi des coûts robustes commence par la saisie de données complètes et structurées pour chaque demande LLM. À l'aide du Passerelle TrueFoundry AI, vous pouvez acheminer tout le trafic d'inférence, que ce soit vers un modèle d'API (comme OpenAI, Claude ou Mistral) ou vers un modèle auto-hébergé que vous exploitez. Cette passerelle agit comme votre « guichet unique » pour l'observabilité et l'attribution des coûts.

Pour chaque demande, vous devez :

- Étiquetez les métadonnées telles que l'utilisateur, l'équipe, l'environnement et la fonctionnalité pour une attribution précise des coûts (Comment ajouter des balises de métadonnées).

- Capturez et analysez le nombre de jetons, la latence des demandes et le modèle utilisé, ce qui vous permet de disposer des bases nécessaires à la rétrofacturation, à la rétrofacturation et à la gestion des dépenses en temps réel (Analyses et surveillance).

- Intégrer OpenTelemetry pour intégrer ces mesures à votre pile d'observabilité existante, en corrélant les dépenses LLM avec le comportement général du système.

2. Governance

Une solution complète de suivi des coûts LLM doit vous permettre de faire respecter les limites avant les budgets sont dépassés.

- Rate Limits: définir des quotas journaliers/mensuels par utilisateur, équipe, environnement, modèle ou même des métadonnées personnalisées (Guide de limitation de débit). Cela permet d'éviter des charges de travail « incontrôlables » qui entraînent une hausse des dépenses.

- Plafonds budgétaires et exécution automatisée: configurez des règles de sorte que si une équipe ou une fonctionnalité dépasse le budget, les demandes puissent être bloquées automatiquement ou les responsables alertés (Execution du budget).

- Access control: Limitez les modèles expérimentaux ou onéreux aux équipes et aux flux de travail qui en ont réellement besoin (Politiques d'accès).

- Rambardes: bloquez les messages non sécurisés ou peu rentables et empêchez toute extension accidentelle des messages rapides (Vue d'ensemble des garde-corps).

Ensemble, ces fonctionnalités de gouvernance transforment la journalisation en solution de suivi des coûts en temps réel et applicable qui évite les dépassements dès sa conception, et pas seulement grâce à des rapports rétroactifs.

3. Optimisation continue : dynamisez votre solution de suivi des coûts LLM

Après l'observabilité et la gouvernance, optimisation est le processus continu de réduction des dépenses sans sacrifier les performances ou la qualité.

- Smart Charger Inquilibration and Smart Router: Tirez parti de TrueFoundry charge équilibrage pour envoyer les demandes au modèle le plus rentable. Par exemple, les requêtes simples peuvent être envoyées à Mistral ou à un petit modèle affiné, tandis que les requêtes complexes peuvent être acheminées vers GPT-4.

- Semantic cache : Cette technique stocke et réutilise les résultats LLM en fonction de la similitude sémantique des requêtes. Cependant, il n'est pas largement adopté, car il peut entraîner une incertitude ou une variabilité accumulée des réponses des modèles en raison de différences subtiles dans le contexte rapide.

- Mises en cache et traitements par lots: Profitez de Lots Prediction API pour minimiser les requêtes répétées et regrouper les demandes similaires, en réduisant considérablement les coûts des jetons.

- Ingenierie rapide et résultats structurés: Utilisez le structuré scheme outillage pour limiter les sorties LLM verbeuses/imprévisibles et stabiliser les coûts.

- Model Ajustement: Pour les charges de travail répétitives et spécifiques à un domaine, utilisez Optimisation des flux de travail par TrueFoundry pour raccourcir les invitations et compresser les demandes en fonction de votre contexte professionnel.

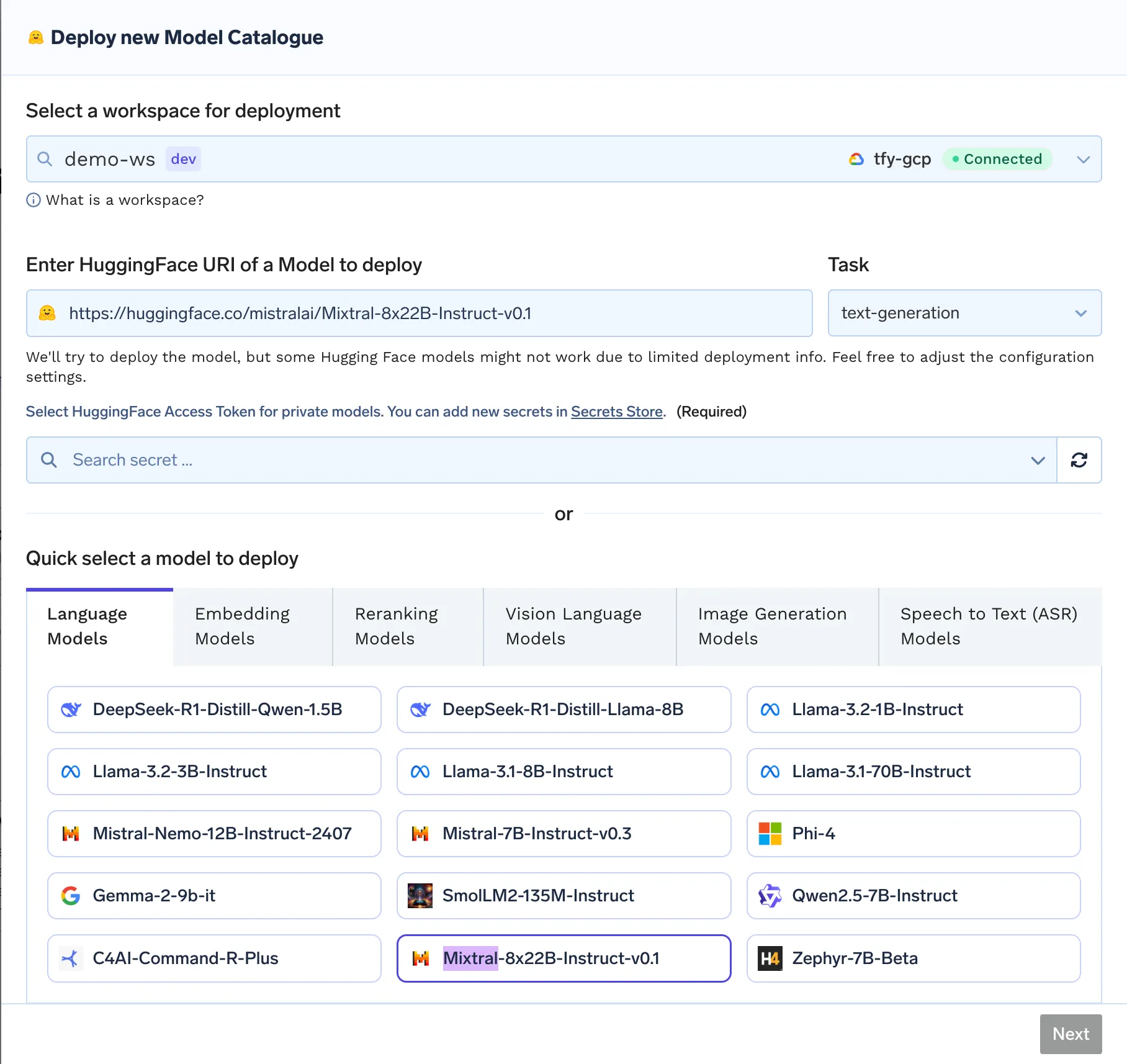

- Auto-accommodation: Lorsque les charges de travail se stabilisent et que le volume augmente, exécutez des LLM open source (tels que Mistral ou Llama) via self-hébergé déploiement peut réduire considérablement les taux d'API par jeton, tout en utilisant les mêmes outils d'observabilité et de politique.

4. Indicateurs clés : ce qu'il faut suivre dans votre solution de suivi des coûts LLM

Une optimisation des coûts réussie repose sur des mesures vigilantes. Les éléments suivants sont essentiels à suivre sur l'ensemble de votre pile :

- Jetons by request: normalise et compare les modèles d'utilisation.

- Cost by utilisateur/équipe/fonctionnalité: permet de générer des rapports de rétrofacturation et de rétrofacturation à des fins de responsabilité interne.

- Cache access rate: indique le montant des dépenses économisées grâce à la mise en cache intelligente.

- Demandes acheminées vers des modèles coûteux: you help to reorienter le trafic non essentiel vers des options moins coûteuses.

- Photos des coûts et des anomalies: permet de détecter les régressions, les erreurs de configuration ou d'éventuels abus.

Tous ces éléments peuvent être collectés et visualisés automatiquement avec Analyses TrueFoundry.

5. Quand héberger vous-même des LLM dans le cadre de votre solution de suivi des coûts

- Si votre organisation possède LLM previsible use and highest volume, les économies réalisées grâce aux modèles open source auto-hébergés peuvent être importantes.

- True Foundry passerelle LLM multicloud et auto-hébergés Deploiement Guides assurez-vous que la logique de surveillance, de gouvernance et de routage fonctionne de manière identique pour les API externes et vos clusters internes.

6. Meilleures pratiques pour les solutions de suivi des coûts LLM

- Centralisez tout le trafic d'inférence via une passerelle activée par l'observabilité.

- Automatisez le balisage et les alertes budgétaires pour la ventilation des coûts par poste par fonctionnalité, équipe ou flux de travail.

- Passez en revue et ajustez régulièrement les limites de débit et les politiques d'accès au fur et à mesure de l'évolution de votre modèle, de votre équipe et de votre combinaison de fonctionnalités.

- Surveiller et adresser risques de sécurité et de consommation incontrôlées, en particulier avec les modèles auto-hébergés ou à privilèges élevés.

- Utiliser prédiction par lots 3 et une validation rapide pour garantir une utilisation efficace des ressources et éviter les fuites de jetons.

Conclusion

Un moderne LLM Coûts Tracking Solution est bien plus qu'un simple reporting après coup, c'est un plan de contrôle stratégique pour chaque phase du déploiement de l'IA, de la gouvernance quotidienne à l'optimisation continue. En tirant parti des fonctionnalités complètes proposées par Passerelle IA de TrueFoundry, les équipes bénéficient d'une visibilité granulaire, d'un contrôle proactif des dépenses et d'un routage rentable pour chaque LLM qu'elles utilisent, que ce soit via une API ou des clusters auto-hébergés.

Pour une analyse technique approfondie étape par étape, voir :

- Présentation de TrueFoundry AI Gateway

- Architecture de passerelle complète

- Metadonnées balisage et attribution des coûts

- Analytic and observability

- Debit limitation

- Execution du budget

- Access control

- Garde-corps pour les instructions et l'utilisation des jetons

- Smart Charger Inquilibration and Smart Router

- Lots Prediction API

- Auto-accommodation Deploiements

- Réglage précis du LLM

Questions fréquemment posées

Qu'est-ce qu'une solution de suivi des coûts LLM ?

Une solution de suivi des coûts LLM est un plan de contrôle stratégique conçu pour surveiller, gérer et optimiser les dépenses uniques associées aux opérations du modèle linguistique étendu. Contrairement à l'infrastructure cloud traditionnelle, elle convient spécifiquement à la tarification basée sur les jetons, les charges d'inférence variables et les ressources gourmandes en calcul. Ces plateformes offrent une visibilité en temps réel sur les dépenses de plusieurs fournisseurs, modèles et équipes.

Pourquoi est-il important de suivre les coûts d'utilisation du LLM ?

Le suivi des coûts d'utilisation du LLM est essentiel car les dépenses liées à l'infrastructure d'Ia peuvent augmenter de façon exponentielle et silencieuse en raison de la tarification des jetons basée sur la consommation. Sans surveillance granulaire, les organisations sont confrontées à des dépassements budgétaires massifs, à une facturation mensuelle imprévisible et à un manque de responsabilité financière. Un suivi efficace garantit une croissance durable en liant chaque dollar dépensé à une valeur commerciale et à un retour sur investissement mesurables.

Quels sont les outils de suivi des coûts du LLM à prendre en compte ?

Il existe plusieurs outils et plateformes spécialisés qui dominent actuellement le marché en matière de gestion et de suivi des coûts du LLM. TrueFoundry propose une passerelle IA unifiée pour la gestion et la gouvernance des dépenses multimodèles. Parmi les autres solutions de premier plan, citons LitellM, qui fournit un proxy léger pour une visibilité des dépenses en temps réel, et Portkey, qui se concentre sur l'attribution détaillée des coûts pour les applications d'IA génératives.

Les plateformes LLMops fournissent-elles un suivi des coûts intégrés ?

Oui, la plupart des plateformes LLMops avancées intègrent nativement une solution de suivi des coûts LLM pour gérer le cycle de vie complet des modèles. Des plateformes telles que TrueFoundry et Weights & Biases capturent des données télémétriques détaillées dans les environnements de production, affichant les coûts des jetons ainsi que les indicateurs de performance. Cette intégration native permet aux développeurs d'optimiser à la fois la précision et l'efficacité financière au sein d'un flux de travail unique et unifié.

Comment une solution de suivi des coûts de LLM peut-elle m'avertir lorsque les dépenses de LLM dépassent un certain seuil ?

Les solutions de suivi des coûts LLM utilisent la surveillance en temps réel pour déclencher des notifications automatisées par e-mail, Slack ou webhooks lorsque l'utilisation atteint des pourcentages prédéfinis d'un budget. Ces systèmes peuvent être configurés avec des règles d'application automatisées qui limitent le trafic ou bloquent les demandes une fois qu'un plafond est atteint. Ces alertes proactives empêchent les charges de travail « excessives » et garantissent le maintien des garanties financières.

Qu'est-ce qui fait de TrueFoundry une solution idéale de suivi des coûts LLM ?

TrueFoundry est une solution idéale de suivi des coûts LLM, car elle combine l'attribution des coûts en temps réel avec un contexte approfondi basé sur des métadonnées. Il permet aux entreprises de définir une tarification personnalisée par modèle et de définir des seuils budgétaires granulaires pour des équipes, des projets ou des environnements spécifiques. Son AI Gateway optimise davantage les dépenses grâce à un routage intelligent, à une mise en cache sémantique et à des modèles de répli automatiques, garantissant ainsi des performances élevées au prix le plus bas possible.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)