Les 5 meilleures alternatives LiteLM pour les entreprises en 2026

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

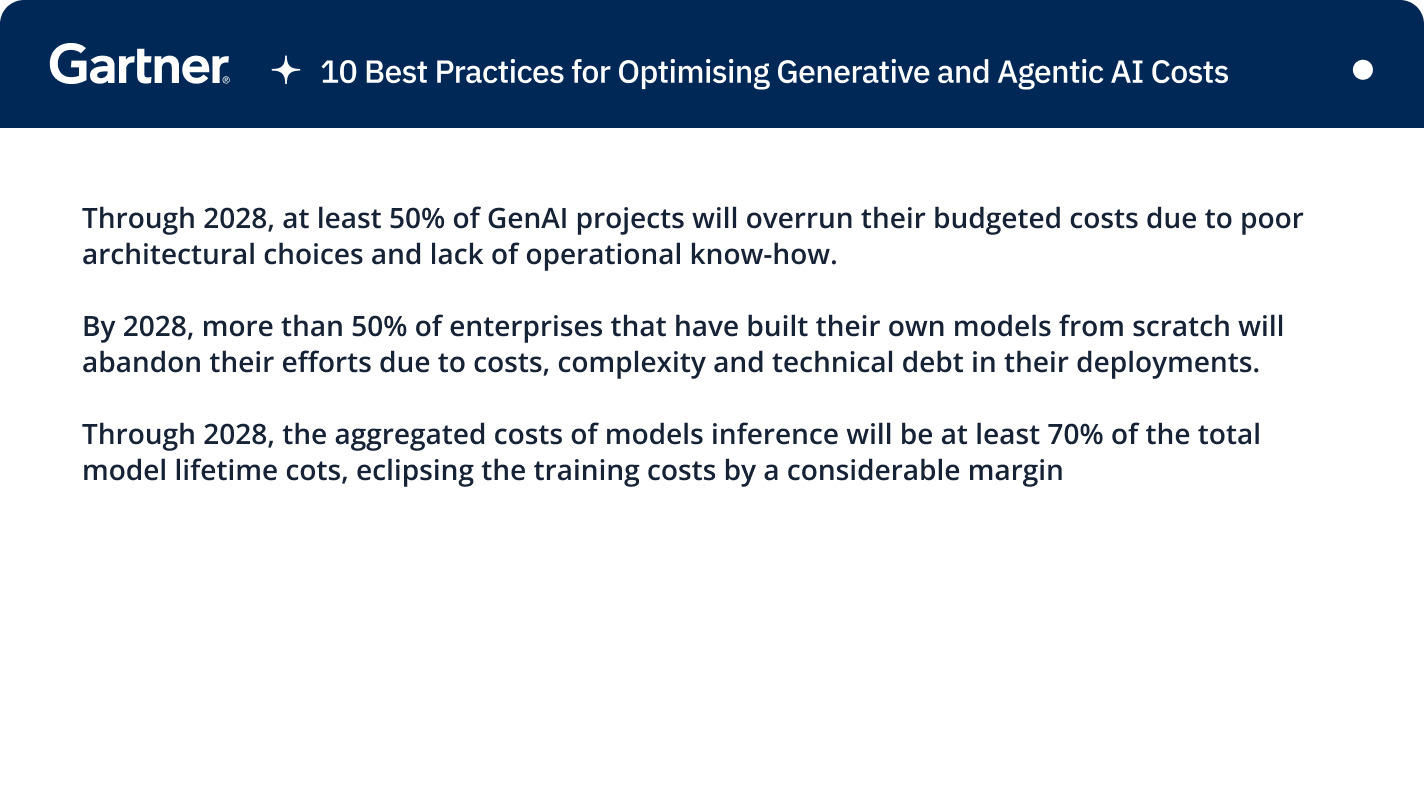

Alors que les grands modèles de langage (LLM) occupent une place de plus en plus importante dans les applications modernes, les développeurs recherchent en permanence des outils qui simplifient leur collaboration avec plusieurs fournisseurs de modèles. Que vous créiez avec OpenAI, Anthropic, Cohere ou des modèles open source tels que LLama et Mistral, la gestion de ces connexions de manière propre et évolutive peut rapidement devenir compliquée. Vous avez besoin de stratégies de routage, d'observabilité, de suivi des jetons et de basculement, le tout sans encombrer le code de votre application.

C'est là que LitellM a attiré l'attention. Il s'agit d'une couche d'abstraction basée sur Python qui offre une API unifiée entre les différents fournisseurs LLM. Il est léger, facile à connecter à votre application et vous permet de passer d'un modèle à l'autre avec un minimum d'effort. Pour les projets en phase de démarrage et les petites équipes, il s'agit d'un point de départ pratique.

Cependant, à mesure que les applications arrivent à maturité et que les charges de travail augmentent, les limites de LiteLM peuvent devenir plus visibles. Certaines équipes vont au-delà de sa simplicité et commencent à rechercher des plateformes offrant des informations plus approfondies, un meilleur contrôle de l'infrastructure et des fonctionnalités plus avancées.

L'une des préoccupations courantes que nous avons régulièrement entendues de la part des développeurs est que Litellm a introduit une latence notable. Vous pouvez voir les résultats de l'analyse comparative ici.

True Foundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une évolutivité intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

LiteLM est un excellent outil pour démarrer avec le routage multimodèle. Il fait le résumé de différents fournisseurs de LLM tels qu'OpenAI, Anthropic, Cohere, etc., ce qui facilite le prototypage des flux de travail des agents avec une interface unique.

Cependant, lorsque l'on passe du développement local à des cas d'utilisation destinés aux entreprises, plusieurs défis critiques apparaissent :

Dans cet article, nous allons expliquer ce que LitellM fait bien et ce qui pourrait ne pas être le cas. Ensuite, nous explorerons cinq puissantes alternatives offrant des capacités plus étendues. Que vous recherchiez plus de contrôle, une observabilité plus approfondie ou une meilleure évolutivité, ces outils peuvent vous aider à trouver la solution la mieux adaptée à vos besoins croissants en matière d'infrastructure GenAI.

What is LiteLM ?

LiteLM est une bibliothèque Python open source qui fournit une API simple et unifiée pour interagir avec plusieurs fournisseurs de grands modèles de langage (LLM). Son objectif principal est d'éliminer les différences entre les fournisseurs tels que OpenAI, Anthropic, Cohere, Hugging Face et d'autres afin que les développeurs puissent passer de l'un à l'autre sans avoir à réécrire le code. Quelques modifications de configuration suffisent pour tester, comparer ou changer de modèle tout en préservant la cohérence de la logique de votre application.

Il est particulièrement utile pour les équipes qui expérimentent différents modèles ou créent des applications basées sur LLM qui peuvent avoir besoin de flexibilité pour acheminer les demandes entre les fournisseurs.

Caractéristiques principales :

- API unifiée pour plusieurs LLM à l'aide du format compatible OpenAI

- Changez facilement de modèle grâce à la configuration

- Mode serveur proxy pour la journalisation, la limitation du débit et la mise en cache de base

- Suivi de l'utilisation des jetons et prise en charge de la gestion des clés d'API

- Open source et simple à intégrer dans n'importe quel backend Python

Tarification : LitellM lui-même est totalement gratuit et open source. Comme il n'héberge ni ne propose de modèles directement, vous ne payez que pour l'utilisation des fournisseurs LLM sous-jacents (comme OpenAI ou Anthropic). Il n'y a pas de frais de licence pour utiliser LiteLLM.

Difficultés : Bien que LitellM soit idéal pour les intégrations rapides et le prototypage, il peut ne pas convenir aux applications de production. Il manque d'observabilité avancée, de contrôles de sécurité, de pistes d'audit et de fonctionnalités d'entreprise telles que le suivi des performances des modèles ou l'assistance au réglage fin. Il existe également un support intégré limité pour le déploiement de modèles auto-hébergés ou open source, dont certaines équipes peuvent avoir besoin au fur et à mesure de leur évolution. À mesure que les équipes évoluent, comprendre Licences LLM devient également important, en particulier lorsque vous mélangez des API commerciales avec des modèles open source qui peuvent comporter différentes restrictions d'utilisation. Il s'agit d'une puissante couche d'abstraction, mais pas d'une plate-forme d'infrastructure à part entière.

1. High Latence Surcharge

L'une des préoccupations les plus citées concernant LitellM est la latence importante qu'il introduit, en particulier lorsqu'il agit en tant que proxy pour des fournisseurs LLM externes tels qu'OpenAI, Anthropic ou Cohere. Dans les tests de performance, cette surcharge de latence devient un goulot d'étranglement pour les applications en temps réel telles que les agents de chat, les assistants vocaux et les outils de support client basés sur l'IA. Le délai supplémentaire l'emporte souvent sur les avantages de son abstraction, en particulier lorsqu'il est utilisé dans des boucles d'agents où plusieurs appels LLM sont enchaînés.

2. Difficile à déployer dans les environnements d'entreprise

La légèreté de LiteLM le rend attrayant pour les cas d'utilisation simples, mais son déploiement dans des environnements professionnels, tels que des serveurs sur site, des VPC sécurisés ou des clusters Kubernetes, nécessite un échafaudage manuel important. Il n'existe pas de support intégré pour les problèmes au niveau de la plate-forme tels que la découverte de services, la mise à l'échelle automatique, la journalisation centralisée ou la configuration sécurisée. Par conséquent, les équipes des secteurs réglementés ou ayant des besoins de conformité stricts ont du mal à adopter et à opérationnaliser LitellM en production.

3. Absence de support au niveau de l'entreprise et de contrats de niveau de service

LitellM est un projet open source sans soutien commercial formel, ce qui signifie qu'il n'y a pas de plan de support d'entreprise, pas de SLA pour la disponibilité et aucune voie d'escalade dédiée. Cela en fait une dépendance risquée pour les charges de travail d'IA critiques, où la fiabilité, la responsabilité et un support proactif sont essentiels. Les équipes qui construisent des systèmes de production ont besoin de garanties et de structures de support que LitellM ne propose pas actuellement.

4. Sujette aux bogues à grande échelle

En raison de son cycle de développement rapide et de sa nature axée sur la communauté, LitellM peut être instable lorsqu'il est utilisé à grande échelle. Les utilisateurs ont signalé de fréquentes régressions entre les versions, des bogues marginaux et un comportement incohérent dans des scénarios simultanés ou multi-locataires. En l'absence de pipelines de tests rigoureux ou de garanties de rétrocompatibilité, le déploiement de LitelTM dans des systèmes à grande échelle entraîne souvent des problèmes de production imprévisibles.

5. Fonctionnalités limitées au-delà du proxy d'API

Bien que LiteLM simplifie la tâche de routage des appels d'API entre plusieurs fournisseurs LLM, il ne fait guère plus que cela. Il ne prend pas en charge l'hébergement de modèles open source, l'ajustement des flux de travail, l'observabilité telle que le traçage des agents, la gouvernance multi-tenant ou l'intégration d'outils d'agent, des fonctionnalités souvent requises par les entreprises déployant des LLM à grande échelle. Les équipes à la recherche d'une plateforme GenAI unifiée trouveront que la portée de LitellM est trop limitée, les obligeant à développer ou à exploiter elles-mêmes ces fonctionnalités manquantes.

6. Idéal pour le prototypage, pas pour la production

LiteLM convient parfaitement aux développeurs qui ont besoin de tester rapidement différentes API LLM ou de prototyper de nouvelles idées. Cependant, au moment où ces prototypes doivent passer à la phase de production, notamment en termes d'observabilité, de sécurité et de fiabilité, ils commencent à échouer. La gestion manuelle des clés d'API, des quotas d'utilisation, des mesures de latence et de la logique de routage devient une charge qui ne s'adapte pas à l'augmentation des charges de travail ou aux besoins des équipes.

Read also : Kong contre LiteLM

Comment fonctionne LiteLM ?

LiteLM fonctionne en se situant entre votre application et plusieurs fournisseurs de grands modèles linguistiques (LLM), agissant comme une couche d'abstraction légère. Au lieu d'appeler directement OpenAI, Anthropic ou d'autres API LLM, vous envoyez vos demandes via LiteLM, qui les transmet ensuite au fournisseur sélectionné en utilisant un format d'API cohérent. Cette conception vous permet d'écrire votre application une seule fois et d'échanger des LLM en arrière-plan sans apporter de modifications majeures à votre base de code.

La bibliothèque est conçue pour imiter le format populaire d'API OpenAI, donc si votre application utilise déjà OpenAI chat/complétions ou réalisations points de terminaison, vous pouvez brancher LiteLM avec un minimum de refactorisation. Vous pouvez changer de fournisseur simplement en mettant à jour les variables d'environnement ou les fichiers de configuration, ce qui en fait la solution idéale pour tester différents modèles ou équilibrer performances et coûts.

En plus de sa couche d'abstraction centrale, LiteLM prend également en charge un mode proxy. Dans cette configuration, LiteLM s'exécute en tant que serveur local ou hébergé qui gère les appels d'API LLM pour votre application. Ce proxy offre des fonctionnalités supplémentaires, telles que :

- Journalisation : Capture et stockage des demandes, des réponses et des métadonnées à des fins de débogage et d'analyse

- Debit Limitation : Empêchez la surutilisation des jetons ou le dépassement des limites tarifaires des fournisseurs, c'est pourquoi limitation de débit dans la passerelle AI become critique for the fiability of the production.

- Basic Cache : Évitez les appels répétés en mémorisant les réponses précédentes

- Suivi de l'utilisation des jetons : Surveillez le nombre de jetons consommés par chaque demande

- Solution de réponse pour les fournisseurs : Configurez une logique simple pour revenir à un autre modèle en cas d'échec

Le mode proxy de LitellM est particulièrement utile dans les environnements de développement et de préparation où les équipes ont besoin de visibilité sur le comportement des modèles sans ajouter d'infrastructure lourde.

Dans les coulisses, LiteLM utilise Python demandes library for send and receive of API call. Il prend en charge les appels synchrones et asynchrones et inclut des hooks pour la journalisation personnalisée, la rotation des touches et la gestion des demandes. L'architecture est volontairement légère, avec un minimum de dépendances et met clairement l'accent sur l'expérience des développeurs.

Bien que LiteLM ne soit pas conçu pour gérer le routage de modèles complexes à grande échelle, il permet aux équipes de travailler facilement avec plusieurs fournisseurs et réduit considérablement le temps d'intégration. Pour de nombreuses applications ou expériences à un stade précoce, cela élimine les difficultés liées généralement à la gestion des différentes API LLM.

Les 5 meilleures alternatives LiteLM de 2026

Les développeurs qui recherchent des alternatives à LiteLM comparent également souvent plus directement les couches d'abstraction et les outils de routage. Par exemple, les discussions autour de LiteLM et OpenRouter se concentrent généralement sur les différences en termes de couverture des fournisseurs, de temps de latence, de comportement de mise en cache et de préparation à la production. Bien que les deux visent à simplifier l'accès multimodèle, les équipes d'entreprise ont souvent besoin de capacités d'observabilité, de gouvernance et de mise à l'échelle plus approfondies que celles fournies par les wrappers légers.

Bien que LiteLM soit une couche d'abstraction utile pour travailler avec plusieurs fournisseurs de LLM, il ne peut pas offrir tout ce dont les équipes ont besoin lorsqu'elles passent à la production ou gèrent des charges de travail plus complexes. Si vous souhaitez améliorer l'observabilité, l'orchestration des modèles, le contrôle du trafic ou la gestion des API, d'autres plateformes proposent des fonctionnalités plus robustes. Ces alternatives peuvent mieux prendre en charge la mise à l'échelle, la personnalisation et la fiabilité à long terme des applications GenAI.

Voici les cinq meilleures solutions à envisager en 2026 :

- True Foundry

- Hélicone

- Port Key

- Eden AI

- Kong AI

1. True Foundry

True Foundry est une alternative puissante à LiteLM pour les équipes qui ont besoin de bien plus qu'une simple abstraction de modèles. Alors que LiteLM est excellent pour unifier les API entre les fournisseurs de LLM, TrueFoundry est conçu pour les équipes qui souhaitent exécuter des LLM en production, en s'appuyant sur une infrastructure robuste, une observabilité et un contrôle total sur la façon dont les modèles sont déployés et mis à l'échelle.

TrueFoundry inclut une passerelle LLM intégrée, mais elle ne s'arrête pas au routage. Vous pouvez héberger, affiner et diffuser des modèles open source tels que Mistral ou LLama sur votre propre cloud ou sur site. Cela donne aux équipes plus de flexibilité et de contrôle des données que LiteLM, qui repose entièrement sur des API tierces.

Contrairement au proxy léger de LiteLM, TrueFoundry propose un système entièrement géré intégrant le routage du trafic, la gestion des solutions de secours, le versionnage rapide, l'analyse des coûts et l'observabilité. Il fonctionne avec des fournisseurs tels qu'OpenAI, Anthropic et Hugging Face, mais prend également en charge les modèles auto-hébergés utilisant vLLM et TGI. Cela signifie que vous pouvez commencer par des modèles basés sur des API et passer progressivement à l'hébergement de votre propre site, sans modifier votre intégration.

Comme il s'exécute sur votre infrastructure Kubernetes, TrueFoundry offre également un niveau de sécurité et de conformité pour lequel LitellM n'est tout simplement pas conçu. Vous évitez les coûts de sortie, conservez la pleine propriété des données et pouvez facilement appliquer les politiques de gouvernance internes.

Caractéristiques principales :

- Passerelle LLM prête pour la production avec prise en charge des modèles hébergés et auto-hébergés.

- Outils complets et rapides de contrôle des versions, de restauration et de test des performances.

- Support multicloud et sur site avec intégration complète de Kubernetes.

- Optimisation des flux de travail pour les modèles open source.

- Surveillance de l'utilisation des jetons, de la latence et des coûts au niveau de la demande.

Pourquoi c'est la meilleure alternative à LiteLM :

LiteLM simplifie le développement, mais TrueFoundry permet l'évolutivité. Il est idéal pour les équipes qui vont au-delà de l'expérimentation et passent à la production, en particulier celles qui souhaitent conserver une certaine flexibilité quant à l'emplacement et à la manière dont leurs modèles fonctionnent. Si vous êtes prêt à créer des systèmes GenAI sérieusement dotés d'observabilité, de contrôle du déploiement et d'optimisation des performances, TrueFoundry offre ce qui manque à LiteLM dès le départ.

Pour plus de détails, consultez notre documentation.

2. Hélicone

Helicone est une couche d'observabilité open source spécialement conçue pour les équipes travaillant avec de grands modèles linguistiques. Alors que Litellm se concentre sur le routage et l'unification de l'accès à plusieurs fournisseurs, Helicone résout un défi différent mais tout aussi important : la visibilité. Il permet aux développeurs de suivre chaque demande LLM en détail afin de comprendre, de déboguer et d'optimiser l'utilisation des modèles à mesure que les applications évoluent.

Helicone fonctionne en se situant entre votre candidature et votre fournisseur de LLM. Au lieu d'appeler directement OpenAI ou Anthropic, vous envoyez vos appels d'API via le proxy d'Helicone. À partir de là, il capture de riches métadonnées relatives à chaque demande, notamment la latence, la saisie rapide, la sortie de réponse, l'utilisation des jetons, les taux d'erreur et les coûts estimés. Ces données sont ensuite affichées dans un tableau de bord épuré et convivial pour les développeurs.

Contrairement à LiteLM, qui élimine les différences entre les modèles et facilite le changement de fournisseur, Helicone est idéal pour les équipes qui sont déjà liées à un ou plusieurs fournisseurs mais souhaitent plus de transparence. Il est particulièrement utile lorsque la rapidité, le comportement des utilisateurs et la cohérence des performances sont importants.

Helicone prend également en charge l'auto-hébergement, ce qui donne aux équipes un contrôle total sur les journaux et la conservation des données. Il s'intègre facilement à la plupart des piles GenAI basées sur Python et réduit au minimum les frais de configuration.

Caractéristiques principales :

- Enregistrement en temps réel des mesures relatives aux demandes, aux réponses et aux jetons

- Tableaux de bord intégrés pour le suivi des coûts, de la latence et des erreurs

- Intégration facile avec OpenAI, Anthropic et d'autres API

- Auto-hébergable architecture axée sur la confidentialité

- Léger et facile à installer

Why is a alternative to LiteLM :

Helicone ne remplace pas la logique de routage de LitellM, mais il peut s'agir d'un solide compagnon, ou d'une alternative si votre priorité passe de l'abstraction du modèle à la surveillance. Si vous utilisez un ou deux modèles principaux et que vous avez besoin d'informations plus approfondies sur leur comportement en production, Helicone offre une visibilité qui fait actuellement défaut à LitellM. Il s'agit d'un outil ciblé qui apporte une réelle valeur ajoutée aux équipes qui souhaitent déboguer et affiner leur utilisation du LLM à grande échelle.

3. Port Key

Portkey est une couche d'infrastructure LLM conçue pour aider les développeurs à gérer les appels d'API entre plusieurs fournisseurs de modèles linguistiques avec une plus grande fiabilité. Comme LitellM, il propose une interface unifiée pour se connecter aux modèles d'OpenAI, d'Anthropic, de Mistral et d'autres. Mais là où LitellM met l'accent sur la simplicité, Portkey est conçu pour les environnements de production qui nécessitent une résilience et un contrôle accrus.

Il a introduit des fonctionnalités telles que les nouvelles tentatives automatiques, la mise en cache, les délais d'expiration des demandes et le routage de secours. Cela permet de maintenir plus facilement la stabilité des applications GenAI, même lorsque les fournisseurs sont confrontés à des temps de latence ou à des temps d'arrêt. Portkey prend également en charge le suivi des coûts et des jetons par demande, aidant ainsi les équipes à optimiser l'utilisation de manière plus efficace que le suivi minimal de LitellM.

Portkey peut être déployé dans le cloud ou auto-hébergé et convient parfaitement aux équipes qui recherchent une couche de fiabilité légère sans créer leur propre logique de nouvelle tentative et de routage à partir de zéro.

Caractéristiques principales :

- Routage multifournisseur avec logique de repli et de nouvelle tentative

- Mise en cache, délais d'expiration et limitation de débit

- Suivi en temps réel des coûts et de l'utilisation des jetons

- Point de terminaison proxy compatible avec OpenAI

- Deploiement auto-hébergable ou géré

Why is a alternative to LiteLM :

Portkey est une bonne avancée dans Portkey contre LiteLM des comparaisons lorsque vos appels LLM nécessitent plus qu'une simple abstraction. Il apporte robustesse et observabilité de base, ce qui le rend idéal pour les équipes qui passent de l'expérimentation à la production, où la disponibilité et la rentabilité commencent à être importantes.

Discover also : Les 5 meilleurs Alternatives à Portkey

4. Eden AI

Eden AI est une place de marché d'API qui permet aux développeurs d'accéder à plusieurs services d'IA, tels que les modèles linguistiques, l'OCR, la traduction et la synthèse vocale, via une seule API unifiée. Alors que LiteLM se concentre exclusivement sur les fournisseurs de LLM abstraits, Eden AI adopte une approche plus large, permettant de combiner facilement les services de différents fournisseurs sans gérer des intégrations distinctes.

Pour les LLM, il prend en charge des fournisseurs tels que OpenAI, Cohere et DeepAI et permet le routage en fonction des prix, de la vitesse ou de la disponibilité. Il est particulièrement utile pour les équipes qui créent des applications d'IA multimodales qui souhaitent une solution prête à l'emploi avec un minimum de configuration.

Caractéristiques principales :

- API unifiée pour plusieurs fournisseurs d'IA selon les modalités

- Supporte les LLM, la synthèse vocale, la traduction, l'analyse d'images, etc.

- Analyse comparative des fournisseurs en termes de performances et de prix

- Analyse de l'utilisation et de la facturation en temps réel

- Interface No-Code pour tester et évaluer les API

Why is a alternative to LiteLM :

Si vous recherchez un moyen simple de vous connecter aux LLM et à d'autres services d'IA sans gérer plusieurs API, Eden AI est une option pratique. Bien qu'il ne soit pas aussi centré sur les développeurs que LitellM, il est idéal pour les équipes qui souhaitent disposer d'une gamme plus large d'outils d'IA via une seule interface.

5. Kong AI

Kong AI est une extension du populaire Kong Gateway, conçue pour prendre en charge la gestion des API pour les charges de travail d'IA, y compris les grands modèles de langage. Alors que LiteLM se concentre sur l'abstraction des API LLM au niveau de l'application, Kong AI propose des fonctionnalités de passerelle API de niveau entreprise telles que le contrôle du trafic, l'authentification, la limitation du débit et l'observabilité, adaptées aux services d'IA.

Kong AI permet aux organisations de gérer l'accès à plusieurs fournisseurs de LLM de manière sécurisée et fiable. Il ne fournit pas de syntaxe LLM unifiée comme LitellM, mais il aide les équipes à appliquer la gouvernance, à surveiller le trafic et à intégrer les appels LLM dans de plus grands écosystèmes d'API. Pour les entreprises qui utilisent déjà Kong pour les API traditionnelles, l'étendre aux LLM peut être une solution naturelle.

Kong prend également en charge des plugins et des intégrations avec des outils tels que Prometheus et OpenTelemetry, ce qui permet aux équipes de mieux comprendre le comportement au niveau des demandes et les performances du système.

Caractéristiques principales :

- Extensions spécifiques à l'IA pour Kong Gateway.

- Authentification des demandes, limitation du débit et gestion des clés d'API.

- Mise en forme du trafic, nouvelles tentatives et coupure de circuit.

- Intégration avec des outils d'observabilité tels que Grafana et Prometheus.

- Fonctionne à la fois avec les API LLM basées sur le cloud et auto-hébergées.

Why is a alternative to LiteLM :

Kong AI convient parfaitement aux équipes axées sur la sécurité, l'évolutivité et la gouvernance. Il ne s'agit pas d'une couche d'abstraction de modèle mais d'une puissante option d'infrastructure pour gérer le trafic LLM dans les environnements de production.

Pour les équipes qui évaluent un Kong alternative spécifiquement axée sur les charges de travail GenAI, Kong AI s'impose comme une option solide lorsque la gouvernance, le contrôle du trafic et la sécurité de l'entreprise sont plus importants que l'abstraction du modèle.

Read also : Comparaison entre Bifrost et LiteLM

Conclusion

LiteLM est un excellent point de départ pour les développeurs qui recherchent un moyen simple d'intégrer plusieurs LLM, mais à mesure que les projets se développent, les besoins en infrastructure deviennent de plus en plus complexes. Qu'il s'agit d'une meilleure observabilité, d'un routage au niveau de la production ou d'un contrôle plus strict du trafic et de l'utilisation, des alternatives telles que TrueFoundry, Helicone, Portkey, Eden AI et Kong AI proposent des solutions plus personnalisées pour faire évoluer les applications GenAI. Le bon choix dépend de vos objectifs, qu'il s'agit d'optimiser la flexibilité, la fiabilité ou une sécurité de niveau professionnel. À mesure que l'écosystème GenAI arrive à maturité, il vaut la peine d'évaluer des plateformes adaptées à la manière dont vous créez, surveillez et développez vos produits alimentés par LLM.

Questions fréquemment posées

Quelles sont les meilleures alternatives LiteLM en 2026 ?

Alors que des outils tels que Portkey et Helicone offrent des fonctionnalités de passerelle, TrueFoundry se distingue comme la première alternative LiteLM pour les besoins de haute performance. Contrairement à LiteLM, qui peut introduire une latence importante, la passerelle AI de TrueFoundry fonctionne avec une surcharge minimale d'environ 3 à 4 ms et gère plus de 350 RPS sur un seul processeur virtuel. Il associe cette vitesse à une fiabilité de niveau professionnel, ce qui en fait le choix idéal pour les équipes qui doivent passer du simple prototypage à des applications LLM robustes et prêtes pour la production.

Pourquoi les équipes recherchent-elles des alternatives à LiteLM ?

Les équipes recherchent souvent des alternatives à LiteLM lorsque leurs applications arrivent à maturité et que les performances deviennent critiques. Les principaux facteurs sont les frais de latence élevés, qui ont un impact sur l'expérience utilisateur en temps réel, et l'absence de SLA formels ou de support d'entreprise. En outre, les développeurs trouvent que le déploiement de LiteLLM dans des environnements sécurisés, sur site ou VPC est difficile. Des alternatives telles que TrueFoundry comble ces lacunes en offrant une latence extrêmement faible, une garantie de disponibilité et des options de déploiement fluides pour les infrastructures d'entreprise complexes.

LiteLM convient-il à une utilisation en production ?

LitellM est excellent pour le prototypage rapide et le développement à un stade précoce, mais il rencontre souvent des difficultés dans les environnements de production. Sa nature axée sur la communauté signifie qu'il ne dispose pas de la stabilité, des tests rigoureux et des garanties de support requises pour les applications critiques. Pour les charges de travail de production, les équipes préfèrent des plateformes telles que TrueFoundry, qui offrent une gouvernance intégrée, des performances prévisibles et la capacité de gérer une simultanéité élevée sans risque de régressions ou de temps d'arrêt non gérés.

Quelle alternative LiteLM convient le mieux aux charges de travail des entreprises ?

TrueFoundry est le meilleur choix pour les charges de travail d'entreprise. Il va au-delà du simple proxy d'API pour proposer un système d'exploitation LLM complet. Les entreprises bénéficient de fonctionnalités telles que la gestion centralisée des clés, le suivi des coûts et le routage basé sur la latence, le tout soutenu par un support d'entreprise et des SLA. TrueFoundry simplifie également la conformité en conservant les données dans votre région et en s'intégrant parfaitement aux clusters Kubernetes existants, garantissant ainsi la sécurité, l'évolutivité et la préparation de votre infrastructure aux audits.

Les alternatives LiteLM peuvent-elles prendre en charge les modèles auto-hébergés ?

Oui, LiteLM Alternatives prend en charge les modèles auto-hébergés, ce qui constitue un facteur de différenciation clé. Alors que LiteLM se concentre principalement sur le proxy d'API externes, les alternatives avancées de LiteLM telles que TrueFoundry prennent en charge à la fois des propriétaires d'API (comme OpenAI) et des modèles open source auto-hébergés (comme Llama ou Mistral). TrueFoundry gère la complexité du déploiement de ces modèles sur votre propre infrastructure, que ce soit sur site ou dans le cloud, vous donnant un contrôle total sur vos données et vos calculs tout en conservant une interface unifiée pour toutes vos interactions LLM.

Les alternatives LiteLM sont-elles open source ?

De nombreuses alternatives, y compris LiteLM lui-même, sont open source. Cependant, les outils open source ne disposent souvent pas du support dédié et des garanties de stabilité nécessaires aux applications commerciales à grande échelle. Les plateformes telles que TrueFoundry offrent le meilleur des deux mondes : elles offrent la flexibilité et l'extensibilité que les développeurs adorent, associées à la fiabilité, aux fonctionnalités de sécurité et à l'assistance 24 h/24 et 7 j/7 que les entreprises exigent. Cela vous permet de ne pas être laissé à résoudre vous-même les problèmes d'infrastructure critiques.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)