LangChain contre LangGraph : lequel vous convient le mieux ?

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

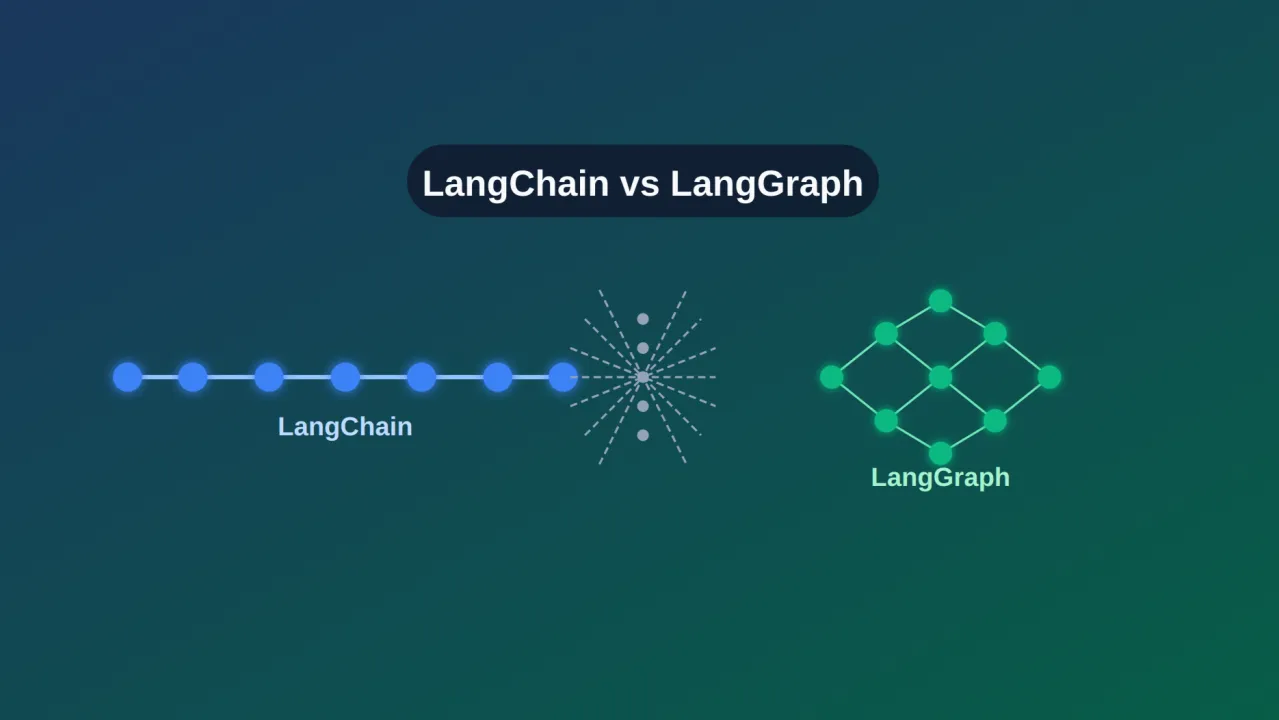

Lorsqu'il s'agit de créer des applications basées sur de grands modèles de langage (LLM), les développeurs ont désormais plus de choix que jamais. LangChain et LangGraph sont deux des frameworks dont on parle le plus. Bien que les deux visent à simplifier le processus de connexion des LLM aux outils, aux données et aux flux de travail, ils adoptent des approches très différentes. LangChain est rapidement devenue l'une des bibliothèques les plus populaires pour créer des applications pilotées par l'IA, offrant un vaste écosystème d'intégrations et d'abstractions. D'autre part, LangGraph, construit sur Langchain, se concentre sur des systèmes à états de type agent, utilisant un modèle d'exécution basé sur des graphes pour gérer des raisonnements complexes et des interactions en plusieurs étapes.

Si vous essayez de choisir entre LangChain et LangGraph, il est important de comprendre leurs forces, leurs limites et leurs cas d'utilisation idéaux. Cette comparaison vous aidera à déterminer quel framework convient le mieux à votre projet, qu'il s'agisse de créer des applications LLM simples, des agents d'IA robustes ou des solutions d'entreprise évolutives.

Qu'est-ce que LangChain ?

Chaîne Lang est un framework open source pour la conception d'applications d'IA basées sur LLM. Il propose aux développeurs une bibliothèque de composants modulaires en Python et JavaScript qui connectent les modèles de langage à des outils externes et à des sources de données, tout en offrant une interface cohérente pour les chaînes de tâches, la gestion rapide et la gestion de la mémoire.

LangChain fait le pont entre les fonctionnalités LLM brutes et les fonctionnalités du monde réel. Il aide les développeurs à créer des flux de travail appelés « chaînes », dans lesquels chaque étape consiste à générer du texte, à interroger une base de données, à récupérer des documents ou à invoquer des API externes, le tout dans une séquence logique. Cette structure modulaire accélère non seulement le prototypage, mais favorise également la clarté et la réutilisation, ce qui est utile que vous créiez des chatbots, résumiez des documents, génériez du contenu ou automatisiez des flux de travail

Lancé à l'origine en octobre 2022, LangChain a rapidement évolué pour devenir un projet dynamique axé sur la communauté. Il a depuis été adopté par des centaines d'intégrations d'outils et de fournisseurs de modèles, permettant de basculer facilement entre OpenAI, Hugging Face, Anthropic, IBM Watsonx, etc. LangChain offre un moyen élégant et structuré d'intégrer des modèles de langage à des applications pratiques. Il fait abstraction de la complexité, amplifie la flexibilité et rationalise le développement, ce qui en fait un choix incontournable pour les équipes qui créent des systèmes performants basés sur LLM.

Fonctionnalité de base de LangChain

LangChain est conçu pour simplifier la création d'applications basées sur LLM grâce à des flux de travail linéaires étape par étape. Ses fonctionnalités de base sont les suivantes :

- Enchaînement rapide : Combinez plusieurs instructions dans une séquence, où le résultat d'une étape alimente la suivante.

- Gestion de la mémoire : Conservez le contexte à court terme, tel que l'historique des conversations, à l'aide de composants de mémoire modulaires.

- Intégration des documents et des données : Chargez, fractionnez et récupérez des informations à partir de PDF, de pages Web et de bases de données vectorielles.

- Intégration du LLM et de l'API : Connectez-vous facilement à plusieurs fournisseurs LLM, API et outils externes.

- Prototypage rapide : Assemblez rapidement les chaînes à des fins de test et d'expérimentation sans configuration complexe.

- Gestion des flux de travail : Supporte le branchement simple et l'exécution séquentielle des tâches, ce qui est idéal pour la synthèse, la réponse à des questions ou la génération de contenu.

Qu'est-ce que LangGraph ?

LangGraph est un framework open source de l'équipe LangChain qui aide les développeurs à créer des flux de travail d'agents d'IA plus intelligents et plus adaptables. Au lieu d'exécuter les tâches en ligne droite comme une chaîne traditionnelle, LangGraph les organise dans un graphique, où chaque « nœud » représente une tâche et les « bords » définissent la manière dont ces tâches sont connectées. Cette conception permet de créer des flux capables de se ramifier, de boucler et de conserver leur état, ce qui donne aux agents la flexibilité nécessaire pour gérer des scénarios plus complexes.

L'un des principaux atouts de LangGraph est qu'il prend en charge les agents de longue date conscients de l'État. Si un agent rencontre une erreur ou doit faire une pause, il peut reprendre exactement là où il s'est arrêté. Vous pouvez également intégrer des points de contrôle humains, afin qu'une personne puisse revoir ou ajuster une action avant que l'agent n'aille de l'avant. En outre, LangGraph peut mémoriser les interactions passées et le contexte au fil du temps, ce qui est essentiel pour créer des agents capables d'apprendre et de s'adapter.

Il est également doté de solides caractéristiques de production. Les développeurs peuvent surveiller les flux de travail à l'aide d'outils tels que LangSmith, qui fournissent un débogage visuel, des journaux détaillés et une visibilité complète sur la manière dont un agent prend des décisions. LangGraph peut fonctionner localement ou être déployé sur des plateformes gérées telles que LangGraph Platform et Studio. LangGraph est conçu dans un souci de fiabilité, de flexibilité et de transparence, ce qui en fait un choix judicieux pour les systèmes d'IA complexes qui vont au-delà de la simple automatisation étape par étape.

Fonctionnalité de base de LangGraph

LangGraph est conçu pour les flux de travail dynamiques, dynamiques et multi-agents, offrant des fonctionnalités qui vont au-delà de l'exécution linéaire des tâches. Ses fonctionnalités de base sont les suivantes :

- Gestion des flux de travail basée sur des graphiques : Créez des flux de travail complexes avec des boucles, des branchements et la révision des états précédents.

- Gestion explicite de l'état : Contrôle total de l'état du flux de travail, permettant des processus de longue durée, des nouvelles tentatives et un suivi des décisions en plusieurs étapes.

- Orchestration multi-agents : Coordonnez plusieurs agents d'IA, chacun ayant des rôles spécialisés, au sein d'un seul flux de travail connecté.

- Exécution adaptative : Gérez les entrées dynamiques, les chemins conditionnels et les scénarios alternatifs sans interrompre le flux.

- Intégration et surveillance : Des outils tels que LangGraph Studio et LangSmith permettent le débogage, la journalisation et la visualisation en temps réel des flux de travail des agents.

- Gestion résiliente des tâches : Supporte la restauration des erreurs, les nouvelles tentatives et les points de contrôle pour des applications robustes et prêtes pour la production.

Maintenant que nous avons abordé les bases de LangGraph et LangChain. Examinons en profondeur la différence entre LangChain et LangGraph.

LangChain et LangGraph

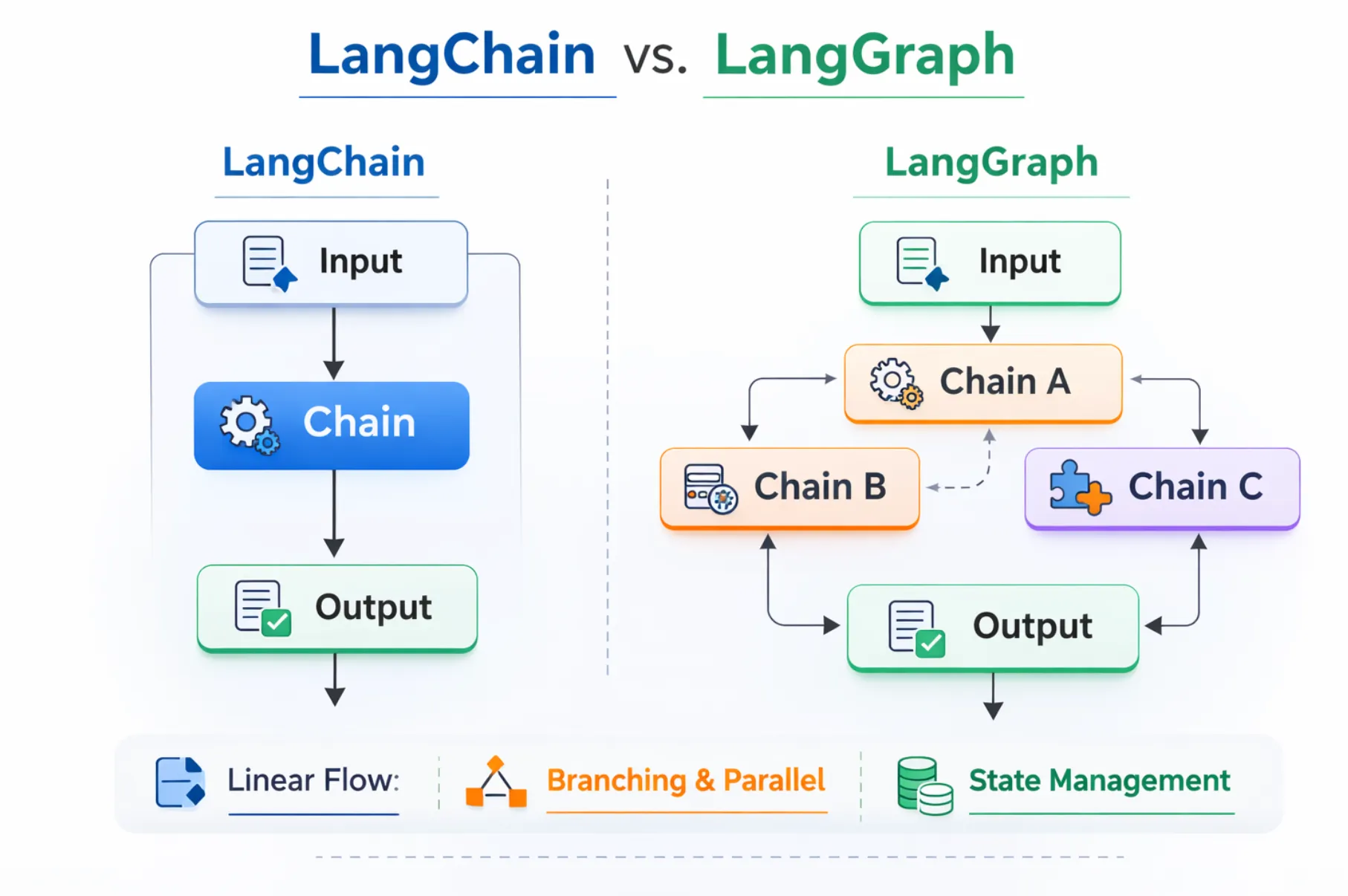

LangChain est conçu pour rendre les flux de travail complexes alimentés par LLM simples et intuitifs. Il excelle lorsque vos tâches suivent un schéma séquentiel prévisible, en récupérant des données, en les résumant, en répondant à des questions, etc. Sa conception modulaire propose des éléments de construction prêts à l'emploi tels que des chaînes, de la mémoire, des agents et des outils, ce qui permet d'accélérer le prototypage et de simplifier le codage. Si vous souhaitez créer rapidement un flux de travail qui suit un chemin connu, LangChain est votre solution de choix.

D'autre part, LangGraph vous offre puissance et flexibilité là où les choses commencent à se casser ou à tourner en boucle. Au lieu de séquences linéaires, vous concevez des flux de travail basés sur des graphes avec des nœuds, des arêtes, un état explicite, des nouvelles tentatives, une logique de branchement et même des points de contrôle humains dans la boucle. Il se distingue lorsque votre application doit s'adapter, revenir en arrière, mettre en boucle ou mémoriser un contexte de longue durée, qu'il s'agisse d'agents en plusieurs étapes, d'arbres de décision complexes ou d'assistants virtuels qui doivent raisonner au fil du temps.

Explication de la comparaison des principales fonctionnalités

flux de travail

- Chaîne Lang : Fonctionne mieux avec des séquences linéaires ou de simples DAG (graphes acycliques dirigés). Idéal pour les tâches étape par étape où le résultat d'une étape alimente directement la suivante.

- LangGraph : Conçu pour des flux de travail complets basés sur des graphiques, prenant en charge les boucles, les branchements et la révision des états précédents. Parfait pour les processus adaptatifs ou itératifs.

Gestion de l'État

- Chaîne Lang : Gère l'état implicitement, ce qui signifie que la mémoire ou le contexte sont conservés via des modules intégrés, mais le suivi complexe de l'état sur plusieurs étapes peut être limité.

- LangGraph : Fournit un contrôle explicite de l'état, permettant aux développeurs de gérer avec précision les flux de travail de longue durée, les nouvelles tentatives et les interactions multi-agents.

Facilité d'utilisation

- Chaîne Lang : Simple et convivial pour les développeurs, il est idéal pour le prototypage rapide et la configuration rapide.

- LangGraph : Plus complexe en raison de son architecture basée sur des graphes, nécessitant une planification minutieuse mais offrant une plus grande flexibilité pour les flux de travail dynamiques.

Complexité

- Chaîne Lang : Convient aux branchements simples et aux canalisations simples. Une configuration minimale permet de maintenir le développement propre et maintenable.

- LangGraph : Conçu pour gérer les boucles, les nouvelles tentatives, la coordination multi-agents et les processus décisionnels avancés. Idéal pour les applications complexes nécessitant une logique adaptative.

Production

- Chaîne Lang : Écosystème solide avec des intégrations pour plusieurs LLM, bases de données vectorielles et outils tiers. Excellent pour un déploiement et une expérimentation rapides.

- LangGraph : Fournit un prototypage visuel et une surveillance via sa plateforme, y compris des outils tels que LangGraph Studio et LangSmith, ce qui facilite le débogage et le suivi des flux de travail des agents en production.

Quand utiliser LangChain ?

LangChain est idéal lorsque votre processus avance étape par étape sans branchement fréquent, boucle ou gestion d'état complexe.

Flux de travail simples et linéaires

LangChain est idéal pour les tâches qui suivent une séquence claire sans branchement complexe. Par exemple, traduire du texte ou résumer des documents en une seule étape.

depuis langchain.chat_models, importez ChatOpenAI

depuis langchain.prompts, importez ChatPromptTemplate

prompt = ChatPromptTemplate.from_template (« Résumez ce texte : {text} »)

modèle = ChatOpenAI ()

chaîne = prompt | modèle

output = chain.invoke ({"text » : « LangChain simplifie le travail avec les LLM."})

impression (sortie)

Prototypage rapide

La bibliothèque de connecteurs prédéfinis de Langchain (LLM, bases de données, API) permet aux développeurs d'assembler et de tester rapidement des flux de travail. Utile pour les projets de validation de concept ou les itérations rapides.

Mémoire à court terme et expérimentation

Grâce aux modules de mémoire intégrés, LangChain peut conserver temporairement le contexte. Ceci est utile pour les expériences de chat, les tests de recherche ou les invites en plusieurs étapes qui ne nécessitent pas d'état à long terme.

depuis langchain.memory, importez ConversationBufferMemory

depuis langchain.chains, importez ConversationChain

depuis langchain.llms, importez OpenAI

mémoire = ConversationBufferMemory ()

conversation = ConversationChain (LLM=OpenAI (), mémoire=mémoire)

conversation.run (« Expliquez LangChain pour les débutants. »)

conversation.run (« Résumez votre explication en une ligne. »)

Applications ciblées et maintenables

Pour les applications qui n'ont pas besoin de boucle, de logique adaptative ou d'orchestration multi-agents, LangChain garantit des flux de travail simples, modulaires et faciles à gérer.

depuis langchain.chains, importez SimpleSequentialChain, LLMchain

depuis langchain.prompts import PromptTemplate

depuis langchain.llms, importez OpenAI

llm = OpenAI ()

prompt = PromptTemplate (Template="Traduire en français : {text} », input_variables= ["text"])

chaîne = LLMChain (llm=llm, prompt=prompt)

seq_chain = SimpleSequentialChain (chaînes = [chaîne])

print (seq_chain.run (« Bonjour, comment allez-vous ? »))

Choisissez LangChain lorsque vous vous concentrez sur la création de flux de travail LLM clairs, structurés et bien intégrés avec une configuration minimale et une flexibilité maximale.

Quand utiliser LangGraph ?

LangGraph est idéal pour les flux de travail dynamiques et adaptatifs nécessitant le suivi de l'état, le branchement ou l'orchestration multi-agents. Il convient parfaitement aux agents d'IA et aux systèmes complexes qui ont besoin de revoir les étapes, de gérer des chemins alternatifs ou de maintenir le contexte au fil du temps.

Flux de travail adaptatifs avec boucles et branchements

Utilisez LangGraph lorsque votre processus doit changer de direction, réessayer des étapes ou gérer des décisions en plusieurs étapes.

depuis langgraph import StateGraph

def process_input (état) :

input_data = état ["entrée"]

résultat = input_data.upper () # transformation simple

return {"result » : résultat, « input » : input_data}

graphe = StateGraph ()

graph.add_node (« processeur », process_input)

graph.add_edge (« processor », « processor ») # boucle arrière pour réessayer

output = graph.run ({"input » : « bonjour tout le monde"})

impression (sortie)

Processus dynamiques et de longue durée

LangGraph fournit une gestion d'état explicite, ce qui le rend idéal pour les flux de travail qui doivent préserver le contexte sur plusieurs étapes ou sessions.

def agent_step (état) :

state ["history"] .append (state ["input"])

return {"history » : état ["historique"], « input » : état ["next_input"]}

graphe = StateGraph ()

graph.add_node (« agent », agent_step)

result = graph.run ({"history » : [], « input » : « Étape 1 », « next_input » : « Étape 2})

imprimer (résultat)

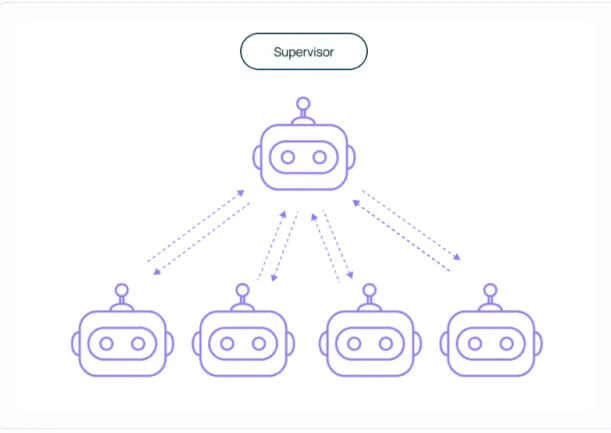

Orchestration multi-agents

Langgraph coordonne plusieurs agents d'IA dotés de rôles spécialisés dans un seul flux de travail. Effectuez des étapes en boucle, branchez et réessayez tout en maintenant un état cohérent.

def agent1 (état) :

return {"message » : « Agent1 a été traité" + state ["data"]}

def agent2 (état) :

return {"message » : « Agent2 confirmé" + état ["message"]}

graphe = StateGraph ()

graph.add_node (« A1 », agent 1)

graph.add_node (« A2 », agent 2)

graph.add_edge (« A1 », « A2 »)

output = graph.run ({"data » : « informations sur la tâche"})

impression (sortie)

Surveillance adaptée à la production

LangGraph s'intègre à LangSmith et LangGraph Studio pour fournir la journalisation, le débogage et la surveillance en temps réel des flux de travail des agents. Parfait pour les applications complexes où la transparence et la gestion des erreurs sont importantes.

Utilisez LangGraph lorsque votre application nécessite des flux de travail dynamiques, dynamiques et adaptatifs. Il excelle dans les systèmes multi-agents, l'orchestration de l'IA et les processus où la mémoire, le contexte et la logique de branchement sont essentiels.

LangChain contre LangGraph — Quel est le meilleur ?

LangChain et LangGraph sont tous deux d'excellents outils, mais ils résolvent des problèmes différents. Le choix de la solution qui vous convient le mieux dépend de la complexité de vos flux de travail et du type de contrôle dont vous avez besoin.

Quand LangChain pourrait être le meilleur choix

LangChain est parfait si votre candidature suit un processus clair, étape par étape. Il fonctionne bien lorsque le flux de travail est prévisible, sans embranchements ou retours en boucle fréquents. Par exemple, vous pouvez utiliser LangChain pour :

- Créez un chatbot qui répond aux questions à l'aide d'un seul cycle de réponse rapide

- Création d'un outil de synthèse ou de génération de contenu

- Implémentez la génération RAG (Retrieval-Augmented Generation) pour une recherche rapide des informations

Ses principaux atouts sont la rapidité, la simplicité et une vaste bibliothèque d'intégrations. Cela rend LangChain particulièrement intéressant pour le prototypage, les projets de petite et moyenne envergure et les utilisations éducatives, où il est plus important de faire fonctionner rapidement quelque chose que de gérer des cas extrêmes ou des branchements complexes.

Quand LangGraph se démarque

LangGraph brille dans les situations où l'application doit s'adapter, revenir en arrière ou s'exécuter sur une plus longue période tout en gardant une trace de l'état. Il est conçu pour les flux de travail de type agent qui peuvent :

- Parcourez les étapes jusqu'à ce qu'une condition soit remplie

- Faites une pause et reprenez exactement là où vous vous étiez arrêtés

- Utiliser des points de contrôle humains pour la vérification ou les ajustements

Cela fait de LangGraph le meilleur choix pour les systèmes multi-agents, la prise de décision complexe et les déploiements de niveau production où la flexibilité et la résilience sont essentielles.

Comment décider

Si vous n'êtes toujours pas sûr, tenez compte des points suivants :

- Complexité du workflow: S'il est principalement linéaire, commencez par LangChain. S'il comporte des boucles, des branchements et une logique adaptative, optez pour LangGraph.

- Exigences de l'État: Si vous n'avez besoin que de mémoire à court terme pour une seule exécution, LangChain fera l'affaire. Si vous avez besoin d'un état persistant et contrôlable, LangGraph est préférable.

- Plans à long terme : Si votre application risque de devenir un système plus complexe ultérieurement, LangGraph peut vous éviter une étape de migration.

Lutin :

LangChain est l'option rapide et accessible pour les flux de travail simples à modérément complexes. LangGraph est le choix robuste et flexible pour les systèmes d'IA dynamiques et complexes. Les deux font partie du même écosystème, vous pouvez donc commencer par l'un et passer à l'autre si vos besoins évoluent. Votre choix doit correspondre à la portée actuelle de votre projet et à vos futurs objectifs d'évolutivité.

Cas d'utilisation réels de LangChain et LangGraph

Différentes entreprises utilisent LangChain ou LangGraph en fonction de la complexité et du type de flux de travail dont elles ont besoin. LangChain est généralement choisi pour les tâches linéaires étape par étape, tandis que LangGraph gère les processus dynamiques, dynamiques et multi-agents.

Pourquoi les passerelles IA sont importantes pour les utilisateurs de LangChain/LangGraph

Lorsque vous créez avec LangChain ou LangGraph, vous créez de puissants flux de travail alimentés par LLM. Mais pour qu'ils fonctionnent de manière fiable, rentable et sécurisée en production, il ne suffit pas d'orchestration. C'est là qu'un Passerelle IA entre. Il fait office de couche de contrôle entre votre application et les modèles qu'elle utilise, garantissant un routage fluide, un suivi des coûts, une gestion rapide et une sécurité.

La création d'un flux de travail dans LangChain ou LangGraph n'est que la première étape. Une fois que vous passez à la production, la gestion de l'aspect opérationnel de l'utilisation du LLM devient tout aussi importante que la conception du flux de travail lui-même. Une passerelle IA fait office de couche de contrôle, vous aidant à acheminer les demandes vers le modèle le plus approprié, à surveiller les performances et à assurer le bon fonctionnement de vos applications.

Sans cette couche, il est facile de rencontrer des problèmes tels qu'une latence imprévisible, une hausse des coûts ou une utilisation incohérente des instructions dans les différentes parties de votre système. Les passerelles IA offrent la visibilité et le contrôle nécessaires pour maintenir les performances, optimiser les dépenses et assurer la sécurité de vos terminaux LLM.

Comment TrueFoundry complète LangChain et LangGraph

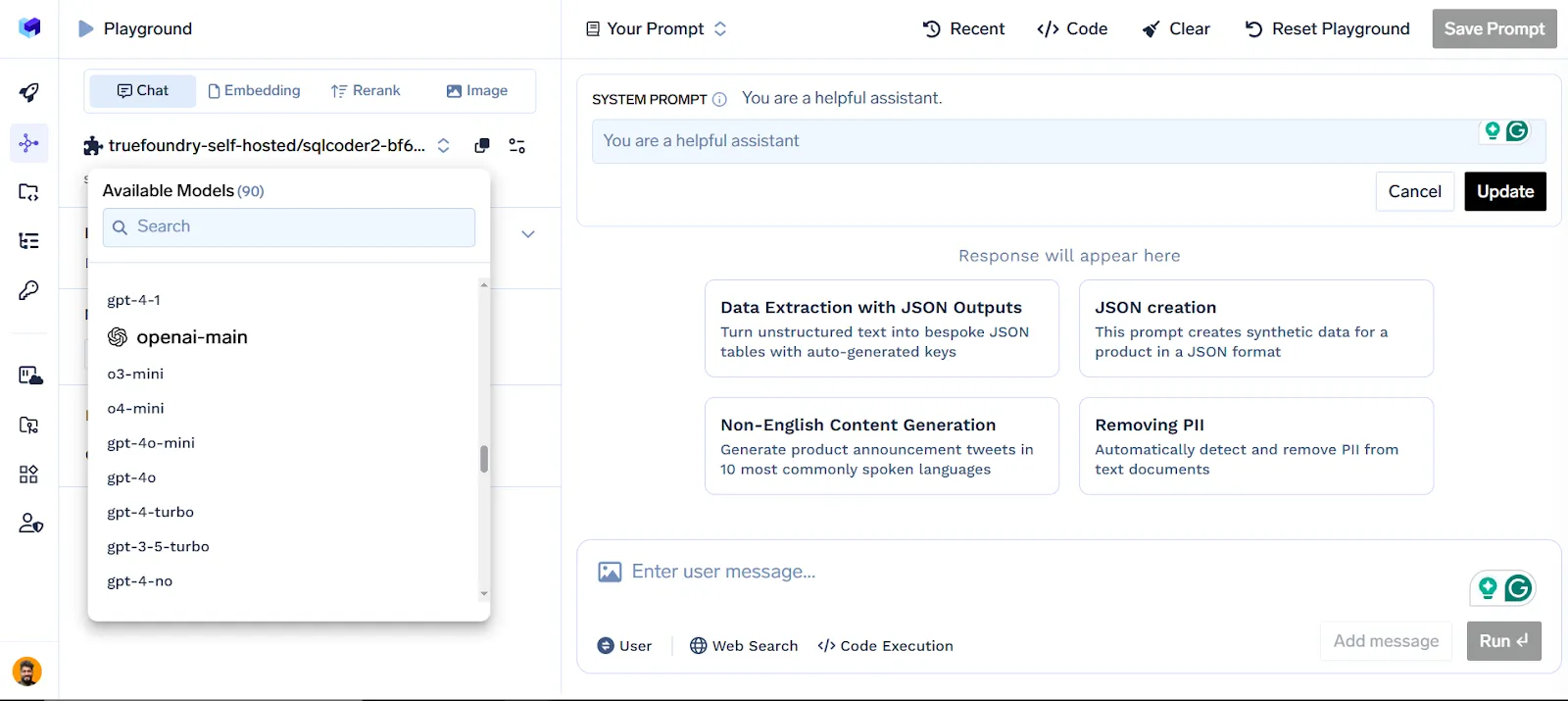

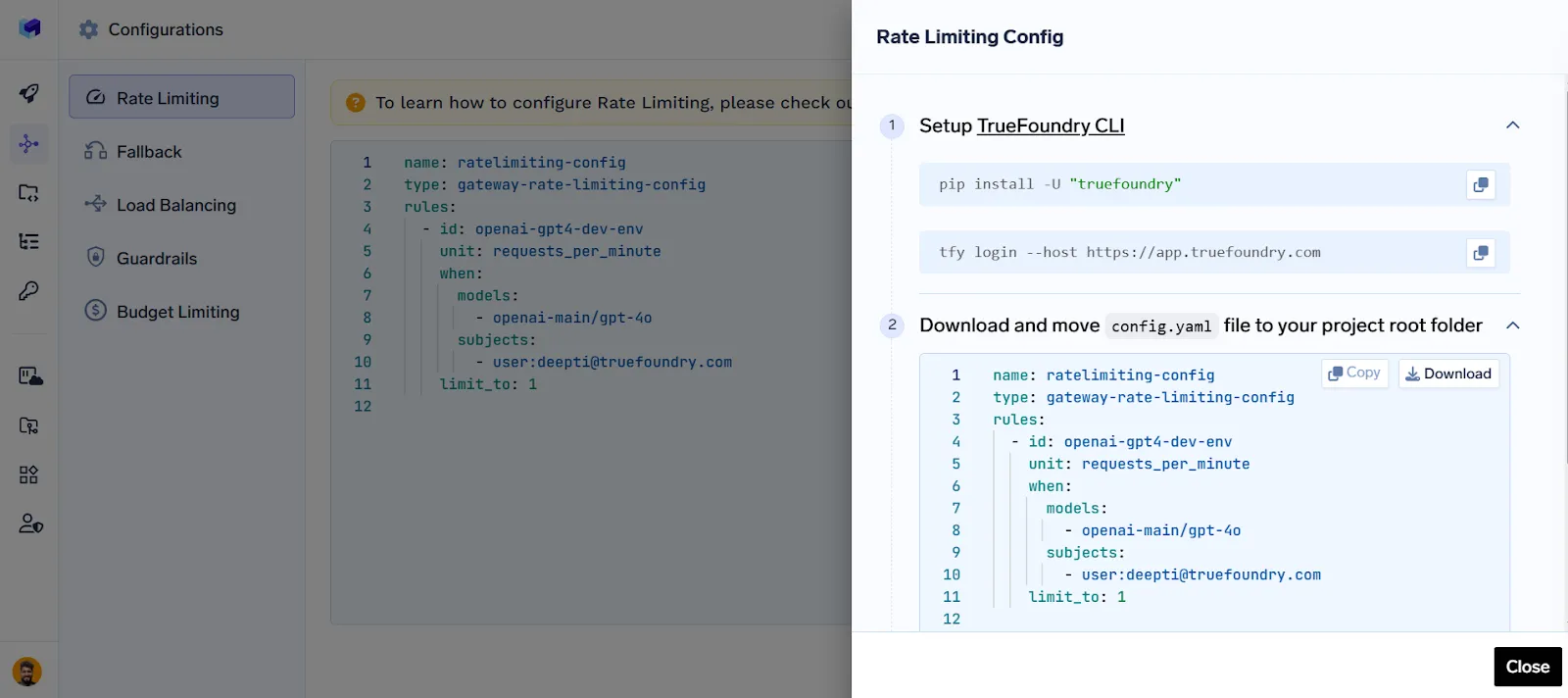

TrueFoundry AI Gateway étend les capacités de vos flux de travail LLM en proposant :

Gestion centralisée du LLM : Connectez et gérez plusieurs fournisseurs de modèles tels qu'OpenAI, Anthropic et Hugging Face à partir d'un seul tableau de bord.

Routage, limitation de débit, repli, garde-corps et équilibrage de charge : Optimisez le flux de demandes, contrôlez l'utilisation, garantissez la sécurité des sorties, passez aux sauvegardes en cas de panne et équilibrez le trafic entre les modèles.

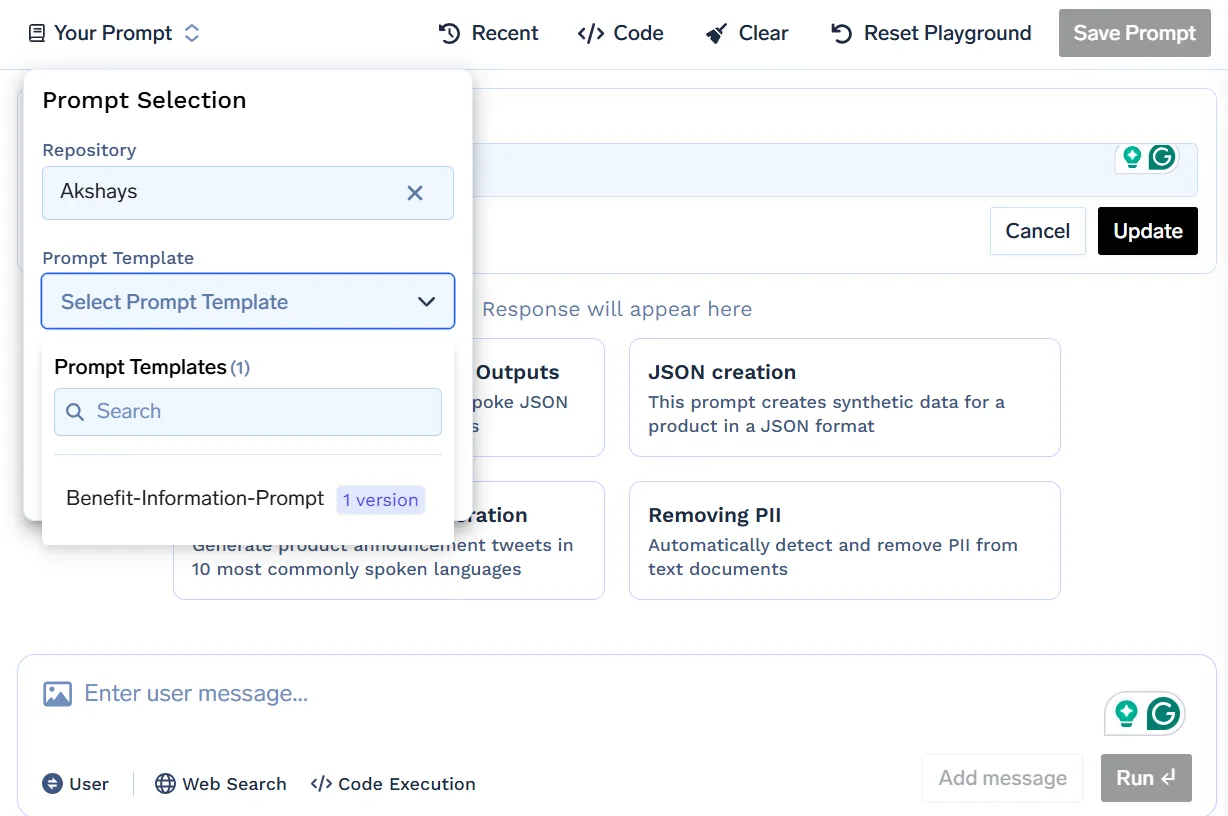

Gestion rapide : Des instructions de version, de test et de restauration sans interruption de votre système actif.

Observabilité, traçage et débogage : Surveillez la latence, l'utilisation des jetons et les taux d'erreur en temps réel, et suivez chaque demande dans votre flux de travail pour faciliter le débogage et l'optimisation.

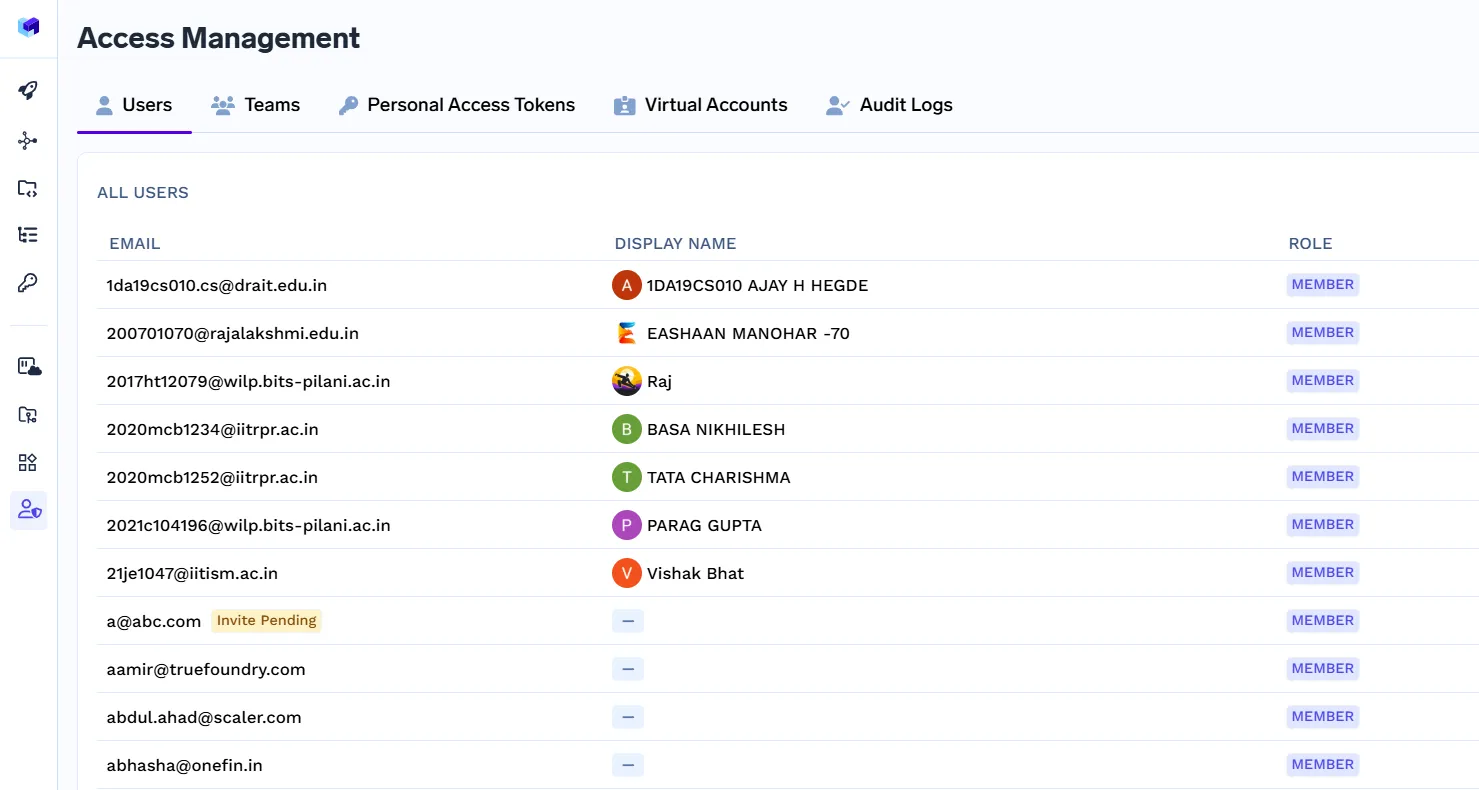

Contrôle d'accès, RBAC et conformité: définissez qui peut accéder aux ressources à l'aide du contrôle d'accès basé sur les rôles, et maintenez sécurité de l'IA de niveau entreprise et gouvernance.

Pourquoi TrueFoundry se démarque

True Foundry prend en charge plus de 250 LLM prêts à l'emploi, vous offrant une flexibilité maximale. Il est conçu pour des performances de niveau production, offrant une mise en cache, une limitation de débit et des analyses avancées. Que vous exécutiez une simple séquence LangChain ou un réseau d'agents LangGraph complexe, il s'intègre parfaitement.

Grâce à des fonctionnalités de conformité, de gouvernance des données et de sécurité prêtes à l'emploi, TrueFoundry garantit que vos flux de travail LLM sont non seulement fonctionnels, mais également robustes, évolutifs et sécurisés.

Conclusion

LangChain et LangGraph sont tous deux de puissants outils pour créer des applications basées sur LLM, chacun excellant dans différents scénarios. LangChain est idéal pour les flux de travail linéaires et simples qui bénéficient d'un prototypage rapide et d'intégrations étendues, tandis que LangGraph est conçu pour les systèmes d'agents complexes, adaptatifs et dynamiques. Le choix de la bonne solution dépend de la complexité de votre projet et de ses objectifs à long terme. Quel que soit votre choix, l'association de ces frameworks à TrueFoundry en tant que passerelle IA garantit la sécurité, l'efficacité et la disponibilité de vos flux de travail pour la production. Avec la bonne combinaison, vous pouvez passer du concept à des solutions d'IA robustes et évolutives en toute confiance.

Questions fréquemment posées

LangGraph remplacera-t-il LangChain ?

Non. LangGraph et LangChain ont des objectifs différents. LangChain est optimisé pour les flux de travail LLM linéaires étape par étape et le prototypage rapide, tandis que LangGraph est conçu pour les flux de travail dynamiques, multi-agents et avec état. Chacun a son créneau et l'un ne remplace pas l'autre ; ils peuvent se compléter dans des systèmes complexes.

Pouvons-nous utiliser LangGraph sans LangChain ?

Oui LangGraph peut fonctionner indépendamment pour gérer des flux de travail basés sur des graphes, des systèmes multi-agents et des processus dynamiques. Bien que les composants LangChain puissent être intégrés pour certaines tâches, vous n'avez pas besoin de LangChain pour créer ou exécuter des applications dans LangGraph, ce qui le rend flexible pour les flux de travail complexes sans dépendances linéaires.

LangGraph appartient-il à LangChain ?

Non. LangGraph est développé par la même organisation que LangChain, mais il s'agit d'un framework distinct. Il se concentre sur l'orchestration basée sur des graphes et les flux de travail multi-agents. Bien qu'ils partagent certaines intégrations et philosophies de conception, LangGraph est géré de manière indépendante et possède ses propres outils, tels que LangGraph Studio et LangSmith.

Dois-je apprendre LangChain avant LangGraph ?

Pas nécessairement. Vous pouvez commencer directement avec LangGraph, en particulier si votre application nécessite des flux de travail complexes, des boucles ou une orchestration multi-agents. Cependant, la familiarité avec LangChain peut aider à comprendre les composants LLM modulaires, le chaînage rapide et les flux de travail de base, ce qui peut accélérer l'apprentissage de LangGraph pour les configurations hybrides.

Quelles sont les limites de LangGraph ?

La complexité de LangGraph peut constituer une limite pour les projets simples. Il a une courbe d'apprentissage plus abrupte que LangChain, et les flux de travail plus petits peuvent être surconçus à l'aide de sa structure graphique. En outre, son orchestration multi-agents nécessite une gestion, une planification et une surveillance minutieuses de l'état, ce qui la rend moins idéale pour le prototypage rapide.

LangGraph est-il un sur-ensemble de LangChain ?

Non. LangGraph n'est pas un sur-ensemble de LangChain. Bien qu'il prenne en charge les flux de travail avancés que LangChain ne peut pas gérer efficacement, il n'inclut pas automatiquement tous les utilitaires de flux de travail linéaires ou les connecteurs prédéfinis de LangChain. Il s'agit de frameworks complémentaires, chacun optimisé pour des types de flux de travail et des cas d'utilisation spécifiques.

Quelle est la différence entre la mémoire LangGraph et la mémoire LangChain ?

La mémoire LangChain est implicite et modulaire, généralement pour la conservation du contexte à court terme, comme l'historique des discussions. D'autre part, la mémoire LangGraph est explicite, ce qui donne aux développeurs un contrôle total sur le suivi de l'état, le contexte multi-agents et les flux de travail de longue durée. La mémoire LangGraph convient mieux aux systèmes adaptatifs complexes, tandis que la mémoire LangChain convient aux tâches linéaires et simples.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)