La question de 360 000$ sur l'économie des grands modèles linguistiques

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Le but de cet article est d'informer le lecteur sur le fonctionnement de la tarification des grands modèles linguistiques (LLM). Ceci est motivé par nos conversations avec de nombreuses entreprises utilisant des LLM à des fins commerciales. Au cours de ces conversations, nous nous sommes rendu compte que l'économie du LLM est souvent mal comprise, ce qui laisse une énorme marge d'optimisation.

Vous rendez-vous compte que le fait de la même tâche peut prendre 3 500$ avec un modèle ou 1 260 000$ avec un autre? Cela se fait au prix de la différence de performance, mais cela laisse une grande marge de manœuvre pour réfléchir au compromis entre les coûts et les performances. La tâche est-elle telle que je puisse utiliser quelque chose de moins cher ?

Nous avons constaté à maintes reprises que des entreprises surestimaient ou sous-estimaient leurs dépenses consacrées aux grands modèles linguistiques. Nous essaierons donc ici de comprendre le coût de fonctionnement de certains des modèles linguistiques les plus populaires et de comprendre comment fonctionne leur tarification.

ℹ️

Le but de ce blog n'est pas d'éduquer le lecteur sur les LLM ou leurs performances. Il s'agit d'un blog à forte intensité mathématique axé sur la compréhension de la tarification du LLM. Par souci de simplicité, nous ne comparerions pas les performances de ces modèles.

Résumé de Wikipedia

Le échantillon pour l'analyse des prix

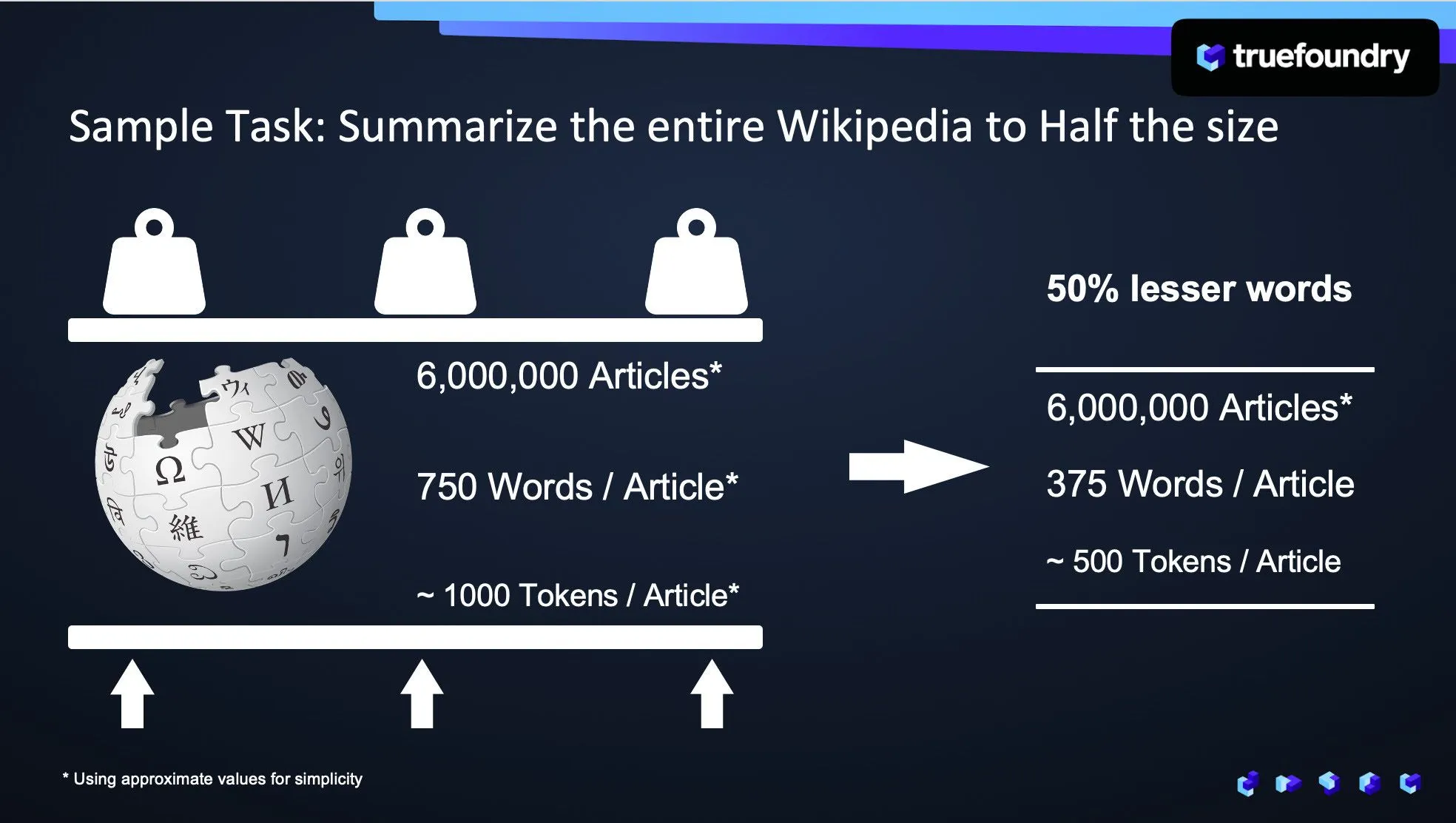

Pour comprendre comment fonctionne la tarification des LLM, nous comparerions les coûts engagés pour la même tâche, c'est-à-dire pour résumer Wikipédia à la moitié de sa taille.

Détails Taille de la tâche

Nous utiliserions quelques approximations pour simplifier les calculs et les rendre facilement compréhensibles

Taille du corpus Wikipedia

- ~ 6 millions d'articles au total

- ~ 750 mots par article

- ~ 1000 jetons par article

❓

Jetons sont des sous-parties de mots qui ne dépendent pas précisément du début ou de la fin des mots. Il s'agit de l'unité dans laquelle les API OpenAI divisent l'entrée en jetons avant qu'elle ne soit traitée. Les jetons peuvent inclure des espaces de fin et même des sous-mots.

Taille attendue de la sortie résumée

Pour cette tâche, nous supposons que chaque article est simplement compressé à la moitié de sa taille pour des raisons de simplicité. Par conséquent, les résultats que nous attendons seront les suivants :

- ~6 millions d'articles

- ~375 mots par article résumé

- ~500 jetons par article

Comprendre les coûts

Comparer ce que coûterait l'utilisation de différents modèles pour cette tâche

Les leviers de la tarification dans les API OpenAI/tierces

OpenAI et les autres API tierces facturent généralement en fonction de deux leviers ; si vous souhaitez déduire à l'aide de leurs API

Coût d'entrée

Ce coût dépend du nombre de jetons (expliqué ci-dessus) transmis en tant que contexte/invite/instruction à l'API.

Coût de sortie

Son coût est basé sur le nombre de jetons que l'API renvoie en réponse.

Pour une tâche telle que la synthèse, étant donné que vous devez transmettre l'intégralité du document ou de l'extrait à résumer au modèle, le nombre de jetons qui font partie de l'invite peut devenir significatif, d'où le coût d'entrée.

Base du coût supporté par les modèles auto-hébergés

Avec les modèles auto-hébergés, l'utilisateur doit gérer/approvisionner la machine nécessaire à l'exécution du modèle. Bien que cela puisse inclure le coût de gestion de ces ressources, la tarification est relativement facile à comprendre puisqu'elle est uniquement basée sur le coût de fonctionnement de la machine (généralement celui facturé par les fournisseurs de cloud, sauf si vous avez votre propre cluster sur site)

Coût de la machine

Coût du provisionnement de la machine requise pour exécuter/héberger le modèle. Étant donné que la plupart de ces modèles plus grands sont plus grands que ce qui peut être exécuté sur un ordinateur portable ou un seul appareil local, l'utilisation d'un fournisseur de cloud pour ces machines est la plus courante.

Les fournisseurs de cloud proposent ces instances, mais les utilisateurs peuvent être confrontés à des problèmes de disponibilité du GPU car ces modèles nécessitent un GPU.

Coûts des instances Google Cloud

Coûts des instances Microsoft Azure

Instances ponctuelles

Les fournisseurs de cloud fournissent leur capacité inutilisée à un coût 40 à 90 % inférieur à celui des instances à la demande

Comparaison des coûts des différents modèles

GPT 4 - Longueur de contexte 8K

Coûts unitaires

Formule de coût

Coût = Non Nombre de jetons (pour 1 000 articles) X Nombre d'articles (en milliers) X Coût unitaire (pour 1 million de jetons)

Coût des intrants

1 000 (jetons/article) X 6 000 000 (articles) X 30$ (/Mn de jetons) = 180 000$

Coût de production

0,5 K (jetons/article) X 6 000 K (articles) X 60$ (/Mn de jetons) = 180 000$

Coût total

Coût d'entrée + coût de sortie

= 360 000 dollars

GPT 4 - Longueur de contexte de 32 Ko

Coûts unitaires

Coût d'entrée (/Mn de jetons) Coût de sortie (/Mn de jetons) 60$ à 120$

Formule de coût

Coût = Non Nombre de jetons (pour 1 000 articles) X Nombre d'articles (en milliers) X Coût unitaire (pour 1 million de jetons)

Coût des intrants

1 000 (jetons/article) X 6 000 000 (articles) X 60$ (/Mn de jetons) = 360 000$

Coût de production

0,5 K (jetons/article) X 6 000 K (articles) X 120$ (/Mn de jetons) = 360 000$

Coût total

Coût d'entrée + coût de sortie

= 720 000 dollars

Claude anthropique V1

Coûts unitaires

Formule de coût

Coût = Nombre de jetons (pour 1 000 articles) X Nombre d'articles (en milliers) X Coût unitaire (pour 1 million de jetons)

Coût des intrants

1 000 (jetons/article) X 6 000 000 (articles) X 11$ (/Mn de jetons) = 66 000$

Coût de production

0,5 K (jetons/article) X 6 000 K (articles) X 60$ (/Mn de jetons) = 96 000$

Coût total

Coût d'entrée + coût de sortie

= 162 000 dollars

InstructGPT - DaVinci

Coûts unitaires

Formule de coût

Coût = Non Nombre de jetons (pour 1 000 articles) X Nombre d'articles (en milliers) X Coût unitaire (pour 1 million de jetons)

Coût des intrants

1 000 (jetons/article) X 6 000 000 (articles) X 20$ (/Mn de jetons) = 120 000$

Coût de production

0,5 K (jetons/article) X 6 000 K (articles) X 20$ (/Mn de jetons) = 60 000$

Coût total

Coût d'entrée + coût de sortie

= 180 000 dollars

Curie

Coûts unitaires

Formule de coût

Coût = Non Nombre de jetons (pour 1 000 articles) X Nombre d'articles (en milliers) X Coût unitaire (pour 1 million de jetons)

Coût des intrants

1 000 (jetons/article) X 6 000 000 (articles) X 2$ (/Mn de jetons) = 12 000$

Coût de production

0,5 K (jetons/article) X 6 000 K (articles) X 60$ (/Mn de jetons) = 6 000$

Coût total

Coût d'entrée + coût de sortie

= 18 000 dollars

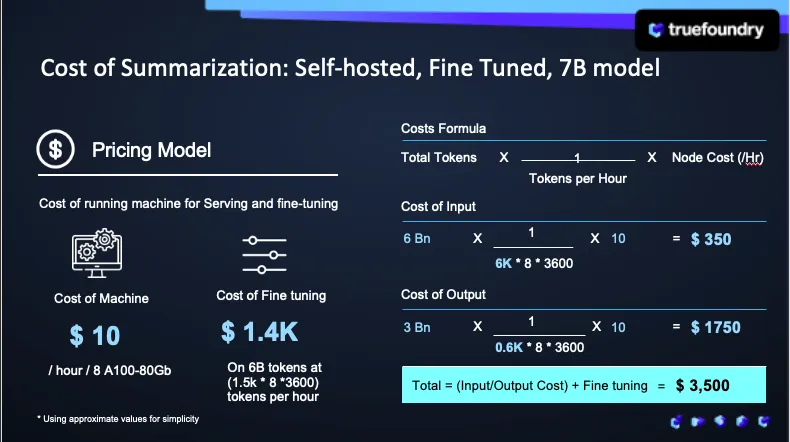

Modèle 7B auto-hébergé

Coûts unitaires

Coût de fonctionnement de la machine (/h pour Spot A100-80 Go) 10$

Formule de coût

Coût = Nombre de jetons (pour 1 000 articles) X Nombre d'articles (en milliers) X Coût unitaire (pour 1 million de jetons)

Coût des intrants

1 000 (jetons/article) X 6 000 000 (articles) X 30$ (/Mn de jetons) = 180 000$

Coût de production

0,5 K (jetons/article) X 6 000 K (articles) X 60$ (/Mn de jetons) = 180 000$

Coût total

Coût d'entrée + coût de sortie

= 360 000 dollars

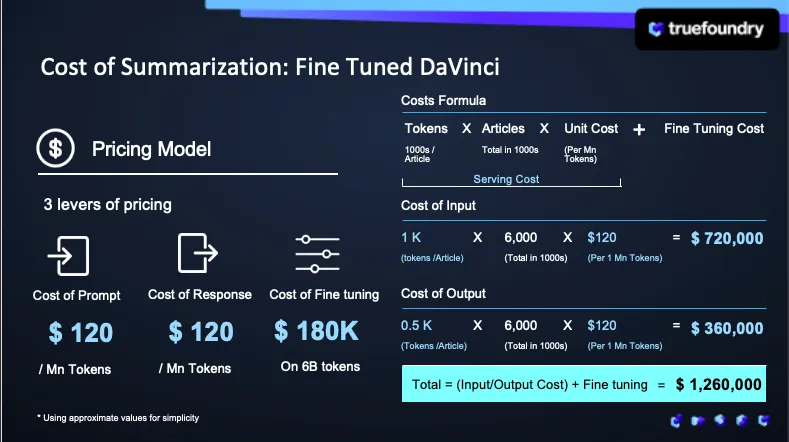

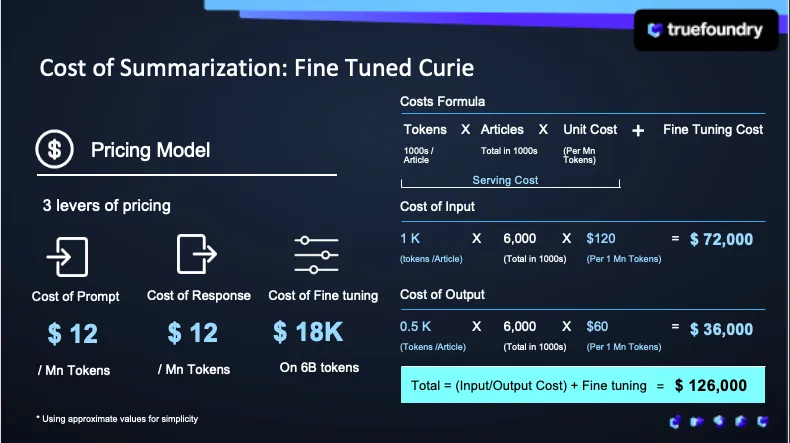

Modèles de réglage fin

Dans la plupart des cas d'utilisation, les entreprises en ont besoin pour affiner des modèles spécifiques à leurs propres données et à des tâches particulières. De nombreuses entreprises ont indiqué que les modèles open source affinés étaient comparables, voire parfois meilleurs, que les API tierces comme OpenAI sur une tâche spécifique.

Un DaVinci affiné

Coût total

Coût d'entrée + coût de sortie

= 1 260 000 dollars

Curie affiné

Coût total

Coût d'entrée + coût de sortie

= 126 000 dollars

Modèle 7B auto-hébergé et affiné

Coût total

Coût d'entrée + coût de sortie

= 126 000 dollars

Assembler le tout

Points à retenir de la tarification :

- Les modèles DaVinci et Curie sont environ 7 fois plus chers si vous les adaptez à votre cas d'utilisation

- Les coûts augmentent avec une augmentation de la fenêtre contextuelle d'environ 2 fois

- Le coût d'utilisation du modèle augmente avec l'augmentation du nombre de paramètres du modèle

Effet de l'ajustement sur les performances

Nous utilisons le benchmark suivant pour analyser l'effet du réglage fin des modèles sur les performances des modèles. Il est intéressant de noter que :

- Les modèles à paramètres inférieurs peuvent également être plus performants que les modèles plus grands lorsqu'ils sont adaptés à un cas d'utilisation particulier.

- Des économies de coûts importantes sont possibles sans nuire aux performances, si le bon compromis est établi entre le coût et la performance.

Type de tâcheBest 6B/7B OOTB Model Few-ShotMoveLM 7B Zero-ShotGPT-3.5 Turbo Zero-ShotGPT-3.5 Turbo Few-ShotGPT-4 Zero-shotGPT-4 Few-ShotGPT-4 Few-ShotRevance - jeu de données interne0,330,930,840,840,920,95Extraction - sortie structurée pour les requêtes0.380,980,220.720.380.73 Raisonnement - déclenchement personnalisé0,620,930.870.880.90.88Classification - domaine de la requête de l'utilisateur0,210,790.60.730.70.76Extraction - sortie structurée à partir du typage d'entités0,830,870,90,890,890,89

Ce que nous faisons

TrueFoundry pense que l'avenir des LLM réside dans la coexistence de LLM open source et commerciaux au sein d'une même application !

Nous croyons en un état d'applications où les tâches les plus simples sont gérées par des LLM open source légers, tandis que les tâches les plus complexes ou celles qui nécessitent des fonctionnalités distinctes (par exemple, la recherche sur le Web, les appels d'API, etc.), qui ne sont proposées que par des LLM commerciaux à source fermée, peuvent leur être déléguées.

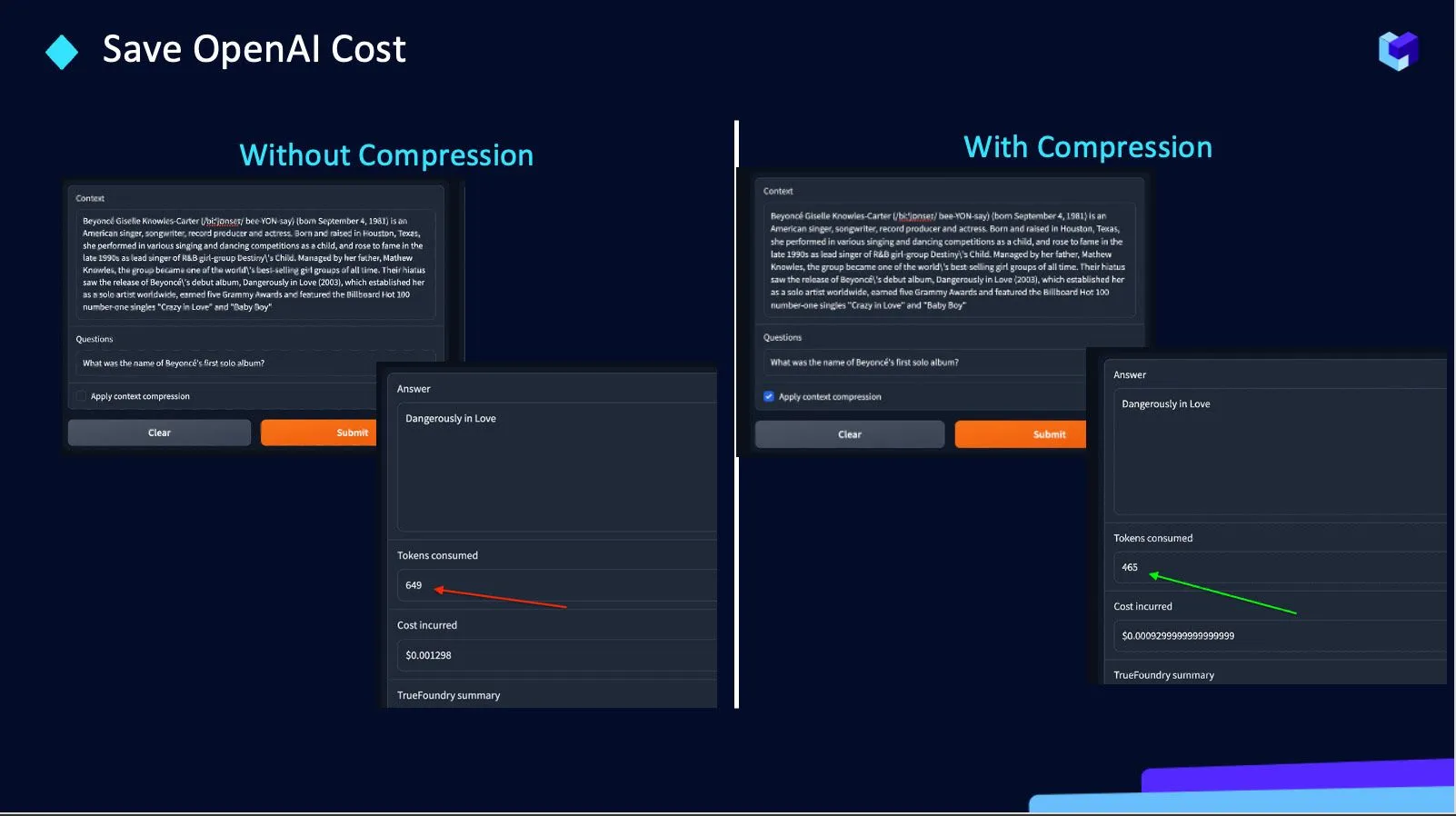

Si vous utilisez OpenAI

Nous contribuons à réduire le nombre de jetons envoyés aux API OpenAI. Pourquoi nous avons décidé de travailler là-dessus parce que :

- Nous avons remarqué que plus de la moitié des coûts étaient liés au traitement des jetons contextuels/rapides.

- Tous les mots ne sont pas nécessaires. Les LLM sont excellents pour travailler avec des phrases incomplètes.

D'où True Foundry construit une API de compression pour économisez le coût d'OpenAI d'environ 30 %.

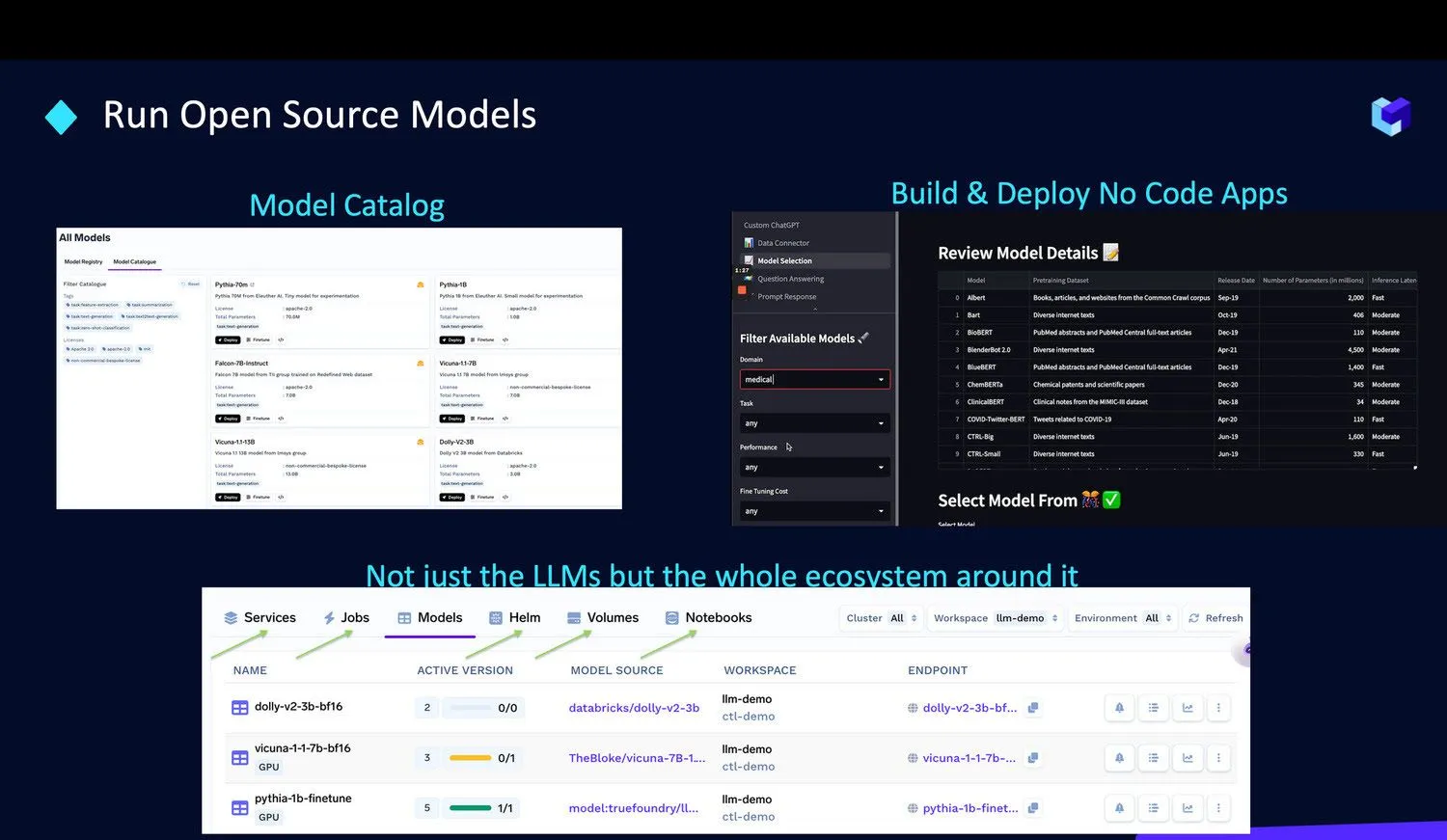

Si vous souhaitez utiliser des LLM Open Source

Nous simplifions l'exécution de ces modèles au sein de votre propre infrastructure grâce à nos offres suivantes :

- Catalogue de modèles : Des LLM open source optimisés pour l'inférence et le réglage fin.

- API intégrées : Elles peuvent être directement échangées contre les API HuggingFace et OpenAI que vous utilisez déjà dans vos applications.

- Optimisation des coûts : Trans-cloud sur K8s en tirant parti de vos crédits ou de votre budget cloud.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)