Examen d'Amazon SageMaker : fonctionnalités, prix, avantages et inconvénients (+ meilleure alternative)

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Amazon SageMaker est effectivement devenu le système d'exploitation par défaut pour l'apprentissage automatique au sein du périmètre AWS. Lancé en 2017, il promettait d'industrialiser ce qui était alors un écosystème fragmenté de scripts personnalisés et de provisionnement manuel des serveurs. En faisant abstraction de la configuration EC2 sous-jacente et de l'orchestration des conteneurs, il a permis aux entreprises de standardiser leurs pipelines de machine learning.

Mais nous sommes en 2026 et la proposition de valeur d'un service géré à source fermée et à cloud unique fait l'objet d'un examen minutieux. Les plaintes que nous adressent les équipes d'ingénieurs sont constantes : des modèles de tarification opaques qui entraînent un choc en fin de mois, des courbes d'apprentissage abruptes pour les personnes qui ne sont pas des natifs d'AWS et une architecture « jardin clos » qui pénalise les stratégies multicloud.

Cette revue technique considère SageMaker non pas comme une brochure marketing, mais comme un élément d'infrastructure. Nous examinons l'économie des unités, les frictions opérationnelles et les compromis architecturaux sur la base des données de G2, de Gartner Peer Insights et de l'expérience opérationnelle directe. Nous évaluerons également si des plans de contrôle découplés tels que True Foundry offrir une solution viable pour échapper à la dépendance vis-à-vis des fournisseurs.

Qu'est-ce qu'Amazon SageMaker ?

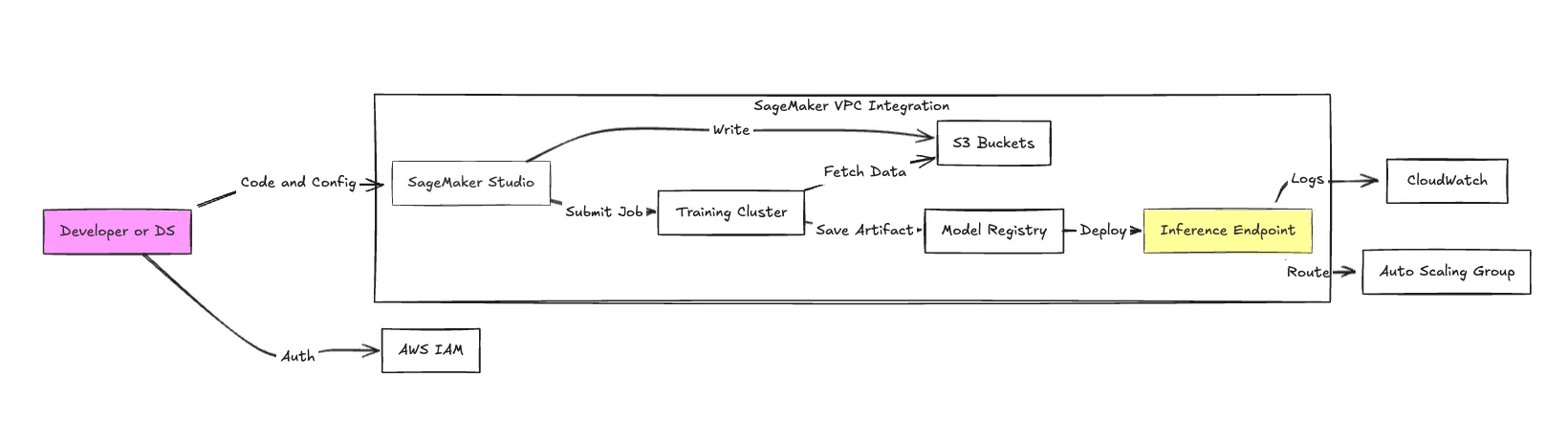

Amazon SageMaker est essentiellement un wrapper de services gérés autour du calcul AWS (EC2), du stockage (S3/EBS) et de l'orchestration de conteneurs (EKS/ECS). Il fournit un environnement de développement intégré (IDE) de bout en bout et un plan de contrôle pour le cycle de vie du machine learning.

Les mises à jour récentes, telles que le « Studio unifié » et l'intégration à Data Lakehouses, tentent de combler le fossé entre l'ingénierie des données et les opérations de machine learning. Cependant, pour l'ingénieur de la plateforme, SageMaker est essentiellement un ensemble d'API propriétaires utilisées pour fournir un calcul éphémère pour la formation et un calcul persistant pour l'inférence.

Public cible :

- Équipes de science des données d'entreprise : Les organisations qui ont besoin d'une conformité IAM stricte et d'une isolation VPC.

- Ingénieurs ML : Les équipes qui ont besoin d'une infrastructure gérée sans gérer directement les manifestes Kubernetes.

Champ d'application opérationnel :

- Développement de modèles personnalisés : Expérimentation basée sur un bloc-notes (JupyterLab).

- Orchestration de la formation : Formation distribuée sur des clusters hautes performances (instances P4/P5).

- Service d'inférence : Déploiement de terminaux pour le traitement en temps réel (REST) ou par lots.

- Gouvernance des MLOps : Registre de modèles, suivi de la lignée et détection de dérive.

Principales fonctionnalités d'Amazon SageMaker

SageMaker est un monolithe. Bien qu'il propose des dizaines de sous-services, les composants suivants constituent la pile opérationnelle de base.

SageMaker Studio et environnements de développement

Studio est un IDE basé sur le Web basé sur JupyterLab. Tout en centralisant l'accès, il introduit de la latence. La création d'une application « KernelGateway » peut prendre plusieurs minutes. Il crée une couche d'abstraction sur l'instance EC2 sous-jacente, ce qui simplifie l'accès mais complique l'utilisation des ressources système locales pour le débogage.

Entraînement des modèles et HyperPod

SageMaker permet une formation distribuée entre les clusters. HyperPod SageMaker est la caractéristique remarquable ici, conçue pour résister aux pannes matérielles lors de longues sessions de formation LLM. Il détecte et remplace automatiquement les instances défectueuses, ce qui est essentiel lors de la location de clusters GPU coûteux où la défaillance d'un seul nœud peut faire perdre des jours de temps de calcul.

Déploiement et inférence de modèles

SageMaker propose l'inférence en temps réel, l'inférence sans serveur et l'inférence asynchrone.

- En temps réel : Points de terminaison persistants (toujours en cours d'exécution). Bon pour une faible latence (<100 ms), mauvais pour les coûts en cas de baisse d'utilisation.

- Tests parallèles : Permet d'acheminer un pourcentage du trafic vers une nouvelle version du modèle afin de valider les performances sans affecter les utilisateurs.

- Sans serveur : Utile pour le trafic intermittent, mais présente des « démarrages à froid » (souvent de 5 à 10 secondes), ce qui le rend inutilisable pour les applications sensibles à la latence.

Pilote automatique SageMaker

Une solution AutoML qui utilise des algorithmes pour trouver le meilleur modèle. Bien qu'il soit utile pour le prototypage rapide sur des données tabulaires, les ingénieurs expérimentés trouvent souvent le code généré difficile à refactoriser ou à optimiser pour les contraintes d'inférence de production.

Outils MLOps (pipelines, registre, moniteur)

Il s'agit de la couche de « colle ». SageMaker Pipelines est un service CI/CD spécialement conçu pour le ML. Il s'intègre étroitement au Model Registry (gestion des versions) et au Model Monitor (détection de dérive). Le compromis consiste à associer de nombreux fournisseurs et à migrer un pipeline SageMaker vers Débit d'air ou Flux de travail Argo nécessite généralement une réécriture complète.

Préparation des données (Data Wrangler, Feature Store)

Data Wrangler fournit une interface utilisateur pour le nettoyage des données, générant du code python. Le Feature Store fait office de référentiel centralisé pour les fonctionnalités. Notez que le Feature Store est soutenu par Glue et DynamoDB, ce qui signifie que les lectures à haut débit peuvent entraîner des coûts secondaires importants du côté de la base de données.

Tarification d'Amazon SageMaker

La tarification est le point de friction le plus courant. SageMaker fonctionne selon un modèle basé sur la consommation avec une majoration par rapport à la tarification EC2 brute. Il n'y a pas de frais initiaux, mais la prévisibilité des coûts est faible en raison du grand nombre de vecteurs facturables.

Modèle de tarification

Vous êtes facturé pour :

- Calcul : Frais par seconde pour les instances de formation et d'inférence.

- Rangement : Frais en Go par mois pour les volumes EBS attachés aux instances (souvent négligés).

- Traitement des données : GB facture les entrées et sorties de données du service.

- Métadonnées : Coûts associés au stockage des métriques et des journaux dans CloudWatch.

Composantes des coûts et exemples concrets

1. Instances de bloc-notes :

Une instance d'ordinateur portable de taille moyenne ml.t3. standard coûte environ **0,05 $/heure**. Cependant, les développeurs les laissent souvent fonctionner du jour au lendemain. Une équipe de 10 développeurs qui laisse les instances actives pendant un mois génère environ 360 dollars de « gaspillage », hors frais de stockage.

2. Points de terminaison d'inférence (The Silent Budget Killer) :

C'est par inférence que les coûts montent en flèche. Contrairement à la formation (qui se termine), les terminaux fonctionnent 24 heures sur 24, 7 jours sur 7.

- Instance : ml.g5.xlarge (NVIDIA A10G).

- Coût : ~1,40 $/heure (US-est-1).

- Coût mensuel : ~1 008$ par instance.

- Redondance : La production nécessite au moins deux instances pour garantir une haute disponibilité.

- Total : ~2 016 $/mois par modèle.

3. Instances de formation et ponctuelles :

Managed Spot Training peut offrir jusqu'à 90 % de réduction par rapport aux tarifs à la demande. Cependant, les instances Spot peuvent être préemptées (interrompues) par AWS à tout moment. Si votre logique de points de contrôle d'entraînement n'est pas robuste, vous perdez de la progression.

Scénario du monde réel :

Une start-up de taille moyenne qui forme un LLM personnalisé et héberge 5 modèles en production peut facilement voir des factures dépassant 25 000$ par mois. D'après Tarification AWS, les frais de traitement des données pour des fonctionnalités telles que Data Wrangler commencent à 0,14 $/nœud par heure, qui évoluent de manière linéaire en fonction du volume de données.

Avis sur Amazon SageMaker : ce qu'en disent les utilisateurs

Nous avons analysé les commentaires de G2, de Gartner Peer Insights et des forums de développeurs pour identifier le consensus.

Évaluations générales

- G2 : 4.2/5 (Sur la base de l'adoption par les entreprises).

- À la première : 4.5/5 (Orientée vers les magasins spécialisés en AWS).

Avantages (Ce que les utilisateurs adorent)

Les utilisateurs apprécient la nature « conforme » de la plateforme.

- Infrastructure gérée : « La possibilité de créer un cluster de formation distribué sans toucher aux manifestes Kubernetes est la principale raison pour laquelle nous restons », explique un ingénieur ML senior sur G2.

- Sécurité : L'intégration fluide avec les rôles IAM et les points de terminaison VPC répond aux exigences strictes en matière d'InfoSec.

- Boutique de fonctionnalités : La gestion centralisée des fonctionnalités réduit les fuites de données entre la formation et l'inférence.

Inconvénients (plaintes courantes)

Le sentiment négatif se concentre sur l'expérience des développeurs (DX) et l'opacité de la facturation.

- Chocs liés à la facturation : Les « ressources zombies » sont un thème récurrent des critiques. Les utilisateurs suppriment un point de terminaison mais oublient les volumes EBS attachés ou les accélérateurs d'inférence élastique, qui continuent à être facturés indéfiniment.

- Complexité du débogage : « Lorsqu'une tâche de formation échoue en raison d'une « AlgorithmError » opaque, il est plus difficile de déboguer les journaux de conteneurs sous-jacents dans CloudWatch que de déboguer un conteneur local », explique un utilisateur sur PeerSpot.

- Verrouillage AWS : La migration d'un modèle entraîné et enregistré dans SageMaker vers un autre cloud (par exemple, GCP ou sur site) est techniquement difficile car les artefacts du modèle sont souvent encapsulés dans des formats spécifiques à SageMaker.

Remarque concernant « SageMaker Gateway » : ce terme est souvent source de confusion. Il fait référence à l'intégration d'Amazon API Gateway aux terminaux SageMaker pour exposer les modèles en tant qu'API REST publiques. Bien que puissant, il introduit une couche supplémentaire de latence et de coût (API Gateway facture par million de requêtes) que les développeurs doivent gérer.

Amazon SageMaker en vaut-il la peine ?

La décision dépend de la philosophie architecturale de votre organisation et de l'élasticité budgétaire.

Quand SageMaker prend tout son sens :

- Centricité AWS : Vos données se trouvent dans S3, votre authentification est IAM et vous avez engagé d'importantes dépenses (EDP) auprès d'AWS.

- Conformité : Vous avez besoin de vous conformer immédiatement à FedRAMP, HIPAA ou SOC2 et vous ne disposez pas des ressources nécessaires pour créer une plateforme conforme sur Kubernetes brut.

- ML traditionnel : Votre objectif principal est la régression, la classification ou les flux de travail XGBoost/Scikit-Learn où les conteneurs prédéfinis de SageMaker excellent.

Quand envisager des solutions de rechange :

- GenAI et LLM Focus : SageMaker a été conçu pour le ML traditionnel. Bien qu'il prenne en charge les LLM, le flux de travail des développeurs semble modernisé.

- Exigences relatives au multicloud : Si vous devez exécuter une inférence sur GCP (pour la disponibilité du TPU) ou sur site (pour la souveraineté des données), SageMaker est une solution idéale.

- Contrôle des coûts : Vous devez optimiser l'utilisation du GPU et ne pouvez pas vous permettre la « prime de service géré » (généralement de 20 à 30 % par rapport à l'EC2 brut).

- Contrôle Kubernetes : Vous voulez des déploiements Kubernetes standard qui peuvent être débogués avec kubectl, plutôt que des API propriétaires.

TrueFoundry : une meilleure alternative à Amazon SageMaker

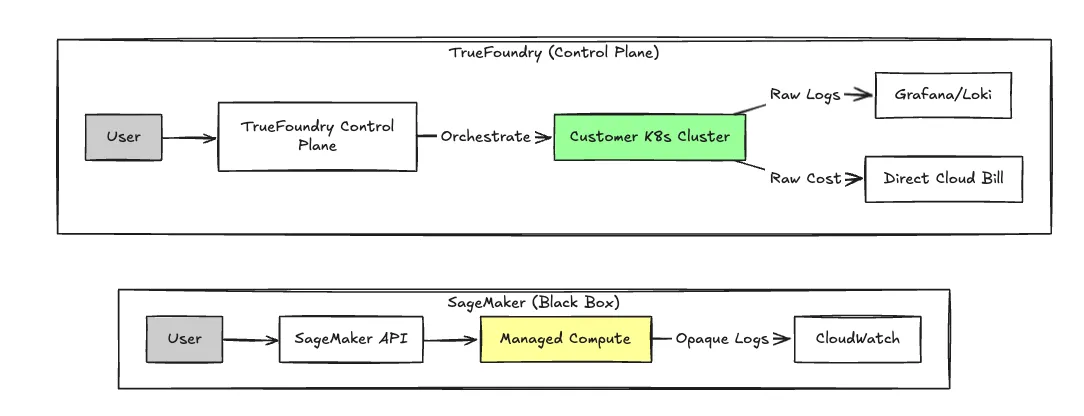

Pour les équipes qui trouvent SageMaker trop rigide ou trop coûteux, True Foundry fonctionne sur une architecture fondamentalement différente. Il s'agit d'un plan de contrôle situé au-dessus de votre propre compte cloud (AWS, GCP, Azure), plutôt que d'un service géré en boîte noire.

Cette approche « Bring Your Own Cloud » (BYOC) permet à TrueFoundry d'orchestrer le calcul au sein de votre VPC. Vous bénéficiez de l'expérience de développeur d'une plateforme gérée telle que Heroku, mais de l'économie unitaire sous-jacente des instances EC2/GKE/AKS brutes.

Comparaison : TrueFoundry et Amazon SageMaker

Comparaison de l'architecture

La différence essentielle réside dans l'endroit où s'effectue le calcul. Dans SageMaker, vous louez les capacités de calcul de la plateforme. Dans TrueFoundry, la plateforme orchestre vos fonctions informatiques.

Comment Whatfix a obtenu des cycles de publication 6 fois plus rapides et une flexibilité de déploiement mondiale

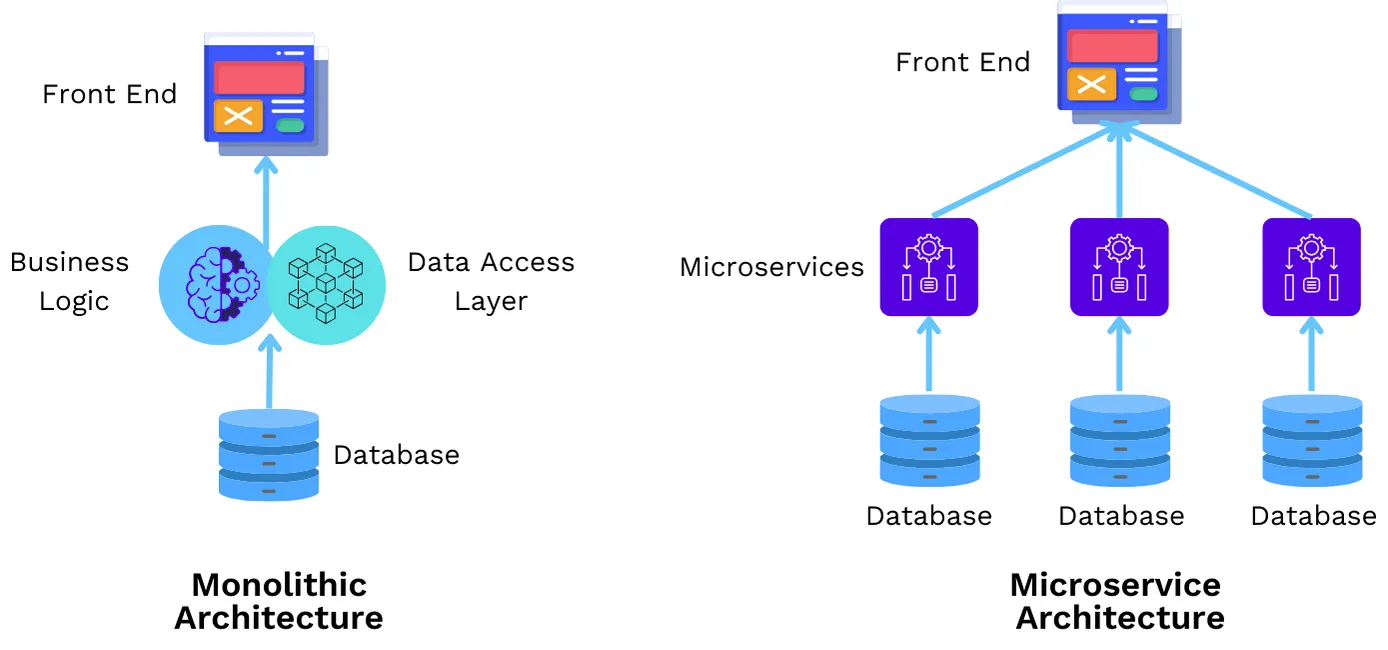

Whatfix, qui dessert plus de 80 entreprises du Fortune 500, avait besoin de moderniser son cycle de vie de publication dans divers environnements cloud et sur site. En adoptant TrueFoundry pour gérer ses microservices basés sur Kubernetes, l'entreprise a éliminé les difficultés liées aux déploiements monolithiques. Cette transition a réduit leur délai de déploiement sur site de trois mois à seulement deux semaines.

Whatfix a atteint un cycle de publication 6 fois plus court, ce qui a permis à une petite équipe DevOps de prendre en charge plus de 150 développeurs avec une interface unique pour la gestion multi-clusters.

Lisez l'histoire complète : Étude de cas sur la migration et le déploiement sur site de Whatfix Kubernetes

Verdict final

Amazon SageMaker est une boîte à outils robuste destinée aux entreprises. Si votre organisation est légalement ou techniquement liée à AWS et que vous disposez d'une équipe DevOps dédiée pour gérer les complexités de facturation et de configuration, il s'agit d'un choix standard et sûr.

Cependant, pour les équipes qui développent des applications GenAI modernes où la rareté des GPU et l'économie unitaire constituent des risques existentiels, la « taxe AWS » est difficile à justifier.

TrueFoundry propose l'évolution logique : la facilité d'utilisation d'un service géré associée à la liberté économique et architecturale de posséder votre infrastructure. Si vous devez déployer des LLM sur AWS et GCP pour trouver les GPU les moins chers, ou si vous souhaitez simplement un tableau de bord qui parle le langage des développeurs plutôt que celui des comptables, TrueFoundry est le meilleur choix architectural.

Réservez une démo avec TrueFoundry pour découvrir comment vous pouvez réduire vos coûts d'inférence de 40 % tout en reprenant le contrôle de votre infrastructure.

Questions fréquemment posées

Qu'est-ce qui fait de TrueFoundry une alternative idéale à Amazon SageMaker ?

TrueFoundry est l'alternative idéale à AWS SageMaker car elle permet un contrôle total de l'infrastructure sans recourir à une tarification « boîte noire ». Contrairement à un service entièrement géré classique, il permet aux data scientists d'héberger des modèles d'apprentissage automatique à l'aide de PyTorch ou de TensorFlow avec un minimum d'effort. Le Passerelle TrueFoundry AI élimine les tâches fastidieuses liées à l'orchestration tout en offrant l'évolutivité requise pour l'IA générative.

Quelle est la qualité d'Amazon SageMaker ?

SageMaker est techniquement mature et fiable pour le ML traditionnel. Elle excelle en termes de sécurité et de conformité, mais obtient de mauvais résultats en termes de convivialité, d'expérience de débogage et de transparence des coûts par rapport aux plateformes MLOps modernes.

Est-ce que SageMaker est meilleur que Databricks ?

Cela dépend des données. Databricks (Unified Data Analytics Platform) est la solution idéale pour les charges de travail gourmandes en Spark et le ML basé sur l'ingénierie des données. SageMaker est généralement préféré pour les tâches d'apprentissage profond et d'inférence pures lorsque les données sont déjà préparées dans S3.

Est-ce que SageMaker est largement utilisé ?

Oui, il détient la plus grande part de marché parmi les services de ML dans le cloud public, simplement en raison de la domination d'AWS. Cependant, la part de marché évolue à mesure que « l'indépendance du cloud » devient une priorité pour les stacks GenAI.

SageMaker est-il un concurrent d'OpenAI ?

Non. OpenAI fournit des modèles en tant que service (API). SageMaker fournit l'infrastructure nécessaire pour entraîner et héberger vos propres modèles (y compris des alternatives open source à OpenAI, comme Llama 3 ou Mistral).

Est-ce que SageMaker est meilleur qu'Azure ML ?

Ils sont similaires du point de vue fonctionnel. Azure ML est généralement considéré comme ayant une interface utilisateur plus intuitive et une meilleure intégration avec VS Code, tandis que SageMaker offre un contrôle plus granulaire de l'infrastructure de bas niveau pour les utilisateurs avancés.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)