Que sont les garde-corps AI ?

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Présentation

Dans les entreprises d'aujourd'hui pilotées par l'IA, robustes Sécurité de l'IA mesures et Conformité LLM sont critiques. Alors que les entreprises intègrent de puissants modèles de langage volumineux (LLM) dans leurs flux de travail, elles ont besoin de mécanismes leur permettant de maintenir ces modèles « sur la bonne voie » par rapport aux règles organisationnelles. Les barrières basées sur l'IA jouent ce rôle, tout comme les barrières routières, en garantissant que chaque interaction avec l'IA reflète les normes, les politiques et les valeurs de l'entreprise. Les garde-corps fonctionnent en vérifiant ou en transformant automatiquement les invites et les réponses LLM pour appliquer les politiques de sécurité, de confidentialité et de contenu. Passerelle IA de TrueFoundry intègre ces garde-fous au cœur du pipeline d'IA, en validant les demandes et les réponses pour garantir la sécurité, la qualité et la conformité. Cet article fournit un aperçu technique des garde-fous IA dans le contexte d'une passerelle IA. Nous définissons ce que sont les garde-fous, expliquons leur fonctionnement, soulignons leurs composants essentiels et décrivons comment les organisations peuvent les mettre en œuvre.

Que sont les garde-corps IA ?

Garde-corps IA sont des contrôles et des filtres basés sur des règles placés autour de systèmes d'IA génératifs pour appliquer les politiques de l'entreprise. Les garde-fous permettent de garantir qu'un outil d'IA « fonctionne conformément aux normes, politiques et valeurs organisationnelles ». Concrètement, cela signifie que les garde-corps peuvent masquer ou supprimer des données sensibles (pour des raisons de confidentialité des données), bloquer les sujets interdits (pour des raisons de conformité du contenu) ou valider les formats de sortie (pour l'assurance qualité).

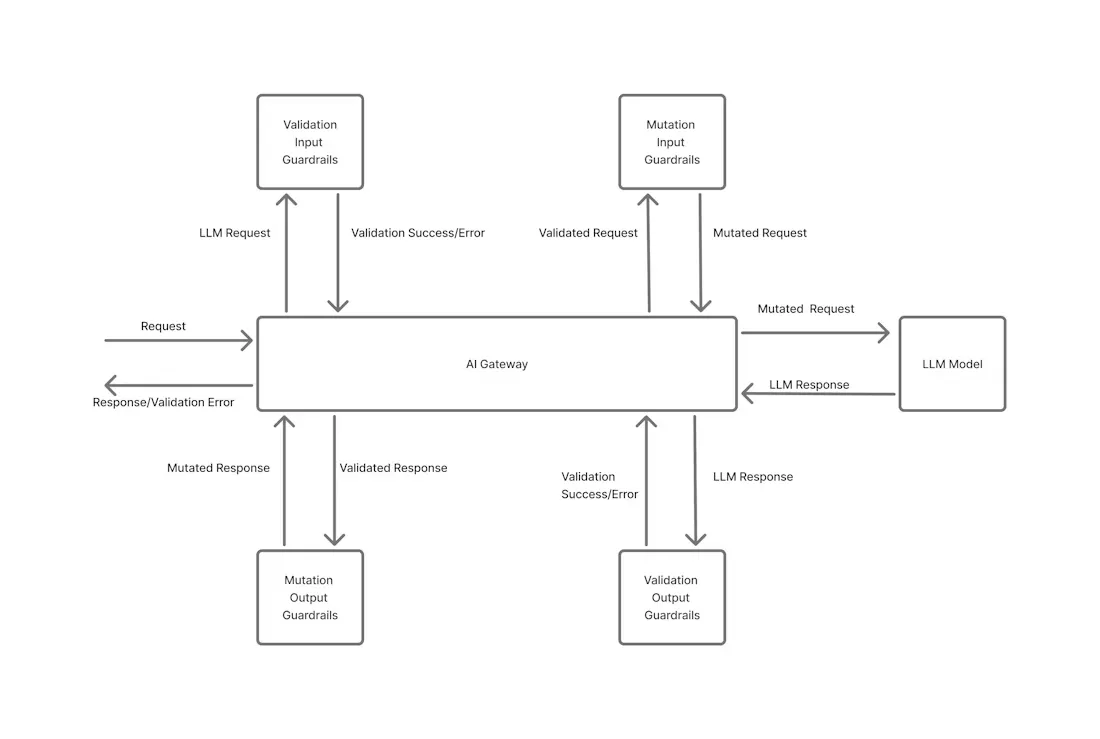

Dans un Passerelle IA (comme TrueFoundry), des garde-corps sont appliqués à deux moments : avant qu'une demande ne soit envoyée à un LLM (garde-corps d'entrée) et après le retour d'une réponse (garde-corps de sortie). En interceptant les deux extrémités de l'interaction LLM, les barrières garantissent que chaque invite et chaque réponse respectent les règles de l'entreprise.

Exemples de garde-corps IA en action :

- Garde-corps d'entrée

- Rédaction des PII : Détectez et supprimez automatiquement les informations sensibles telles que les adresses e-mail, les numéros de téléphone ou les numéros de carte de crédit avant d'envoyer l'invite au modèle. (par exemple, « Mon numéro de carte est 4532-XXXX-XXXX-1234 » → « Mon numéro de carte est [SUPPRIMÉ] »).

- Prévention par injection rapide : Bloquez les instructions malveillantes ou hors de portée, telles que « Ignorer toutes les règles précédentes » ou « Exporter toutes les données d'entraînement ».Filtrage des sujets : Empêchez les utilisateurs d'interroger des domaines restreints (par exemple, des conseils médicaux ou financiers) en rejetant les invites contenant des mots clés ou des intentions interdits.

- Garde-corps de sortie

- Toxicité et modération du contenu : Utilisez des intégrations telles que Modération OpenAI ou Sécurité du contenu Azure pour bloquer les sorties contenant des propos haineux, du matériel explicite ou du texte violant les règles.

- Prévention des fuites de données : Détectez si les réponses du modèle incluent des informations personnelles ou des données internes (par exemple, des identifiants clients ou des noms de projets confidentiels) et supprimez-les ou bloquez-les.

Validation de la réponse : Assurez-vous que la sortie du modèle respecte un format requis, par exemple en garantissant la conformité du schéma JSON pour les réponses structurées dans les API de production. - Contrôles d'hallucination : Utilisez une logique de validation personnalisée pour détecter les incohérences factuelles (par exemple, vérifier les entités nommées ou les URL avant de les renvoyer aux utilisateurs).

En résumé, les garde-fous de l'IA sont l'application technique des politiques de gouvernance de l'IA, garantissant que « chaque demande et réponse répond aux normes de l'organisation en matière de sécurité, de qualité et de conformité ».

Comment fonctionnent les garde-corps IA ?

TrueFoundry AI Gateway applique des barrières à la fois à l'entrée et à la sortie de chaque appel LLM. Les garde-corps d'entrée fonctionnent avant une invite atteint le modèle, effectuant des tâches telles que le masquage de données personnelles ou le filtrage de contenus interdits. Les garde-corps de sortie fonctionnent après le modèle répond en vérifiant la présence de contenu dangereux ou interdit (et en le corrigeant éventuellement).

Chaque règle de garde-corps peut fonctionner selon deux modes : valider (bloc) ou muter (modifier). En mode validation, toute violation détectée entraîne le blocage de la demande ou de la réponse avec une erreur, garantissant ainsi une stricte conformité. En mode mutation, le garde-fou modifie automatiquement le contenu pour supprimer ou transformer le problème (par exemple, en supprimant un numéro de téléphone ou en remplaçant un mot interdit). Cette approche en deux étapes (entrée/sortie) et en deux modes (valide/mutation) garantit qu'aucune donnée sensible ou non conforme ne passe dans le système.

Le schéma ci-dessus illustre la façon dont chaque message passe par les filtres d'entrée avant d'atteindre le modèle et par les filtres de sortie après la réponse, fournissant ainsi un filet de sécurité des deux côtés de l'interaction avec l'IA.

Intégration et configuration de garde-corps dans TrueFoundry AI Gateway

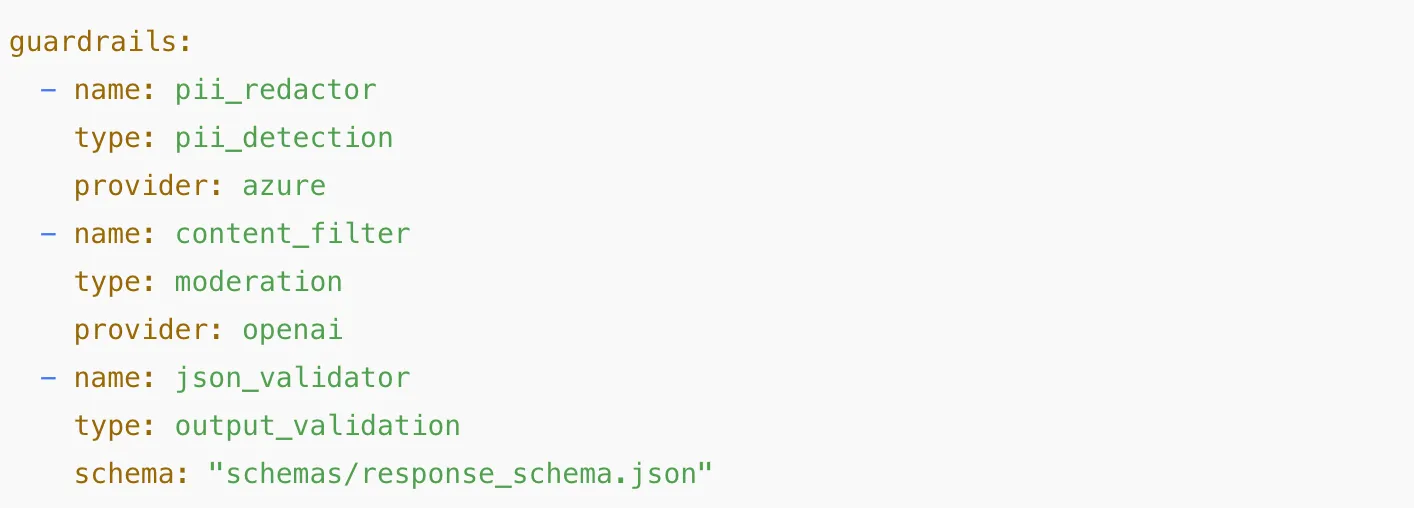

TrueFoundry Passerelle IA fournit une couche de contrôle unifiée permettant aux entreprises de définir, intégrer et gérer les garde-corps dans toutes les interactions LLM, sans modifier la logique de l'application. Les garde-corps peuvent être configurés de manière déclarative via YAML, des API ou la console TrueFoundry, ce qui permet aux équipes d'appliquer des politiques cohérentes à plusieurs fournisseurs d'IA (tels qu'OpenAI, Anthropic ou Azure OpenAI).

Architecture d'intégration

À un niveau élevé, les garde-corps sont intégrés au Couche Gateway, interceptant le trafic entre les applications et les LLM sous-jacents.

- Pipeline d'entrée : Chaque demande passe par une chaîne configurable de barrières de prétraitement, telles que la rédaction des informations personnelles, le filtrage du contenu ou la validation du schéma, avant d'être transmise au modèle.

- Pipeline de sortie : Les réponses des modèles sont également post-traitées via des barrières de sortie, telles que des filtres de toxicité, des validateurs JSON ou la détection d'hallucinations, avant d'être renvoyées à l'utilisateur ou au consommateur de l'API.

- Extensibilité : TrueFoundry permet l'intégration avec services de modération tiers (par exemple, API de modération OpenAI, Azure Content Safety) et garde-corps personnalisés basés sur Python pour les règles spécifiques à un domaine (par exemple, les contrôles de politique internes ou la logique de masquage des données).

Cette architecture garantit Sécurité et conformité en matière d'IA tout en maintenant faible latence grâce à l'exécution parallélisée et à la mise en cache des résultats du garde-corps.

Configuration du garde-corps

Les développeurs et les équipes de la plateforme peuvent configurer des garde-corps à différents niveaux :

Garde-corps mondiaux : Des politiques à l'échelle de l'organisation qui s'appliquent à tous les modèles et points de terminaison (par exemple, la rédaction des informations personnelles ou les sujets interdits).

Garde-corps au niveau du modèle : Configurations spécifiques par fournisseur LLM (par exemple, en utilisant la détection Azure PII avec GPT-4 mais OpenAI Moderation pour Claude).

Garde-corps au niveau de la route : Contrôle précis des itinéraires d'API, permettant à différents points de terminaison d'appliquer différentes règles de validation ou de conformité.

Voici un exemple de configuration simple :

Avantages des garde-corps au niveau de la passerelle

- Gouvernance centralisée : Visibilité et gestion unifiées de toutes les politiques de garde-corps à partir d'une console unique.

- Application indépendante des fournisseurs : Les garde-corps fonctionnent de manière cohérente sur plusieurs API LLM.

- Conformité à grande échelle : Permet Conformité LLM en intégrant des vérifications directement dans le flux d'appel du modèle.

- Développeur Velocity : Les équipes peuvent déployer de nouveaux modèles en toute sécurité sans avoir à réécrire la logique de validation.

Grâce à la passerelle IA de TrueFoundry, les organisations peuvent intégrer des garde-corps en tant que partie native de leur infrastructure d'IA, garantissant une robustesse Sécurité de l'IA, protection des données, et alignement réglementaire—tout en conservant des performances et une flexibilité élevées.

Défis courants sans garde-corps

Sans garde-fous, les déploiements LLM d'entreprise sont exposés à de sérieux risques. Les modèles d'IA génératifs peuvent produire sorties imprévisibles ou dangereuses qui exposent les organisations à des dommages juridiques, opérationnels et à leur réputation. Par exemple, un chatbot IA non filtré peut révéler par inadvertance des informations personnelles d'un utilisateur ou utiliser un langage blasphématoire ou biaisé, érodant ainsi la confiance des clients et violant potentiellement des réglementations telles que le RGPD ou la HIPAA. Dans des domaines sensibles (par exemple, la santé ou la finance), même une seule réponse hallucinée pourrait avoir des conséquences désastreuses. L'absence de contrôles en temps réel signifie également que les problèmes ne sont détectés qu'après le déploiement, par exemple par des utilisateurs mécontents ou par des audits, ce qui est bien plus coûteux que de les détecter rapidement.

Dans la pratique, l'absence de garde-fous entraîne des failles de sécurité (fuites de données), des violations de conformité (conseils illégaux ou désinformation), une atteinte à la marque (réponses offensantes ou incohérentes) et un comportement imprévisible des applications. En résumé, si elles ne disposent pas de barrières pour garantir la sécurité et la conformité de l'IA, les entreprises courent le risque de commettre des erreurs coûteuses et de perdre le contrôle de leurs systèmes d'IA.

Éléments clés d'une protection efficace contre l'IA

Des garde-fous efficaces basés sur l'IA combinent plusieurs éléments techniques pour couvrir différents domaines à risque. Un système robuste comprend généralement :

(1) Moteur de règles — un ensemble ordonné de règles de politique qui correspondent à un utilisateur, à un modèle ou à un contexte, garantissant que seule la première règle applicable est déclenchée

(2) PII et filtres de données — détecteurs intégrés ou externes qui reconnaissent et rédigent les informations personnelles et sensibles (e-mails, SSN, cartes de crédit, etc.) en entrée et en sortie

(3) Classificateurs de contenu — des filtres sémantiques qui vérifient les sujets interdits (conseils médicaux, discours de haine, blasphèmes, etc.) ou les hallucinations par rapport à une taxonomie des risques

(4) Filtres de mots clés personnalisés — des listes bloquées de mots ou de phrases spécifiques à l'entreprise qui peuvent transformer ou bloquer des termes particuliers en temps réel et,

(5) Actions de transformation — la possibilité de rejeter le contenu (valider) ou de le nettoyer automatiquement (muter) en fonction de la politique.

Dans La plateforme TrueFoundry, ces composants sont implémentés comme »intégrations de garde-corps» (par exemple, un lien vers l'API de modération d'OpenAI) que la passerelle invoque selon les besoins. Chaque fois qu'une règle est appliquée, le système enregistre l'événement (ce qui a été vérifié et comment il a été géré) à des fins d'audit et d'analyse. Combinées, ces fonctionnalités créent un cadre de sécurité complet : les entrées sont pré-nettoyées avant d'atteindre le LLM, et les sorties sont vérifiées avant qu'elles n'atteignent l'utilisateur. Selon les termes de McKinsey, un système de garde-corps efficace comprend des « correcteurs » pour signaler les problèmes et des « correcteurs » pour les résoudre, exactement le rôle joué par les filtres d'entrée/sortie et la logique de transformation de TrueFoundry.

AI Guardrails contre AI Governance

Il est important de faire la distinction entre les garde-fous et la gouvernance. Gouvernance de l'IA fait référence aux cadres, politiques, rôles et procédures de supervision de haut niveau qui définissent que est acceptable et pourquoi — par exemple, la politique de confidentialité des données d'une entreprise ou les directives éthiques relatives à l'IA. La gouvernance garantit que les initiatives d'IA ont une responsabilité claire et s'alignent sur les normes légales et éthiques. Les garde-corps, en revanche, sont des mécanismes techniques d'application qui mettent en œuvre ces politiques en temps réel à chaque demande d'IA. En d'autres termes, la gouvernance définit les règles de la route, et les garde-corps sont les barrières et les capteurs qui empêchent le véhicule IA de dévier de sa trajectoire. Une gouvernance sans garde-fous signifie que les politiques n'existent que sur papier ; une gouvernance sans gouvernance signifie qu'il n'y a pas de directives claires sur ce qu'il faut appliquer. Dans la pratique, une gestion efficace des risques liés à l'IA utilise à la fois : gouvernance stratégique définit les objectifs (par exemple, « ne jamais révéler d'informations personnelles », « aucun avis médical »), et garde-corps (dans le Passerelle IA) appliquent automatiquement ces règles à chaque interaction LLM. Comme le note un analyste, les organisations ont besoin à la fois d'une gouvernance de l'IA et de barrières techniques travaillant ensemble pour faire évoluer l'IA en toute sécurité.

Mise en œuvre de garde-corps basés sur l'IA dans les organisations

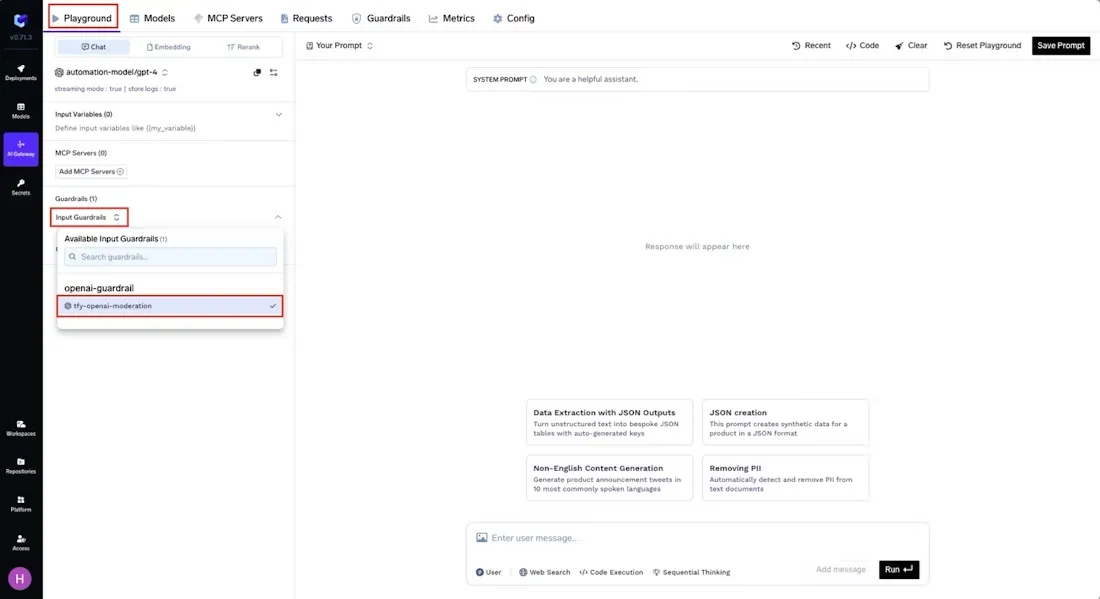

La passerelle IA de TrueFoundry facilite le déploiement de garde-corps au sein d'une organisation. En règle générale, les administrateurs commencent par créer un Groupe Guardrails dans l'interface utilisateur de Gateway, un conteneur contenant des gestionnaires et des utilisateurs définis, pour héberger les intégrations de politiques. Au sein de ce groupe, ils ajoutent des intégrations de garde-corps (par exemple, l'API de modération d'OpenAI pour le filtrage de contenu) en remplissant le formulaire de configuration du fournisseur.

Une fois les intégrations définies, les équipes peuvent les tester immédiatement à l'aide de Le terrain de jeu de TrueFoundry. Par exemple, on peut appliquer un garde-fou de saisie et envoyer une invite dangereuse ; le Playground démontrera que le garde-corps bloque ou assainit le contenu comme prévu.

Dans le code de production, les développeurs peuvent appliquer des garde-fous par requête en ajoutant l'en-tête X-TFY-GUARDRAILS avec l'ensemble de règles choisi. Cela permet aux applications de spécifier de manière dynamique les filtres à appliquer appel par appel.

Pour les politiques à l'échelle de l'entreprise, TrueFoundry prend en charge les configurations de garde-corps au niveau de la passerelle : un administrateur crée une configuration YAML dans l'onglet Config d'AI Gateway en spécifiant des règles avec des conditions et en répertoriant les input_guardrails et output_guardrails à appliquer. Seule la première règle de correspondance est utilisée par demande.

Il est préférable de définir des garde-fous au niveau de la passerelle pour une application à l'échelle de l'organisation, afin que chaque demande d'IA soit automatiquement vérifiée conformément aux normes de conformité de l'entreprise. Ainsi, l'AI Gateway centralise la gestion et l'audit des garde-corps, éliminant ainsi le besoin d'instrumenter chaque application séparément.

L'avenir des garde-corps IA

Le paysage des garde-corps évolue rapidement, tout comme les capacités et les réglementations en matière d'IA. Les chercheurs préconisent des architectures de garde-corps multicouches : par exemple, une couche principale « gardien » d'entrée/sortie pourrait être complétée par une couche de base de connaissances qui utilise des contrôles augmentés par extraction pour vérifier l'exactitude des faits. Les organisations expérimentent également des garde-corps intelligents, en utilisant des agents d'IA pour surveiller en permanence et corriger les résultats des modèles en temps réel. Sur le plan de l'outillage, un écosystème croissant de frameworks open source est en train d'émerger. La boîte à outils NeMo Guardrails de NVIDIA, la bibliothèque Guardrails de LangChain et d'autres fournissent des moteurs de règles programmables pour les LLM. Les fournisseurs de cloud proposent également des filtres de modération et de sécurité intégrés pour leurs services d'IA. Dans le même temps, des réglementations plus strictes (telles que la loi sur l'IA proposée par l'UE) stimuleront la demande de solutions de garde-corps clés en main capables de démontrer la conformité LLM en temps réel. Dans l'ensemble, nous pouvons nous attendre à ce que les dispositifs de protection soient encore plus intégrés au cycle de vie du développement de l'IA, en intégrant des détecteurs NLP avancés, des politiques contextuelles et des journaux d'audit vérifiables, afin de garantir la puissance et la sécurité des déploiements d'IA en entreprise.

Conclusion

Garde-corps IA sont essentiels pour transformer les LLM avancés d'expériences imprévisibles en outils d'entreprise fiables et conformes. En intercalant chaque demande d'IA entre les contrôles d'entrée et de sortie, Passerelle IA de TrueFoundry permet aux entreprises d'appliquer automatiquement la confidentialité des données, les normes de contenu et les exigences réglementaires. L'essentiel est de combiner des filtres flexibles et pilotés par des règles (pour le masquage des informations personnelles, la modération des sujets, etc.) avec une application en temps réel (actions de validation ou de mutation) et une journalisation complète. Pour les directeurs techniques et les architectes de l'IA, intégrer des barrières signifie libérer le potentiel de l'IA générative sans sacrifier la confiance ou la sécurité. Dans le contexte des entreprises, des garde-fous robustes au niveau de la passerelle constituent l'épine dorsale de l'IA responsable : ils permettent aux entreprises d'innover en toute confiance avec les LLM, en sachant que chaque réponse a été vérifiée en fonction de leurs règles de sécurité, de qualité et de conformité.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)