Vercel AI Gateway vs OpenRouter: ¿Cuál es el mejor para usted?

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Introducción

A medida que los equipos adoptan grandes modelos lingüísticos en todos los productos y sistemas internos, Puertas de enlace de IA se han convertido en una capa arquitectónica común. En lugar de integrarse por separado con cada proveedor de modelos, los equipos buscan cada vez más un API única que abstrae las diferencias entre los proveedores, simplifica el enrutamiento y reduce la sobrecarga de integración.

Esto ha llevado al surgimiento de ofertas tipo gateway que prometen un desarrollo más rápido y una experimentación más sencilla. Entre estas, Puerta de enlace Vercel AI y Enrutador abierto se comparan con frecuencia, a menudo porque ambas se encuentran entre las aplicaciones y varios proveedores de LLM.

Sin embargo, aunque parecen similares en la superficie, los dos están diseñados para necesidades y etapas muy diferentes de adopción de la IA. Uno está optimizado para la experiencia de los desarrolladores frontales, mientras que el otro prioriza el acceso amplio a los modelos y la experimentación rápida.

El objetivo de esta comparación es aclarar esas diferencias en todo el ámbito, la arquitectura y la preparación para la producción, de modo que los equipos puedan elegir la puerta de enlace adecuada para su caso de uso.

Para obtener más información sobre el panorama de AI Gateway y las consideraciones que hay que tener en cuenta antes de elegir un proveedor, lea la La guía de mercado de Gartner para AI Gateways 2025 está aquí.

¿Qué es Vercel AI Gateway?

Puerta de enlace Vercel AI forma parte de la plataforma de aplicaciones más amplia de Vercel y está diseñada para facilitar a los desarrolladores el consumo de LLM internamente aplicaciones web y basadas en frontend.

A un alto nivel, Vercel AI Gateway:

- Proporciona una interfaz unificada para los proveedores de LLM seleccionados

- Está estrechamente integrado con el Vercel AI SDK

- Funciona a la perfección con Next.js, las funciones sin servidor y los tiempos de ejecución periféricos

Su enfoque principal es experiencia de desarrollador. Los desarrolladores que crean aplicaciones en Vercel pueden añadir capacidades de LLM con una configuración mínima, sin preocuparse por las credenciales o los SDK específicos del proveedor.

Es importante destacar que Vercel AI Gateway se entiende mejor como puerta de enlace a la capa de aplicación. Está optimizado para simplificar el uso de la LLM dentro de las aplicaciones alojadas en Vercel, en lugar de actuar como un plano de control a nivel de infraestructura para la IA en todos los equipos, entornos o despliegues.

¿Qué es OpenRouter?

Enrutador abierto está basado en la nube modelo de plataforma de enrutamiento y agregación que proporciona una API única para acceder a una amplia gama de LLM de todos los proveedores

Las principales fortalezas de OpenRouter incluyen:

- Acceso a cientos de modelos de varios proveedores

- Fácil cambio y comparación entre modelos

- Límites de facturación y tarifas agregados a través de una API

Esto hace que OpenRouter sea particularmente atractivo para:

- Desarrolladores que experimentan con diferentes modelos

- Equipos que evalúan o comparan el comportamiento de LLM

- Creación rápida de prototipos sin compromiso con un solo proveedor

OpenRouter es intencionadamente ligero. Se centra en enrutamiento y agregación, no en el despliegue, la gobernanza o la administración de la infraestructura. Como resultado, funciona bien como modelo de router, pero no está diseñado para servir como una capa de control de IA centralizada para los sistemas de producción.

Lea también: Alternativas a OpenRouter

Vercel AI Gateway frente a OpenRouter: las principales diferencias de un vistazo

Alcance de la arquitectura y la implementación

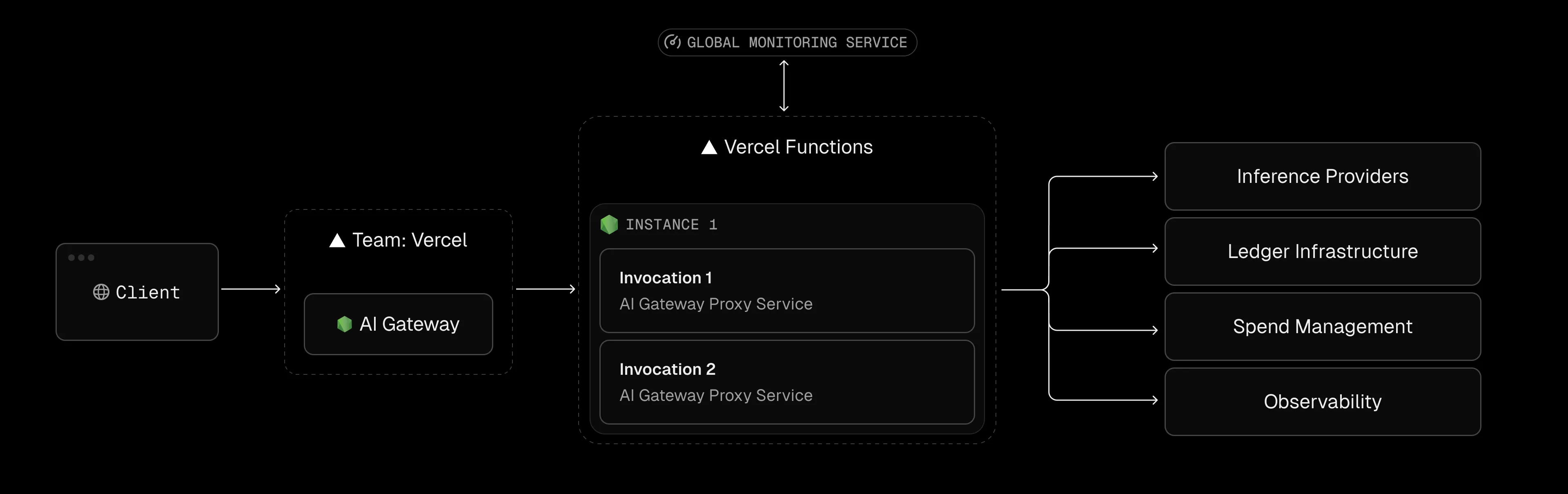

Arquitectura Vercel AI Gateway

Vercel AI Gateway está diseñado como puerta de enlace gestionada dentro del ecosistema Vercel. Su aplicación (que suele utilizar el SDK de IA de Vercel) envía solicitudes a la puerta de enlace y Vercel gestiona la conectividad del proveedor, el comportamiento de enrutamiento y los controles de uso. La puerta de enlace está posicionada para ayudar a los equipos envía más rápido sin administrar las cuentas y claves de los proveedores, al tiempo que ofrece botones operativos como presupuestos, supervisión del uso, equilibrio de carga y soluciones alternativas.

Implicación del alcance: está optimizado para Aplicaciones alojadas en Vercel y flujos de trabajo para desarrolladores, no para ejecutar la puerta de enlace dentro de su propia infraestructura privada.

Arquitectura OpenRouter

OpenRouter es un capa de enrutamiento en la nube: su aplicación llama a la API de OpenRouter y OpenRouter dirige el tráfico al modelo/proveedor elegido. Soporta controles de enrutamiento como enrutamiento de proveedores, y ofrece funciones como Enrutador automático para seleccionar entre los modelos en función de la solicitud, además de las alternativas de los modelos y el equilibrio de carga en función de la disponibilidad.

Desde el punto de vista de los datos y las operaciones, OpenRouter documenta lo que registra metadatos básicos de solicitud y eso las solicitudas/finalizaciones no se registran de forma predeterminada (a menos que te suscribas).

También admite los patrones de uso del equipo a través de Organizaciones (créditos compartidos, administración centralizada de claves y seguimiento del uso).

Implicación del alcance: es genial para acceso y enrutamiento multimodelo, pero sigue siendo fundamentalmente un servicio gestionado en la nube en lugar de algo que se implementa dentro de los límites de la red.

Dónde encaja TrueFoundry: perspectiva de puerta de enlace de inteligencia artificial empresarial

Tanto Vercel AI Gateway como OpenRouter ayudan a unificar el acceso a los modelos, pero muchos equipos se enfrentan a un nuevo conjunto de requisitos a medida que pasan de aplicaciones únicas o experimentación a despliegues de IA a escala empresarial. En esta etapa, la comodidad por sí sola ya no es suficiente.

Los requisitos comunes que surgen incluyen:

- Despliegues privados (entornos de VPC, locales o aislados)

- Gobierno centralizado en varios equipos y aplicaciones

- Auditabilidad y aplicación de políticas como comportamiento predeterminado

- Observabilidad constante en todos los modelos, proveedores y entornos

Esta es la brecha que True Foundry está diseñado para llenar.

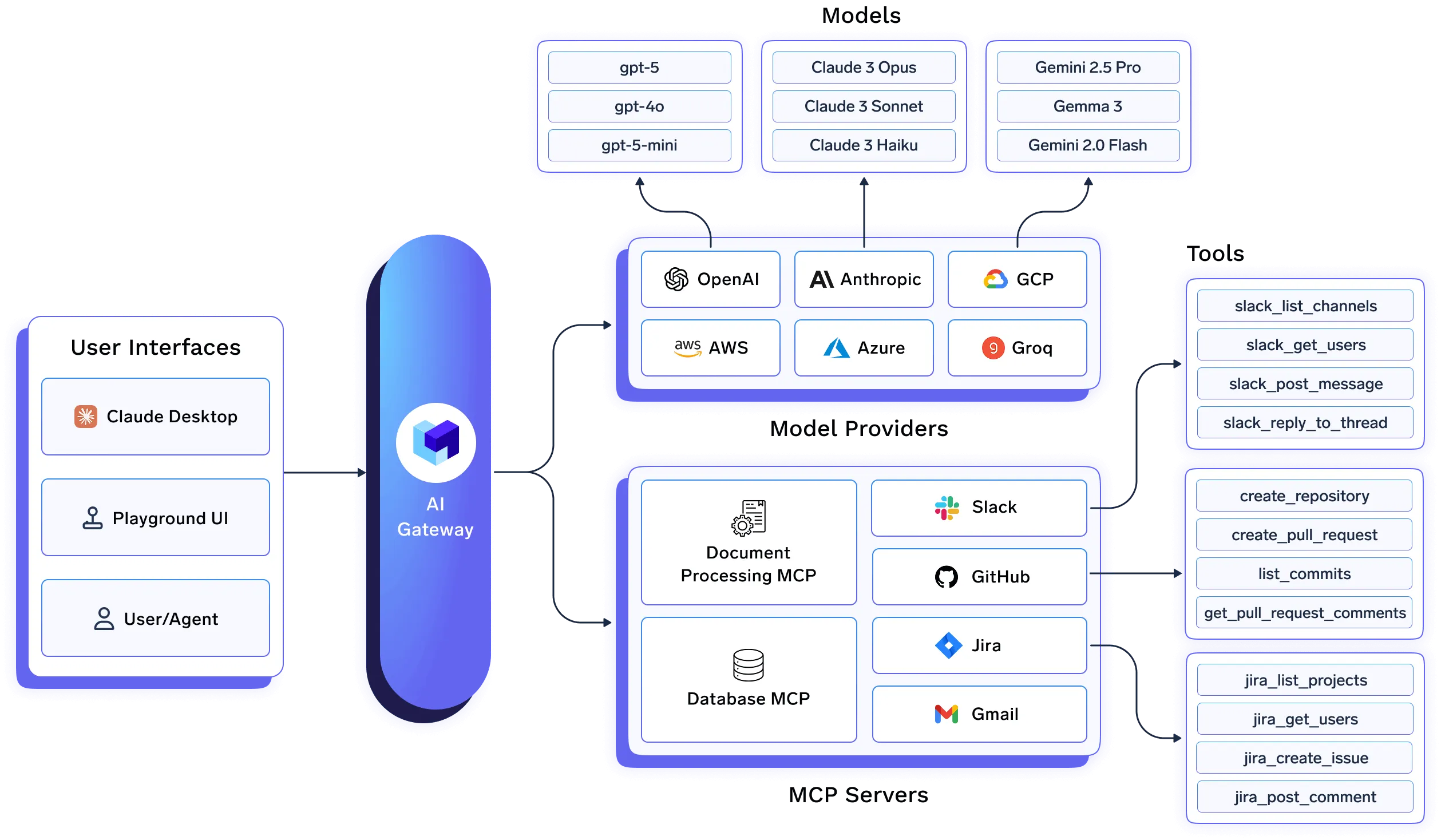

True Foundry Puerta de enlace de IA está construido como plano de control a nivel de infraestructura, no solo una capa de conveniencia de enrutamiento o aplicación. Se puede implementar como SaaS o autohospedado dentro de su propia infraestructura local o en la nube, lo que permite a las organizaciones mantener el tráfico de LLM dentro de sus límites de seguridad y cumplimiento y, al mismo tiempo, estandarizar el acceso detrás de una única puerta de enlace.

Más allá del enrutamiento básico, la puerta de enlace TrueFoundry proporciona:

- Control de acceso centralizado y políticas de uso aplicado de manera uniforme en todos los equipos

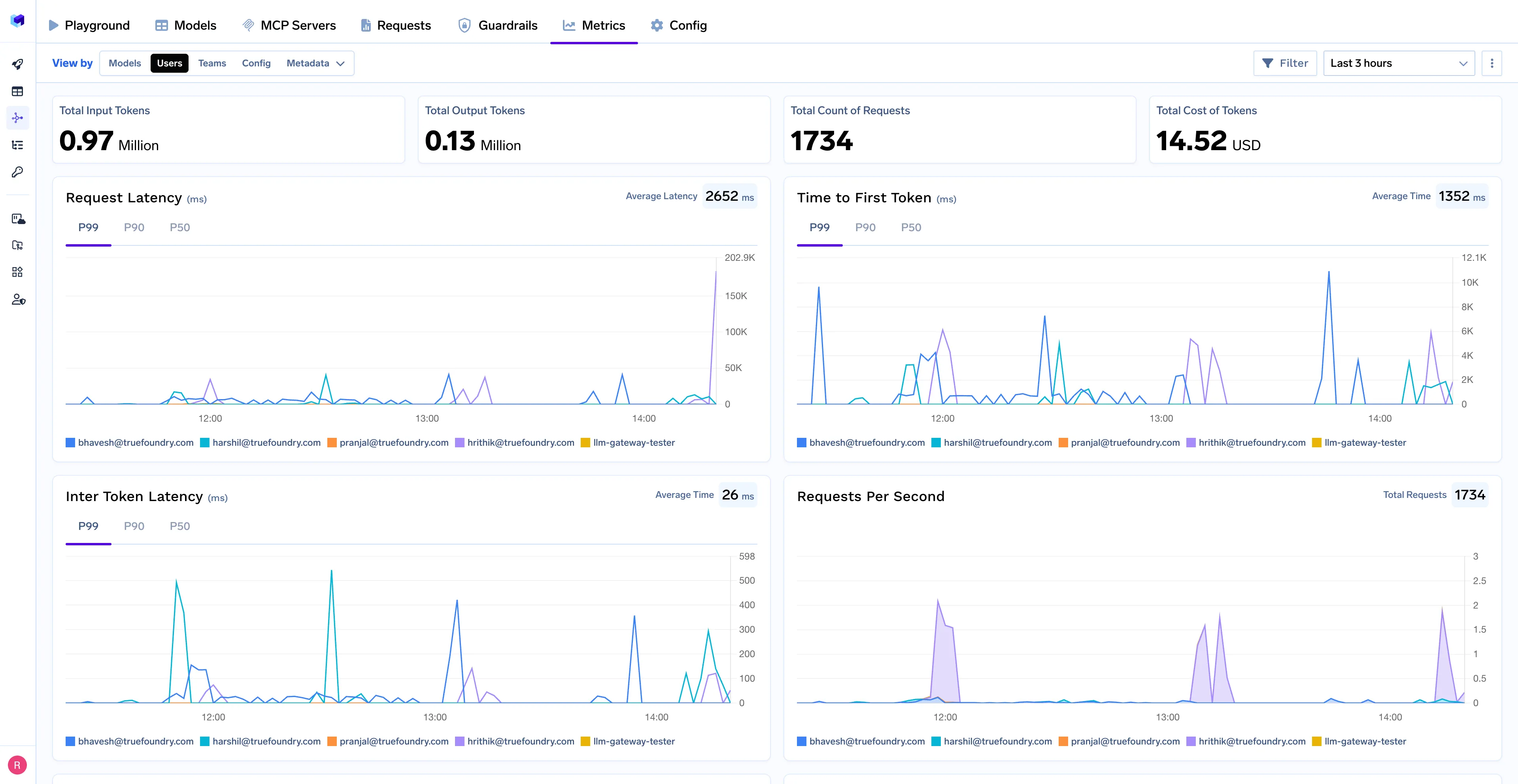

- Observabilidad unificada, incluidos el uso, la latencia y la atribución de costos por aplicación o equipo

- Enrutamiento independiente del modelo, que funciona con modelos autohospedados, modelos ajustados y proveedores externos

- Listo para la producción primitivas de despliegue, diseñado para integrarse de forma limpia con los entornos nativos de Kubernetes

En lugar de reemplazar las herramientas centradas en los desarrolladores, TrueFoundry las complementa a medida que las organizaciones maduran. Está diseñado para equipos que necesitan seguridad, cumplimiento y visibilidad operativa de nivel empresarial a medida que los LLM pasan de experimentos aislados a flujos de trabajo empresariales principales.

En la práctica, esto significa tratar el acceso a la LLM como infraestructura compartida, no una lógica específica de la aplicación, en la que las políticas, la observabilidad, los controles de costos y los límites de implementación se aplican de manera centralizada, independientemente de cómo los equipos individuales construyan o implementen sus aplicaciones.

Conclusión

Tanto Vercel AI Gateway como OpenRouter desempeñan un papel importante a la hora de simplificar el acceso a modelos lingüísticos de gran tamaño, pero están diseñados para diferentes etapas de la adopción de la IA. Vercel AI Gateway prioriza la experiencia de los desarrolladores dentro del ecosistema de Vercel, mientras que OpenRouter se destaca en la agregación de modelos y la experimentación rápida.

A medida que las organizaciones van más allá de las aplicaciones individuales, surgen nuevos requisitos en torno a la gobernanza, la observabilidad, el control de la implementación y el cumplimiento. En esta etapa, las pasarelas a nivel de aplicación o que solo utilizan enrutamiento suelen convertirse en limitantes.

Aquí es donde las pasarelas a nivel de infraestructura, como True Foundry entra en juego. Al tratar el acceso a la LLM como una infraestructura empresarial compartida y no como una lógica de aplicaciones, los equipos obtienen el control y la visibilidad necesarios para operar los sistemas de IA de manera confiable en la producción.

La elección de la puerta de enlace adecuada depende, en última instancia, del punto en el que se encuentre la organización en su camino hacia la IA, y comprender estas distinciones desde el principio ayuda a evitar la modificación de la arquitectura a medida que la IA se convierte en un elemento fundamental de la empresa.

Preguntas frecuentes

¿Cuál es la diferencia entre OpenRouter y Vercel AI?

OpenRouter es una API unificada que permite a los desarrolladores acceder a muchos modelos de IA (OpenAI, Anthropic, etc.) a través de un punto final. El Vercel AI SDK de Vercel es un conjunto de herramientas para crear aplicaciones de IA e interfaces de chat en marcos web como Next.js. OpenRouter se centra en el enrutamiento por modelos; Vercel AI se centra en el desarrollo de aplicaciones de IA frontend.

¿Qué es mejor: Vercel AI Gateway o OpenRouter?

El Vercel AI Gateway es mejor si ya implementas aplicaciones en Vercel y deseas integrar el registro, el almacenamiento en caché y el enrutamiento dentro de tu proyecto. OpenRouter es mejor para acceder a muchos modelos de IA de diferentes proveedores en un solo lugar, con precios flexibles y cambios de modelo entre plataformas.

¿Vercel es similar a OpenRouter?

No, Vercel y OpenRouter no son lo mismo. Vercel es principalmente una plataforma en la nube para implementar aplicaciones web e incluye herramientas de desarrollo de inteligencia artificial. OpenRouter es específicamente un servicio de API que dirige las solicitudes a múltiples modelos de IA. Se superponen en el uso de la IA, pero tienen diferentes propósitos principales.

¿Es posible alojar Vercel AI Gateway u OpenRouter en las instalaciones?

No. Ambos son servicios en la nube totalmente gestionados sin soporte para alojamiento privado o local. Las implementaciones empresariales que requieren entornos de VPC, de nube aislada o privada deben considerar plataformas como TrueFoundry.

¿Vercel AI Gateway puede gestionar experimentos con varios modelos como OpenRouter?

No. Vercel AI Gateway se centra en simplificar el uso de la LLM en las aplicaciones de Vercel. No admite la experimentación con varios modelos o proveedores. Para probar, cambiar y comparar varios modelos, OpenRouter o una plataforma de nivel empresarial como TrueFoundry son más adecuados.

¿En qué se diferencia TrueFoundry de Vercel AI Gateway y OpenRouter?

TrueFoundry es una puerta de enlace de IA de nivel empresarial que proporciona gobernanza, observabilidad, control de acceso y cumplimiento centralizados. A diferencia de Vercel AI (centrada en la interfaz) o OpenRouter (enrutamiento multimodelo), gestiona el tráfico de LLM en todos los equipos y entornos, lo que permite gestionar los modelos de forma segura, lista para la producción y a nivel de infraestructura.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)