Prompting, RAG o ajuste fino: ¿la elección correcta?

%20(11).webp)

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Introducción

La incitación, el ajuste fino y la generación aumentada de recuperación (RAG) son las técnicas de aprendizaje de LLM más populares. La elección de la técnica correcta implica una evaluación cuidadosa de los requisitos, los recursos y los resultados deseados del proyecto.

En las siguientes secciones, profundizaremos en cada técnica, analizaremos sus complejidades, aplicaciones y cómo decidir cuál es la más adecuada para sus necesidades

Indicación o ajuste fino, o RAG: elegir el enfoque correcto

Identificación de los requisitos de su proyecto

El primer paso para decidir entre solicitar, ajustar y RAG es examinar detenidamente los datos de los que dispone y el problema específico que pretende resolver. Considera si tu tarea implica conocimientos comunes o información especializada o requiere datos actualizados de fuentes externas. La complejidad del problema, el estilo y el tono del resultado deseado y el nivel de personalización necesario también son factores críticos.

Si se trata de temas altamente especializados o de nicho, es posible que sea necesario realizar ajustes o RAG para lograr el nivel deseado de precisión y relevancia. Por otro lado, si tu proyecto implica consultas más generales o la creación de contenido, las indicaciones podrían ser suficientes y más rentables.

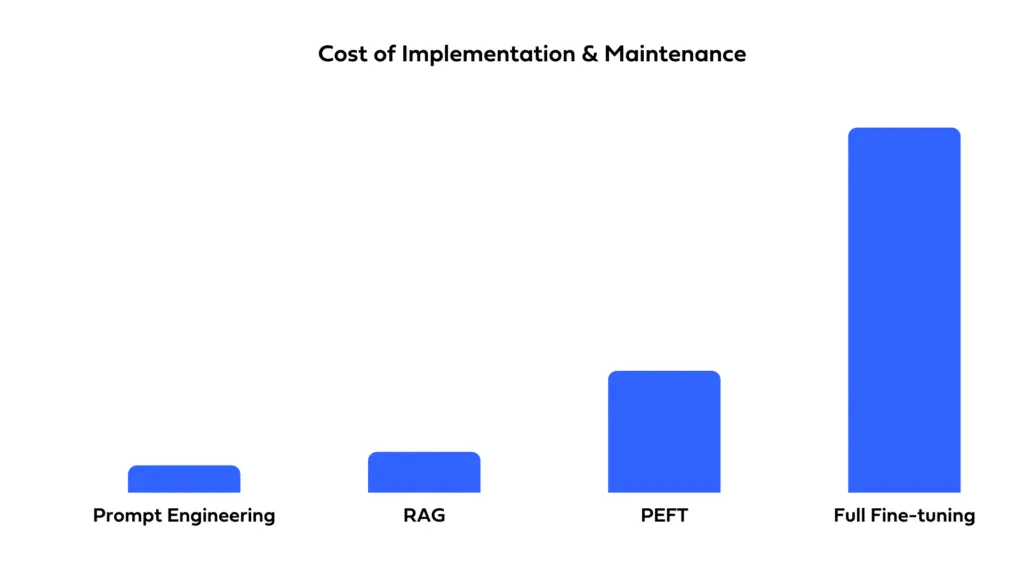

Evaluación de las implicaciones financieras de cada enfoque

La elección entre la incitación, el ajuste y la RAG también depende de las restricciones presupuestarias. La solicitud es, por lo general, la que consume menos recursos, ya que utiliza el modelo tal cual. El ajuste preciso requiere datos y recursos computacionales adicionales para la capacitación, lo que genera costos más altos. El RAG también puede consumir muchos recursos, especialmente si implica configurar y mantener una base de datos externa para su recuperación.

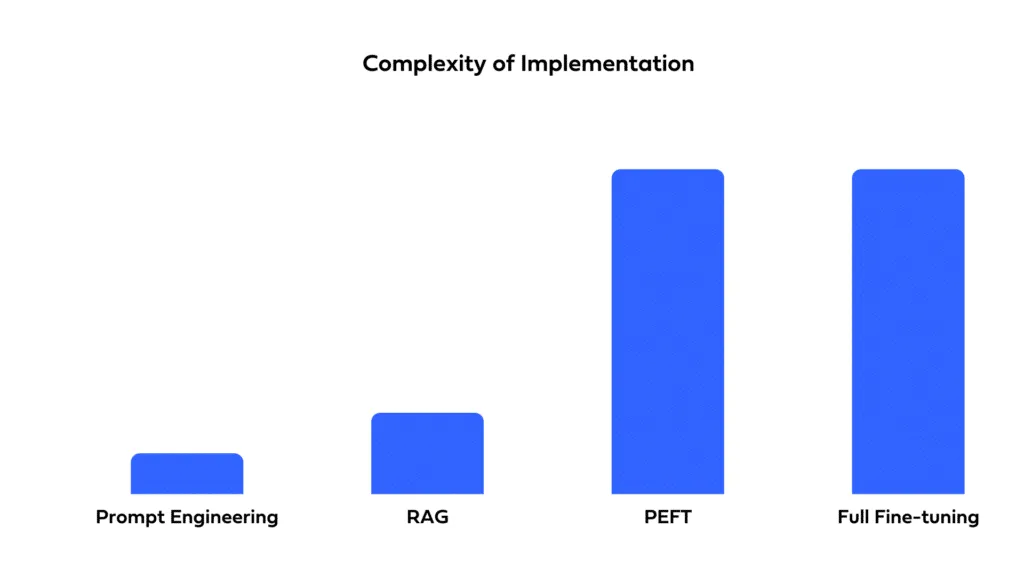

Tiempo de implementación y requisitos de recursos

Tenga en cuenta la rapidez con la que necesita implementar la solución y los recursos de los que dispone. Las indicaciones permiten una implementación rápida con un tiempo de configuración mínimo. El ajuste fino, si bien puede ofrecer un mejor rendimiento, requiere tiempo para la capacitación y la optimización. La tecnología RAG implica la complejidad de integrar fuentes de datos externas, lo que puede ampliar los plazos de desarrollo y requerir conocimientos especializados.

Transparencia e interpretabilidad

RAG facilita la atribución de la fuente, lo que permite a los usuarios discernir el origen de la información utilizada para generar la respuesta. La indicación y el ajuste fino actúan como una caja negra que dificulta el rastreo de las respuestas.

Cuándo optar por Prompting

Escenarios en los que la incitación es la opción más eficaz

Prompting es ideal para proyectos que requieren soluciones rápidas y rentables y puede basarse en la base de conocimientos generales de modelos previamente entrenados. Se adapta a aplicaciones como:

- Creación de contenido general: Elaboración de publicaciones de blog, artículos o escritura creativa en los que el tono y el estilo sean flexibles.

- Respuesta a preguntas básicas: Proporcionar a los usuarios información sobre una amplia gama de temas sin la necesidad de contar con una amplia experiencia en el campo.

- Desarrollo de prototipos: Creación rápida de prototipos para validar ideas o conceptos antes de invertir en soluciones más complejas.

Limitaciones y consideraciones

Si bien las solicitudes son muy accesibles, es posible que no siempre proporcionen la precisión o la personalización necesarias para tareas especializadas. La calidad de los resultados puede variar considerablemente en función del diseño de la solicitud, lo que requiere una elaboración y unas pruebas cuidadosas.

Cuándo optar por el ajuste fino

Proyectos que se benefician del ajuste fino

El ajuste fino es el método preferido cuando su proyecto exige un alto grado de especificidad o necesita alinearse estrechamente con estilos, tonos o conocimientos específicos de un dominio determinado. Es particularmente eficaz para:

- Atención al cliente especializada: Adaptar las respuestas para reflejar los productos, los servicios y el estilo de interacción con los clientes de su empresa.

- Generación de contenido dirigido: Crear contenido que se adhiera a las directrices específicas de la marca o a la jerga del sector.

- Análisis de datos mejorado: Generar información a partir de datos que requieren la comprensión de nichos de mercado o escenarios complejos.

Equilibrar los costos y los beneficios

La decisión de realizar un ajuste fino debe considerar la compensación entre la mejora del rendimiento y los costos y recursos adicionales necesarios. Es esencial para los proyectos en los que el valor de la personalización y la precisión supera estas consideraciones.

Cuándo optar por RAG

Identificación de casos de uso que requieren las capacidades de RAG

RAG sobresale en situaciones en las que las respuestas deben complementarse con la información más reciente o datos detallados de dominios específicos. Es especialmente adecuado para:

- Creación de contenido dinámico: Generar contenido que incluya los últimos avances, estadísticas o hallazgos.

- Resolución de consultas complejas: Responder a preguntas multifacéticas que se benefician de la síntesis de información de diversas fuentes.

- Asistencia de investigación en profundidad: Proporcionar explicaciones o resúmenes detallados basados en una amplia gama de documentos y datos.

Comparación de RAG con otros enfoques en términos de complejidad y rendimiento

RAG puede ofrecer resultados superiores para consultas complejas y áreas de conocimiento especializadas, pero conlleva una mayor complejidad y necesidades de recursos. Es la elección correcta cuando el alcance del proyecto justifica la inversión en la creación y el mantenimiento de la infraestructura necesaria para la recuperación de datos en tiempo real

Prompting, RAG y ajuste fino con TrueFoundry

Ingeniería rápida

La solicitud está habilitada por nuestro Puerta de enlace LLM módulo, que admite los flujos de trabajo que a menudo se asocian a mejores herramientas de ingeniería rápida utilizado para aplicaciones de LLM de producción. LLM Gateway ofrece una API unificada que permite a los usuarios acceder a varios proveedores de LLM, incluidos sus propios modelos autohospedados, a través de una única plataforma. Cuenta con funciones centralizadas de administración de claves, autenticación y atribución de costos. Además, ofrece soporte para el retroceso y los reintentos, así como para la integración con barreras de seguridad.

TRAPO

Hemos creado plantillas para el flujo de trabajo para configurar RAG con solo unos pocos clics. Lea nuestro blog sobre cómo implementar un Chatbot basado en RAG usando TrueFoundry. Se encarga del proceso integral de creación de una base de datos vectorial, incrustación de modelos, LLM, etc., a la vez que le brinda los controles adecuados para personalizar el flujo de trabajo de acuerdo con sus necesidades.

Afinación fina

TrueFoundry ha simplificado la ajuste fino procese abstrayendo todas las complejidades y configurando las configuraciones de recursos correctas para las técnicas de LoRa/QLoRa. Puede implementar un portátil Jupyter de ajuste fino para experimentar o iniciar un trabajo de ajuste específico. Lea la guía detallada aquí.

Estamos en True Foundry admiten las tres técnicas de aprendizaje de LLM: instrucciones, RAG y ajuste fino de una manera extremadamente simplificada.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)