MCP Registry & AI Gateway: arquitectura y casos de uso empresarial

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Entre 2020 y 2023, modelos de fundaciones como GPT-3 y GPT-4 demostraron que los modelos lingüísticos grandes pueden generar texto similar al humano, escribir código, resumir documentos y responder preguntas complejas, pero estos modelos fueron apátridas y en caja de arena, no podían acceder a los sistemas internos, las bases de datos ni las aplicaciones, y no tenían forma de tomar medidas reales.

Puedes preguntarle a una modelo:

»Escriba una consulta de MongoDB para enumerar todas las colecciones de la base de datos de cumplimiento.»

Generaría una producción que miró como una consulta de MongoDB válida, pero:

- No tenía ni idea de si el la base de datos existía

- No sabía qué colecciones estuvieron presentes en el DB

- No podía decir si el la consulta incluso se ejecutaría

- No había manera de inspeccionar esquemas, verificar los resultados, o desencadenar acciones de seguimiento como resumir o notificar a otro sistema

Era todo conjetura — con sin circuito de retroalimentación.

Para solucionar este problema, los desarrolladores comenzaron a crear capas alrededor de los LLM:

- Encadenamiento rápido

- Envoltorios personalizados en Python

- Inyección de llamadas a la API REST mediante plantillas de cadenas

- Relleno manual de contexto

(«usando el siguiente esquema, escribe la consulta»)

Estas fueron soluciones inteligentes, pero más difícil de mantener.

Frameworks como Cadena LANG, Índice Llama, y Núcleo semántico surgió para organizar estos flujos de trabajo. Estas herramientas ayudaron a organizar las cosas, pero los problemas no desaparecieron. Los modelos seguían siendo campos alucinantes, caían en la trampa de ser inyectados rápidamente, se saltaban la validación y no tenían una forma estándar definida de ejecutar las funciones reales. Cada nuevo caso de uso seguía siendo como reinventar la rueda.

El verdadero punto de inflexión se produjo cuando los desarrolladores se dieron cuenta de:

»No necesitamos modelos para adivinar los comandos. Necesitamos que llamen a funciones reales, de la misma manera que las aplicaciones de frontend llaman a las API de backend.»

A mediados de 2023, OpenAI presentó llamada a funciones, lo que permite que los modelos vuelvan estructurados JSON salida que se asignó directamente a llamadas a funciones reales.

Redefinió lo que era posible con la integración de modelos

- Los LLM ahora pueden interactuar con herramientas que utilizan entradas y salidas claramente definidas

- Las modelos se comportaron como Clientes de API, en lugar de generadores basados en conjeturas

- Las tareas ahora podrían ser automatizado con múltiples pasos e interacciones del sistema

Con la llamada a funciones llegó el auge de herramientas y agentes — modelos que podrían encadenar acciones, seguir los flujos de trabajo e interactuar con sistemas reales

Pero...

1. Cada implementación fue específico del proveedor.

2. No se compartió ninguno formato estándar para saber cómo se describieron o invocaron las herramientas.

Aquí es donde MCP (Protocolo de contexto modelo) entra — propuesto como protocolo abierto general para una comunicación estructurada entre modelos y herramientas externas. En lugar de codificar las API de las herramientas en cada aplicación de LLM, MCP ofrece una cargador universal para conexiones AI-Tool — como API abierta, Antrópico etc., pero para las herramientas de llamadas de LLM. Se basa en JSON-RPC 2.0, una especificación muy utilizada que admite llamadas a procedimientos remotos (RPC) mediante JSON.

Qué define MCP

- Cómo un modelo puede llamar a un método de herramienta (p. ej., runAggregation)

- Cómo pasar parámetros y obtener respuestas estructuradas

- Cómo describen las herramientas los métodos disponibles (mediante esquemas o manifiestos)

- Un estándar ligero para la integración de herramientas en cualquier backend (base de datos, CLI, API en la nube)

Piense en MCP como el contrato de API entre un modelo y una herramienta. Sin un protocolo estándar, se requieren todas las integraciones ingeniería personalizada — costoso, propenso a errores y repetitivo. MCP resolvió esto creando un idioma universal, simplificando la integración de herramientas de una vez por todas. Pero, ¿qué es exactamente el MCP y cómo funciona en la práctica? Profundicemos más.

Protocolo de contexto modelo

MCP (Protocolo de contexto modelo) es un protocolo ligero diseñado específicamente para la comunicación estructurada entre Modelos de IA y herramientas externas.

En esencia, MCP usa JSON-RPC 2.0, un protocolo probado para llamar a procedimientos remotos con entradas y salidas estructuradas, perfecto para convertir la salida de LLM en invocaciones de herramientas del mundo real.

Así que ¿por qué inventar otro protocolo?

Opciones existentes como DESCANSAR o GraphQL son demasiado genéricas, demasiado detalladas o demasiado frágiles para los flujos de trabajo centrados en la IA. MCP cierra esta brecha al proporcionar una estructura clara, una sobrecarga mínima y un enfoque explícito en los flujos de trabajo centrados en la IA. No pretende reemplazar las API, sino permitir que los modelos las usen de forma segura, repetible y predecible.

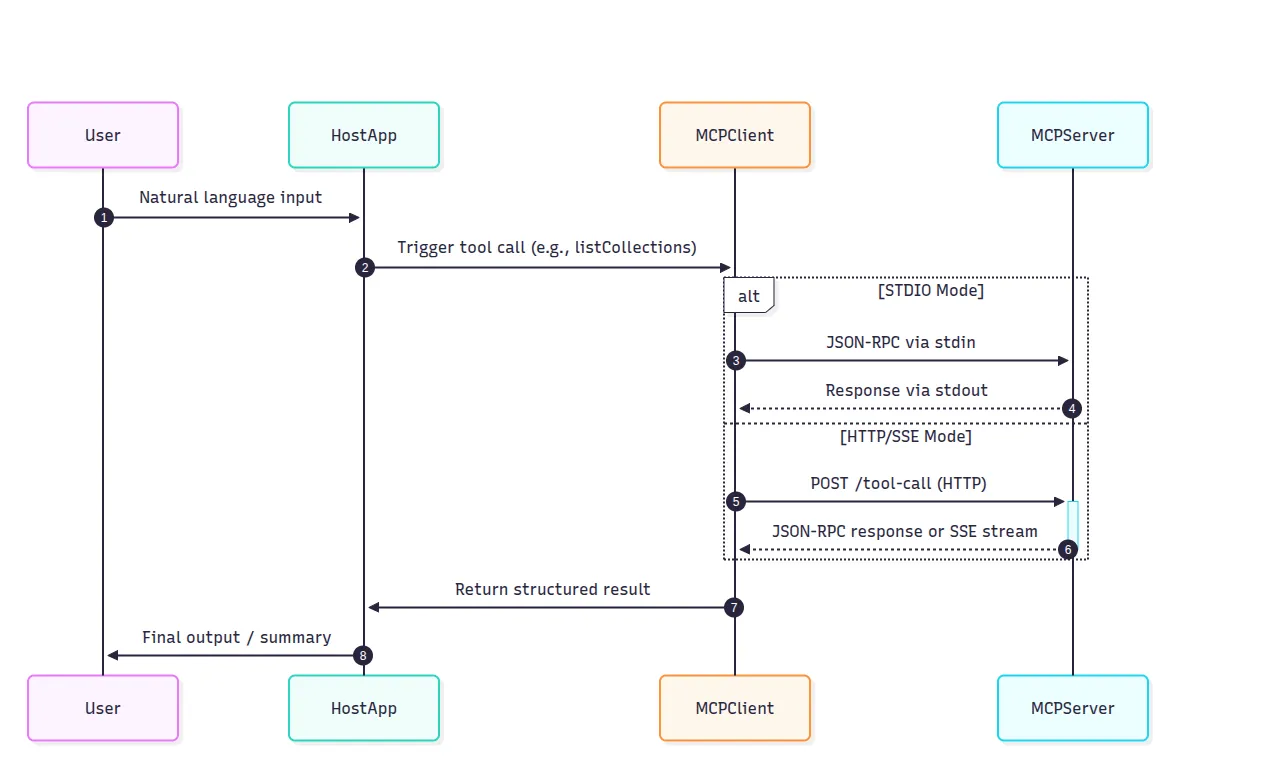

- Aplicación Host: organiza las llamadas a las herramientas, gestiona los resultados de LLM y encadena las respuestas (por ejemplo, un agente de GRC que consulta Mongo, resume los resultados y envía alertas).

- Servidor MCP: implementa una lógica específica del dominio, como ListCollections, RunAggregation o SendMessageToSlack.

- Cliente MCP: una biblioteca mínima que gestiona el formato de las solicitudes, la autenticación, los reintentos y conecta el host al servidor MCP apropiado.

Los servidores suelen exponer:

- Herramientas: comandos ejecutables como ListCollections, RunAggregation o SendSlackMessage.

- Recursos: datos descriptivos como definiciones de esquemas, metadatos de colecciones o estructura de bases de datos.

De manera opcional, los servidores también pueden exponer:

- Indicaciones: Plantillas/instrucciones estandarizadas para agentes

- Primitivas del lado del cliente: Cómo almacenar en caché o agrupar sugerencias

- Notificaciones: Transmisiones de eventos en tiempo real (a través de SSE)

Opciones de transporte: STDIO frente a HTTP/SSE

MCP es independiente del transporte y admite dos modos:

Ambos transportes siguen el mismo formato JSON-RPC, por lo que puede cambiar de transporte sin tener que volver a escribir la lógica.

Esa es la gran idea detrás del MCP: una forma minimalista y limpia de que las modelos llamen herramientas sin un frágil pegamento rápido. Sin órdenes alucinadas. Sin relleno manual de contexto. Simplemente borre las entradas y salidas. Pero, ¿cómo funciona eso realmente en una aplicación real? Veamos un ejemplo con un asistente de cumplimiento con tecnología MongoDB.

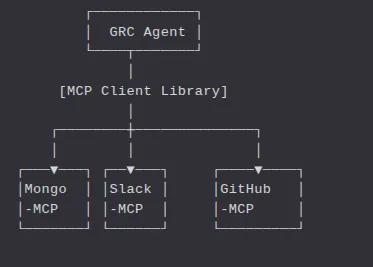

Automatización de un flujo de trabajo de GRC mediante Mongo-MCP

Imagine que está creando un asistente de GRC (gobierno, riesgo y cumplimiento).

Este asistente debe:

- Obtenga colecciones y registros de auditoría de una base de datos de MongoDB

- Resuma los hallazgos para un oficial de cumplimiento

- Notifica a los equipos pertinentes en Slack

- Si lo desea, presente un problema de seguimiento en GitHub

En una configuración tradicional, configuraría esta lógica mediante llamadas REST o scripts de Python, rellenando esquemas y credenciales en plantillas de mensajes. Cada integración sería personalizada y frágil.

Con MCP, cada una de estas herramientas (MongoDB, Slack, GitHub) se convierte en un proveedor de funciones de primera clase, al exponer métodos claramente definidos, como:

- Listar colecciones

- Ejecutar agregación

- Enviar mensaje

- Crear problema

El agente GRC (nuestra aplicación host) simplemente llama a estas herramientas utilizando el esquema JSON-RPC de MCP

Escenario: Detectar y denunciar infracciones de políticas Instrucción para el usuario:»Consulta la base de datos de cumplimiento para ver si hay alguna infracción de las políticas hoy mismo y notifica al equipo en Slack.»

1. Entrada del usuario → Aplicación anfitriona → LLM El agente GRC (aplicación host) envía el mensaje del usuario al modelo. El modelo reconoce las herramientas y responde con:

{

"tool_calls": [

{

"name": "listCollections",

"arguments": {

"database": "compliance"

}

}

]

}

2. La aplicación host invoca Mongo-MCP a través del cliente MCP Esta llamada a la herramienta se convierte en una solicitud JSON-RPC:

{

"jsonrpc": "2.0",

"method": "listCollections",

"params": {

"database": "compliance"

},

"id": "req-001"

}

3. Mongo-MCP ejecuta la función a la que Mongo-MCP asigna esta llamada:

def listCollections(database: str) -> List[str]:

return mongo_client[database].list_collection_names()

Ejecuta la función, obtiene el resultado y responde:

{

"jsonrpc": "2.0",

"result": [

"audit_logs",

"policy_violations",

"user_sessions"

],

"id": "req-001"

}

4. Agent Chains the Next Call: RunAggregation El modelo ahora genera una llamada de seguimiento basada en las colecciones disponibles:

{

"tool_calls": [

{

"name": "runAggregation",

"arguments": {

"database": "compliance",

"collection": "policy_violations",

"pipeline": [

{ "$match": { "timestamp": { "$gte": "2025-08-05" } } },

{ "$group": { "_id": "$severity", "count": { "$sum": 1 } } }

]

}

}

]

}

Esto da como resultado otra llamada JSON-RPC a Mongo-MCP y el servidor devuelve:

{

"jsonrpc": "2.0",

"result": [

{ "_id": "high", "count": 5 },

{ "_id": "medium", "count": 12 }

],

"id": "req-002"

}

El agente devuelve este resultado al modelo con un mensaje como:

»Resuma los datos de infracción de esta política en inglés sencillo».

La modelo responde:

«TEn la actualidad, hubo 5 infracciones de políticas de gravedad alta y 12 de gravedad media en la base de datos de cumplimiento.»

5. El modelo llama a Slack-MCP para avisar al equipo. Ahora, el agente lanza una última llamada estructurada a la herramienta:

{

"tool_calls": [

{

"name": "sendMessage",

"arguments": {

"channel": "#compliance-alerts",

"message": "5 high and 12 medium policy violations detected today. Please review."

}

}

]

}

El servidor Slack-MCP envía el mensaje y el flujo de trabajo finaliza. Todo esto ocurrió mediante llamadas JSON estructuradas, no mediante la manipulación de cadenas ni mediante ingeniería rápida.

¿Por qué necesita un registro de servidores MCP en MCP Gateway?

La demostración de Mongo-MCP parece limpia. El modelo hizo llamadas estructuradas a las herramientas. Cada función funcionó según lo esperado. Sin alucinaciones. Sin plantillas de cuerdas quebradizas. Pero ese es un camino feliz, y los sistemas reales no solo tienen que ver con funcionar, sino con trabajar de manera segura, confiable y observable a escala.

En la producción, el MCP sin procesar se queda corto en algunas áreas clave:

1. Sin control de acceso (RBAC): Raw MCP no tiene una forma integrada de restringir quién puede llamar a qué.

- ¿Qué sucede si desea permitir la ejecución de Aggregation pero bloquear DeleteCollection?

- ¿Qué sucede si un modelo solo debe consultar ciertos conjuntos de datos (por ejemplo, las finanzas no pueden acceder a los recursos humanos)?

En las organizaciones reales, el RBAC (control de acceso basado en roles) no es negociable, especialmente cuando los modelos están conectados a herramientas delicadas.

2. No hay claves de autenticación o API que Raw MCP no gestione

- Validar qué agente o modelo está realizando la llamada

- Credenciales de alcance por equipo, entorno o proyecto

- Caducidad o revocación del token

Esto significa que cualquier persona con acceso al servidor mcp puede llamar a cualquier herramienta y no hay ningún registro de auditoría.

3. Sin observabilidad No puedes arreglar lo que no puedes ver.

- ¿Cuál es la latencia de cada llamada a la herramienta?

- ¿Cuál es la tasa de errores o el recuento de reintentos?

- ¿Qué herramientas se están utilizando en exceso o se están agotando?

Con MCP sin procesar, no tiene paneles, registros ni trazas. Estás volando a ciegas.

4. Los LLM de No Guarrails son creativos, a veces demasiado creativos.

Raw MCP tiene:

- Sin límites de tokens (por ejemplo, evitar agregaciones masivas)

- Sin límites de tamaño de resultado (por ejemplo, devolver 5 MB desde Mongo)

- Sin disyuntores ni indicaciones de pausa (por ejemplo, «¿Estás seguro de que quieres enviar esta alerta de Slack?»)

Sin barreras, un solo error puede provocar miles de mensajes de Slack o borrados accidentales de datos.

5. Sin reintentos, limitaciones ni cuotas en la producción

En producción, las herramientas no siempre se comportan a la perfección: pueden fallar, perder el tiempo de espera o responder lentamente. Sin medidas de seguridad, incluso los modelos que se comportan bien pueden:

- Límites de tasa de aciertos

- Servicios Hammer con reintentos

- Exponga las herramientas sensibles al uso indebido

El protocolo MCP sin procesar asume que todo funciona: un mundo de «camino feliz». Sin embargo, la infraestructura del mundo real es desordenada. Necesitas una lógica de reintento, un almacenamiento en caché, una limitación de velocidad y un control de acceso inteligentes para mantener la cordura a gran escala.

- Autenticación + acceso basado en tokens

- RBAC por modelo, usuario, organización y herramienta

- Observabilidad y rastreo

- Cuotas, límites y estrategias de reintento

- Flujos de trabajo de aprobación para acciones delicadas

Esto es exactamente lo que ofrece TrueFoundry Gateway.

Desde demostraciones de un solo servidor hasta flujos de trabajo de agentes de nivel empresarial

En el primera mitad de este artículo aprendimos qué es el Modelo-Contexto-Protocolo y utilizamos un Servidor Mongo mcp para automatizar una plataforma GRC heredada. Ese ejemplo de juguete es genial para un día de hackeo, pero rápidamente se topa con fricciones en el mundo real:

True Foundry Puerta de enlace de IA empaqueta las tuberías que faltan (un registro MCP, autenticación central, RBAC, barandales y una gran capacidad de observación) para que los equipos puedan pasar de «agente de hello-world» a producción de forma segura y repetida.

Qué aporta Gateway a Raw MCP

TrueFoundry posiciona el Gateway como un plano de control que se encuentra entre sus agentes (o interfaz de usuario de chat) y todos los proveedores de LLM y servidores MCP registrados.

Las capacidades clave incluyen:

- Registro central de MCP — añada servidores públicos o autohospedados una vez; descúbralos en todas partes

- Credenciales unificadas — generar un soltera Token de acceso personal (PAT) o token de cuenta virtual (VAT) con ámbito automático que se intercambia automáticamente por tokens de encabezado o OAuth por servidor entre bastidores

- RBAC de grano fino — restringir cuál los usuarios, las aplicaciones o los entornos pueden ver o ejecutar cuál herramientas

- Agent Playground y cliente MCP integrado — creación rápida de prototipos sin escribir una línea de código

- Observabilidad y barandillas — latencia, costo, rastreos, flujos de aprobación, límites de velocidad y almacenamiento en caché integrados

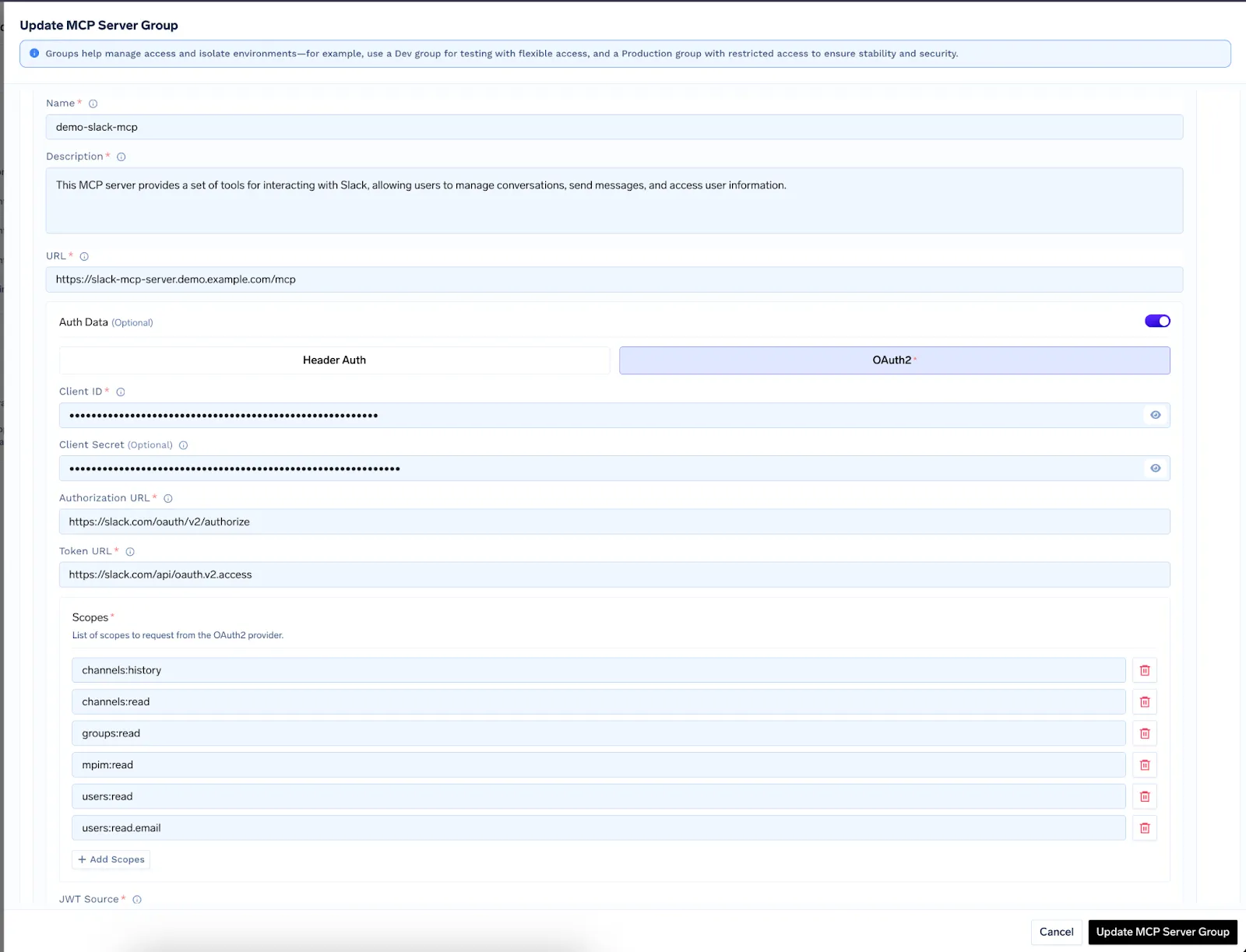

Piense en ello como el Puerta de enlace de API + malla de servicio + tienda secreta para el entorno emergente de MCP. «Como se indica en el Guía de autenticación del servidor MCP, el Gateway gestiona automáticamente el almacenamiento de credenciales y el ciclo de vida de los tokens».

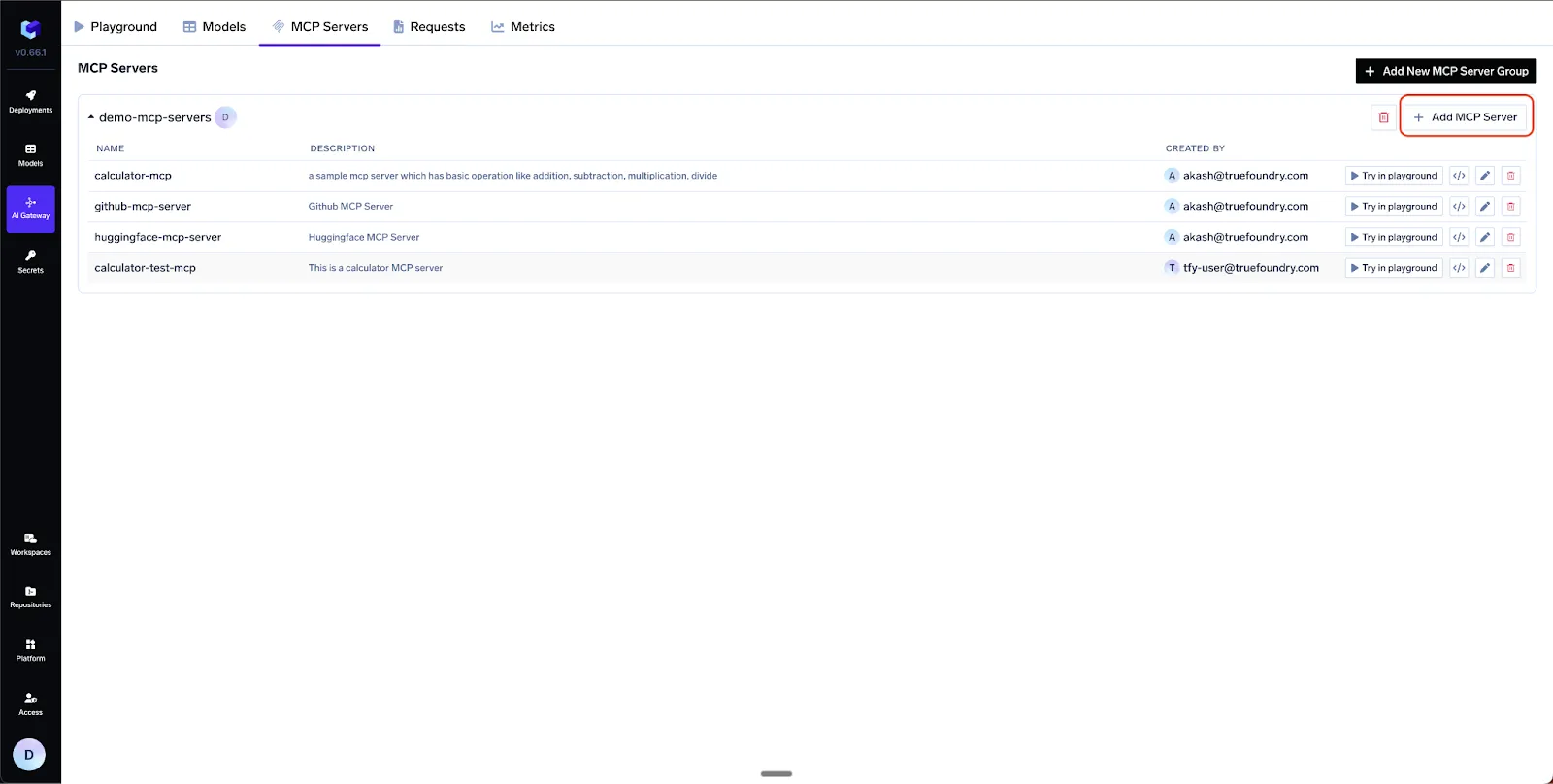

Prácticos: registro de su primer servidor MCP

El primer paso en la interfaz de usuario es crear un grupo—p. ej., dev-mcps o prod-mcps. Los grupos permiten adjuntar diferentes reglas de RBAC y flujos de aprobación a diferentes entornos.

«Puedes seguir el Guía de inicio del servidor TrueFoundry MCP para obtener pasos detallados».

AI Gateway ➜ MCP Servers ➜ «Agregar un nuevo grupo de servidores MCP

name: prod-mcps

access control:

- Manage: SRE-Admins

- User : Prod-Runtime-Service-AccountsDentro del grupo, elige Añadir/editar servidor MCP y rellena tres cosas:

Puedes añadir con la misma facilidad:

- Sin autenticación servidores de demostración (por ejemplo, Calculator)

- Autenticación de encabezado servidores que aceptan una clave API estática (por ejemplo, Hugging Face)

- Cualquier cantidad de servidores futuros (Atlassian, Datadog, microservicios internos)

Entre bastidores, el Gateway almacena las credenciales en su almacén secreto y gestiona la actualización de los tokens.

Autenticación y RBAC

TrueFoundry admite tres esquemas de autenticación por servidor MCP:

«Estos modos se describen con más detalle en la Documentación de autenticación del servidor MCP».

Una vez registrado un servidor, usted no entregue fichas sin procesar a cada desarrollador. En su lugar, se autentican una vez al Gateway y reciba:

- PALMADITA — con alcance de usuario, amigable para los humanos, bueno para CLI y experimentos

- IVA — cuenta de servicio con alcance, bloqueada en servidores seleccionados, perfecta para aplicaciones de producción

El Gateway compara el token de llamada con:

- A nivel de grupo permisos (¿puede este usuario acceder a cualquier servidor en prod-mcps?)

- A nivel de servidor permisos (¿está slack-mcp en la lista blanca?)

- Nivel de herramienta permisos (¿pueden llamar a SendMessageToChannel?)

Si alguna comprobación falla, la solicitud es rechazada. delante de llega a tu espacio de trabajo de Slack.

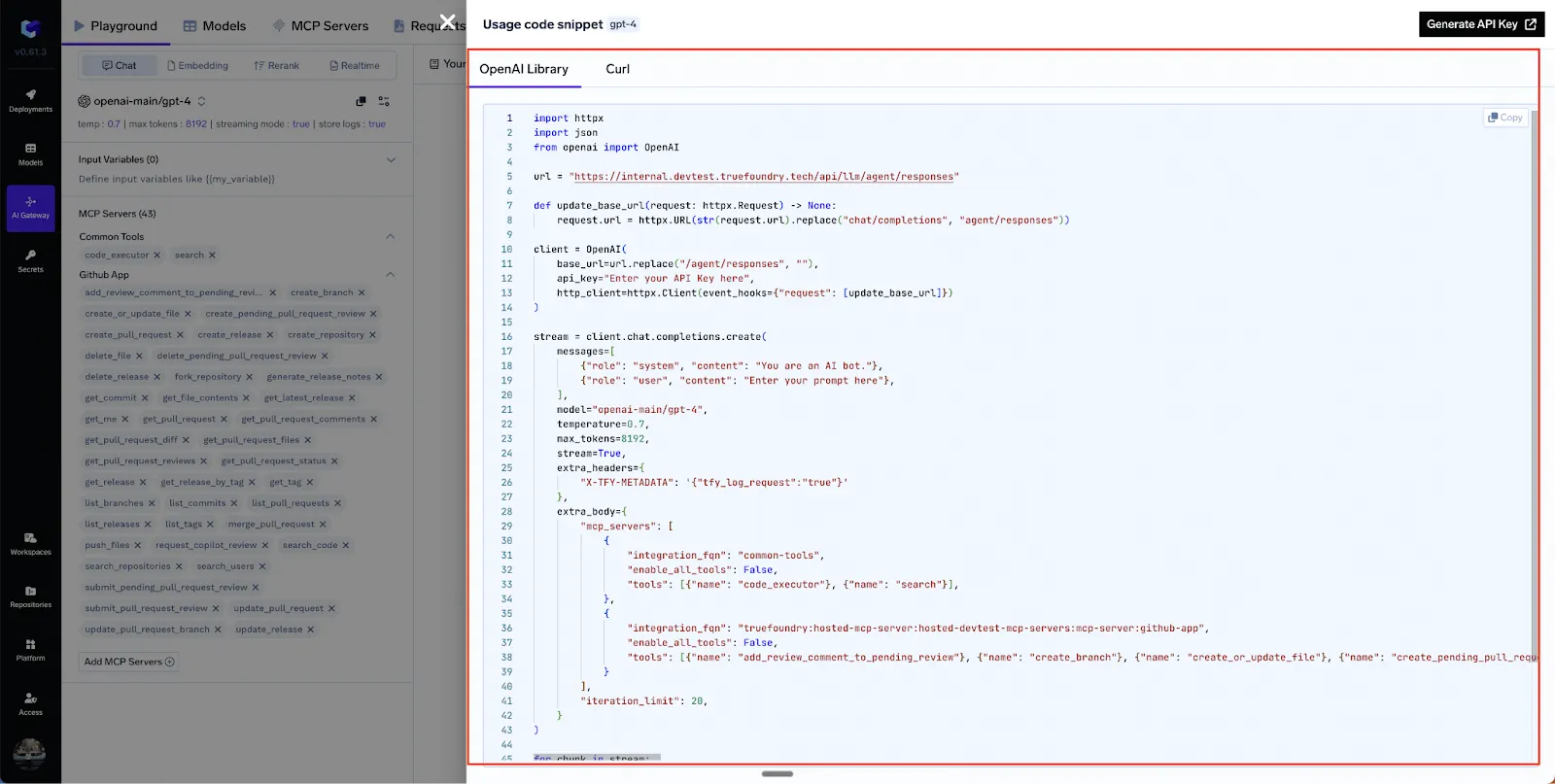

De Playground al código: la API del agente

Tras experimentar en la interfaz de usuario, puede hacer clic «Fragmento de código API» para generar ejemplos de Python, JS o cURL que funcionen. A continuación se muestra un recortado Cuerpo JSON que conecta tres servidores (GitHub, Slack, Calculator):

Publicación/API/LLM/Agente/Respuestas

{

"model": "gpt-4o",

"stream": true,

"iteration_limit": 5,

"messages": [

{

"role": "user",

"content": "Summarize open PRs on repo X and DM me the top blockers."

}

],

"mcp_servers": [

{

"integration_fqn": "truefoundry:prod-mcps:github-mcp",

"tools": [ {"name": "listPullRequests"}, {"name": "createComment"} ]

},

{

"integration_fqn": "truefoundry:prod-mcps:slack-mcp",

"tools": [ {"name": "sendMessageToUser"} ]

},

{

"integration_fqn": "truefoundry:common:calculator-mcp",

"tools": [ {"name": "add"} ]

}

]

}

«Puedes encontrar un ejemplo similar en el Guía sobre el uso del servidor MCP en Code Agent, que también incluye fragmentos completos de Python y JS».

El streaming la respuesta intercala:

- asistente fichas (razonamiento LLM)

- llamada de herramientas fragmentos (nombre de la función + argumentos incrementales)

- resultado-herramienta eventos (salida JSON)

Esto le permite construir reactiva Interfaces de usuario que muestran cada paso del bucle de la agencia en tiempo real.

Observabilidad, barandas y política

Incluso un agente de «hola mundo» puede costar dinero real y causar un daño real. TrueFoundry ofrece una capacidad de observación de primera clase:

- Paneles de latencia/error — TTFT, latencia de tareas, errores HTTP, reintentos de herramientas

- Seguimiento de tokens y costos — gasto de atributos por modelo, equipo y indicador de función

- Trazas de OpenTelemetry — salto a salto abarca a todos los agentes, Proxy MCP, y LLM

- Límites de velocidad y almacenamiento en caché — evitar bucles incontrolados y reutilizar resultados de búsqueda web idénticos

- Ganchos para barandillas — aplique la depuración de información personal, los filtros NSFW o la «aprobación por humanos» en cualquier herramienta destructiva

Todas las métricas vienen listas para usar; no se requieren agentes de sidecar ni exportadores personalizados.

Apoyando Todas Transportes MCP (HTTP y STDIO)

Muchos servidores de código abierto aún hablan estudio (stdin/stdout) en lugar de HTTP. TrueFoundry recomienda envolverlos con proxy mcp y desplegarlo como un servicio regular

# wrap a Python stdio server

mcp-proxy --port 8000 --host 0.0.0.0 --server stream python my_server.py

Existen plantillas listas para usar para los servidores Notion y Perplexity, además de manifiestos K8 para imágenes de Node o Python. Una vez colocado como proxy, el registro es idéntico al de cualquier otro punto final HTTP MCP.

«True Foundry Guía de MCP Server STUDIO cubre este enfoque de proxy y proporciona plantillas de implementación».

Ejemplo de tutorial: Enterprise Compliance Bot

Volvamos a nuestro legado GRC escenario, pero aumenta la ambición:

«Mantenga nuestras pruebas de cumplimiento actualizadas. Si un archivo de política cambia en GitHub, guarda la diferencia en MongoDB, crea un ticket de Jira y publica un resumen en Slack».

Servidores involucrados

Flujo

- Webhook de GitHub accede a una función de nube.

- La función llama al API de agente (token de IVA) con los cuatro servidores activados.

- Razones de LLM → llama a GitHub.getFileDiff → Mongo.insertDocument → Jira.createIssue → slack.sendMessage.

- Cada llamada a la herramienta y el resultado se transmiten por streaming; la observabilidad captura la latencia de cada salto.

- Si la diferencia es > x (cierto número de líneas de código, como umbral), un barandilla inserta «requiere aprobación manual» y detiene la ejecución; un responsable de seguridad puede aprobarlo a través de la interfaz de usuario de Gateway.

Gobernanza

- El IVA adjunto a la función solo se muestra en los cuatro servidores listados:privilegio mínimo.

- Separar desarrollador y empujar los grupos te permiten hacer pruebas con un entorno aislado de Jira y con Slack en fase de prueba.

- Los auditores pueden reproducir cualquier incidente: los rastros y las cargas útiles JSON completas se conservan 30 días de forma predeterminada.

Ampliación del ecosistema: creación de su propio servidor MCP

Como MCP es solo JSON-RPC sobre HTTP o stdio, ninguna el servicio interno puede exponer herramientas, aquí hay un pequeño ejemplo:

- Coloca este contenedor en tu clúster de Kubernetes.

- Regístralo en el desarrollador grupo con Sin autenticación mientras se desarrolla.

- Cambiar a Autenticación de encabezado o OAuth 2 antes de moverlo a prod-mcps.

A partir de ese momento, cada un agente de tu empresa puede razonar sobre los controles de cumplimiento con exactamente la misma ergonomía que Slack o GitHub.

Hoja de referencia sobre las mejores prácticas

«Esta hoja ha sido adaptada del Descripción general de TrueFoundry MCP, estas directrices ayudan a garantizar despliegues seguros y confiables».

Conclusión

MCP permite que los grandes modelos lingüísticos (LLM) hablen el mismo idioma que las herramientas, pero no se ocupa de aspectos como la seguridad, el descubrimiento o la gobernanza a nivel empresarial. Ahí es donde entra en juego AI Gateway de TrueFoundry: añade todo lo que los equipos necesitan desde el primer momento, como un Registro MCP, autenticación integrada, control de acceso basado en roles (RBAC), capacidad de observación profunda y una potente API de agente para unirlo todo.

Preguntas frecuentes

¿Qué es un registro MCP en los sistemas de IA?

Un registro MCP es un catálogo centralizado que almacena y administra los servidores del Protocolo de contexto modelo (MCP) disponibles y sus capacidades específicas. Actúa como un directorio en el que se pueden realizar búsquedas para los agentes de IA, lo que les permite descubrir herramientas y recursos de forma dinámica. Este registro garantiza que los modelos puedan identificar los servicios correctos necesarios para ejecutar tareas complejas de varios pasos.

¿Cuál es la diferencia entre un registro MCP y una puerta de enlace de IA?

Un registro MCP es un directorio pasivo de herramientas, mientras que una puerta de enlace de IA es la capa de aplicación activa que administra el tráfico. El registro indica al sistema qué recursos existen, mientras que la puerta de enlace controla el acceso, gestiona la autenticación y aplica políticas de seguridad, como el enmascaramiento de la información personal identificable o la limitación de velocidad durante la ejecución efectiva de las solicitudes modelo.

¿Puede funcionar una puerta de enlace de IA sin un registro MCP?

Sí, una puerta de enlace de IA puede funcionar sin un registro MCP mediante configuraciones estáticas, pero pierde la flexibilidad del descubrimiento dinámico de herramientas. Sin un registro, los desarrolladores deben codificar manualmente cada conexión al servidor, lo que dificulta la escalabilidad y el mantenimiento del sistema. La integración de un registro permite que la puerta de enlace se adapte automáticamente a medida que se agregan nuevas herramientas al ecosistema.

¿Cómo hace cumplir una puerta de enlace de IA las políticas de un registro de MCP?

La pasarela de IA recupera los metadatos y las reglas de gobierno del registro del MCP para validar las solicitudes entrantes en tiempo real. Hace una referencia cruzada de los permisos de usuario y los requisitos de seguridad definidos en el registro antes de enrutar el tráfico al servidor apropiado. Esto garantiza que cada interacción cumpla con los estándares organizativos y los protocolos de residencia de datos.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)