¿Qué es el Protocolo de contexto modelo (MCP) y cómo funciona?

.webp)

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

¿Qué pasaría si su sistema de inteligencia artificial pudiera hacer cosas, como extraer datos de un CRM, actualizar un panel de control o enviar un correo electrónico, sin necesidad de un equipo de ingenieros que lo controle todo? Ahí es donde entra en juego el Model Context Protocol, o MCP. Es un nuevo estándar abierto que ayuda Agentes de IA conéctese de forma segura a herramientas, sistemas y fuentes de datos con mucho menos esfuerzo.

A medida que la IA se vuelve más capaz, el verdadero desafío no es el modelo. Se trata de darle acceso al contexto y las acciones correctos. Entonces, ¿cómo resuelve MCP esto? ¿Qué aspecto tiene debajo del capó? ¿Y por qué empresas como Anthropic y Microsoft apuestan por ello? Vamos a profundizar.

.webp)

¿Qué es el Model Context Protocol?

.webp)

MCP, abreviatura de Model Context Protocol, es un estándar abierto diseñado para ayudar a los agentes de IA a interactuar con herramientas, datos y servicios externos de una manera estructurada y segura. Imagínelo como un conector universal que permite que su modelo de IA se «conecte» a sistemas del mundo real, del mismo modo que un puerto USB conecta los dispositivos a su ordenador. En lugar de confiar en API codificadas o integraciones patentadas, MCP proporciona un lenguaje común para que las herramientas y los agentes se comuniquen entre sí. Este es el núcleo de MCP frente a API: las API tradicionales exponen puntos finales predefinidos, mientras que MCP añade un protocolo estructurado que permite a los sistemas de IA descubrir herramientas, recursos e indicaciones de forma dinámica durante el tiempo de ejecución.

El protocolo fue introducido por Anthropic como parte de su visión más amplia de hacer que los agentes de IA sean más capaces, seguros y autónomos. Utiliza una arquitectura sencilla pero potente: los clientes (como un modelo de IA) envían solicitudes a los servidores (que incluyen herramientas o fuentes de datos) y obtienen respuestas estructuradas que pueden introducirse en el modelo como contexto.

Una de las mayores ventajas de MCP es que es modular. Ya sea que su herramienta sea una base de datos, una aplicación interna, un producto SaaS o incluso un sistema de archivos, puede exponerla como Servidor MCP. Esto significa que no es necesario volver a capacitar a sus agentes ni volver a integrarlos cada vez que se agrega un nuevo sistema. Simplemente siguen el protocolo.

MCP también es independiente del idioma y flexible en cuanto al transporte. Es compatible con varios SDK (Python, TypeScript, Java, C#) y puede funcionar en diferentes capas de comunicación, incluidas HTTP y WebSockets. Esto facilita su uso en todas las plataformas, ya sea que ejecute flujos de trabajo de IA en la nube, en el borde o incluso en entornos de TI empresariales.

En esencia, MCP cambia la conversación sobre la IA de «¿qué puede decir el modelo?» a «qué puede hacer el modelo hacer?» Y ese es exactamente el salto que los agentes necesitan para pasar de ser asistentes pasivos a verdaderos colaboradores en la toma de decisiones.

Arquitectura de MCP

El Model Context Protocol (MCP) está diseñado para permitir a los agentes de IA interactuar de forma segura con herramientas y fuentes de datos externas mediante una interfaz estandarizada. Su arquitectura separa claramente las responsabilidades en tres capas: el anfitrión, el cliente y el servidor. Cada capa desempeña una función específica a la hora de gestionar el acceso, mantener el aislamiento y permitir el intercambio de contextos.

En el centro de todo se encuentra un protocolo de comunicación estructurado y con estado basado en JSON-RPC 2.0 que gestiona los flujos de solicitud-respuesta entre los agentes y las interfaces de las herramientas. El resultado es un sistema modular que permite a los desarrolladores crear una sola vez y escalar entre agentes, herramientas y dominios sin tener que volver a implementarlo. Esta separación de las preocupaciones también permite a los equipos trabajar en paralelo en el desarrollo de agentes y la integración de sistemas. La arquitectura está diseñada para soportar despliegues locales y distribuidos.

.webp)

Anfitrión

El host es el entorno de ejecución principal del agente o modelo de IA. Coordina todo, desde las políticas de seguridad y la estrategia de muestreo hasta los flujos de trabajo de invocación de herramientas. Los anfitriones son responsables de generar y gestionar las instancias de los clientes y desempeñan un papel fundamental en la forma en que una aplicación de IA interactúa con el ecosistema de MCP.

- Los anfitriones imponen el control de acceso, el consentimiento del usuario y los límites de sesión en todas las herramientas

- Manejan la agregación de contextos y determinan cómo se fusionan y pasan al modelo los datos de varios clientes.

Por ejemplo, en un sistema como Claude Desktop, el host administra varias conexiones de clientes, cada una de las cuales interactúa con un servicio externo diferente, a la vez que mantiene un contexto unificado para el ciclo de razonamiento del modelo.

Cliente

Cada cliente es un puente de comunicación dedicado entre el host y un único servidor MCP. Negocia las capacidades con el servidor, administra la sesión de RPC y distribuye los datos de un lado a otro. Los clientes están diseñados para permanecer aislados y sin estado más allá del alcance de una sola sesión.

- Un cliente se conecta a un servidor, preservando un aislamiento estricto y minimizando el riesgo

- Los clientes gestionan la detección (herramientas, recursos, indicaciones) y hacen cumplir la validación de los mensajes y la seguridad de tipos

Los clientes actúan como la capa de abstracción que permite al modelo de IA invocar herramientas o obtener datos sin estar directamente vinculado a los detalles de implementación del sistema.

Servidor

Un servidor MCP es un contenedor alrededor de una herramienta, API o sistema externo. Expone la funcionalidad y los datos en un formato estandarizado, por lo que cualquier cliente compatible con MCP puede acceder a ellos. Los servidores funcionan de forma independiente y son responsables de definir el alcance de sus capacidades.

- Los servidores exponen tres primitivas principales: herramientas (acciones), recursos (datos) e indicaciones (flujos con plantillas)

- Respetan las restricciones de acceso y se pueden implementar localmente o en la red, según la arquitectura del sistema

Por ejemplo, un servidor puede exponer una base de datos de Postgres como un recurso consultable o empaquetar la API de GitHub como un conjunto de herramientas a las que se puede invocar. Una vez creado, el mismo servidor puede atender a varios tipos de clientes en diferentes hosts.

Nota: El diseño host-cliente-servidor de MCP impone una estricta separación de responsabilidades. El host controla el acceso y el contexto, cada cliente mantiene una sesión aislada y los servidores exponen las capacidades de las herramientas mediante un protocolo estándar. Esta estructura es fundamental para crear sistemas de agentes de inteligencia artificial seguros, modulares y escalables en diversas cadenas de herramientas.

Componentes principales de MCP

Las interacciones de MCP se basan en cuatro primitivas clave: herramientas, recursos, indicaciones y la capa de sesión. Estos componentes eliminan la complejidad de bajo nivel y proporcionan una interfaz limpia para que los modelos razonen, actúen e interactúen con los sistemas del mundo real de forma modular y predecible.

Herramientas

Las herramientas son funciones ejecutables expuestas por el servidor y a las que el modelo puede llamar a través del cliente. Cada herramienta se define con parámetros de entrada, esquema de salida y una descripción de su propósito. El modelo usa estos metadatos para determinar cuándo y cómo usar una herramienta. Los ejemplos incluyen la creación de tickets de soporte, el envío de mensajes de Slack o la iniciación de flujos de trabajo. Las herramientas pueden ser sincrónicas o asincrónicas, según la implementación del backend. El modelo decide el momento de la invocación de la herramienta en función del contexto actual y la intención de la tarea.

Recursos

Los recursos son datos de solo lectura que los servidores exponen para proporcionar contexto al modelo. Pueden ser registros de bases de datos, documentos, entradas de registro o resultados de búsqueda. Los clientes solicitan recursos cuando el modelo necesita buscar o recuperar datos antes de tomar una acción. Los servidores definen lo que está disponible y el cliente se encarga de formatearlo para incluirlo en la solicitud del modelo. Los recursos son fundamentales para basar las respuestas de los agentes en información actualizada y relevante.

Indicaciones

Las solicitudes son plantillas predefinidas o flujos de interacción registrados por el servidor. Sirven como andamios estructurados que pueden guiar el comportamiento del modelo en contextos específicos. Por ejemplo, un mensaje puede definir el diseño de un informe de error, un correo electrónico de escalamiento o una guía de incorporación. El usuario puede activar las solicitudes o invocarlas mediante programación. Su función es garantizar la coherencia, reducir las alucinaciones y acelerar la generación estructurada en flujos de trabajo de alto riesgo.

Capa de sesión (JSON-RPC)

Toda la comunicación entre clientes y servidores se realiza a través de JSON-RPC 2.0. Este protocolo admite la mensajería bidireccional con estado y es flexible en cuanto al transporte. Funciona con STDIO, HTTP/SSE o WebSockets. La capa de sesión permite realizar llamadas de solicitud/respuesta, notificaciones de eventos, registro de capacidades y operaciones de larga duración. Al adherirse a JSON-RPC, MCP garantiza una escritura sólida, patrones de comunicación predecibles y compatibilidad entre idiomas y plataformas. Este modelo de sesión es lo que posibilita el descubrimiento dinámico de herramientas y la interacción en tiempo de ejecución.

Nota: Las herramientas, los recursos, las indicaciones y la capa de sesión forman la base de cada interacción de MCP. Permiten a los modelos razonar, actuar y recuperar el contexto mediante primitivas estructuradas y predecibles, lo que permite la integración en tiempo real con sistemas externos sin sacrificar la seguridad ni la flexibilidad.

Consideraciones de seguridad con MCP

Cuando se utilizan servidores MCP (Model Context Protocol), la seguridad es una prioridad máxima porque estos servidores actúan como puertas de enlace entre los modelos de IA y los sistemas externos. Una seguridad adecuada garantiza que los datos confidenciales, las API y los flujos de trabajo empresariales permanezcan protegidos, al tiempo que permite una integración perfecta de la IA.

- Autenticación y control de acceso: Asegúrese de que solo los usuarios o modelos autorizados puedan acceder a las herramientas y las API. Implemente el acceso basado en roles o la autenticación basada en tokens para evitar el uso no autorizado.

- Cifrado de datos: Cifre los datos tanto en tránsito como en reposo para proteger la información confidencial intercambiada entre modelos y sistemas externos.

- Limitación y limitación de velocidad: Evite el abuso o la sobrecarga accidental de los servicios conectados controlando la cantidad de solicitudes que puede gestionar un servidor MCP.

- Auditoría y registro: Mantenga registros detallados de todas las interacciones, incluidas las solicitudes y respuestas, para supervisar las anomalías y mantener la trazabilidad.

- Exposición segura de API: Limite la exposición de las herramientas internas solo a lo que sea necesario. Evite exponer públicamente los terminales delicados.

- Gestión de errores y respaldo: Garantice mecanismos sólidos para gestionar las solicitudes fallidas o no autorizadas sin filtrar datos confidenciales.

Un servidor MCP debidamente protegido proporciona un entorno seguro para que los modelos de IA interactúen con sistemas externos y, al mismo tiempo, minimiza el riesgo de filtraciones de datos, uso indebido o fallas del sistema.

¿Cómo funciona el MCP?

MCP funciona mediante un flujo estructurado de cinco pasos que permite a los modelos lingüísticos descubrir, invocar e interactuar con herramientas y fuentes de datos en tiempo real. Así es como funciona el protocolo desde el principio:

Paso 1: El host inicializa los clientes

La aplicación host inicia el proceso lanzando uno o más clientes MCP, cada uno configurado para conectarse a un servidor MCP específico. El anfitrión también es responsable de administrar la autorización de los usuarios, hacer cumplir las políticas de control de acceso y mantener el contexto en las interacciones entre varias herramientas.

Paso 2: Los clientes descubren las capacidades del servidor

Cada cliente inicia un apretón de manos con su servidor asignado. Durante este intercambio, el servidor anuncia las herramientas, los recursos y las instrucciones compatibles, junto con las descripciones, los parámetros de entrada y los tipos de devolución. A continuación, el cliente empaqueta estos metadatos en el contexto del modelo para que el modelo sepa lo que puede usar.

Paso 3: El modelo toma decisiones

Con los datos de capacidad ahora integrados en su indicador, el modelo razona sobre las herramientas disponibles y las entradas actuales del usuario. Si la tarea requiere una acción o la recuperación de información, el modelo decide qué herramienta o recurso invocar, formula los parámetros apropiados y envía la solicitud al cliente.

Paso 4: Intercambio de datos entre el cliente y el servidor

El cliente reenvía la solicitud del modelo al servidor mediante JSON-RPC. El servidor ejecuta la función o obtiene los datos y, a continuación, devuelve una respuesta estructurada. El cliente devuelve el resultado al modelo, que lo usa para continuar con el procesamiento o tomar más decisiones.

Paso 5: El anfitrión administra los comentarios y el flujo de la sesión

La aplicación host monitorea todo el ciclo, administra el estado de la sesión en curso, registra el uso de las herramientas, aplica los límites de velocidad y garantiza que el agente se mantenga dentro de su alcance. Este paso garantiza la seguridad, la trazabilidad y la observabilidad de las acciones impulsadas por la IA.

¿Cómo gestiona un agente de IA un ticket de soporte con MCP?

.webp)

Este diagrama muestra cómo un agente de IA usa MCP para descubrir herramientas, invocar acciones y gestionar tickets en varios servidores en tiempo real. Visualiza todo el flujo de principio a fin, desde la entrada del usuario hasta la respuesta del sistema.

Considere la posibilidad de contar con un agente de soporte de IA integrado en una aplicación de servicio de asistencia. Cuando se inicia la aplicación host, inicializa dos clientes MCP: uno conectado a un servidor MCP de Zendesk y otro vinculado a un sistema de escalamiento interno. Cada cliente establece un enlace de capacidades con su servidor respectivo. El servidor de Zendesk anuncia herramientas como getTicketById y UpdateTicketStatus, mientras que el servidor de escalación expone EscalateTicket.

Estos metadatos se pasan al contexto del modelo. Cuando un usuario escribe la instrucción «Escalar el ticket #1289 si está marcado como urgente», el modelo interpreta la solicitud y determina que primero debe buscar el ticket. Llama a getTicketById («1289") a través del cliente de Zendesk. El servidor responde con los detalles del ticket e indica que la prioridad es «urgente». Basándose en eso, el modelo decide escalar el asunto y llama a EscalateTicket («1289") a través del segundo cliente.

Ambas llamadas se ejecutan a través de JSON-RPC. Los clientes reenvían las solicitudes a sus servidores respectivos, que procesan las funciones y devuelven respuestas estructuradas. Estas respuestas, los metadatos de los tickets y la confirmación de escalamiento se devuelven al modelo y se incorporan a su contexto. A continuación, el anfitrión finaliza el ciclo registrando las interacciones, validando las políticas de acceso y actualizando la interfaz de usuario con el siguiente resultado: «El ticket #1289 se escaló correctamente».

MCP vs RAG: ¿Por qué es importante entender la diferencia?

Antes de integrar los sistemas de IA, es importante entender cómo el MCP (Model Context Protocol) y el RAG (Retrieval-Augmented Generation) cumplen diferentes propósitos. Si bien ambos mejoran la funcionalidad del LLM, el MCP se centra en conectar los modelos con las herramientas y las API, mientras que el RAG enriquece las respuestas de los modelos con conocimientos externos.

Lea también: MCP frente a RAG

¿Por qué necesitamos MCP?

A medida que los agentes de IA se vuelven más capaces, su mayor limitación no es el razonamiento, sino el acceso. La mayoría de los modelos lingüísticos funcionan de forma aislada, sin ninguna forma estructurada de interactuar con herramientas o fuentes de datos externas. Los desarrolladores terminan programando de forma rígida las llamadas a las API, creando envoltorios frágiles o gestionando integraciones puntuales que no se escalan bien. Esto no solo ralentiza el desarrollo, sino que también introduce problemas de seguridad y mantenimiento.

MCP aborda este problema al estandarizar la forma en que los agentes de IA descubren, razonan e invocan las herramientas. Define un protocolo limpio que permite a los sistemas exponer sus capacidades, como las API, las bases de datos o los sistemas de archivos, de una manera estructurada y compatible con los modelos. Los agentes, a su vez, pueden aprender de forma dinámica qué acciones están disponibles, decidir cuándo usarlas y activarlas de forma segura mediante JSON-RPC.

Caso de uso en el mundo real

Piense en un asistente de inteligencia artificial integrado en una plataforma de recursos humanos empresarial. Con MCP, el asistente puede conectarse a un servidor de nóminas, a una base de conocimientos interna y a un directorio de empleados, cada uno como un servidor MCP. Cuando un gerente escribe: «Concédele a Rahul cinco días de licencia y notifícalo a Recursos Humanos», el modelo llama de forma dinámica a las herramientas apropiadas expuestas por estos servidores: una para actualizar el estado de la licencia, otra para enviar un mensaje de Slack a Recursos Humanos y una tercera para registrar la solicitud en el sistema interno, todo en tiempo real, sin ningún código personalizado en el modelo.

Este tipo de orquestación sería frágil y caro de construir manualmente. Con MCP, se convierte en modular, repetible y seguro en todo el mundo Plataformas de automatización MCP. Con MCP, se vuelve modular, repetible y seguro. A medida que las organizaciones despliegan más herramientas y servicios, MCP garantiza que los agentes de IA puedan interactuar con ellas de forma segura e inteligente, sin necesidad de nuevas integraciones para cada cambio.

¿Por qué MCP es más que una simple llamada de funciones?

La llamada a funciones hizo posible que los modelos lingüísticos interactuaran con las herramientas de forma estructurada. Usted define una herramienta, sus parámetros y su propósito, y el modelo puede invocarla devolviendo un objeto JSON. Esto funciona bien en casos de uso sencillos, especialmente cuando la cantidad de herramientas es pequeña y estática. Sin embargo, la invocación de funciones tiene limitaciones fundamentales: se parte del supuesto de que se conocen todas las herramientas desde el principio, que cada modelo está perfectamente adaptado a ellas y que la infraestructura que las rodea está codificada o es frágil.

MCP aborda estas brechas al introducir un protocolo completo, no solo un formato. Para equipos que evalúan MCP frente a A2A, esta distinción es importante porque el MCP estandariza la interacción entre el modelo y la herramienta, mientras que el A2A se centra en la comunicación entre agentes autónomos. Formaliza la interacción entre los agentes de IA y los sistemas externos mediante una arquitectura host-cliente-servidor y una comunicación estructurada a través de JSON-RPC. En lugar de integrar las definiciones de las herramientas directamente en la línea de comandos del modelo, MCP permite a los modelos descubrir de forma dinámica qué herramientas están disponibles en tiempo de ejecución, invocarlas de forma segura y recibir respuestas estructuradas, todo ello a través de una interfaz estándar.

Ejemplo del mundo real

Imagine un asistente de inteligencia artificial integrado en un panel de operaciones minoristas. Con la llamada a funciones, el modelo tendría que configurarse manualmente con acceso a herramientas como GetInventory, UpdatePrice y NotifyWarehouse. Todas las herramientas deben estar conectadas a la línea de comandos del sistema del agente. Sin embargo, con MCP, puede conectarse a diferentes servidores: uno para el inventario, otro para los precios y otro para la logística, y el agente descubrirá automáticamente todas las herramientas expuestas. Sin codificación fija, sin necesidad de volver a implementar.

Por qué es importante

- Separación de preocupaciones: los desarrolladores pueden crear servidores una vez y compartirlos entre modelos y equipos

- Orquestación dinámica: los modelos pueden razonar sobre la base de las capacidades disponibles y adaptar los flujos de trabajo sobre la marcha

La llamada a funciones era un primer paso necesario. MCP se basa en esa base y cuenta con la infraestructura, el protocolo y la flexibilidad necesarios para crear sistemas de agentes robustos y aptos para la producción.

¿Cómo implementa Truefoundry Gateway el servidor MCP?

Registro unificado de servidores MCP

.webp)

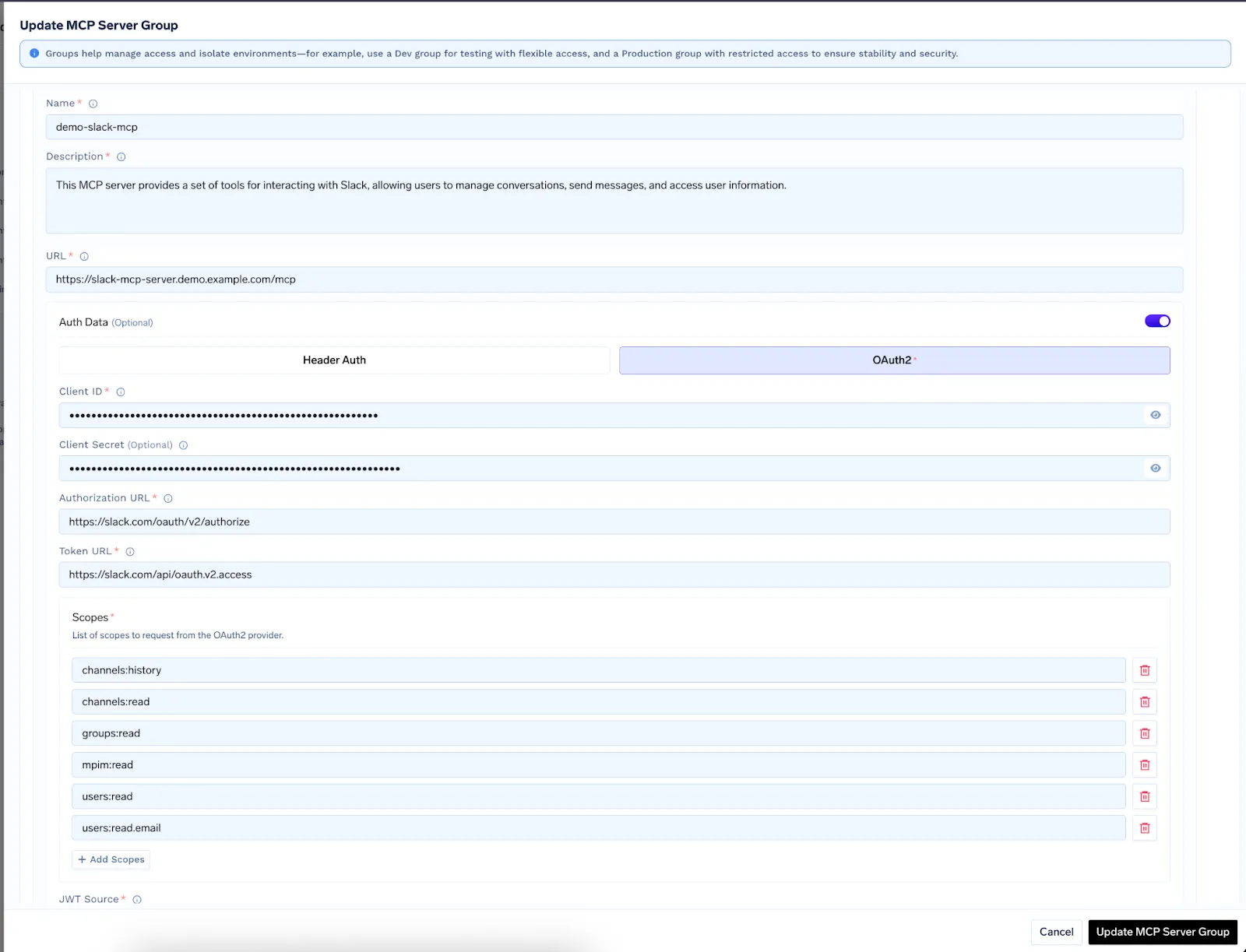

True Foundry Puerta de enlace MCP proporciona un portal único para descubrir y registrar todos sus servidores MCP, ya sean internos, locales, híbridos o de terceros, en «grupos de servidores MCP» organizados que aíslan los entornos (por ejemplo, desarrollo frente a producción) y exigen flujos de aprobación impulsados por RBAC para la gobernanza y la visibilidad. El Gateway, listo para usar, incluye conectores prediseñados para herramientas empresariales como Slack, Confluence, Datadog, Sentry y GitHub, lo que permite la integración sin código en los flujos de trabajo de los agentes de LLM. Para necesidades personalizadas, puedes registrar cualquier API interna o propia en cuestión de minutos para que los agentes que utilizan LLM puedan descubrirla y utilizarla al instante sin modificar tu SDK.

Autenticación segura e integración de SDK

La puerta de enlace admite varios esquemas de autenticación, como la no autenticación, los tokens basados en encabezados y las credenciales de cliente de OAuth2, con un SSO federado a través de proveedores de identidad como Okta y Azure AD. Las credenciales de OAuth2 se almacenan de forma segura en el administrador de secretos integrado de TrueFoundry y se inyectan automáticamente en las solicitudes de proxy, lo que centraliza la administración de credenciales y reduce el riesgo.

.webp)

Los desarrolladores pueden interactuar mediante programación con los servidores MCP registrados mediante los SDK oficiales de Python y TypeScript, que gestionan Autorización MCP de principio a fin, o mediante AI Gateway Playground, una interfaz intuitiva en la que puede agregar servidores MCP, seleccionar herramientas y ejecutar instrucciones en lenguaje natural que invocan servicios remotos en tiempo real. Tanto Playground como el SDK incluyen botones con forma de «fragmento de código de API» para generar plantillas de integración listas para usar en el idioma que prefieras.

Observabilidad y equilibrio de carga

La puerta de enlace de IA de TrueFoundry incorpora la capacidad de observación y el equilibrio de carga de nivel empresarial. Las solicitudes se envían en función del peso o la latencia a los puntos finales más saludables, mientras que todas las invocaciones del MCP se registran y se auditan en paneles de control de gobierno, lo que garantiza la supervisión del cumplimiento y el rendimiento. En un blog reciente, el equipo describe cómo el Gateway actúa como el plano de control central para la infraestructura moderna de IA generativa, unificando los LLM, los servidores MCP y los protocolos de agente a agente en una sola interfaz para lograr una baja latencia, alta confiabilidad y una escalabilidad perfecta. Este enfoque permite la orquestación del lenguaje natural en todos los sistemas empresariales, lo que permite la automatización de principio a fin, como la creación de problemas de Jira a partir de alertas de Slack, sin necesidad de escribir código de integración.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)