Infraestructura local de LLM Gateway: descripción general

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Introducción

Los modelos lingüísticos de gran tamaño se están convirtiendo rápidamente en una capa central del software empresarial. Lo que comenzó como una experimentación basada en la nube con API alojadas ahora está evolucionando hacia sistemas de nivel de producción integrados en herramientas internas, aplicaciones orientadas al cliente y flujos de trabajo automatizados.

A medida que se produce este cambio, muchas organizaciones se enfrentan a una dura realidad: no todas las cargas de trabajo de IA pueden ejecutarse en la nube pública.

Los datos empresariales confidenciales, la propiedad intelectual patentada, las cargas de trabajo reguladas, las aplicaciones de latencia crítica y las obligaciones de cumplimiento impulsan a los equipos a implementar LLM en infraestructura local o privada. Sin embargo, el simple hecho de utilizar modelos de alojamiento automático no resuelve el problema operativo más amplio. A medida que se conectan más equipos, aplicaciones y modelos, las organizaciones necesitan una forma coherente de controlar el acceso, hacer cumplir las políticas, supervisar el uso y gestionar los costos en todo su ecosistema de LLM.

Aquí es donde un Infraestructura local de LLM Gateway se convierte en fundamental.

En lugar de permitir que cada aplicación se integre directamente con los modelos individuales, un LLM Gateway introduce una capa de control centralizada que rige la forma en que se accede a los modelos y se utilizan. En los entornos locales, esta puerta de enlace se convierte en la columna vertebral que permite a las empresas ampliar la adopción de la LLM de forma segura, compatible y eficiente sin sacrificar la visibilidad ni el control.

¿Qué es una pasarela de LLM en una configuración local?

Un Puerta de enlace LLM es una capa centralizada de acceso y gobierno que se encuentra entre las aplicaciones y los modelos de lenguaje. En lugar de que las aplicaciones llamen directamente a los modelos, todas las solicitudes de LLM pasan por la puerta de enlace, que refuerza los controles de seguridad, enrutamiento, observabilidad y políticas en un solo lugar.

En un configuración local, tanto la puerta de enlace como los modelos se ejecutan completamente dentro de la infraestructura de la organización, como un centro de datos, una nube privada (VPC) o un entorno aislado. Esto garantiza que las indicaciones, las respuestas, las incrustaciones y los metadatos nunca superen los límites controlados.

En un nivel superior, una puerta de enlace de LLM local proporciona:

- Un único punto de entrada para todos los accesos al LLM, eliminando las integraciones directas de modelos en todas las aplicaciones

- Autenticación y autorización centralizadas, garantizando que solo los usuarios y servicios aprobados puedan acceder a modelos específicos

- Enrutamiento basado en políticas, lo que permite enviar las solicitudes de forma dinámica al modelo correcto en función de las restricciones de carga de trabajo, entorno o costos

- Observabilidad total, incluidos los registros rápidos, el uso de tokens, la latencia y el seguimiento de errores

- Gobernanza y auditabilidad, lo que permite a las empresas comprender quién usó qué modelo, con qué datos y cuándo

Al abstraer el acceso al modelo detrás de una API estandarizada, la puerta de enlace desvincula el desarrollo de aplicaciones de la infraestructura del modelo. Los equipos pueden cambiar de modelo, introducir versiones ajustadas o aplicar nuevas reglas de gobierno sin modificar el código de la aplicación.

En entornos locales donde la infraestructura es finita, los requisitos de cumplimiento son estrictos y la complejidad operativa es alta, esta capa de puerta de enlace centralizada es lo que hace viable la adopción de la LLM a gran escala. Transforma los modelos autohospedados de despliegues aislados a una plataforma de IA gobernada y lista para la producción.

Por qué las empresas necesitan pasarelas de LLM locales

Ejecutar un LLM en las instalaciones rara vez es solo una decisión de infraestructura. Por lo general, está impulsado por requisitos empresariales no negociables en torno al control, la seguridad y la gobernanza de los datos. Un Puerta de enlace LLM es lo que hace que estas implementaciones sean prácticas a escala.

Residencia y soberanía de datos

Las empresas suelen gestionar entradas confidenciales, como documentos internos, registros de clientes, código fuente o datos clasificados. En entornos regulados, es inaceptable que incluso los datos transitorios y rápidos salgan de una infraestructura controlada.

Una pasarela de LLM local garantiza que:

- Las indicaciones y las respuestas nunca superan los límites de la empresa

- Manejo de datos las políticas se aplican de manera consistente

- Los equipos pueden demostrar dónde se procesan y almacenan los datos

Esto es especialmente importante para las organizaciones que operan bajo estrictos requisitos de soberanía o localización de datos.

Seguridad y control de acceso

Las integraciones directas entre la aplicación y el modelo crean límites de seguridad fragmentados. Cada servicio termina administrando sus propias credenciales, permisos y lógica de acceso, lo que dificulta la aplicación de estándares de seguridad uniformes.

Un LLM Gateway centraliza:

- Autenticación y autorización

- Acceso basado en funciones a modelos específicos

- Protección contra el uso no autorizado o en la sombra de la IA

Al enrutar todo el tráfico a través de una única capa de control, las empresas reducen significativamente su superficie de ataque y ganan confianza en la forma en que se accede a los modelos.

Cumplimiento y auditabilidad

Los marcos regulatorios requieren cada vez más que las organizaciones respondan a preguntas como:

- ¿Quién accedió a qué modelo?

- ¿Qué datos se procesaron?

- ¿Cuándo y con qué propósito?

Una pasarela de LLM local proporciona registros de auditoría integrados de forma predeterminada. Cada solicitud se puede registrar, medir y rastrear sin depender de los equipos de aplicaciones individuales para implementar correctamente la lógica de cumplimiento.

Esto es esencial para los entornos sujetos al RGPD, ITAR, HIPAA o a los estándares de gobierno interno.

Administración de costos y capacidad

Los recursos de GPU locales son limitados y costosos. Sin controles centralizados, los equipos pueden consumir fácilmente en exceso la capacidad de inferencia o implementar cargas de trabajo ineficientes.

Una pasarela de LLM permite:

- Límite de velocidad y cuotas por equipo o aplicación

- Enrutamiento inteligente entre los modelos disponibles

- Visibilidad del uso de los tokens y la carga de la infraestructura

Esto permite a las organizaciones tratar la inferencia de LLM como un recurso administrado en lugar de como un gasto descontrolado.

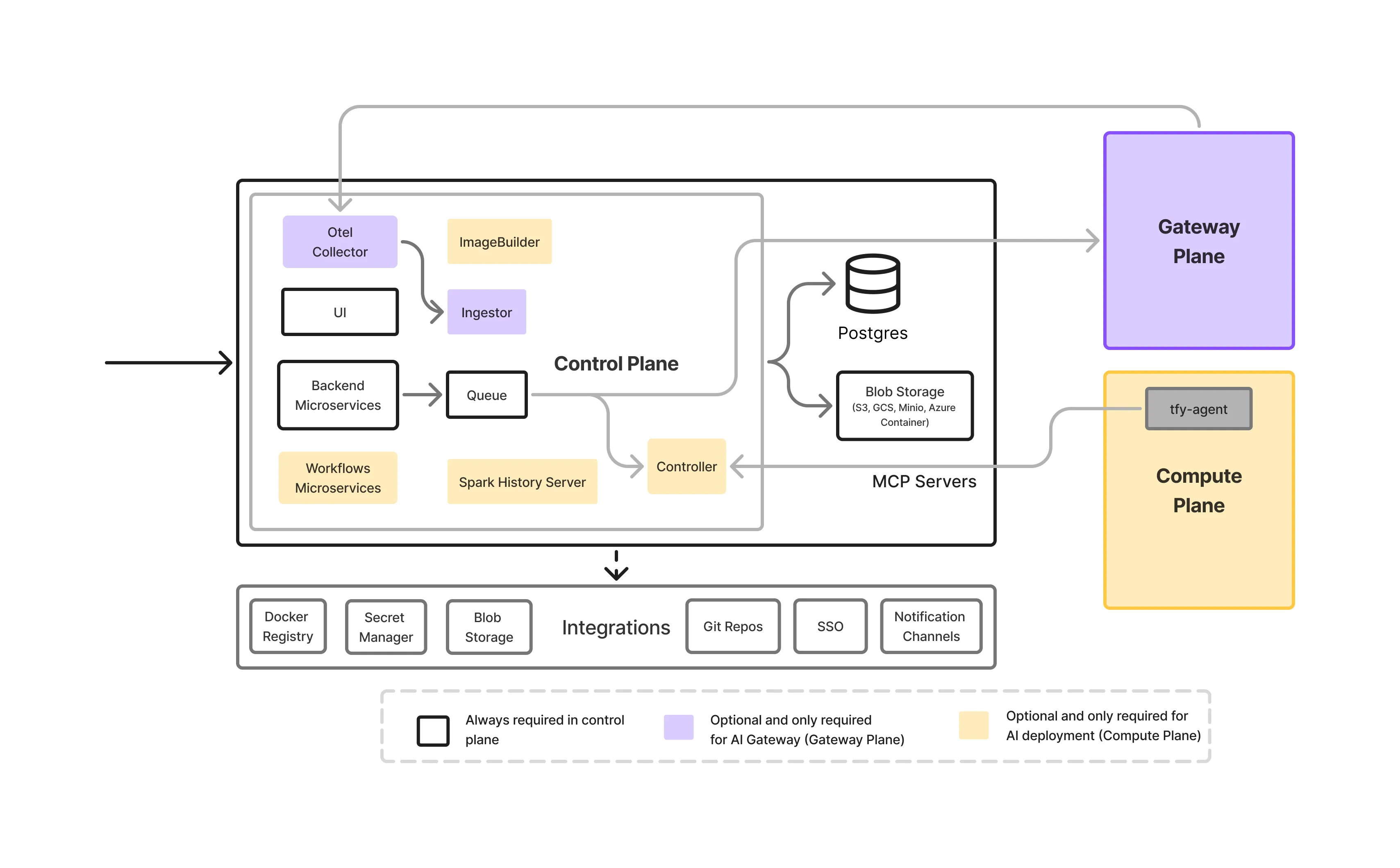

Componentes principales de una infraestructura de puerta de enlace LLM local

Un local LLM Gateway no es un servicio único. Es un pila de infraestructura en capas diseñado para controlar cómo se accede, se gobierna y se opera a los modelos en los entornos empresariales.

Plano de control de pasarela

Esta es la puerta principal para todo el tráfico de LLM.

Gestiona la autenticación, la autorización, la validación de solicitudes y las decisiones de enrutamiento. Al aplicar las políticas de forma centralizada, el plano de control elimina la necesidad de que los equipos de aplicaciones integren la lógica de seguridad o gobernanza en su código.

Modelo de capa de servicio

Esta capa es responsable de modelo de servicio, que aloja los LLM reales que se ejecutan en las instalaciones y los expone para una inferencia acelerada por GPU de baja latencia, que incluye:

- Modelos básicos de código abierto

- Modelos internos perfeccionados

- Servicios de inferencia acelerados por GPU

La pasarela abstrae estos modelos en una API unificada, lo que permite a los equipos cambiar o actualizar los modelos sin afectar a las aplicaciones.

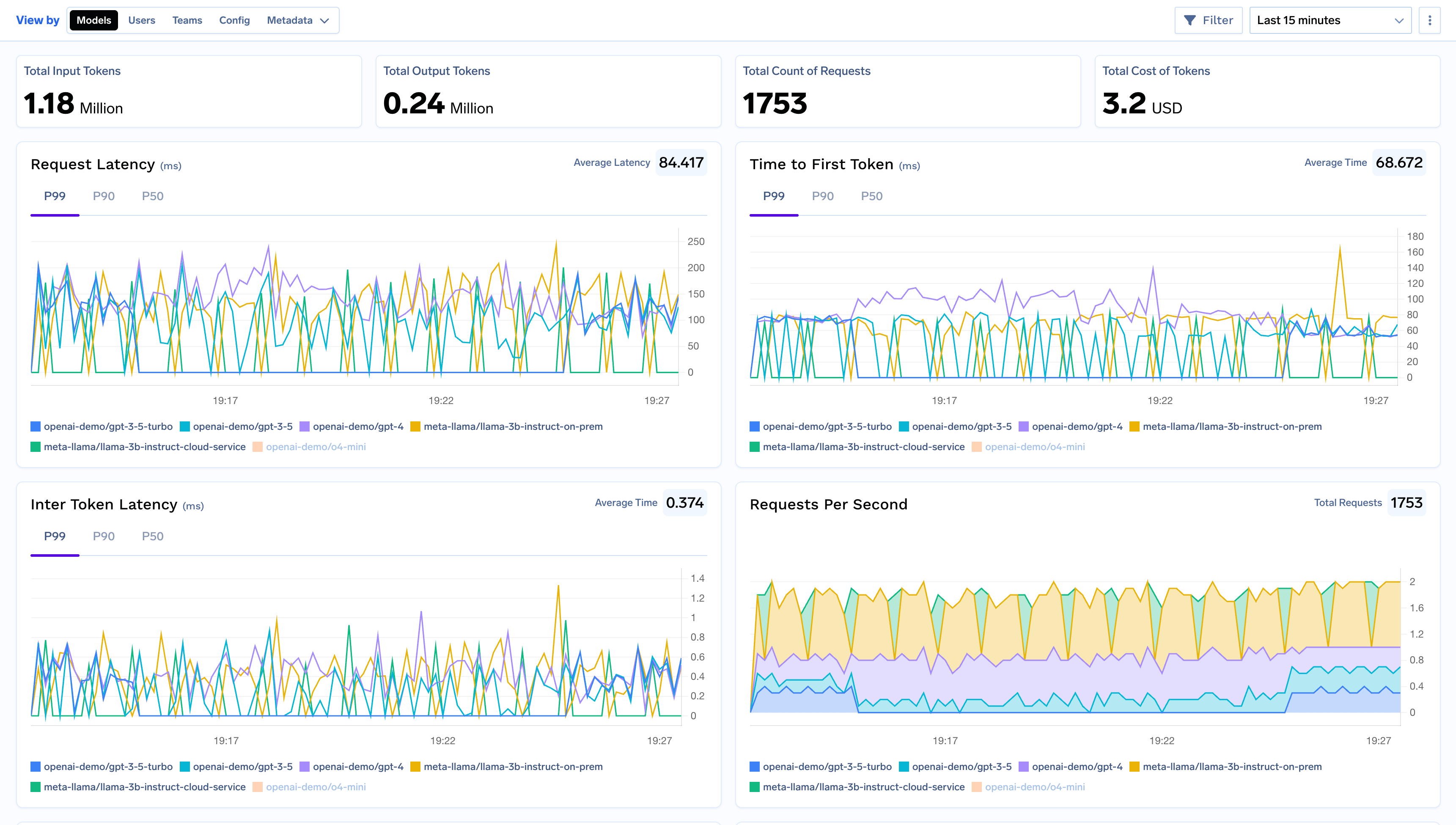

Seguimiento de observabilidad y uso

La visibilidad es fundamental en los entornos locales donde los recursos son limitados.

La puerta de enlace proporciona:

- Métricas de uso a nivel de token y solicitud

- Monitorización de latencia y errores

- Registro opcional de solicitudes y respuestas

Esto permite a los equipos comprender cómo se utilizan los modelos e identificar los problemas de rendimiento o costos de manera temprana.

Motor de gobernanza y políticas

Las reglas de gobierno se definen una vez y se aplican en todas partes.

Esto incluye:

- Qué equipos o servicios pueden acceder a modelos específicos

- Límites de tarifas y cuotas

- Políticas basadas en el medio ambiente (desarrollo frente a producción)

- Filtrado o redacción de contenido opcional

La gobernanza centralizada evita que las políticas se desvíen entre los equipos y las aplicaciones.

Capa de ejecución de infraestructura

Los servicios de puerta de enlace y modelo suelen ejecutarse en una infraestructura basada en Kubernetes compatible con GPU. Esta capa proporciona:

- Aislamiento del entorno

- Escalado controlado de las cargas de trabajo de inferencia

- Ejecución segura dentro de las redes empresariales

Garantiza que la puerta de enlace funcione de manera confiable como parte de una pila de IA local más amplia.

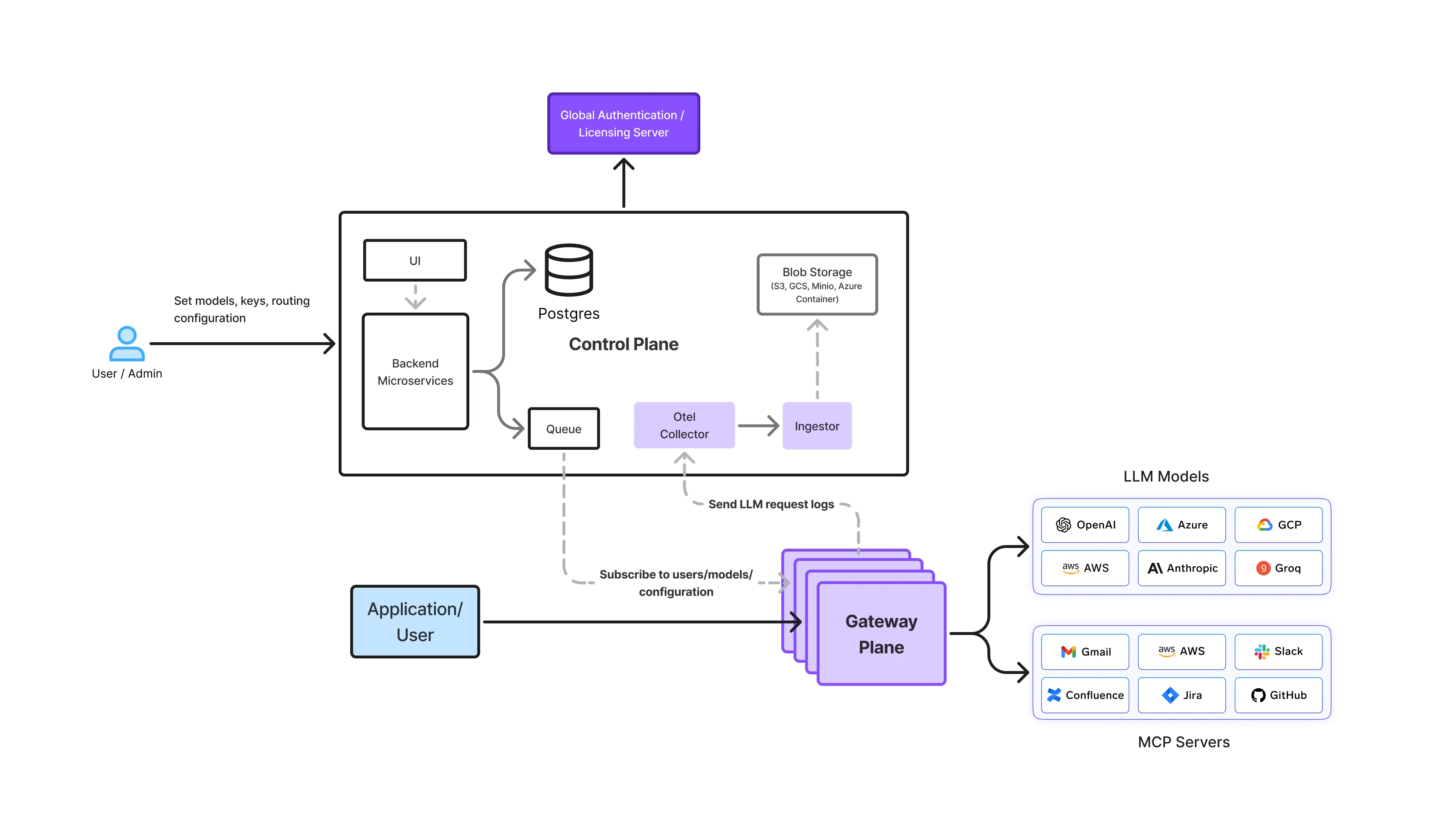

Arquitectura de puerta de enlace LLM local típica

En una configuración local, la puerta de enlace LLM actúa como capa de control central entre aplicaciones y modelos autohospedados. Todas las solicitudes pasan por esta capa, lo que garantiza una seguridad, una gobernanza y una observabilidad coherentes.

Flujo de solicitudes a un nivel alto

- La aplicación envía una solicitud

Las herramientas, las API o los agentes internos envían solicitudes de LLM a la puerta de enlace en lugar de llamar directamente a un modelo. - Gateway hace cumplir las políticas

La puerta de enlace autentica la solicitud, comprueba los permisos de acceso, aplica límites de velocidad y valida las reglas de gobierno. - Modelo de enrutamiento inteligente

Según la configuración, la solicitud se enruta al modelo local apropiado, como un modelo interno ajustado o un modelo básico de uso general. - Ejecución de inferencias

El modelo se ejecuta en una infraestructura respaldada por GPU dentro del entorno empresarial. - Registro y medición

El uso, la latencia y los errores se capturan para la supervisión, el seguimiento de los costos y la auditabilidad. - Respuesta devuelta a la solicitud

El resultado final se devuelve a través de la puerta de enlace al servicio solicitante.

Modelos de implementación para puertas de enlace LLM locales

Las empresas implementan las pasarelas de LLM locales de diferentes maneras según los requisitos de seguridad, cumplimiento y conectividad. La arquitectura de las puertas de enlace sigue siendo la misma, el modelo de implementación cambia.

Implementaciones totalmente aisladas

En entornos altamente regulados, la infraestructura funciona con sin acceso a una red externa.

- Todos los modelos, puertas de enlace y telemetría funcionan completamente de forma local

- Sin tráfico saliente a API o servicios externos

- Común en los sistemas gubernamentales críticos, aeroespaciales y de defensa

En estas configuraciones, LLM Gateway proporciona un control total al tiempo que cumple con los estrictos requisitos de aislamiento.

Implementaciones de nube privada o VPC

Muchas empresas implementan pasarelas de LLM dentro de sus propias cuentas en la nube o redes privadas.

- Se ejecuta en VPC controladas por la empresa

- Ofrece una seguridad sólida con una mayor flexibilidad operativa

- Escalado y mantenimiento más sencillos en comparación con las configuraciones totalmente aisladas

Este modelo es común para las organizaciones reguladas de SaaS y servicios financieros.

Modelos híbridos locales y externos

Algunas organizaciones dividen las cargas de trabajo en función de la sensibilidad.

- Los mensajes sensibles se envían a los modelos locales

- Las cargas de trabajo no confidenciales se pueden redirigir a proveedores externos

- Gobernanza y observabilidad unificadas a través de la misma pasarela

La puerta de enlace garantiza políticas consistentes incluso cuando hay varios entornos de ejecución involucrados.

Desafíos en las implementaciones locales de puertas de enlace LLM

Si bien las pasarelas de LLM locales brindan control y cumplimiento, también presentan desafíos operativos que las empresas deben planificar.

Infraestructura y operaciones

La administración local de las cargas de trabajo de inferencia respaldadas por la GPU requiere una planificación cuidadosa de la capacidad. Sin la automatización, escalar modelos o gestionar los picos de tráfico puede resultar complicado desde el punto de vista operativo.

Rendimiento y utilización de recursos

Los entornos locales tienen un procesamiento finito. Un enrutamiento deficiente o la falta de controles de solicitudes pueden provocar problemas de latencia o infrautilizar las GPU. La administración centralizada del tráfico es esencial para equilibrar el rendimiento y la eficiencia.

Coherencia de la gobernanza

A medida que varios equipos adoptan las LLM, las reglas de gobierno pueden cambiar fácilmente si se aplican a nivel de aplicación. Mantener controles de acceso y políticas de uso coherentes en todos los entornos es difícil sin una puerta de enlace centralizada.

Auditabilidad a escala

Las empresas deben mantener registros claros del uso de LLM sin sobrecargar el almacenamiento ni afectar el rendimiento. Lograr el equilibrio adecuado entre la observabilidad y los gastos generales es un desafío común.

Mejores prácticas para pasarelas de LLM locales listas para la producción

Las empresas que tienen éxito con las implementaciones de LLM locales tratan la puerta de enlace como infraestructura básica, no solo un proxy de API.

Centralice todo el acceso a LLM

Todas las aplicaciones y los agentes deben acceder a los modelos exclusivamente a través de la pasarela. Esto elimina las integraciones clandestinas y garantiza una seguridad y una gobernanza uniformes.

Mantenga las aplicaciones independientes del modelo

Las aplicaciones nunca deben depender de puntos finales de modelos específicos. La abstracción de los modelos detrás de la pasarela permite a los equipos intercambiar, actualizar o ajustar los modelos sin cambiar el código.

Defina las políticas una vez y aplíquenlas en todas

Los controles de acceso, los límites de velocidad y las reglas de uso deben residir en la capa de puerta de enlace, no dentro de la lógica de la aplicación. Esto evita que las políticas se desvíen entre equipos y entornos.

Separe los entornos con claridad

El desarrollo, la puesta en escena y la producción deben aislarse a nivel de infraestructura y políticas. Esto reduce el riesgo y hace que la experimentación sea más segura.

Inicie sesión de manera responsable

Capture suficiente telemetría para la auditabilidad y la optimización y, al mismo tiempo, oculte o limite los datos sensibles de las solicitudes cuando sea necesario. La observabilidad debería permitir el control, no introducir nuevos riesgos.

Seguir estas prácticas garantiza que las pasarelas de LLM locales permanezcan seguro, escalable y administrable a medida que crece la adopción.

Conclusión

A medida que las empresas van más allá de la experimentación e incorporan grandes modelos lingüísticos en los sistemas básicos, el control se vuelve tan importante como la capacidad. Las implementaciones locales abordan las necesidades de residencia, seguridad y cumplimiento de los datos, pero sin una capa de acceso centralizada, se fragmentan rápidamente y son difíciles de controlar.

Un Infraestructura local de LLM Gateway proporciona el plano de control que falta. Estandariza la forma en que las aplicaciones interactúan con los modelos, aplica políticas consistentes y brinda la visibilidad necesaria para operar los LLM de manera responsable y a escala.

Eligiendo el mejor puerta de enlace LLM para las implementaciones locales requiere equilibrar la gobernanza, el rendimiento y la simplicidad operativa en lugar de centrarse únicamente en el enrutamiento de solicitudes.

En lugar de tratar los modelos autohospedados como servicios aislados, las organizaciones que adoptan un enfoque centrado en la puerta de enlace convierten los LLM en una infraestructura empresarial gestionada: segura, observable y lista para el crecimiento a largo plazo.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)