Solución de seguimiento de costos de LLM para la observabilidad, la gobernanza y la optimización empresarial

.webp)

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Por qué todas las organizaciones necesitan una solución sólida de seguimiento de costos de LLM

A medida que las empresas introducen la IA generativa y los modelos de grandes lenguajes (LLM) en la producción, la administración de los costos se convierte en algo fundamental. Los precios basados en tokens, comunes entre los proveedores de LLM, aportan una complejidad única:

- Múltiples LLM con precios distintos—Los modelos OpenAI, Claude, Mistral y autohospedados tienen un costo diferente por token.

- Uso variable por flujo de trabajo, usuario o equipo—Cada función del producto o sesión de usuario puede consumir tokens a ritmos muy diferentes.

- Contexto en capas y canalizaciones dinámicas—Funciones como Retrieval Augmented Generation (RAG), las cadenas de herramientas y los agentes introducen una expansión impredecible de los tokens.

Sin una solución dedicada de seguimiento de costos de LLM, los equipos carecen de visibilidad hasta que los costos aumentan inesperadamente. Esto amenaza los presupuestos e impide los esfuerzos de ampliación.

Aquí se explica cómo abordar el seguimiento, la gobernanza y la optimización de principio a fin, junto con enlaces directos y naturales a la documentación de TrueFoundry para cada elemento principal.

1. Observabilidad unificada

La creación de un seguimiento de costos sólido comienza con la captura de datos completos y estructurados para cada solicitud de LLM. Utilizando el Puerta de enlace de IA TrueFoundry, puede dirigir todo el tráfico de inferencia, ya sea a un modelo de API (como OpenAI, Claude o Mistral) o a un modelo autohospedado que utilice. Esta pasarela actúa como su «panel único» para la observabilidad y la atribución de costos.

Con cada solicitud, debes:

- Etiquete los metadatos, como el usuario, el equipo, el entorno y la función, para una atribución precisa de los costos (Cómo añadir etiquetas de metadatos).

- Capture y analice el recuento de tokens, la latencia de las solicitudes y el modelo que se utilizó, lo que le brinda la base para la gestión de contracargos, devoluciones y gastos en tiempo real (Análisis y monitoreo).

- Integrar Telemetría abierta para incluir estas métricas en su conjunto de observabilidad existente, correlacionando el gasto en LLM con el comportamiento más amplio del sistema.

2. Gobernanza

Una solución integral de seguimiento de costos de LLM debe permitirle hacer cumplir los límites delante de se superan los presupuestos.

- Límites de tarifas: Establezca cuotas diarias/mensuales por usuario, equipo, entorno, modelo o incluso metadatos personalizados (Guía de limitación de velocidad). Esto ayuda a evitar cargas de trabajo «descontroladas» que aumentan el gasto.

- Límites presupuestarios y cumplimiento automatizado: Configure las reglas para que, si un equipo o una función supera el presupuesto, las solicitudes se bloqueen automáticamente o se avise a los administradores (Ejecución del presupuesto).

- Control de acceso: Restrinja los modelos experimentales o de alto costo solo a aquellos equipos y flujos de trabajo que realmente los requieran (Políticas de acceso).

- Barandas: Bloquear las solicitudes inseguras o poco rentables y evitar la expansión accidental de las solicitudes (Descripción general de las barandillas).

En conjunto, estas capacidades de gobierno convierten el inicio de sesión en un solución de seguimiento de costos en vivo y aplicable eso evita los sobrecostos desde el diseño, no solo mediante la presentación de informes retroactivos.

3. Optimización continua: Cómo hacer que su solución de seguimiento de costos de LLM sea dinámica

Tras la observabilidad y la gobernanza, mejoramiento es el proceso continuo de reducción del gasto sin sacrificar el rendimiento ni la calidad.

- Equilibrio de carga y enrutamiento inteligente: Aproveche las ventajas de TrueFoundry equilibrio de carga para enviar solicitudes al modelo más rentable. Por ejemplo, las consultas simples pueden dirigirse a Mistral o a un modelo pequeño con precisión, mientras que las más complejas pueden dirigirse al GPT-4.

- Almacenamiento en caché semántico: Esta técnica almacena y reutiliza los resultados de LLM en función de la similitud semántica de las consultas. Sin embargo, no se adopta de manera generalizada, ya que puede aumentar la incertidumbre o la variabilidad en las respuestas del modelo debido a las sutiles diferencias en el contexto inmediato.

- Almacenamiento en caché y procesamiento por lotes: Aproveche las API de predicción por lotes para minimizar las consultas repetidas y agregar solicitudes similares, lo que reduce drásticamente los costos de los tokens.

- Resultados estructurados y de ingeniería rápidos: Usa el herramientas de esquemas estructurados para limitar los resultados de LLM verbosos e impredecibles y estabilizar los costos.

- Ajuste fino del modelo: Para cargas de trabajo repetitivas y específicas de un dominio, utilice Optimización de los flujos de trabajo de TrueFoundry para acortar las indicaciones y comprimir las solicitudes para su contexto empresarial.

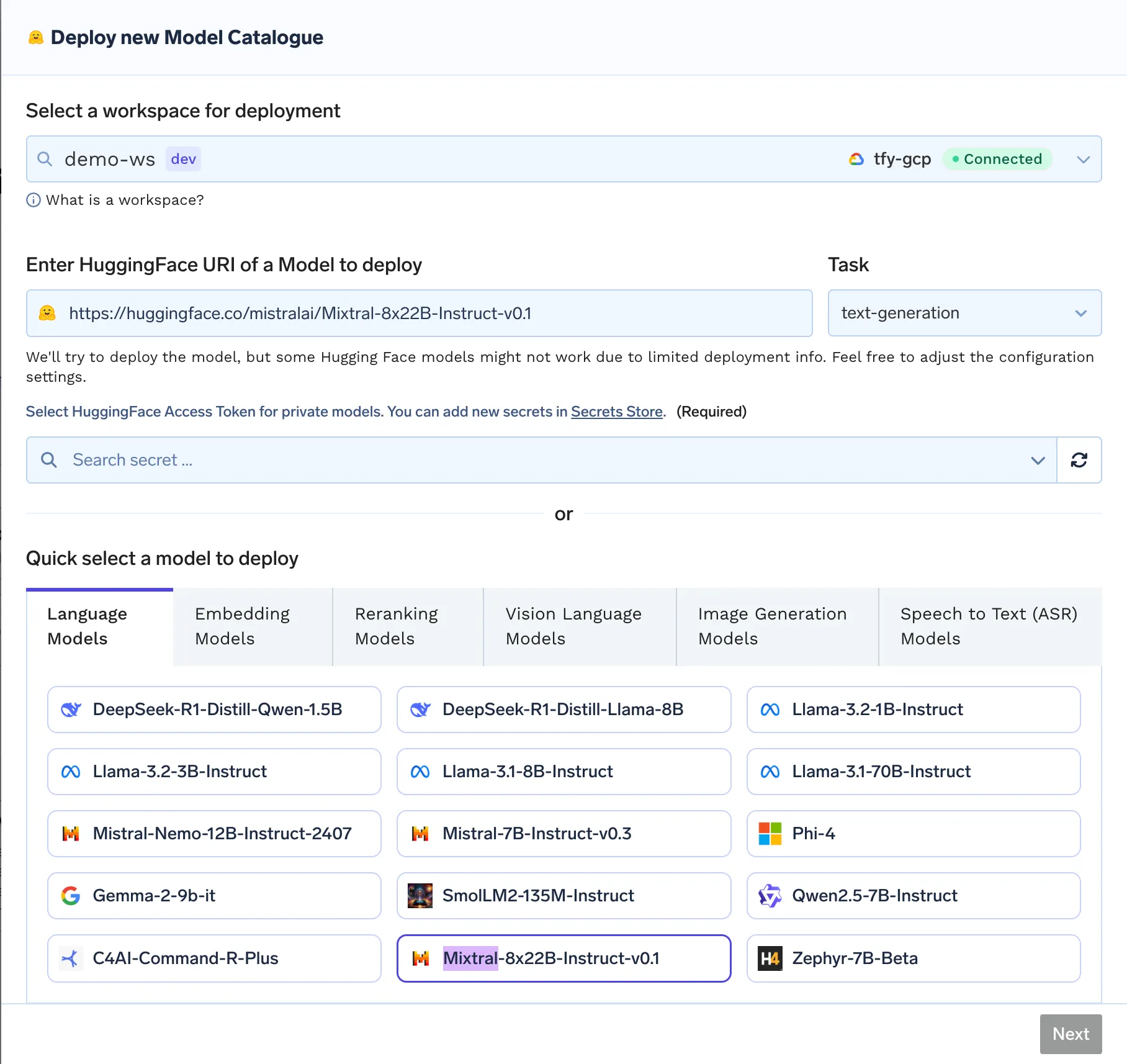

- Autohospedaje: Cuando las cargas de trabajo se estabilicen y el volumen aumente, ejecute LLM de código abierto (como Mistral o Llama) a través de implementación autohospedada puede reducir drásticamente las tasas de API por token, al mismo tiempo que utiliza las mismas herramientas de política y observabilidad.

4. Métricas clave: qué debe rastrear en su solución de seguimiento de costos de LLM

La optimización exitosa de los costos depende de una medición cuidadosa. Los siguientes aspectos son fundamentales para hacer un seguimiento de su cartera de productos:

- Tokens por solicitud: Normaliza y compara los patrones de uso.

- Coste por usuario/equipo/función: Permite la presentación de informes de devoluciones y contracargos para la rendición de cuentas interna.

- Proporción de aciertos de caché: Revela cuánto gasto se ahorra mediante el almacenamiento en caché inteligente.

- Solicitudes dirigidas a modelos caros: Le ayuda a transferir el tráfico no esencial a opciones más baratas.

- Alzas o anomalías de costos: Le permite detectar regresiones, errores de configuración o posibles abusos.

Todo esto se puede recopilar y visualizar automáticamente con Análisis de TrueFoundry.

5. Cuándo autohospedar las LLM como parte de su solución de seguimiento de costos

- Si su organización tiene uso predecible y de alto volumen de LLM, los ahorros derivados de los modelos de código abierto autohospedados pueden ser significativos.

- True Foundry puerta de enlace LLM multinube y guías de implementación autohospedadas asegúrese de que la lógica de monitoreo, gobierno y enrutamiento funcione de manera idéntica tanto para las API externas como para los clústeres internos.

6. Mejores prácticas para las soluciones de seguimiento de costos de LLM

- Centralice todo el tráfico de inferencia a través de una puerta de enlace habilitada para la observabilidad.

- Automatice las alertas de etiquetado y presupuesto para desglosar los costos de las partidas por función, equipo o flujo de trabajo.

- Revisa y ajusta periódicamente los límites de tarifas y las políticas de acceso a medida que tu modelo, equipo y combinación de funciones evolucionen.

- Supervisar y direccionar riesgos de seguridad y consumo descontrolado, especialmente con modelos autohospedados o con altos privilegios.

- Utilice predicción de lotes3 y una validación rápida para garantizar un uso eficiente de los recursos y evitar la fuga de fichas.

Conclusión

Un moderno Solución de seguimiento de costos LLM es más que un simple informe posterior a los hechos: es un plano de control estratégico para cada fase del despliegue de la IA, desde la gobernanza diaria hasta la optimización continua. Aprovechando las funciones integrales que ofrecen La puerta de enlace de IA de TrueFoundry, los equipos obtienen una visibilidad granular, controles proactivos de gastos y enrutamiento rentable para cada LLM que utilizan, ya sea mediante API o clústeres autohospedados.

Para obtener información técnica detallada paso a paso, consulte:

- Descripción general de TrueFoundry AI Gateway

- Arquitectura de puerta de enlace completa

- Etiquetado de metadatos y atribución de costos

- Análisis y observabilidad

- Limitación de velocidad

- Ejecución del presupuesto

- Control de acceso

- Barandas para el uso de avisos y fichas

- Equilibrio de carga y enrutamiento inteligente

- API de predicción por lotes

- Implementaciones de autohospedaje

- Perfeccionamiento de los LLM

Preguntas frecuentes

¿Qué es una solución de seguimiento de costos de LLM?

Una solución de seguimiento de costos de LLM es un plano de control estratégico diseñado para monitorear, administrar y optimizar los gastos únicos asociados con las operaciones del Modelo de Lenguaje Amplio. A diferencia de la infraestructura de nube tradicional, hace un seguimiento específico de los precios basados en fichas, las cargas de inferencia variables y los recursos con uso intensivo de cómputos. Estas plataformas proporcionan visibilidad en tiempo real de los gastos de varios proveedores, modelos y equipos.

¿Por qué es importante el seguimiento de los costos de uso de LLM?

El seguimiento de los costos de uso de la LLM es fundamental porque los gastos de infraestructura de IA pueden crecer de manera exponencial y silenciosa debido a los precios de los tokens basados en el consumo. Sin una supervisión pormenorizada, las organizaciones se enfrentan a enormes sobrecostos presupuestarios, a una facturación mensual impredecible y a una falta de responsabilidad financiera. El seguimiento eficaz garantiza un crecimiento sostenible al vincular cada dólar gastado con un valor empresarial y un ROI mensurables.

¿Cuáles son algunas herramientas de seguimiento de costos de LLM a considerar?

Existen varias herramientas y plataformas especializadas que actualmente lideran el mercado en la gestión y el seguimiento de los costos de LLM. TrueFoundry ofrece una puerta de enlace de inteligencia artificial unificada para la gestión y el gobierno de los gastos en varios modelos. Otras soluciones destacadas son LitellM, que proporciona un proxy ligero para ver los gastos en tiempo real, y Portkey, que se centra en la atribución detallada de los costos para las aplicaciones de IA generativa.

¿Las plataformas LLMOP proporcionan un seguimiento de costos integrado?

Sí, las plataformas LLMOP más avanzadas integran de forma nativa una solución de seguimiento de costos de LLM para administrar el ciclo de vida completo del modelo. Plataformas como TrueFoundry y Weights & Biases capturan datos telemétricos detallados en todos los entornos de producción y muestran los costos simbólicos junto con las métricas de rendimiento. Esta integración nativa permite a los desarrolladores optimizar tanto la precisión como la eficiencia financiera en un flujo de trabajo único y unificado.

¿Cómo me alerta una solución de seguimiento de costos de LLM cuando los gastos de LLM superan un umbral?

Las soluciones de seguimiento de costos de LLM utilizan la supervisión en tiempo real para activar notificaciones automáticas por correo electrónico, Slack o webhooks cuando el uso alcanza los porcentajes predefinidos de un presupuesto. Estos sistemas se pueden configurar con reglas de cumplimiento automatizadas que limitan el tráfico o bloquean las solicitudes una vez que se alcanza un límite máximo. Estas alertas proactivas evitan las cargas de trabajo «descontroladas» y garantizan que se mantengan las barreras financieras.

¿Qué hace que TrueFoundry sea una solución ideal de seguimiento de costos de LLM?

TrueFoundry es una solución ideal de seguimiento de costos de LLM porque combina la atribución de costos en tiempo real con un contexto profundo basado en metadatos. Permite a las empresas definir precios personalizados por modelo y establecer umbrales presupuestarios granulares para equipos, proyectos o entornos específicos. Su AI Gateway optimiza aún más el gasto mediante el enrutamiento inteligente, el almacenamiento en caché semántico y la sustitución automática de modelos, lo que garantiza un alto rendimiento al precio más bajo posible.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)