Introducción a Kubernetes y MLOps: desafíos y beneficios

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Bienvenido a esta serie sobre cómo crear y configurar una infraestructura de aprendizaje automático escalable en un entorno de Kubernetes. En esta serie, abordaremos varios temas relacionados con el desarrollo, la implementación y la administración de modelos de aprendizaje automático en un clúster de Kubernetes.

Infraestructura escalable de aprendizaje automático: prácticas recomendadas

Las operaciones de aprendizaje automático, comúnmente conocidas como MLOps, se refieren a las prácticas y técnicas que se utilizan para administrar el ciclo de vida de los modelos de aprendizaje automático. La infraestructura escalable de operaciones de aprendizaje automático permite a las organizaciones crear, implementar y gestionar modelos a escala, lo que aumenta el retorno de la inversión (ROI) de sus iniciativas de ciencia de datos.

Los beneficios de una infraestructura mLOps escalable incluyen:

- Tiempo de comercialización más rápido para los modelos de aprendizaje automático

- Escalabilidad y flexibilidad mejoradas para los flujos de trabajo de aprendizaje automático

- Implementaciones de modelos consistentes y repetibles

- Colaboración mejorada entre los científicos de datos y los equipos de operaciones de TI

- Precisión y confiabilidad mejoradas del modelo

Airbnb invirtió mucho en la creación de una práctica de MLOps escalable desde el principio. Utilizó modelos de aprendizaje automático para mejorar sus algoritmos de clasificación de búsquedas mediante búsquedas basadas en los datos de los usuarios, lo que se tradujo en una mejor experiencia de búsqueda y en un aumento estimado del 10% en las reservas. Airbnb también utilizó modelos de aprendizaje automático para ofrecer recomendaciones personalizadas a sus usuarios, ¡lo que ayudó a mejorar la experiencia y la participación de los usuarios!

Desafíos en la configuración de la infraestructura mLOps

Las organizaciones que confían en máquinas virtuales (VM), ya sea en AWS, Google Cloud Platform (GCP) o Microsoft Azure, para configurar su infraestructura de capacitación e implementación de aprendizaje automático pueden enfrentarse a varios desafíos:

- Escalabilidad: Las máquinas virtuales tienen opciones de escalabilidad limitadas y es posible que las organizaciones tengan que configurar manualmente instancias adicionales para gestionar la carga, lo que genera problemas de rendimiento y un aumento de los costes.

- Administración de recursos: Las máquinas virtuales requieren una configuración manual para la asignación de recursos y es posible que las organizaciones deban estimar los recursos necesarios para sus cargas de trabajo de aprendizaje automático. Esto puede provocar una infrautilización de los recursos o limitaciones de recursos, lo que repercute en el rendimiento de los modelos de aprendizaje automático.

- Control de versiones: La administración de diferentes versiones de los modelos de aprendizaje automático puede resultar difícil cuando se utilizan máquinas virtuales. Es posible que las organizaciones tengan que administrar manualmente las diferentes versiones del modelo, lo que puede llevar mucho tiempo y ser propenso a errores.

- Seguridad: Las máquinas virtuales pueden tener vulnerabilidades de seguridad y es posible que las organizaciones tengan que configurar manualmente las funciones de seguridad, como los firewalls y los sistemas de detección de intrusos, para proteger sus modelos y datos de aprendizaje automático.

- Monitorización y registro: La supervisión del rendimiento de los modelos de aprendizaje automático y la infraestructura subyacente en una infraestructura basada en máquinas virtuales puede ser un desafío y puede resultar difícil rastrear el estado de los componentes individuales, identificar los cuellos de botella y solucionar problemas.

Kubernetes en MLOps

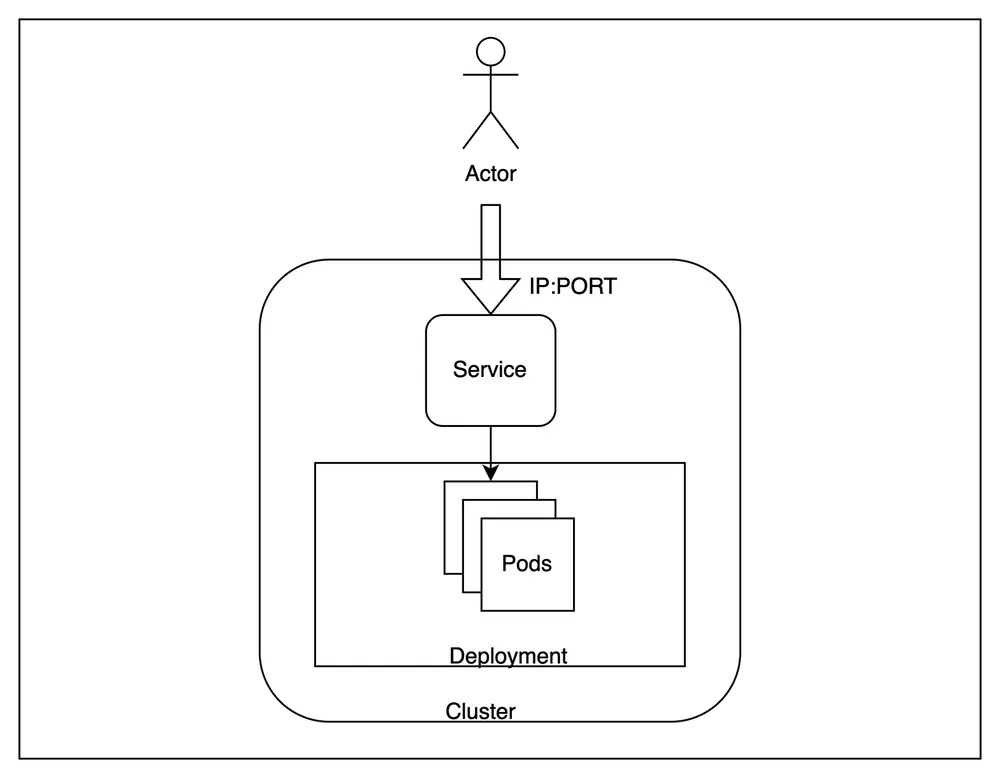

Kubernetes es una popular plataforma de orquestación de contenedores de código abierto que automatiza el despliegue, el escalado y la administración de aplicaciones en contenedores. Proporciona una API unificada y una configuración declarativa que simplifica la administración de las cargas de trabajo en contenedores, lo que permite a las organizaciones crear una infraestructura escalable, resiliente y portátil para entrenar e implementar modelos de aprendizaje automático. Kubernetes ofrece varias ventajas en comparación con las máquinas virtuales sin procesar, como una mejor utilización de los recursos, un control de versiones simplificado y un escalado eficiente. Además, Kubernetes ofrece funciones de seguridad integradas y capacidades centralizadas de monitoreo y registro, que pueden ayudar a las organizaciones a garantizar la seguridad y confiabilidad de su infraestructura de aprendizaje automático. Kubernetes es una excelente opción para las organizaciones que buscan crear canales de aprendizaje automático escalables a largo plazo.

Kubernetes gestionado en AWS, GCP y Azure

Los proveedores de nube (AWS, GCP y Azure) ofrecen servicios gestionados de Kubernetes (EKS, GKE y AKS, respectivamente) que permiten a las organizaciones configurar, configurar y administrar fácilmente los clústeres de Kubernetes, lo que elimina la sobrecarga operativa asociada con la ejecución y el escalado de Kubernetes. Además, los proveedores de nube ofrecen integraciones con otros servicios en la nube, como almacenamiento, bases de datos y redes, lo que puede simplificar aún más la implementación y la administración de las cargas de trabajo de aprendizaje automático en Kubernetes. Al adoptar Kubernetes directamente o mediante un servicio gestionado, las organizaciones pueden crear una canalización de MLOps flexible y escalable que pueda gestionar sus crecientes cargas de trabajo de aprendizaje automático y acelerar la comercialización de sus modelos de aprendizaje automático.

Ventajas de Kubernetes para MLOps

Analicemos con más detalle los beneficios de usar Kubernetes para las canalizaciones de entrenamiento e implementación del aprendizaje automático

- Administración de recursos: Kubernetes permite a las organizaciones aprovisionar y administrar fácilmente los recursos necesarios para ejecutar trabajos de capacitación en aprendizaje automático e implementar modelos. Puede aumentar y reducir automáticamente los recursos en función de la carga de trabajo, lo que garantiza una utilización eficiente de los recursos y reduce los costos.

- Implementación simplificada con las mejores prácticas de SRE: Kubernetes proporciona una API unificada y una configuración declarativa que simplifica la implementación de los modelos de aprendizaje automático. Las organizaciones pueden implementar modelos fácilmente de manera escalable y resiliente, con soporte integrado para las actualizaciones continuas y los despliegues canarios, lo que puede ayudar a minimizar el tiempo de inactividad y mejorar la confiabilidad.

- Flexibilidad y portabilidad: Kubernetes proporciona una infraestructura flexible y portátil que puede soportar varios escenarios de implementación, incluidos los entornos locales, en la nube e híbridos. Esto permite a las organizaciones mover fácilmente sus cargas de trabajo de aprendizaje automático entre diferentes entornos y evitar la dependencia de un proveedor.

- Mejor utilización de los costos y los recursos: Kubernetes permite a las organizaciones utilizar los recursos de manera eficiente, al empaquetar varias cargas de trabajo de aprendizaje automático en un solo nodo, lo que ayuda a minimizar los costos de infraestructura. Además, Kubernetes puede aprovechar otro hardware especializado para acelerar el entrenamiento y la inferencia del aprendizaje automático, lo que puede mejorar aún más el rendimiento.

Ejemplo de caso de uso 1: AirBnB

Airbnb, el mercado en línea que permite a las personas alquilar sus casas o apartamentos a los viajeros. Con millones de usuarios y una enorme cantidad de datos que analizar, Airbnb necesitaba una infraestructura de aprendizaje automático sólida y escalable para analizar el comportamiento de los usuarios, mejorar las clasificaciones de búsqueda y ofrecer recomendaciones personalizadas a los usuarios.

Para lograrlo, Airbnb invirtió en la creación de una infraestructura de MLOps en Kubernetes, lo que permitió a su equipo de ciencia de datos desarrollar e implementar modelos de aprendizaje automático a escala. Con Kubernetes, Airbnb pudo contenedorizar sus modelos e implementarlos como microservicios, lo que facilitó la administración y el escalado de su infraestructura a medida que crecían sus necesidades. Como resultado, Airbnb pudo mejorar sus clasificaciones de búsqueda y ofrecer recomendaciones más relevantes a sus usuarios, lo que se tradujo en un aumento de las reservas y de los ingresos. Además, la empresa pudo mejorar la eficiencia de sus flujos de trabajo de ciencia de datos, lo que permitió a su equipo centrarse en desarrollar modelos de aprendizaje automático más avanzados.

Ejemplo de caso de uso 2: Lyft

Lyft, un importante proveedor de transporte como SaaS (TaaS), creó inicialmente su infraestructura de aprendizaje automático sobre AWS mediante una combinación de instancias EC2 y contenedores Docker. Utilizaron instancias EC2 para aprovisionar máquinas virtuales con distintos niveles de recursos de CPU, memoria y GPU, en función de los requisitos específicos de la carga de trabajo de aprendizaje automático. También usaron contenedores Docker para empaquetar e implementar sus cargas de trabajo de aprendizaje automático y garantizar la coherencia en los diferentes entornos.

Sin embargo, a medida que las cargas de trabajo de aprendizaje automático de Lyft crecían en complejidad y escala, se enfrentaron a varios desafíos, incluida la coherencia en diferentes entornos y equipos, y decidieron migrar su infraestructura de aprendizaje automático a una infraestructura basada en Kubernetes utilizando KubeFlow inicialmente y luego una plataforma interna. Al migrar a una infraestructura basada en Kubernetes, Lyft pudo crear una infraestructura de aprendizaje automático más eficiente y escalable, lo que les ayudó a acelerar sus procesos de desarrollo e implementación del aprendizaje automático. Además, pudieron aprovechar las ventajas de Kubernetes, como el escalado automático y la utilización eficiente de los recursos, para optimizar sus cargas de trabajo de aprendizaje automático y reducir los costos de infraestructura. ¡Utilizaron EKS de AWS como su servicio de Kubernetes administrado!

En general, la inversión en infraestructura de MLOps en Kubernetes permitió a Airbnb y Lyft lograr importantes aumentos de productividad y mejorar sus resultados, lo que demuestra el valor que los MLOps escalables sobre Kubernetes pueden aportar a las organizaciones que buscan aprovechar el aprendizaje automático a gran escala.

Desafíos de Kubernetes en MLOps

A pesar de los beneficios, el uso de Kubernetes para la infraestructura de aprendizaje automático conlleva su propio conjunto de desafíos y complejidades:

- Administración de recursos cuando se trata de conjuntos de datos grandes o modelos complejos: debido a los requisitos de una gran cantidad de recursos informáticos, incluidas las GPU, la memoria y el almacenamiento, puede resultar difícil garantizar una asignación eficiente de manera que no entre en conflicto con otras cargas de trabajo que se ejecutan en el clúster de Kubernetes.

- Integración de diferentes herramientas: las organizaciones pueden usar diferentes herramientas de aprendizaje automático, como TensorFlow, PyTorch y scikit-learn, cada una con sus propios requisitos y dependencias. La integración de estas herramientas y dependencias con la infraestructura de Kubernetes puede resultar compleja y llevar mucho tiempo.

- Preocupaciones de seguridad para los modelos de aprendizaje automático: es fundamental garantizar que los modelos de aprendizaje automático estén protegidos contra el acceso no autorizado o los ataques. Si bien Kubernetes ofrece varias funciones de seguridad, como el control de acceso basado en roles (RBAC), las políticas de red y el aislamiento de contenedores, configurarlas correctamente puede resultar difícil cuando se trata de datos confidenciales, como la información personal o los registros financieros.

- Supervisión y registro en un entorno distribuido: la supervisión del rendimiento de los modelos de aprendizaje automático y la infraestructura subyacente es fundamental para garantizar un rendimiento óptimo. Sin embargo, en un entorno distribuido de Kubernetes, puede resultar difícil rastrear el estado de los componentes individuales, identificar los cuellos de botella y solucionar los problemas. Las organizaciones deben configurar herramientas de monitoreo y registro que brinden visibilidad en tiempo real de sus flujos de trabajo de aprendizaje automático y de la infraestructura de Kubernetes.

Si bien existen desafíos, al seguir las mejores prácticas y aprovechar las capacidades de Kubernetes, las organizaciones pueden superar estos desafíos y crear una infraestructura MLOps escalable, segura y confiable.

Conclusión

Kubernetes for Machine Learning ofrece numerosas ventajas para las organizaciones que buscan optimizar sus flujos de trabajo de aprendizaje automático. Si bien la configuración y la administración de la infraestructura de MLOps en Kubernetes plantean desafíos, como la administración de recursos, la seguridad y la supervisión, un conocimiento profundo de Kubernetes y las mejores prácticas puede ayudar a superar estos obstáculos.

En esta serie de ML on Kubernetes, trataremos varios temas relacionados con la creación y configuración de la infraestructura de ML en un entorno de Kubernetes, incluidos los siguientes:

- Contenerización y orquestación con Kubernetes

- Capacitación distribuida sobre Kubernetes

- Servicio e implementación de modelos basados en Kubernetes

- Infraestructura de aprendizaje automático basada en GPU en Kubernetes

- Canalización de CI/CD de Kubernetes

- Monitorización de Kubernetes para MLOP

y mucho más..

Al adoptar estas mejores prácticas y aprovechar el poder de Kubernetes, las organizaciones pueden escalar e implementar modelos de aprendizaje automático con coherencia, confiabilidad y seguridad. Esto, a su vez, reduciría el tiempo de comercialización, mejoraría la colaboración entre los equipos de ciencia de datos y de operaciones de TI y mejoraría el ROI de sus inversiones en ciencia de datos.

Descubra cómo Gong ha creado una infraestructura escalable de investigación de aprendizaje automático en Kubernetes

True Foundry es un PaaS de implementación de aprendizaje automático sobre Kubernetes para acelerar los flujos de trabajo de los desarrolladores y, al mismo tiempo, permitirles una flexibilidad total a la hora de probar e implementar modelos, al tiempo que garantiza una seguridad y un control totales para el equipo de Infra. A través de nuestra plataforma, permitimos a los equipos de aprendizaje automático implementar y supervisar modela en 15 minutos con un 100% de confiabilidad, escalabilidad y la capacidad de revertirse en segundos, lo que les permite ahorrar costos y lanzar los modelos a la producción más rápido, lo que permite obtener un verdadero valor empresarial.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)