Qu'est-ce qu'une passerelle MCP ? Un guide pratique pour les équipes d'IA d'entreprise

Mis à jour : March 12, 2026

.webp)

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Les systèmes d'IA ne se limitent plus à répondre à des questions. Ils agissent de plus en plus. Ils lisent les tickets d'assistance, interrogent les bases de données internes, mettent à jour les CRM, résolvent les problèmes liés à Jira et déclenchent parfois des flux de production. Le passage des assistants conversationnels aux agents opérationnels modifie l'architecture sous-jacente.

La plupart des équipes commencent par des connexions directes. Un LLM appelle une API Slack. Un autre agent interroge Postgres. Un troisième parle à GitHub. Au début, ça fonctionne. Mais à mesure que le nombre d'agents et d'outils augmente, le motif devient fragile. Les informations d'identification sont éparpillées. Les règles d'accès sont affichées dans les instructions. Il existe peu de visibilité centralisée sur ce que fait réellement un agent.

Le Model Context Protocol (MCP) introduit une méthode standard permettant aux modèles de découvrir et d'invoquer des outils externes. Il n'est plus nécessaire de créer un code de colle personnalisé pour chaque association modèle-outil. Cela seul a du sens.

Mais le MCP ne résout pas à lui seul la question de la gouvernance. Il n'applique pas le contrôle d'accès. Il ne fournit pas d'audit centralisé ni de limites de coûts. Dans les environnements d'entreprise, ces lacunes sont importantes.

C'est là que l'idée d'une passerelle MCP émerge. Il ne s'agit pas d'un module complémentaire optionnel mais d'une couche de contrôle qui rend le MCP utilisable à grande échelle.

Deploy a secure MCP Gateway inside your own cloud environment with TrueFoundry.

- Run the MCP Gateway inside your cloud while maintaining full control over security and access.

Pourquoi les agents d'IA ont-ils besoin d'une couche d'intégration standardisée ?

La première génération de systèmes LLM était largement passive. Vous avez envoyé une invite. Vous avez reçu un texto. Si la réponse était fausse, c'était gênant et non catastrophique. Ce modèle ne tient plus.

Les agents IA modernes interrogent les bases de données, modifient les tickets, envoient des e-mails et déclenchent l'automatisation en aval. Ils ne se contentent pas de générer du langage. Ils exécutent leur intention. Et une fois que l'exécution entre en ligne de compte, l'architecture est plus importante que la rapidité de l'ingénierie.

La plupart des équipes commencent par des intégrations directes. Un agent reçoit une clé d'API GitHub. Un autre obtient des informations d'identification Slack. Un troisième se connecte au CRM. Chaque intégration est construite indépendamment, souvent dans le code de l'application ou dans des scripts wrapper. On dirait que c'est rapide. C'est rapide. Mais il n'est pas évolutif.

Chaque agent gère ses propres informations d'identification. Les règles d'accès sont éparpillées. L'observabilité est fragmentée entre les systèmes. L'ajout d'un nouvel outil nécessite le câblage d'une autre connexion directe. Bientôt, personne ne sait exactement quel agent peut toucher quel système.

Le motif ressemble à ceci :

.webp)

Il n'y a pas de couche de contrôle. Aucune piste d'audit centralisée. Aucune application de politique unifiée.

À mesure que le nombre d'agents augmente, cette topologie devient fragile. Ce qui commence par de la flexibilité devient progressivement un risque opérationnel. Une couche d'intégration standardisée n'est pas une question d'élégance. C'est une question de confinement.

Qu'est-ce qu'un protocole de contexte modèle (MCP) ?

Le Model Context Protocol, ou MCP, est un protocole ouvert qui définit la manière dont les modèles d'IA découvrent et interagissent avec des outils externes. Au lieu que chaque modèle s'intègre différemment à chaque API, MCP introduit un langage partagé entre les agents et les systèmes. Il s'appuie sur des concepts similaires au protocole de serveur de langage et applique la même idée de négociation standardisée des capacités à l'utilisation des outils d'IA.

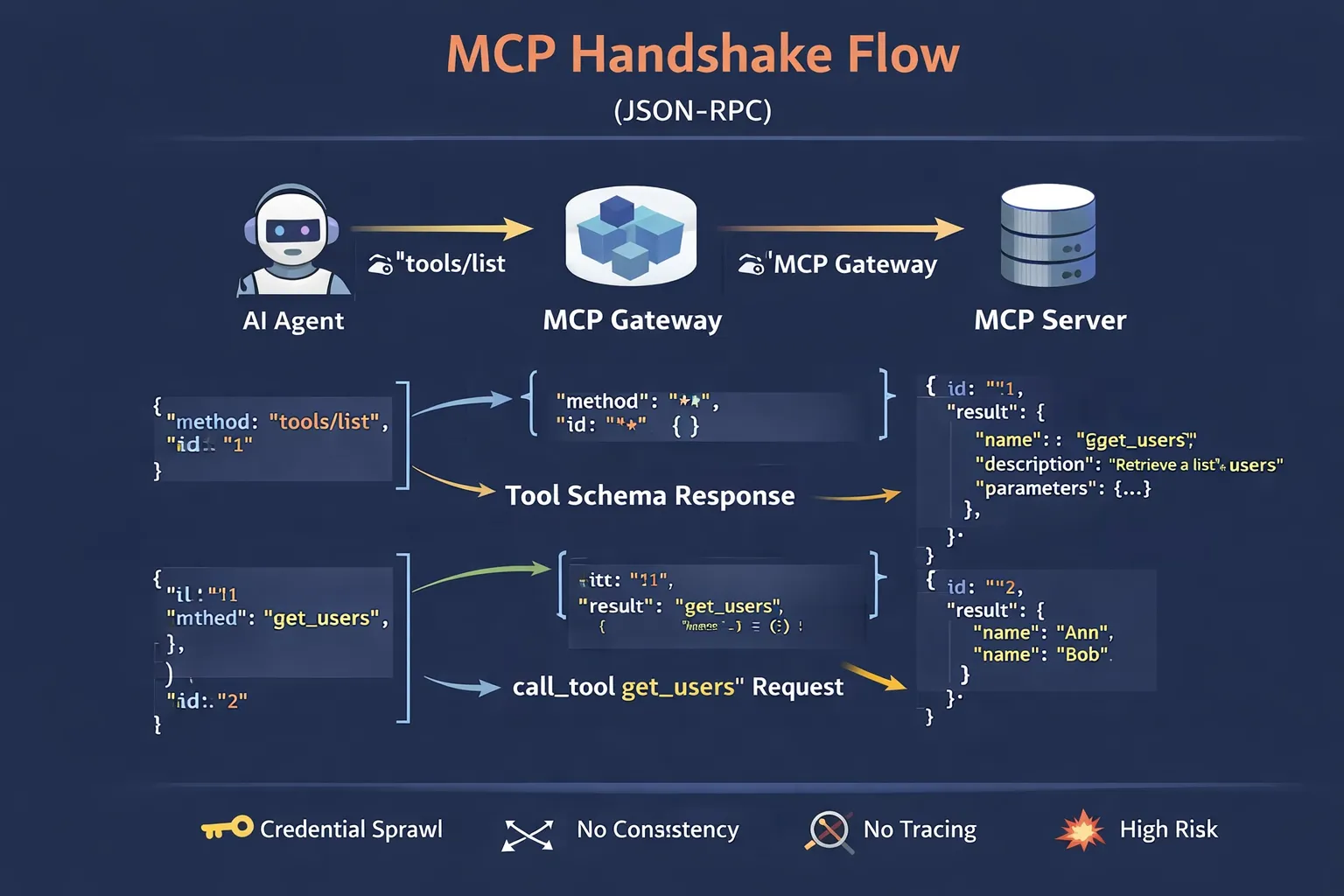

À la base, MCP utilise JSON-RPC sur HTTP. Lorsqu'un client MCP se connecte à un serveur MCP, il exécute une étape de découverte. Le modèle envoie une demande d'outils/de liste pour comprendre quels outils disponibles sont exposés.

{

« méthode » : « outils/liste »

}

Le serveur répond avec une liste structurée d'outils MCP, y compris leurs noms, leurs schémas d'entrée et les sorties attendues. À partir de là, l'agent peut invoquer un outil spécifique à l'aide d'une méthode call_tool, en transmettant des arguments conformes au schéma déclaré.

Cette poignée de main est importante. Il normalise la découverte et l'invocation des capacités entre les fournisseurs et les systèmes. Un connecteur GitHub et un connecteur Postgres exposent les outils différemment au niveau du backend, mais via MCP, ils présentent une interface unifiée au modèle.

En fait, MCP supprime l'explosion combinatoire des intégrations personnalisées. Au lieu d'écrire un code d'assemblage sur mesure pour chaque association modèle-outil, les équipes implémentent les serveurs MCP une seule fois et permettent aux modèles d'interagir via un protocole uniforme. C'est devenu la norme MCP concernant la façon dont les modèles d'IA communiquent avec les services principaux et les sources de données de l'écosystème MCP.

Mais la standardisation des protocoles n'est pas la même chose que la gouvernance. Cette distinction devient importante.

Qu'est-ce qu'une passerelle MCP ?

Si le MCP définit la façon dont les modèles communiquent avec les outils, une passerelle MCP définit qui est autorisé à parler et dans quelles conditions.

Une passerelle MCP se trouve entre les agents IA et un ou plusieurs serveurs MCP. Au lieu que les agents établissent des connexions directes aux serveurs GitHub, aux connecteurs de base de données ou aux moteurs de flux de travail, ils se connectent à la passerelle. La passerelle devient le point de terminaison unique : un point d'entrée central pour la découverte et l'invocation des outils. Il fonctionne comme un proxy centralisé pour tout le trafic MCP.

Du point de vue de l'agent, rien ne change structurellement. Il effectue toujours une poignée de main entre les outils et les listes. Il émet toujours des requêtes call_tool. Mais ces requêtes sont interceptées, évaluées et acheminées par la passerelle avant qu'un système principal ne les exécute.

Au minimum, la passerelle MCP joue quatre rôles.

Tout d'abord, le contrôle des découvertes. Il filtre quels outils sont visibles pour quels agents.

Deuxièmement, le routage. Il transmet les demandes au serveur MCP approprié.

Troisièmement, l'authentification. Il valide l'identité et peut propager les informations d'identification au nom d'un utilisateur.

Quatrièmement, l'application des politiques. Il peut appliquer des limites de débit, des restrictions de portée ou des contraintes d'exécution avant de transférer le trafic.

Sur le plan architectural, la différence est simple mais profonde :

.webp)

La passerelle MCP centralise le contrôle sans modifier les serveurs individuels. Le MCP reste le protocole. La passerelle devient la couche de gestion qui sécurise l'utilisation du protocole en production.

Lisez également : Qu'est-ce que MCP Gateway

Là où le MCP seul ne suffit pas dans les environnements d'entreprise

Le MCP normalise les interactions. Il ne normalise pas le contrôle.

Par défaut, MCP ne définit pas le contrôle d'accès basé sur les rôles. Si un agent peut se connecter à un serveur, il peut découvrir tous les outils que ce serveur expose. Il n'existe pas de concept natif de définition de la visibilité par équipe, par charge de travail ou par utilisateur. L'accès devient un problème d'infrastructure en dehors du protocole lui-même.

Il n'existe pas non plus de couche d'audit centralisée. Chaque serveur MCP peut enregistrer sa propre activité, mais il n'existe aucun point d'agrégation inhérent indiquant quel agent a invoqué quel outil, pour le compte de qui et dans quel ordre. Reconstituer l'intention sur différents serveurs MCP devient un exercice manuel.

La gouvernance des coûts présente une lacune similaire. MCP ne suit pas la consommation de jetons et ne fixe pas de limites d'utilisation. Un agent peut invoquer des outils à plusieurs reprises, déclenchant des appels de modèles ou des requêtes de base de données, sans aucune contrainte budgétaire intégrée.

Il y a ensuite le problème de l'explosion de l'outil. À mesure que les organisations ajoutent des connecteurs (GitHub, Slack, services internes, systèmes d'observabilité), la liste des outils détectables s'allonge. Sans contrôles de visibilité, les agents sont exposés à des fonctionnalités dont ils n'ont peut-être pas besoin, ce qui complique le raisonnement et augmente le rayon d'action. En temps réel, l'absence de politiques de sécurité transforme une lacune de gouvernance en une responsabilité active.

Le MCP est nécessaire. Ce n'est pas suffisant. Le déploiement en entreprise nécessite une couche de contrôle supplémentaire.

Qu'est-ce qu'une passerelle MCP et son rôle dans les systèmes d'IA de production

Dans les environnements de production, quelle est la meilleure définition d'une passerelle MCP ? Il ne s'agit pas simplement d'un proxy de routage, mais il se comporte davantage comme un plan de contrôle superposé à plusieurs plans d'exécution.

Le plan d'exécution est composé de serveurs MCP. Ils se connectent à GitHub, Postgres, Slack, aux API internes et aux systèmes existants. Ils effectuent des actions. Ils renvoient les résultats.

Le plan de contrôle se trouve à la passerelle. Il décide quel agent peut voir quels outils, sous quelle identité et avec quelles contraintes. Cette séparation est subtile, mais elle modifie la façon dont les risques sont gérés. Une passerelle MCP est un proxy inversé spécialement conçu pour le trafic MCP, avec des fonctionnalités de sécurité que les proxys standard n'offrent pas.

L'une des capacités essentielles est la propagation de l'identité. Dans de nombreux systèmes réels, un agent d'IA agit pour le compte d'un utilisateur humain. Sans propagation, l'agent fonctionne souvent avec un compte de service partagé. Avec une passerelle, l'identité de l'utilisateur authentifié peut être injectée en aval via des jetons OAuth ou OIDC.

Le flux ressemble à ceci :

.webp)

La passerelle valide le JWT, le mappe aux autorisations d'Alice et transmet la demande à l'aide de ses informations d'identification étendues. Si Alice ne peut pas supprimer un dépôt, l'agent agissant pour elle ne le peut pas non plus. L'autorisation est appliquée au niveau du protocole et n'est pas prise en compte dans les invites.

Le tranchage des outils est une autre fonction essentielle. La passerelle filtre les réponses aux outils/listes, exposant uniquement un sous-ensemble pertinent pour une équipe ou une charge de travail particulière. Les capacités dangereuses n'apparaissent tout simplement jamais dans le contexte de l'agent. Les données sensibles et les terminaux à privilèges élevés restent invisibles pour les agents qui n'ont aucune raison d'y accéder.

Enfin, l'application des politiques se fait au niveau du protocole. Avant qu'une requête call_tool n'atteigne un serveur, la passerelle peut inspecter les arguments, appliquer des quotas ou bloquer complètement les opérations.

Dans les systèmes d'IA de production, cette couche de médiation fait la différence entre l'expérimentation et l'infrastructure gouvernable.

Risques opérationnels et de sécurité sans passerelle MCP

Les connexions directes entre le modèle et l'outil semblent efficaces jusqu'à ce que vous examiniez les modes de défaillance.

Le premier problème est l'étalement des titres de compétences. Chaque agent possède souvent ses propres clés d'API ou comptes de service. Ces clés se trouvent dans des variables d'environnement, des fichiers de configuration ou des magasins secrets disséminés entre les services. La rotation des informations d'identification devient fastidieuse. Révoquer l'accès direct pour un flux de travail compromis est encore pire. Il n'y a pas de point d'étranglement unique.

Vient ensuite une exposition excessive à l'outil. Lorsque les agents disposent d'un accès direct étendu à tous les serveurs MCP disponibles, la réponse aux outils/à la liste peut devenir surchargée. Les modèles sont plus performants lorsque l'espace d'action est restreint. L'exposition de dizaines d'outils externes peu liés augmente la complexité du raisonnement et augmente la probabilité d'une sélection d'outils incorrecte. En d'autres termes, la posture de sécurité et les performances du modèle se dégradent simultanément.

L'observabilité en souffre également. Sans passerelle agrégeant le trafic MCP, le suivi du comportement d'un agent nécessite de passer au peigne fin les journaux de plusieurs serveurs MCP. Il n'existe pas de calendrier d'exécution unifié. Le débogage devient une conjecture.

Enfin, il y a un rayon d'explosion. Si un agent se connecte directement aux systèmes de production avec des informations d'identification à privilèges élevés, les erreurs se propagent immédiatement. Une instruction mal interprétée peut déclencher des opérations irréversibles.

L'absence de couche de contrôle ne réduit pas simplement l'élégance. Il augmente le risque opérationnel de manière à ce qu'il augmente discrètement au fil du temps.

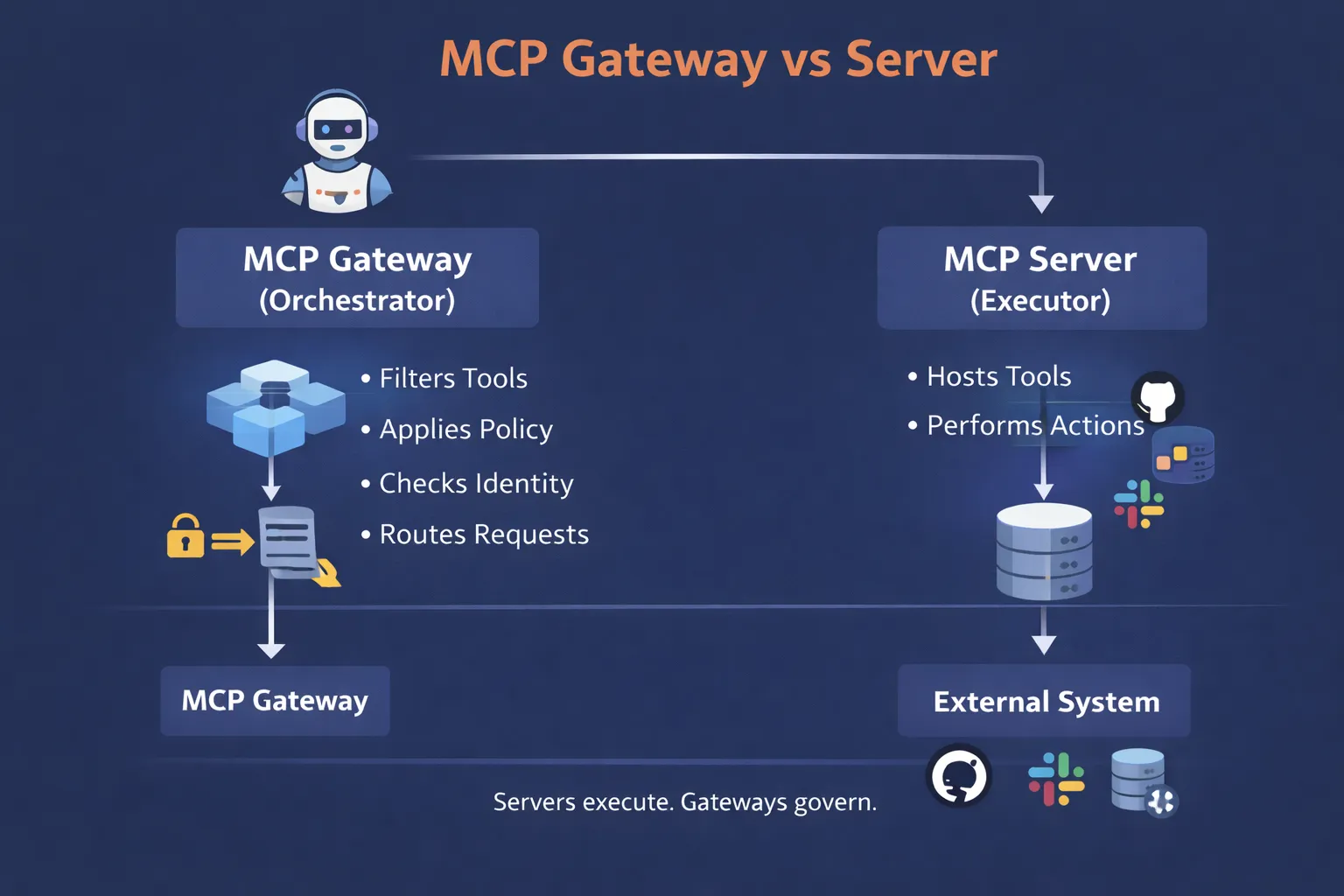

MCP Gateway contre Server

La terminologie peut prêter à confusion, d'autant plus que les deux composants parlent MCP.

Un serveur MCP est un exécuteur. Il se connecte à un système spécifique, GitHub, Slack, Postgres, à une API interne, et expose des outils qui effectuent des actions concrètes. Il sait comment traduire une requête call_tool en requête de base de données ou en appel d'API. Il fait le travail.

Une passerelle MCP, en revanche, est un orchestrateur. Il n'exécute pas de logique métier. Il régit le contrôle d'accès aux serveurs principaux. Il filtre les réponses de découverte, applique l'authentification, propage l'identité, applique des politiques de sécurité et achemine les demandes vers le point de terminaison d'exécution approprié.

La distinction est structurelle :

Sans serveurs, il n'y a pas d'outils. Sans passerelles, il n'y a pas de contrôle centralisé. Dans les architectures de production, les deux rôles coexistent généralement, chacun opérant à un niveau de responsabilité différent. L'ajout de nouveaux serveurs MCP est simple lorsqu'ils s'enregistrent via une passerelle ; les nouveaux serveurs sont intégrés une seule fois et leurs outils deviennent disponibles de manière sélective plutôt qu'universelle.

Le MCP est-il meilleur qu'une passerelle API ?

Le MCP ne remplace pas les API et ne remplace pas une passerelle API.

Les API restent l'interface fondamentale entre les systèmes. Ils définissent les contrats, appliquent les schémas et exposent les capacités de l'entreprise de manière structurée. Les passerelles API se trouvent devant ces interfaces et gèrent l'authentification, la limitation du débit, la gestion du trafic et parfois la transformation.

Le MCP fonctionne à un niveau différent. Il ne remplace pas les points de terminaison REST ou GraphQL. Au lieu de cela, il rend ces API utilisables par les modèles d'IA. Grâce à la découverte et à l'invocation standardisées des outils, MCP traduit les fonctionnalités structurées de l'API dans un format que les modèles peuvent raisonner. Cette distinction est particulièrement importante pour l'intégration de systèmes impliquant à la fois des services traditionnels et des flux de travail pilotés par l'IA.

Dans les architectures d'entreprise modernes, les deux coexistent souvent. Les API fournissent des services et des intégrations d'applications. Les passerelles API régissent le trafic HTTP traditionnel. Les serveurs MCP exposent certaines fonctionnalités aux agents. Une passerelle MCP gère ensuite le contrôle d'accès des agents.

La relation est complémentaire et non concurrentielle. La suppression des API entraînerait l'effondrement de l'intégration du système. La suppression de MCP rendrait ces API invisibles pour les modèles. Les systèmes d'IA de production nécessitent généralement que les deux couches travaillent ensemble.

Fonctionnalités de base d'une passerelle MCP d'entreprise

Toutes les passerelles qui transfèrent le trafic JSON-RPC ne sont pas considérées comme prêtes pour l'entreprise. Les environnements de production exigent bien plus que le routage. Ils ont besoin d'identité, de visibilité et d'une portée délibérée dans tous les cas d'utilisation, qu'il s'agisse de l'assistance client ou de flux de travail complexes en plusieurs étapes.

Authentification unifiée (au nom de Access)

.webp)

Lors de déploiements sérieux, les agents agissent rarement seuls. Ils agissent pour quelqu'un. Une passerelle MCP d'entreprise valide le contexte utilisateur entrant, généralement via JWT ou OIDC, et propage cette identité en aval. Au lieu d'une clé de service partagée, les demandes sont exécutées pour le compte d'un utilisateur spécifique.

Cela permet d'éviter le problème de l' « agent générique ». Si un utilisateur ne peut pas accéder à un référentiel de production, l'agent ne le peut pas non plus. L'identité est appliquée au niveau du protocole et n'est pas prise en compte dans les invites.

Registre d'outils centralisé

Une passerelle MCP d'entreprise gère un registre des serveurs MCP et des outils MCP disponibles. Au lieu que chaque agent découvre tout par défaut, la visibilité est gérée de manière centralisée. Les nouvelles fonctionnalités des nouveaux serveurs sont enregistrées une seule fois et exposées de manière sélective. Cette configuration élimine le manque de documentation qui apparaît généralement lorsque les équipes ne savent plus quels outils existent et qui peut les utiliser.

Journalisation des audits

Chaque appel à tools/list et call_tool peut être enregistré avec des métadonnées : identité de l'agent, contexte utilisateur, arguments et état de la réponse. Cela permet de créer une piste d'audit cohérente entre les systèmes. Les évaluations de débogage et de conformité deviennent plus faciles à traiter qu'à des fins d'investigation.

Regroupement logique d'outils

Les systèmes de production nécessitent souvent une exposition limitée. Un agent de support n'a pas besoin d'outils d'administration de base de données. Un flux de travail financier n'a pas besoin de contrôles de déploiement. Ce type de cadrage améliore directement l'expérience utilisateur ; les agents se comportent de manière plus prévisible lorsque leur espace d'action est intentionnellement limité.

Une configuration simple peut ressembler à ceci :

serveur_virtuel :

nom : support-scope

autoriser_outils :

- github.list_issues

- github.get_comments

- crm.update_ticket

La passerelle filtre les réponses de découverte en conséquence. Les agents ne voient que ce qu'ils sont censés voir.

Les fonctionnalités d'entreprise ne consistent pas à ajouter des outils supplémentaires. Il s'agit de réduire les surfaces non contrôlées.

Comment la passerelle MCP de TrueFoundry aide-t-elle les entreprises ?

La passerelle MCP de TrueFoundry est conçue pour fonctionner là où se trouvent réellement les charges de travail de l'entreprise : dans l'environnement cloud du client. Il peut être déployé au sein d'un VPC dédié à l'aide de conteneurs Docker, ce qui signifie que le trafic des outils, les informations d'identification et les interactions avec les modèles ne doivent pas nécessairement traverser une infrastructure partagée externe. Pour les secteurs réglementés, ce modèle de déploiement à lui seul réduit les frictions.

Le contrôle d'accès est géré par un RBAC affiné entre les agents, les outils MCP et les équipes. Au lieu de coder en dur les informations d'identification dans les environnements d'exécution des agents, la passerelle s'intègre à des fournisseurs d'identité centralisés et associe les rôles à une visibilité étendue des outils. Les politiques de sécurité sont déclaratives. L'autorisation a lieu avant l'exécution.

Le stockage des informations d'identification constitue une autre préoccupation d'ordre pratique. Les clés d'API et les jetons de service sont stockés et gérés de manière centralisée au lieu d'être intégrés dans du code ou des fichiers d'environnement. Les politiques de rotation peuvent être appliquées une seule fois au niveau de MCP Gateway, plutôt qu'entre des dizaines d'agents.

Des environnements de test sûrs sont tout aussi importants. Les équipes peuvent définir des domaines d'outils isolés pour les agents intermédiaires, empêchant ainsi tout accès direct accidentel aux systèmes de production. Cette séparation est imposée de manière structurelle, et pas seulement par convention.

L'observabilité lie le système. Les appels d'outils, la propagation d'identité, la télémétrie et les décisions politiques sont entièrement traçables. Les mesures relatives aux modèles d'utilisation, à la latence et au trafic MCP sont présentées dans un tableau de bord unique. En cas de problème, vous pouvez inspecter la chaîne d'exécution sans reconstruire les événements sur plusieurs systèmes.

L'objectif n'est pas l'abstraction en soi. Il s'agit de confinement, de clarté et d'exécution contrôlée sur Plateformes d'automatisation MCP infrastructure interne que vous gérez déjà.

MCP Gateway par rapport aux approches traditionnelles

Lorsque les équipes évaluent les passerelles MCP, la véritable comparaison ne se limite pas aux autres passerelles. Cela va à l'encontre des alternatives qu'ils utilisent déjà.

Une comparaison détaillée pour voir le positionnement de TrueFoundry.

| Aspect | Direct Tool Access | API Gateway Only | TrueFoundry MCP Gateway |

|---|---|---|---|

| Tool Governance | None | Limited | Built-in |

| Access Control | Manual | App-centric | Agent-aware RBAC |

| Observability | Minimal | API-level | Tool and intent-level |

| Deployment Model | Ad-hoc | SaaS or self-hosted | Runs in your cloud |

Le contrôle d'accès direct maximise la vitesse mais laisse le contrôle distribué et fragile. Une passerelle API améliore la sécurité du périmètre, mais elle ne comprend pas l'intention de l'agent ni la portée de l'outil. Une passerelle MCP introduit une couche de gestion spécifiquement consciente de l'exécution pilotée par les modèles et du trafic MCP.

La distinction est subtile, mais elle détermine si les systèmes d'IA restent des expériences ou deviennent des infrastructures.

Réservez une démo pour en savoir plus sur le fonctionnement de TrueFoundry MCP Gateway dans les environnements d'entreprise.

Réflexions finales sur les passerelles MCP

MCP fournit un langage partagé entre les modèles et les outils. Cela constitue à lui seul un pas en avant significatif. Elle réduit la prolifération de l'intégration et normalise la façon dont les agents découvrent et invoquent les systèmes externes. Mais la normalisation n'est pas synonyme de gouvernance.

À mesure que les agents d'IA se rapprochent des systèmes opérationnels, l'architecture qui les entoure devient déterminante. Qui peut voir quels outils ? Sous l'identité de qui les actions sont exécutées. Où se trouvent les pistes d'audit. Comment le risque est-il maîtrisé ? Ces questions se situent au-dessus de la couche protocolaire.

Une passerelle MCP y répond en introduisant le contrôle sans rompre l'interopérabilité.

Pour les équipes d'entreprise, le véritable changement est mental. Les agents ne sont plus des expériences associées à des API. Ils jouent un rôle au sein de l'infrastructure de production. Une fois que vous acceptez cela, la nécessité d'un plan de contrôle devient moins optionnelle et plus structurelle.

Questions fréquemment posées

À quoi sert une passerelle MCP ?

Une passerelle MCP se trouve entre les agents IA et les serveurs MCP. Il contrôle les outils qu'un agent peut consulter, applique l'authentification, achemine les demandes et enregistre les activités. Au lieu que les agents se connectent directement à des systèmes tels que GitHub ou des bases de données, ils se connectent à la passerelle, qui fait office de couche de contrôle. TrueFoundry rend cela opérationnel en fournissant une interface unifiée qui gère ces connexions dans l'ensemble de votre écosystème d'IA.

Quelle est la différence entre une passerelle MCP et un serveur ?

Une passerelle MCP régit l'accès à ces serveurs. Il gère l'identité, la visibilité et l'application des politiques avant qu'un outil ne soit invoqué. Un serveur MCP exécute des actions. Il se connecte à un outil ou à une source de données spécifique et effectue des opérations. TrueFoundry MCP Registry vous permet d'organiser ces serveurs en groupes gouvernés pour un meilleur contrôle administratif.

Quelle est la différence entre une passerelle API et une passerelle MCP ?

Une passerelle MCP est conçue pour les flux de travail pilotés par les agents. Il régit la découverte et l'exécution des outils MCP au sein du protocole MCP, en ajoutant une autorisation et une observabilité que les passerelles API ne fournissent pas. Une passerelle API gère le trafic des applications traditionnelles. Il comprend les routes HTTP, l'authentification et les limites de débit. TrueFoundry comble cette lacune en proposant un plan de contrôle IA spécialisé qui comprend le contexte unique des interactions entre LLM et outil.

Le MCP est-il meilleur que l'API ?

Non, le MCP et les API ont des objectifs différents : les API définissent les interfaces système et les points de terminaison REST, tandis que le MCP rend ces interfaces utilisables et détectables par les modèles d'IA. Dans la plupart des systèmes d'entreprise, les deux couches doivent fonctionner ensemble pour garantir une intégration parfaite. La plate-forme TrueFoundry prend en charge cette coexistence en fournissant des interfaces de connecteur standard qui ne nécessitent aucune modification du SDK par rapport aux outils existants.

Comment la passerelle TrueFoundry MCP aide-t-elle les entreprises ?

TrueFoundry fournit une passerelle MCP gérée qui s'exécute dans votre cloud. Il centralise la gestion des informations d'identification, applique un contrôle d'accès précis et assure l'observabilité des flux de travail des agents.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

One Layer of Control for All AI

Gouvernez, déployez et suivez l'IA dans votre propre infrastructure

Réservez un séjour de 30 minutes avec notre Expert en IA

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

Démo du livreBlogs récents

Best AI Agent Platforms in 2026: Compared for Enterprise and Developer Teams

Ashish Dubey

PII Redaction at the Gateway vs. the Application Layer: A Performance and Correctness Analysis

Boyu Wang

Context Engineering at the Gateway Layer: How Session Management Enables Long-Running Agents

Boyu Wang

.webp)

How to Test AI-Powered Systems and LLM Workflows in Production-Like Environments

Ashish Dubey

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)