Intégration de TrueFoundry AI Gateway à New Relic

.webp)

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Les systèmes LLM se comportent comme des services distribués. Ils font appel à plusieurs fournisseurs de modèles. Ils s'exécutent sur plusieurs applications et agents. Ils sont expédiés rapidement et changent souvent. Cela rend le débogage difficile lorsqu'un utilisateur signale une mauvaise réponse ou une réponse lente.

La pièce manquante est une limite d'exécution unique que chaque requête franchit. Une fois que vous avez défini cette limite, vous pouvez appliquer une politique. Vous pouvez standardiser le routage. Vous pouvez enregistrer des traces nettes pour chaque appel.

TrueFoundry AI Gateway vous donne cette limite. New Relic vous permet d'explorer ces traces en même temps que le reste de la télémétrie de votre application. Avec OpenTelemetry comme format partagé, vous pouvez exporter des traces de passerelle vers New Relic en quelques minutes.

Passerelle TrueFoundry AI

Passerelle TrueFoundry AI se trouve devant le trafic de votre modèle. Les applications et les agents envoient des demandes à la passerelle. La passerelle redirige vers le fournisseur et le modèle appropriés. Cela crée un point d'entrée régi pour le routage et les contrôles. Cela crée également un point cohérent où les traces peuvent être générées et exportées.

Nouvelle relique

Nouvelle relique est une plateforme d'observabilité qui prend en charge la surveillance complète de la pile et la surveillance des performances des applications avec des analyses en temps réel. Il peut ingérer des données OpenTelemetry. Cela en fait un endroit naturel pour analyser les traces LLM depuis la passerelle avec les mêmes flux de travail que vous utilisez déjà pour les services et l'infrastructure.

OpenTelemetry

L'intégration est basée sur OpenTelemetry. TrueFoundry AI Gateway exporte les traces à l'aide des protocoles OpenTelemetry standard. New Relic accepte l'ingestion d'OTLP. Cela permet de garder l'intégration propre et d'éviter un couplage serré.

À quoi ressemble l'intégration

Vous configurez un exportateur de traces OpenTelemetry dans l'interface utilisateur TrueFoundry AI Gateway. Vous le pointez vers un point de terminaison de traces OTLP de New Relic. Vous ajoutez le bon en-tête d'authentification à l'aide d'une clé de licence New Relic ingest générée à partir de l'intégration d'OpenTelemetry dans New Relic.

Une fois activée, la passerelle continue de générer des traces pour ses propres vues de surveillance. L'exportation est additive. Il transmet les mêmes traces à New Relic afin que vous puissiez également les analyser là-bas.

Guide d'intégration

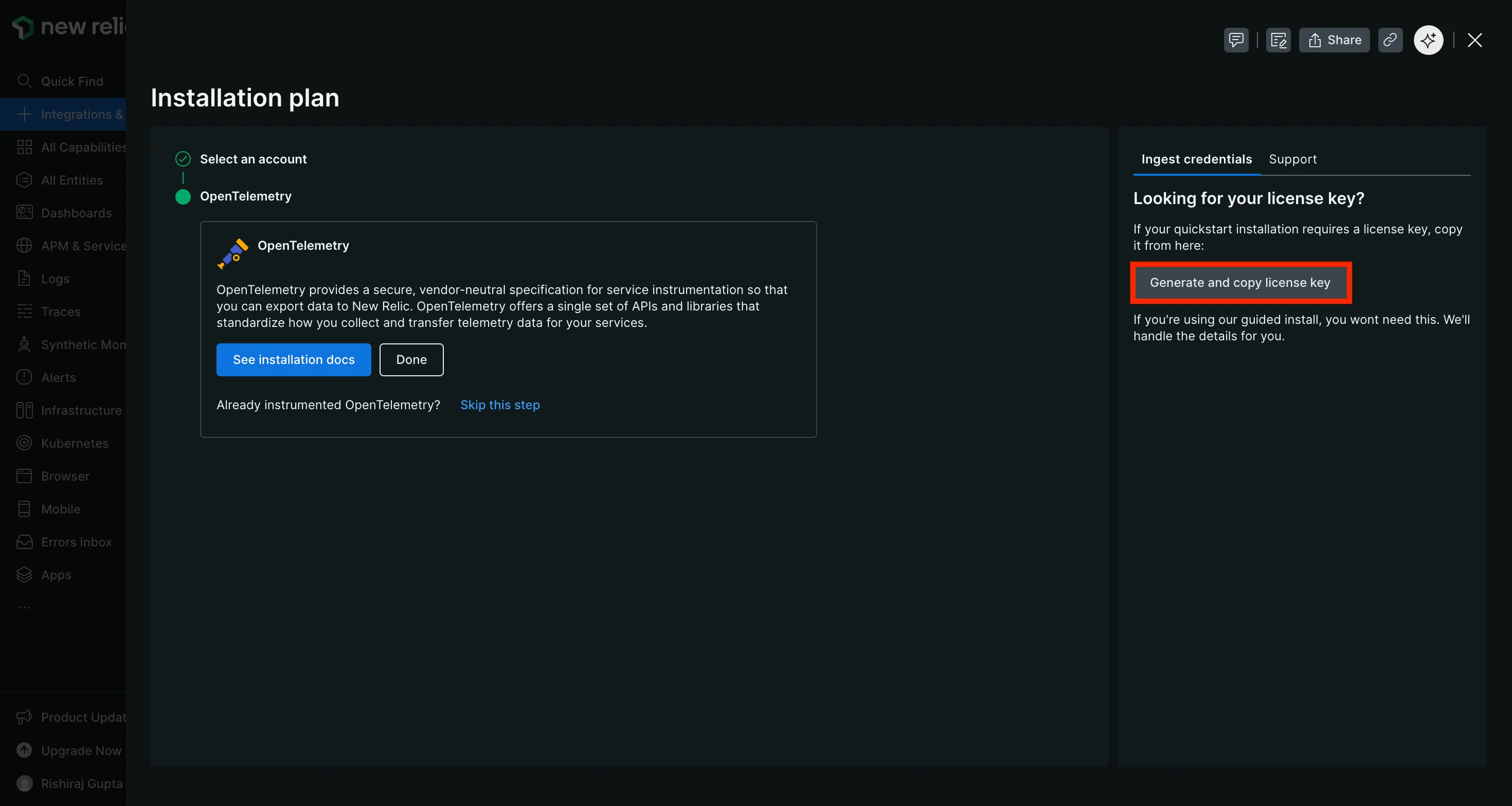

Étape 1 Obtenez votre clé de licence New Relic Ingest

Ouvrez votre tableau de bord New Relic. Accédez à Intégrations et agents. Recherchez OpenTelemetry et ouvrez cette intégration. Dans le plan d'installation, recherchez la zone d'ingestion des informations d'identification et générez la clé de licence.

Utilisez la clé de licence d'ingestion disponible sur la page d'intégration d'OpenTelemetry. Une clé d'API New Relic classique ne fonctionnera pas pour l'ingestion d'OTLP.

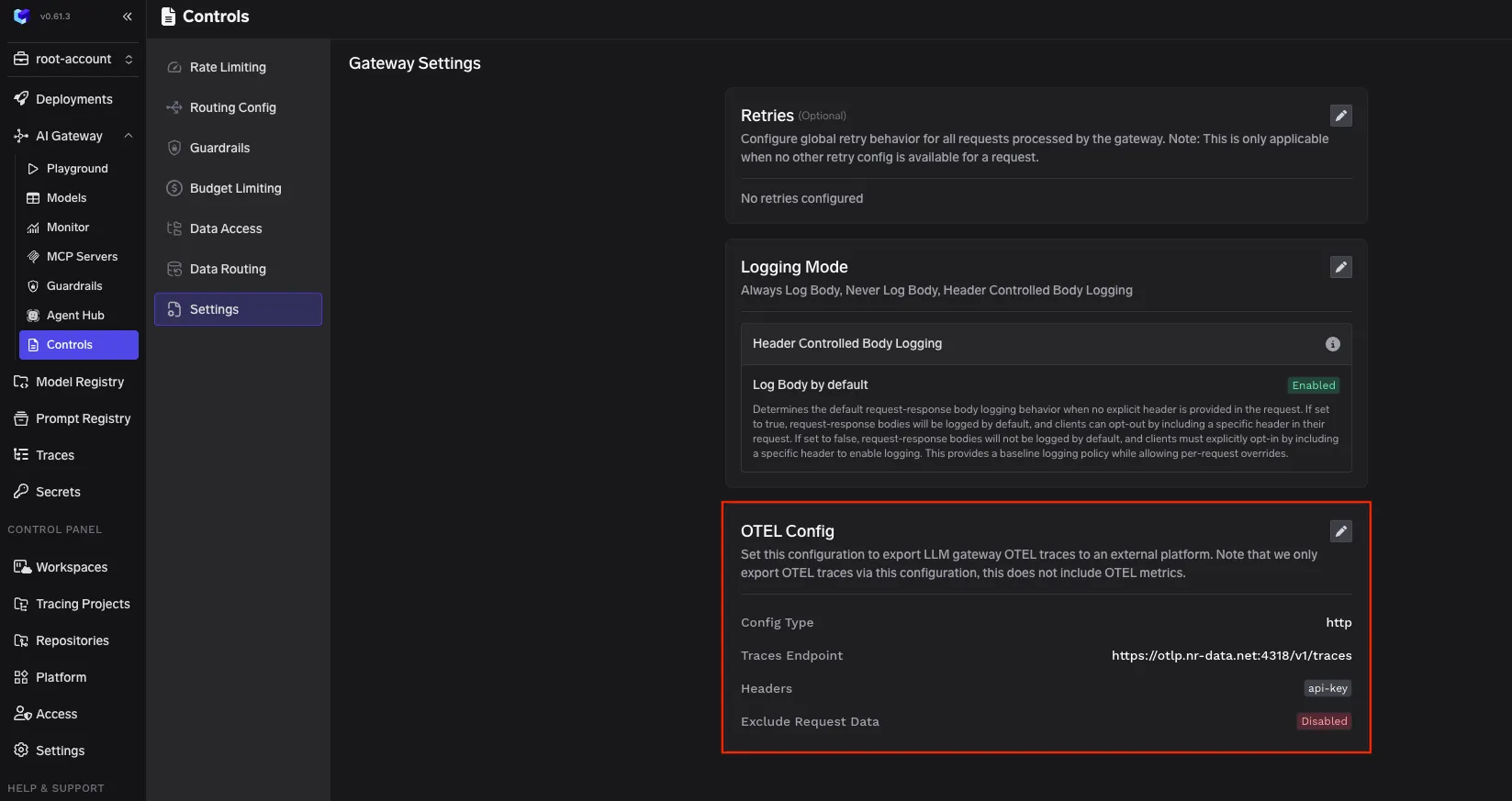

Étape 2 Activer l'exportateur OpenTelemetry dans TrueFoundry

Dans le tableau de bord TrueFoundry, accédez à AI Gateway, puis à Contrôles, puis à Paramètres. Accédez à la section OTEL Config et modifiez la configuration de l'exportateur.

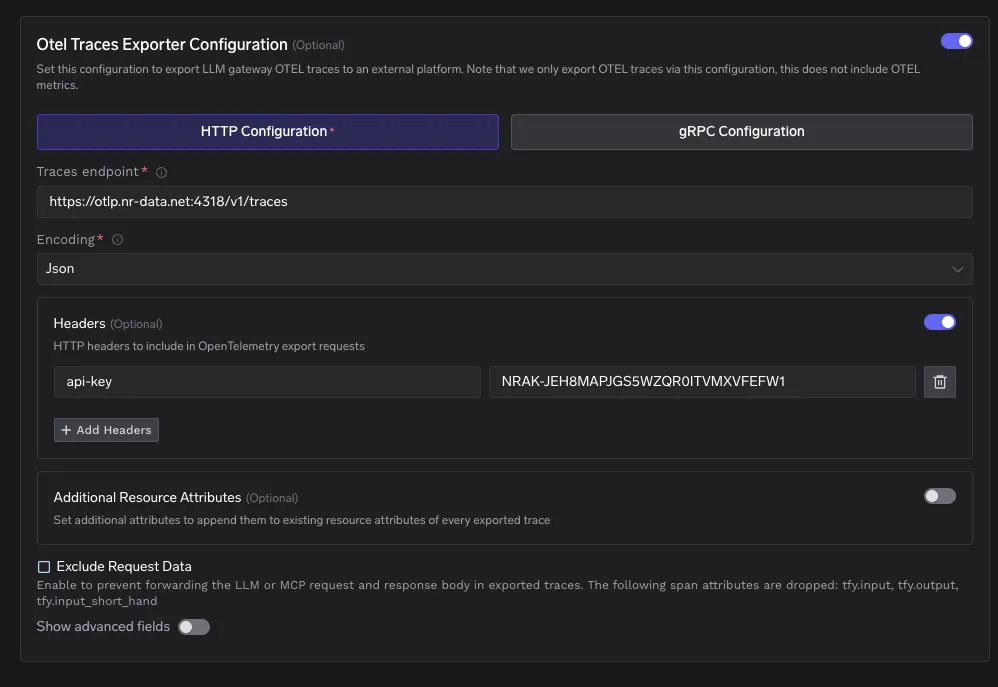

Étape 3 Définissez le point de terminaison et l'encodage des traces New Relic

Activez l'exportateur de traces et remplissez les champs principaux.

Type de configuration

http

Point de terminaison de traces pour la région des États-Unis

https://otlp.nr-data.net:4318/v1/traces

Encodage

Jason

New Relic utilise des points de terminaison régionaux. Si votre compte se trouve dans la région de l'UE, utilisez plutôt ce point de terminaison.

https://otlp.eu01.nr-data.net:4318/v1/traces

Étape 4 Ajoutez l'en-tête requis

Ajoutez un en-tête avec cette clé et votre clé de licence d'ingestion comme valeur.

clé API : <your New Relic ingest license key>

Étape 5 Enregistrez et envoyez quelques demandes

Enregistrez la configuration. Envoyez ensuite quelques demandes LLM via AI Gateway. Ensuite, la passerelle exportera automatiquement les traces vers New Relic.

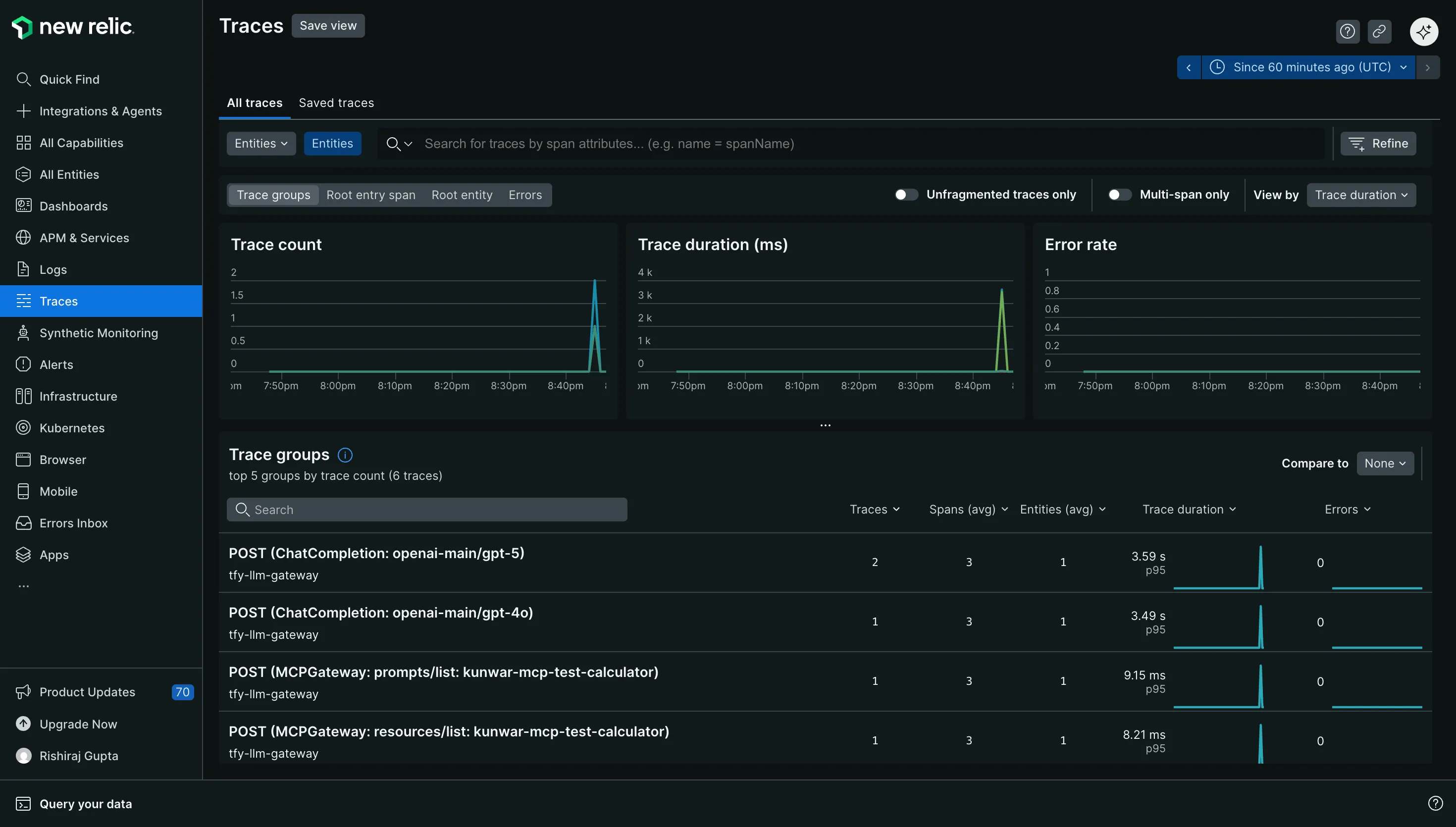

Étape 6. Afficher les traces dans New Relic

Dans New Relic, accédez à Traces et recherchez des traces depuis le service de passerelle. Ouvrez ensuite une trace et inspectez les spans pour déterminer le chemin d'appel et la synchronisation du modèle.

Afficher les traces

Vous pouvez afficher les traces LLM à côté du reste de votre télémétrie. Cela est utile lorsqu'un problème LLM est en fait un pic de latence en amont. Cela est également utile lorsque le ralentissement d'un fournisseur de modèles n'est qu'une partie d'un incident plus vaste.

Vous pouvez créer des tableaux de bord qui suivent la latence et le volume du trafic LLM. Vous pouvez créer des alertes en cas de pics de latence ou de taux d'erreur. Vous pouvez corréler le comportement des traces avec les journaux et les signaux d'infrastructure lors d'un incident.

Quelques notes de configuration importantes en production

Choisissez le point de terminaison qui correspond à votre région New Relic. C'est la cause la plus fréquente de traces manquantes. Si vous souhaitez un filtrage plus riche dans New Relic, ajoutez des attributs de ressources supplémentaires dans la configuration de l'exportateur. Utilisez ces attributs pour le regroupement au niveau de l'environnement et de l'équipe.

New Relic prend en charge les protocoles HTTP et gRPC pour l'ingestion OTLP. Si vous avez besoin d'un débit plus élevé, vous pouvez envisager le gRPC. Si vous souhaitez une inspection plus facile lors de la configuration, HTTP avec encodage JSON est un point de départ simple.

Conclusion

Un système LLM fiable a besoin d'un endroit fiable pour appliquer les contrôles et d'un endroit fiable pour comprendre le comportement. TrueFoundry AI Gateway fournit une limite d'exécution unique pour tout le trafic des modèles. New Relic fournit un flux de travail d'observabilité mature pour explorer les traces et répondre aux incidents. OpenTelemetry connecte les deux via un chemin d'exportation standard.

Si vous utilisez déjà New Relic pour vos services, cette intégration permet à votre trafic LLM de rejoindre la même boucle opérationnelle en modifiant le moins possible le code de votre application.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)