Les 8 meilleures alternatives et concurrents d'Amazon Bedrock pour 2026 [Examen détaillé]

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Amazon Bedrock constitue un point de départ viable pour les équipes strictement liées à l'écosystème AWS, car il propose une couche d'API gérée pour les modèles de base (FM) sans gestion immédiate de l'infrastructure. Cependant, à mesure que les charges de travail liées à l'IA entrent en production en 2026, les équipes d'ingénierie sont inévitablement confrontées au « mur des plateformes ». Cette barrière se manifeste par trois points de friction principaux :

- Taxe sur l'écosystème AWS : Frais de sortie et coûts de transfert de données importants lorsque les pipelines interagissent avec des services externes. Comme indiqué dans Tarification à la demande d'AWS EC2, le transfert de données vers Internet peut coûter jusqu'à 0,09$ par Go. Pour les applications multimodales à volume élevé, ces frais de sortie peuvent éroder de manière significative l'économie des unités.

- Contrôle du cycle de vie : Les services gérés appliquent leurs propres calendriers de dépréciation. Ce peut créer des frictions pour les pipelines de production qui nécessitent une stabilité à long terme sur des versions de modèles spécifiques.

- Échelle linéaire des coûts : Les services gérés utilisent généralement des modèles de tarification par jeton qui évoluent de manière linéaire en fonction de l'utilisation. Bien que rentable pour le prototypage, cette structure diffère souvent de l'économie unitaire du matériel approvisionné en gros volumes. Points de référence du secteur indiquent que pour des charges de travail spécifiques à haut débit ou par lots, le passage d'API gérées à une infrastructure auto-hébergée optimisée peut produire des gains d'efficacité de multiples significatifs, en particulier lors de l'utilisation d'instances ponctuelles ou de capacités réservées.

Pour les architectes qui conçoivent pour le long terme, l'objectif passe du simple accès aux API à l'élaboration d'une « stratégie de migration et multicloud ». Ce guide évalue les compromis techniques, l'économie des unités et les réalités opérationnelles des meilleures alternatives à Bedrock. Bien que les services gérés soient pratiques, des plateformes telles que TrueFoundry sont en train de devenir le plan de contrôle préféré des entreprises qui ont besoin de la facilité d'utilisation de Bedrock associée au contrôle économique et opérationnel du déploiement sur leur propre infrastructure cloud.

Les 8 meilleures alternatives à AWS Bedrock pour 2026

Dans cette section, nous analysons le mérite technique et l'adéquation architecturale des concurrents suivants :

- True Foundry

- Google Vertex AI

- Service Azure OpenAI

- IA générative Oracle Cloud Infrastructure (OCI)

- Databricks Mosaic AI

- Botpress

- Runpod

- Altair AI Studio

TrueFoundry : passerelle d'IA et couche d'orchestration indépendantes du cloud

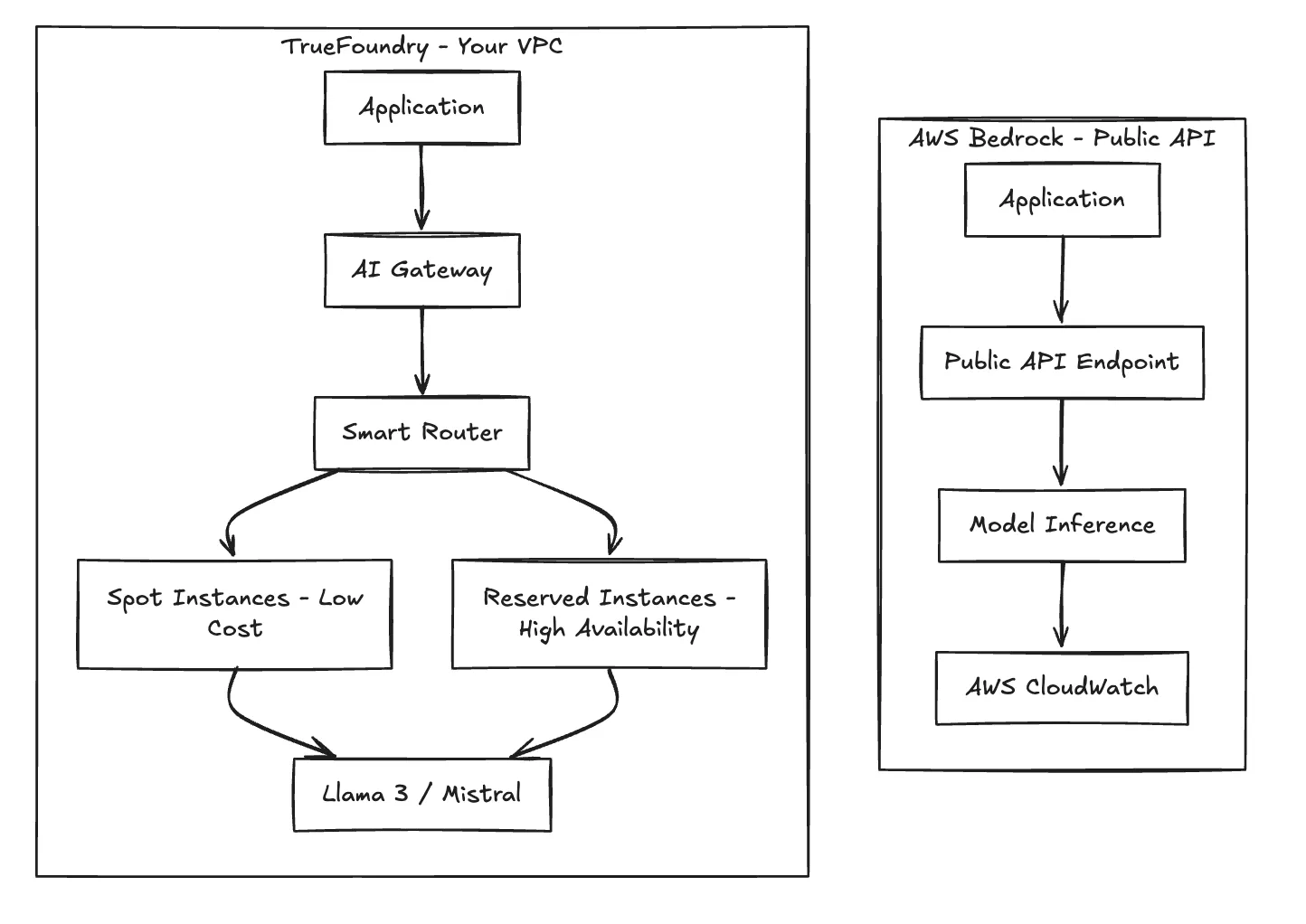

TrueFoundry fonctionne comme un plan de contrôle indépendant de la plate-forme plutôt que écosystème propriétaire. Contrairement à Bedrock, qui est un API gérée où l'inférence se produit sur une infrastructure partagée, TrueFoundry orchestre les couches de calcul et d'inférence directement dans vos propres clusters VPC ou Kubernetes (EKS, GKE, AKS ou bare metal).

Cette architecture dissocie l'expérience des développeurs de l'infrastructure sous-jacente.

Principales caractéristiques de TrueFoundry :

- Déploiement de Kubernetes : Déploie des charges de travail d'IA sur vos propres clusters avec une mise à l'échelle automatique et des bilans de santé configurés automatiquement.

- Passerelle IA : Une surface d'API unifiée (compatible avec OpenAI) qui gère l'équilibrage de charge, les nouvelles tentatives et les solutions de secours. Il peut acheminer le trafic vers Azure OpenAI si AWS Bedrock atteint les limites de débit.

- Orchestration des instances Spot : Permet une utilisation fiable des instances Spot à des fins d'inférence, réduisant potentiellement les coûts de calcul de 50 à 60 % par rapport à la tarification à la demande.

- Gestion rapide du cycle de vie : Les instructions sont traitées comme du code, la gestion des versions et les tests étant intégrés au pipeline CI/CD.

Pourquoi TrueFoundry est un meilleur choix :

True Foundry ne facture pas de prime sur les jetons d'inférence lorsque vous hébergez vos propres modèles open source. Vous payez le coût de l'infrastructure sous-jacente directement auprès de votre fournisseur de cloud. Pour les charges de travail à volume élevé, ce coût de calcul forfaitaire est nettement inférieur à la mise à l'échelle linéaire de la tarification basée sur des jetons.

Plans tarifaires TrueFoundry :

- Développeur : Niveau gratuit pour les développeurs individuels.

- Démarreur : Tarif mensuel fixe par siège pour les petites équipes.

- Pro/Enterprise : Tarification personnalisée, y compris le SSO, le RBAC et une assistance dédiée.

Ce que les clients disent de TrueFoundry

Les utilisateurs de G2 évaluent régulièrement TrueFoundry 4,8/5, mettant en évidence la capacité de la plateforme à faire abstraction de la complexité de Kubernetes pour les ingénieurs backend. Une critique note que, « Cela a transformé notre équipe backend en ingénieurs MLOps du jour au lendemain, sans avoir à apprendre comme Kubeflow. »

Action : Inscrivez-vous à la version gratuite de TrueFoundry pour tester l'AI Gateway.

Google Vertex AI

Caractéristiques

Vertex AI s'intègre parfaitement à l'écosystème Google Cloud. Il fournit un accès natif à la famille Gemini et prend en charge AutoML. Il excelle dans l'opérationnalisation de modèles grâce à des magasins de fonctionnalités intégrés et à une recherche vectorielle qui s'intègre directement à BigQuery.

Tarification

Les prix sont segmentés par opération. Par exemple, le prix de Gemini 1.5 Pro est calculé pour 1 000 caractères/images. Il est essentiel que la prédiction sur des modèles personnalisés entraîne des frais horaires par nœud. Consultez Vertex AI Pricing pour la répartition spécifique des types de machines (par exemple, n1-standard-4 contre TPU v5e).

Cas d'utilisation uniques

Vertex est idéal pour les organisations qui utilisent BigQuery pour les pipelines RAG (Retrieval-Augmented Generation) en raison de son accès aux données à faible latence au sein du backbone GCP.

Service Azure OpenAI

Caractéristiques

Azure OpenAI Service fournit un accès de niveau professionnel à GPT-4o et DALL-E 3. Il ajoute des couches de conformité (SOC2, HIPAA) et un réseau privé via Azure Private Link qui font défaut aux API OpenAI standard.

Tarification

Azure utilise un modèle « Pay-as-you-go » et des « unités de débit provisionnées » (PTU). Les PTU offrent une latence garantie mais nécessitent un engagement initial important. Selon la tarification Azure OpenAI, les modèles GPT-4 standard peuvent coûter beaucoup plus cher par jeton que les alternatives open source hébergées sur des machines virtuelles autogérées.

Cas d'utilisation uniques

Choix par défaut pour les entreprises ayant des accords Microsoft Enterprise existants nécessitant un RBAC strict via Microsoft Entra ID.

Infrastructure cloud Oracle (OCI)

Caractéristiques

OCI Generative AI repose sur une architecture « supercluster » dotée d'un réseau RDMA, conçue pour une formation de haute performance. Il dispose d'un partenariat avec Cohere pour la recherche vectorielle intégrée.

Tarification

OCI est agressif en matière de calcul. Selon Oracle Cloud Pricing, leurs instances GPU sont souvent inférieures à celles d'AWS et d'Azure, ce qui les rend attrayantes pour les tâches de formation brutes.

Cas d'utilisation uniques

Idéal pour les charges de travail de calcul haute performance (HPC) et la formation de modèles fondamentaux massifs à partir de zéro, où l'efficacité de calcul brute par dollar est le principal indicateur de performance clé.

Databricks Mosaic AI

Caractéristiques

Mosaic AI permet aux entreprises de pré-former et d'affiner les LLM à l'aide de données propriétaires dans le « Data Lakehouse ». L'architecture garantit que les données de formation ne dépassent jamais les limites de gouvernance du client.

Tarification

Les prix sont exprimés en unités Databricks (DBus) plus les coûts sous-jacents du cloud. Ce modèle découplé offre de la transparence mais nécessite une surveillance des types d'instances.

Cas d'utilisation uniques

Idéal pour les organisations qui considèrent les données propriétaires comme un avantage concurrentiel et qui ont besoin de former des modèles plus petits et spécifiques à un domaine (SLM).

Botpress

Caractéristiques

Botpress est un outil d'orchestration low-code au niveau de la couche applicative. Il comprend un générateur de flux visuel et des connecteurs pour WhatsApp/Slack, axés sur la gestion des dialogues plutôt que sur l'hébergement de modèles.

Tarification

Modèle de facturation basé sur l'utilisation par message entrant.

Cas d'utilisation uniques

Idéal pour les équipes produit qui créent des robots de support client qui n'ont pas besoin de gérer l'infrastructure GPU.

Runpod

Caractéristiques

Runpod propose des conteneurs (Pods) « GPU sans serveur ». Il permet aux développeurs de créer des instances avec des modèles préconfigurés pour vLLM ou Stable Diffusion en quelques secondes.

Tarification

Runpod est en concurrence sur la base de taux horaires bruts. Par exemple, Runpod Pricing propose souvent des GPU A100 à des tarifs nettement inférieurs à ceux des hyperscalers, parfois aussi bas que 1,69$ de l'heure pour les instances de cloud communautaire.

Cas d'utilisation uniques

Destiné aux startups qui ont besoin d'un calcul GPU rentable et à la demande pour le traitement par lots ou la mise au point sans contrats à long terme.

Altair AI Studio

Caractéristiques

Se concentre sur la science des données industrielles, en fournissant un environnement sans code pour la préparation des données et le déploiement du machine learning, intégré aux flux de travail de simulation.

Tarification

Utilise un modèle d'unité de licence (unités Altair) regroupé dans l'ensemble de son portefeuille de logiciels.

Cas d'utilisation uniques

Conçu pour les secteurs manufacturier et aérospatial impliquant des simulations basées sur la physique.

Alternatives open source à AWS Bedrock pour l'IA générative

Frameworks open source remarquables

- Visage étreignant : Le hub central pour les modèles. Le Open LLM Leaderboard suit les performances de modèles haut de gamme tels que Llama 3 et Mistral.

- VLLM : Un moteur de service à haut débit qui utilise PagedAttention pour gérer la mémoire, offrant souvent un débit 2 à 4 fois supérieur à celui des transformateurs Hugging Face standard.

Avantages et défis

- Avantages : Confidentialité totale des données, aucune dépendance vis-à-vis d'un fournisseur et possibilité de quantifier des modèles (par exemple, AWQ) pour les exécuter sur du matériel grand public.

- Difficultés : Fardeau opérationnel. Vous êtes responsable des mises à jour des pilotes, de la compatibilité CUDA et de la haute disponibilité.

Comparaison des concurrents d'AWS Bedrock

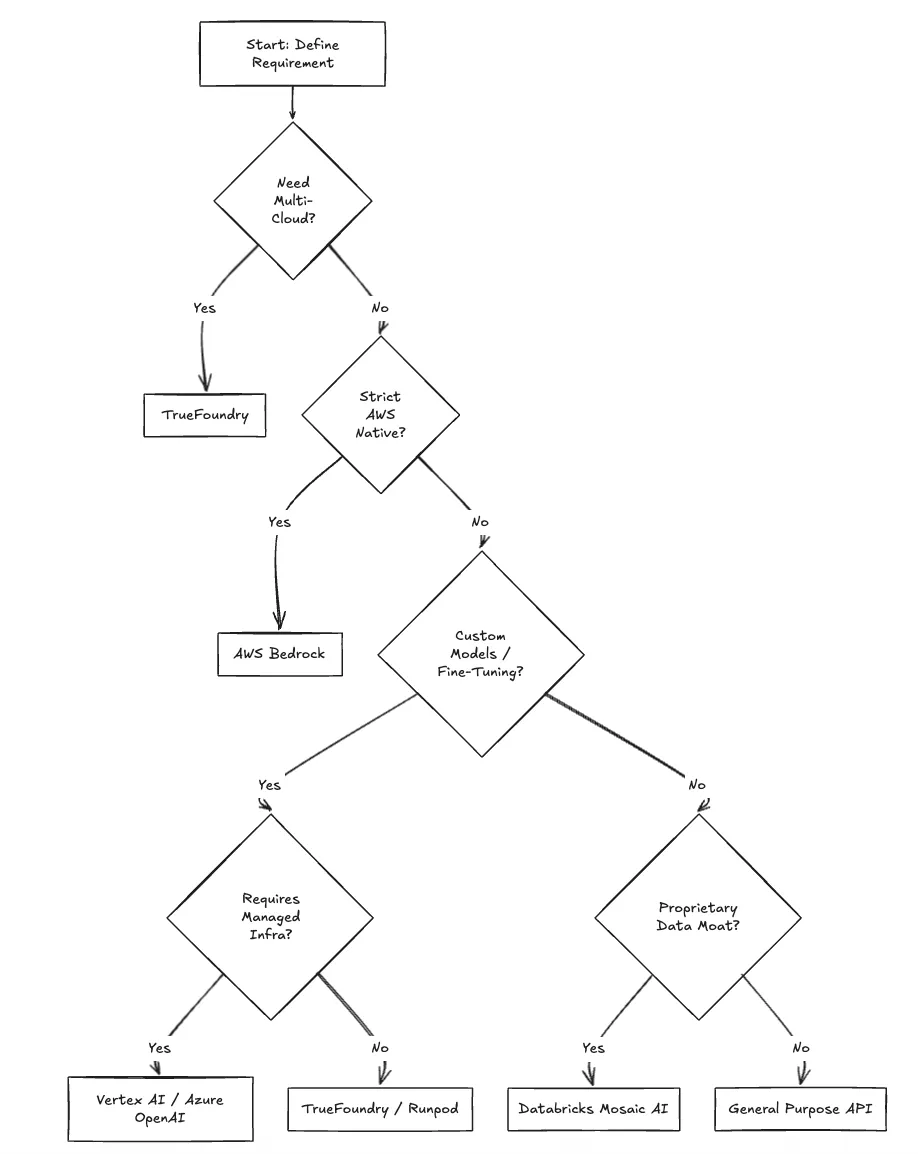

Comment choisir une alternative à AWS Bedrock

Le choix de la bonne alternative nécessite un cadre de décision basé sur la maturité de l'infrastructure et les objectifs architecturaux.

Envisagez-vous de mettre en place une architecture multicloud ?

Si votre stratégie consiste à éviter la dépendance à un fournisseur unique, un plan de contrôle unifié est essentiel. True Foundry vous permet de déployer sur n'importe quel cluster d'AWS, GCP et Azure à partir d'un tableau de bord unique.

La prévisibilité des coûts est-elle essentielle à la budgétisation ?

La tarification basée sur les jetons est difficile à prévoir. Si vous avez besoin de dépenses mensuelles stables, possédez l'ordinateur via True Foundry (sur les instances réservées ou sur Spot) permet une budgétisation déterministe. Tel que cité dans Plans d'économies AWS, s'engager à utiliser le calcul peut permettre de réaliser des économies allant jusqu'à 72 % par rapport aux prix à la demande : des économies que vous ne pouvez pas réaliser avec la tarification de l'API de Bedrock.

Avez-vous besoin de la souveraineté des données et de l'isolation des VPC ?

Les secteurs réglementés ne peuvent souvent pas envoyer de données à un point de terminaison d'API public à locataires multiples. True Foundry déploie le point de terminaison d'inférence à l'intérieur votre VPC, en veillant à ce que les données ne quittent jamais votre périmètre.

Êtes-vous prêt à évoluer au-delà d'AWS ?

AWS Bedrock est une solution fonctionnelle destinée aux équipes de prototypage au sein de l'écosystème AWS. Cependant, pour les équipes d'ingénierie qui créent des produits d'IA multicloud rentables, le modèle « API-Wrapper » devient une contrainte. TrueFoundry offre la passerelle nécessaire : la propriété de l'infrastructure et la flexibilité d'une version personnalisée sans les frais opérationnels liés à la gestion des manifestes Kubernetes bruts.

Questions fréquemment posées

Amazon Bedrock en vaut-il la peine ?

Pour le prototypage initial, Bedrock est efficace. Cependant, pour les applications de production, le balisage sur les jetons les rend souvent moins rentables que l'hébergement de modèles sur votre propre infrastructure. En utilisant une plateforme d'IA telle que Passerelle TrueFoundry AI qui est conçu pour le prototypage rapide de modèles d'IA, vous permet d'éviter des dépenses élevées et de réaliser des économies de coûts importantes.

Quelles sont les limites d'Amazon Bedrock ?

Les limites incluent la dépendance à l'écosystème, les coûts imprévisibles à grande échelle (tarification basée sur des jetons) et les restrictions relatives au déploiement de modèles quantifiés personnalisés (tels que les formats GGUF) susceptibles d'économiser sur le calcul. Les équipes ont souvent besoin d'une intégration fluide avec diverses sources de données pour des tâches complexes tout en gérant différentes versions de leurs modèles de machine learning.

Amazon Bedrock est-il similaire à ChatGPT ?

Non. ChatGPT est une application SaaS. Bedrock est un PaaS (Platform as a Service) utilisé pour créer des applications telles que ChatGPT. Il s'agit d'un service entièrement géré qui vous permet d'accéder aux grands modèles linguistiques OpenAI via de simples instructions textuelles.

Quel est le niveau de sécurité d'Amazon Bedrock ?

Bedrock suit le modèle de responsabilité partagée d'AWS. Bien qu'il offre un cryptage, vos données sont traitées sur une infrastructure gérée par AWS. L'auto-hébergement via TrueFoundry dans votre propre VPC offre une meilleure isolation. Nous mettons en œuvre des mesures de sécurité et un contrôle d'accès stricts pour protéger votre développement d'IA sur toutes les architectures.

Quel est l'équivalent d'AWS Bedrock dans GCP ?

Vertex AI est similaire à Amazon Bedrock avec des API gérées, mais inclut des outils MLOps plus robustes pour une formation personnalisée.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)