Serveurs MCP dans Claude Code

.webp)

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Qu'est-ce que MCP

Le MCP est défini comme « l'USB-C pour les applications d'IA ». MCP fournit un protocole cohérent pour relier les modèles d'IA à des outils externes.

Avec MCP, les applications d'IA comme Claude ou ChatGPT ne se limitent pas à la génération de texte. Ils peuvent se connecter directement à des sources de données (telles que des fichiers locaux ou des bases de données), à des outils (tels que des moteurs de recherche ou des calculateurs) et à des flux de travail structurés (invites spécialisées ou automatisations).

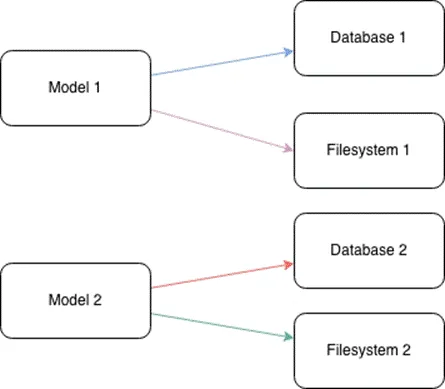

Lorsque MCP n'est pas encore disponible.

Lorsqu'il n'existe pas de protocole tel que MCP, chaque application d'IA doit s'intégrer séparément à chaque outil externe. Cela rend le processus très complexe, long et coûteux

Lorsque nous disposons de plusieurs applications d'IA et de nombreux outils, le nombre d'intégrations requises devient extrêmement important

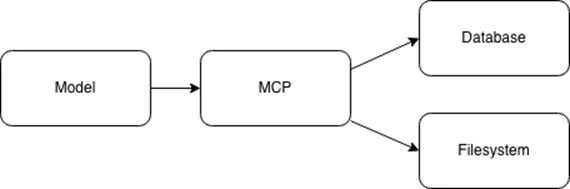

Quand MCP est disponible

MCP résout le problème d'intégration M × N en le transformant en un modèle M + N via un protocole de connexion standardisé. Chaque application d'IA s'intègre une seule fois côté client MCP, et chaque outil ou source de données s'intègre une fois sur Serveur MCP côté.

Terminologie clé du MCP

Composantes

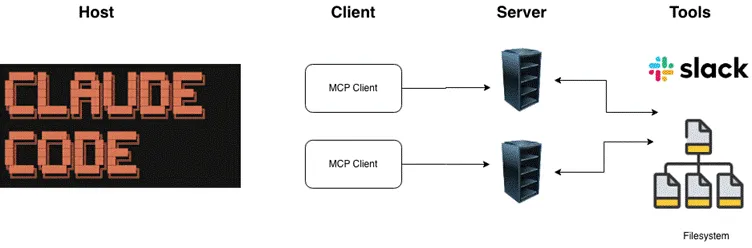

Semblable au modèle client-serveur du protocole HTTP, MCP suit également une architecture client-serveur.

- Hôte: environnement dans lequel l'utilisateur interagit directement avec l'application IA (par exemple, Claude Desktop, Cursor).

- Cliente: composant de l'hôte chargé d'établir et de gérer la connexion au serveur MCP.

- Serveur: application ou service externe qui fournit des fonctionnalités (telles que des outils, des ressources et des instructions) via le protocole MCP.

Capacités

Bien que MCP puisse se connecter à de nombreux outils différents, il existe des outils communs qui sont partagés entre plusieurs applications d'IA. Vous trouverez ci-dessous les principales catégories d'outils couramment utilisés dans les systèmes d'IA :

- Outils: fonctions exécutables qu'un modèle d'IA peut appeler pour effectuer des actions ou des calculs (par exemple, un outil calculate_summary).

- Ressources: sources de données en lecture seule qui fournissent des informations contextuelles sans nécessiter de calculs importants (par exemple, les pages de documentation de l'entreprise).

- Promptes: modèles ou flux de travail prédéfinis qui guident les interactions entre les utilisateurs, les modèles d'IA et les outils externes.

Composants de l'architecture MCP

Après avoir compris les concepts clés et la terminologie du MCP, nous pouvons maintenant examiner son architecture.

Le Protocole de contexte du modèle (MCP) repose sur une architecture client-serveur qui permet aux modèles d'IA d'interagir avec des outils et des services externes.

Hôte

Le Hôte est l'environnement dans lequel les utilisateurs finaux interagissent directement avec l'application d'IA (par exemple, Claude Desktop, Cursor).

L'Hôte est responsable de :

- Gestion des interactions et des autorisations des utilisateurs

- Initier des connexions aux serveurs MCP via des clients MCP

- Traiter les demandes des utilisateurs et les acheminer vers des outils externes appropriés

- Renvoi des résultats à l'utilisateur

Cliente

Le Cliente est un composant de l'hôte qui gère la connexion à un serveur MCP spécifique.

Caractéristiques principales :

- Chaque client maintient une connexion 1:1 avec un seul serveur

- Gère les communications au niveau du protocole MCP

- Agit en tant qu'intermédiaire entre l'hôte et le serveur

Serveur

Le Serveur est un programme ou un service externe qui fournit des fonctionnalités au modèle d'IA via le protocole MCP.

Le serveur est responsable de :

- Fournir un accès à des outils, des sources de données ou des services externes

- Exécution locale (sur la même machine que l'hôte) ou à distance (via le réseau)

- Exposer des interfaces standardisées afin que les clients puissent interagir avec ses fonctionnalités

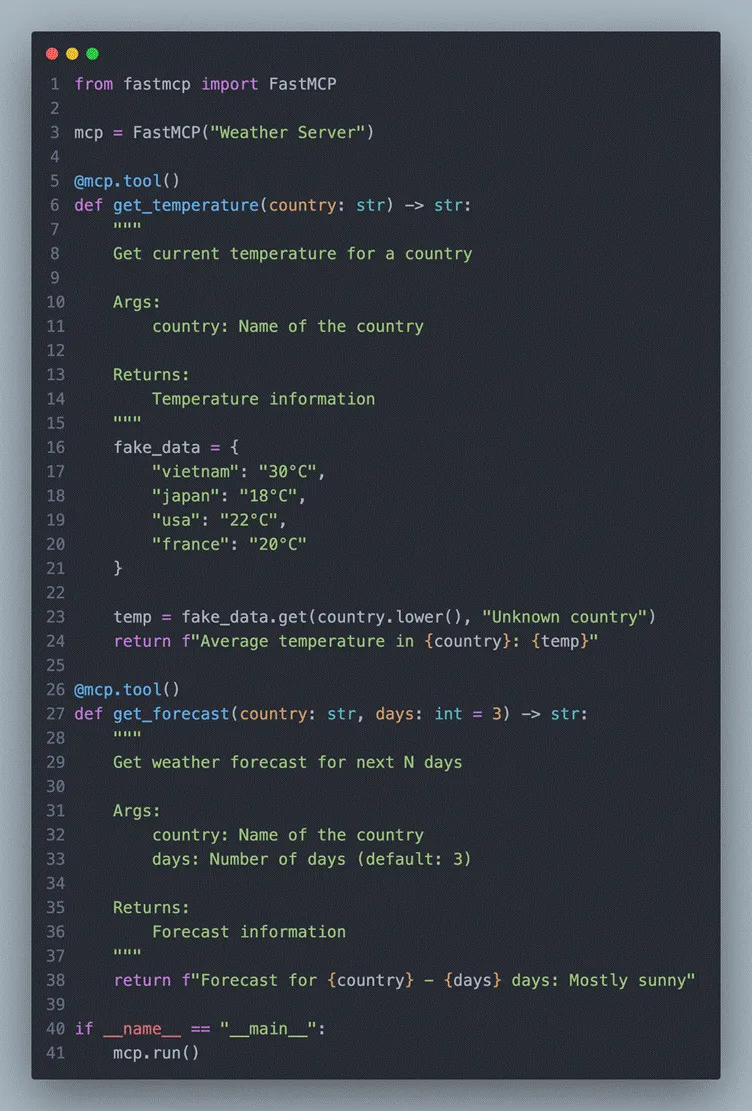

Création d'un serveur MCP simple

Installez fastmcp

pip installe fastmcp

Serveur MCP de base : outil météo

C'est ça ! FastMCP gère tout, y compris :

- Protocole JSON-RPC

- Enregistrement de l'outil

- Validation du type

- Gestion des erreurs

Connexion à Claude Code

claude mcp ajoute la météo --command python --args /full/path/to/get_weather.py

Redémarrez Claude Code → les serveurs MCP se connecteront automatiquement.

Vous pouvez maintenant demander à Claude des choses comme :

- « Quelle est la température au Japon ? »

- « Lisez le fichier sur ~/documents/report.txt »

Claude invoquera automatiquement les outils de vos serveurs MCP de manière fluide.

Configuration de MCP avec Claude Code

Sur la base de la documentation Claude (https://code.claude.com/docs/en/mcp), configuration

McPin Claude Code est assez simple : il suffit de lancer

claude mcp ajouter

et il gère automatiquement la configuration pour vous

Pour répertorier et vérifier tous les serveurs MCP configurés dans Claude Code, essayez d'exécuter :

liste claude mcp

Claude Code et MCP : meilleures pratiques

1. Serena MCP

Lien : https://github.com/oraios/serena

J'ai expérimenté un flux de travail piloté par l'IA et j'ai connecté Serena MCP directement (en utilisant simplement Sonet 4.5).

Franchement, j'ai l'impression d'être « Waouh ». Au lieu de déposer un tas de fichiers sur l'IA en espérant qu'elle trouve une solution, elle lit la base de code comme un développeur senior de l'équipe.

Pourquoi ça marche si bien ?

- CHIFFON: Il indexe l'ensemble de la base de code, utilise la recherche sémantique pour extraire uniquement les parties les plus pertinentes et fournit un contexte clair au modèle → moins de bruit, meilleures réponses.

- Construit sur Protocole de serveur de langue, il comprend donc le code de manière structurelle, et pas seulement en tant que texte brut.

- Mémoire profonde: Il mémorise la base de code indexée, vous n'avez donc pas à recharger les jetons à chaque fois.

- Recherche sémantique est — demandez « Où est gérée l'authentification ? » et il trouve les fonctions/classes associées même si la dénomination est étrange. Pour les grands projets, c'est une bouée de sauvetage.

Dans l'ensemble : moins de jetons, un contexte plus clair, une compréhension beaucoup plus approfondie du code.

Si vous créez des agents de codage, vous devriez l'essayer. Vous commencez vraiment à avoir l'impression que l'IA est votre coéquipière.

2. MCP à pensée séquentielle

Lien : https://github.com/modelcontextprotocol/servers/tree/main/src/sequentialthinking

Faits marquants

- Raisonnement structuré: Claude Code résout des problèmes complexes grâce à une réflexion logique étape par étape.

- Gère des tâches complexes: Optimisé pour les tâches en plusieurs étapes telles que la conception de systèmes ou la refonte architecturale.

- Évolutivité: prend en charge la planification et l'analyse étape par étape pour les bases de code à grande échelle.

Cas d'utilisation

- Refactorisation des architectures de microservices

- Planification des tâches par étapes pour les grands projets

- Optimisation de la conception du système et des flux de travail de débogage

3. Utilisation de sous-agents spécialisés

Lien : https://github.com/wshobson/agents

Il s'agit d'un système complet, prêt pour la production, conçu pour s'intégrer à Claude Code et étendre ses capacités de manière significative.

Il combine :

- 112 agents d'IA spécialisés

- 16 orchestrateurs de flux de travail multi-agents

- 146 compétences d'agent

- 79 outils de développement

- Organisé en 72 plugins ciblés et à usage unique pour Claude Code

Chaque agent a un rôle clairement défini, tel que la conception de l'architecture backend, le développement frontend, l'optimisation de l'infrastructure cloud, les tests automatisés, les MLOps, etc., le tout configuré selon les meilleures pratiques modernes.

Installation :

git clone https://github.com/wshobson/agents.git ~/.claude/agents

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)