True ML Talks #1 - Flux de travail d'apprentissage automatique @ Gong

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Aujourd'hui, True Foundry lance une série d'études approfondies sur l'apprentissage automatique dans le cadre de laquelle nous nous entretenons avec des leaders du ML et de la science des données dans les entreprises utilisant le ML pour explorer les cas d'utilisation et les flux de travail du ML au sein de leurs organisations. Dans le cadre de cette série, nous allons héberger et approfondir le ML Stack d'entreprises telles que Gong, StichFix, SalesForce, Gusto, Simple, et bien d'autres encore.

📌

Dans cette série, nous explorons le monde de l'apprentissage automatique pour dévoiler le spectre des applications de machine learning et des configurations d'infrastructure dans tous les secteurs.

Nos conversations tourneront autour de quatre thèmes clés :

1. Cas d'utilisation de l'apprentissage automatique pour les entreprises

2. Comment ont-ils construit leur infrastructure d'apprentissage automatique, y compris le pipeline de formation et d'expérimentation, le déploiement et le service, la surveillance, et les ont-ils optimisés en termes de coûts et de latence en cours de route ?

3. Défis rencontrés lors de la mise en place d'une suite de machines virtuelles, avec des défis spécifiques liés à l'industrie

4. Un aperçu des innovations de pointe appliquées au cours du processus de création et de mise à l'échelle de l'infrastructure ML.

Pour lancer la première discussion de la série, nous avons parlé à Noam Lotner de Gong. Gong est une plateforme de renseignement fiscal. Il permet aux équipes chargées des recettes de réaliser leur plein potentiel en dévoilant la réalité des clients à partir des conversations de l'équipe des recettes. Gong analyse les interactions avec les clients par téléphone, e-mail, Web, etc., afin de fournir les meilleures informations aux équipes chargées des ventes afin qu'elles puissent les utiliser pour conclure davantage de transactions.

Noam Lotner est chef de l'équipe des opérations de recherche chez Gong. Il construit la plate-forme opérationnelle du groupe de recherche AI/ML, en automatisant les processus de publication des modèles, la gestion des expériences et les tests de performance, en développant des outils d'étiquetage et de création de jeux de données et en permettant un accès sécurisé aux sources de données de production.

Consultez notre conversation ci-dessous :

Pourquoi le ML est-il important pour Gong : une plateforme d'intelligence commerciale

Gong analyse les interactions avec les clients par téléphone, e-mail, Web, etc. L'apprentissage automatique devient d'autant plus essentiel pour analyser les interactions commerciales et fournir des informations aux équipes chargées des recettes. Les algorithmes de machine learning peuvent automatiser des tâches qui étaient auparavant effectuées manuellement, telles que l'analyse des appels vidéo, la transcription et l'analyse des appels téléphoniques commerciaux. Cela permet de gagner du temps et d'améliorer l'efficacité du processus de vente.

- Pipeline d'analyse des appels vidéo → Afin d'analyser les appels, l'équipe traite la vidéo, classe les images et effectue un certain traitement sur certains types de segments vidéo.

- Pipeline d'analyse des transcriptions audio → La voix reçoit en fait une transcription automatique ainsi qu'un autre pipeline qui implique de nombreux modèles, vérifiant où se trouve le discours, détectant quel orateur parle et quand, ainsi que le contenu de la conversation.

- Pipeline textuel basé sur la PNL → Il existe un pipeline pour extraire les informations des diapositives et des notes d'appel. Pour les e-mails, un pipeline différent de traitement NLP, de messagerie et de commentaires est utilisé.

Comment ces modèles sont-ils segmentés selon les clients ?

Bien que nous ayons posé cette question à Gong, nous constatons que toutes les entreprises SaaS :

- Modèles communs à tous les clients : Certains modèles, comme les modèles ASR, permettent la reconnaissance automatique de la parole. Cela permet de standardiser le service et de maintenir la cohérence sur l'ensemble de la plateforme

- Des modèles uniques pour chaque client : Dans le cas des startups SaaS, en particulier dans le cas d'une plateforme d'intelligence commerciale comme Gong, chaque modèle doit être unique. Ceci est fait pour garantir la confidentialité et la sécurité des données ainsi que pour proposer une personnalisation ou une personnalisation en formant le modèle sur l'ensemble de données du client. Cela s'accompagne de deux défis : la diffusion et la confidentialité des données. Étant donné que Gong permet aux clients de suivre une formation sur les modèles en fonction de leurs propres données, ils doivent exposer les interfaces ML sur leur plateforme. La séparation des données pour chaque client devient donc un défi.

📌

Nombre de modèles : Nombre de clients X Types de modèles

📌

« Nous utilisons le même modèle de base pour tout le monde. Nous permettons également aux clients de suivre une formation sur des modèles spécifiques pour leur propre contenu. »

Afin d'optimiser les coûts, Gong utilise des serveurs multimodèles dans la couche d'inférence, car exécuter des modèles séparés sur des machines distinctes signifierait un système coûteux.

Voici un blog détaillé de Gong qui parle de l'utilisation du ML dans les ventes B2B

Flux de travail du système ML chez Gong

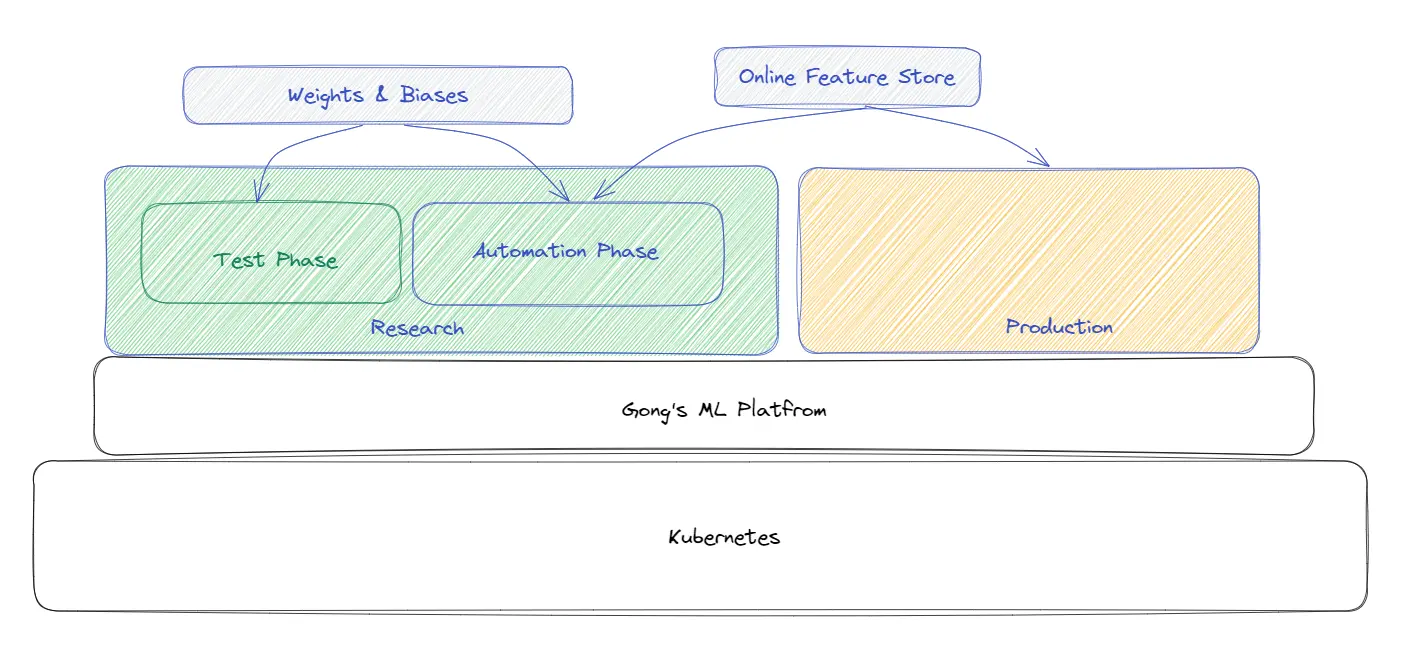

Chez Gong, le système ML est structuré selon l'organisation ML.

- Recherche: Il existe un environnement distinct pour la recherche. L'équipe travaille séparément : elle récupère les données, effectue la formation, termine la formation, publie le modèle, puis le modèle est envoyé au pipeline de déploiement, géré par l'ingénierie.

- Déploiement de la production (partie de l'ingénierie) : Le modèle entraîné est déployé en production par l'équipe d'ingénierie.

Dans ce blog (ainsi que dans une série de discussions), nous aborderons plus en détail les défis de Research Side infra pour Gong

Comment le flux de travail ML Researcher est-il configuré chez Gong ?

- Phase de test de base: Les chercheurs prennent des données et s'entraînent sur leurs propres machines ou à l'aide de machines virtuelles en extrayant des données de la production vers leur machine

- Phase d'automatisation: Une fois le modèle finalisé, un pipeline automatique est créé pour traiter les données afin de mettre la plus grande quantité de données entre les mains du chercheur.

Pour permettre aux chercheurs de faire tourner facilement les machines, l'ensemble de la pile est configuré sur Kubernetes pour le Research Infra. La plupart des modèles de l'équipe de recherche n'utilisent pas les fonctionnalités en ligne.

Nuage: La majeure partie de l'infrastructure se trouve sur AWS et fonctionne également avec d'autres fournisseurs de cloud dans une capacité légèrement inférieure.

Gestion de l'infrastructure: les pipelines utilisent en fait les modèles spécifiques à chaque client. Il y a une machine qui s'affiche et gère tous les appels de cette entreprise

Autres défis qui font du ML un problème complexe à résoudre chez Gong

- Coût: Nous l'avons également abordé plus haut. Le coût est un défi majeur pour Gong, car d'énormes quantités de données sont nécessaires pour entraîner puis réentraîner le modèle. Les ensembles de données vocales sont très volumineux (quelques centaines d'heures de parole se traduisent par quelques centaines de gigaoctets de données). Les ensembles de données NLP sont de plus petite taille, mais ils peuvent comporter de nombreuses lignes. Étant donné que la recherche est séparée de la production, cela permet à l'équipe de recherche de faire preuve de flexibilité quant à la quantité de données à utiliser pour la formation des modèles. L'équipe de recherche travaille pour permettre d'optimiser la quantité de données à utiliser lors de la formation.

- Simplification de la plateforme de machine learning: L'un des aspects importants de la simplification du processus est de masquer la complexité de la sélection du type de données à utiliser pour la formation grâce au contrôle d'accès approprié derrière les outils.

Cela se fait différemment selon les sources de données. Dans le cas d'un grand nombre de bases de données (chacune contenant un type d'information différent et chacune est accessible différemment), beaucoup de travail est fait pour créer des pipelines sécurisés qui ne permettent qu'aux personnes autorisées d'utiliser les données et de créer un journal indiquant qui a accédé aux données et dans quel but. Cela permet également aux chercheurs de mélanger et de faire correspondre les résultats provenant de différentes sources de données. - Sécurité et confidentialité des données : L'une des principales préoccupations de Gong est la sécurité et la confidentialité, c'est-à-dire s'assurer qu'il n'y a pas de fuites et qu'aucune personne n'ayant aucune autorité ne puisse accéder aux données, et qu'aucun client n'obtienne les données d'un autre client. Cela est très compliqué en raison de la grande quantité de données.

Comment Gong a résolu le problème : stocker les données dans des emplacements sécurisés, annoter chaque point de données et disposer de droits d'accès, en fonction de l'identifiant du client locataire. L'accès se fait par des mécanismes d'identification contrôlés, et tout ce qui peut être automatisé est automatisé - S'assurer qu'il n'est pas possible que les données d'un client soient intégrées à un autre modèle - En utilisant un grand modèle linguistique, il est possible de déduire quelque chose d'un client et un autre client obtient les informations privées. C'est quelque chose qui doit être pris en compte.

- La reconversion automatique n'est pas facile: Le recyclage n'est effectué que lorsqu'il existe une méthode vraiment bien maîtrisée pour effectuer toutes les étapes du pipeline. C'est très rare. Les efforts de reconversion dépendent du type de modèle. Par exemple, dans le cas d'un modèle de reconnaissance vocale pour une langue spécifique, il est assez facile de procéder à une nouvelle formation avec les mêmes paramètres sur de nouvelles données.

L'actualisation des données modifie également une grande partie du contenu et nécessite également qu'un chercheur fasse à nouveau des recherches afin de s'assurer que le nouveau modèle fonctionne réellement mieux que ce que nous avions auparavant.

Réflexions supplémentaires de Noam

Kubernetes est la solution

Tout ce qui est fait au sein de l'équipe de recherche est maintenant transféré vers Kubernetes. Une partie du travail de Noam consiste à aider son équipe à accéder automatiquement aux ressources depuis le cloud Kubernetes. Il s'agit actuellement d'un effort continu.

📌

« Je recommande à tous ceux qui se lancent dans ce domaine de réfléchir très tôt à l'échelle et à la façon dont leur groupe va fonctionner. »

« Je pense que la plupart des systèmes MLOps nécessitent Kubernetes pour gérer les ressources. Je ne vois aucune plateforme dans le futur capable de faire quoi que ce soit en rapport avec les MLOps sans utiliser Kubernetes. »

Quelques points importants à noter :

- Scale to Zero est très important en termes de gestion des coûts. Le fait d'avoir des machines qui fonctionnent sans rien faire représente une énorme baisse des coûts.

- Le système doit être agile pour gérer efficacement les problèmes de sécurité et de confidentialité. Les données doivent rester là où elles se trouvent et vous devez y apporter votre code.

MLOps : créer ou acheter

📌

« Mon point de vue est que Gong avait besoin de créer cette plateforme »

- Lors de la création, commencez par Kubernetes, une plateforme évolutive et flexible.

- Configurez tous les systèmes de manière à être prêt pour la séparation des locataires et pour l'application du RGPD. Si quelqu'un souhaite supprimer les données, vous devez les supprimer.

- Il est très important de réfléchir très tôt à la question de l'échelle. Rendez votre infrastructure agile et flexible, assurez-vous de disposer de capacités d'évolutivité et de pouvoir déployer et démarrer autant de machines que vous le souhaitez, quand vous en avez besoin. Mais faites-les abattre dès que leur idole sera.

Sécurité, sécurité, sécurité

Rien ne peut être plus important pour une entreprise SaaS que la sécurité. Le pipeline ML doit donner la priorité à la sécurité en raison de la confidentialité des données lors du traitement des données sensibles des clients et pour contrôler les accès non autorisés.

J'espère que la première série de blogs des TrueML Talks a pu vous donner des informations précieuses sur la façon dont vous pouvez envisager de créer votre infrastructure de recherche en apprentissage automatique pour alimenter vos équipes de ML. #MLOps #MachineLearning #DataScience #DevOps #ModelOps #AIInfrastructure

Lisez nos nouveaux blogues de la série

Dirigez-vous vers notre deuxième épisode des conférences TrueML où nous discutons avec le responsable de la plateforme chez Stitch. Continuez à regarder le TrueML série youtube et retrouvez tous les épisodes de la série de blogs TrueML ici -

True Foundry est un PaaS de déploiement de machine learning sur Kubernetes destiné à accélérer les flux de travail des développeurs tout en leur offrant une flexibilité totale dans les tests et le déploiement de modèles, tout en garantissant une sécurité et un contrôle complets à l'équipe Infra. Grâce à notre plateforme, nous permettons aux équipes de machine learning de déployer et surveiller des modèles en 15 minutes avec une fiabilité à 100 %, une évolutivité et la possibilité de revenir en arrière en quelques secondes, ce qui leur permet de réduire les coûts et de mettre les modèles en production plus rapidement, ce qui permet de réaliser une véritable valeur commerciale.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)