Architecture de journalisation de TrueFoundry pour AI Gateway

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Introduction : Le coût caché de l'analytique

Chaque passerelle IA du marché propose des journaux et des analyses. À première vue, ils semblent être une caractéristique standard. Mais les choix architecturaux effectués en coulisse ont des conséquences massives et cachées sur votre fiabilité, votre sécurité et vos résultats financiers. Le comment est un détail essentiel qui distingue une plateforme véritablement destinée aux entreprises d'une proposition risquée.

Lorsque nous avons décidé de fournir à nos clients des analyses rapides et évolutives, nous étions justement confrontés à ce défi. L'objectif était clair : fournir des informations puissantes via notre couche de passerelle d'intelligence artificielle sans créer de cauchemar opérationnel pour les équipes de plateforme de nos clients.

Nous avons réalisé très tôt que pour créer une solution digne de nos clients professionnels, nous devions innover au-delà de l'approche standard du secteur. Cet article détaille notre parcours depuis le puissant mais problématique ClickHouse vers une architecture native S3 ne nécessitant aucune maintenance, un système qui donne à nos clients un avantage concurrentiel puissant et durable.

Le problème : pourquoi l'expédition de ClickHouse est une activité risquée

Notre choix initial, comme beaucoup d'autres acteurs de l'industrie, s'est porté sur ClickHouse. Il s'agit d'une technologie open source phénoménale, réputée pour sa rapidité incroyable dans les requêtes analytiques. Cependant, sa puissance a un coût opérationnel élevé.

Le problème principal est le suivant : la gestion d'une base de données critique avec état telle que ClickHouse dans l'environnement cloud d'un client est un véritable champ de mines opérationnel. Pour le faire correctement, vous devez gérer :

- Haute disponibilité (HA) : Que se passe-t-il si ClickHouse tombe en panne ? Disposez-vous d'un plan de basculement fluide ?

- Reprise après sinistre (DR) : Effectuez-vous des sauvegardes régulières et vérifiées ? Qu'est-ce que l'objectif de temps de reprise (RTO) en cas de problème catastrophique ?

- Entretien : Qui est responsable des mises à niveau des versions, des correctifs de sécurité et de l'optimisation des performances ?

Ce n'est pas que théorique. Une simple erreur kubectl supprime un PV la commande pourrait effacer accidentellement le volume persistant d'un client, en effaçant définitivement tous leurs journaux historiques et leurs données de mesures. Pour toute entreprise, ce niveau de risque est tout simplement inacceptable. Nous étions en train de devenir un fournisseur géré de ClickHouse, ce qui nous a détourné de notre mission principale.

Nous avons examiné le paysage des concurrents

Nous avons fait des recherches et découvert que la plupart des plateformes de l'espace LLM Gateway ont opté pour l'un des trois compromis imparfaits.

- L'approche « boîte noire » : Ils résolvent le problème de gestion en exécutant une base de données Clickhouse dans leur propre service cloud.

Le compromis : Les clients perdent souveraineté des données. Pour utiliser la plateforme, vous êtes obligé d'envoyer vos données de journal/mesures, qui peuvent contenir des informations personnelles identifiables (PII) ou des informations commerciales exclusives, en dehors de votre environnement cloud sécurisé. Lors d'un entretien avec des entreprises clientes, nous avons estimé qu'il était extrêmement important que leurs données soient sécurisées et restent dans leur environnement cloud ou isolé, et non dans le plan de contrôle d'AI Gateway.

- L'approche « DIY » : Certaines plateformes fournissent un diagramme Helm ou un modèle et confient au client l'entière responsabilité de la gestion de sa propre instance ClickHouse.

Le compromis : La totalité de la charge opérationnelle complexe est transférée directement à l'équipe chargée de la plateforme du client, qui est déjà très occupée. Ils doivent déterminer eux-mêmes la haute disponibilité, les sauvegardes et la maintenance.

- L'approche « à échelle limitée » : Cela implique soit d'utiliser une base de données transactionnelle standard (comme Postgres) qui ne peut pas être adaptée à de lourdes charges de travail analytiques, soit de s'appuyer sur un réseau désordonné d'exportateurs tiers.

Le compromis : Cela entraîne des performances chroniquement médiocres, une expérience utilisateur fragmentée et une incapacité à fournir des informations approfondies et intégrées.

Nous les avons rejetées toutes les trois. Il devait y avoir un moyen de garantir la performance, la sécurité, et aucune charge opérationnelle. Nous l'avons donc construit.

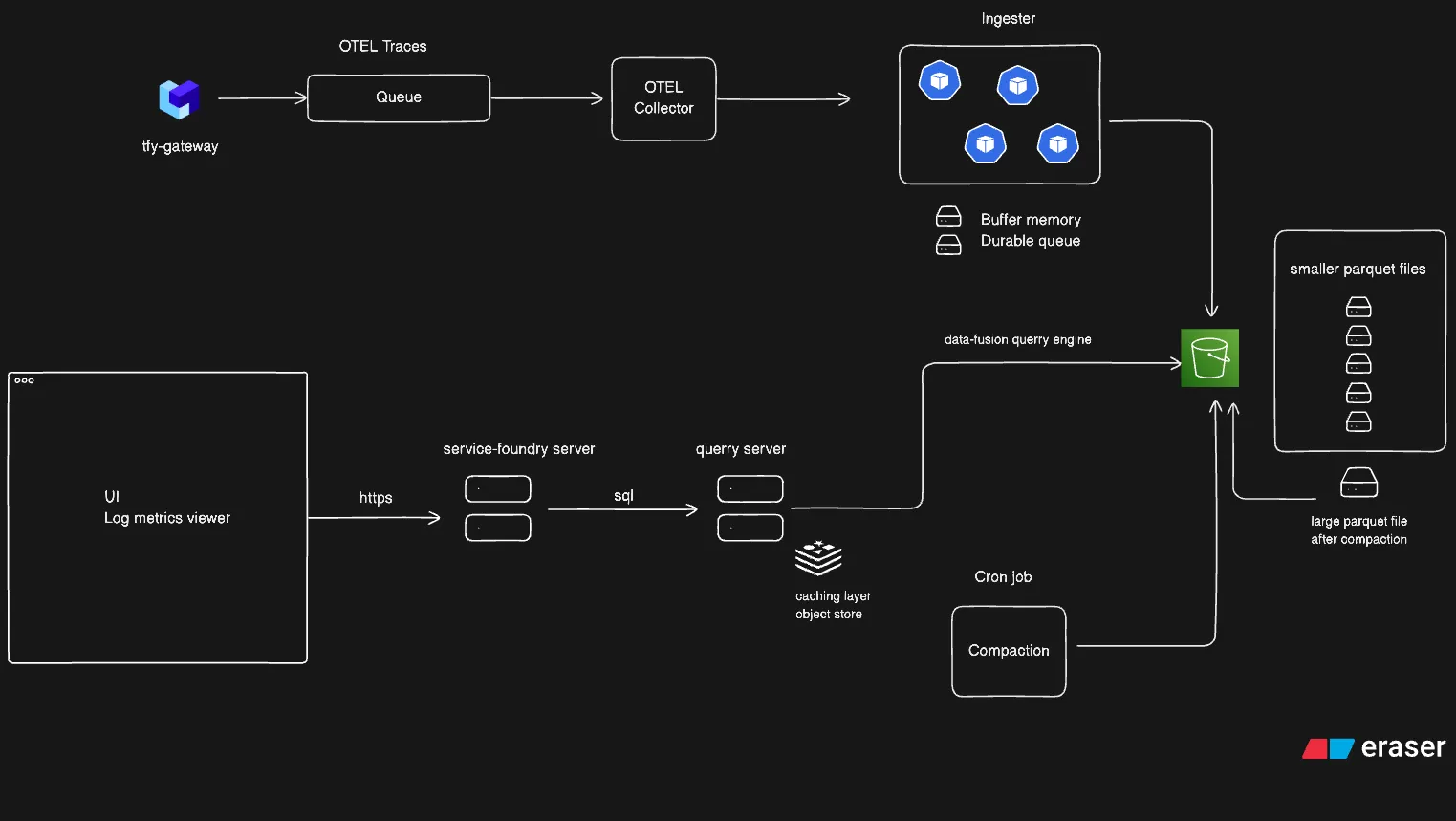

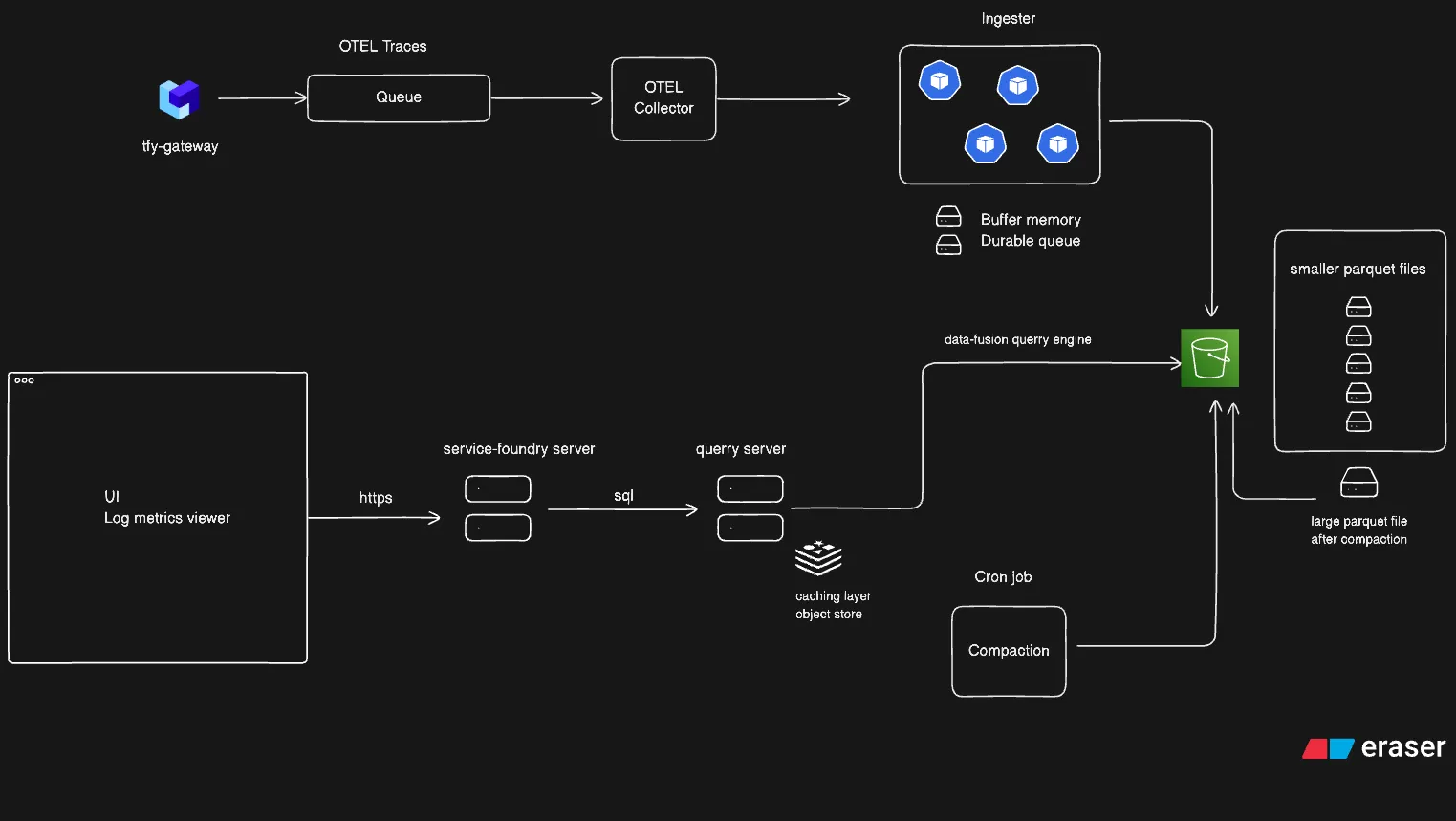

Notre architecture

Notre principe directeur était simple mais puissant : découpler le stockage et le calcul. Les données doivent être stockées de manière sécurisée et durable dans le stockage d'objets du client (comme S3), tandis qu'un moteur évolutif et autonome gère les requêtes.

La couche de stockage : votre S3 + Delta Lake

Nous avons complètement supprimé le serveur de base de données et avons fait du compartiment S3 du client la source de référence.

- Pourquoi S3 ? Il résout instantanément les problèmes de haute disponibilité, de reprise après sinistre et de sauvegarde. AWS, GCP et Azure ont investi des milliards pour rendre leurs services de stockage d'objets incroyablement durables et disponibles. Vos données sont automatiquement protégées dans votre propre environnement.

- Pourquoi choisir Delta Lake ? C'est notre recette secrète d'ingénierie. S3 n'est qu'un magasin de valeurs-clés ; il ne comprend pas intrinsèquement les transactions de base de données. C'est là qu'intervient Delta Lake. Il s'agit d'un framework de stockage open source qui intègre les transactions ACID (l'atomicité et la cohérence d'une base de données traditionnelle) à votre lac de données S3. C'est la « magie » qui permet à l'ingesteur d'écrire des données simultanément sans corruption.

- Pourquoi le format Parquet ? Toutes les données sont stockées au format Apache Parquet, un format de stockage en colonnes très efficace qui constitue la norme industrielle en matière d'analyse. Cela garantit que vous possèdent réellement vos données et peuvent y accéder avec n'importe quel outil, que ce soit la bibliothèque Spark, DuckDB ou Polars. Cela élimine complètement la dépendance vis-à-vis des fournisseurs.

Le moteur de requêtes : DataFusion d'Apache

Nous utilisons Fusion de données, un moteur de requêtes du projet Apache. Il s'agit d'un moteur moderne et sans état qui lit les fichiers Parquet directement depuis S3. Pour surmonter la latence réseau inhérente à S3, nous avons créé une couche de mise en cache multiniveaux sophistiquée (en mémoire et sur disque) qui permet de conserver les données actives prêtes à être interrogées, offrant ainsi une expérience d'interface utilisateur rapide et réactive.

Quels sont les avantages

Notre architecture se traduit par une valeur claire et convaincante qui a un impact direct sur votre entreprise.

- Aucun frais d'exploitation : Vous n'avez jamais à penser à gérer, appliquer des correctifs, faire évoluer ou sauvegarder une base de données pour vos journaux et vos métriques. Cela fonctionne tout simplement et permet à l'équipe de votre plateforme d'économiser d'innombrables heures.

- Souveraineté totale des données : Vos journaux et statistiques ne quittez jamais votre compte cloud. Vous conservez la propriété et le contrôle complets, répondant aux exigences de sécurité et de conformité les plus strictes de l'entreprise.

- Réduction du coût total de possession (TCO) : Le stockage S3 est nettement moins cher que les SSD provisionnés nécessaires à une base de données performante. Notre empreinte informatique sans état et optimisée permet de réduire encore davantage votre facture de cloud.

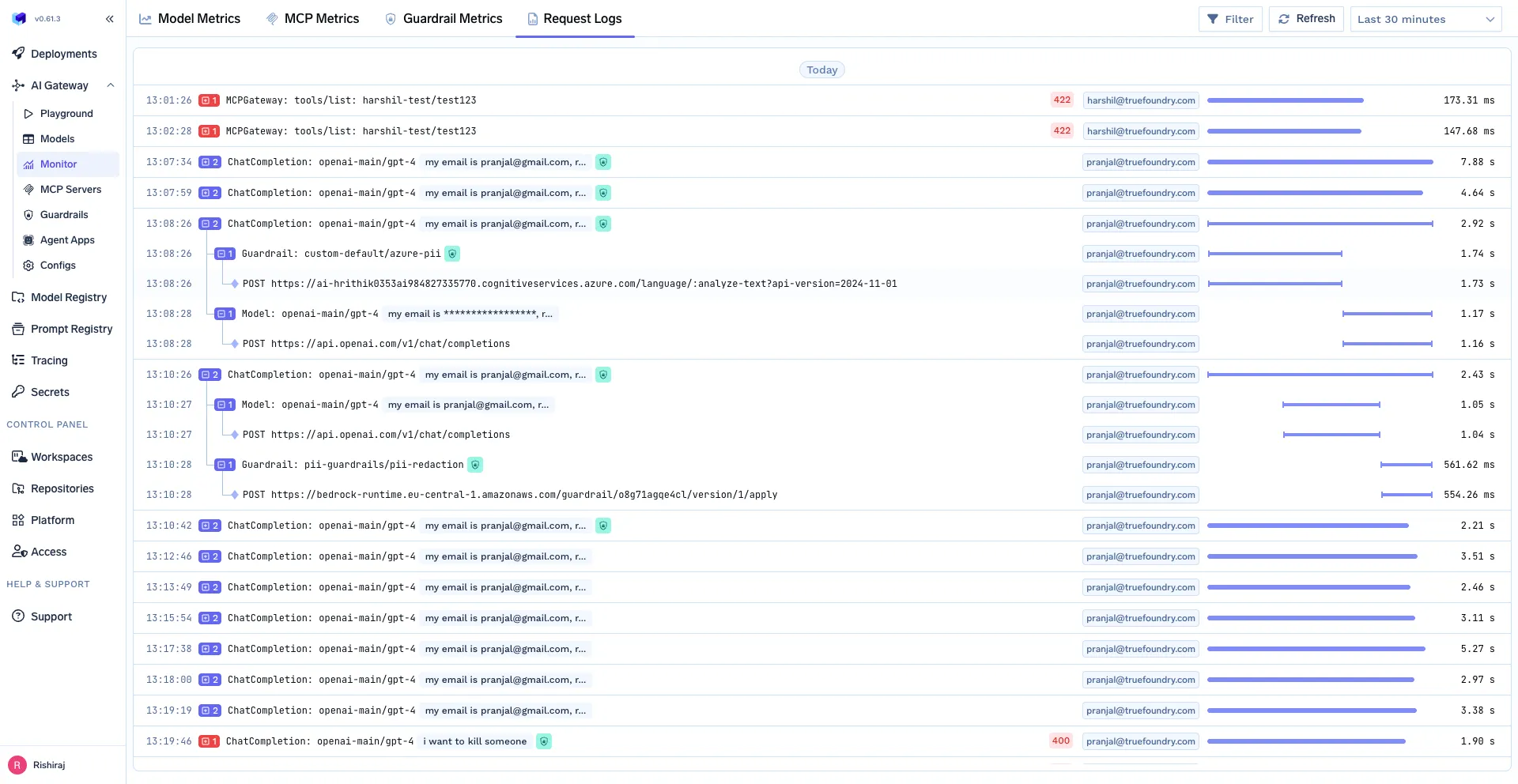

- Observabilité inégalée et normes ouvertes : Nous avons construit notre pipeline d'ingestion sur le Télémétrie ouverte (OTel) norme. Cela nous permet de fournir des informations incroyablement précises au niveau des traces, par exemple pour déterminer la latence exacte d'une vérification Guardrail par rapport à l'appel LLM lui-même. Cela vous donne également la liberté de transférer facilement ces données standardisées vers n'importe quelle autre plateforme d'observabilité telle que Datadog.

Relever la barre en matière d'observabilité en entreprise grâce à la passerelle IA de TrueFoundry

Le parcours visant à fournir des analyses prêtes à l'emploi à l'aide de notre AI Gateway a été jalonné de raccourcis alléchants et de compromis faciles. Nous avons fait face à un défi opérationnel critique, avons rejeté les solutions standard du secteur et avons conçu une architecture supérieure à partir de principes fondamentaux. Êtes-vous prêt à découvrir à quoi ressemble une passerelle IA sécurisée, sans maintenance et avec une latence inférieure à ms ? Planifiez une démonstration avec nous dès aujourd'hui.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)