Intégration de LangChain avec Truefoundry

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Boostez vos applications LangChain avec la plateforme prête à la production de TrueFoundry

LangChain est devenu un cadre puissant pour créer des applications innovantes alimentées par de grands modèles de langage (LLM). Sa modularité et ses intégrations étendues permettent aux développeurs de créer une IA conversationnelle sophistiquée, des outils d'analyse de données, etc. Cependant, le déploiement et la gestion de ces applications LangChain dans un environnement de production présentent des complexités en matière d'évolutivité, d'observabilité, de gestion des coûts et de support multi-LLM.

Cet article de blog vous expliquera comment tirer parti de TrueFoundry avec vos projets LangChain afin de créer un flux de travail fluide et efficace entre le développement et la production.

Pourquoi utiliser TrueFoundry pour vos applications LangChain ?

TrueFoundry répond aux défis critiques liés à l'exécution d'applications LangChain à grande échelle :

- Accès LLM unifié: Connectez-vous à différents fournisseurs de LLM de premier plan (OpenAI, Anthropic, et d'autres seront bientôt disponibles) via un point de terminaison d'API unique et cohérent, simplifiant les intégrations et facilitant les expérimentations.

- Déploiement de modèles sans effort: Déployez et diffusez vos modèles alimentés par Langchain avec une mise à l'échelle automatique, garantissant une haute disponibilité et une utilisation optimale des ressources sans la complexité de Kubernetes.

- Observabilité approfondie avec LLM Tracing: Bénéficiez d'une visibilité sans précédent sur les interactions LLM de votre application LangChain. Surveillez, déboguez et optimisez chaque étape de vos chaînes et de vos agents en production.

- Suivi des coûts et des performances: surveillez de près vos dépenses LLM et les indicateurs de performance de vos différents modèles, afin de prendre des décisions fondées sur des données pour optimiser les coûts et améliorer l'expérience utilisateur.

- Fiabilité adaptée à la production: implémentez sans effort des mécanismes intelligents de repli et de nouvelle tentative, garantissant la résilience et la fiabilité de vos applications LangChain dans des scénarios réels.

Démarrage rapide : connexion de LangChain à TrueFoundry

La prise en main de TrueFoundry et LangChain est incroyablement simple grâce à la compatibilité des signatures OpenAI de TrueFoundry. Vous pouvez l'intégrer de manière fluide en configurant simplement votre Chat OpenAI interface.

Installation

Tout d'abord, assurez-vous que l'intégration LangChain OpenAI est installée :

pip install langchain-openaiConfiguration de base

Connectez votre application LangChain à la passerelle LLM unifiée de TrueFoundry en mettant à jour votre Chat OpenAI modèle :

from langchain_openai import ChatOpenAI

TRUEFOUNDRY_PAT = "YOUR_TRUEFOUNDRY_PERSONAL_ACCESS_TOKEN"

TRUEFOUNDRY_BASE_URL = "YOUR_TRUEFOUNDRY_UNIFIED_ENDPOINT"

llm = ChatOpenAI(api_key=TRUEFOUNDRY_PAT,base_url=TRUEFOUNDRY_BASE_URL,model="openai-main/gpt-4o")

response = llm.invoke("What's the weather like today in Bengaluru?")

print(response.content)Points clés :

- Remplacer

« YOUR_TRUEFOUNDRY_PERSONAL ACCESS_TOKEN »avec votre TrueFoundry actuel Jeton d'accès personnel (PAT). - Set

« YOUR_TRUEFOUNDRY_UNIFIED_ENDPOINT »à l'URL de base fournie par votre configuration TrueFoundry. - Utilisez la convention de dénomination des modèles de TrueFoundry :

nom principal du fournisseur/nom du modèle. Par exemple,openai-main/gpt-4opour le GPT-4o d'OpenAI.

Avec cette configuration minimale, toutes les demandes effectuées via le llm l'objet sera automatiquement acheminé via votre passerelle TrueFoundry AI, bénéficiant de l'authentification, de l'équilibrage de charge et d'une journalisation complète.

Intégration fluide avec LangGraph

TrueFoundry s'intègre parfaitement à LangGraph, le framework de LangChain pour créer des flux de travail multi-agents et comprendre LangChain et LangGraph aide les équipes à choisir le modèle d'orchestration adapté aux systèmes d'IA de production. Configurez simplement vos nœuds LLM dans votre LangGraph pour utiliser le TrueFoundry Chat OpenAI client, et TrueFoundry gérera automatiquement l'infrastructure sous-jacente et l'observabilité.

from langchain_openai import ChatOpenAI

from langgraph.graph import StateGraph, MessagesState

from langchain_core.messages import HumanMessage

TRUEFOUNDRY_PAT = "YOUR_TRUEFOUNDRY_PERSONAL_ACCESS_TOKEN"

TRUEFOUNDRY_BASE_URL = "YOUR_TRUEFOUNDRY_UNIFIED_ENDPOINT"

def call_model(state: MessagesState):

model = ChatOpenAI(api_key=TRUEFOUNDRY_PAT,base_url=TRUEFOUNDRY_BASE_URL,model="openai-main/gpt-4o")

response = model.invoke(state["messages"])

return {"messages": [response]}

workflow = StateGraph(MessagesState)

workflow.add_node("agent", call_model)

workflow.set_entry_point("agent")

workflow.set_finish_point("agent")

app = workflow.compile()

result = app.invoke({"messages": [HumanMessage(content="Tell me a short story.")]})

print(result)Libérer l'observabilité et les informations

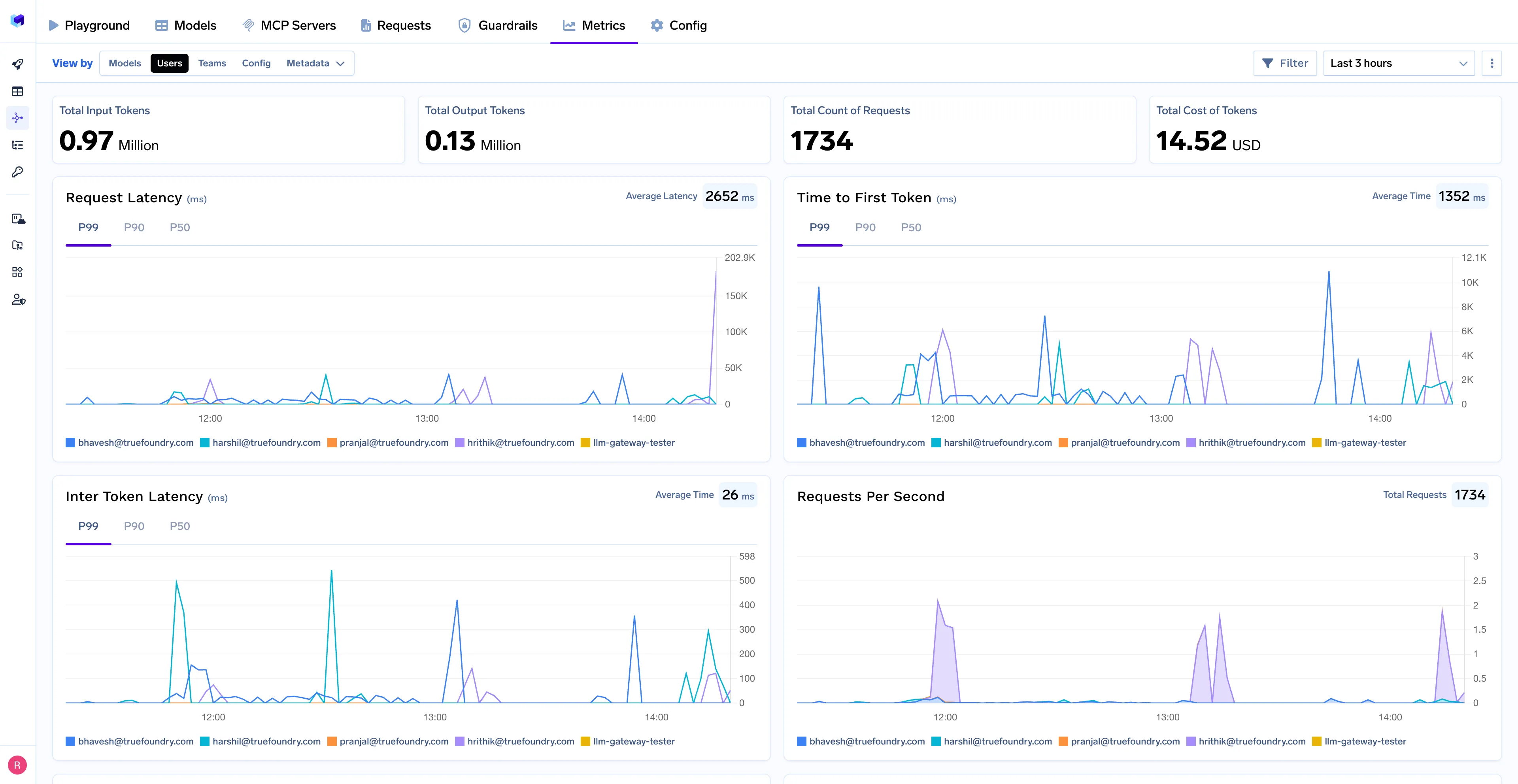

L'un des avantages les plus importants de l'utilisation de TrueFoundry avec LangChain réside dans ses capacités intégrées de surveillance et d'observabilité. Toutes les demandes transitant par la passerelle TrueFoundry AI sont automatiquement :

- Journalisation: Fournir des informations détaillées sur les demandes et les réponses.

- Traçage: vous permet de suivre le flux d'exécution de vos composants LangChain.

- Surveillance: Suivi des principaux indicateurs de performance et des coûts.

Accédez à votre tableau de bord de surveillance intuitif sur la plateforme TrueFoundry pour obtenir une visibilité complète sur le comportement de votre application LangChain en production. Explorez les journaux de requêtes, analysez les indicateurs de performance tels que la latence et l'utilisation des jetons, suivez la ventilation des coûts par modèle et identifiez les modèles d'erreur pour accélérer le débogage.

Commencez à utiliser TrueFoundry et LangChain dès aujourd'hui !

TrueFoundry fournit l'infrastructure et les outils essentiels pour faire passer vos applications innovantes LangChain du développement à la production en toute confiance et efficacité. En simplifiant l'intégration du LLM, en automatisant les déploiements et en fournissant une observabilité approfondie, TrueFoundry permet à votre équipe de se concentrer sur la création de solutions d'IA de pointe plutôt que sur la complexité de l'infrastructure.

Prêt à découvrir la puissance de TrueFoundry pour vos projets LangChain ?

- Visitez le Site web TrueFoundry pour en savoir plus et vous inscrire à un essai gratuit.

- Explorez la gamme complète Documentation TrueFoundry pour des guides détaillés et des références d'API.

- Plongez plus profondément dans Suivi LLM et Traçage LangGraph avec TrueFoundry.

Pour toute question ou assistance, n'hésitez pas à contacter l'équipe TrueFoundry à support@truefoundry.com

Exploitez tout le potentiel de vos applications LangChain avec TrueFoundry et construisez l'avenir de l'IA, dès aujourd'hui !

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)