Les 5 meilleures alternatives à Kong AI

.webp)

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

L'intelligence artificielle transforme la façon dont les entreprises développent, déploient et font évoluer leurs applications. Avec l'essor rapide des grands modèles de langage (LLM) et de l'IA générative, les développeurs ont de plus en plus besoin de plateformes fournissant accès fiable aux modèles, observabilité et opérations rentables.

Kong AI est devenue une solution de premier plan, offrant une gestion des API, une surveillance et une optimisation des flux de travail basées sur l'IA afin de rationaliser les performances des applications d'IA. Cependant, aucune plateforme unique ne répond aux besoins de toutes les organisations. Flexibilité de déploiement, sécurité de niveau entreprise, observabilité et intégration à l'infrastructure existante sont des facteurs critiques qui influencent le choix de la plateforme.

Trouver une alternative fiable à Kong aide les développeurs à découvrir des solutions mieux adaptées à leurs exigences opérationnelles, à leur infrastructure technologique et à leurs ambitions de croissance. Des passerelles open source aux plateformes d'IA d'entreprise complètes telles que TrueFoundry, il existe diverses alternatives aux passerelles Kong pour optimiser le routage, la gouvernance et l'évolutivité des modèles.

Dans cet article, nous examinerons le fonctionnement de Kong AI, ses principales fonctionnalités et les principales alternatives disponibles en 2026.

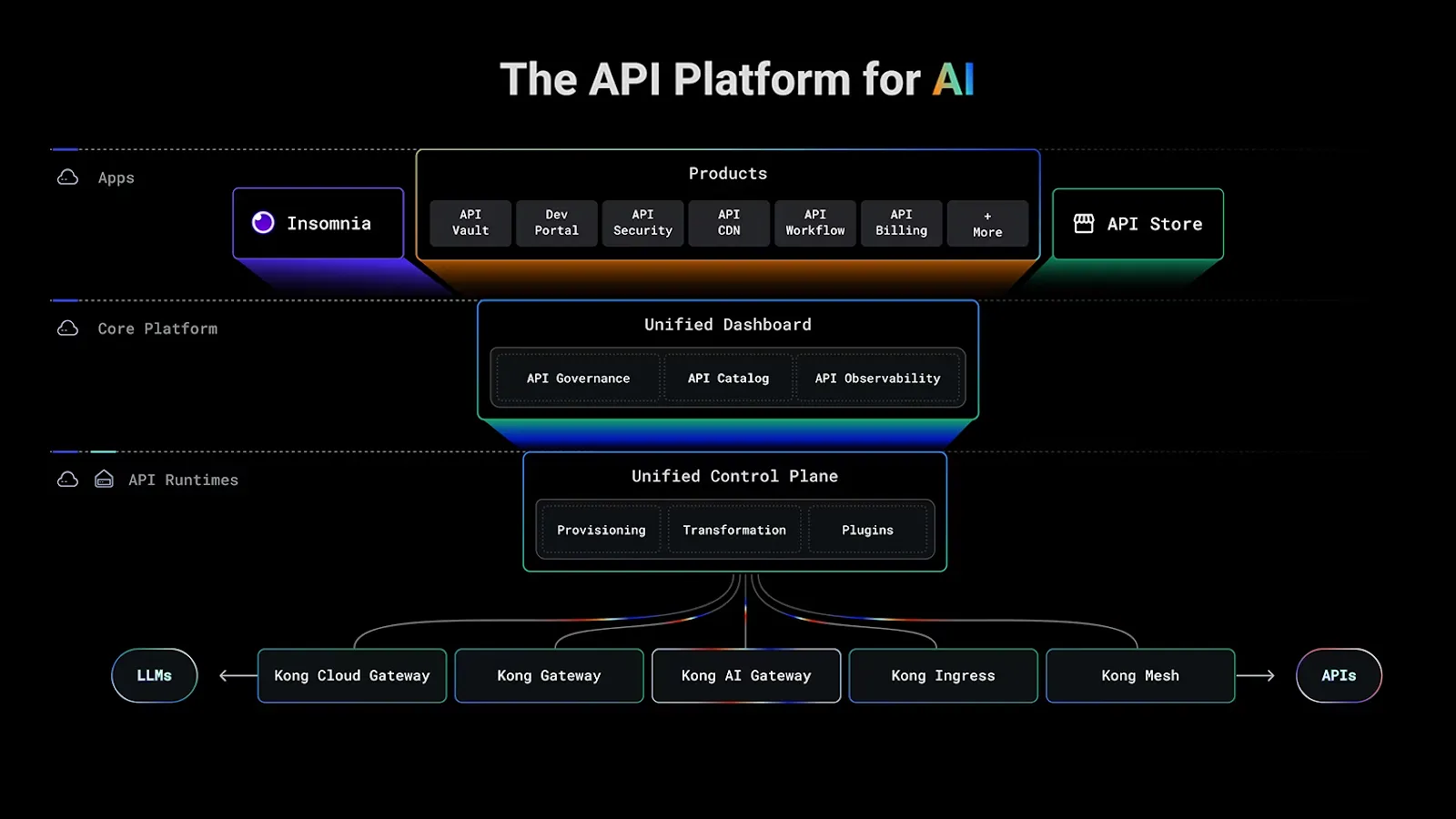

Qu'est-ce que Kong AI ?

Kong AI est une passerelle d'IA de niveau entreprise construite sur la base de Kong Gateway, conçue pour simplifier l'intégration, la gestion et la gouvernance des modèles d'IA au sein des organisations. Il fournit une plate-forme d'API unifiée qui permet aux entreprises d'exposer, d'acheminer et de surveiller en toute sécurité les services d'IA de plusieurs fournisseurs, notamment OpenAI, Azure AI, AWS Bedrock et GCP Vertex.

En centralisant la gestion du trafic d'IA, Kong AI aide les organisations à accélérer les initiatives d'IA tout en gardant le contrôle de la sécurité, de la conformité et des performances opérationnelles.

La plateforme est particulièrement adaptée aux entreprises qui ont besoin de mettre en œuvre des flux de travail d'IA avancés, de gérer plusieurs modèles linguistiques et d'appliquer des politiques de gouvernance à grande échelle. Ses fonctionnalités sont conçues pour rationaliser le développement de l'IA, réduire les frais opérationnels et améliorer la rentabilité, tout en garantissant un accès fiable et sécurisé aux ressources d'IA.

Caractéristiques principales :

Support multi-LLM : Kong AI permet une intégration fluide avec plusieurs fournisseurs d'IA, permettant aux entreprises de passer efficacement d'un modèle à l'autre pour répondre à différents cas d'utilisation ou maintenir une haute disponibilité.

Pipelines RAG automatisés : La plateforme peut créer automatiquement des pipelines de génération augmentée par extraction, améliorant ainsi la précision des réponses de l'IA et réduisant les hallucinations dans les sorties générées.

Assainissement des informations personnelles et sécurité rapide : Kong AI renforce la sécurité et la conformité du contenu en nettoyant les données sensibles et en mettant en œuvre des règles de sécurité rapides dans toutes les interactions avec l'IA.

Intégrations d'IA sans code : Les développeurs peuvent enrichir, transformer ou augmenter le trafic des API à l'aide des LLM compatibles sans écrire de code, ce qui permet un déploiement rapide des fonctionnalités d'IA dans les applications.

Gestion avancée du trafic : La mise en cache sémantique, le routage et l'équilibrage de charge optimisent le trafic d'IA, réduisent les appels d'API redondants et contrôlent les coûts, tandis que les fonctionnalités d'observabilité fournissent des informations exploitables sur les performances et l'utilisation.

Kong AI prend également en charge les protocoles de contrôle des modèles (MCP), permettant un déploiement sécurisé, fiable et évolutif de serveurs d'IA. Ses outils d'analyse et d'observabilité permettent aux équipes de suivre la consommation d'IA, d'optimiser les coûts et de surveiller les performances de toutes les charges de travail d'IA.

Lisez également : Kong contre LiteLM

Comment fonctionne Kong AI ?

Kong AI s'appuie sur l'architecture de base de Kong Gateway, en ajoutant des couches et des plugins spécifiques à l'IA gérer, sécuriser et optimiser le trafic vers les grands modèles linguistiques (LLM). Kong AI agit comme une passerelle intelligente entre vos applications et les grands modèles de langage (LLM), gérant les demandes, appliquant des politiques et optimisant les performances. Au lieu d'envoyer des demandes directement à un fournisseur de modèles, Kong AI les intercepte, applique des règles et achemine le trafic de manière efficace tout en capturant des mesures et en suivant l'utilisation.

Il s'appuie sur un framework basé sur des plugins qui peut :

- Validez et nettoyez les instructions pour garantir la conformité et la sécurité des données.

- Injectez dynamiquement le contexte pertinent à partir de bases de données vectorielles, améliorant ainsi la fiabilité du modèle.

- Acheminez les demandes sur plusieurs modèles en fonction de la latence, du coût ou de la similitude sémantique.

- Mettez en cache les demandes répétées afin de réduire les appels redondants et de réduire les coûts.

En outre, Kong AI fournit observabilité et analyse, y compris l'utilisation des jetons, la latence, le suivi des erreurs et les tableaux de bord de performance. Cette combinaison de routage, de gouvernance, de mise en cache et de surveillance permet aux développeurs de déployer des applications d'IA de manière fiable tout en maîtrisant les coûts.

Pourquoi explorer les alternatives à Kong AI ?

Bien que Kong AI Gateway propose des fonctionnalités robustes pour gérer et sécuriser le trafic d'IA, il se peut qu'il ne réponde pas aux besoins spécifiques de chaque organisation. Certaines équipes ont besoin d'une intégration plus poussée avec les frameworks agentiques, d'une observabilité plus flexible ou d'un contrôle plus précis de l'orchestration des modèles au-delà de la gestion au niveau de l'API. D'autres peuvent préférer les plateformes open source qui permettent une plus grande personnalisation ou une plus grande liberté d'auto-hébergement sans contraintes de licence pour les entreprises.

En outre, la force de Kong AI réside dans sa gouvernance des API et sa conformité d'entreprise, qui peuvent sembler complexes ou excessives pour les petites équipes qui se concentrent uniquement sur l'expérimentation LLM ou sur des charges de travail légères.

Les considérations de coût et les frais de déploiement peuvent également inciter les équipes à évaluer des LLMOP ou des outils d'infrastructure d'IA spécialement conçus pour permettre une configuration plus rapide et une plus grande compatibilité avec les écosystèmes.

L'exploration d'alternatives permet aux entreprises de choisir la plateforme la mieux adaptée à leur stack d'IA, que la priorité soit accordée à l'évolutivité, à l'agilité des développeurs, à la rentabilité ou à l'observabilité du modèle de bout en bout.

Les 4 meilleures alternatives à Kong AI

Alors que Kong AI offre une gouvernance et une observabilité robustes, plusieurs plateformes proposent désormais des fonctionnalités d'orchestration et de passerelle d'IA plus avancées. Ces alternatives offrent une plus grande flexibilité, un routage multimodèle et un contrôle plus complet des charges de travail basées sur l'IA. Vous trouverez ci-dessous les quatre principales plateformes à l'origine de cette évolution.

1. True Foundry

True Foundry permet aux entreprises de gouverner, de déployer, de faire évoluer et d'observer l'IA agentique à l'aide d'une plateforme unifiée de bout en bout. Contrairement aux solutions ponctuelles qui gèrent uniquement l'orchestration ou l'hébergement de modèles, TrueFoundry crée une solution complète qui prend en charge une IA sécurisée, conforme et performante à grande échelle. Il est natif de Kubernetes et conçu pour répondre aux besoins des entreprises dans des environnements hybrides, VPC, sur site ou isolés.

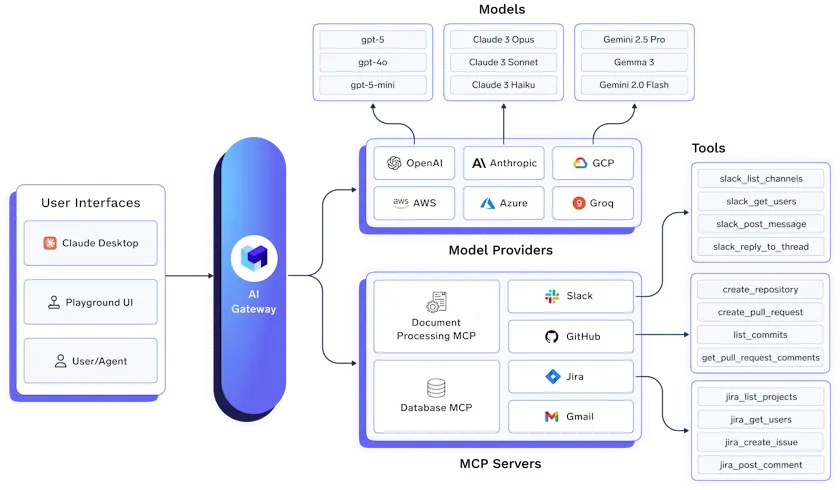

Orchestrez avec AI Gateway

Passerelle IA de TrueFoundry fournit un protocole centralisé pour les flux de travail des agents. Il gère la mémoire, l'orchestration des outils et le raisonnement en plusieurs étapes, permettant aux agents de planifier des actions, d'appeler des outils externes et de maintenir l'état contextuel avec une visibilité et un contrôle complets.

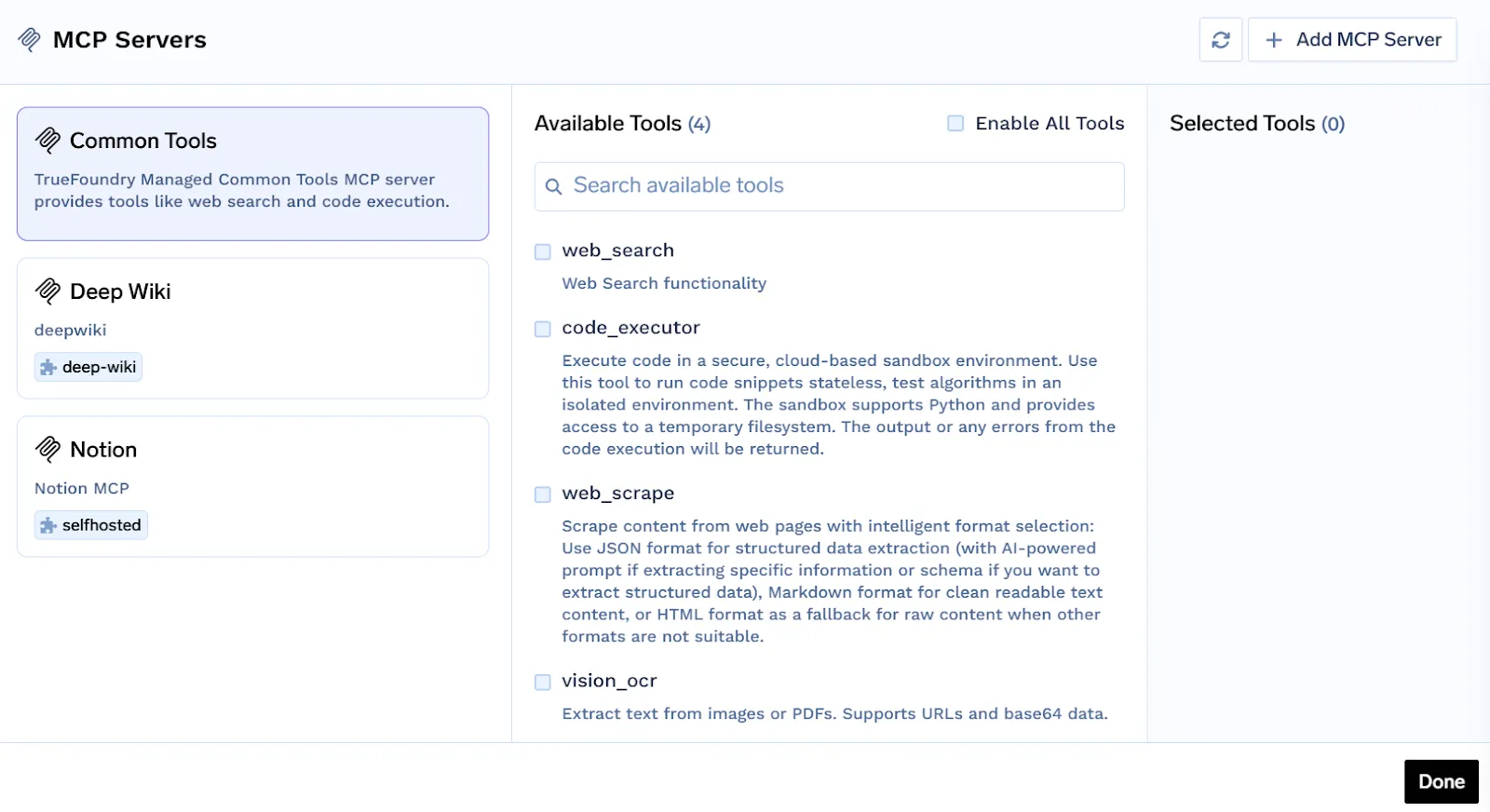

MCP et gestion rapide du cycle de vie

Le Registre des MCP et des agents gère une bibliothèque structurée d'outils et d'API avec validation des schémas et contrôles d'accès précis. En combinaison avec la gestion rapide du cycle de vie, les équipes peuvent modifier, tester et surveiller les instructions afin de garantir un comportement cohérent et vérifiable des agents.

Pour en savoir plus sur le fonctionnement interne d'un registre d'agents d'IA, lisez notre guide détaillé sur ce qu'est un registre d'agents IA.

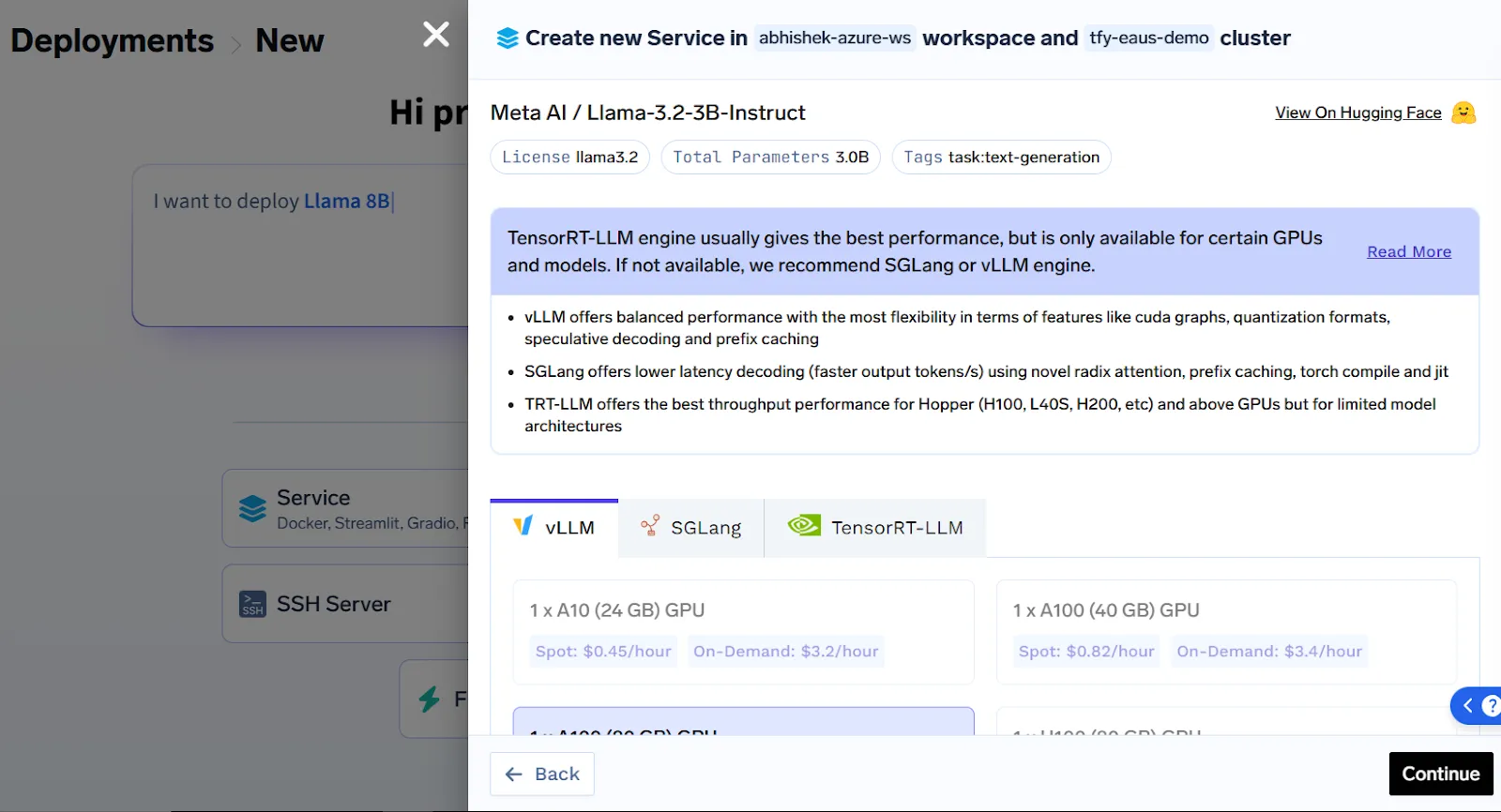

Déployez n'importe quel modèle, n'importe quel framework

Les entreprises peuvent héberger n'importe quel modèle de LLM ou d'intégration à l'aide de backends optimisés tels que vLLM, TGI ou Triton. Le réglage fin est intégré au flux de travail pour former sur des données propriétaires et déployer des points de contrôle mis à jour. Les agents basés sur LangGraph, CrewAI, AutoGen ou des frameworks personnalisés sont entièrement pris en charge et conteneurisés pour la production.

Conformité et observabilité au niveau de l'entreprise

TrueFoundry peut fonctionner dans des environnements VPC, sur site, hybrides ou isolés, garantissant ainsi un contrôle total des données. Il est conforme aux normes SOC 2, HIPAA et RGPD et prend en charge le SSO, le RBAC et la journalisation d'audit immuable. L'observabilité inclut le traçage complet des agents, la surveillance de l'utilisation du GPU et du processeur, l'état des nœuds et le comportement de dimensionnement. Les métriques peuvent être intégrées à Grafana, Prometheus ou Datadog.

Optimisé en termes d'échelle et de coût

La plateforme fournit Orchestration du GPU, prise en charge du GPU fractionné et mise à l'échelle automatique en temps réel pour optimiser l'utilisation et minimiser les coûts. Des entreprises comme NVIDIA signalent une amélioration de 80 % de l'efficacité des clusters GPU grâce à l'automatisation et aux flux de travail agentiques de TrueFoundry.

En unifiant l'orchestration, le déploiement, la conformité et l'observabilité, TrueFoundry fournit une plateforme d'entreprise complète permettant de créer et de faire évoluer l'IA agentique en toute confiance.

Alors que Kong AI gère le trafic des API, TrueFoundry régit le cycle de vie complet de l'IA , de la mise à disposition des modèles à la surveillance des agents, ce qui en fait la solution idéale pour les déploiements à l'échelle de l'entreprise.

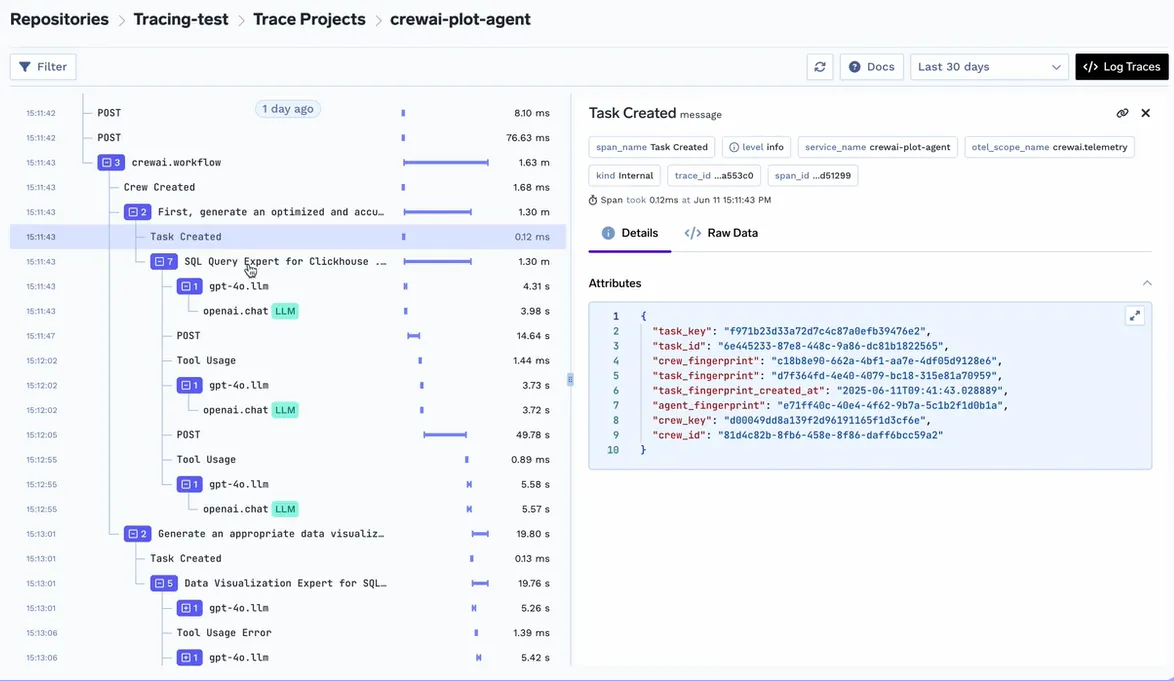

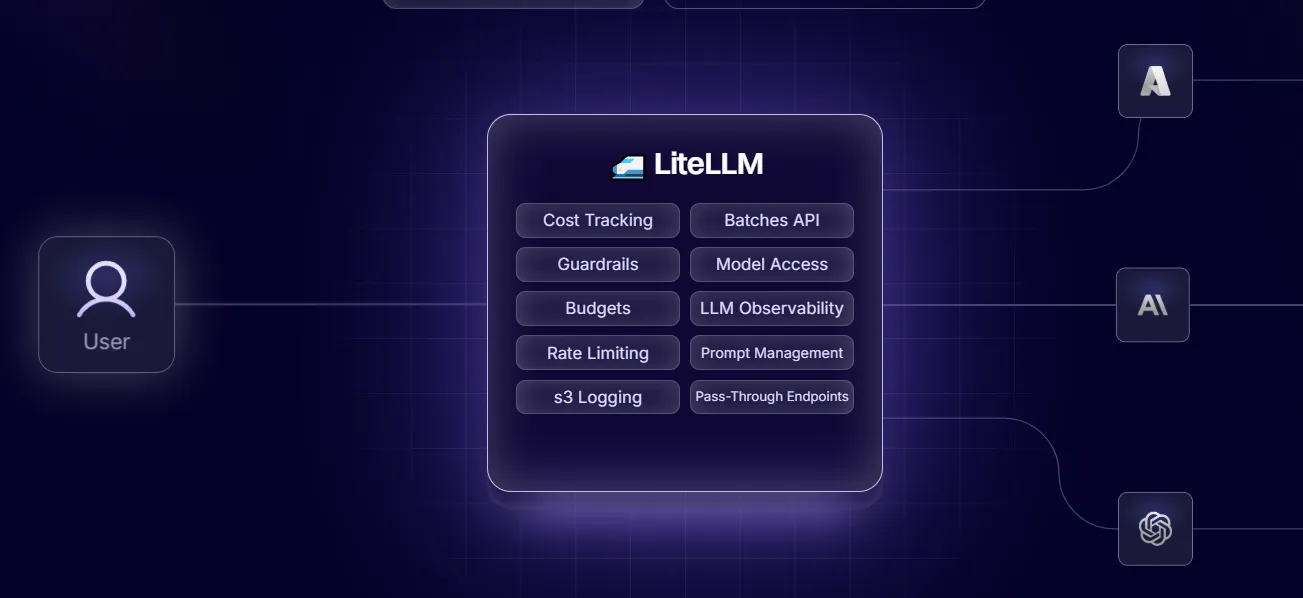

2. LitellM

LiteLM est une plateforme légère qui permet aux développeurs de gérer, de surveiller et d'optimiser les demandes LLM dans les environnements de production. Il met l'accent sur la mise en cache sémantique et l'utilisation efficace des jetons afin de réduire les coûts opérationnels. LiteLM fournit une observabilité détaillée, y compris l'enregistrement des demandes, le suivi de la latence et des mesures de performance.

Il prend en charge plusieurs fournisseurs LLM tels que OpenAI, Anthropic et Google Gemini, offrant une flexibilité pour les applications multimodèles. Son architecture adaptée aux conteneurs permet un déploiement et une évolutivité rapides sans gestion d'infrastructure lourde. La plateforme est idéale pour les équipes qui recherchent un moyen simple mais efficace de standardiser les opérations d'IA.

Caractéristiques principales :

- API unifiée pour plusieurs fournisseurs de LLM

- Mise en cache sémantique pour réutiliser les réponses et réduire les coûts

- Enregistrement des demandes et suivi des mesures de performance

- Déploiement facile dans des environnements conteneurisés

- Supporte OpenAI, Anthropic, Google Gemini et autres

Si vous avez besoin de fonctionnalités ou d'échelles différentes, vous pouvez explorer certaines alternatives à LiteLM.

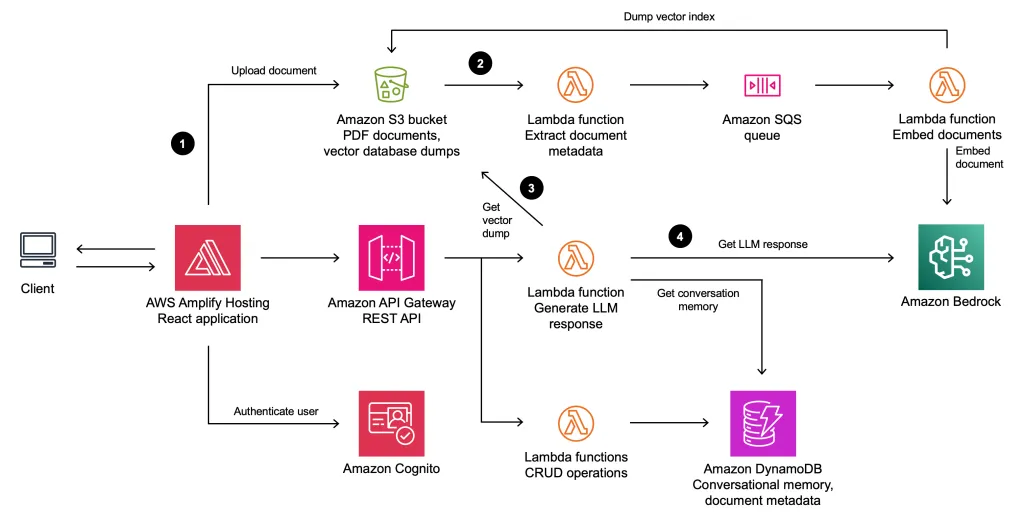

3. AWS Bedrock

AWS Bedrock est un service d'IA entièrement géré conçu pour aider les entreprises à créer des applications à l'aide de modèles de base sans gérer l'infrastructure sous-jacente. Il donne accès à plusieurs modèles, notamment Anthropic, AI21 et Amazon Titan. La plateforme garantit une sécurité et une conformité de niveau professionnel, en s'intégrant parfaitement aux outils d'identité et de surveillance d'AWS. Bedrock simplifie l'expérimentation multimodèle en centralisant le routage, la journalisation et la surveillance des coûts. Il est optimisé pour les charges de travail à grande échelle et les déploiements de production, permettant aux développeurs de se concentrer sur le développement d'applications d'IA plutôt que sur la gestion de l'infrastructure.

Caractéristiques principales :

- Accès aux modèles de fondation d'Anthropic, AI21, Amazon Titan, etc.

- Infrastructure entièrement gérée pour les charges de travail liées à l'IA

- Gestion intégrée de la sécurité, de la conformité et des identités

- Expérimentation multimodèle avec des informations sur les coûts et les performances

- Intégration facile à l'écosystème AWS et aux outils d'analyse

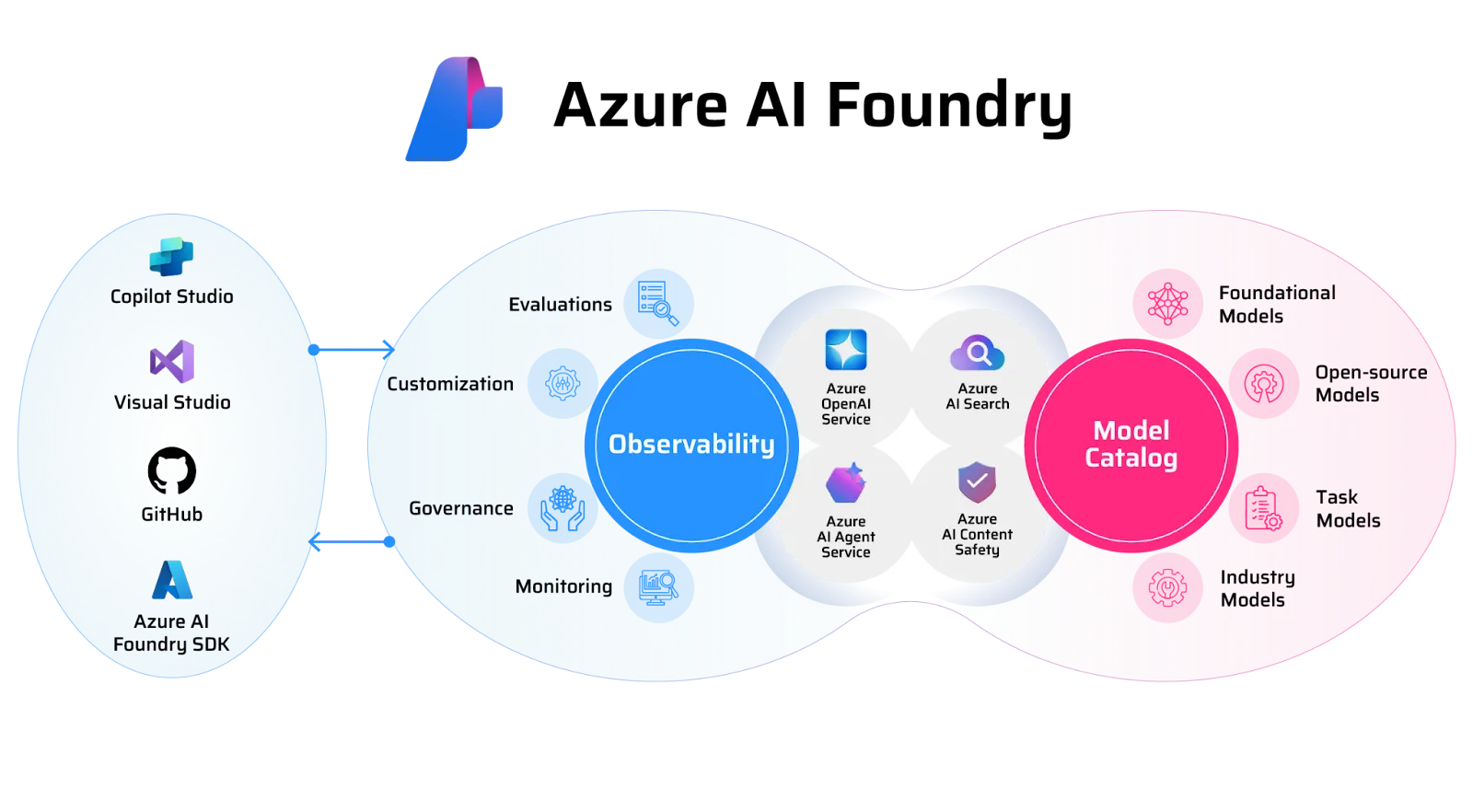

4. Azure AI Foundry

Azure AI Foundry est la plateforme cloud native de Microsoft pour le déploiement, la surveillance et la gestion des applications d'IA. Il fournit un accès sécurisé à Azure OpenAI Service et à des modèles personnalisés tout en offrant un contrôle centralisé des charges de travail d'IA. La plateforme garantit la conformité de l'entreprise aux normes SOC 2, HIPAA et GDPR.

Azure AI Foundry inclut des fonctionnalités d'observabilité telles que le suivi des requêtes et des jetons, la surveillance de la latence et l'analyse de l'utilisation. Les options de déploiement hybrides permettent aux entreprises d'exécuter des charges de travail sur site, dans le cloud ou dans plusieurs régions. Il est idéal pour les entreprises qui ont besoin d'une infrastructure d'IA sécurisée, évolutive et prête à la gouvernance.

Caractéristiques principales :

- Supporte le service Azure OpenAI et les LLM personnalisés

- Gouvernance et contrôle d'accès centralisés pour les charges de travail liées à l'IA

- Observabilité et télémétrie pour les modèles et les instructions

- Prise en charge du déploiement hybride et multicloud

- Conformité des entreprises aux normes SOC 2, HIPAA et RGPD

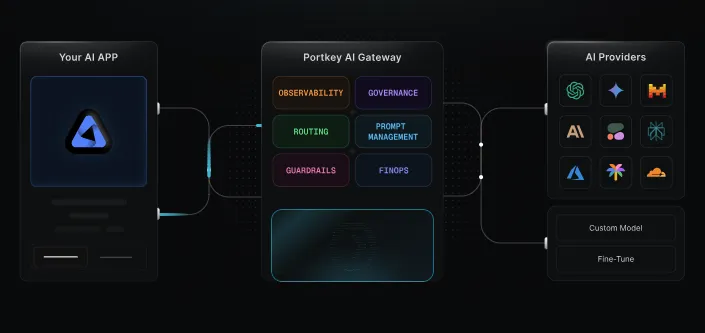

5. Clé de port

Portkey est une passerelle d'IA dédiée conçue pour préparer la production de grands modèles linguistiques (LLM) en mettant l'accent sur le routage « intelligent » et une observabilité approfondie. Alors que Kong AI aborde le problème du point de vue traditionnel de la gestion des API, Portkey est conçu de manière native pour la couche application, offrant aux développeurs un contrôle granulaire sur les invites, les jetons et le comportement des modèles.

Pour les équipes qui ont besoin d'optimiser les coûts sans sacrifier les performances, la mise en cache sémantique et l'équilibrage de charge des requêtes de Portkey constituent une alternative légère mais puissante aux passerelles d'entreprise plus lourdes.

Caractéristiques principales :

- Achemine les demandes de manière dynamique en fonction de la latence, du coût, du niveau d'utilisateur ou de la complexité des demandes

- Réduit les coûts et la latence en mettant en cache les réponses pour des requêtes sémantiquement similaires

- Garantit une haute disponibilité grâce à des nouvelles tentatives et à des basculements automatisés pour les fournisseurs défaillants

- Fournit une observabilité détaillée de l'utilisation des jetons, des coûts et de la latence pour chaque demande

Comment choisir la bonne passerelle IA ?

Le choix d'une alternative à Kong AI dépend de votre infrastructure spécifique et de la complexité de vos applications d'IA. Utilisez ces trois questions pour prendre une décision :

1. Où doivent se trouver vos données ?

- Conformité stricte (VPC/sur site) : Si vous gérez des données sensibles (comme les soins de santé ou les finances) et que vous avez besoin de vous conformer au GDPR/HIPAA, donnez la priorité aux plateformes qui proposent un déploiement auto-hébergé ou « apportez votre propre cloud ».

- Rapidité et facilité (Saas/natif du cloud) : Si votre priorité est le développement rapide et que vous n'êtes pas soumis à des contraintes strictes en matière de résidence des données, les solutions cloud gérées ou les passerelles SaaS légères vous permettront d'avancer plus rapidement avec moins de maintenance.

2. Gérez-vous des API ou des agents ?

- Routage API de base : Si vous devez uniquement acheminer des messages texte vers des modèles tels que GPT-4, recherchez des passerelles axées sur la latence, la mise en cache et le contrôle des coûts.

- Flux de travail des agences : Si vous créez des agents autonomes qui utilisent des outils, de la mémoire et un raisonnement en plusieurs étapes, vous avez besoin d'une plateforme qui offre un « traçage des agents » approfondi et une observabilité, et pas seulement une simple journalisation des API.

3. Quelle est l'importance de la neutralité vis-à-vis des fournisseurs ?

- Flexibilité multimodèle : Si vous souhaitez basculer entre les modèles OpenAI, Anthropic et open source pour trouver le meilleur prix, choisissez une passerelle indépendante qui regroupe ces fournisseurs en une seule API.

- Intégration de l'écosystème : Si l'ensemble de votre infrastructure se trouve déjà sur un fournisseur de cloud majeur (comme AWS ou Azure), l'utilisation de sa passerelle IA native peut réduire les problèmes d'intégration, même si cela limite vos choix de modèles.

Conclusion

Kong AI Gateway est une solution puissante pour gérer le trafic d'IA, garantir la sécurité et fournir une observabilité dans des environnements multi-LLM. Cependant, les entreprises ont des besoins variés, qu'il s'agisse d'un routage multimodèle léger ou d'une orchestration et d'une conformité de niveau professionnel.

Des plateformes telles que TrueFoundry, LiteLM, AWS Bedrock et Azure AI Foundry proposent des alternatives qui répondent à des lacunes spécifiques, notamment le traçage des agents, la gestion rapide du cycle de vie et l'optimisation des GPU. Le choix de la bonne plateforme dépend de l'évolutivité, de la flexibilité du déploiement et des exigences de gouvernance. L'exploration de ces alternatives permet aux équipes de créer des applications d'IA fiables, efficaces et sécurisées adaptées à leurs objectifs opérationnels et commerciaux.

Êtes-vous prêt à aller au-delà des passerelles API de base ? Passez à TrueFoundry pour bénéficier d'une plateforme unifiée qui régit l'ensemble du cycle de vie de votre IA, du déploiement efficace des modèles à l'orchestration des GPU, en passant par une observabilité agentique complète. Réservez une démo dès aujourd'hui pour faire évoluer les opérations d'IA de votre entreprise en toute confiance.

Questions fréquemment posées sur les alternatives à Kong AI

Quelle est la meilleure alternative à Kong AI ?

Si vous recherchez une alternative robuste à Kong, TrueFoundry propose une plateforme unifiée pour les grandes entreprises. Contrairement à un outil de gestion d'API standard, il gère les modèles d'apprentissage automatique et le routage du trafic avec des options de déploiement flexibles, améliorant ainsi la gestion du cycle de vie de l'IA bien mieux que de simples passerelles.

Kong est-il une bonne passerelle d'IA ?

Alors que la passerelle d'API Kong fournit un contrôle du trafic, une limitation du débit et des politiques de sécurité solides, nombreux sont ceux qui recherchent une alternative à KongHQ pour l'IA. Alors que Kong AI régit le trafic des API, TrueFoundry gère l'ensemble du cycle de vie de l'IA, du service des modèles à la surveillance des agents, ce qui en fait la solution idéale pour les déploiements au niveau des entreprises.

Quels produits sont similaires à Kong Gateway ?

Lors de l'évaluation des alternatives à la passerelle Kong, vous trouverez des options open source telles qu'Apache APISIX et Gloo Edge. Pour les utilisateurs du cloud, AWS API Gateway (sur Amazon Web Services) et Azure API Management (sur Microsoft Azure) offrent la sécurité des API et la gestion des accès, mais TrueFoundry simplifie l'ensemble du cycle de vie de l'IA.

Qui sont les concurrents de la passerelle Kong AI ?

Les principaux concurrents de Kong sont Red Hat et Google Cloud, qui stimulent la transformation numérique. Des plateformes telles que la plateforme Anypoint de MuleSoft se concentrent sur la monétisation et l'analyse des API. Cependant, pour les besoins d'intégration complexes dans le monde de la gestion du cycle de vie de l'IA, TrueFoundry fournit une plateforme d'entreprise de qualité supérieure.

Est-ce que Gloo Gateway est équivalent à Kong Gateway ?

Gloo est un puissant concurrent de KongHQ qui propose des fonctionnalités de sécurité et l'application de politiques pour les clés API. Alors que Gloo possède des fonctionnalités uniques, Kong privilégie la facilité d'utilisation. TrueFoundry équilibre les deux, évitant une courbe d'apprentissage abrupte tout en prenant en charge les meilleures pratiques pour une utilisation professionnelle.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)